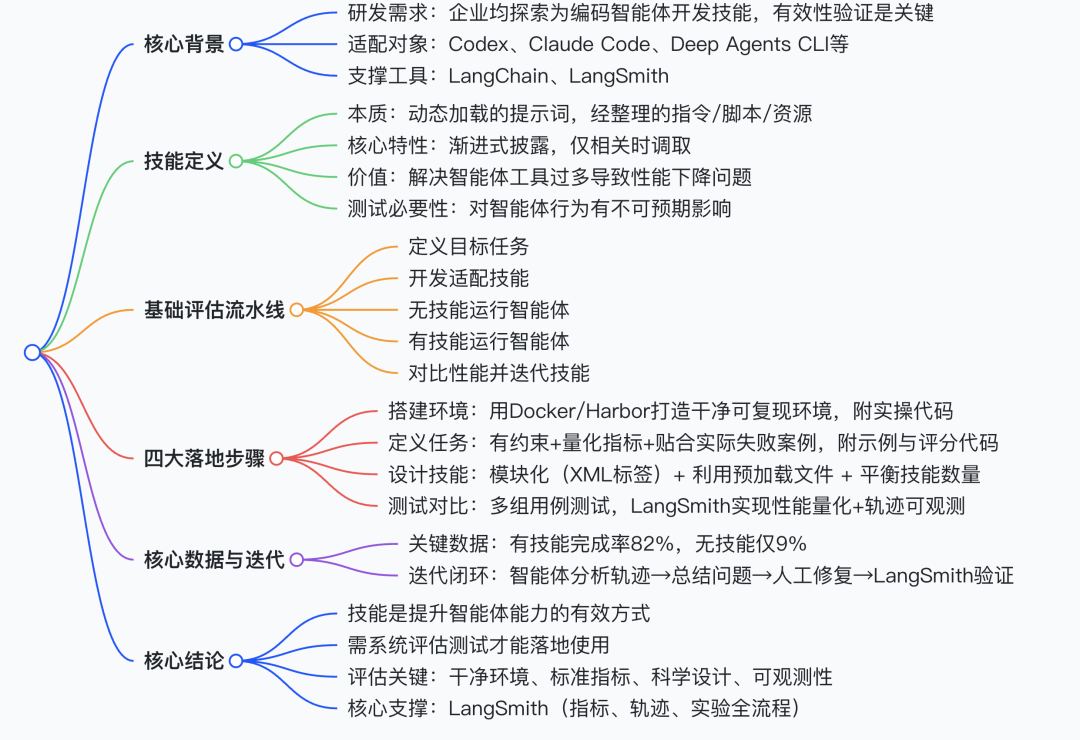

LangChain:编码智能体技能评估5步法,Claude Code效率提升91%!

编者摘要:2026 年 3 月 LangChain 发布的这篇博客,核心分享了编码智能体技能的定义、标准化评估流水线及实操最佳实践,旨在解决技能研发中的有效性验证问题。技能是为提升智能体特定领域性能、通过渐进式披露动态加载的指令 / 脚本 / 资源,本质为动态提示词,因会影响智能体行为,需像测试 LLM 提示词一样系统评估。

博客提出五步基础评估流水线:定义目标任务、开发适配技能、对比智能体有无技能的任务执行表现,进而迭代技能。落地核心分为四大步骤,且全程以 LangSmith 为核心工具支撑:一是搭建 Docker 等干净可复现的测试环境,消除智能体启动条件敏感的影响;二是基于实际失败案例设计有约束的任务,搭配技能调用情况、任务完成度等量化指标,避免过度设计任务难度;三是科学设计技能,通过 XML 标签实现模块化、依托 AGENTS.md 提升调用可靠性、平衡技能数量与内容分布;四是设计多组测试用例对比性能,借助 LangSmith 捕获智能体执行轨迹,实现可观测性,让智能体自主分析失败原因,形成研发迭代闭环。

测试数据显示,Claude Code 有技能时任务完成率达 82%,无技能仅 9%。博客最终指出,技能是提升编码智能体能力的有效方式,而干净的测试环境、标准化任务指标、科学的技能设计及基于 LangSmith 的可观测性,是搭建评估流水线的关键,量化评估与可观测性更是技能高效迭代的核心

这篇发布于 2026 年 3 月 5 日的 LangChain 官方博客,由 Robert Xu 撰写,核心围绕编码智能体(Coding Agent)的技能(Skills)评估展开,详细定义了技能的概念,提出了技能评估的基础流水线,并分享了落地该流水线的四大核心步骤与最佳实践,同时结合 LangSmith 平台的能力,阐述了如何实现技能的高效测试与迭代,以下是内容的详细总结:

一、背景与技能(Skills)的定义

-

研发背景

LangChain 为 Codex、Claude Code、Deep Agents CLI 等编码智能体打造适配 LangChain/LangSmith 生态的技能,而技能的有效性验证是研发核心;目前几乎所有企业都在探索为编码智能体开发技能,技能评估成为通用需求。

-

技能的定义

是经整理的指令、脚本和资源,用于提升智能体在特定领域的性能,核心特性为渐进式披露的动态加载—— 仅当技能与当前任务相关时,智能体才会调取,解决了 “给智能体过多工具导致性能下降” 的问题。

-

技能的本质与测试必要性

实际可视为智能体需要时动态加载的提示词(Prompt),其会对智能体行为产生不可预期的影响,因此需像测试 LLM 提示词一样,验证 “哪些技能能提升性能”“哪些内容修改的优化效果最显著”。

二、技能评估的基础流水线

LangChain 提出的标准化评估流程共 5 步,核心是对比智能体在 “有无技能” 下的表现,并持续迭代技能:

- 定义希望 Claude Code 等编码智能体完成的目标任务;

- 开发适配这些任务的对应技能;

- 让智能体在无技能的情况下执行任务;

- 让智能体在有技能的情况下执行相同任务;

- 对比两次执行的性能表现,对技能进行优化迭代。

三、技能评估的四大步骤与最佳实践

博客将基础流水线落地为四大可执行步骤,每个步骤均给出实操指南、避坑点和代码 / 案例示例,是全文的核心内容。

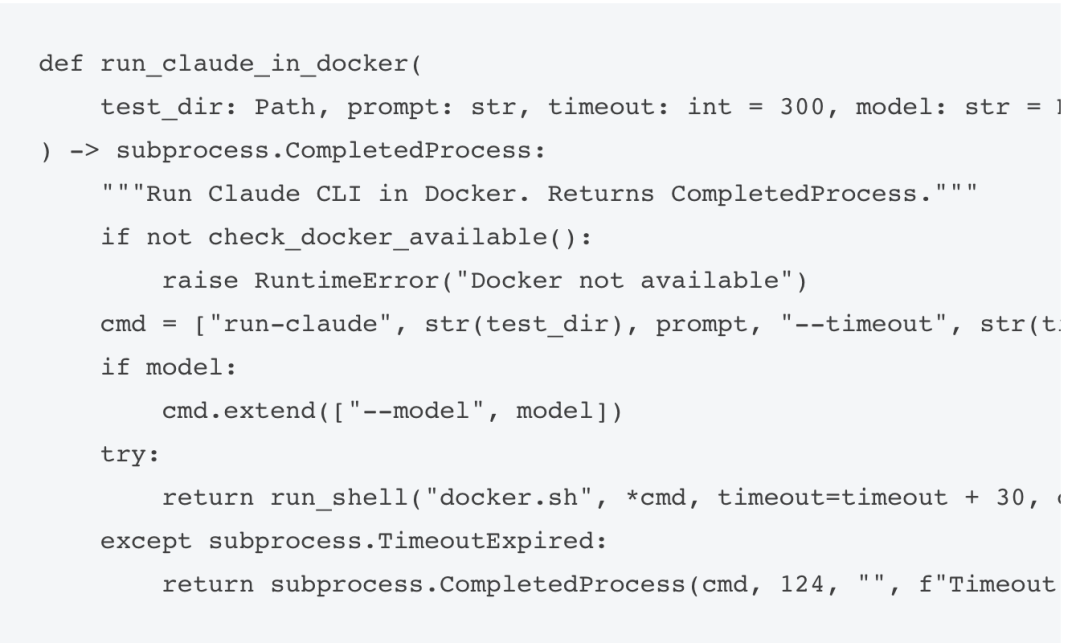

步骤 1:搭建干净、可复现的测试环境

-

核心原因

测试技能本质是测试智能体能否有效利用技能信息,而编码智能体 / 工具集的行动空间大,且对启动条件高度敏感(如 Claude Code 会先探索目录,目录内容会影响其执行策略),因此一致、干净的环境是测试可复现的关键。

-

实操方案

LangChain 采用轻量级 Docker 脚手架运行 Claude Code,并提供了对应的 Python 实现代码;也可选择 Harbor 或其他沙箱环境替代。

-

核心代码

给出

run_claude_in_docker函数,实现 Docker 中 Claude CLI 的运行,支持指定测试目录、提示词、超时时间和模型,处理了 Docker 不可用、运行超时等异常情况。

步骤 2:定义标准化的测试任务

摒弃 “凭感觉判断性能” 的方式,通过明确、可量化的任务建立系统基准,避免性能退化,核心原则有 3 点:

- 创建有约束的任务

- 问题:开放式输出难以评分,且对智能体设计过度规定会否定有效解决方案;

- 方案:选择修复有 bug 的代码这类任务,缩小智能体的设计空间,便于验证正确性(若修复后仍在预定义测试中出现 bug,可直接判定失败)。

- 为任务匹配清晰的量化指标

- 核心跟踪指标(均通过 LangSmith 评估记录):技能是否被正确调用(相关时调用、无关时不调用);任务是否完成(统计完成步骤数,区分 “完全失败” 和 “接近成功”);完成任务的轮次(衡量效率);完成任务的实际耗时(更精准的效率指标);

- 价值:实现技能对智能体性能提升的量化,为迭代提供数据支撑。

- 避免过度设计任务难度

- 原则:编码智能体本身的问题解决能力已很强,若任务过于复杂 / 对抗性,测试的将是智能体能力而非技能有效性;

- 方案:基于智能体的实际失败案例设计任务,打造 “能引发失败的最直接测试用例”(如针对 Claude Code 无法向 LangSmith 上传评估器的问题,设计 “基于数据集创建轨迹评估器并上传至 LangSmith” 的任务)。

-

案例与评分代码

给出 LangChain/LangSmith 相关的示例任务(创建轨迹数据集 + 评估器并上传),并提供

check_accuracy评分函数,通过对比智能体输出与真实值(ground truth)验证结果正确性。

步骤 3:科学定义与设计技能内容

核心解决 **“技能内容包含什么、放在哪里”** 的问题,技能研发常伴随预加载的 AGENTS.md/CLAUDE.md 文件,需明确内容的存放位置和拆分方式,核心指南有 3 点:

- 让技能模块化

- 实现方式:用 XML 标签划分技能的不同内容板块,便于替换 / 移除板块进行 A/B 测试;

- 实践发现:300-500 行的大型技能中,小的格式 / 措辞修改(如正面 / 负面引导、markdown/XML 标签)对性能影响极小;迭代时建议修改一个或多个板块,而非精细化优化。

- 充分利用 AGENTS.md 和 CLAUDE.md

- 解决问题:技能的调用可靠性低(如 Claude Code 曾完全不调用 “langchain agents” 技能,即使加提示词,调用率也仅 70%);

- 方案:因这两个文件会被可靠加载到上下文,可在其中写入技能的调用规则(何时 / 如何调用),以及多技能协同使用的指导,实现技能的稳定调用,提升任务通过率并减少执行轮次。

- 平衡技能间的内容分布

- 核心要点:技能名称和描述决定智能体的调用准确性,测试发现~20 个相似 LangGraph 技能会导致智能体调错,而 12 个技能时调用完全准确;

- 平衡原则:少量技能整合内容会提升加载一致性,但会让智能体读取无关内容;多技能拆分则相反,需通过测试找到最优平衡。

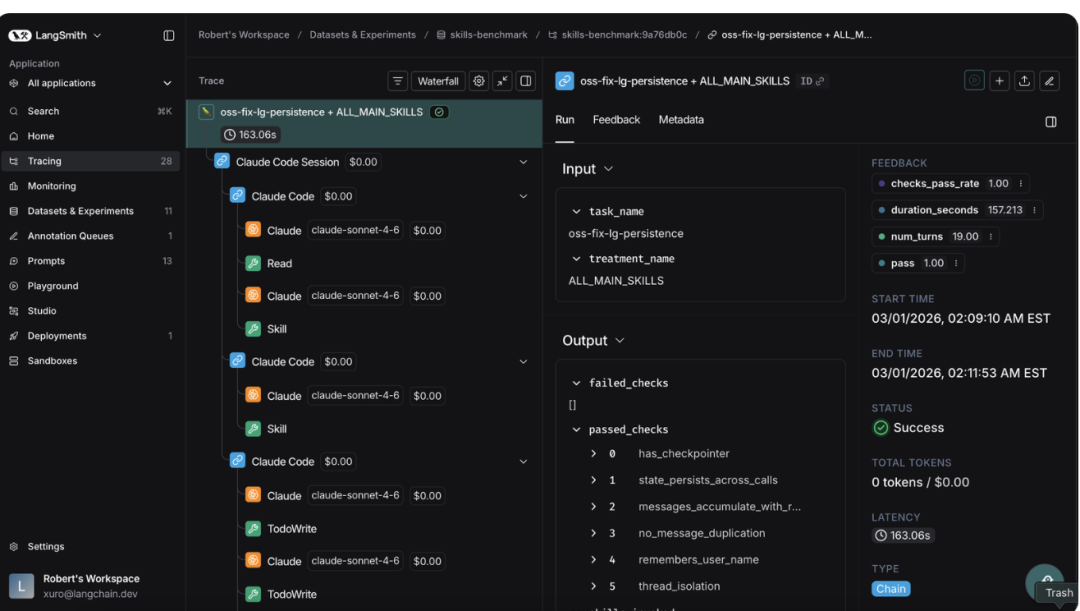

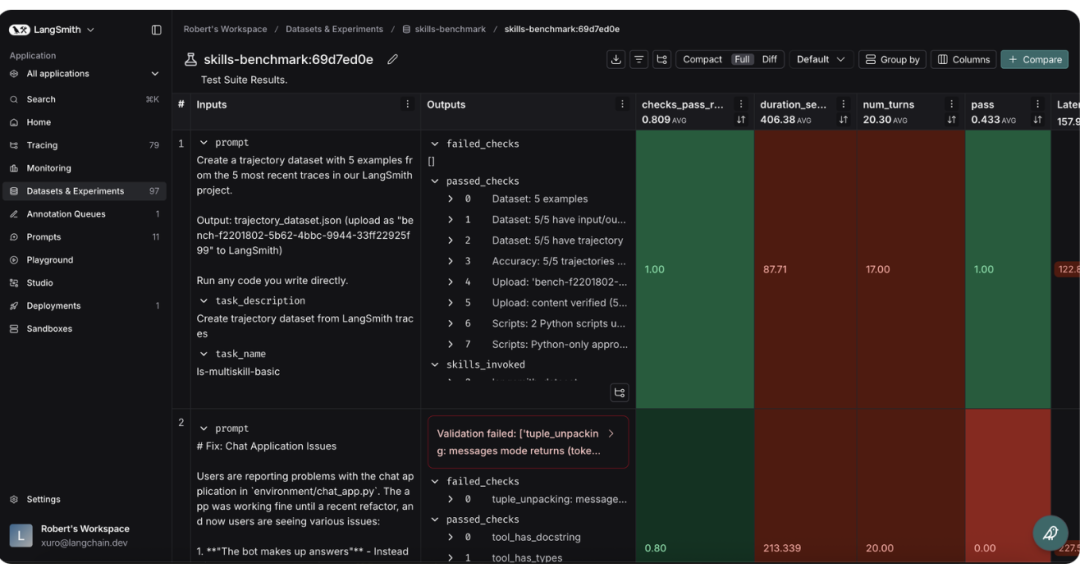

步骤 4:运行测试并对比性能表现

核心是多组合测试 + 结合 LangSmith 实现可观测性 + 基于结果迭代,具体实操:

-

设计多组测试用例

设置对照组(无技能)、全技能组、技能整合成少数大技能组、技能拆分为多个小技能组,覆盖不同的技能使用场景。

-

量化对比性能

通过 LangSmith 的 pytest 集成对比各组任务完成率,核心数据:Claude Code 有技能时任务完成率 82%,无技能时仅 9%;且不同的技能拆分 / 整合方式在不同任务上的表现有差异。

-

实现智能体轨迹的可观测性

- 解决问题:难以理解 Docker 中 Claude Code 的执行行为和失败原因;

- 方案:将 LangSmith 与测试集成,捕获智能体的所有行动(读取的文件、创建的脚本、技能调用情况),实现执行轨迹的全链路追踪。

-

高效迭代技能

让 Claude Code 利用自身的追踪技能分析 LangSmith 中的轨迹数据,自动总结失败问题;研发人员基于总结提出修复方案,重新测试后,在 LangSmith 的实验门户中查看性能变化,形成迭代闭环。

四、结论

- 技能是提升 Codex、Claude Code、Deep Agents CLI 等编码智能体能力的有效方式,可解决智能体 “工具过多导致性能下降” 的问题;

- 与 LLM 提示词、智能体其他组件一致,技能必须经过系统的评估与测试才能保证有效性,无评估的技能无法落地使用;

- 搭建技能评估流水线的关键:干净的测试环境、标准化的任务与指标、科学的技能设计、基于 LangSmith 的可观测性与性能对比;

- 对于编码智能体的技能研发,**“可观测性” 和 “量化评估”** 是核心,尤其针对 Claude Code 这类高性能智能体,只有明确其执行轨迹和失败原因,才能实现技能的高效迭代。

五、工具支撑

全文围绕LangSmith展开,其作为 LangChain 的可观测性与评估平台,承担了指标跟踪、轨迹捕获、实验对比、结果可视化的核心作用,是技能评估流水线落地的关键工具,同时其 pytest 集成、实验门户等功能实现了测试的自动化与迭代的高效化。

AI行业迎来前所未有的爆发式增长:从DeepSeek百万年薪招聘AI研究员,到百度、阿里、腾讯等大厂疯狂布局AI Agent,再到国家政策大力扶持数字经济和AI人才培养,所有信号都在告诉我们:AI的黄金十年,真的来了!

在行业火爆之下,AI人才争夺战也日趋白热化,其就业前景一片蓝海!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

人才缺口巨大

人力资源社会保障部有关报告显示,据测算,当前,****我国人工智能人才缺口超过500万,****供求比例达1∶10。脉脉最新数据也显示:AI新发岗位量较去年初暴增29倍,超1000家AI企业释放7.2万+岗位……

单拿今年的秋招来说,各互联网大厂释放出来的招聘信息中,我们就能感受到AI浪潮,比如百度90%的技术岗都与AI相关!

就业薪资超高

在旺盛的市场需求下,AI岗位不仅招聘量大,薪资待遇更是“一骑绝尘”。企业为抢AI核心人才,薪资给的非常慷慨,过去一年,懂AI的人才普遍涨薪40%+!

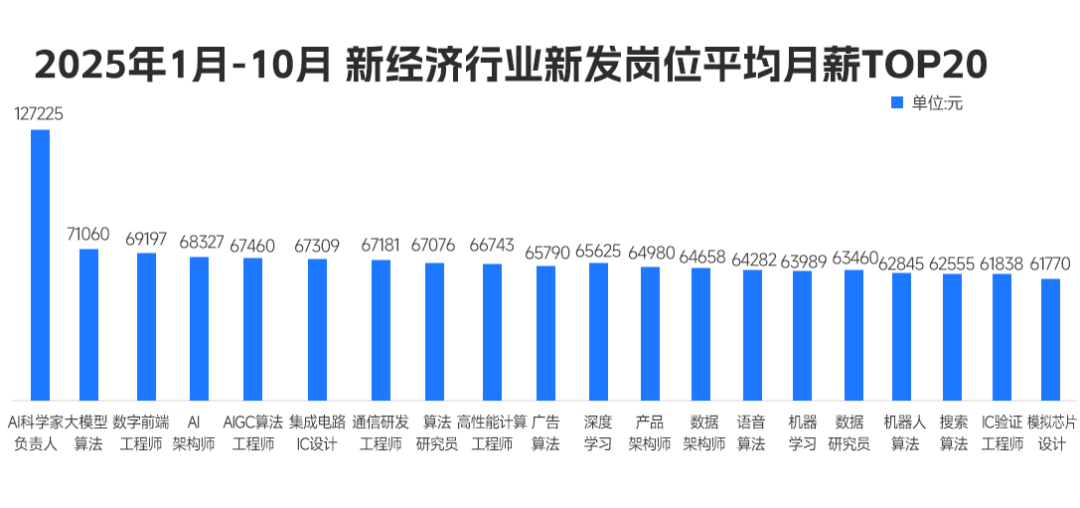

脉脉高聘发布的《2025年度人才迁徙报告》显示,在2025年1月-10月的高薪岗位Top20排行中,AI相关岗位占了绝大多数,并且平均薪资月薪都超过6w!

在去年的秋招中,小红书给算法相关岗位的薪资为50k起,字节开出228万元的超高年薪,据《2025年秋季校园招聘白皮书》,AI算法类平均年薪达36.9万,遥遥领先其他行业!

总结来说,当前人工智能岗位需求多,薪资高,前景好。在职场里,选对赛道就能赢在起跑线。抓住AI风口,轻松实现高薪就业!

但现实却是,仍有很多同学不知道如何抓住AI机遇,会遇到很多就业难题,比如:

❌ 技术过时:只会CRUD的开发者,在AI浪潮中沦为“职场裸奔者”;

❌ 薪资停滞:初级岗位内卷到白菜价,传统开发3年经验薪资涨幅不足15%;

❌ 转型无门:想学AI却找不到系统路径,83%自学党中途放弃。

他们的就业难题解决问题的关键在于:不仅要选对赛道,更要跟对老师!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献129条内容

已为社区贡献129条内容

所有评论(0)