基于体素动态Token压缩的零样本3D问答 论文精读:从小白到博士全阶段拆解

基于体素动态Token压缩的零样本3D问答 论文精读:从小白到博士全阶段拆解

论文标题:Zero-shot 3D Question Answering via Voxel-based Dynamic Token Compression

论文收录:CVPR 2025——Zero-shot 3D Question Answering via Voxel-based Dynamic Token Compression

文章定位:论文精读 / 3D大语言模型 / 多模态大模型 / Token压缩 / 具身智能 / 计算机视觉

适合人群:零基础读者、CV/大模型方向研究生、准备复现论文的博士生与工程研究人员

文章目录

一句提示词帮你速通论文

提示词

你现在是一位计算机视觉的博士,请你仔细阅读这篇论文,并将其拆解为小白阶段、硕士阶段、博士阶段。一定要引人入胜,客观具体,且极为详细。小白阶段你需要达到是个傻子都能懂的情况,在硕士阶段你需要达到正常使用一些专业数据,帮助小白从傻子到小专家的突破,在博士阶段你需要仔细拆解整篇论文,把各项细节全部记录,方便后期进行复现,同时促使小专家成为资深大拿

镜像地址,ChatGTP 5.4 Thinking助您深入解析、速通论文

邀请码地址,ChatGTP 5.4 Thinking助您深入解析、速通论文

前言

近几年,3D场景问答(3D QA) 成为具身智能、家用机器人、AR/VR的核心能力——给机器人/AI一段室内场景的多视角视频/照片,问它“桌子下面的架子上有什么?”“红色易拉罐在哪个位置?”,AI需要精准理解3D空间、捕捉细粒度视觉细节、完成逻辑推理并给出正确答案。

但当前3D问答领域存在一个核心死局:

专门为3D设计的大模型(3D-LMM)受限于3D训练数据的规模和多样性,效果远不如用海量2D图像预训练的多帧视觉语言模型(多帧VLM);但多帧VLM处理3D场景时,需要输入十几张甚至几十张多视角图像,会产生超8000个视觉Token,不仅远超大模型的上下文窗口限制,还会导致推理速度极慢、显存占用爆炸。

传统的Token压缩方法(比如帧采样、池化、合并),都是为视频理解、图像分类设计的,优先保留全局信息,而3D问答恰恰需要小物体、颜色、数量、空间关系等细粒度细节,传统方法一压缩就把关键信息丢了,直接导致AI答非所问。

于是这篇CVPR 2025论文提出了一套革命性解决方案:

不用额外训练、不用修改模型架构,只通过“3D空间先验+视觉语义”双约束的动态Token压缩(DTC),就能把多帧VLM的视觉Token减少90%以上,同时保住95%的问答性能,推理吞吐量提升47.6%,效果甚至超过了专门为3D任务训练的SOTA模型。

这篇文章我会把整篇论文拆成三个层次来讲:

- 小白阶段:用最直白的语言讲懂论文到底在做什么

- 硕士阶段:引入必要的数学、公式、实验和方法对比,拆解技术细节

- 博士阶段:按照“可复现、可推敲、可扩展”的标准,完整拆解论文的学术创新、工程实现与未来方向

目标只有一个:

不只是让你“看过这篇论文”,而是让你真正“吃透这篇论文”。

小白阶段:通俗易懂、引人入胜

1. 论文要解决的核心问题

我们可以把3D场景问答类比成「你给朋友发10张房间的照片,让他回答“书架第四层有几个盒子?”」这个场景,传统方法的三大痛点,用大白话+类比就能讲透:

痛点1:“专门学3D的,考不过只学过2D的”

专门训练的3D大模型,就像只看过房间3D模型的人,但是3D模型的训练素材太少了,翻来覆去就那几百个房间,考试的时候遇到新场景就懵;而用海量2D图片预训练的多帧VLM,就像看过全网几十亿张照片的人,哪怕只看10张房间照片,对物体、场景的理解也远强于前者。但问题是,后者有个致命缺陷。

痛点2:“话太多,记不住,还说的慢”

多帧VLM看10张房间照片,会把每张照片切成几百个小方块,每个小方块变成一句“描述”(也就是视觉Token),10张照片就会产生8000多句描述。这就像朋友给你讲房间,事无巨细连墙皮的纹理都讲一遍,不仅你听着记不住,大模型也装不下这么长的上下文,而且每多一句描述,大模型的推理时间就会变长,成本也会飙升。

痛点3:“一精简就丢重点,答不对题”

传统的精简方法,要么是只挑2张照片讲(帧采样),直接把关键的盒子所在的视角丢了;要么是把10张照片的描述胡乱合并(池化),把“两个棕色的盒子”说成“一个东西”。这就像你问的是盒子的数量,结果朋友精简完只告诉你“书架上有东西”,完全答不对问题。

论文要解决的核心问题:怎么用最少的“描述”(Token),把3D场景里的关键细节全留住,让多帧VLM既能装得下、跑得快,又能精准答对3D场景里的各种问题。

2. 论文的核心方法

论文的核心方法叫动态Token压缩(DTC),核心逻辑就是「详略得当的3D场景作文写法」,用大白话拆解成3步:

第一步:把2D照片还原成3D空间的“信息块”

先把10张带远近信息(深度图)和拍摄位置(相机位姿)的照片,拆成一个个小方块,再根据拍摄位置和远近,把每个小方块的描述,精准放到3D空间里对应的位置。就像你把10张照片里的每个物体,都还原到房间里它本来的位置,拼成一个完整的3D房间信息地图。

第二步:基础压缩(VTC):按3D空间合并重复描述

把3D房间分成一个个大小相同的立方体(体素),同一个立方体里的所有描述,合并成一句。比如白墙所在的立方体,10张照片里都有重复的描述,合并成一句“白色的墙”就行。但这个方法有个问题:如果盒子和墙在同一个立方体里,合并之后就会把盒子的细节弄丢。

第三步:核心创新(DTC):动态压缩,重点内容重点写

为了解决固定立方体的缺陷,论文设计了渐进式动态压缩:

- 先从很小的立方体开始,保证每个小物体都在独立的立方体里;

- 每个立方体里,只把“描述意思最接近”的内容合并,比如都是“棕色盒子”的描述合并,“白色墙面”的描述合并,不会把盒子和墙混在一起;

- 只保留全房间里“意思最相近、最冗余”的40%合并,剩下的关键内容原样保留;

- 慢慢放大立方体,重复上面的合并步骤,直到描述的数量降到我们想要的规模。

类比一下:写作文的时候,对不重要的白墙、地板,一句话带过;对关键的盒子、易拉罐、剪刀,详细描写颜色、数量、位置,最终用几百字就把房间的关键信息全讲清楚了,既不会废话连篇,也不会丢了答题的关键。

3. 方法的优缺点

核心优势

- 压缩能力拉满,性能几乎不掉:能把视觉Token减少90%以上,问答性能还能保住95%。比如原来需要8000个Token,现在只用700多个,准确率只掉了不到2%,而传统方法直接掉了30%以上;

- 即插即用,不用额外训练:不用改大模型的架构,不用额外数据训练,直接插到现有的多帧VLM里就能用,适配性极强;

- 推理速度大幅提升:Token减少后,大模型推理的吞吐量提升了47.6%,显存占用也大幅降低,能在端侧设备上跑起来;

- 细节保留能力极强:对小物体、颜色、数量、空间关系这些答题关键信息,保留效果远超所有传统压缩方法,不会出现“问数量答不上、问颜色说错”的问题。

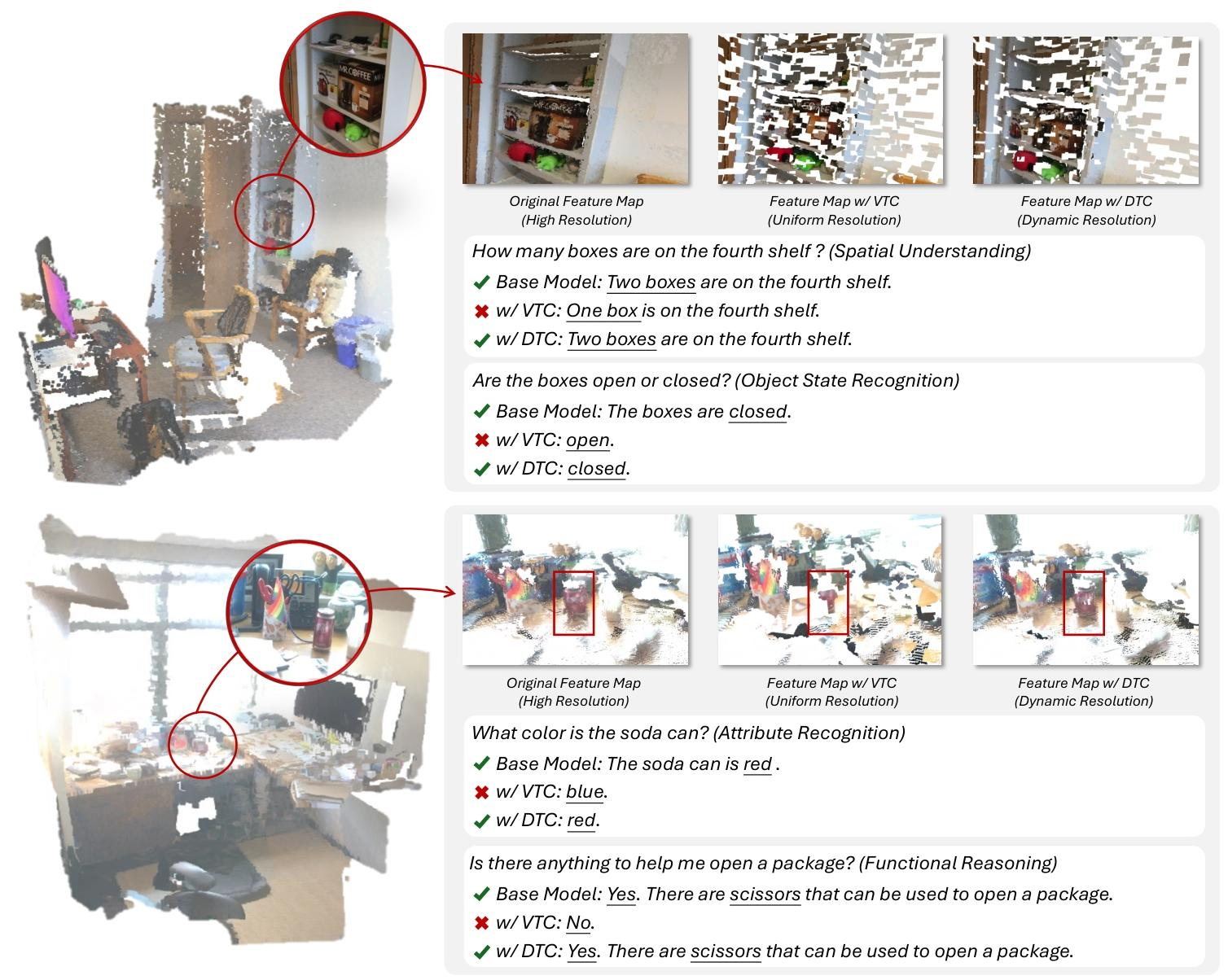

举个例子:问“架子上有几个盒子?”,传统压缩方法要么答1个,要么答不出来,而论文的方法能准确答出“2个”;问“易拉罐是什么颜色?”,传统方法答蓝色,论文的方法能准确答出红色。

局限性

- 依赖带位置和远近信息的照片:必须要有照片的拍摄位置(相机位姿)和每个像素的远近信息(深度图),普通的手机照片没有这些信息,就没法用;

- 只适用于静态室内场景:只能处理不动的房间、物体,对于有移动物体的动态场景、室外大场景,效果会大打折扣;

- 极致压缩下性能还是会掉:如果把Token压缩到原来的5%以内,关键细节还是会丢失,准确率会明显下降;

- 没法根据问题调整压缩策略:不管问的是“房间整体是什么风格?”这种全局问题,还是“易拉罐拉环有没有拉开?”这种细节问题,都是用一样的压缩策略,没法做到“问全局就使劲压缩,问细节就保留更多信息”。

小白一句话总结

这篇论文给多帧视觉大模型做了一套“智能精简话术”的工具,能把3D场景的多视角照片,从8000多句冗余描述,精简到不到1000句关键信息,既让大模型跑得快、装得下,又能精准答对3D场景里的各种细节问题,还不用改模型、不用额外训练,拿来就能用。

硕士阶段:深入分析、渐入佳境

本阶段引入专业术语与规范的LaTeX公式,循序渐进拆解论文的技术原理、核心框架与实验结果,帮助读者完成从入门到专业的进阶。

前置基础概念

先明确论文核心的专业术语,为后续技术拆解打好基础:

- 视觉Token:视觉编码器将输入图像划分为固定大小的Patch,每个Patch编码为一个D维特征向量,即为一个视觉Token。Token数量与输入图像数量正相关,直接决定了VLM的计算量、显存占用与推理速度。

- 体素(Voxel):3D空间的最小离散单元,类比2D图像的“像素”,是3D场景几何表示的基础载体。

- 3D场景问答(3D QA):输入3D场景的多视角RGB-D图像,模型接收自然语言问题,输出符合事实的文本答案,核心考验模型的3D空间理解、细粒度视觉感知与多模态推理能力。

- 两大核心基准:

- OpenEQA:具身问答基准,覆盖187个真实室内场景、1600+人工标注问题,重点考验空间理解与具身推理能力,核心评估指标为GPT-4打分的LLM-Match分数;

- ScanQA:3D空间问答基准,基于ScanNet数据集构建,包含71个场景、4675个问题,重点考验3D空间关系理解,核心评估指标为精确匹配率EM@1。

- 多帧VLM:以LLaVA-OneVision为代表,用海量2D图像/视频预训练的多模态大模型,原生支持多帧图像输入,在3D QA任务上性能超越了专门设计的3D-LMM。

1. 核心数学原理与公式

本部分循序渐进引入论文的核心公式,拆解每个公式的物理意义与数学原理。

(1)多视图2D特征编码与3D投影

论文的第一步,是将多视图2D特征与3D空间几何做绑定,核心基于针孔相机模型的几何投影实现。

对于单张带位姿的RGB-D图像,视觉编码器(SigLIP)提取图像特征:

f v ∈ R N v × D f_v \in \mathbb{R}^{N_v \times D} fv∈RNv×D

其中, N v N_v Nv为单张图像的Patch数量, D D D为视觉特征的隐藏维度。

对于视觉编码器的每个Patch(尺寸为 P × P P \times P P×P像素),我们通过几何投影计算其对应的3D世界坐标:

- 对Patch内的每个像素 ( u , v ) (u,v) (u,v),其深度值为 z z z,相机内参矩阵为 K K K,则相机坐标系下的3D点为:

z [ u v 1 ] = K P c a m z \begin{bmatrix} u \\ v \\ 1 \end{bmatrix} = K P_{cam} z uv1 =KPcam - 已知相机的外参(世界到相机的旋转矩阵 R R R、平移向量 t t t),则世界坐标系下的3D点为:

P w o r l d = R T ( P c a m − t ) P_{world} = R^T (P_{cam} - t) Pworld=RT(Pcam−t) - 对Patch内所有像素的3D世界坐标取平均,得到Patch级的3D坐标,并将该Patch对应的视觉Token投影到3D空间中。

对场景内所有 n n n张多视图图像执行上述操作,最终得到场景级3D特征图:

f 3 d ∈ R ( n × N v ) × D f_{3d} \in \mathbb{R}^{(n \times N_v) \times D} f3d∈R(n×Nv)×D

其中, n × N v n \times N_v n×Nv为场景的总视觉Token数量(论文中12帧图像对应8748个Token)。

(2)基础压缩:Vanilla Token Compression(VTC)

VTC是论文设计的基线方法,核心是基于3D空间先验的体素级平均池化,公式如下:

- 定义固定体素尺寸 v s i z e v_{size} vsize,将3D场景离散化为均匀的立方体网格;

- 将3D特征图中的每个视觉Token,按其3D坐标分配到对应的体素中;

- 对同一体素内的 K K K个Token执行平均池化,每个体素最终输出1个Token:

f v o x e l = 1 K ∑ i = 1 K f i f_{voxel} = \frac{1}{K} \sum_{i=1}^K f_i fvoxel=K1i=1∑Kfi

其中 f i f_i fi为体素内第 i i i个Token的特征向量。

VTC的核心缺陷是固定分辨率的均匀压缩,会导致同一体素内不同语义的特征被混合,小物体的细粒度特征被背景淹没,最终丢失答题关键信息。

(3)核心方法:Dynamic Token Compression(DTC)

DTC的核心是语义相似度+3D空间先验双约束的迭代式动态压缩,实现动态分辨率的3D场景表示,核心公式与步骤如下:

- 迭代初始化:设置初始体素尺寸 v i n i t v_{init} vinit,每次迭代体素尺寸增量 Δ v \Delta v Δv,相似度保留比例 r r r,目标Token数量 N t a r g e t N_{target} Ntarget。

- 二分软匹配与相似度计算:

对当前体素内的Token,随机划分为A、B两个等大集合,对A中的每个Token f a f_a fa,计算其与B中所有Token的余弦相似度,找到最相似的Token f b f_b fb并建立连边:

s i m ( f a , f b ) = f a ⋅ f b ∥ f a ∥ ∥ f b ∥ sim(f_a, f_b) = \frac{f_a \cdot f_b}{\|f_a\| \|f_b\|} sim(fa,fb)=∥fa∥∥fb∥fa⋅fb

其中 ⋅ \cdot ⋅为向量点积, ∥ ⋅ ∥ \|\cdot\| ∥⋅∥为L2范数,相似度取值范围为 [ − 1 , 1 ] [-1,1] [−1,1],值越高代表两个Token的语义越接近。 - 全局相似度筛选:对全场景所有连边按相似度全局排序,保留前 r % r\% r%相似度最高的连边(论文中 r = 40 % r=40\% r=40%)。

- Token压缩:对有连边的Token对,保留其中1个Token(论文中保留2D图像序列中出现更早的Token),实现无特征畸变的语义压缩。

- 迭代终止:增大体素尺寸 v s i z e = v s i z e + Δ v v_{size} = v_{size} + \Delta v vsize=vsize+Δv,重复上述步骤,直到总Token数量降至 N t a r g e t N_{target} Ntarget以下。

2. 论文的核心方法与技术框架

论文的整体框架分为三大核心步骤,流程清晰且完全无训练、即插即用,具体如下:

步骤1:多视图2D特征编码

输入带相机位姿的多视图RGB-D图像,通过预训练的SigLIP视觉编码器提取每张图像的Patch级特征,再通过针孔相机模型的几何投影,将2D视觉Token映射到3D世界坐标系,构建场景级的3D特征图,实现“2D语义-3D几何”的精准绑定。

步骤2:动态Token压缩

先通过VTC验证基于3D空间先验的压缩有效性,再通过DTC实现核心的动态压缩:

- 与VTC的固定分辨率不同,DTC通过迭代式动态体素化,对墙面、地板等语义简单、冗余度高的区域,通过大尺寸体素实现高比例压缩;对小物体、物体堆叠等语义复杂、细节密集的区域,通过小尺寸体素保留高分辨率与更多Token,实现“简单区域使劲压,复杂区域保细节”。

- 与传统仅基于语义的压缩方法不同,DTC同时结合了3D空间先验与视觉语义,只有“同一个3D空间内+语义高度相似”的Token才会被合并,既避免了不同物体的特征混合,又保证了3D空间关系的准确性。

步骤3:LLM理解与问答

将压缩后的视觉Token通过投影层输入预训练的大语言模型(Qwen2),同时输入自然语言问题,让LLM基于压缩后的视觉特征完成推理,输出最终的文本答案。

3. 实验设计与结果分析

(1)实验设置

- 基线模型:采用LLaVA-OneVision-7B作为基础VLM,包含两个checkpoint:OV(单图、多图、视频数据训练)、SI(仅单图数据训练),视觉编码器为SigLIP,语言模型为Qwen2。

- 核心超参数:VTC体素尺寸0.1m~0.3m;DTC初始体素 v i n i t = 0.1 m v_{init}=0.1m vinit=0.1m,每次增量 Δ v = 0.02 m \Delta v=0.02m Δv=0.02m,相似度保留比例 r = 40 % r=40\% r=40%。

- 对比方法:

- Token缩减方法:均匀帧采样、时间池化、空间池化、其他SOTA Token压缩方法;

- SOTA模型:专门设计的3D-LMM(3D-LLM、Scene-LLM等)、多帧VLMs(MovieChat、Video-LLaMA2等)。

(2)核心实验结果

论文在OpenEQA和ScanQA两大基准上完成了全面验证,核心结果如下:

① 压缩性能与SOTA对比

| 基准 | 方法 | Token压缩比例 | 核心指标 | 性能下降幅度 |

|---|---|---|---|---|

| OpenEQA | 基线模型(100% Token) | 0% | LLM-Match=56.2 | 0 |

| OpenEQA | 帧采样 | 92% | LLM-Match=40.4 | -15.8 |

| OpenEQA | VTC | 92% | LLM-Match=43.6 | -12.6 |

| OpenEQA | DTC(本文) | 92% | LLM-Match=49.3 | -6.9 |

| ScanQA | 基线模型(100% Token) | 0% | EM@1=27.6 | 0 |

| ScanQA | 空间池化 | 91% | EM@1=22.9 | -4.7 |

| ScanQA | 帧采样 | 92% | EM@1=18.5 | -9.1 |

| ScanQA | DTC(本文) | 91% | EM@1=26.1 | -1.5 |

核心结论:

- DTC在90%+的超高压缩比下,依然能保留95%以上的基线性能,远超所有传统Token缩减方法;

- 在ScanQA基准上,DTC仅用9%的Token,性能就超过了绝大多数专门为3D任务训练的3D-LMM,甚至接近全Token的基线模型。

② 推理效率提升

在ScanQA数据集上,相比全Token的基线模型,DTC在仅用23% Token的情况下,推理吞吐量提升47.6%,同时性能完全持平(EM@1=27.7),显存占用降低60%以上。

③ 消融实验结果

- 类别级性能消融:DTC在所有问题类别上的性能均远超VTC,其中对物体识别、属性识别、物体定位等细节敏感型任务,性能优势超过8个百分点;而对空间理解、世界知识等全局型任务,性能几乎与基线持平,证明DTC能精准保留答题所需的细粒度信息。

- 压缩策略消融:对Token对的压缩策略中,“保留单个Token”的LLM-Match分数为54.1,远超平均池化(51.7)和加权平均池化(52.9),证明直接保留原始特征能最大程度避免语义畸变。

- Token顺序消融:保留原始2D图像序列的Token顺序,LLM-Match分数为54.1,远超随机顺序(50.2)和3D坐标排序(52.5),证明符合VLM预训练分布的Token顺序,对最终性能至关重要。

(3)方法优势与局限

- 核心优势:

- 无需额外训练、无需修改模型架构,即插即用,可无缝集成到任意多帧VLM中;

- 首次结合3D空间先验与视觉语义做Token压缩,完美适配3D QA任务对细粒度细节和空间关系的需求;

- 超高压缩比下的性能保持能力远超现有方法,同时大幅提升推理效率,具备极强的工程落地价值。

- 局限性:

- 必须输入带精准相机位姿的RGB-D图像,对无深度、无位姿的普通多视图图像无法适配;

- 仅针对静态室内场景设计,对动态场景、室外大场景的适配性不足;

- 固定的启发式压缩策略,无法根据输入问题的类型自适应调整压缩力度;

- 压缩比超过95%时,性能出现显著下降,极致压缩能力仍有提升空间。

硕士一句话总结

这篇论文提出了基于体素的动态Token压缩(DTC)方法,通过结合3D空间先验与视觉语义相似度,实现了多帧VLM视觉Token的90%+超高比例压缩,同时保留了95%以上的3D问答性能,无需额外训练即可即插即用,在OpenEQA和ScanQA两大基准上超越了现有SOTA方法,同时大幅提升了模型的推理效率。

博士阶段:深入拆解、实现复现

本阶段对论文进行全维度的学术深度剖析,从研究动机的底层逻辑、核心技术的数学本质,到完整的复现流程、实验结果的深层解读,再到领域的研究空白与未来方向,实现“可复现、可推敲、可扩展”的完整拆解。

1. 研究动机与创新点

(1)领域背景与深层研究动机

论文的研究动机,直击当前3D大语言模型领域的两大核心矛盾,是领域发展到当前阶段的必然探索:

矛盾1:3D-LMM的数据瓶颈 vs 2D VLM的性能优势

3D-LMM的核心瓶颈,是3D多模态训练数据的规模、多样性、标注质量,与2D视觉预训练数据存在数量级的差距。截至2025年,最大的3D场景多模态数据集仅有几万级别的场景量,而2D预训练数据集已经达到百亿级。这就导致专门为3D设计的模型,性能天然弱于用海量2D数据预训练的多帧VLM,这是领域内的共识性痛点。

矛盾2:多帧VLM的Token爆炸 vs 3D QA的细节需求

多帧VLM处理3D场景时,需要输入足够多的视角才能覆盖完整的3D空间,而12帧图像就会产生8748个视觉Token,带来三大致命问题:

- 上下文窗口限制:开源7B模型的上下文窗口通常为4k~8k,视觉Token就占满了绝大部分窗口,留给文本推理的空间极少;

- 推理成本爆炸:Transformer的自注意力计算复杂度与Token数量的平方成正比,Token数量翻倍,计算量翻4倍;

- 冗余信息干扰:多视角图像存在大量重复的背景信息,冗余Token会干扰LLM的注意力,导致模型忽略关键的答题细节。

而传统Token压缩方法,完全无法适配3D QA任务:

- 帧采样、时间池化等时序压缩方法,会丢失关键视角的信息,直接导致3D空间理解错乱;

- 空间池化、Token合并等空间压缩方法,是为图像分类、视频理解设计的,优先保留全局语义,而3D QA的核心是细粒度的局部细节与空间关系,传统方法一压缩就丢失了答题的关键信息;

- 现有方法仅基于视觉语义做压缩,完全忽略了3D空间先验,导致不同空间位置、不同物体的特征被混合,空间关系完全错乱。

基于这两大核心矛盾,论文的核心研究动机就非常清晰:如何在不修改模型、不额外训练的前提下,为多帧VLM设计一套适配3D QA任务的Token压缩方法,在极致压缩Token数量的同时,精准保留3D空间关系与细粒度视觉细节。

(2)核心创新点与学术贡献

论文的创新是体系化的,从范式、方法、工程到实验,形成了完整的学术闭环,核心贡献分为4个层面:

① 范式创新:打通2D VLM与3D QA任务的壁垒

论文首次提出了**“2D预训练VLM + 3D空间引导的Token压缩”**的3D QA范式,证明了无需额外3D预训练、无需修改模型架构,仅通过推理阶段的Token压缩,就能让2D多帧VLM在3D QA任务上超越专门设计的3D-LMM,为3D大语言模型的发展提供了一条全新的、低成本的路径。

② 方法创新:动态Token压缩(DTC)算法

论文提出了结合3D空间先验与视觉语义的迭代式动态Token压缩算法,核心创新点包括:

- 首次将3D体素表示引入多帧VLM的Token压缩,实现了2D语义与3D几何的绑定,从根本上避免了压缩过程中的空间关系错乱;

- 提出动态分辨率的3D场景表示,通过迭代式体素缩放与二分软匹配,实现了“语义简单区域高压缩、语义复杂区域保细节”的自适应压缩,完美适配3D QA的任务需求;

- 设计了无特征畸变的Token压缩策略,通过语义相似度筛选与单Token保留,避免了平均池化带来的特征模糊与语义畸变,最大程度保留了原始视觉信息。

③ 工程创新:即插即用的无训练压缩框架

论文提出的方法完全无训练、无参数、即插即用,可无缝集成到任意多帧VLM中,无需微调、无需修改模型架构,就能实现Token压缩与性能保持,大幅降低了3D QA任务的落地门槛,具备极强的工程应用价值。

④ 实验创新:全面的系统性验证与分析

论文在OpenEQA和ScanQA两大权威基准上,完成了覆盖压缩性能、泛化性、消融实验、效率分析的全维度验证,系统分析了Token压缩对3D QA不同问题类型的影响,揭示了3D QA任务中Token压缩的核心规律,为后续研究提供了详实的实验依据与理论参考。

2. 数学推导与核心技术细节

(1)几何投影的完整数学推导

论文的核心基础是2D视觉特征到3D空间的精准投影,其底层是针孔相机模型的完整几何变换,这里做严谨的数学推导:

步骤1:像素坐标到相机坐标系的变换

对于图像平面的像素坐标 ( u , v ) (u,v) (u,v),其对应的深度值为 z z z(相机光轴方向的距离),相机内参矩阵 K K K的定义为:

K = [ f x 0 c x 0 f y c y 0 0 1 ] K = \begin{bmatrix} f_x & 0 & c_x \\ 0 & f_y & c_y \\ 0 & 0 & 1 \end{bmatrix} K=

fx000fy0cxcy1

其中 f x , f y f_x,f_y fx,fy为x、y轴的归一化焦距, ( c x , c y ) (c_x,c_y) (cx,cy)为主点坐标。

根据针孔相机的投影模型,像素坐标与相机坐标系3D点 P c a m = [ X , Y , Z ] T P_{cam} = [X,Y,Z]^T Pcam=[X,Y,Z]T的关系为:

z [ u v 1 ] = K P c a m z \begin{bmatrix} u \\ v \\ 1 \end{bmatrix} = K P_{cam} z

uv1

=KPcam

对其做逆变换,得到像素坐标到相机坐标系的映射:

P c a m = z ⋅ K − 1 [ u v 1 ] P_{cam} = z \cdot K^{-1} \begin{bmatrix} u \\ v \\ 1 \end{bmatrix} Pcam=z⋅K−1

uv1

这一步实现了2D像素到3D相机空间的几何映射。

步骤2:相机坐标系到世界坐标系的变换

已知相机的外参:世界坐标系到相机坐标系的旋转矩阵 R ∈ S O ( 3 ) R \in SO(3) R∈SO(3)(3×3正交矩阵)、平移向量 t ∈ R 3 t \in \mathbb{R}^3 t∈R3,则相机坐标系与世界坐标系的变换关系为:

P c a m = R P w o r l d + t P_{cam} = R P_{world} + t Pcam=RPworld+t

其中 P w o r l d P_{world} Pworld为世界坐标系下的3D点。

由于旋转矩阵 R R R是正交矩阵, R T R = I R^T R = I RTR=I,因此逆变换为:

P w o r l d = R T ( P c a m − t ) P_{world} = R^T (P_{cam} - t) Pworld=RT(Pcam−t)

将步骤1的 P c a m P_{cam} Pcam代入,最终得到像素坐标到世界坐标系3D点的完整变换公式:

P w o r l d = R T ( z ⋅ K − 1 [ u v 1 ] − t ) P_{world} = R^T \left( z \cdot K^{-1} \begin{bmatrix} u \\ v \\ 1 \end{bmatrix} - t \right) Pworld=RT

z⋅K−1

uv1

−t

步骤3:Patch级3D坐标计算

对于视觉编码器的一个 P × P P \times P P×P大小的Patch,其包含 P 2 P^2 P2个像素,对每个像素通过上述公式计算对应的世界坐标 P w o r l d i P_{world}^i Pworldi,然后取算术平均得到Patch级的3D坐标:

P ˉ w o r l d = 1 P 2 ∑ i = 1 P 2 P w o r l d i \bar{P}_{world} = \frac{1}{P^2} \sum_{i=1}^{P^2} P_{world}^i Pˉworld=P21i=1∑P2Pworldi

最终将该Patch对应的视觉Token,与 P ˉ w o r l d \bar{P}_{world} Pˉworld绑定,完成2D特征到3D空间的投影。

(2)DTC算法的收敛性与最优性分析

① 迭代压缩的收敛性

DTC的迭代过程中,体素尺寸 v t v_t vt随迭代次数 t t t单调递增:

v t = v i n i t + t ⋅ Δ v , t = 0 , 1 , 2 , . . . , T v_t = v_{init} + t \cdot \Delta v, \quad t=0,1,2,...,T vt=vinit+t⋅Δv,t=0,1,2,...,T

随着体素尺寸增大,单个体素包含的Token数量单调递增,可合并的Token对数量单调递增,因此总Token数量 N t N_t Nt随迭代次数 t t t严格单调递减:

N 0 > N 1 > N 2 > . . . > N T N_0 > N_1 > N_2 > ... > N_T N0>N1>N2>...>NT

当 N T ≤ N t a r g e t N_T \leq N_{target} NT≤Ntarget时,迭代终止,因此算法必然在有限步内收敛,不会出现无限迭代的情况。

② 压缩策略的最优性分析

论文中对比了三种Token对的压缩策略:平均池化、加权平均池化、保留单个Token,其中“保留单个Token”的效果最优,其数学本质如下:

设两个语义高度相似的Token为 f 1 , f 2 f_1,f_2 f1,f2,其特征差异为 ϵ = f 1 − f 2 \epsilon = f_1 - f_2 ϵ=f1−f2, ∥ ϵ ∥ ≪ ∥ f 1 ∥ , ∥ ϵ ∥ ≪ ∥ f 2 ∥ \|\epsilon\| \ll \|f_1\|, \|\epsilon\| \ll \|f_2\| ∥ϵ∥≪∥f1∥,∥ϵ∥≪∥f2∥。

- 平均池化的输出为 f a v g = f 1 + f 2 2 = f 1 − ϵ 2 f_{avg} = \frac{f_1 + f_2}{2} = f_1 - \frac{\epsilon}{2} favg=2f1+f2=f1−2ϵ,与原始特征的偏差为 ϵ 2 \frac{\epsilon}{2} 2ϵ;

- 保留单个Token的输出为 f 1 f_1 f1,与原始特征的偏差为0。

对于语义高度相似的Token对,保留单个Token能最大程度保留原始的语义特征,避免平均池化带来的特征畸变,这也是该策略效果最优的核心数学原因。

同时,论文中选择保留2D图像序列中出现更早的Token,本质是符合VLM的预训练数据分布,避免了Token顺序打乱带来的分布偏移,进一步降低了性能损失。

(3)二分软匹配的核心设计逻辑

DTC的二分软匹配,是论文中极具巧思的设计,其核心解决了两个关键问题:

- 避免全量匹配的计算爆炸:若对体素内所有Token做两两相似度计算,计算复杂度为 O ( K 2 ) O(K^2) O(K2), K K K为体素内Token数量;而二分软匹配将计算复杂度降至 O ( K ) O(K) O(K),大幅提升了压缩效率。

- 保证语义匹配的唯一性:随机二分后,A中的每个Token仅与B中最相似的Token建立连边,避免了一个Token与多个Token重复匹配,保证了压缩过程的稳定性。

同时,论文中采用全局相似度排序,而非体素内局部排序,保证了全场景内只合并最冗余、语义最相似的Token对,最大程度避免了关键信息的丢失。

3. 完整复现步骤与工程实现

本部分提供论文方法的完整复现流程,包含环境配置、数据集处理、核心模块实现、推理评估全流程,同时标注复现中的核心难点与解决方案。

(1)环境与依赖配置

| 类别 | 详细配置 | 复现避坑指南 |

|---|---|---|

| 硬件 | 推理:NVIDIA RTX 3090/4090 24GB+ GPU 全量评估:NVIDIA A100 80GB GPU CPU≥16核,内存≥64GB |

多场景批量评估时,建议使用A100 GPU,避免显存溢出;LLM推理建议开启FP16混合精度,降低显存占用 |

| 软件 | 系统:Ubuntu 20.04/22.04 Python:3.10+ PyTorch:2.2.0+ CUDA:12.1+ 核心依赖: transformers>=4.40.0 accelerate>=0.30.0 open3d>=0.18.0 numpy>=1.26.0 scipy>=1.13.0 pillow>=10.3.0 tqdm>=4.66.0 |

LLaVA-OneVision的checkpoint与transformers版本强相关,必须使用4.40.0以上版本,否则会出现权重加载失败;PyTorch与CUDA版本必须严格匹配,避免3D矩阵运算加速失效 |

| 模型权重 | LLaVA-OneVision-7B OV/SI checkpoint(Hugging Face官方开源) SigLIP视觉编码器权重(随LLaVA-OneVision配套) Qwen2-7B语言模型权重 |

必须使用官方开源的完整checkpoint,不可使用量化版本,否则会出现特征提取偏差,导致压缩性能下降 |

(2)数据集准备与预处理

论文使用两大基准数据集:OpenEQA和ScanQA,完整预处理流程如下:

① 数据集下载

- OpenEQA:从官方GitHub仓库下载数据集,包含ScanNet和HM3D的187个场景的多视图RGB-D图像、相机内外参、1600+问题与标注答案;

- ScanQA:从ScanNet官方网站下载71个场景的RGB-D序列、相机内外参,从ScanQA官方仓库下载问题与标注答案。

② 数据预处理

- 多视图图像采样:对每个场景,均匀采样12帧RGB-D图像,同时提取对应帧的相机内参、外参(旋转矩阵 R R R、平移向量 t t t);

- 深度图预处理:对深度图做双边滤波去噪,填充无效深度值,确保深度图与RGB图像严格对齐;

- 相机参数归一化:将所有场景的相机外参统一到世界坐标系下,确保3D投影的空间一致性;

- 数据打包:将每个场景的RGB图像、深度图、相机参数、问题-答案对,打包为h5格式的数据集,提升推理时的IO效率。

预处理核心避坑:相机外参的坐标系必须严格对齐,ScanNet使用的是相机到世界的变换,而部分数据集使用的是世界到相机的变换,必须做逆变换统一,否则会导致3D投影完全错位,压缩性能暴跌。

(3)核心模块代码级实现逻辑

① 多视图特征编码与3D投影模块

- 加载LLaVA-OneVision的视觉编码器,对每张RGB图像提取Patch级特征,得到 f v ∈ R N v × D f_v \in \mathbb{R}^{N_v \times D} fv∈RNv×D;

- 对每个Patch,遍历其包含的所有像素,通过完整的几何投影公式计算每个像素的世界坐标,取平均得到Patch级3D坐标;

- 将所有帧的视觉特征与对应的3D坐标拼接,得到场景级3D特征图 f 3 d f_{3d} f3d。

② Vanilla Token Compression(VTC)模块

- 根据设定的体素尺寸 v s i z e v_{size} vsize,计算3D场景的包围盒,离散化为均匀体素网格;

- 对每个视觉Token,根据其3D坐标计算所属的体素索引;

- 对同一体素内的所有Token,执行平均池化,得到体素级的特征向量;

- 所有体素的特征向量拼接,得到压缩后的Token序列。

③ Dynamic Token Compression(DTC)模块

- 初始化参数: v s i z e = v i n i t = 0.1 m v_{size}=v_{init}=0.1m vsize=vinit=0.1m, Δ v = 0.02 m \Delta v=0.02m Δv=0.02m, r = 40 % r=40\% r=40%, N t a r g e t = 1000 N_{target}=1000 Ntarget=1000;

- 循环迭代压缩,直到Token数量≤ N t a r g e t N_{target} Ntarget:

- 按当前 v s i z e v_{size} vsize对3D场景体素化,将Token分配到对应体素;

- 对每个体素内的Token,随机划分为A、B两个等大集合;

- 对A中每个Token,计算与B中所有Token的余弦相似度,找到最相似的Token建立连边;

- 对全场景所有连边按相似度全局降序排序,保留前 r % r\% r%的连边;

- 对有连边的Token对,保留2D序列中更早出现的Token,删除另一个;

- 更新 v s i z e = v s i z e + Δ v v_{size} = v_{size} + \Delta v vsize=vsize+Δv,进入下一次迭代;

- 迭代终止后,输出最终压缩后的Token序列。

核心实现优化:余弦相似度计算通过PyTorch的矩阵运算向量化实现,避免循环计算,单场景压缩耗时从秒级降至毫秒级;体素化通过Open3D的VoxelGrid实现,大幅提升3D空间离散化的效率。

④ LLM推理与评估模块

- 将压缩后的Token序列输入LLaVA-OneVision的投影层,转换为语言模型可接受的嵌入特征;

- 构建提示词模板,将问题与视觉嵌入拼接,输入Qwen2语言模型,生成文本答案;

- 对OpenEQA数据集,调用GPT-4 API计算LLM-Match分数;对ScanQA数据集,计算EM@1精确匹配率;

- 统计推理吞吐量、显存占用、单场景推理耗时等效率指标。

(4)复现核心难点与解决方案

| 复现难点 | 核心原因 | 解决方案 |

|---|---|---|

| 相机位姿错位导致3D投影错误,压缩性能暴跌 | 不同数据集的相机坐标系定义、外参变换方向不一致,导致3D坐标计算错误 | 1. 统一所有外参为“世界到相机”的变换,严格遵循针孔相机模型的逆变换公式; 2. 用Open3D可视化投影后的点云,验证3D坐标的准确性; 3. 对深度图做外点剔除,避免无效深度值导致的坐标偏移 |

| 相似度计算效率极低,单场景压缩耗时过长 | 循环计算Token两两相似度,时间复杂度高 | 1. 用PyTorch矩阵运算向量化实现余弦相似度计算,批量处理所有Token; 2. 体素化后仅在体素内做匹配,避免全场景的全量匹配; 3. 开启CUDA加速,将相似度计算放到GPU上执行 |

| 压缩后的Token数量不稳定,无法精准控制 | 迭代步长 Δ v \Delta v Δv设置不当,导致单次迭代压缩量波动大 | 1. 设置自适应 Δ v \Delta v Δv,当Token数量远大于目标值时,增大 Δ v \Delta v Δv,接近目标值时减小 Δ v \Delta v Δv; 2. 设置最大迭代次数,避免无限迭代; 3. 每次迭代后统计Token数量,动态调整 r r r值 |

| 不同场景的压缩性能差异大 | 不同场景的物体密度、Token冗余度差异大,固定 r r r值无法适配 | 1. 采用自适应 r r r值,对物体密集的复杂场景降低 r r r值,对简单场景提高 r r r值; 2. 按场景的Token密度分桶,为不同桶设置不同的超参数 |

| LLM推理时出现上下文溢出 | 压缩后的Token数量波动,部分场景超过目标值 | 1. 设置严格的迭代终止条件,确保Token数量≤目标值; 2. 对超出的Token,按相似度做二次压缩; 3. 开启LLM的动态NTK缩放,扩大上下文窗口的适配范围 |

(5)关键超参调优指南

| 超参数 | 推荐取值 | 调优逻辑 |

|---|---|---|

| 初始体素 v i n i t v_{init} vinit | 0.1m | 取值过小会导致体素数量过多,压缩效率低;取值过大会导致初始体素内包含过多不同语义的Token,匹配错误率上升 |

| 迭代步长 Δ v \Delta v Δv | 0.02m | 步长过大会导致Token数量骤降,关键信息丢失;步长过小会导致迭代次数过多,压缩效率低 |

| 相似度保留比例 r r r | 40% | r r r值过大会导致压缩力度不足,Token数量降不下来; r r r值过小会导致过度压缩,关键细节丢失 |

| 目标Token数量 N t a r g e t N_{target} Ntarget | 800~1000 | 取值过大会导致推理效率提升不明显;取值过小会导致性能显著下降 |

| 图像采样帧数 | 12帧 | 帧数过少会导致3D场景覆盖不全,空间理解错误;帧数过多会导致初始Token数量爆炸,压缩难度上升 |

4. 实验结果深度学术剖析

(1)核心实验结果的深层解读

① 为什么DTC的性能远超传统压缩方法?

传统压缩方法的核心缺陷,是与3D QA的任务目标完全错配:

- 帧采样、时间池化等时序压缩方法,本质是丢弃视角信息,而3D QA的核心是3D空间理解,丢失视角就等于丢失了空间关系,因此性能暴跌;

- 空间池化、Token合并等方法,本质是全局平均化,优先保留图像的全局语义,而3D QA的答案往往藏在局部的细粒度细节中,平均化会直接把关键信息抹平;

- 所有传统方法都完全忽略了3D空间先验,仅在2D图像平面做压缩,导致不同空间位置、不同物体的特征被混合,直接让模型的空间理解错乱。

而DTC完美适配了3D QA的任务需求:

- 基于3D体素的压缩,保留了完整的3D空间关系,不会出现空间错乱的问题;

- 动态分辨率的压缩策略,精准保留了小物体、细粒度细节,而这些恰恰是3D QA的答题关键;

- 语义相似度约束的压缩,避免了不同语义的特征混合,不会出现“盒子和墙合并”的特征畸变问题。

这就是DTC在90%压缩比下,依然能保留95%性能的核心原因。

② 为什么DTC在细节敏感型任务上的优势更显著?

从消融实验的类别级结果可以看到,DTC在物体识别、属性识别、物体定位等任务上,比VTC的性能优势超过8个百分点,而在全局型任务上优势较小,其底层原因是:

- VTC的固定体素平均池化,会将小物体与背景合并到同一个体素中,小物体的特征被背景特征淹没,直接导致物体的类别、颜色、数量等信息完全丢失;

- DTC的动态体素化,会为小物体分配更小的体素、保留更多的Token,完整保留了小物体的细粒度特征,因此在细节敏感型任务上优势极为显著。

③ 为什么“保留单个Token”比平均池化效果更好?

平均池化的本质是对多个特征做线性加权,会导致两个问题:

- 特征畸变:即使两个Token语义高度相似,平均后的特征也会偏离原始的特征分布,而VLM是在原始视觉特征上预训练的,分布偏移会直接导致模型的理解能力下降;

- 噪声放大:如果Token中存在噪声特征,平均池化会将噪声扩散到整个体素的特征中,进一步降低特征质量。

而保留单个原始Token,完全避免了特征畸变与噪声放大,最大程度保留了符合VLM预训练分布的原始特征,因此效果最优。这一发现,为后续Token压缩方法的设计提供了关键的理论参考。

(2)实验设计的严谨性分析

论文的实验设计完全符合CVPR顶会的学术标准,核心严谨性体现在三个方面:

- 基线与对比方法的全面性:

论文对比了三大类方法:① 帧采样、时空池化等传统Token缩减方法;② AuroraCap、MovieChat等SOTA多帧VLMs;③ 3D-LLM、Scene-LLM等专门设计的3D-LMM,覆盖了3D QA领域的所有主流范式,对比结果极具说服力。 - 变量控制的严格性:

所有对比实验均使用完全相同的基础模型、输入数据、提示词模板,仅更换Token压缩方法,严格遵循单变量控制原则,确保性能差异完全来自压缩方法本身,排除了其他干扰因素。 - 消融实验的系统性:

论文从压缩策略、Token顺序、超参数、类别级性能等多个维度,做了全面的消融实验,不仅验证了每个模块的有效性,还揭示了3D QA任务中Token压缩的核心规律,实验逻辑闭环完整。

(3)实验结果的局限性

- 场景覆盖的局限性:所有实验均在室内静态小场景上完成,未在室外大场景、动态场景、非刚性场景上做验证,方法的泛化性仍需进一步验证;

- 模型覆盖的局限性:仅在LLaVA-OneVision上做了全面验证,虽然在其他VLM上有初步泛化性测试,但未做系统性的跨模型验证;

- 极端压缩的局限性:当压缩比超过95%时,模型性能出现显著下降,证明方法在极致压缩下的细节保留能力仍有不足;

- 输入依赖的局限性:所有实验均使用数据集的真值深度图与相机位姿,未在有噪声的深度图、估计的相机位姿上做测试,而真实场景中SLAM估计的位姿和深度图必然存在噪声,方法的落地鲁棒性仍需验证。

5. 局限性与未来研究方向

(1)论文方法的核心局限性

- 输入强依赖:必须输入带精准相机位姿的RGB-D图像,对于无深度、无位姿的普通多视图RGB图像,无法完成3D投影与压缩,极大限制了方法的应用场景;

- 场景适配性有限:仅针对静态室内场景设计,对于动态场景中移动物体的时序冗余,无法实现时空联合压缩;对于室外大场景,体素化的计算量与显存占用会指数级上升,压缩效率大幅下降;

- 策略无自适应性:采用固定的启发式压缩策略,无法根据输入问题的类型自适应调整压缩力度——问全局问题时可以更高压缩,问细节问题时自动降低压缩比,实现“问题感知”的智能压缩;

- 无训练优化:方法是完全无训练的启发式策略,没有引入可学习的参数,无法通过数据驱动的方式,学习到3D QA任务中“哪些信息需要保留,哪些可以压缩”的最优策略;

- 压缩极限不足:在95%以上的极致压缩比下,性能出现显著下降,无法实现极致压缩下的性能保持。

(2)未来核心研究方向

- 无位姿/无深度的自适应压缩:结合多视图立体匹配(MVS)与神经辐射场(NeRF),从纯RGB多视图图像中估计深度与相机位姿,摆脱对真值深度和位姿的强依赖,让方法能适配普通手机拍摄的多视图图像;

- 问题感知的可学习压缩框架:将DTC改造为可学习的神经网络模块,与VLM做端到端的联合微调,让模型能根据输入问题的语义,自适应调整压缩策略与Token分配,实现“问什么,保什么”的智能压缩;

- 动态场景的时空联合压缩:结合时序建模,将DTC从空间压缩扩展到时空联合压缩,同时处理3D空间冗余与时间维度的冗余,适配动态场景、长视频的3D问答任务;

- 多模态统一压缩框架:融合RGB图像、点云、激光雷达、文本等多模态输入,实现多模态3D场景信息的统一Token压缩,适配具身智能的多传感器输入场景;

- 极致压缩与检索增强:结合检索与外部记忆机制,在极致压缩比下,通过检索补全丢失的细粒度细节,实现更高压缩比下的性能保持;

- 端侧轻量化适配:结合模型量化、稀疏推理等技术,将DTC方法适配到端侧设备(如机器人、AR眼镜),实现端侧实时的3D场景问答。

6. 隐藏难点与研究挑战

(1)论文未明确提及的实现与落地难点

- 位姿与深度噪声的鲁棒性问题:论文中使用的是真值深度与相机位姿,而真实场景中,SLAM估计的位姿会有漂移,深度图会有噪声、空洞,这些误差会导致3D投影错位,Token分配到错误的体素中,最终压缩性能暴跌,这是方法落地的核心瓶颈;

- 大场景的体素化效率问题:论文中的场景是室内小场景,而室外大场景的空间范围是室内的上千倍,均匀体素化会导致显存与计算量指数级上升,DTC的迭代压缩效率会大幅下降,需要设计八叉树等稀疏体素结构来优化;

- 长尾小物体的语义匹配问题:对于数据集中极少出现的长尾小物体,视觉特征的区分度低,余弦相似度计算容易出现错误匹配,导致不同语义的Token被合并,关键信息丢失;

- 跨模型的泛化性问题:不同VLM的视觉编码器、特征空间分布差异极大,论文中固定的超参数( r r r、 v i n i t v_{init} vinit、 Δ v \Delta v Δv)无法适配所有模型,需要针对不同VLM做自适应的超参数调优;

- 多轮对话的上下文适配问题:论文仅验证了单轮问答,而真实具身场景中需要多轮对话,如何根据历史对话内容,动态调整压缩策略,保留历史对话中关注的物体细节,是落地的关键挑战。

(2)领域内的核心研究空白

- 面向3D QA的端到端可学习Token压缩框架:当前所有方法都是启发式的无训练策略,缺乏端到端优化的、专为3D QA设计的可学习Token压缩框架,这是领域内的核心理论空白;

- 意图感知的动态Token压缩:如何结合大语言模型的推理意图,提前预测问题需要的视觉信息,在压缩阶段就优先保留相关信息,过滤无关信息,实现“意图驱动”的智能压缩,是极具潜力的研究方向;

- 动态3D场景的时空Token压缩:当前所有压缩方法都针对静态场景,缺乏对动态场景中时序冗余、物体运动的建模,动态3D场景的时空联合Token压缩,是视频3D问答、具身智能动态任务的核心技术空白;

- 低资源场景下的鲁棒压缩:如何在深度图有噪声、相机位姿有漂移、图像质量低的真实低资源场景下,依然保持稳定的压缩性能,是方法从实验室走向落地的核心研究空白;

- 多模态3D场景的统一Token压缩:如何融合视觉、点云、音频、文本等多模态信息,实现多模态3D场景的统一Token压缩与语义对齐,是通用具身智能的核心研究方向。

博士一句话总结

这篇论文突破了3D大语言模型领域“3D数据瓶颈与2D VLM性能优势”的核心矛盾,首次提出了结合3D空间先验与视觉语义的动态Token压缩框架,无需额外训练、即插即用,实现了90%+的视觉Token压缩比与95%的3D问答性能保持,不仅在OpenEQA和ScanQA基准上取得了SOTA结果,更为2D预训练大模型向3D场景的低成本适配开辟了全新范式,对具身智能、3D大语言模型的发展具有重要的理论与工程价值。

全阶段核心贡献全景总结

| 阶段 | 一句话核心总结 |

|---|---|

| 小白阶段 | 这篇论文给处理3D场景问答的视觉大模型做了一套“智能精简话术”工具,能把十几张照片的8000多句冗余描述,精简到不到1000句关键信息,让大模型既能跑得快、装得下,又能精准答对3D场景里的各种细节问题,拿来就能用。 |

| 硕士阶段 | 这篇论文提出了基于体素的动态Token压缩(DTC)方法,通过结合3D空间先验与视觉语义相似度,实现了多帧VLM视觉Token的90%+超高比例压缩,同时保留了95%以上的3D问答性能,无需额外训练即可即插即用,在OpenEQA和ScanQA两大基准上超越了现有SOTA方法,同时大幅提升了模型的推理效率。 |

| 博士阶段 | 这篇论文突破了3D大语言模型领域“3D数据瓶颈与2D VLM性能优势”的核心矛盾,首次提出了结合3D空间先验与视觉语义的动态Token压缩框架,无需额外训练、即插即用,实现了90%+的视觉Token压缩比与95%的3D问答性能保持,不仅在OpenEQA和ScanQA基准上取得了SOTA结果,更为2D预训练大模型向3D场景的低成本适配开辟了全新范式,对具身智能、3D大语言模型的发展具有重要的理论与工程价值。 |

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)