2026 AI 应用的“最后一公里”:OpenClaw 与星链4SAPI 的协同实战

一、从“模型过剩”到“调用困境”:2026年开发者的真实焦虑

2026年,人工智能领域已迈入“模型爆发”的深水区。Claude-Opus 4.6 凭借其无与伦比的逻辑推理能力,成为复杂任务的首选;Kimi K2.5 在超长文本理解与深度思考上的表现,重新定义了文档分析的边界;而开源社区的 Llama 4、Qwen 3.5 等模型,则凭借灵活的私有化部署能力,占据了企业应用的半壁江山 。

然而,一个颇具讽刺意味的现象随之浮现:模型越强,调用越乱。对于一线开发者和技术团队而言,真正的痛点早已不是“有没有更好的模型”,而是“如何高效、稳定地用好这些模型”。

每天在十几个网页端之间手动切换、复制粘贴对话,显然是反效率的。真正具备工程思维的团队,早已将目光投向“无感集成层”——让顶级 AI 能力像水电一样,无缝流入飞书对话框、VS Code 编辑器、Obsidian 笔记库,甚至是企业自建的业务系统中。

在这一背景下,OpenClaw 这一开源 AI 代理框架的爆火,绝非偶然。它本质上是一个 “AI 能力适配器”,为上层应用提供了标准化的 Agent 调度能力。但 OpenClaw 解决了“连接”的问题,却无法独自解决“连接质量”的问题——模型调用的稳定性、响应速度、成本控制,需要一个更底层的基础设施来承载。

这正是星链4SAPI 所扮演的角色:作为 AI 时代的 API 聚合与智能路由网关,为 OpenClaw 提供稳定、高效、低成本的模型调用能力 。

二、OpenClaw 的“触角”能伸向哪些场景?

基于 OpenClaw 的 Agent 调度能力,配合星链4SAPI 的统一接入层,开发者可以在几乎所有的生产力工具中,植入顶级的 AI 能力。

1. 办公协同类:飞书 / 钉钉 / 企业微信

-

技术实现:通过 OpenClaw 的 IM 平台适配插件,将机器人接入群聊 。模型调用层指向星链4SAPI,实现统一的 API 密钥管理。

-

落地价值:某技术团队利用 Claude-Opus 4.6 自动处理日均数千条用户反馈,通过 OpenClaw 的工作流编排,将非结构化投诉自动归类为结构化 Bug 报告,整体处理效率提升 400% 。

2. 知识管理类:Obsidian / Notion / Logseq

-

技术实现:利用 OpenClaw 的文件读写 Skill,监听笔记库变更。当新增笔记时,自动调用 Kimi K2.5 的长文本模型进行摘要、打标签,并将结果写回元数据。

-

落地价值:知识工作者可在 Obsidian 内实现“对话式检索”,基于过去积累的百万字笔记库,构建私有的 AI 问答引擎,彻底解决大模型对私有数据“一无所知”的困境 。

3. 开发工具类:VS Code / Cursor / JetBrains

-

技术实现:在 IDE 插件中配置自定义 API 端点,指向星链4SAPI 的统一接入地址(如

https://4sapi.com/v1),模型选择claude-opus-4.6或gpt-5.3-codex。 -

落地价值:独立开发者反馈,原本需要一周完成的复杂功能开发,通过自然语言描述需求,由 AI 生成核心代码逻辑,上线周期压缩至两天。

4. 低代码平台:Dify / FastGPT / Coze

-

技术实现:在低代码平台的自定义模型提供商中,填写星链4SAPI 的 base_url 和 API Key,即可将平台内置的工作流引擎与顶级模型打通。

-

落地价值:某电商公司利用 Dify 搭建的智能客服,通过星链4SAPI 调用 DeepSeek-V3 模型,不仅理解产品参数,还能结合实时促销策略给出推荐,问题解决率提升至 95%。

三、技术视角:为什么是星链4SAPI?

或许有人会问:OpenClaw 不是可以直接配置官方 API 吗?为什么中间要加一层星链4SAPI?

从纯工程角度看,直连方案在单 Agent 场景下或许可行,但在多 Agent、高并发的生产环境中,会暴露出三个致命短板 :

-

协议碎片化:Anthropic 的 Messages API、Google 的 Gemini SDK、各家国产模型的定制接口——每一个模型都有自己的调用规范。OpenClaw 的 Agent 如果要对接多个模型,代码中会充斥着适配层胶水代码,维护成本呈指数级上升。

-

网络不稳定:对于国内开发环境,直连海外官方接口的延迟波动极大,实测平均响应时常超过 2 秒,丢包率在高并发场景下难以控制。这对于依赖多轮调用的 Agent 工作流而言,是致命的 。

-

账号风险与成本失控:单个 API Key 在高频调用下极易触发官方风控;多厂商、多币种的账单管理,让成本核算变成一场噩梦。

星链4SAPI 的核心价值,正是在 OpenClaw 与模型厂商之间构建了一个稳定的“中间层” :

-

协议归一化:将所有下游模型的 API 协议,统一映射为开发者熟悉的 OpenAI 标准格式。OpenClaw 只需维护一套调用逻辑,切换模型只需修改

model字段。 -

智能路由与负载均衡:在全球部署边缘加速节点,实时监控各上游服务的健康状态。当某个节点出现波动时,毫秒级切换到备用线路,实测可用性维持在 99.9% 以上 。

-

企业级账号池:后端维护了与企业官方合作的专用算力通道,将高并发请求均匀分发至多个企业账号,有效规避单账号限流与封禁风险。

-

聚合计费与监控:提供统一的管理控制台,所有模型调用消耗均以人民币结算,每一笔请求的 Token 消耗、延迟数据都可追溯 。

四、深度实战:OpenClaw + 星链4SAPI 的三个典型架构

场景一:构建高可用的企业级 IM 机器人

痛点:很多企业的飞书/钉钉机器人频繁“失联”,根本原因在于后端直连的官方 API 稳定性不足。

架构方案:

-

OpenClaw 部署为后端服务,通过官方插件接入飞书 。

-

在 OpenClaw 的模型配置文件中,将 base_url 指向星链4SAPI 的接入点,API Key 替换为星链的统一密钥。

-

利用星链4SAPI 的智能负载均衡能力,将用户请求均匀分发至多个可用节点。

实际效果:某外贸企业接入后,面向海外客户的 24 小时咨询机器人,在多时区高并发场景下依然保持秒级响应,问题解决准确率稳定在 95% 以上。

场景二:多 Agent 协同的“分级模型路由”

痛点:在多 Agent 工作流中,所有任务都用顶级模型是一种巨大的成本浪费。

架构方案:

某技术团队搭建的“调研-写作-审查”三 Agent 写作流水线,给出了一个经典实践 :

-

调研 Agent:配置 GPT-4o-mini(低成本),负责信息检索与初步整理。

-

写作 Agent:配置 Claude Sonnet(中档),负责长文生成。

-

审查 Agent:配置 Claude Opus(顶配),负责逻辑校验与事实核查。

实际效果:通过星链4SAPI 的统一密钥,在同一套代码中实现了不同厂商、不同档位模型的无缝切换。相较于全流程使用 Opus,Token 成本降低 60%-70%。

场景三:基于私有知识库的 RAG 增强

痛点:大模型对私有数据一无所知,且容易产生幻觉。

架构方案:

-

利用 OpenClaw 的 Skill 机制,将内部文档(技术手册、产品说明)存入指定存储。

-

通过星链4SAPI 内置的向量检索能力,在用户提问时,自动召回最相关的上下文片段,拼接到 Prompt 中再喂给大模型 。

实际效果:这种“检索+生成”的闭环,有效抑制了 GPT-5.4、Claude-4.6 等模型的幻觉问题,让 AI 的回答真正“有据可依”。

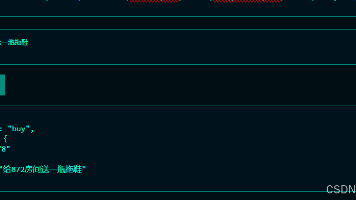

五、开发者视角:接入星链4SAPI 的代码示意

对于已经熟悉 OpenAI SDK 的开发者而言,接入星链4SAPI 几乎没有学习成本。以下是一个典型的 OpenClaw 模型配置示例(Python 伪代码):

python

from openai import OpenAI

# 唯一需要修改的部分:base_url 和 api_key

client = OpenAI(

api_key="你的星链4SAPI_Key",

base_url="https://4sapi.com/v1" # 统一接入端点

)

# 调用 Claude-Opus-4.6

response = client.chat.completions.create(

model="claude-opus-4.6",

messages=[{"role": "user", "content": "分析这段代码的性能瓶颈"}]

)

# 切换模型只需改一个参数

response_cheap = client.chat.completions.create(

model="gpt-4o-mini",

messages=[{"role": "user", "content": "简单总结一下"}]

)这段代码清晰地展示了星链4SAPI 的核心价值:开发者只需关注业务逻辑和 model 参数的选择,其余的一切——接口协议、网络优化、负载均衡、账号管理——全部交给聚合层处理 。

六、结语:AI 工程化的核心是“抽象”

2026 年,模型的“诸神之战”仍在继续。但作为一名技术从业者,我们需要清醒地认识到:真正拉开效率差距的,往往不是模型本身的性能,而是调用模型的工程架构。

OpenClaw 解决了 Agent 层面的“连接”与“编排”,而星链4SAPI 则在更底层解决了“如何稳定、高效、低成本地调用模型”这一工程化难题。它不是一个具体的模型,而是一个 AI 时代的“协议转换器”与“流量调度中心” 。

当你还在为每一个新模型的接入而加班重构代码时,懂得运用聚合层的开发者,已经在飞书、VS Code、Obsidian 中,通过一套代码、一个 Key,调动着整个 AI 生态的顶级能力。

这,或许就是 2026 年,AI 工程化思维带来的核心红利。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献35条内容

已为社区贡献35条内容

所有评论(0)