ollama v0.18.1 版本完整更新详解:OpenClaw 联网搜索、无头模式、模型基准测试全解析

前言

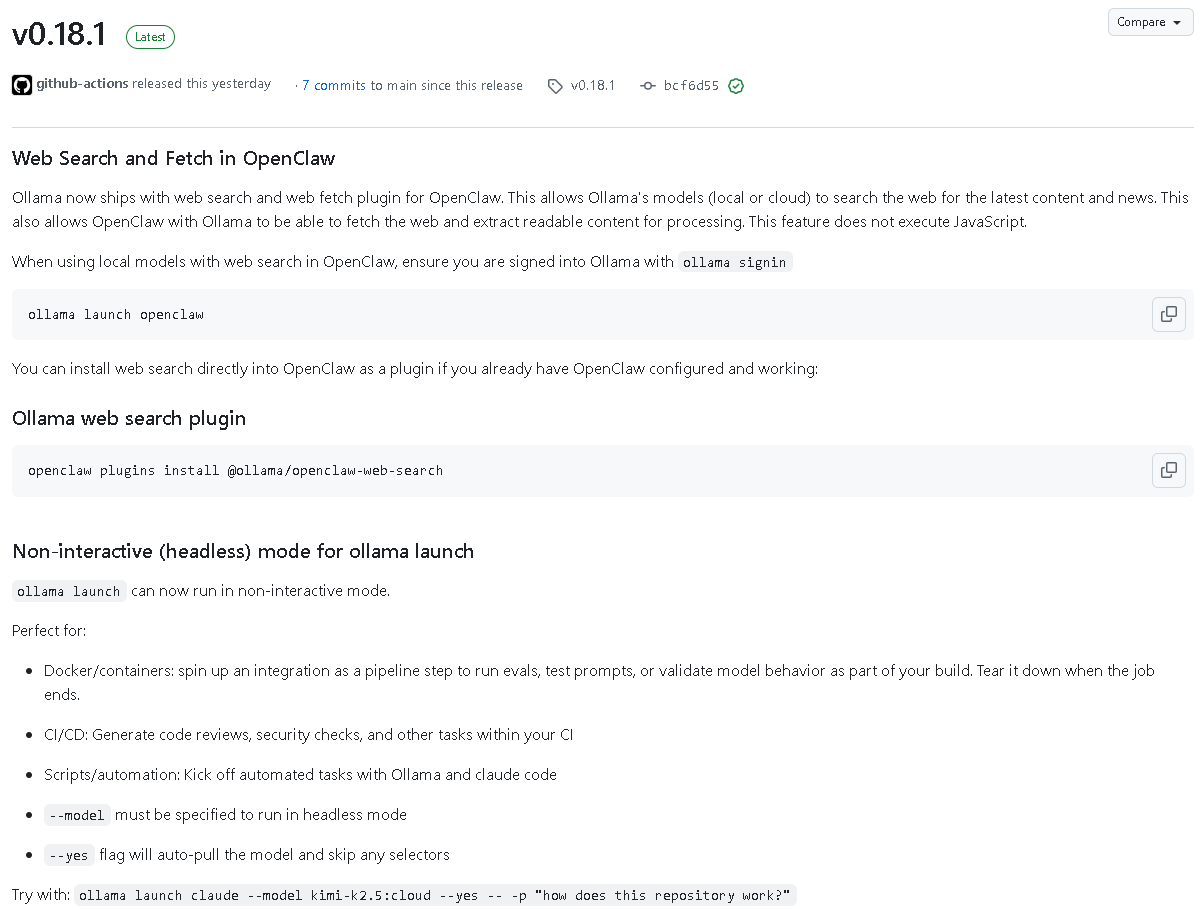

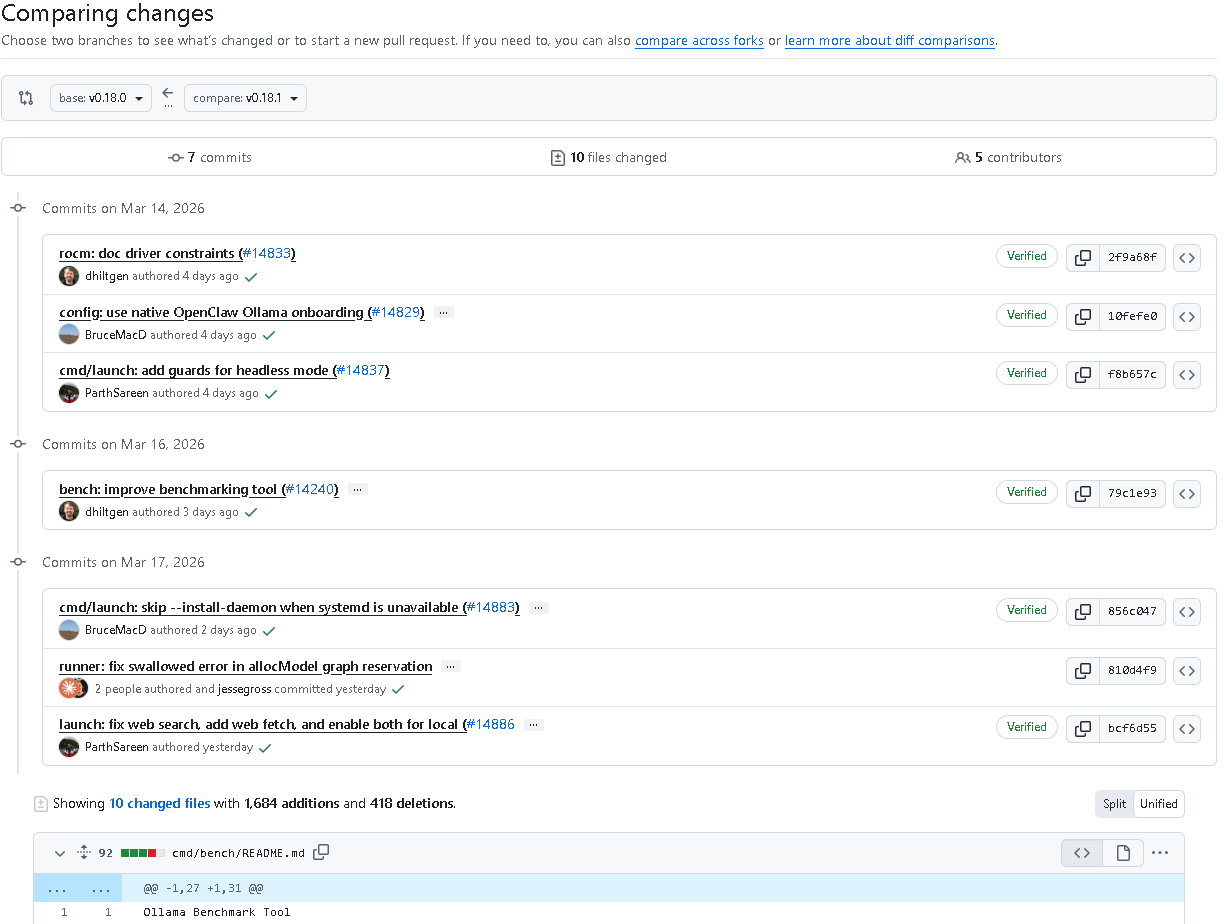

Ollama 作为当下最流行的本地大模型运行工具,凭借极简的部署方式、丰富的模型支持、跨平台兼容能力,成为 AI 开发者、运维人员、后端工程师本地运行、测试、集成大模型的首选方案。在 2026 年 3 月 17 日,Ollama 正式推出 v0.18.1 版本,这是一次面向工程化、自动化、联网能力、性能测试的重量级更新。

本次版本核心围绕 OpenClaw 集成、Web Search、无头运行模式、模型基准测试工具、系统兼容性、显卡驱动支持等方面进行了大量重构与增强。对于经常在本地运行模型、需要做 CI/CD 集成、做模型性能对比、在容器环境部署 Ollama 的开发者来说,v0.18.1 解决了大量实际工程痛点。

本文将基于官方发布内容,完整、细致、无遗漏地讲解 ollama v0.18.1 所有更新内容、使用方式、命令示例、配置变化、代码改动与适配说明,帮助大家快速上手新版本所有能力。

一、ollama v0.18.1 版本整体概览

ollama v0.18.1 于 2026 年 3 月 17 日正式发布,本次更新主要包含以下几大方向:

- OpenClaw 集成官方 Ollama 认证与模型服务,不再使用第三方授权。

- 为 OpenClaw 提供官方 Web Search 与 Web Fetch 插件,本地模型与云端模型均可使用联网能力。

- 新增

ollama launch无头(非交互、headless)运行模式,支持 Docker、CI/CD、自动化脚本。 - 大幅优化内置 Go 语言编写的模型基准测试工具,支持 TTFT、VRAM 监控、预热、CSV 输出。

- 完善 Linux 环境下 systemd 不存在时的兼容逻辑,自动跳过守护进程安装。

- 修复底层模型分配、错误捕获、版本对比、插件校验等问题。

- 完善 AMD GPU 驱动约束说明,明确 ROCm 7 版本要求,优化显卡问题排查。

本次提交共计 7 次提交,涉及 10 个文件修改,5 位贡献者参与,代码新增 1684 行、删除 418 行,属于功能与稳定性并重的版本。

二、OpenClaw 全新集成:官方 Ollama 授权 + 网页搜索与抓取

OpenClaw 是 Ollama 生态中非常重要的助手集成框架,在 v0.18.1 中,Ollama 对 OpenClaw 进行了彻底重构,统一使用 Ollama 官方账号体系与模型服务,同时带来了最受期待的联网搜索、网页内容抓取能力。

2.1 Web Search 与 Web Fetch 插件

ollama v0.18.1 为 OpenClaw 内置了 Ollama 官方的网页搜索与网页抓取插件,这意味着:

- Ollama 的本地模型与云端模型,都可以通过 OpenClaw 访问互联网最新内容、新闻、资料。

- OpenClaw 可以抓取网页并提取可读文本,交给模型进行理解、总结、处理。

- 该功能不会执行 JavaScript,保证安全、轻量、无风险。

2.1.1 使用本地模型 + 网页搜索的前提

在 OpenClaw 中使用本地模型并开启网页搜索,必须先完成 Ollama 登录:

ollama signin

登录完成后,直接启动 OpenClaw:

ollama launch openclaw

2.1.2 单独安装网页搜索插件

如果你已经配置并正常使用 OpenClaw,可以不重新初始化,直接安装插件:

openclaw plugins install @ollama/openclaw-web-search

2.2 OpenClaw 授权与初始化逻辑重构

在旧版本中,OpenClaw 有独立的引导流程与授权体系,v0.18.1 做出以下关键修改:

ollama launch openclaw统一使用 Ollama 官方认证体系与模型提供商。- 初始化流程改为非交互模式,自动完成配置、网关设置、模型绑定。

- 自动覆盖旧版 openclaw.json 配置,并重新应用模型配置。

- 安装时会优先自动更新 OpenClaw,确保使用最新引导参数。

- 新增

--auth-choice ollama标识,直接使用 Ollama 账号体系。 - 自动配置自定义网关地址与模型 ID,不再需要手动修改配置文件。

2.3 插件版本自动校验机制

为了保证联网功能稳定,ollama v0.18.1 增加了严格的插件版本检查:

- 网页搜索插件最低要求版本:

0.2.1 - 程序会自动检查

package.json中的版本号。 - 低于最低版本时,会自动重新安装插件。

- 支持语义化版本比较,自动处理带 v 与不带 v 的版本号格式。

同时,系统会自动:

- 注册插件并设置为启用状态。

- 关闭 OpenClaw 内置的网页搜索与抓取,避免冲突。

- 将

ollama_web_search、ollama_web_fetch加入白名单,确保权限通过策略校验。

2.4 守护进程安装兼容优化

在 Linux 环境中,很多 Docker 容器、精简系统没有 systemd。ollama v0.18.1 增加了自动判断逻辑:

- 判断

/run/systemd/system是否存在。 - 判断环境变量

XDG_RUNTIME_DIR是否存在。 - 不满足条件时,自动跳过

--install-daemon参数,不再尝试安装系统服务。 - 无 systemd 环境直接以前台进程方式运行网关,保证在容器内正常运行。

这一改动极大提升了在 Docker、Kubernetes、精简 Linux 系统上的兼容性。

三、ollama launch 无头(非交互)运行模式

这是本次更新对运维、自动化、CI/CD、开发流水线最有价值的功能:ollama launch 支持无头(非交互、headless)模式。

3.1 无头模式适用场景

-

Docker / 容器环境

在构建流水线中启动模型集成,运行评估、测试提示词、验证模型行为,任务结束后自动销毁。 -

CI/CD 流水线

在自动化流程中执行代码审查、安全检查、批量生成、模型验证等任务。 -

脚本与自动化任务

使用 Ollama 与 Claude 相关能力编写自动化脚本,无人值守运行。

3.2 无头模式使用规则

- 必须使用

--model指定模型,不能使用交互式选择。 - 可使用

--yes自动拉取缺失模型,跳过所有选择交互。 - 无终端输入输出时,会直接抛出明确错误,引导用户使用无头模式。

3.3 无头模式使用示例

基础启动命令:

ollama launch claude --model kimi-k2.5:cloud --yes -- -p "how does this repository work?"

在 OpenClaw 中使用子代理执行任务:

ollama launch claude --model kimi-k2.5:cloud --yes -- -p "how does this repository work?" using a subagent

这种方式可以完全在脚本、CI 中运行,不需要人工干预,是企业级 AI 自动化的关键能力。

3.4 终端交互判断逻辑

ollama v0.18.1 在代码层面增加了终端判断:

- 检查标准输入、标准输出是否为终端。

- 非终端环境下禁止交互式模型选择。

- 直接提示:模型选择需要交互式终端,请使用

--model运行在无头模式。

这让脚本、后台运行、管道调用时不会卡住,而是直接报错并给出解决方案,非常工程化。

四、Ollama 基准测试工具全面增强

ollama v0.18.1 对内置的 ollama-bench 基准测试工具进行了大规模升级,该工具由 Go 语言编写,用于模型性能压测、对比、数据输出。

4.1 新版 Benchmark 工具核心功能

- 一次运行测试多个模型。

- 支持文本与图像提示词。

- 可配置温度、最大 Token、随机种子等生成参数。

- 支持预热阶段(warmup),让测试结果更稳定。

- 支持 TTFT(首词时延)监控。

- 实时监控 VRAM 与 CPU 内存占用。

- 支持固定提示词 Token 长度,保证测试可复现。

- 输出格式支持:benchstat、CSV。

- 展示模型参数、量化等级、模型系列、体积、显存占用。

4.2 可观测指标说明

工具会输出以下关键性能指标:

- prefill:提示词处理时间,单位 ns/token。

- generate:文本生成时间,单位 ns/token。

- ttft:从请求到输出第一个字符的时延。

- load:模型加载耗时(一次性开销)。

- total:请求总耗时。

同时会输出模型信息:

- Params:参数量(如 4.3B)

- Quant:量化等级(如 Q4_K_M)

- Family:模型系列(如 gemma3)

- Size:模型文件大小

- VRAM:显卡显存占用(Size > VRAM 表示部分加载到内存)

4.3 编译与运行方式

4.3.1 编译二进制

go build -o ollama-bench ./cmd/bench

运行:

./ollama-bench -model gemma3 -epochs 6 -format csv

4.3.2 直接 go run 运行

go run ./cmd/bench -model gemma3 -epochs 3

4.4 常用命令示例

4.4.1 基础性能测试

./ollama-bench -model llama3 -epochs 10 -temperature 0.7 -max-tokens 500 -seed 42 -warmup 2 -format csv -output results.csv

4.4.2 图片模型测试

./ollama-bench -model qwen3-vl -image photo.jpg -epochs 6 -max-tokens 100 -p "Describe this image"

4.4.3 固定提示词 Token 数量

./ollama-bench -model gemma3 -epochs 6 -prompt-tokens 512

4.5 benchstat 格式使用

benchstat 是 Go 生态标准性能分析工具,ollama-bench 默认输出该格式。

保存结果:

./ollama-bench -model gemma3 -epochs 6 > gemma3.bench

按阶段统计:

benchstat -col /step gemma3.bench

对比两次优化前后性能:

./ollama-bench -model gemma3 -epochs 6 > before.bench

# 修改后重新测试

./ollama-bench -model gemma3 -epochs 6 > after.bench

benchstat before.bench after.bench

4.6 CSV 机器可读格式

可直接导出为 CSV,用于 Excel、Python 绘图、报表、数据库入库:

./ollama-bench -model gemma3 -format csv -output result.csv

CSV 包含字段:名称、阶段、计数、每计数纳秒、每秒 Token 数,方便后续数据分析。

4.7 命令行参数完整说明

-model:待测试模型,必填,支持多个用逗号分隔。-epochs:每个模型运行轮次,默认 6。-max-tokens:最大生成 Token,默认 200。-temperature:生成温度,默认 0.0。-seed:随机种子,0 为随机。-timeout:超时时间,单位秒。-p:提示词内容。-image:图片路径,用于多模态测试。-k:保活时间。-format:输出格式 benchstat / csv。-output:输出文件,默认标准输出。-warmup:预热次数,默认 1。-prompt-tokens:指定提示词 Token 长度。-v:详细日志。-debug:调试日志。

五、模型拉取逻辑优化

ollama v0.18.1 优化了模型不存在时的提示信息:

- 旧版仅提示执行

ollama pull。 - 新版提示:可手动 pull,或使用

--yes自动拉取模型。

配合无头模式,在自动化脚本中直接使用 --yes 即可实现全自动环境初始化,不需要人工判断模型是否存在。

六、错误修复与底层优化

6.1 模型分配错误修复

修复了 allocModel 中错误被吞掉的问题:

- 旧版在图资源预留失败时直接返回 nil,错误丢失。

- 新版会返回真实错误,方便排查显存不足、资源抢占问题。

6.2 网页搜索插件修复

- 修复网页搜索底层逻辑问题。

- 增加网页抓取(fetch)能力。

- 本地模型与云端模型统一启用联网能力。

6.3 无头模式守卫逻辑

增加多项校验,确保无头模式必须携带 --model,避免非法运行。

七、AMD GPU 支持与驱动兼容说明

ollama v0.18.1 完善了 AMD 显卡支持文档,明确驱动要求与排查方案。

7.1 ROCm 驱动版本要求

Linux 下使用 AMD GPU 必须升级到 ROCm 7 驱动,Ollama 内置的 ROCm 7 库不兼容旧版驱动。

如果使用 ROCm 6.x 及更早版本,会出现:

- GPU 发现超时。

- 一直卡在 GPU 初始化。

- 最终自动降级到 CPU 运行。

升级方式:使用 amdgpu-install 工具安装 ROCm 7 官方驱动,升级后重启系统。

7.2 GPU 问题排查方法

- 开启调试日志:

OLLAMA_DEBUG=1

- 查看内核日志:

sudo dmesg | grep -i amdgpu

sudo dmesg | grep -i kfd

- 检查驱动版本是否为 ROCm 7。

- 多卡环境出现乱输出,需要参考官方多卡适配方案。

八、ollama v0.18.1 对开发者的实际价值

-

本地模型终于可以联网

过去本地模型只能使用训练数据,现在通过 OpenClaw 插件直接获取实时信息,实用性大幅提升。 -

真正支持生产级自动化

无头模式 + CI/CD + Docker,让 Ollama 从玩具工具变成可用于自动化、测试、流水线的工程组件。 -

标准化性能测试

内置 Go 基准测试工具,支持量化、显存、TTFT、吞吐量、预热、复现测试,非常适合模型优化、硬件对比。 -

Linux/容器兼容性极大增强

自动判断 systemd、自动跳过守护进程、非交互运行,在云原生环境几乎零报错。 -

OpenClaw 走向官方化、统一化

不再分散授权,全部接入 Ollama 生态,后续更新与维护更稳定。

九、总结

代码地址:github.com/ollama/ollama

ollama v0.18.1 是一次偏向工程化、自动化、企业化的重要版本,不再只是简单的模型运行工具,而是朝着:

- 本地模型 + 联网能力

- 云原生、容器、CI/CD 友好

- 标准化性能测试与评估

- 高兼容、高稳定、可观测

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献23条内容

已为社区贡献23条内容

所有评论(0)