可信AI、AI测评与AI治理:为什么人工智能不仅要聪明,更要可信、可评与可管

作者:非凡大爹|版本:v1|日期:2026-03-18|DocID:AI-Trust-Eval-Governance-2026-03-LD-V1

原创声明:本文为原创学习与研究整理稿,首发于CSDN,转载请注明出处。

文章目录

摘要

随着人工智能快速进入教育、科研、办公、医疗、金融和公共服务等真实场景,人们关注的重点已不再只是“AI能做什么”,而进一步转向“AI能不能被放心使用”。围绕这一问题,当前人工智能领域逐渐形成了三个彼此关联的核心概念,即可信AI、AI测评与AI治理。其中,可信AI回答的是“什么样的AI值得信任”,AI测评回答的是“如何判断AI是否值得信任”,AI治理回答的是“如何通过制度、规则、流程和责任机制确保AI持续处于可控、合规与可信状态”。本文从概念内涵、逻辑关系和现实意义三个层面,对三者进行系统梳理,以期为人工智能教学、研究与应用提供一个较为清晰的理解框架[1-4]。

关键词: 可信人工智能;AI测评;AI治理;人工智能风险管理;生成式人工智能

一、引言

近几年,人工智能尤其是大模型与生成式人工智能的发展速度极快。它们在文本生成、代码生成、知识问答、图像理解、智能助手等方面展现出很强的能力,推动了人工智能从实验室走向真实应用场景。然而,随着AI影响不断扩大,一个更本质的问题也随之凸显:AI不仅要“有能力”,还要“值得信任”。

在这一背景下,学术界、产业界以及国际组织越来越重视三个概念:可信AI、AI测评与AI治理。三者既相互联系,又各有侧重,共同构成当前人工智能高质量发展的重要理论与实践框架[1-4]。

二、什么是可信AI?

1. 可信AI的基本含义

所谓可信AI(Trustworthy AI),并不只是指模型能力强、回答快或者生成内容流畅,而是指一个AI系统在特定应用场景中,能够在有效性、可靠性、安全性、透明性、可解释性、隐私保护、公平性和可问责性等方面达到可接受水平,从而值得个人、组织和社会信任[1][5]。

从本质上看,可信AI强调的不是“AI会不会做”,而是“AI做得对不对、稳不稳、安不安全、出了问题能不能解释和纠正”。这意味着,一个AI系统即便表现得很“聪明”,如果经常出现幻觉、带有明显偏见、容易被恶意诱导,或者在关键场景下无法解释其结论,那么它仍然不能算是真正意义上的可信AI[1][5]。

2. 国际主流框架中的可信AI

NIST(National Institute of Standards and Technology,美国国家标准与技术研究院)在《Artificial Intelligence Risk Management Framework (AI RMF 1.0)》中指出,可信AI通常应具有以下关键特征:有效且可靠、安全、安保与韧性、可问责与透明、可解释与可理解、隐私增强,以及公平且有害偏差得到管理[1]。

与此同时,OECD(Organisation for Economic Co-operation and Development ,经济合作与发展组织)强调AI应当是创新且值得信赖的,并应尊重人权、民主价值和法治[2]。欧盟高层专家组在《Ethics Guidelines for Trustworthy AI》中也提出,可信AI应当满足合法、合伦理和技术稳健三个层面的要求[5]。

3. 对可信AI的通俗理解

可以把可信AI概括为一句话:

可信AI,就是能够被人类放心使用的人工智能。

它不仅要“能力强”,还要“风险可控”;不仅要“能做事”,还要“能负责任地做事”。

三、什么是AI测评?

1. AI测评的基本含义

AI测评(AI Evaluation),是指对AI系统进行系统化、结构化检验的过程。它的目的不是简单给AI打一个“高分”或“低分”,而是综合判断AI系统的能力边界、适用条件、潜在风险以及真实场景中的表现[1]。

因此,AI测评不仅测“性能”,也测“风险”;不仅测“能不能做”,也测“在什么条件下会失效”;不仅关注模型本身,也关注模型在实际应用中的整体效果。

2. AI测评不只是跑分

过去人们理解AI测评,往往停留在 benchmark 层面,比如准确率、通过率、得分率等。但在大模型时代,仅靠公开题库上的高分,已经不足以说明一个系统在现实环境中同样可靠。原因在于,真实场景具有更强的不确定性、开放性和复杂性,模型可能在看似简单的问题上出现幻觉,也可能在边界条件下表现失常[1]。

因此,现代AI测评已经逐渐从单一的“性能比较”转向“能力评估 + 风险评估 + 场景评估”一体化框架[1]。

3. AI测评关注的主要内容

从研究和应用实践看,AI测评至少包括以下几个方面:

(1)能力测评

主要检验AI系统是否具备预期功能,如语言理解、推理、数学、代码生成、多模态理解等。

(2)可靠性与稳健性测评

主要检验模型在复杂输入、异常情境、对抗干扰或开放问题下是否依旧稳定。

(3)安全性测评

主要考察模型是否容易输出危险内容、违规内容、有害建议,或被恶意提示词利用。

(4)公平性与偏差测评

主要检验模型在面对不同群体、不同语境时,是否存在系统性偏见或不公正输出。

(5)场景化应用测评

主要关注AI进入真实业务或教学场景后,是否真正有效、是否提升效率、是否带来新的隐患。

4. AI测评的意义

AI测评的真正价值,在于帮助我们回答以下问题:

- 这个AI系统到底强在哪里?

- 它的能力边界在哪里?

- 它在哪些条件下可能失效?

- 它是否适合进入真实应用场景?

- 它是否达到了可信使用的基本要求?

因此,可以说:AI测评是连接技术能力与可信应用之间的重要桥梁。

四、什么是AI治理?

1. AI治理的基本含义

如果说可信AI强调“目标”,AI测评强调“验证”,那么AI治理(AI Governance) 强调的就是“保障机制”。

AI治理是指通过规则、制度、流程、组织分工、监督机制和责任体系,确保AI系统在设计、开发、训练、部署、应用和迭代的全过程中,始终保持在可控、合规、负责和可信的状态[1-4]。

2. AI治理为什么重要?

人工智能一旦进入教育、医疗、招聘、金融、公共决策等领域,其影响就不再局限于技术层面,而会直接影响个体权益、组织运行乃至社会秩序。此时,仅靠“模型本身很强”显然不够,还必须考虑以下问题:

- 训练数据是否合法合规?

- 系统上线前是否经过充分测评?

- 上线后是否有监测和反馈机制?

- 出现错误后是否能追责和纠偏?

- 是否保留必要的人类监督和干预能力?

这些问题,已经不再只是技术问题,而是治理问题。

3. 国际视角下的AI治理

NIST 在 AI RMF 中把 Govern 放在整个框架的重要位置,并强调治理功能贯穿其他环节[1]。OECD 将负责任治理视为推动可信AI的重要基础[2]。UNESCO 在《人工智能伦理建议书》中强调,人工智能发展应以人权、人的尊严、透明、公平、问责和人类监督为基础[3]。欧盟《AI Act》则体现了典型的基于风险的治理思路,对不同风险等级的AI系统提出不同监管要求[4]。

4. AI治理的核心特征

AI治理关注的不是一次性检查,而是全生命周期管理。它强调:

- 事前有规则

- 事中有监测

- 事后有追责

- 持续有改进

因此,AI治理不是附加项,而是推动AI从“技术可用”走向“社会可用”的关键支撑。

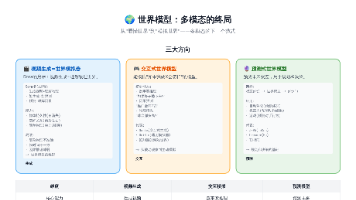

五、可信AI、AI测评与AI治理的关系

这三者之间的关系,可以用一句话概括:

可信AI是目标,AI测评是手段,AI治理是保障。

其中:

- 可信AI解决的是“要达到什么状态”的问题;

- AI测评解决的是“如何判断是否达到”的问题;

- AI治理解决的是“如何确保其持续达标”的问题。

三者缺一不可。

如果没有可信AI这一目标,AI发展容易只看能力不看后果;

如果没有AI测评这一手段,所谓“可信”就可能流于口号;

如果没有AI治理这一保障,测评结果也可能只是一次性的展示,而无法支撑长期、稳定、可控的实际应用[1-4]。

从更完整的逻辑看,三者共同形成了一个闭环:

目标设定(可信AI) → 状态验证(AI测评) → 过程保障(AI治理)

这也是当前人工智能从“模型竞赛”走向“系统建设”的重要标志。

六、为什么这三个概念越来越重要?

当前,人工智能已经不再只是研究论文中的模型,而是逐步成为教育、医疗、办公、金融和公共服务中的基础能力。AI一旦嵌入这些高影响场景,错误输出、偏见决策、隐私泄露、不可解释推荐等问题的后果就会被显著放大。

因此,未来人工智能的核心竞争力,不再只是“谁更聪明”,而是:

- 谁更可信

- 谁更可评

- 谁更可管

- 谁更能稳定落地

这意味着,人工智能的发展逻辑正在发生深刻变化:过去重视的是“更高性能”,今天越来越重视的是“更可信的系统、更系统的测评和更稳健的治理”[1-4]。

七、结语

可信AI、AI测评与AI治理,是理解当前人工智能发展方向的三个关键概念。它们分别从价值目标、验证方法和制度保障三个维度,构成了人工智能高质量发展的基本框架。

对于研究者而言,这意味着人工智能研究不能只停留在模型性能提升上,还要进入风险管理、评价方法和责任机制的系统研究;对于企业而言,这意味着AI竞争不再只是模型竞争,更是治理能力与落地能力的竞争;对于教育者和普通用户而言,这意味着我们评价AI时,不能只问“它厉不厉害”,还要进一步追问:

- 它值不值得信?

- 我们如何验证?

- 谁来负责管理?

真正先进的人工智能,不只是聪明,更要可信、可评与可管。

参考文献

[1] TABASSI E, HARRIS D, EMMERT-STREIB F, et al. Artificial Intelligence Risk Management Framework (AI RMF 1.0)[EB/OL]. Gaithersburg: National Institute of Standards and Technology, 2023[2026-03-18].

[2] OECD. OECD AI Principles[EB/OL]. Paris: OECD, 2019[2026-03-18].

[3] UNESCO. Recommendation on the Ethics of Artificial Intelligence[EB/OL]. Paris: UNESCO, 2021[2026-03-18].

[4] EUROPEAN PARLIAMENT, COUNCIL OF THE EUROPEAN UNION. Regulation (EU) 2024/1689 of the European Parliament and of the Council of 13 June 2024 laying down harmonised rules on artificial intelligence (Artificial Intelligence Act)[S/OL]. Luxembourg: Publications Office of the European Union, 2024[2026-03-18].

[5] EUROPEAN COMMISSION HIGH-LEVEL EXPERT GROUP ON ARTIFICIAL INTELLIGENCE. Ethics Guidelines for Trustworthy AI[EB/OL]. Brussels: European Commission, 2019[2026-03-18].

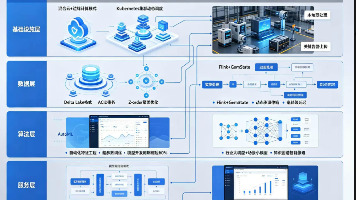

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)