【无标题】

AI 核心概念

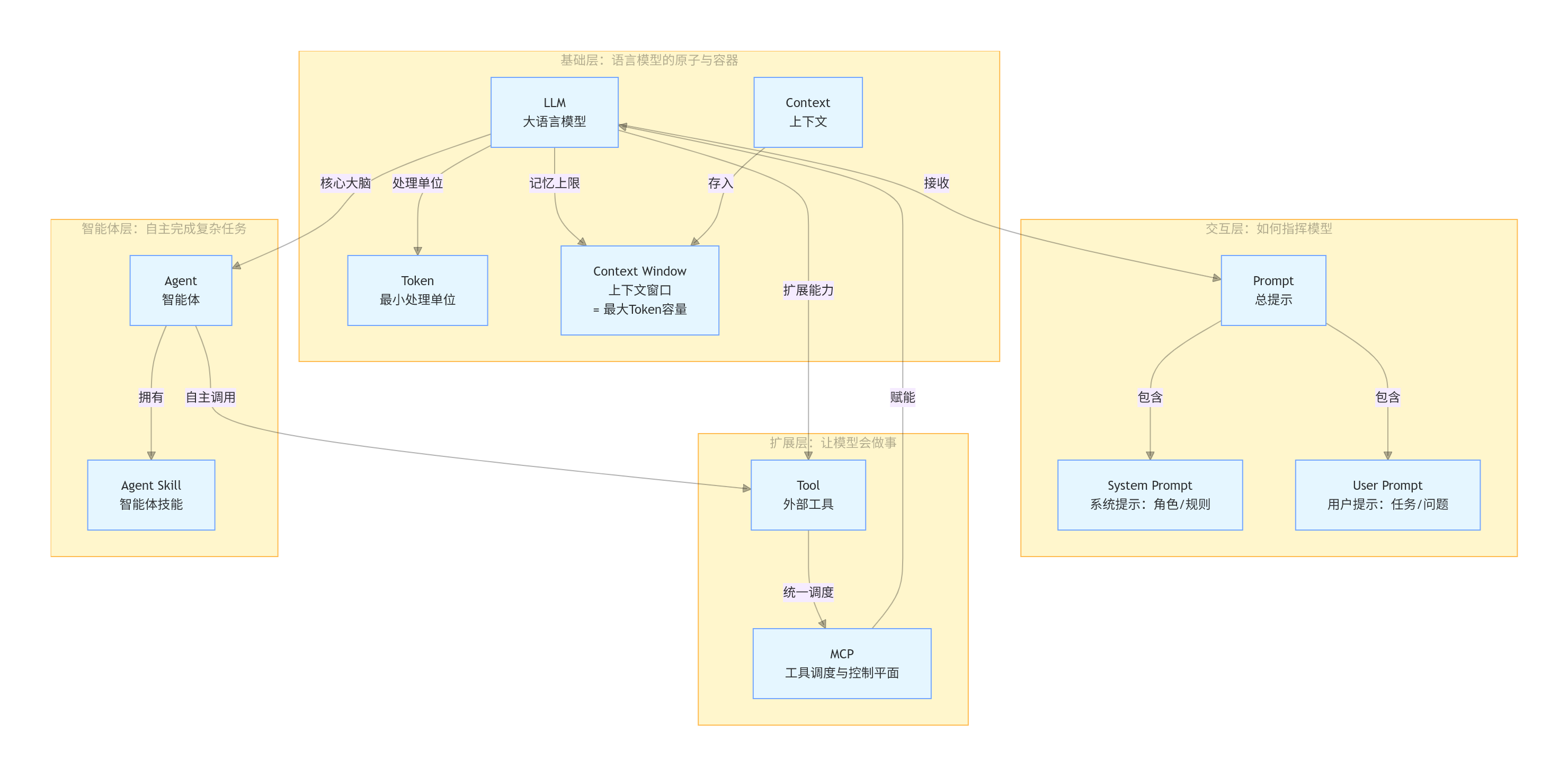

AI 核心概念大串联:LLM, Token, Context, Context Window, Prompt, User Prompt, System Prompt, Tool, MCP, Agent, Agent Skill

LLM 以 Token 为单位,在 Context Window 容纳的 Context 里,通过 System Prompt 设定身份、User Prompt 接收任务,借助 MCP 调度各种 Tool,让 Agent 可以使用不同 Skill 自主完成复杂任务。

一、基础层:语言模型的“原子与容器”

1. LLM(Large Language Model)

大语言模型,基于海量文本训练、能理解和生成人类语言的深度学习模型。

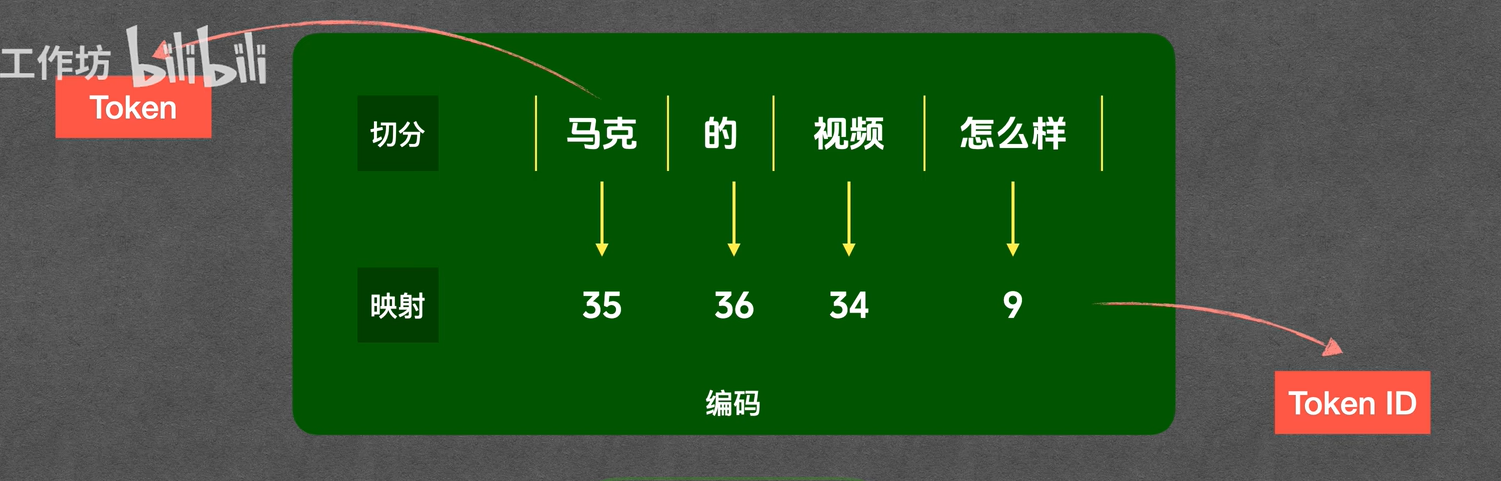

2. Token

LLM 处理文字的最小单位,不是字也不是词,而是模型切分后的片段。

- 中文:1 个 Token ≈ 1~2 个汉字

- 英文:1 个 Token ≈ 4 个字母或者0.75个单词

所有计算、长度限制、计费,都按 Token 算。

Tokenizer,LLM与用户之间的中间人。LLM接收和输出数字,用户输出和接收文字。

Tokenizer将用户的文字编码为LLM的输入数字:

编码过程分为切分和映射两步:1.输入文本被切分成一串token;2,每一个token转换为对应的token ID,所有的Token ID 组成LLM的输入编码。

解码环节 则是将LLM输出的Token ID映射为对应的文本,由于LLM每次输出一个Token ID,所以解码不需要切分。

3. Context

上下文,就是模型“当前记得的所有信息”,包括:

- 历史对话

- 用户问题

- 当前输出

- 系统给的指令(system Prompt)

- 工具返回的结果(天气,定位等)

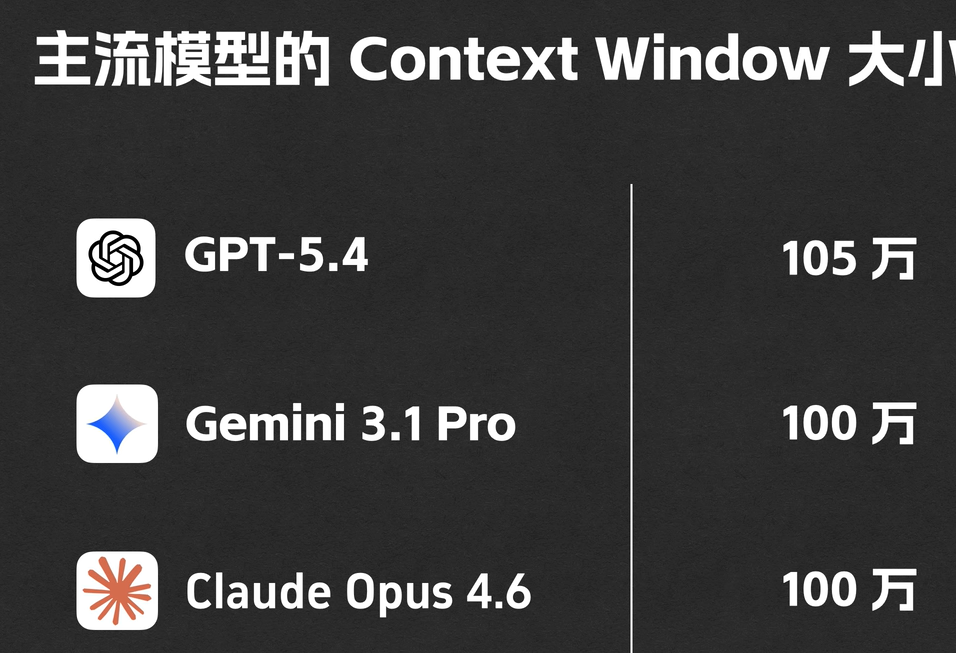

4. Context Window

上下文窗口,模型一次性能装下的最大 Token 数量。

超过这个长度,模型就会“忘事”或截断。

二、交互层:怎么跟 LLM 说话

5. Prompt

提示词,泛指所有喂给模型的输入文本,表示LLM接收的具体问题或者指令,用来引导它输出。

Prompt engineering, 提示词工程。

6. User Prompt

用户提示,用户输入的,就是你在对话框里输入的内容,是任务本身。

7. System Prompt

系统提示,在对话最开头、对用户不可见的指令,是后台配置的,用来:

- 设定角色(如“你是专业助手”)

- 设定输出格式、语气、规则

- 约束行为边界

三、能力扩展层:让模型会“做事”

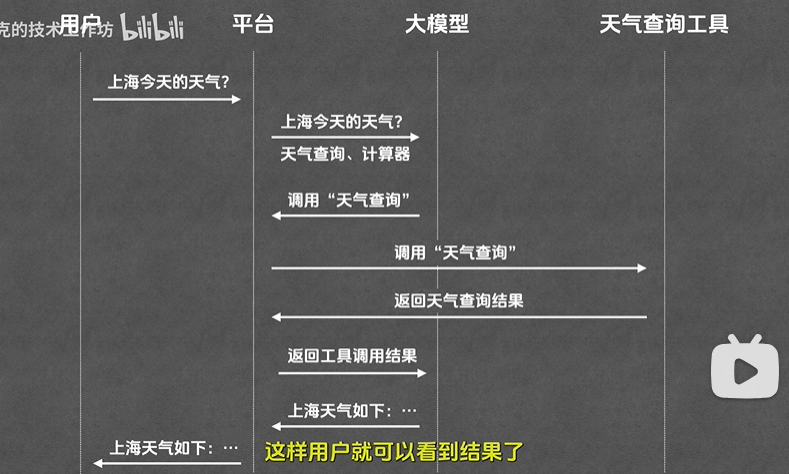

8. Tool

工具,是 LLM 可以调用的外部功能或者函数,让LLM能够感知和影响外部环境**。

常见工具:

- 计算器

- 代码解释器

- 搜索

- 数据库查询

- 绘图、文档处理等

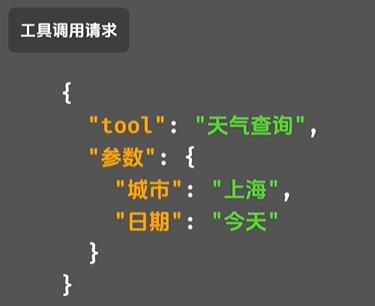

这是一个通过工具查询天气的例子,其中,用户,LLM,工具之间无法直接通信,需要通过平台进行沟通。过程如下:

- 用户向平台发出问题

- 平台将问题和可用用具发送给LLM

- LLM本身如果无法给出答案或者答案不可用,告诉平台需要调用工具以及需要的参数

- 平台调用相应的工具对应的函数

- 工具反馈调用结果

- 平台将结果输入到LLM

- LLM 将结果整理输出到平台

- 平台将结果输出到用户

其中LLM的角色包括:根据问题选择工具、根据工具反馈的结果归纳总结

工具的职责是执行具体的查询任务

平台的作用就是将所有的流程串联在一起

9. MCP(Model Context Protocol 模型上下文协议)

MCP 是统一管理和调度工具的控制平面,负责:

- 告诉模型有哪些工具可用

- 解析模型想调用哪个工具

- 执行工具调用并把结果返回给模型

可以理解为:模型的“工具中台”。

10. Agent

智能体,是具备自主决策能力的 LLM,它可以自主规划和调用工具,直至完成任务。

它不再只是“一问一答”,而是:

- 理解目标

- 规划步骤

- 自主调用工具

- 反思结果

- 直到完成任务

11. Agent Skill

智能体技能,是 Agent 可以复用的标准化能力单元。

比如:

- 写邮件技能

- 数据分析技能

- 行程规划技能

- 代码调试技能

Skill 让 Agent 更专业、更稳定,而不是每次都从零思考。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)