【动手学深度学习】第七课 不知道取什么标题

·

目录

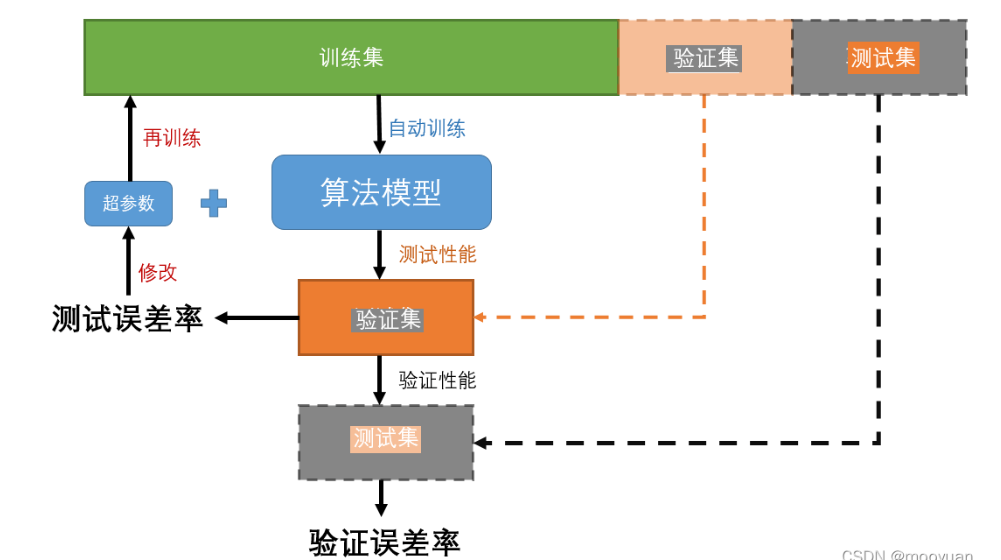

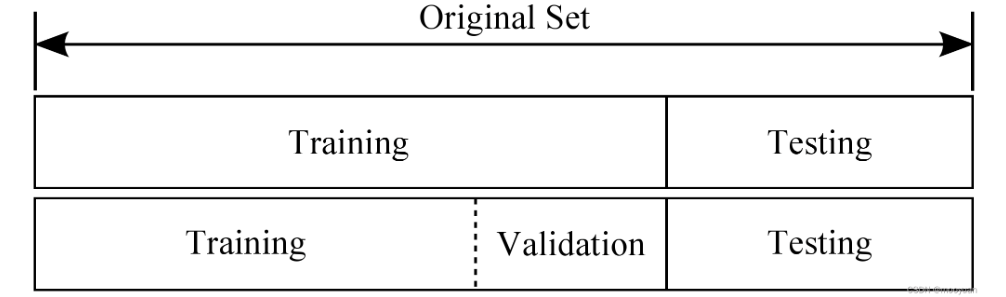

一、训练集,验证集和测试集

- 训练集(train set) —— 用于训练模型

- 验证集(validation set)—— 用于调整超参数和用于对模型的能力进行初步评估。在模型训练时,用以验证当前模型泛化能力(准确率,召回率等),防止过拟合的现象出现,以决定如何调整超参数。

- 测试集(test set) —— 用来评估模最终模型的性能如何

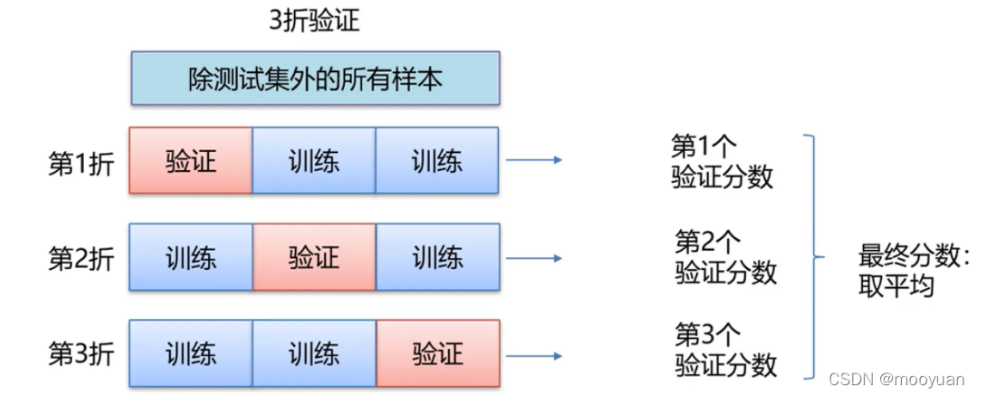

K折交叉验证 —— 当训练数据稀缺时,我们甚至可能无法提供足够的数据来构成一个合适的验证集。 这个问题的一个流行的解决方案是采用K折交叉验证。 这里,原始训练数据被分成个不重叠的子集。 然后执行次模型训练和验证,每次在个子集上进行训练, 并在剩余的一个子集(在该轮中没有用于训练的子集)上进行验证。 最后,通过对次实验的结果取平均来估计训练和验证误差。

二、欠拟合和过拟合

1. 欠拟合

- 对训练样本的一般性质尚未学好。在训练集及测试集上的表现都不好。

- 这可能意味着模型过于简单(即表达能力不足), 无法捕获试图学习的模式。

2. 过拟合

- 定义1:当学习器把训练样本学的“太好”了的时候,很可能已经把训练样本自身的特点当作了所有潜在样本都会具有的一般性质,这样就会导致泛化性能下降,这种现象称为过拟合。

- 定义2:具体表现就是最终模型在训练集上效果好;在测试集上效果差。模型泛化能力弱。

- 过拟合有一定的缓解方法

- 权重衰退(即L2正则化):让权重变小

- 暂退法(Dropout):随机失活神经元

- 早停(Early Stopping):验证集变差就停

- 数据增强

这部分可以参考这篇文章:

三、前向传播和反向传播

我刚开始学习会很容易混淆这两个,实际上它们并不是一对反义词。用我自己的话来说:

前向传播是神经网络从第一层到第n层的一个传播方式。

而反向传播是进行随机梯度下降时用来更新梯度的一个策略。

其实我觉得理解了上面这句话就够了,如果想更具体地学习可以看一下李沐老师这部分的教材。

四、数值稳定性

梯度爆炸(gradient exploding): 参数更新过大,破坏了模型的稳定收敛。

梯度消失(gradient vanishing): 参数更新过小,在每次更新时几乎不会移动,导致模型无法学习。

当然,我们可以采用参数初始化来处理上面的问题。感兴趣可以搜一下,这里就水一下了。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)