[特殊字符] 有线连接调用服务器模型操作手册

·

🟢 阶段一:服务器端配置 (Windows Server + WSL2)

因为之前在研究openclaw,今天突发奇想,想借用下服务器上的算力,所以这里我的ollama是部署在wsl里的,直接部署在windows下效果应该是一样的

预先ping以下你的服务器保证消息通常。

此阶段只需在服务器上操作一次。若服务器重启,需检查步骤 3 和 4。

-

配置 Ollama 监听所有接口

- 打开服务器的 WSL 终端。

- 设置环境变量(临时):

export OLLAMA_HOST=0.0.0.0 - (可选) 永久生效:

echo 'export OLLAMA_HOST=0.0.0.0' >> ~/.bashrc - 重启 Ollama:确保服务重新加载配置(停止后台进程后重新运行

ollama serve)。

-

获取 WSL2 内部 IP

- 在 WSL 终端运行:bash

编辑

ip addr show eth0 | grep "inet\b" | awk '{print $2}' | cut -d/ -f1 - 记录输出的 IP 地址(例如:

172.28.10.55)。

- 在 WSL 终端运行:bash

-

配置 Windows 端口转发 (关键)

- 在服务器上以管理员身份打开 PowerShell。

- 执行命令将 WSL2 的 11434 端口映射到 Windows 宿主机的 11434 端口:powershell

编辑

(将netsh interface portproxy add v4tov4 listenport=11434 connectaddress=<WSL2_IP> connectport=11434<WSL2_IP>替换为步骤 2 中获取的实际 IP)

-

配置 Windows 防火墙

- 仍在管理员 PowerShell 中,开放 11434 端口允许局域网访问:powershell

编辑

New-NetFirewallRule -DisplayName "Ollama WSL2" -Direction Inbound -LocalPort 11434 -Protocol TCP -Action Allow

- 仍在管理员 PowerShell 中,开放 11434 端口允许局域网访问:powershell

-

确认模型列表

- 在 WSL 终端运行

ollama list,记下需要使用的模型名称(如qwen2.5:7b)。

- 在 WSL 终端运行

🔵 阶段二:客户端配置 (您的开发电脑)

此阶段在您的本地电脑上操作。

-

验证网络连通性

- 打开本地电脑的 PowerShell 或 CMD。

- 测试能否读取服务器模型列表(替换

<服务器IP>为实际 IP,如192.168.100.2):powershellcurl http://<服务器IP>:11434/api/tags - 如果返回 JSON 数据,说明连接成功。

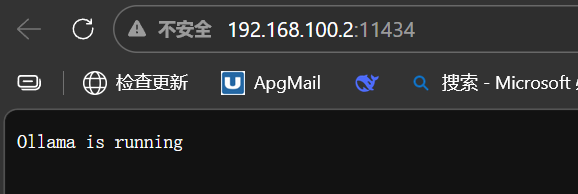

- 在客户端电脑上输入,服务器端的网址能看到这个就算成功。

-

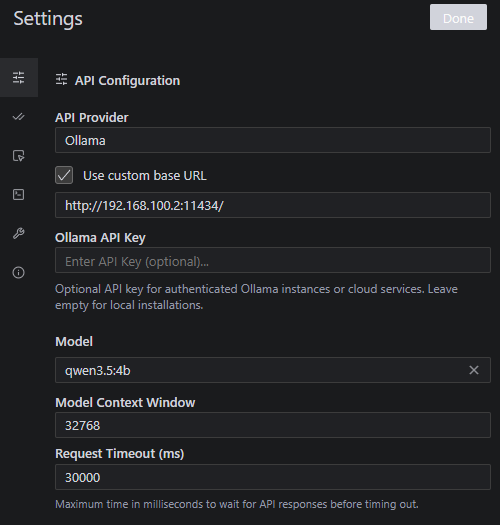

配置 Trae IDE或你的vscode

- 安装插件Cline

- 添加/编辑自定义提供商 (OpenAI Compatible):

- Base URL:

http://<服务器IP>:11434 - Model Name:

<服务器上的确切模型名>(如qwen2.5:7b) - API Key: 任意填写 (如

ollama)

- Base URL:

⚠️ 常见问题与维护

| 问题场景 | 解决方案 |

|---|---|

| 服务器重启后连接失败 | WSL2 的 IP 地址可能会变。 1. 重新在 WSL 查 IP ( ip addr...)。2. 删除旧转发规则: netsh interface portproxy delete v4tov4 listenport=11434。3. 重新执行阶段一的步骤 3。 |

| 模型找不到 (Model not found) | 检查模型名称是否包含版本号(如 :7b, :latest),必须与 ollama list 输出完全一致。 |

| 连接超时 (Timeout) | 1. 检查服务器 Windows 防火墙是否拦截了 11434 端口。 2. 检查客户端与服务器是否能互相 Ping 通。 3. 确认 WSL 内 OLLAMA_HOST 已设为 0.0.0.0。 |

| 想固定 WSL2 IP (进阶) | 可通过配置 .wslconfig 和网络脚本固定 WSL2 IP,避免每次重启都重新配置端口转发(参考搜索到的 CSDN 教程)。 |

核心逻辑总结:

WSL2 (0.0.0.0) --> Netsh 端口转发 --> Windows 宿主机 (局域网IP:11434) --> 客户端电脑

现在您可以顺畅地使用服务器的高性能算力运行大模型了!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)