大模型应用:企业员工 EAP 智能分析系统:大模型在心理评估中的应用解析.118

一、前言

在长期从事心理健康服务的过程中,接触并处理了大量面向青少年与企业员工的心理评估需求。两类群体虽所处场景不同、压力来源各异,却都在快节奏、高负荷的现代环境下面临着情绪调节、压力管理与心理适应等共性挑战。其中,企业员工群体的需求尤为集中且复杂:工作压力、职业倦怠、人际沟通、情绪波动、职业认同等问题,不仅影响个体状态,更直接关系到组织效能、团队稳定与企业长期发展。

传统 EAP 服务往往依赖人工访谈、量表测评与线下咨询,流程长、效率有限,且难以实现规模化、个性化与实时化分析。随着大模型技术与数字化工具的成熟,员工心理评估、风险预警、报告生成与干预建议正在迎来全新的解决方案,今天是结合真实场景需求,对企业员工心理评估体系进行深度解析,从痛点梳理、量表应用、数据化分析到智能工具落地,完整呈现已经规模化应用的员工心理健康服务思路,为企业 EAP 升级与员工关怀提供务实参考。

二、核心基础

1. EAP 评估量表的核心定义

EAP,全称Employee Assistance Program,即员工援助计划,是企业为员工提供的系统性心理支持与职业发展援助方案,而 EAP 评估量表则是量化评估员工心理状态、工作压力、职业满意度等维度的标准化工具。其核心价值在于将抽象的员工心理状态转化为可量化、可分析的指标,帮助企业精准识别员工心理风险、制定针对性干预策略。

EAP 评估量表通常包含多个维度:

- 心理压力维度:涵盖工作压力、生活压力、人际关系压力等子项,采用 1-5 分李克特量表计分

- 情绪状态维度:评估焦虑、抑郁、乐观度等情绪指标

- 职业适配维度:分析工作满意度、职业倦怠、岗位匹配度等

- 社会支持维度:衡量家庭、同事、上级的支持程度

- 从技术视角看,EAP 评估量表的数字化是实现智能分析的基础,其本质是将标准化的心理评估逻辑转化为结构化的数据采集、存储、分析流程。

2. 前端展示界面的核心要求

EAP 评估系统的前端界面需满足三大核心诉求:

- 1. 用户体验友好性:评估流程需简洁流畅,避免冗长复杂的表单填写,减少用户抵触心理

- 2. 数据采集准确性:确保量表题目展示、选项选择、分数计算的精准性

- 3. 交互反馈及时性:评估过程中提供必要的引导,评估完成后快速反馈初步结果

前端技术栈选择需兼顾兼容性与开发效率,推荐使用:

- 基础框架:Vue3,组合式 API 更适合复杂表单开发

- UI 组件库:Element Plus,表单组件丰富,适配性强

- 状态管理:Pinia,轻量型状态管理,适合中小型应用

- 数据可视化:ECharts,评估结果可视化展示

3. 大模型在 EAP 分析中的作用

大模型在 EAP 评估中的核心价值在于将结构化的评估分数转化为专业、个性化、可落地的分析建议,其核心作用体现在:

- 量化数据解读:将冰冷的分数转化为通俗易懂的心理状态描述

- 个性化建议生成:基于评估者的得分特征,生成针对性的心理调节、工作改进建议

- 风险等级判定:结合行业基准数据,判定评估者的心理风险等级

- 趋势分析能力:对比历史评估数据,分析心理状态变化趋势

大模型在此场景下的应用区别于通用聊天场景,核心要求是专业性、严谨性、安全性,需避免生成误导性、非专业的建议。

4. 基础技术架构

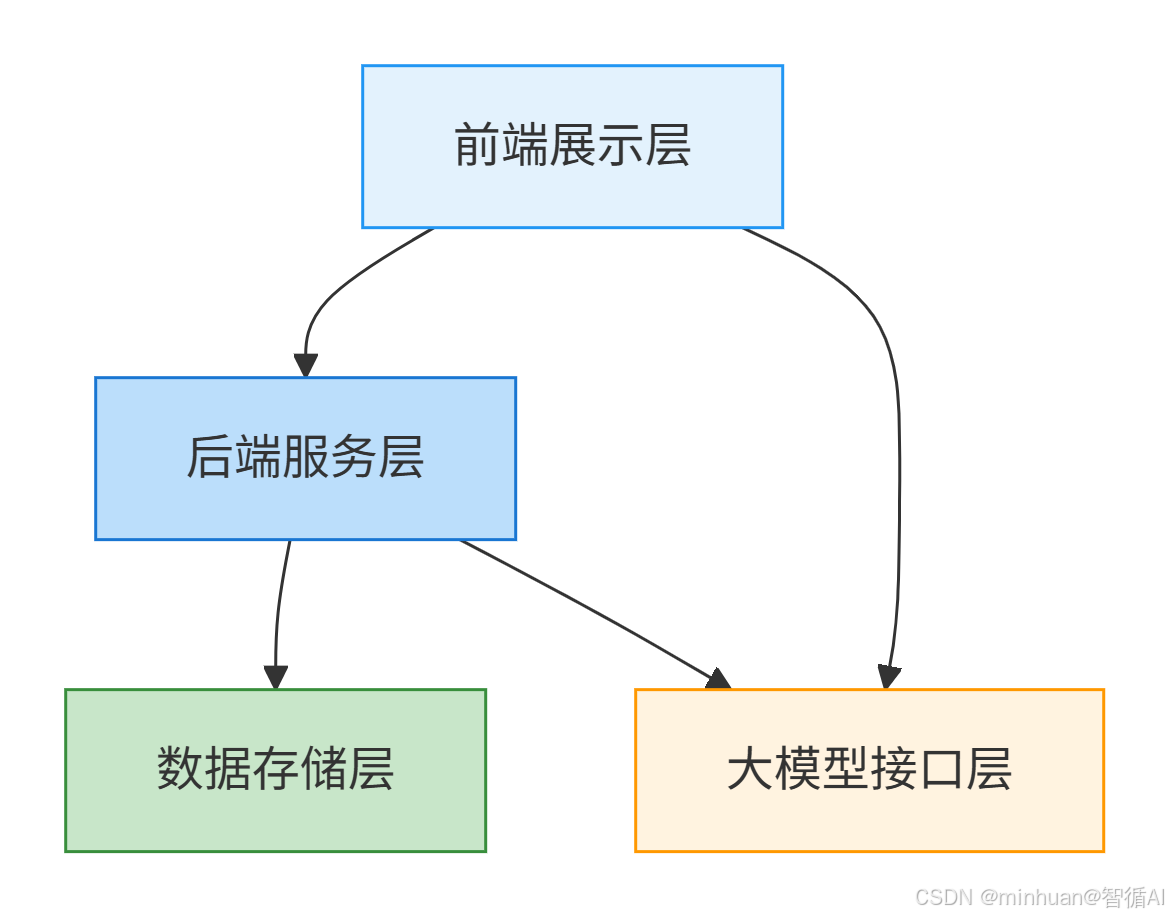

完整的 EAP 评估系统技术架构分为三层:

- 前端展示层:负责评估量表展示、用户交互、结果可视化

- 后端服务层:负责分数计算、权限校验、大模型请求封装、数据校验

- 数据存储层:负责存储评估结果、用户信息、量表配置、行业基准数据

- 大模型接口层:负责与大模型 API 对接,实现 prompt 构建、响应解析、结果格式化

三、EAP 评估系统基础原理

1. EAP 评估量表的计分原理

EAP 评估量表采用标准化的心理测量学计分方式,核心原理包括:

1.1 维度计分规则

以经典的 EAP 压力评估量表为例,其计分逻辑如下:

- 1. 反向题处理:部分题目为反向计分,如"我对工作充满热情",1 分代表完全不符合,5 分代表完全符合;而"我经常感到工作疲惫"则为正向计分

- 2. 维度求和:同一维度下的题目得分求和,得到维度总分

- 3. 标准化转换:将维度总分转换为标准分(Z分数),公式为:Z=(X−μ)/σ,其中X为原始分,μ为常模平均分,σ为常模标准差

- 4. 风险等级划分:根据标准分划分风险等级,低风险:Z<0.5;中风险:0.5≤Z<1.5;高风险:Z≥1.5

1.2 常模数据的作用

- 常模数据是 EAP 评估的基准,来源于同行业、同岗位、同年龄段的大规模样本调研;

- 其作用是将个体得分放在群体中进行对比,避免单纯的分数绝对值导致的误判。

2. 前端交互的核心原理

EAP 评估前端界面的核心交互原理围绕表单状态管理和分步提交逻辑展开:

- 1. 表单状态管理:通过响应式数据记录用户的答题选择,实时校验必填项

- 2. 分步提交逻辑:将长量表拆分为多个步骤,每完成一步保存当前状态,支持断点续答

- 3. 进度计算逻辑:基于已答题数/总题数计算评估进度,实时展示

- 4. 数据校验逻辑:提交前校验所有题目是否完成作答,避免数据缺失

3. 大模型分析的核心原理

大模型在 EAP 分析中的应用核心是Prompt 工程与结构化输出,其底层原理包括:

3.1 Prompt 构建原理

有效的 EAP 分析 Prompt 需包含以下核心要素:

角色设定:你是一名资深的EAP心理咨询师,拥有10年以上员工心理评估分析经验

任务描述:基于以下EAP评估数据,生成专业、严谨、易懂的分析报告和建议

数据输入:{评估分数JSON数据}

输出格式:

1. 整体评估总结(200字以内)

2. 各维度详细分析(每个维度150字左右)

3. 风险等级判定(低/中/高风险)

4. 个性化改进建议(分工作、生活、心理调节三个维度,各1-2条)

专业要求:

- 避免使用专业术语,确保非心理学背景人员能理解

- 建议需具体可落地,避免空泛的表述

- 禁止给出医疗诊断类结论,仅提供心理调节建议

- 高风险情况需提示及时寻求专业心理咨询帮助

3.2 响应解析原理

大模型返回的文本需进行结构化解析,核心步骤:

- 1. 格式校验:检查返回内容是否符合预设格式

- 2. 内容提取:提取评估总结、维度分析、风险等级、改进建议等关键信息

- 3. 格式转换:将文本信息转换为前端可展示的 JSON 结构

- 4. 内容审核:过滤不符合专业规范、存在风险的表述

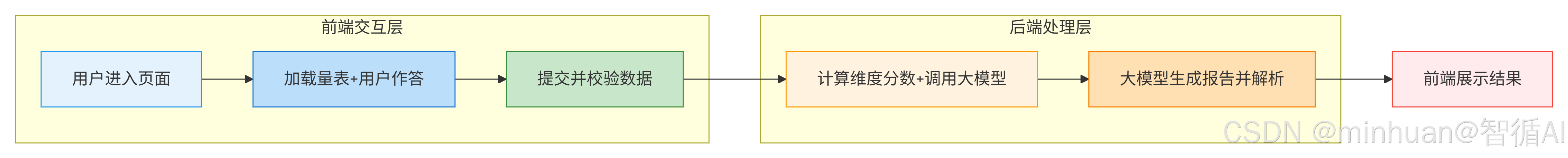

4. 数据流转核心原理

EAP 评估系统的完整数据流转流程:

关键技术要点:

- 前端本地缓存:使用 localStorage 缓存答题状态,避免页面刷新丢失数据

- 数据加密传输:评估数据采用 HTTPS+AES 加密传输,保护用户隐私

- 异步处理机制:大模型请求采用异步处理,避免前端长时间等待

- 异常处理逻辑:大模型服务异常时,启用预设的规则化分析方案

四、系统开发执行流程

1. 需求分析与方案设计

1.1 核心需求拆解

| 需求类别 | 具体需求点 | 技术实现思路 |

|---|---|---|

| 功能需求 | 量表展示 | 基于 Vue 组件化开发量表题目组件 |

| 答题交互 | 实现单选 / 多选 / 评分等答题组件 | |

| 分数计算 | 后端编写计分规则引擎 | |

| 结果展示 | 使用 ECharts 实现维度分数可视化 | |

| 报告生成 | 对接大模型 API 生成分析报告 | |

| 非功能需求 | 响应速度 | 前端懒加载、接口缓存优化 |

| 兼容性 | 适配 PC 端 / 移动端,兼容主流浏览器 | |

| 安全性 | 数据加密、权限控制、内容审核 | |

| 可扩展性 | 量表配置化,支持新增评估维度 |

1.2 技术方案选型

| 技术模块 | 选型结果 | 选型理由 |

|---|---|---|

| 前端框架 | Vue3 + Vite | 轻量、快速、组合式 API 适合复杂表单 |

| UI 组件库 | Element Plus | 表单组件丰富,支持按需引入 |

| 状态管理 | Pinia | 替代 Vuex,更简洁的 API 设计 |

| 数据可视化 | ECharts 5 | 图表类型丰富,定制化能力强 |

| 后端框架 | FastAPI | 高性能、自动生成 API 文档、异步支持 |

| 数据库 | PostgreSQL | 支持 JSON 数据类型,适合存储量表配置 |

| 大模型对接 | OpenAI API / 文心一言 API | 成熟的 API 接口,支持结构化输出 |

| 部署方式 | Docker + Nginx | 容器化部署,便于环境隔离和扩展 |

2. 前端界面核心业务

由于页面的内容很多,代码比较长,我们通过核心的部分来说明涉及到的重要部分,实现一个基于 Vue 3 + Element Plus + ECharts 的单页应用,用于员工心理评估EAP;

2.1 核心业务逻辑:提交评估 (submitAssessment)

这是整个应用最关键的函数,负责验证用户输入、调用后端 API、处理响应并切换页面。

const submitAssessment = async () => {

// 1. 验证所有必填题是否都已作答

const unAnswered = questions

.filter(q => q.required)

.some(q => !answers[q.id]);

if (unAnswered) {

ElMessage.warning('请完成所有必填题目的作答');

return;

}

submitting.value = true; // 开启加载状态

try {

// 2. 数据格式化:将答案从字符串转换为数字

const answersData = {};

Object.keys(answers).forEach(qid => {

answersData[qid] = parseInt(answers[qid]);

});

let response;

// 3. 尝试调用真实后端 API

try {

response = await axios.post('http://localhost:8000/api/assessment/analyze', {

answers: answersData

});

} catch (apiError) {

// 4. 降级策略:如果后端不可用,生成高质量的模拟数据

console.log('后端API不可用,使用模拟数据');

response = {

data: {

assessment_id: 'demo_' + Date.now(),

risk_level: '低风险',

risk_description: '您的心理状态整体良好...',

summary: '根据您的答题情况...',

dimension_scores: { '工作压力': 75, '情绪状态': 82, /*...*/ },

dimensions: { '工作压力': '分析文本...', /*...*/ },

suggestions: { work: [...], life: [...], mental: [...] }

}

};

}

// 5. 更新结果状态

Object.assign(assessmentResult, response.data);

// 6. 切换视图到结果页

currentPage.value = 'result';

loadingResult.value = true;

// 7. 模拟分析延迟,随后初始化图表

setTimeout(() => {

loadingResult.value = false;

Vue.nextTick(() => {

initDimensionChart(); // 关键:DOM渲染完成后才画图表

});

}, 100);

} catch (error) {

console.error('提交评估失败:', error);

ElMessage.error('评估提交失败,请稍后重试');

} finally {

submitting.value = false; // 结束加载状态

}

};重点说明:

- 双重 Try-Catch 结构:外层捕获整体逻辑错误,内层专门捕获 API 请求错误。这种设计实现了“前后端分离开发友好”的特性:即使没有启动 Python/Java 后端,前端也能通过 catch 块中的模拟数据完整运行演示流程。

- 数据清洗:parseInt 确保传给后端的是数字类型,避免类型错误。

- 异步时序控制:使用 setTimeout 模拟服务器计算时间,提升用户体验;使用 Vue.nextTick 确保在切换到 result 页面且 DOM 元素(#dimensionChart)渲染完毕后,再执行 ECharts 初始化,防止因 DOM 不存在导致的报错。

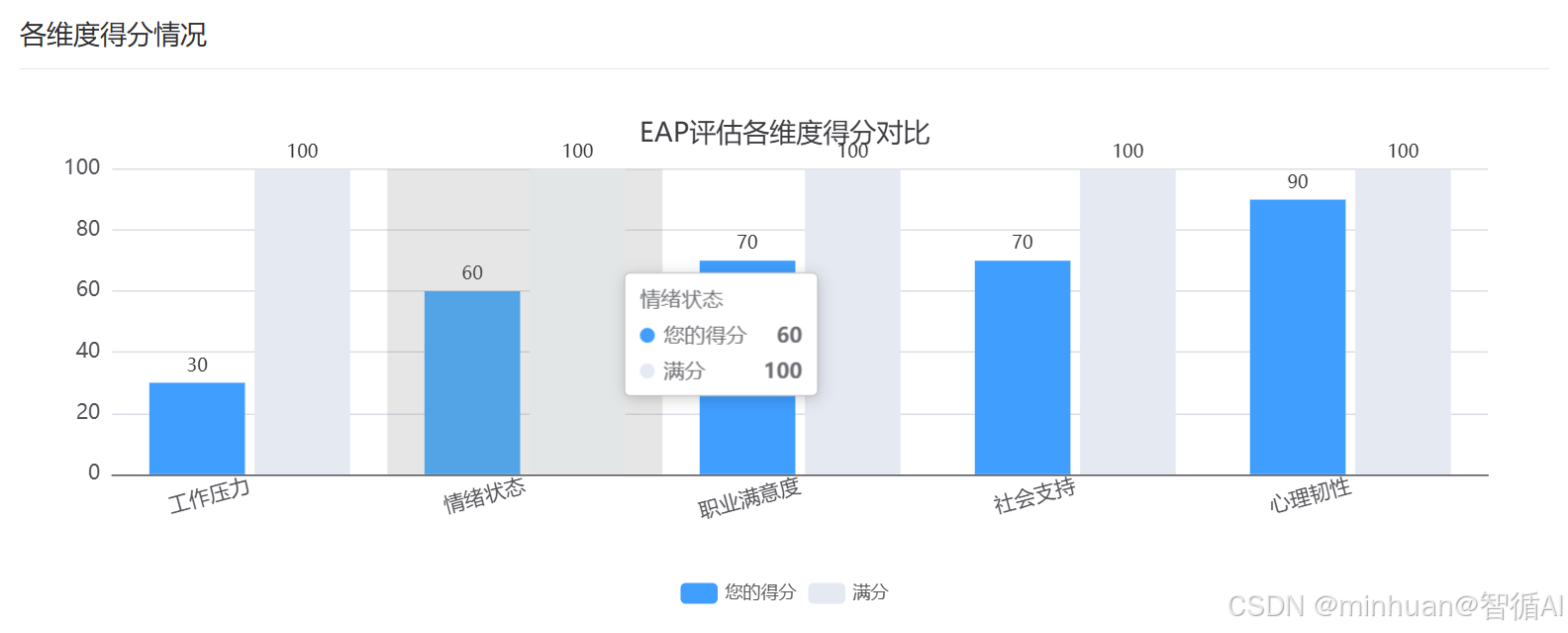

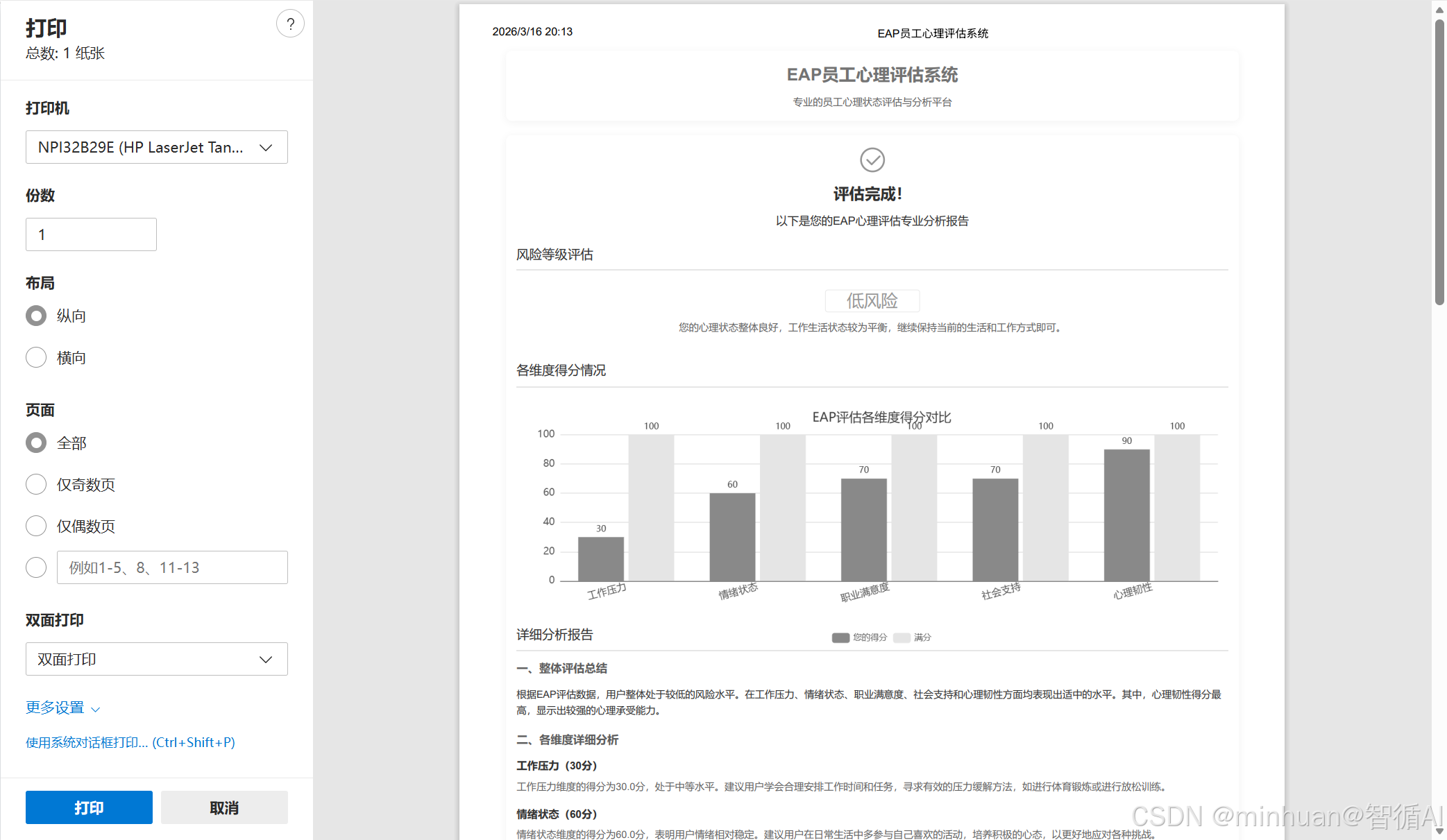

2.2 数据可视化:初始化图表 (initDimensionChart)

该函数负责在结果页面渲染雷达图或柱状图,直观展示用户在各个心理维度上的得分。

const initDimensionChart = () => {

const chartDom = document.getElementById('dimensionChart');

if (!chartDom) return; // 安全校验

const myChart = echarts.init(chartDom);

// 1. 动态提取数据

const dimensionScores = assessmentResult.dimension_scores || {};

const dimensions = Object.keys(dimensionScores);

const scores = dimensions.map(d => dimensionScores[d]);

const maxScores = Array(dimensions.length).fill(100); // 构造满分参考线

if (dimensions.length === 0) return;

// 2. 配置 ECharts 选项

const option = {

title: { text: 'EAP评估各维度得分对比', left: 'center' },

tooltip: { trigger: 'axis' },

legend: { data: ['您的得分', '满分'], bottom: 0 },

grid: { containLabel: true }, // 自适应标签

xAxis: {

type: 'category',

data: dimensions,

axisLabel: { rotate: 15 } // 标签倾斜防止重叠

},

yAxis: { type: 'value', max: 100, min: 0 },

series: [

{

name: '您的得分',

type: 'bar',

data: scores,

itemStyle: { color: '#409eff' }, // 品牌色

label: { show: true, position: 'top' }

},

{

name: '满分',

type: 'bar',

data: maxScores,

itemStyle: { color: '#e5e9f2' }, // 浅灰色背景条

label: { show: true, position: 'top' }

}

]

};

myChart.setOption(option);

// 3. 响应式适配

window.addEventListener('resize', () => {

myChart.resize();

});

};重点说明:

- 动态数据驱动:图表的 X 轴(维度名称)和数据系列完全依赖于 assessmentResult.dimension_scores 对象,这意味着后端返回不同的维度定义,前端无需修改代码即可自动适应。

- 对比可视化:通过绘制两组数据(用户得分 vs 满分),直观地让用户看到自己的差距。

- 响应式监听:绑定了 window.resize 事件,当浏览器窗口大小改变时,图表会自动重绘,保证在移动端和桌面端都显示正常。

2.3 状态重置:重新评估 (restartAssessment)

用于清空当前状态,让用户可以重新开始测试,而无需刷新整个网页。

const restartAssessment = () => {

// 1. 切换回评估页面

currentPage.value = 'assessment';

// 2. 清空答题记录 (answers 是 reactive 对象,需逐个删除 key)

Object.keys(answers).forEach(key => delete answers[key]);

// 3. 清空之前的评估结果

Object.keys(assessmentResult).forEach(key => delete assessmentResult[key]);

// 注意:不需要手动重置图表,因为切回 assessment 页面后,

// result 页面的 DOM 会被 v-if 销毁,下次进入时会重新 initDimensionChart

};重点说明:

- 响应式对象的清理技巧:在 Vue 3 中,直接对 reactive 对象赋值为 {} (如 answers = {}) 会切断响应式连接,导致视图不更新。正确做法是遍历并 delete 属性,或者使用 Object.assign(answers, {})。这里使用了 delete 循环,确保了状态的彻底清空且保持响应性。

- 生命周期管理:利用 v-if 的特性,当 currentPage 切换时,结果页面的 DOM(包括 ECharts 容器)会被销毁,内存中的图表实例也会随之释放,避免了内存泄漏。

2.4 辅助功能:下载报告 (downloadReport)

实现前端触发后端文件流下载的功能。

const downloadReport = async () => {

try {

const assessmentId = assessmentResult.assessment_id || 'demo_report';

// 1. 请求二进制流 (blob)

const response = await axios.get(

`http://localhost:8000/api/assessment/report/${assessmentId}/download`,

{ responseType: 'blob' } // 关键:告诉 axios 处理二进制数据

);

// 2. 创建临时下载链接

const url = window.URL.createObjectURL(new Blob([response.data]));

const link = document.createElement('a');

link.href = url;

link.setAttribute('download', `EAP评估报告_${new Date().getTime()}.pdf`);

// 3. 触发点击并清理

document.body.appendChild(link);

link.click();

document.body.removeChild(link);

window.URL.revokeObjectURL(url); // 释放内存

ElMessage.success('报告下载成功');

} catch (error) {

ElMessage.error('下载报告失败,请稍后重试');

}

};重点说明:

- Blob 处理:responseType: 'blob' 是下载文件的核心,它防止 axios 尝试将 PDF/Excel 文件解析为 JSON 或文本。

- 内存管理:使用 createObjectURL 创建临时的内存引用,下载完成后必须调用 revokeObjectURL 释放,否则会导致浏览器内存泄漏。

- 动态文件名:文件名包含时间戳,防止浏览器缓存导致多次下载同名文件时出错。

前端优化基于实际应用的实践性:

- 容错性强:内置 Mock 数据,考虑了生成环境也配置了演示数据,后端挂了也能演示。

- 交互流畅:利用 nextTick 和 v-if 完美处理了图表渲染时机。

- 数据驱动:图表和报告内容完全由后端返回的 JSON 动态生成,扩展性高。

- 用户体验:包含了加载状态 (loading)、表单验证、成功/失败消息提示 (ElMessage) 以及响应式布局。

3. 后端服务核心业务

我们构建了一个基于 FastAPI 的后端服务,核心功能包括:心理量表计分逻辑、混元大模型智能报告生成以及降级容错机制。以下是提取出的核心方法体及其详细功能介绍:

3.1 核心计分引擎:完整评估流程 (process_assessment)

这是 EAPScoringEngine 类的主入口,负责将原始答题数据转化为标准化的心理评估数据。

def process_assessment(self, answers: Dict[str, int]) -> Dict[str, Any]:

"""完整的评估处理流程"""

# 1. 处理反向题(例如:q10 是反向计分,需转换)

processed_answers = self.process_reverse_questions(answers)

# 2. 计算各维度原始分并转换为百分制 (0-100)

dimension_scores = self.calculate_dimension_scores(processed_answers)

# 3. 基于常模数据计算标准分 (Z-Score),用于横向对比

standard_scores = self.calculate_standard_scores(dimension_scores)

# 4. 根据 Z 分数判定风险等级 (低/中/高)

risk_info = self.determine_risk_level(standard_scores)

return {

"raw_answers": answers,

"processed_answers": processed_answers,

"dimension_scores": dimension_scores,

"standard_scores": standard_scores,

"risk_info": risk_info

}重点说明:

- 反向题处理:心理量表中常包含反向题,如“我感到快乐”vs“我感到悲伤”,此步骤确保所有题目方向一致,分值越高代表状态越差或越好,视具体维度定义而定。

- 标准化评分 (Z-Score):不仅仅看绝对分数,而是通过(用户分 - 常模均值)/标准差 计算Z分数。这使得不同维度的分数具有可比性,能科学地判定用户在人群中的相对位置。

- 风险分级逻辑:基于平均 Z 分数自动划分风险等级(<0.5 低风险,0.5-1.5 中风险,>1.5 高风险),为后续的报告生成提供定性依据。

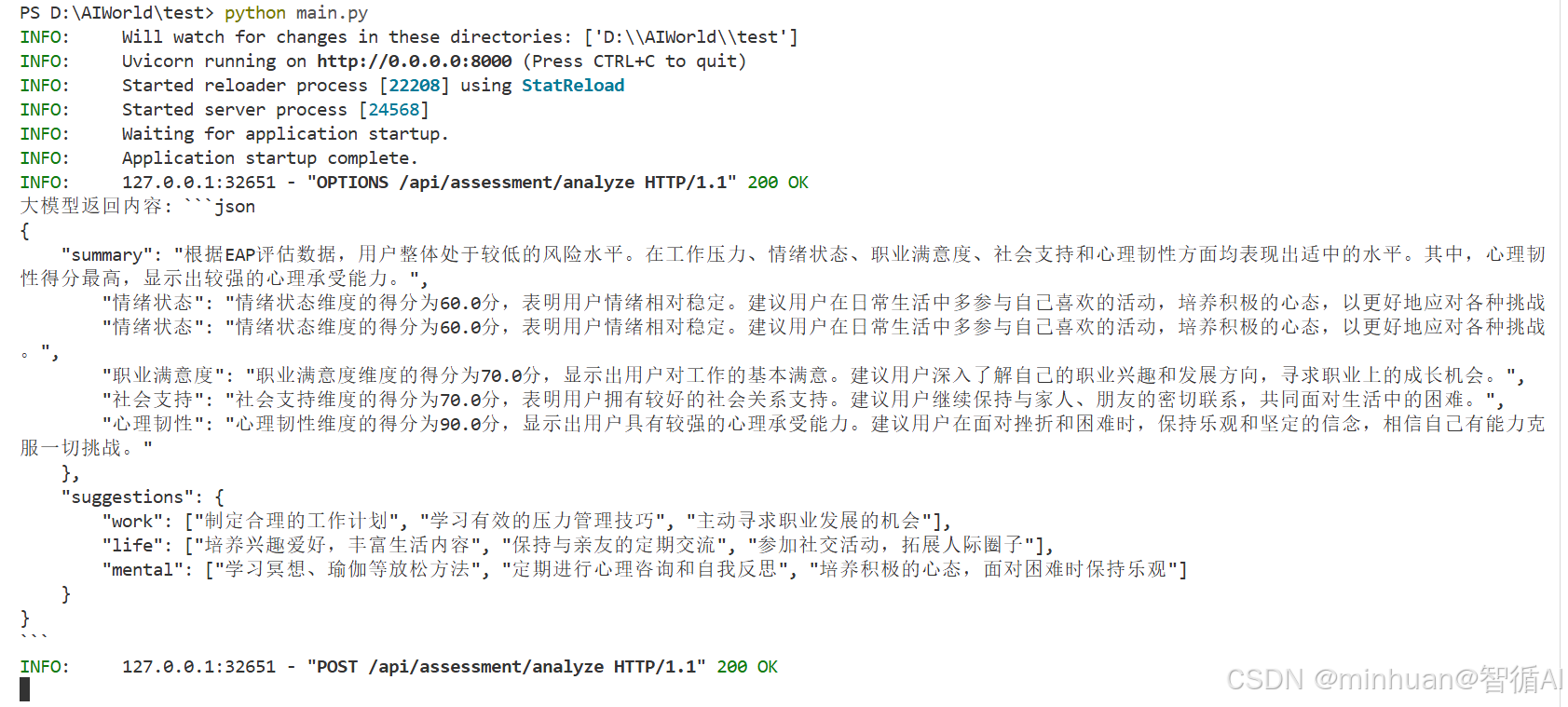

3.2 智能报告生成:大模型调用与整合 (generate_assessment_report)

这是 EAPLLMAnalyzer 类的核心方法,负责构建 Prompt,调用腾讯混元大模型,并整合最终报告。

def generate_assessment_report(self, answers: Dict[str, int], scoring_engine) -> Dict[str, Any]:

"""生成完整的评估报告"""

# 1. 获取基础统计数据

assessment_data = scoring_engine.process_assessment(answers)

dimension_scores = assessment_data["dimension_scores"]

risk_info = assessment_data["risk_info"]

# 2. 构建结构化 Prompt (提示词工程)

prompt = f"""请根据以下EAP评估数据,生成一份专业的心理分析报告(请以JSON格式返回):

【评估数据】

风险等级:{risk_info['risk_level']}

平均Z分数:{risk_info['avg_z_score']}

各维度得分:

- 工作压力:{dimension_scores['工作压力']}分

- 情绪状态:{dimension_scores['情绪状态']}分

- ... (其他维度)

【返回格式要求】

请以JSON格式返回,包含以下字段:

{{

"summary": "整体评估总结",

"dimensions": {{ "工作压力": "分析...", ... }},

"suggestions": {{ "work": [...], "life": [...], "mental": [...] }}

}}

请确保分析内容专业、人性化和可操作。"""

# 3. 调用大模型 API

llm_response = self.call_hunyuan_api(prompt)

# 4. 解析响应或触发降级

if llm_response:

llm_report = self.parse_llm_response(llm_response, assessment_data)

else:

print("大模型API调用失败,使用备用分析方案")

llm_report = self.generate_fallback_report(assessment_data)

# 5. 整合最终报告

full_report = {

"assessment_id": f"eap_{int(time.time())}",

"create_time": datetime.now().strftime("%Y-%m-%d %H:%M:%S"),

"dimension_scores": assessment_data["dimension_scores"],

"standard_scores": assessment_data["standard_scores"],

**llm_report # 合并大模型生成的文本内容

}

return full_report重点说明:

- Prompt 工程:明确指定输出格式为 JSON,并定义了具体的字段结构。这确保了后端可以程序化地解析大模型的返回结果,而不是处理非结构化的文本。

- 数据注入:将精确的量化数据(Z 分数、维度分)注入 Prompt,让大模型基于客观数据进行解释,避免大模型产生幻觉,胡乱编造分数。

- 混合架构:结合“传统统计逻辑”的计分引擎和“生成式 AI”的大模型分析。统计保证准确性,AI 保证报告的个性化和可读性。

3.3 容错机制:备用报告生成 (generate_fallback_report)

当大模型 API 不可用(网络错误、Key 失效、超时)时,此方法确保系统永不崩溃,依然能返回一份基于规则模板的报告。

def generate_fallback_report(self, assessment_data: Dict[str, Any]) -> Dict[str, Any]:

"""生成备用分析报告(当API调用失败时使用)"""

dimension_scores = assessment_data["dimension_scores"]

risk_info = assessment_data["risk_info"]

# 1. 定义基于规则的模板库

dimension_analysis = {

"工作压力": {

"high": f"您的工作压力得分为{dimension_scores['工作压力']}分,处于较高水平...建议合理规划...",

"medium": f"您的工作压力得分为{dimension_scores['工作压力']}分,处于中等水平...",

"low": f"您的工作压力得分为{dimension_scores['工作压力']}分,处于较低水平..."

},

# ... 其他维度类似模板

}

# 2. 根据分数动态选择模板内容

dimensions = {}

for dimension, score in dimension_scores.items():

if score >= 80:

dimensions[dimension] = dimension_analysis[dimension]["high"]

elif score >= 60:

dimensions[dimension] = dimension_analysis[dimension]["medium"]

else:

dimensions[dimension] = dimension_analysis[dimension]["low"]

# 3. 生成通用建议

suggestions = {

"work": ["合理规划每日工作任务...", "每天预留复盘时间..."],

"life": ["保证充足睡眠...", "每周进行体育锻炼..."],

"mental": ["学习冥想技巧...", "培养兴趣爱好..."]

}

# 高风险特殊干预

if risk_info["risk_level"] == "高风险":

suggestions["mental"].append("建议尽快联系专业心理咨询师...")

return {

"summary": f"您的EAP评估整体风险等级为{risk_info['risk_level']}...",

"dimensions": dimensions,

"risk_level": risk_info["risk_level"],

"risk_description": risk_info["risk_description"],

"suggestions": suggestions

}重点说明:

- 业务连续性保障:这是企业级应用的关键。即使 AI 服务挂了,用户依然能得到一份基于心理学常模的、逻辑正确的报告,只是少了一些AI生成的个性化润色。

- 规则引擎逻辑:利用简单的 if-else 分数段判断(>=80, 60-80, <60)来匹配预设的专业话术。这些话术通常由资深心理咨询师预先撰写,保证了底线质量。

- 动态干预:特别针对“高风险”用户,动态追加一条寻求专业帮助的强建议,体现 EAP 系统的伦理责任。

3.4 响应解析与清洗 (parse_llm_response)

负责处理大模型返回的原始文本,将其清洗并转换为 Python 字典。

def parse_llm_response(self, llm_response: str, assessment_data: Dict[str, Any]) -> Dict[str, Any]:

"""解析大模型返回的响应"""

try:

cleaned_response = llm_response.strip()

# 1. 去除 Markdown 代码块标记 (大模型常返回 ```json ... ```)

if cleaned_response.startswith("```json"):

cleaned_response = cleaned_response[7:]

elif cleaned_response.startswith("```"):

cleaned_response = cleaned_response[3:]

if cleaned_response.endswith("```"):

cleaned_response = cleaned_response[:-3]

cleaned_response = cleaned_response.strip()

# 2. 尝试解析 JSON

response = json.loads(cleaned_response)

# 3. 数据完整性校验与默认值填充

return {

"summary": response.get("summary", ""),

"dimensions": response.get("dimensions", {}),

"risk_level": assessment_data["risk_info"]["risk_level"], # 强制使用计算出的风险等级,防止AI胡说

"risk_description": assessment_data["risk_info"]["risk_description"],

"suggestions": response.get("suggestions", {"work": [], "life": [], "mental": []})

}

except json.JSONDecodeError as e:

# 4. 解析失败兜底:如果AI返回的不是合法JSON,直接切换到备用方案

print(f"JSON解析失败: {e}")

return self.generate_fallback_report(assessment_data)重点说明:

- 兼容性清洗:大模型经常会在 JSON 前后包裹 Markdown 标记(json),此函数专门处理这些噪声,确保 json.loads 不报错。

- 关键数据锁定:注意代码中 risk_level 和 risk_description 没有使用大模型的返回值,而是直接使用了 assessment_data 统计引擎计算的结果。

- 原因:风险等级是严肃的医疗/心理结论,必须基于数学计算,不能让大模型“自由发挥”或“ 幻觉”出一个错误的风险等级。大模型只负责解释数据,不负责定义数据。

- 双重兜底:如果 JSON 解析失败,例如大模型抽风返回了纯文本,立即捕获异常并调用 generate_fallback_report,确保接口永远返回合法的结构化数据。

经过实用应用落地运行和反复优化,已经实现了以下最佳实践:

- 确定性 vs 概率性分离:计分和风险判定使用确定性的统计代码(Python/Numpy),报告生成使用概率性的大模型(LLM)。

- 防御性编程:拥有多层 fallback 机制(API 调用失败 -> 解析失败 -> 规则模板兜底),保证服务高可用。

- 数据结构契约:严格定义输入输出格式(Pydantic Model + JSON Schema),确保前后端交互稳定。

- 伦理安全:关键的风险结论由算法锁定,不被 AI 篡改,符合心理健康领域的严谨性要求。

后端接口运行日志和数据返回:

报告下载与打印:

五、总结

整个项目说到底,就是把传统的 EAP 服务从靠人、靠经验的模式,搬到了大模型 + 数字化的跑道上。以前做员工评估,往往是填完表、等报告、等咨询,周期长、个性化也很难做到精准。现在借助大模型,从员工答题、数据处理、维度分析,到风险等级判定、生成个性化报告,整个流程都被大幅压缩了。而且算法能反复学习、不断优化,评估结果也越来越稳定。

整个不仅能做标准化的量表评估,还能把员工的压力、情绪、职业满意度等数据变成直观的图表,让企业管理者一眼就能看懂团队的整体状态。真正的价值,在于把看不见的心理问题变成了可量化、可追踪、可干预的管理指标。对企业来说,既能提前预警高风险员工,提供及时干预,也能基于数据优化管理策略、提升组织效能。对员工来说,得到的是更高效、更私密、更懂你的心理关怀。

所以,这个项目不只是一个技术工具,更是一套全新的员工心理健康管理解决方案。把技术落地到业务场景里,让 EAP 从成本项变成增值项,这才是大模型在心理行业真正该有的样子。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)