极客大神构建了LLM架构画廊,Karpathy点赞

人工智能的高速公路上,LLM加速狂奔,想学习或了解LLM发动机的开发者有福了。

极客大神Sebastian Raschka构建了惊艳开发者的LLM Architecture Gallery(大语言模型架构画廊),将历年来复杂的模型结构化繁为简,引发了技术圈的热烈讨论。

AI大神Karpathy都点赞了。Sebastian Raschka同时将元数据也在GitHub上开源。

漫步架构画廊

LLM架构画廊项目在美国知名科技社区Hacker News上引发了热烈讨论。

画廊高度视觉化且互动性极强。

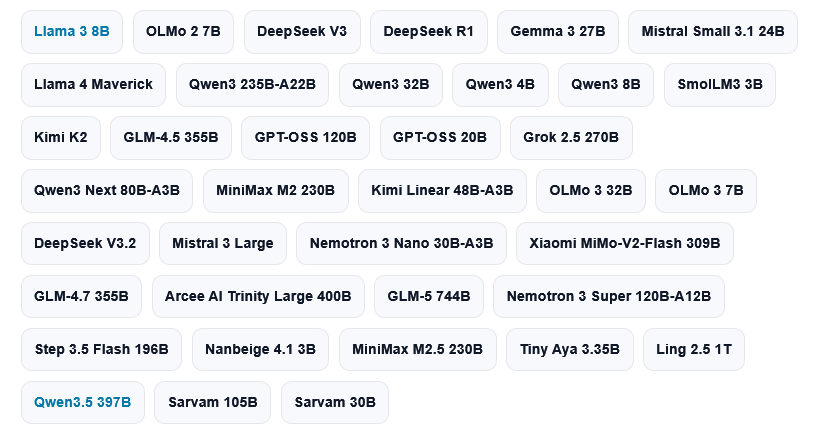

网页集中展示了从2019年的基准模型开始,一直到2026年春季各大科技公司发布的最新开放权重模型的架构图。

开发者只需点击屏幕上的模型名称,就能看到一张高清晰度的架构面板。

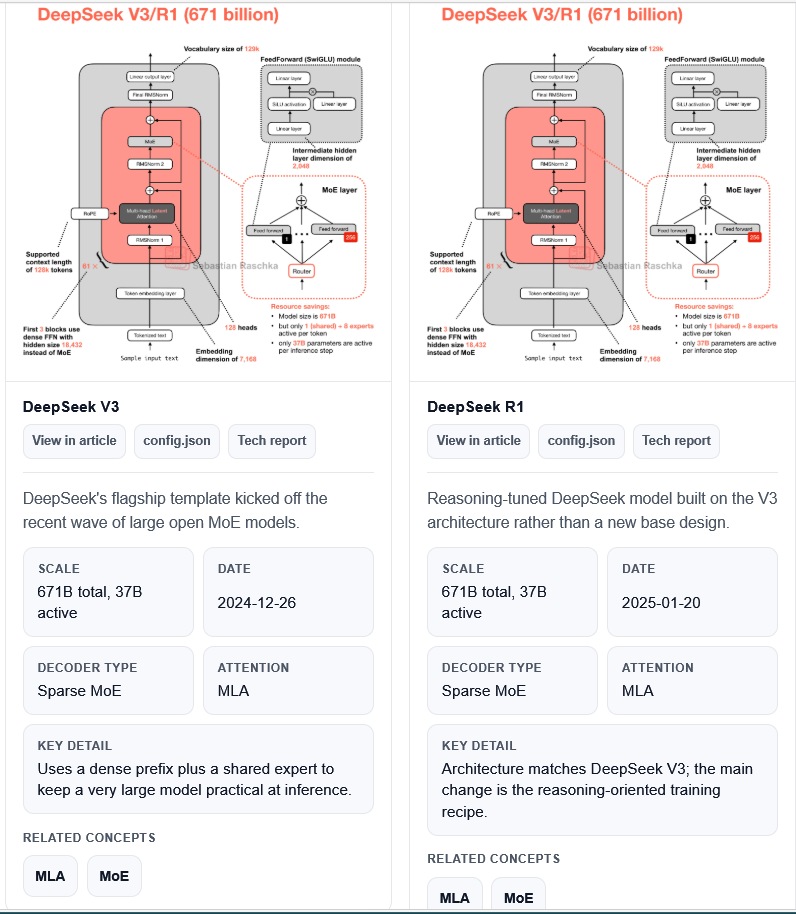

面板上详细标注了词嵌入、位置编码、归一化方法、前馈神经网络、注意力头数量、隐藏层维度以及上下文长度等核心参数。

网站为每一个入选的模型配备了一张紧凑的数据表,包含模型规模、发布日期、解码器类型以及注意力机制种类。网页还内置了对前沿概念的简明解释,涵盖GQA(分组查询注意力)、MLA(多头潜在注意力)、SWA(滑动窗口)、Gated DeltaNet(门控Delta网络)等。

开发者不再需要在浩如烟海的学术论文中来回跳转,只需按图索骥,就能迅速摸清不同模型之间的血脉传承与设计差异。

所有源数据全部托管在GitHub上,开发者可以随时提交反馈和更新建议。

洞悉演进本质

社区资深开发者在浏览完架构画廊后发出感慨,纵观过去7年的人工智能发展史,当今最顶尖的开放权重模型在宏观结构上依然有着早期架构的影子。

大家都在不断地堆叠注意力层和前馈神经网络层。能力的跨越,主要归功于算力规模的扩大以及强化学习等全新训练方法的引入。

在微观架构的设计上,各家实验室展现出了百花齐放的创新能力,核心诉求都指向了节省内存和提升计算效率。

比如Llama 4采用了与DeepSeek V3高度相似的混合专家架构,不同之处在于Llama 4坚守分组查询注意力来优化性能,DeepSeek V3全面拥抱了多头潜在注意力来大幅减少键值缓存带来的显存压力。

高效的设计理念迅速在行业内形成了共识。

法国人工智能初创公司推出的Mistral Large 3模型,采用了多头潜在注意力,在底层逻辑上与DeepSeek V3保持了高度一致,仅仅扩大了专家网络的参数规模。

为了彻底打破传统Transformer架构在处理超长文本时的计算瓶颈,部分研发团队开始尝试全新的底层路线。

通义千问团队推出的Qwen3模型,在传统的注意力层中穿插使用了门控Delta网络,大幅降低了计算复杂度。

英伟达发布的Nemotron 3 Nano模型,选择将Mamba-2状态空间模型与传统注意力机制融合,走上了一条兼顾推理速度与文本连贯性的混合架构之路。

Sebastian通过一幅幅手绘的架构图,为全行业提供了一个透明的观察窗口。

闭源模型背后的黑盒运作模式依然神秘,开放权重的模型生态却在对比中展现出了强大的生命力。

研究人员和工程师们可以通过可视化的图表,清晰地看到哪些技术被行业淘汰,哪些设计又成为了新的标准。

Sebastian是谁?

Sebastian在人工智能和机器学习领域拥有超过10年的经验,职业生涯横跨学术界与工业界。

他曾在美国UW-Madison(威斯康星大学麦迪逊分校)担任统计学助理教授,专门教授机器学习和深度学习课程。

如今在Lightning AI担任LLM研究工程师,专注于模型代码实现、系统训练以及高性能程序的开发。

Sebastian极力推崇动手编码的学习方式。面对复杂的语言模型,许多人习惯用抽象的比喻来解释原理,他更倾向于直接打开代码库,逐行探究数据如何流入模型、如何在神经网络中流转、最后如何输出结果。

他坚信物理学家理查德·费曼的理念,无法亲手建造的事物就无法真正理解。

务实的作风让他在开发者社区中积累了超高人气。

他的个人GitHub账号拥有数万名关注者,名为LLMs-from-scratch(大语言模型从零开始)的代码仓库被fork了超过1万次。

在社交平台和视频网站上,他持续无私地分享模型教程和技术心得。

Sebastian2024年出版的《从零构建大语言模型》(Build a Large Language Model (From Scratch))被无数开发者奉为案头宝典。

全书摒弃了现成的模型代码库,手把手教读者使用Python语言和PyTorch深度学习框架,在一台普通的笔记本电脑上搭建类似GPT架构的基础模型。

读者跟随章节指引,会经历准备训练数据集、设计架构、实施预训练、针对特定任务微调的完整生命周期。

他在字里行间将注意力机制、Transformer架构、文本分词等晦涩的学术概念,转化成了清晰易懂的代码逻辑。

为了帮助读者更好地消化知识,他亲自录制了长达17个小时的配套视频课程,把书本文字变成了生动的操作演示。

2026年推出了续作《从零构建推理模型》(Build a Reasoning Model (From Scratch))。重点探讨如何为系统注入强大的逻辑推理能力。

想深入了解LLM的爱好者或开发者,可以收藏起来了。

参考资料:

https://sebastianraschka.com/

https://github.com/rasbt/llm-architecture-gallery

https://sebastianraschka.com/llm-architecture-gallery/

https://news.ycombinator.com/item?id=47388676

https://x.com/rasbt/status/2033167146302210058

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献105条内容

已为社区贡献105条内容

所有评论(0)