AI自动生成测试用例为什么越来越不准确?很多团队开始重新研究知识图谱

关注 霍格沃兹测试学院公众号,回复「资料」, 领取人工智能测试开发技术合集

最近一年,AI 在软件测试领域最火的应用之一,就是:

AI 自动生成测试用例。

很多团队都做过类似尝试:

把需求文档丢给 AI,让它自动生成测试用例。

甚至有些工具可以做到:

输入一句话:

生成登录功能测试用例

AI 就能生成几十条测试场景。

第一次看到的时候,很多人都会觉得:

AI 测试时代来了。

但只要在真实项目里用一段时间,很多团队很快就会发现一个问题:

AI 写出来的测试用例,经常不完整。

于是一个新的讨论开始在测试圈出现:

AI 自动生成测试用例,真正的技术瓶颈到底在哪里?

在这个探索过程中,一个技术词开始频繁出现:

知识图谱(Knowledge Graph)

很多团队发现,仅靠 RAG 知识库,AI 很难真正理解系统结构。

这篇文章,我们就来拆解一个问题:

AI 自动生成测试用例的真实技术架构,以及为什么越来越多团队开始重新关注知识图谱。

目录

-

AI 自动生成测试用例的真实原理

-

为什么很多团队开始做 AI 测试平台

-

RAG 知识库的核心问题:关联性

-

为什么行业开始重新关注知识图谱

-

知识图谱为什么很难落地

-

AI 自动化测试架构的未来

一、AI 自动生成测试用例的真实原理

很多人第一次看到 AI 自动生成测试用例,会产生一个误解:

AI 理解了你的系统。

但实际上,大部分 AI 测试工具的工作方式是:

AI 在帮你查文档。

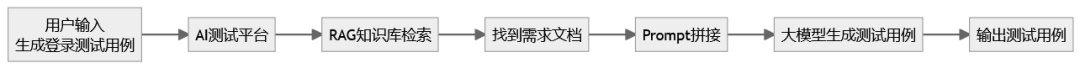

典型架构是这样的:

整个过程其实非常简单:

第一步 AI 在知识库中搜索需求文档

第二步 把需求文档和提示词一起发送给大模型

第三步 大模型根据需求生成测试用例

所以很多人会产生一种错觉:

我只输入一句话,AI 就理解业务了。

但真实发生的是:

AI 自动查找需求文档,然后再生成答案。

二、为什么很多团队开始做 AI 测试平台

如果团队成员直接使用 ChatGPT 或 Claude,会出现一个非常现实的问题:

Prompt 能力差异巨大。

例如:

普通 Prompt

生成登录测试用例

稍微专业一点的 Prompt

根据以下需求生成测试用例

包含正常流程、异常流程、边界值、安全验证

输出为测试用例表结构

生成效果差距非常大。

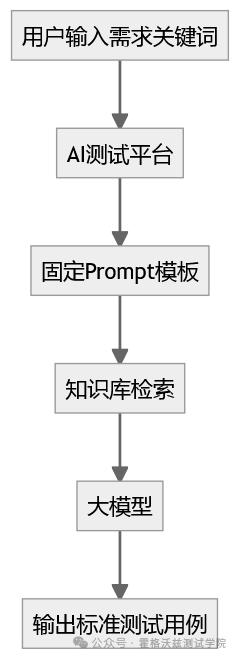

于是很多企业开始做一件事情:

把 Prompt 固定下来。

也就是通过 AI 应用平台,把复杂 Prompt 封装起来。

这样做带来三个重要价值:

统一团队 AI 使用水平

不需要每个人都掌握 Prompt Engineering。

自动查找需求文档

AI 可以自动搜索知识库中的需求。

沉淀测试经验

测试策略、测试模板可以沉淀在平台中。

这也是为什么现在越来越多公司开始搭建:

-

AI 测试平台

-

AI 测试助手

-

AI Test Agent

三、RAG 知识库的核心问题:关联性

目前大部分 AI 测试平台都会使用:

RAG(Retrieval Augmented Generation)

简单来说就是:

先搜索文档,再让 AI 生成答案。

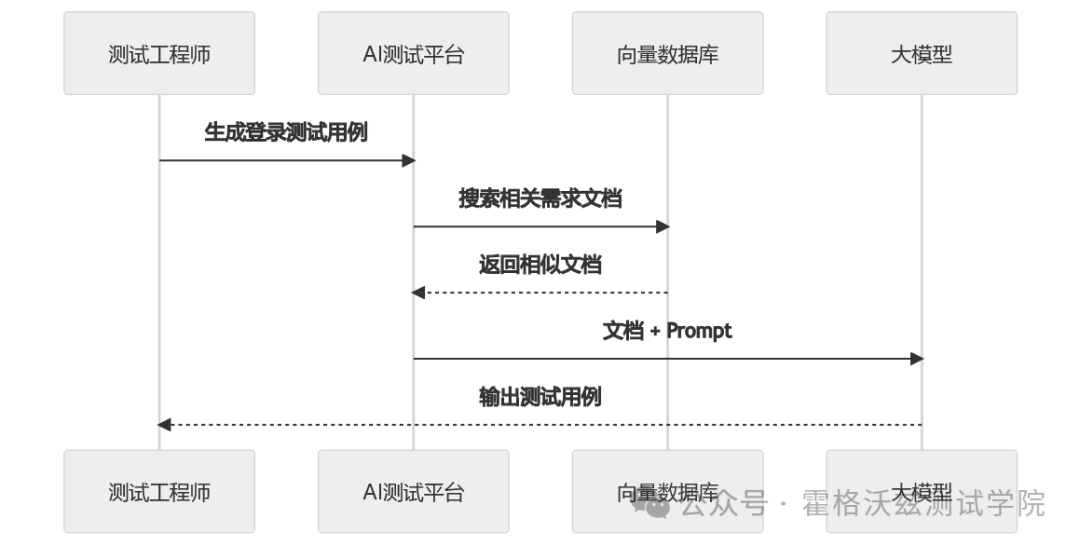

典型流程如下:

看起来逻辑非常合理。

但在真实项目里,会出现几个典型问题。

搜索结果不完整

RAG 的核心是 向量相似度搜索。

如果需求文档被拆成多个部分:

-

登录流程

-

登录安全策略

-

权限校验

-

用户状态

RAG 可能只召回其中一部分。

结果就是:

AI 生成的测试用例缺少关键场景。

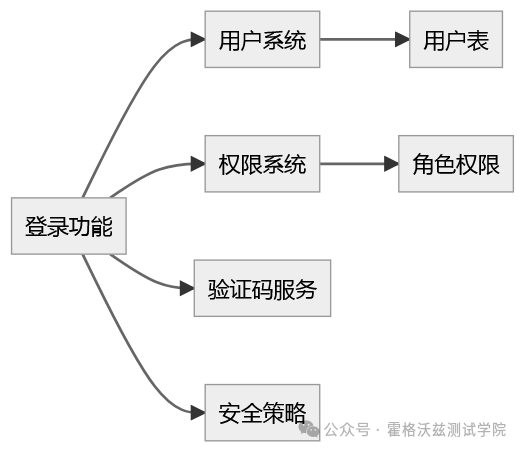

无法理解业务关系

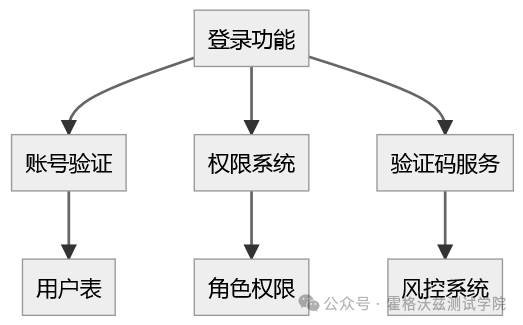

真实系统往往是这样的结构:

这些模块之间存在复杂关系。

但 RAG 只能做一件事情:

搜索相似文本。

它并不知道:

这些模块其实属于同一个业务链路。

效果受模型与切片影响

RAG 的效果还受到很多因素影响:

-

Embedding 模型

-

文档切片策略

-

检索算法

不同方案效果差异很大。

这也是为什么很多团队会发现:

AI 写测试用例 Demo 很惊艳,但真实项目效果一般。

四、为什么行业开始重新关注知识图谱

为了解决 RAG 的关联问题,行业开始重新关注一个技术:

知识图谱(Knowledge Graph)

知识图谱的核心思想不是搜索文档,而是:

构建业务关系网络。

例如:

当 AI 查询:

登录功能测试用例

系统不仅能找到文档,还能找到:

-

相关模块

-

依赖系统

-

上下游关系

这样生成的测试用例就会更加完整。

五、知识图谱为什么很难落地

知识图谱听起来非常理想。

但真正落地时,会遇到一个现实问题:

成本非常高。

构建知识图谱通常需要:

-

数据清洗

-

实体识别

-

关系建模

-

持续维护

而企业项目里的需求文档往往:

-

写得不规范

-

版本很多

-

结构混乱

要把这些数据结构化成知识图谱,成本非常高。

所以目前行业的真实情况是:

|

技术方案 |

行业状态 |

|---|---|

|

RAG知识库 |

已大量应用 |

|

AI测试平台 |

正在落地 |

|

知识图谱 |

仍在探索 |

很多团队仍在寻找:

成本更低的 AI 测试架构。

六、AI 自动生成测试用例的未来架构

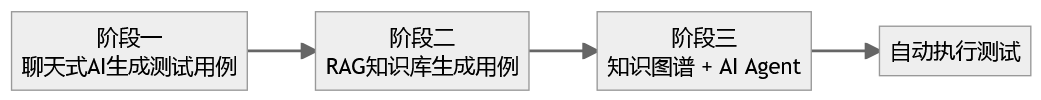

AI 测试技术正在经历三个阶段:

未来真正成熟的 AI 测试架构,很可能会是这样:

也就是说:

AI 不只是写测试用例。

它会逐渐演变成:

自动测试工程师。

结语

AI 自动生成测试用例确实展示了巨大的潜力。

但工程世界里有一个非常朴素的事实:

问题往往不在模型,而在数据结构。

RAG 解决的是:

文档检索问题

知识图谱试图解决的是:

业务关系问题

而真正成熟的 AI 测试系统,仍然在进化之中。

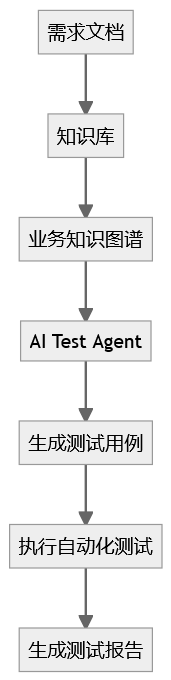

未来几年,我们很可能会看到一种新的角色:

AI Test Agent(测试智能体)

它可以:

-

自动阅读需求

-

自动生成测试用例

-

自动执行测试

-

自动生成测试报告

当这一天真正到来时,软件测试的工作方式可能会发生一次巨大的变化。

关于我们

霍格沃兹测试开发学社,隶属于 测吧(北京)科技有限公司,是一个面向软件测试爱好者的技术交流社区。

学社围绕现代软件测试工程体系展开,内容涵盖软件测试入门、自动化测试、性能测试、接口测试、测试开发、全栈测试,以及人工智能测试与 AI 在测试工程中的应用实践。

我们关注测试工程能力的系统化建设,包括 Python 自动化测试、Java 自动化测试、Web 与 App 自动化、持续集成与质量体系建设,同时探索 AI 驱动的测试设计、用例生成、自动化执行与质量分析方法,沉淀可复用、可落地的测试开发工程经验。

在技术社区与工程实践之外,学社还参与测试工程人才培养体系建设,面向高校提供测试实训平台与实践支持,组织开展 “火焰杯” 软件测试相关技术赛事,并探索以能力为导向的人才培养模式,包括高校学员先学习、就业后付款的实践路径。

同时,学社结合真实行业需求,为在职测试工程师与高潜学员提供名企大厂 1v1 私教服务,用于个性化能力提升与工程实践指导。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)