AI“养龙虾”爆火:功能拆解、技术底层与风险警示

近期,“AI养龙虾”成为科技圈与职场圈的热门话题,刷屏社交平台与技术社区。但需明确的是,此“养龙虾”并非传统水产养殖,而是网友对开源AI智能体框架OpenClaw的形象化称呼——因项目官方图标为红色龙虾,其“自主执行任务”的特性被调侃为“养龙虾”,本质是一款可本地化部署、能调用多工具的AI智能体,并非真正意义上的水产养殖技术赋能工具。

作为2026年初首个引发全民关注的AI智能体,OpenClaw的爆火,本质是AI从“对话式交互”向“行动式执行”的突破,但其背后的技术逻辑、核心功能与潜在风险,值得每一位技术开发者、使用者深入探讨。本文将从技术视角,拆解AI“养龙虾”的功能边界、底层技术架构,剖析当前落地过程中的核心风险,并给出针对性规避建议,适配CSDN技术社区的深度阅读需求。

一、AI“养龙虾”(OpenClaw)核心功能:不止于“好玩”,更是高效“数字员工”

与传统AI大模型(如ChatGPT、国内主流大模型)的“对话式响应”不同,AI“养龙虾”的核心优势的是“自主执行”——用户无需手动操作每一步,只需输入自然语言指令,它便能调用本地应用、整合工具资源,完成复杂流程化任务,这也是其被称为“数字员工”的核心原因。结合技术落地场景,其核心功能可分为4大类,覆盖个人办公与轻量业务场景:

1. 本地工具自动化调用

这是AI“养龙虾”最基础也最核心的功能,可直接获取本地操作系统权限,调用各类办公与工具软件,实现“指令输入-全程自动化执行”闭环。例如:用户指令“整理近一周的工作邮件,筛选重要客户邮件并撰写回复草稿”,它可自动打开邮箱、筛选关键词、提取核心信息,生成符合语气的回复草稿,全程无需用户手动操作;再如文件管理,可根据指令自动分类本地文件、批量重命名、备份指定文件夹,大幅提升办公效率。

2. 跨工具协同与流程串联

区别于单一工具的自动化,AI“养龙虾”可打通不同工具的壁垒,实现跨平台协同。例如:用户指令“从Excel中提取客户信息,导入CRM系统,同时给客户发送节日问候邮件”,它可依次调用Excel、CRM系统、邮件客户端,完成数据提取、导入、邮件编辑与发送的全流程,无需用户在多个工具间切换,解决了传统AI“只能给出步骤,无法落地执行”的痛点。

3. 数据处理与轻量开发辅助

针对技术开发者,AI“养龙虾”可提供轻量开发辅助功能:支持批量处理代码片段(如格式规范化、简单bug排查)、自动生成基础代码模板(如Python数据处理脚本、HTML基础结构),还能调用本地开发工具(如VS Code、Git),完成代码提交、版本管理等基础操作。此外,它还可自动抓取网页数据、整理接口文档,减轻开发者的重复性工作。

4. 个性化定制与持续学习

作为开源框架,OpenClaw支持用户根据自身需求,自定义训练“技能包”——开发者可通过配置插件、优化指令逻辑,让其适配特定场景(如电商运营的订单批量处理、新媒体从业者的文案批量排版)。同时,它能基于用户的使用习惯,持续优化执行逻辑,逐步提升任务完成的准确率,实现“千人千面”的个性化适配。

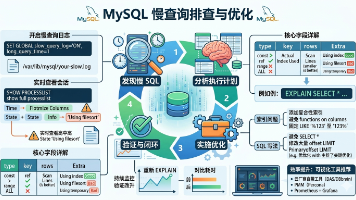

二、底层技术架构:AI“养龙虾”能“干活”的核心逻辑

AI“养龙虾”的自主执行能力,并非单一技术的突破,而是“大语言模型+工具调用框架+本地权限适配”的协同作用。其底层技术架构可分为3层,从核心到应用层层递进,每一层的技术选型都决定了其功能边界与执行效率,具体拆解如下:

1. 核心层:大语言模型(LLM)—— 指令理解与决策大脑

大语言模型是AI“养龙虾”的核心,负责理解用户自然语言指令、拆解任务步骤、规划执行路径。目前,OpenClaw支持对接主流开源大模型(如Llama 3、Qwen系列)与商用大模型(如GPT-4、字节跳动豆包),通过Prompt Engineering(提示词工程),将用户的自然语言指令,转化为可执行的机器指令序列。

核心技术点:采用“指令解析+任务规划”双模块,指令解析模块通过语义理解,识别用户需求的核心目标(如“整理邮件”)与约束条件(如“近一周”“重要客户”);任务规划模块则将目标拆解为可执行的子任务(如“打开邮箱→筛选邮件→提取信息→撰写草稿”),并确定子任务的执行顺序与依赖关系,确保流程连贯。

2. 中间层:工具调用框架—— 跨应用协同的“桥梁”

工具调用框架是连接大语言模型与本地应用的关键,也是AI“养龙虾”能实现“跨工具协同”的核心。其核心作用是将大语言模型输出的子任务指令,转化为对应应用的API调用指令,实现与本地软件、网页工具的交互。

核心技术点:采用模块化设计,支持自定义接入各类工具的API(如邮箱API、Excel API、CRM系统API),同时内置常用工具的适配模板,降低开发者的接入成本;此外,框架内置“错误重试”机制,当某一步骤执行失败(如API调用超时、权限不足),会自动重试或调整执行路径,提升任务完成率。目前,OpenClaw已支持对接办公软件、开发工具、网页浏览器等20+类常用工具,且开源社区正在持续扩展工具库。

3. 应用层:本地权限适配与交互界面—— 落地执行的“载体”

应用层负责与本地操作系统交互,获取执行任务所需的权限(如文件读取/写入权限、应用调用权限),同时提供简单的交互界面,方便用户输入指令、查看执行进度、修改配置参数。

核心技术点:支持Windows、macOS、Linux多系统适配,通过系统底层接口(如Windows的COM接口、Linux的Shell命令),实现对本地应用的精准控制;权限管理采用“分级授权”模式,用户可根据需求,授予不同级别的权限(如仅读取文件、可写入文件、可调用所有应用),兼顾灵活性与安全性;交互界面简洁,支持指令输入、执行日志查看、技能包管理等基础操作,降低非技术用户的使用门槛。

三、不容忽视的风险:AI“养龙虾”的技术坑与安全隐患

尽管AI“养龙虾”的高效性令人心动,但作为一款处于早期阶段的开源AI智能体,其技术不成熟性与安全隐患同样突出。尤其是其“高权限”特性,若使用不当,可能导致数据泄露、设备被控等严重问题。结合国家互联网应急中心、国家安全部发布的风险提示,以及开发者实际落地经验,核心风险可分为4大类,值得重点警惕:

1. 权限滥用与设备安全风险

AI“养龙虾”的核心能力依赖于本地系统权限,而其默认安全配置极为脆弱——若用户为了追求功能完整性,授予其最高系统权限,可能导致两大问题:一是AI误操作风险,如误删除重要文件、修改系统配置,造成不可逆损失;二是被攻击者利用,攻击者可通过漏洞获取设备完全控制权,远程操控设备、窃取资源,其隐蔽性远超传统木马程序。据国家信息安全漏洞库统计,2026年1-3月,OpenClaw已被曝出82个漏洞,其中包含多个超危、高危漏洞,给攻击者提供了可乘之机。

2. 数据安全与隐私泄露风险

AI“养龙虾”在执行任务过程中,会接触大量敏感数据——个人用户的照片、文档、聊天记录、支付账户信息,企业用户的核心业务数据、商业机密、客户信息等。若权限配置不当、插件来源不可信,或数据存储未加密,可能导致敏感数据泄露。此外,部分用户为了图便利,选择第三方部署服务,而这些第三方往往缺乏完善的安全防护条件,极易导致设备数据暴露,进一步加剧隐私泄露风险。从法律层面而言,若AI未经授权收集、处理敏感数据,还可能构成非法获取计算机信息系统数据罪、侵犯公民个人信息罪。

3. 技术门槛与维护成本风险

对于纯技术小白而言,AI“养龙虾”的部署与维护存在较高门槛:原版部署需配置Git、Node.js、Docker等环境,依赖命令行操作,小白很容易卡在安装调试阶段;此外,为了保证功能正常运行,需持续更新版本、修复漏洞、调试插件,若缺乏技术能力,需依赖他人维护,产生持续的时间与人力成本。同时,接入优质大模型需支付Token费用,高频运行可能产生较高的使用成本,有用户反馈,部分场景下日耗可达百元以上。

4. 责任界定与伦理滥用风险

目前,AI智能体的相关法律规范尚未完善,当AI“养龙虾”执行错误操作、产生不良内容,或被用于非法活动(如自动发垃圾邮件、传播虚假信息、实施诈骗)时,开发者、部署者、使用者之间的责任界定模糊,存在明显的法律与伦理灰色地带。例如,有人利用其自动给主播打赏、发私信邀约,涉嫌侵犯他人权益;若被攻击者接管,还可能被用于生成虚假信息,危害网络安全。

四、技术开发者视角:如何安全、高效地“养龙虾”?

针对上述风险,结合开源社区的实践经验与官方安全提示,从技术开发者角度,给出4点实操建议,帮助大家规避风险、发挥AI“养龙虾”的价值:

-

遵循“最小权限原则”:部署时,仅授予AI完成任务所需的最低权限,避免授予最高系统权限;例如,仅允许其读取指定文件夹、调用特定应用,禁止其访问支付软件、核心业务系统等敏感场景,从源头降低安全风险。

-

做好安全防护配置:采用容器、虚拟机等技术,隔离AI的运行环境,避免其影响本地核心系统;对敏感数据进行加密存储,建立完整的操作审计日志,便于追溯异常操作;定期更新OpenClaw版本,及时修复漏洞,不使用来源不明的插件、技能包。

-

理性选型与部署:根据自身需求选择合适的大模型对接,个人用户可优先选择开源大模型,降低使用成本;企业用户建议采用本地部署模式,避免核心数据上传至第三方平台;纯技术小白可选择成熟的第三方部署工具,降低部署门槛,同时谨慎评估使用价值,避免盲目跟风。

-

关注合规与责任边界:开发、使用过程中,严格遵守《个人信息保护法》《网络安全法》等相关法律法规,不利用AI从事非法活动;若用于企业场景,需明确AI的使用范围与责任划分,建立完善的使用规范,避免因AI操作引发法律风险。

五、总结:AI“养龙虾”的未来与技术启示

AI“养龙虾”(OpenClaw)的爆火,并非偶然——它背后反映的是AI技术从“认知”向“行动”的进阶,是智能体技术落地的重要尝试,也为AI的商业化、规模化应用提供了新路径。对于技术开发者而言,它不仅是一款高效的办公辅助工具,更是研究AI工具调用、智能体架构设计的优质开源案例,其模块化设计、跨工具协同逻辑,值得借鉴到更多AI落地场景中。

但我们也需清醒地认识到,AI“养龙虾”仍处于早期阶段,技术不成熟、安全隐患突出,尚未形成完善的行业规范与法律约束。热潮之下,理性看待其价值与风险,不盲目跟风,做好安全防护,才是正确的使用姿态。

未来,随着技术的迭代、漏洞的修复与行业规范的完善,AI智能体有望在更多场景落地,成为提升工作效率、赋能产业升级的重要力量。而对于开发者而言,把握智能体技术的核心逻辑,兼顾功能实现与安全合规,才能在AI技术的浪潮中,真正发挥技术的价值。

最后,提醒各位技术同仁:AI工具的核心是“赋能”,而非“替代”,合理利用AI“养龙虾”,规避风险、提升效率,才是其存在的真正意义。后续,笔者也将持续关注OpenClaw的技术迭代,分享更多部署、优化与安全防护的实操技巧,欢迎大家在评论区交流探讨。

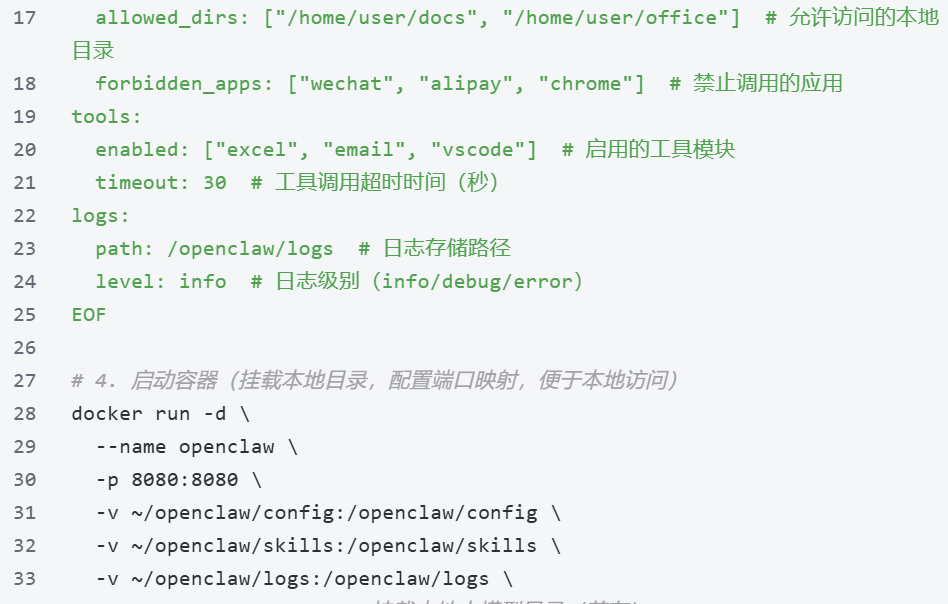

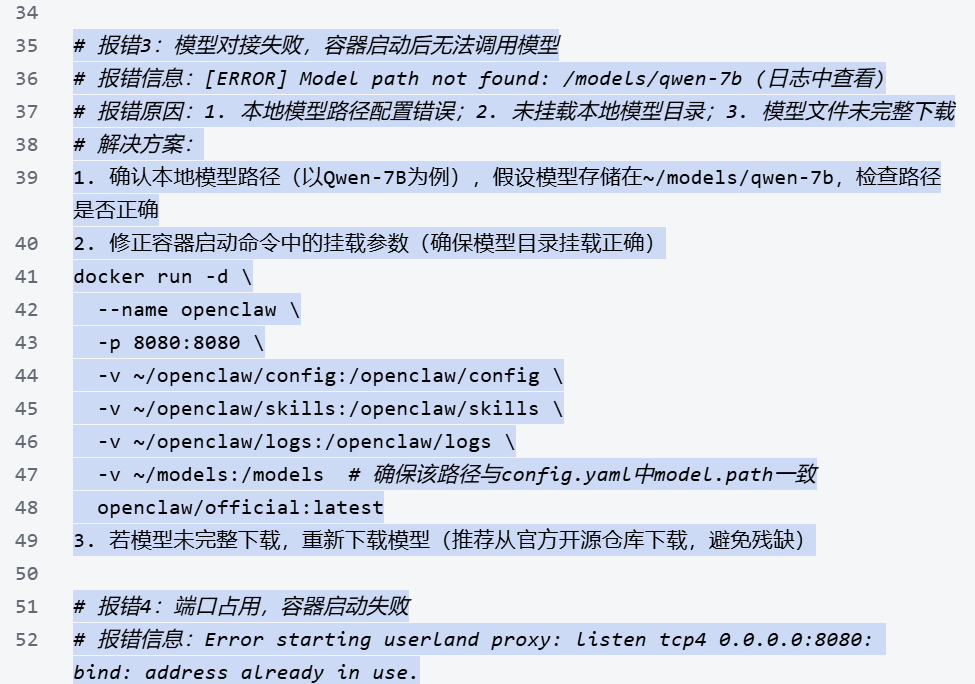

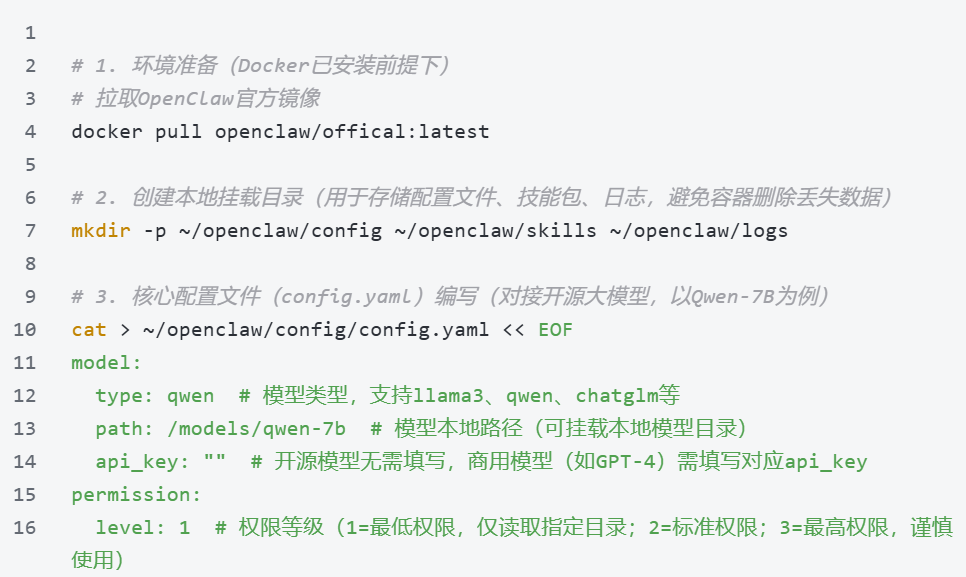

附:OpenClaw本地化部署核心代码片段(实操必备)

以下代码适配Windows/macOS通用环境,基于Docker容器部署(降低环境配置门槛),包含核心依赖安装、大模型对接、基础权限配置,开发者可直接复制修改使用,适配Llama 3、Qwen系列开源大模型,避开部署常见坑。

补充说明:1. 若未安装Docker,可先执行sudo apt install docker-ce(Ubuntu)/ brew install docker(macOS)完成安装;2. 大模型需提前下载至本地,或配置远程模型API地址;3. 权限等级建议设置为1,后续根据需求逐步提升,避免权限过高引发安全风险;4. 若启动失败,可查看logs目录下的error日志,大概率是模型路径配置错误或权限不足。

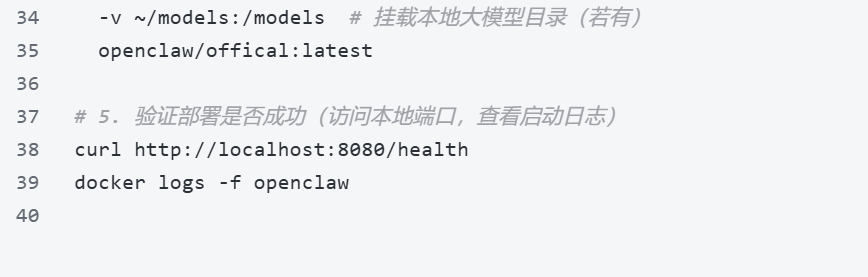

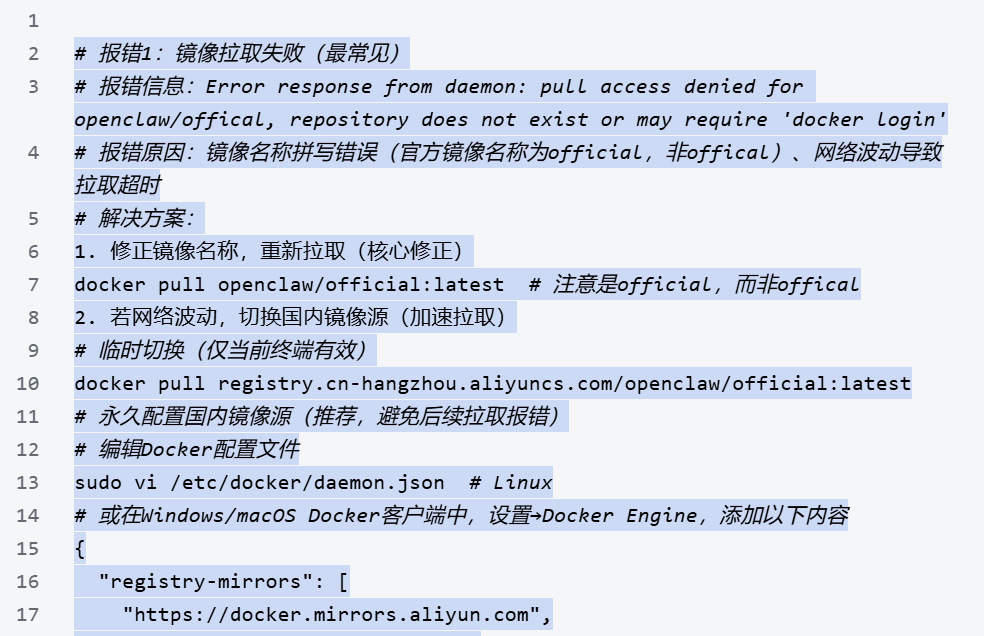

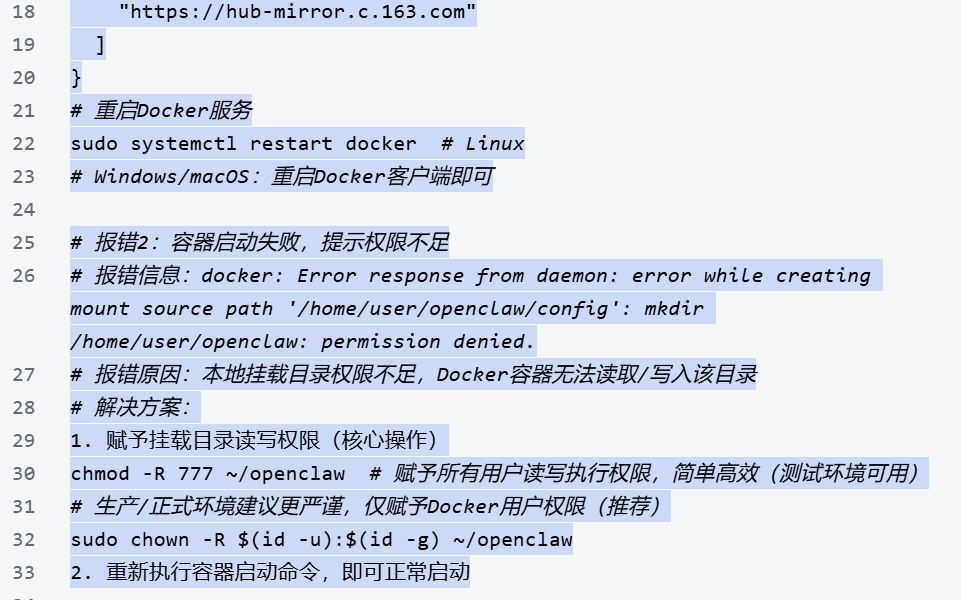

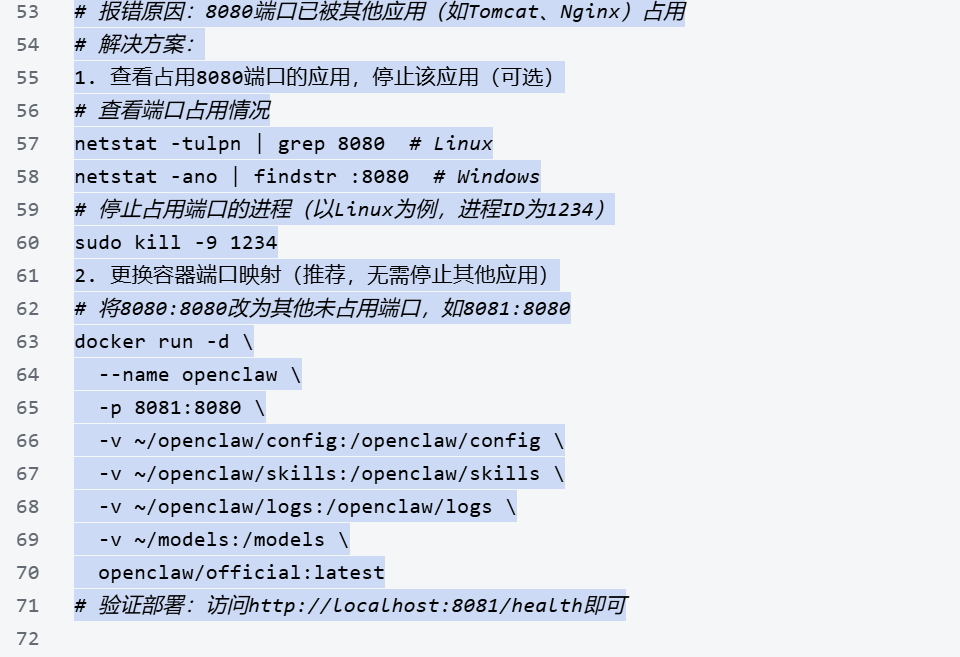

常见部署报错及解决方案(避坑重点)

部署过程中,新手易遇到镜像拉取失败、容器启动报错、模型对接失败等问题,以下整理4类高频报错,附详细原因分析与可直接操作的解决步骤,覆盖Windows/macOS/Linux全环境,无需复杂排查。

补充提示:若遇到其他未列举的报错,可通过「docker logs -f openclaw」查看完整错误日志,重点关注“error”关键字,结合日志提示定位问题;若仍无法解决,可前往OpenClaw开源社区提交issue,获取官方技术支持。

补充提示:若遇到其他未列举的报错,可通过「docker logs -f openclaw」查看完整错误日志,重点关注“error”关键字,结合日志提示定位问题;若仍无法解决,可前往OpenClaw开源社区提交issue,获取官方技术支持。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)