LabVIEW 携手 YOLOv8:全方位视觉处理的奇妙之旅

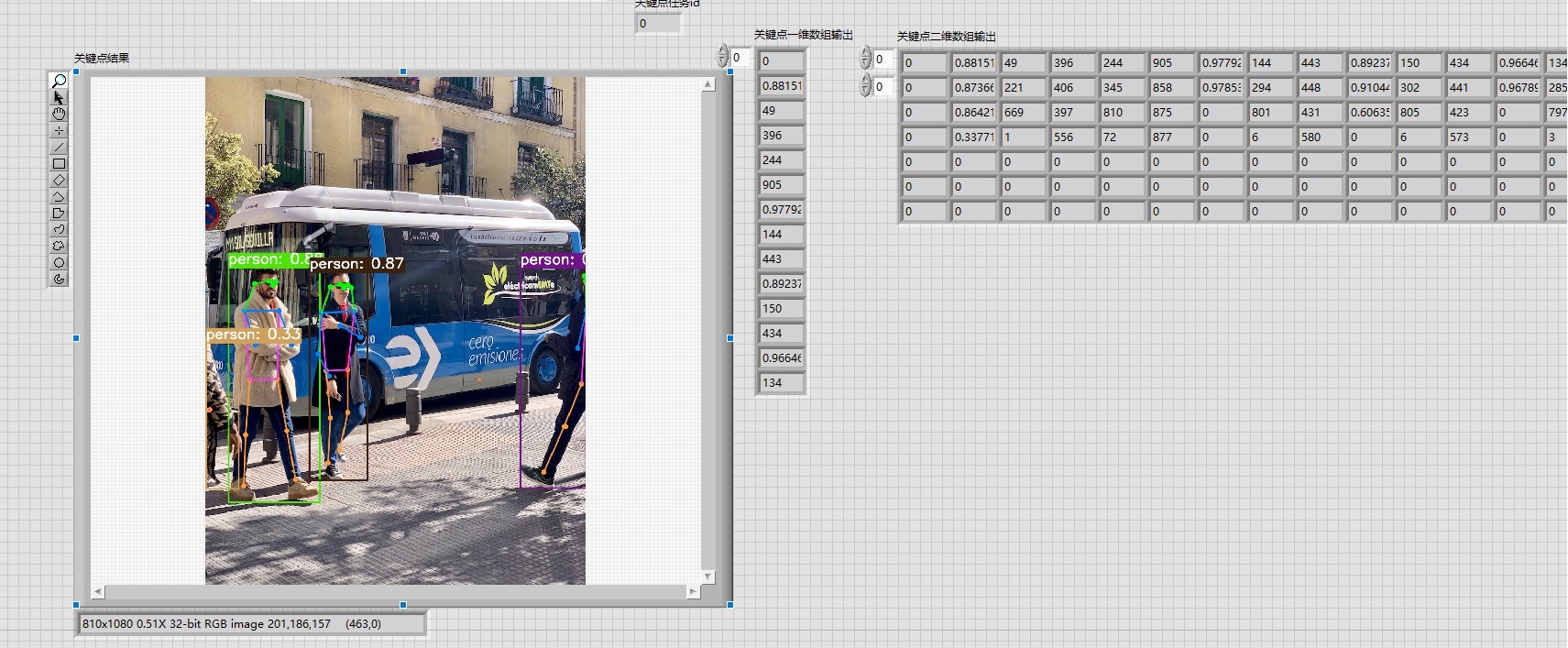

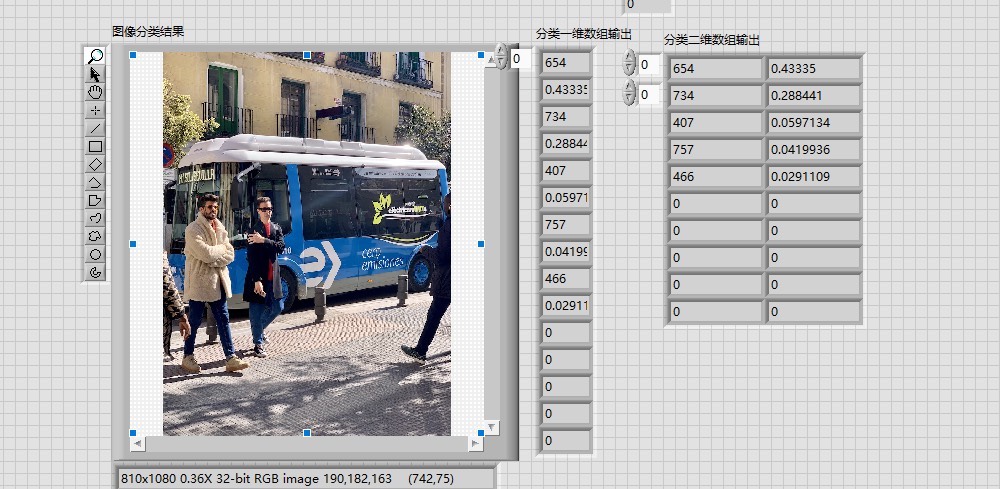

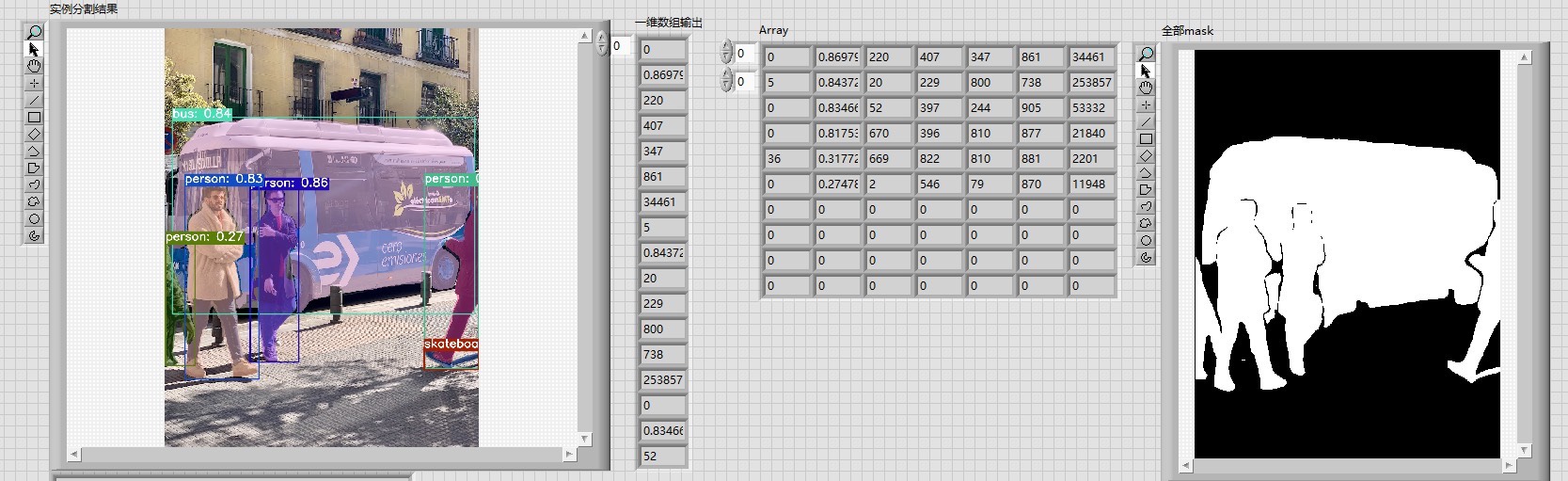

labview yolov8分类,目标检测,实例分割,关键点检测onnxruntime推理,封装dll, labview调用dll,支持同时加载多个模型并行推理,可cpu/gpu, x86/x64位,识别视频和图片,cpu和gpu可选,只需要替换模型的onnx和names即可,源码和库函数,推理速度很快,还有trt模型推理。 同时还有标注,训练源码(labview编写,后台调用python)

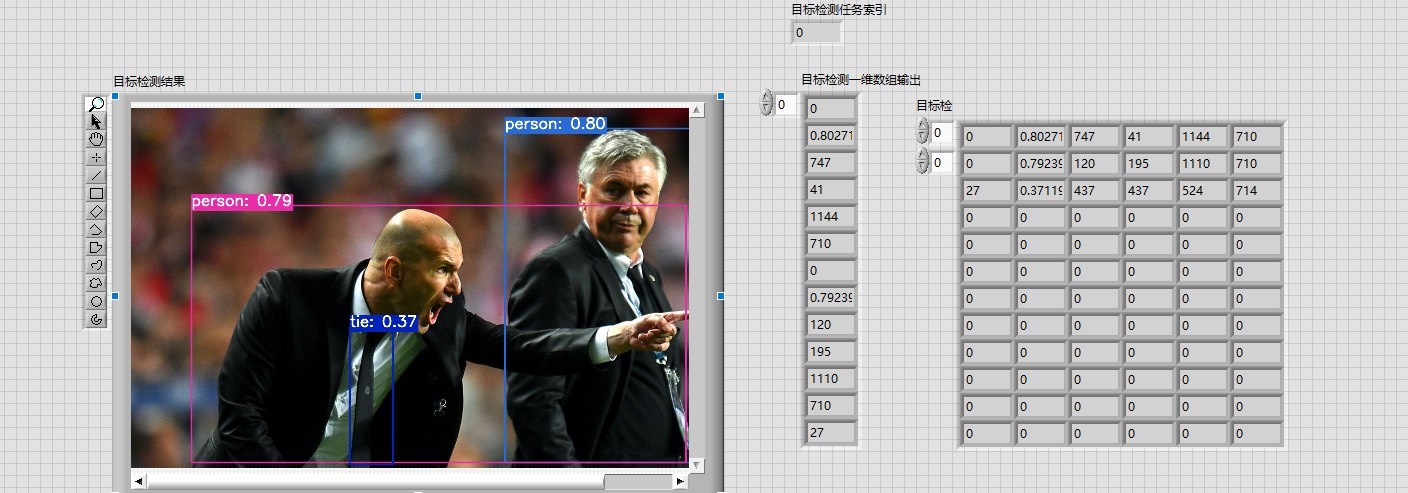

在计算机视觉领域,YOLOv8 无疑是一颗耀眼的明星,它的高效与准确令人称赞。今天咱们就来聊聊如何在 LabVIEW 中玩转 YOLOv8,实现分类、目标检测、实例分割以及关键点检测,并且通过onnxruntime 推理,还能封装成 DLL 供 LabVIEW 调用,支持多模型并行推理,无论是 CPU 还是 GPU,x86 还是 x64 位系统都能轻松驾驭,同时还能识别视频和图片,这可太实用了!

一、onnxruntime 推理实现

首先讲讲onnxruntime 推理。onnxruntime 是一个跨平台的机器学习推理加速器,能很好地与 YOLOv8 的 ONNX 模型配合。

下面以一段简单的 Python 代码示例,展示如何使用onnxruntime 进行目标检测推理:

import onnxruntime

import numpy as np

# 加载ONNX模型

ort_session = onnxruntime.InferenceSession('yolov8n.onnx')

# 假设我们有预处理好的图像数据

image_data = np.random.rand(1, 3, 640, 640).astype(np.float32)

# 运行推理

outputs = ort_session.run(None, {'images': image_data})在这段代码中,我们先通过 onnxruntime.InferenceSession 加载了 YOLOv8 的 ONNX 模型。然后准备了随机生成的图像数据(实际应用中肯定是从图片或视频帧获取并预处理好的数据),最后通过 ort_session.run 方法运行推理,得到输出结果。这些输出结果经过后续处理,就能获取到目标检测的相关信息,比如目标的类别、位置等。

二、封装 DLL

为了方便在 LabVIEW 中调用,我们需要把这些推理功能封装成 DLL。以 C++ 为例,利用 ONNX Runtime C++ API 来封装:

#include <onnxruntime_cxx_api.h>

#include <iostream>

#include <vector>

extern "C" __declspec(dllexport) void runYoloInference(float* image_data, float* output_data) {

Ort::Env env(ORT_LOGGING_LEVEL_ERROR, "yolo_inference");

Ort::SessionOptions session_options;

session_options.SetGraphOptimizationLevel(GraphOptimizationLevel::ORT_ENABLE_ALL);

Ort::Session session(env, "yolov8n.onnx", session_options);

Ort::AllocatorWithDefaultOptions allocator;

const int64_t input_shape[] = {1, 3, 640, 640};

Ort::Value input_tensor = Ort::Value::CreateTensor<float>(allocator, image_data, 3 * 640 * 640, input_shape, 4);

std::vector<const char*> input_names = {"images"};

std::vector<const char*> output_names = {"output0"};

std::vector<Ort::Value> output_tensors;

session.Run(Ort::RunOptions{nullptr}, input_names.data(), &input_tensor, 1, output_names.data(), output_tensors, 1);

Ort::Value& output_tensor = output_tensors[0];

float* output = output_tensor.GetTensorMutableData<float>();

for (int i = 0; i < 1000; ++i) {

output_data[i] = output[i];

}

}在这段 C++ 代码中,我们定义了一个 runYoloInference 函数,它接受输入图像数据指针和输出数据指针。在函数内部,创建了 ONNX Runtime 的环境和会话,准备输入张量并运行推理,最后将推理结果复制到输出数据指针指向的内存区域。通过 declspec(dllexport) 声明,这个函数就能被封装成 DLL 供其他程序调用,比如 LabVIEW。

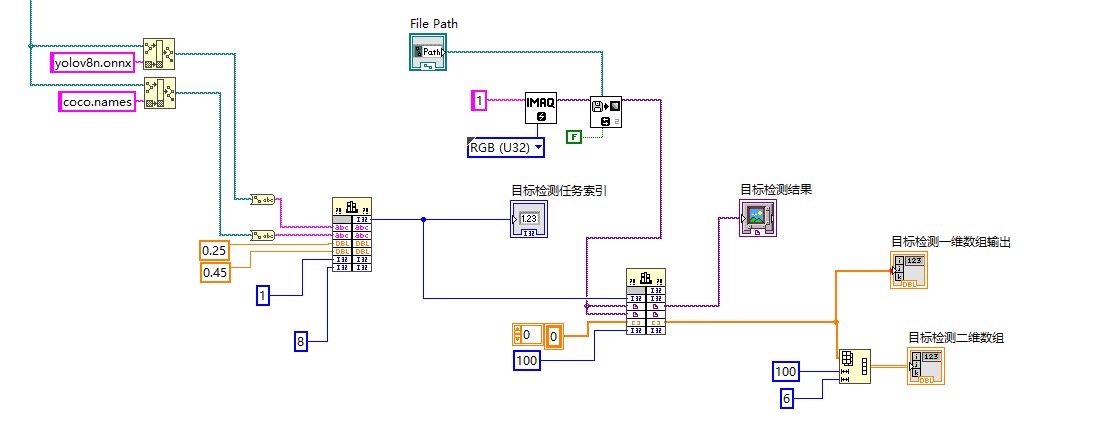

三、LabVIEW 调用 DLL

在 LabVIEW 中调用这个 DLL 也不难。首先在 LabVIEW 中创建一个调用库函数节点,设置好 DLL 路径、函数名以及参数类型。假设我们之前封装的 DLL 名为 yolo_inference.dll:

- 在 LabVIEW 前面板创建输入输出控件,用于传递图像数据和接收推理结果。

- 在程序框图中放置调用库函数节点,设置库名称为

yolo_inference.dll,函数名称为runYoloInference。 - 配置参数,输入图像数据参数设置为

float[]类型,输出数据参数也设置为float[]类型。

这样,就能在 LabVIEW 中顺利调用封装好的 DLL 进行 YOLOv8 推理啦。

四、多模型并行推理

支持同时加载多个模型并行推理是个超酷的功能。在代码实现上,可以利用多线程技术。比如在 Python 中使用 concurrent.futures 模块:

import concurrent.futures

import onnxruntime

import numpy as np

def run_inference(model_path, image_data):

ort_session = onnxruntime.InferenceSession(model_path)

outputs = ort_session.run(None, {'images': image_data})

return outputs

models = ['yolov8n1.onnx', 'yolov8n2.onnx']

image_data = np.random.rand(1, 3, 640, 640).astype(np.float32)

with concurrent.futures.ThreadPoolExecutor() as executor:

futures = []

for model in models:

future = executor.submit(run_inference, model, image_data)

futures.append(future)

results = []

for future in concurrent.futures.as_completed(futures):

results.append(future.result())在这段代码中,定义了 run_inference 函数来运行单个模型的推理。然后通过 ThreadPoolExecutor 创建线程池,提交多个模型的推理任务到线程池并行执行,最后收集所有模型的推理结果。在实际应用到 LabVIEW 中时,结合之前封装的 DLL,通过合理的线程管理,就能实现多模型并行推理,大大提高处理效率。

五、标注与训练源码(LabVIEW 编写,后台调用 Python)

最后说说标注与训练源码。通过 LabVIEW 编写界面,后台调用 Python 脚本来实现标注和训练功能。

labview yolov8分类,目标检测,实例分割,关键点检测onnxruntime推理,封装dll, labview调用dll,支持同时加载多个模型并行推理,可cpu/gpu, x86/x64位,识别视频和图片,cpu和gpu可选,只需要替换模型的onnx和names即可,源码和库函数,推理速度很快,还有trt模型推理。 同时还有标注,训练源码(labview编写,后台调用python)

比如在 LabVIEW 中使用系统命令节点调用 Python 标注脚本:

- 在 LabVIEW 程序框图中放置系统命令节点。

- 设置命令行参数为

python labelscript.py,其中labelscript.py是实现标注功能的 Python 脚本。 - 可以传递相关参数,比如数据集路径等给 Python 脚本。

对于训练部分同样如此,通过系统命令节点调用训练的 Python 脚本,像 python train_script.py --model yolov8n --data data.yaml,这样就能方便地在 LabVIEW 界面控制下,利用 YOLOv8 进行训练了。

总之,通过以上一系列操作,我们在 LabVIEW 中构建了一个功能强大的 YOLOv8 视觉处理系统,无论是推理速度还是功能的多样性都表现出色,无论是处理图片还是视频都游刃有余,而且无论是 CPU 还是 GPU 环境,不同架构的系统都能很好适配,源码和库函数的结合也让开发者能够轻松拓展和优化。希望这篇博文能给大家在相关项目开发中带来启发和帮助!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)