实测GPT-5.4 mini:速度翻倍成本砍2/3,小模型凭什么逼近满血旗舰版?

GPT-5.4 mini 与 nano 深度解析:轻量化模型如何逼近旗舰性能?

快速摘要

2026年3月17日,OpenAI 发布了 GPT-5.4 mini 和 GPT-5.4 nano 两款轻量级模型。其中 mini 在编码基准 SWE-Bench Pro 上拿到 54.4%(旗舰版 57.7%),计算机操控基准 OSWorld-Verified 上达到 72.1%(旗舰版 75.0%),运行速度是上一代 GPT-5 mini 的两倍以上,API 输出价格仅为旗舰版的三分之一。nano 更是以极低的调用成本,在分类、数据提取等场景中提供了足够好的性能。 这两款模型的核心意义在于:它们验证了"大模型决策、小模型执行"的分层智能体架构,为开发者在生产环境中实现低延迟、低成本的 AI 应用提供了切实可行的技术路径。 往下看,有更详细的技术拆解和实操指南。

一、这次发布的背景:为什么需要"小模型"?

2026年3月初,OpenAI 刚刚发布了旗舰级的 GPT-5.4 模型,该模型具备原生计算机操控能力、百万级 token 上下文窗口,以及在多项专业基准上领先的表现。但旗舰模型有一个绕不过去的现实问题——在高频调用的生产场景中,它的延迟和成本都偏高。

举一个具体的例子:如果你正在构建一个编码助手,用户每敲一行代码就需要模型给出补全建议,等待 30 秒显然是不可接受的。又比如你搭建了一套 AI Agent 系统,主模型在规划完任务之后,需要把「搜索代码库」「审查文件」「处理表单」这些子任务分发出去并行执行,每一个子任务都用旗舰模型,成本会迅速膨胀。

这就是 GPT-5.4 mini 和 nano 要解决的问题:继承旗舰模型的核心能力,同时把速度拉上去、把成本降下来,让 AI 能在真实生产环境中大规模铺开。

我在黑龙江节点云计算科技公司考人工智能训练师的时候,教材里就反复强调过"模型选型"这个概念——并不是参数量越大、性能越强的模型就一定是最优选择,关键是要根据具体的任务场景和资源约束,选择最合适的那一个。GPT-5.4 mini 和 nano 的出现,恰好是对这个理念最生动的工程实践。

二、两款模型一览:定位与核心参数

在展开技术细节之前,先梳理一下 GPT-5.4 家族目前的三个成员及其各自的定位。

GPT-5.4(旗舰版) 是整个系列的"大脑",拥有最强的推理能力、最大的上下文窗口(Codex 中支持 100 万 token),以及原生计算机操控能力。API 输入价格为 2.50 美元/百万 token,输出价格为 15.00 美元/百万 token。它适合那些需要深度推理、长文档分析和复杂决策的场景。

GPT-5.4 mini 是本次发布的核心产品。它支持 40 万 token 的上下文窗口,继承了旗舰版在编码、推理、多模态理解和工具调用方面的大部分能力,运行速度是上一代 GPT-5 mini 的两倍以上。API 输入价格为 0.75 美元/百万 token,输出价格为 4.50 美元/百万 token——输出价格大约是旗舰版的三分之一。它的能力覆盖面非常广:文本和图像输入、工具调用、函数调用、网络搜索、文件搜索、计算机操控,一应俱全。

GPT-5.4 nano 则是系列中最小、最快、最便宜的版本。API 输入价格仅为 0.20 美元/百万 token,输出价格为 1.25 美元/百万 token——输出价格大约是旗舰版的十二分之一。OpenAI 官方推荐将它用于分类、数据提取、排序,以及作为编码工作流中的轻量级子智能体。nano 目前仅通过 API 提供,没有在 ChatGPT 界面中上线。

为了让大家更直观地感受三者的差异,我整理了一张关键参数对比:

┌──────────────────┬──────────────┬──────────────┬──────────────┐

│ 项目 │ GPT-5.4 │ GPT-5.4 │ GPT-5.4 │

│ │ (旗舰版) │ mini │ nano │

├──────────────────┼──────────────┼──────────────┼──────────────┤

│ 上下文窗口 │ 1M (Codex) │ 400K │ 400K │

│ 输入价格(/M tok) │ $2.50 │ $0.75 │ $0.20 │

│ 输出价格(/M tok) │ $15.00 │ $4.50 │ $1.25 │

│ SWE-Bench Pro │ 57.7% │ 54.4% │ 52.4% │

│ OSWorld-Verified │ 75.0% │ 72.1% │ 39.0% │

│ GPQA Diamond │ 93% │ 88.0% │ — │

│ Toolathlon │ — │ 42.9% │ — │

│ 图像输入 │ ✅ │ ✅ │ ✅ │

│ 工具/函数调用 │ ✅ │ ✅ │ ✅ │

│ 计算机操控 │ ✅ │ ✅ │ ✅ │

│ 可用渠道 │ API/ChatGPT │ API/ChatGPT │ 仅 API │

│ │ /Codex │ /Codex │ │

└──────────────────┴──────────────┴──────────────┴──────────────┘三、技术原理:小模型如何"学会"大模型的本领?

3.1 知识蒸馏——让学生超越课本

GPT-5.4 mini 和 nano 之所以能在远小于旗舰版参数规模的情况下逼近其性能,背后的核心技术之一就是知识蒸馏(Knowledge Distillation)。

知识蒸馏的思路可以用一个比喻来理解:假设旗舰版 GPT-5.4 是一位经验丰富的老教授(教师模型),而 mini 和 nano 是两个资质不错的学生(学生模型)。传统的训练方式是让学生直接看教材(原始训练数据),自己摸索答案。而知识蒸馏的做法是,让学生不仅看教材,还要认真学习老教授是怎么做题的——包括老教授对每道题各个选项的信心分布(也就是所谓的"软标签",Soft Targets)。

从技术角度来说,教师模型在做推理时,输出层的 softmax 函数会产生一个概率分布。在常规训练中,我们只关注概率最高的那个答案(硬标签)。但在蒸馏过程中,通过引入一个"温度"参数 (T),可以让这个概率分布变得更加平滑。温度越高,各个类别之间的概率差距越小,包含的信息也越丰富——比如,教师模型虽然判断答案是 A,但它同时告诉学生,B 的可能性也有 30%,而 C 只有 5%。这些细微的"暗知识"(Dark Knowledge)正是学生模型学习的关键所在。

在大语言模型领域,知识蒸馏已经发展出了多种更精细的策略。除了输出层的软标签匹配,还可以让学生模型学习教师模型的中间层特征表示、注意力分布模式等。更前沿的方法,比如 GKD(Generalized Knowledge Distillation)还会在训练过程中采样学生模型自己的输出序列来训练,以缓解训练分布和推理分布不一致的问题。

这也是为什么 GPT-5.4 nano 作为一个定位于"分类和数据提取"的超轻量模型,在 SWE-Bench Pro 上竟然能打出 52.4%——这个成绩比上一代中量级的 GPT-5 mini(45.7%)还要高出近 7 个百分点。蒸馏模型在过去几个月的进化速度,可以说是相当惊人的。

3.2 模型压缩的其他路径

除了知识蒸馏,业界在模型压缩领域还有几种常用的技术手段,它们往往会组合使用以获得最佳效果:

- 剪枝(Pruning):通过移除模型中对最终输出贡献较小的参数(权重接近零的连接),来减少模型的实际计算量。结构化剪枝可以直接减少网络层或通道数,非结构化剪枝则是将特定权重置零形成稀疏矩阵。

- 量化(Quantization):将模型参数从高精度(如 32 位浮点数)转换为低精度(如 8 位整数甚至 4 位整数)存储和计算,在精度损失可控的前提下大幅降低内存占用和推理延迟。

- 轻量化架构设计:从模型结构层面入手,设计参数更少但信息传递效率更高的网络架构。

虽然 OpenAI 没有公开 GPT-5.4 mini 和 nano 具体使用了哪些压缩技术的组合,但从它们的性能表现来看,这显然不是简单地"砍参数"就能做到的,而是在模型架构、训练策略和蒸馏方法上进行了深度优化。

四、基准测试深度拆解:数字背后说明了什么?

4.1 编码能力:mini 触碰旗舰天花板

SWE-Bench Pro 是目前衡量大模型"真实编码能力"非常硬核的基准之一。它不是让模型做选择题或填空题,而是直接给一段 GitHub 上的真实软件 Bug,让模型去修复。这就像让一个程序员坐到工位上,打开一个陌生的代码仓库,定位问题、理解上下文、写出修复代码——整个流程都要走通。

在这个基准上,各代模型的表现形成了一条清晰的进化曲线:

GPT-5 mini → 45.7%

GPT-5.4 nano → 52.4% (比上代 mini 高出 6.7%)

GPT-5.4 mini → 54.4% (比上代 mini 高出 8.7%)

GPT-5.4 旗舰 → 57.7%另一个值得关注的编码基准是 Terminal-Bench 2.0。在这项测试中,GPT-5.4 mini 拿到 60.0%,而上一代 GPT-5 mini 只有 38.2%,提升幅度超过 57%。这个差距非常夸张,说明在终端命令行环境下的编码和操作能力上,新一代 mini 模型实现了质的飞跃。

对于开发者来说,这组数据的实际含义非常直接:那些不需要旗舰模型"全功率思考"的编码任务——比如定向代码修改、前端页面生成、调试循环、代码库检索——现在完全可以交给 mini 来处理。速度快一倍,成本低一大截,效果几乎无损。

4.2 推理与工具调用:不只是"缩小版的聪明模型"

编码只是一个切面。一个模型能不能在生产环境中真正"干活",更关键的指标是推理能力和工具调用能力。

GPQA Diamond 是一个博士级科学推理基准,涉及物理、化学、生物等领域的高难度问题。GPT-5.4 mini 在这项测试中拿到了 88.0% 的成绩,与旗舰版(约 93%)的差距控制在了 5 个百分点以内。考虑到 mini 的推理速度和成本优势,这个成绩在实际应用中已经非常有价值。

更值得关注的是工具调用能力。在 AI Agent 架构中,模型需要根据任务需求,正确地选择、组合和使用各种外部工具(API、数据库查询、文件操作等),而且往往是多步骤的链式调用。Toolathlon 正是测试这种复杂工具链能力的基准——结果 GPT-5.4 mini 得分 42.9%,相比上一代 GPT-5 mini(26.9%)提升了近 60%。

在电信行业专用基准 τ²-bench 上,mini 打出了 93.4% 的高分,几乎追平旗舰版的 98.9%,把上一代 GPT-5 mini(74.1%)远远甩在身后。在另一个工具调用基准 MCP Atlas 上,GPT-5.4 mini 拿到 57.7%,上一代 GPT-5 mini 只有 47.6%。

这些数据汇成一个结论:GPT-5.4 mini 已经不只是一个"缩小版的聪明模型",它具备了在生产环境中独立完成复杂任务链的能力。

4.3 计算机操控:小模型也能"看屏幕干活"

GPT-5.4 mini 真正让人意外的,是它在计算机操控方面的表现。

所谓"计算机操控"(Computer Use),就是让 AI 像人一样使用电脑:看屏幕上的 UI 元素,判断该点哪里、该输入什么,然后执行操作。这需要视觉理解、逻辑推理和操作执行三种能力的高度协调。

OSWorld-Verified 正是测试这种综合能力的基准。在这张榜上,GPT-5.4 mini 拿到了 72.1%,旗舰版 GPT-5.4 是 75.0%,差距不到 3 个百分点。而人类基准线是 72.4%——也就是说,mini 模型的计算机操控能力已经接近人类水平。

作为对比,上一代 GPT-5 mini 在同一基准上只有 42.0%,一代之间,计算机操控能力几乎翻了一倍。

不过需要注意的是,nano 在这项测试中只拿到了 39.0%,甚至略低于上一代 GPT-5 mini 的 42.0%。这说明计算机操控任务对模型的视觉推理能力有很高的门槛要求,不是单纯缩小模型就能保住的能力。mini 和 nano 之间在这个维度上存在一道清晰的能力断层。

4.4 长上下文处理:mini 的明确短板

当然,mini 也有明显的弱点。在长上下文处理上,它和旗舰版的差距比其他维度要大得多。

OpenAI 的 MRCR v2 测试在 64K-128K 窗口下的 8 针搜索任务中,GPT-5.4 旗舰版拿到 86.0%,而 mini 只有 47.7%,差距接近 40 个百分点。在 128K-256K 窗口下,这个差距进一步拉大到 79.3% 对 33.6%。

Graphwalks 系列测试也呈现类似趋势。在父节点追踪任务上,GPT-5.4 旗舰版拿到 89.8%,mini 是 71.5%。

这说明在需要对超长文本进行精确信息检索和逻辑追踪的场景下——比如大规模文档分析、长对话记忆保持——GPT-5.4 旗舰版仍然不可替代。但这也恰好印证了产品分层的逻辑:mini 不需要在每个维度都追平旗舰,它只需要在主攻方向——速度、编码、工具调用、计算机操控——做到足够好就行。

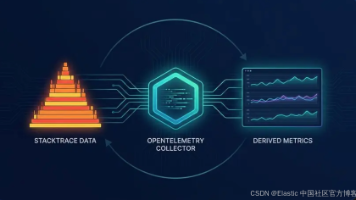

五、核心架构理念:大模型决策,小模型执行

5.1 子智能体范式

这次发布中,OpenAI 花了相当大的篇幅阐述一个重要理念:好的 AI 系统,不一定要用最大的模型来处理所有事情。

他们提出的架构思路非常清晰:旗舰模型 GPT-5.4 负责规划、协调和最终决策,然后把具体任务分发给 GPT-5.4 mini 子智能体并行执行。搜索代码库、审查大型文件、处理支持文档——这些不需要"深度思考"但需要"快速完成"的工作,全部交给 mini。

用一个公司运作的比喻来说:旗舰模型是项目总监,负责制定方案和拍板决策;mini 是执行团队的工程师,负责快速完成各项具体任务;nano 是行政助理,处理分类归档、数据整理这些琐碎但大量的日常工作。

这种分层调度在 OpenAI 的 Codex 开发工具中已经落地了。开发者可以让 GPT-5.4 制定整体方案,然后自动调度 mini 子智能体去执行各个子任务。而且 mini 在 Codex 中只消耗 GPT-5.4 配额的 30%——也就是说,同样的预算,你可以跑三倍多的 mini 任务。

5.2 实际操作:如何通过 API 调用这些模型

对于想要在自己的项目中使用 GPT-5.4 mini 和 nano 的开发者,下面是基本的 API 调用方式。模型标识符分别是 gpt-5.4-mini 和 gpt-5.4-nano。

import openai

client = openai.OpenAI(api_key="your-api-key")

# 使用 GPT-5.4 mini

response = client.chat.completions.create(

model="gpt-5.4-mini",

messages=[

{"role": "system", "content": "你是一个专业的代码审查助手。"},

{"role": "user", "content": "请审查以下 Python 函数的潜在问题..."}

],

temperature=0.3

)

print(response.choices[0].message.content)# 使用 GPT-5.4 nano 做分类任务

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "将以下客户反馈分类为:正面、负面、中性。只输出分类结果。"},

{"role": "user", "content": "产品质量不错,但物流太慢了,等了整整一周。"}

],

temperature=0

)

print(response.choices[0].message.content)如果你要搭建"大模型决策 + 小模型执行"的分层 Agent 架构,基本的思路是:

# 伪代码:分层调度架构

def handle_complex_task(task_description):

# 第一步:用旗舰模型做任务规划

plan = call_gpt54(

model="gpt-5.4",

prompt=f"请将以下任务分解为可并行执行的子任务:{task_description}"

)

subtasks = parse_subtasks(plan)

# 第二步:用 mini 并行执行各子任务

import concurrent.futures

results = {}

with concurrent.futures.ThreadPoolExecutor() as executor:

futures = {

executor.submit(call_gpt54, model="gpt-5.4-mini", prompt=subtask): subtask

for subtask in subtasks

}

for future in concurrent.futures.as_completed(futures):

subtask = futures[future]

results[subtask] = future.result()

# 第三步:用旗舰模型汇总结果并做最终决策

final_result = call_gpt54(

model="gpt-5.4",

prompt=f"请根据以下子任务结果,生成最终报告:{results}"

)

return final_result这种架构的核心优势在于:规划和决策阶段只调用一次旗舰模型(高质量但成本较高),而具体的执行工作由多个 mini 子智能体并行完成(快速且便宜)。在实际项目中,这可以将整体 API 调用成本降低 50% 以上,同时大幅缩短任务完成时间。

5.3 reasoning_effort 参数:灵活调节推理深度

OpenAI 为这些模型提供了一个名为 reasoning_effort 的参数,允许开发者根据任务复杂度灵活调节模型的推理深度。可选值包括 none、low、medium、high。

对于简单的分类任务,设置 reasoning_effort="none" 可以获得最快的响应速度和最低的 token 消耗。对于复杂的编码或推理任务,设置 reasoning_effort="high" 则能让模型进行更充分的"思考"。这个参数的存在,进一步增强了成本控制的灵活性。

六、适用场景详解:什么时候该用哪个模型?

理解了技术原理和基准数据之后,最关键的问题是:在实际项目中,到底该怎么选?

适合用 GPT-5.4 mini 的场景

mini 的最大优势是"全面且快"。它在编码、推理、工具调用、计算机操控方面的表现都很接近旗舰版,同时速度快一倍、成本低两三倍。以下场景中,mini 是非常好的选择:

- 编码助手和自动化开发工具:前端页面生成、代码补全、Bug 定位和修复、代码审查、单元测试生成。这些任务对响应速度很敏感,mini 的延迟表现可以提供接近实时的开发体验。

- AI Agent 的执行层:在分层 Agent 架构中,mini 非常适合担任"执行者"角色。它可以搜索代码库、审查文件、调用 API、填写表单、处理文档——速度快、工具调用可靠,性价比极高。

- 计算机操控类应用:网页自动化操作、桌面应用测试、RPA(机器人流程自动化)等需要"看屏幕做操作"的场景。mini 在 OSWorld-Verified 上 72.1% 的表现已经达到了人类基准水平。

- 多模态实时应用:需要结合图像和文本进行实时推理的场景,比如实时图表解读、截图内容提取等。

适合用 GPT-5.4 nano 的场景

nano 的定位很明确:高吞吐、低延迟、极低成本。它适合那些"量大但任务简单"的场景:

- 文本分类和情感分析:客户反馈分类、邮件优先级排序、内容审核标签等。

- 数据提取和结构化:从非结构化文本中提取关键信息,比如从合同中提取条款、从简历中提取技能列表等。

- 排序和推荐的预处理:对候选结果做初步排序和筛选,为后续更复杂的处理做准备。

- 轻量级编码辅助:作为编码工作流中的辅助子智能体,处理一些简单的代码片段生成或格式化任务。

仍然需要用 GPT-5.4 旗舰版的场景

- 超长文档分析:当需要在数十万甚至百万 token 的长文本中进行精确的信息检索和逻辑追踪时,旗舰版的长上下文能力明显优于 mini。

- 复杂多步推理:涉及高度抽象推理、需要多轮深度"思考"的任务。

- 高精度知识工作:需要模型在专业领域(法律、金融、医学等)给出最精准判断的场景。

- 最终决策环节:在分层 Agent 架构中,汇总子任务结果并做出最终决策的那个环节,仍然建议使用旗舰版。

七、可用渠道与使用方式

GPT-5.4 mini 已经在 API、Codex 和 ChatGPT 三端同步上线。在 ChatGPT 端,免费用户和 Go 用户可以通过菜单中的「Thinking」功能来使用 mini 模型。对于付费用户,当 GPT-5.4 Thinking 的额度耗尽时,mini 会自动作为降级备选方案,这样用户即使在额度紧张的情况下也不会突然失去推理能力。

GPT-5.4 nano 目前仅通过 API 提供,面向开发者使用。

此外,GitHub Copilot 也已经同步接入了 GPT-5.4 mini。对于日常使用 Copilot 进行编码的开发者来说,这意味着编码建议的响应速度和质量都会得到显著提升。

Microsoft Foundry 也已支持部署这两款模型。企业用户可以在 Foundry 的模型目录中评估和部署 GPT-5.4 mini 和 nano,并根据不同工作负载选择合适的模型。

八、行业影响与技术趋势

8.1 "更小的模型,更好的效果"不再是空谈

放在两年前,如果有人说"一个为速度和成本优化的小模型,能在解决真实工程问题时摸到旗舰模型的天花板",大多数人会觉得这是天方夜谭。但现在,GPT-5.4 mini 在 SWE-Bench Pro 上追到了旗舰版的 94%,在 OSWorld-Verified 上追到了 96%,在 GPQA Diamond 上追到了 95%。这些数字实实在在地证明了:通过知识蒸馏和模型压缩技术的不断进步,小模型正在以远超预期的速度逼近大模型的能力边界。

Hebbia 的 CTO Aabhas Sharma 在测试后的评价很有代表性:GPT-5.4 mini 在多项输出任务和引用召回率上,以低得多的成本匹敌甚至超越了竞品模型,还实现了比更大模型更高的端到端通过率。

Notion AI 工程负责人 Abhisek Modi 也表示:GPT-5.4 mini 在处理定义明确的聚焦任务时展现了令人印象深刻的精度,在处理复杂格式的页面编辑方面,它匹配甚至超越了 GPT-5.2 的表现,而计算资源消耗只是后者的一小部分。

8.2 分层调度正在成为行业共识

"大模型负责思考,小模型负责执行"——这种分层调度的架构思路,正在成为 AI 应用开发的行业共识。OpenAI 在自家的 Codex 产品中率先落地了这种架构,允许开发者用旗舰模型做规划、用 mini 做执行。Google 的 Gemini 系列也有类似的多层级模型布局(Gemini Pro、Flash、Flash-Lite)。

对开发者来说,这意味着架构设计的思维方式需要转变。以前的做法是"选一个最强的模型,所有任务都扔给它";现在更高效的做法是"根据任务复杂度,动态路由到不同层级的模型"。

8.3 对开发者生态的影响

这次发布对不同角色的开发者意味着不同的东西。对于独立开发者和小团队来说,以前可能因为 API 成本问题而犹豫是否在产品中深度集成 AI 能力,现在 mini 和 nano 的定价已经足够低,让小规模项目也能承受大量的 AI 调用。对于企业级应用来说,分层调度架构可以在保持服务质量的前提下,将推理成本降低一个数量级,这对于需要处理大规模并发请求的场景尤其重要。

九、关于 AI 与开发者关系的一点思考

值得一提的是,在 GPT-5.4 mini 和 nano 发布的同一天,OpenAI 创始人 Sam Altman 发了一条引发广泛讨论的帖子,大意是对那些"逐字逐句写出极其复杂软件"的开发者表示感激。评论区的反应很复杂——有人读出了认可,也有人读出了不安。

争论的焦点在于:当 AI 模型的编码能力越来越强,软件开发者的角色会如何变化?这个问题没有简单的答案,但有一个方向越来越清晰:当语法层面的编码工作被 AI 大幅简化之后,开发者的核心价值正在从"怎么写代码"转向"怎么设计系统"。理解需求、设计架构、把控质量、做出权衡——这些能力的重要性只会越来越高。

从这个角度来看,GPT-5.4 mini 和 nano 与其说是在"替代"开发者,不如说是在重新定义开发者的工作内容。善用这些工具的开发者,反而会因为执行效率的大幅提升而能够承担更复杂、更有价值的工作。

十、总结

GPT-5.4 mini 和 nano 的发布,标志着轻量级 AI 模型正式进入了一个新阶段。mini 在编码、推理、工具调用和计算机操控四个核心维度上逼近旗舰版的表现,同时将速度提升两倍、成本降低为三分之一。nano 则以极低的价格覆盖了高频低复杂度的应用场景。

更重要的是,这次发布背后的技术理念——知识蒸馏驱动的模型压缩、分层智能体架构、按任务复杂度动态路由——正在构建一种更成熟、更经济的 AI 应用范式。大模型定义智力的天花板,小模型打通 AI 走进每一个应用的毛细血管。这不再是愿景,而是今天就能跑起来的技术架构。

对于任何想在自己的产品或工作流中引入 AI 能力的开发者来说,现在是一个非常好的时机。GPT-5.4 mini 的性能足以胜任绝大多数实际任务,而它的成本已经低到了"不用"才是更大的浪费。

参考资料:

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献25条内容

已为社区贡献25条内容

所有评论(0)