Ollama本地模型接入OpenClaw教程

点击此处进入Ollama官网进行下载,下载后安装并打开

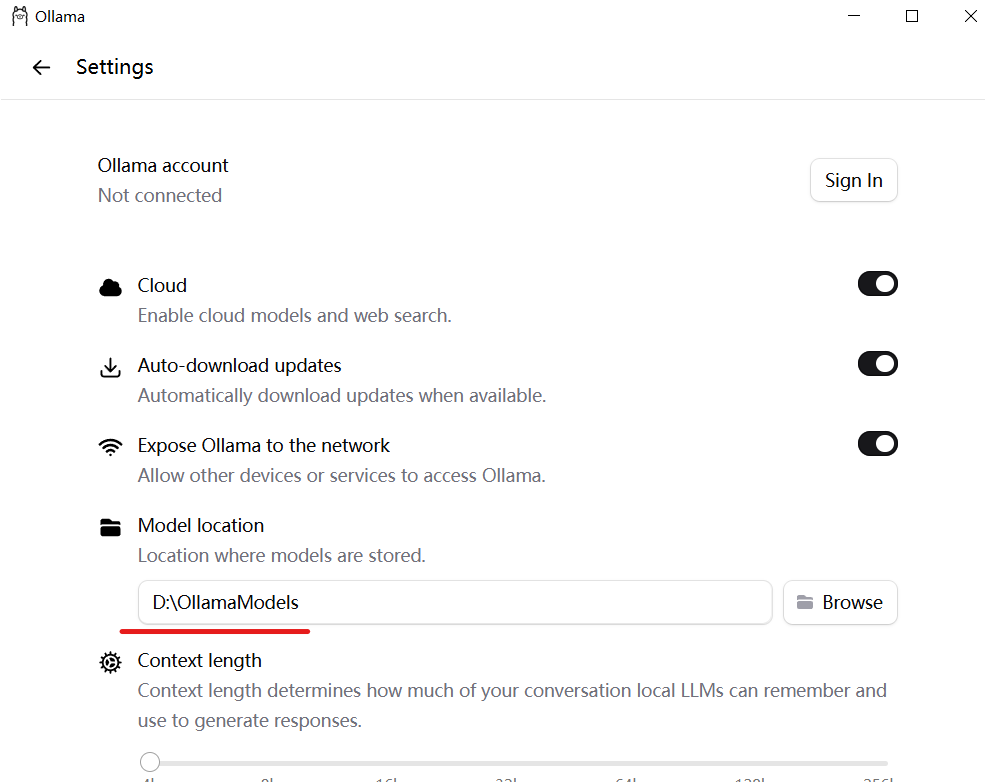

Ollama模型默认是下载到C盘。由于模型比较大,我们可以更改模型存放的位置。

首先打开Ollama,点击左侧“Settings”,在下图中找到“Model location”可选择模型存放的位置。建议将模型位置放在固态硬盘区,不建议将模型存放位置设置为机械盘

一、选择模型

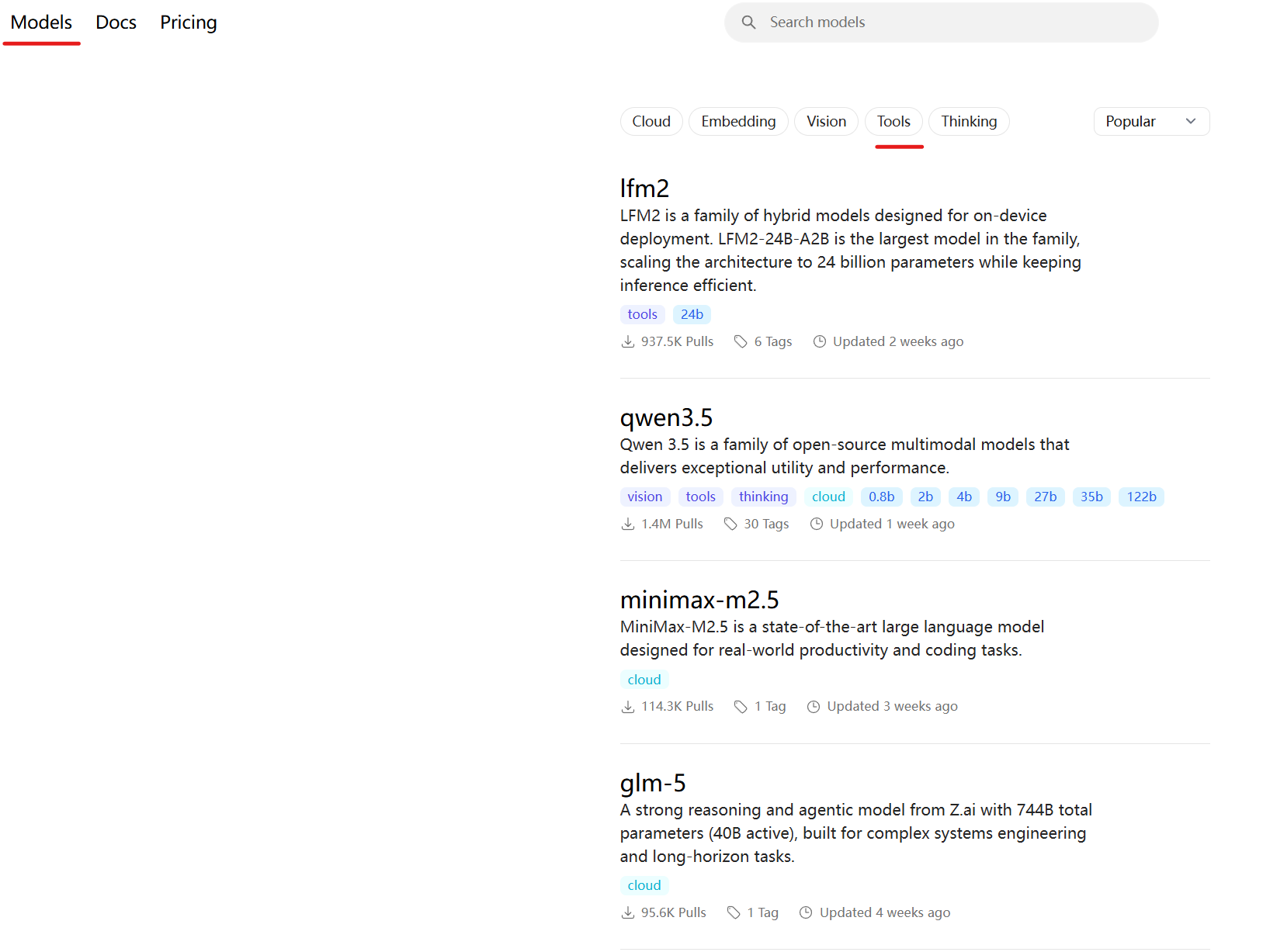

1.查看可自动识别模型

点击此处查看Ollama可下载的模型。OpenClaw 只会自动发现报告了 tools 能力的模型,不是所有模型都能被发现。所以我们点击Tools,这里面的模型是所有可以被OpenClaw自动发现的模型。依次点击左上角的Models——点击右侧的“Tools”,这里列出的所有模型是可以被OpenClaw自动识别的。我们选择一个进行下载

2.下载模型

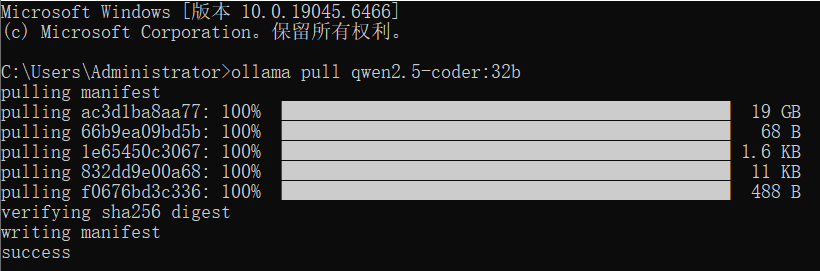

选择一个模型,win+R键打开运行框,输入CMD并回车,进入命令行。在命令行输入下列命令进行拉取

#ollama pull +要拉取的模型名称

ollama pull qwen2.5-coder:32b运行后如下图,会自动拉取所选择的模型

二、环境变量

1.配置环境变量

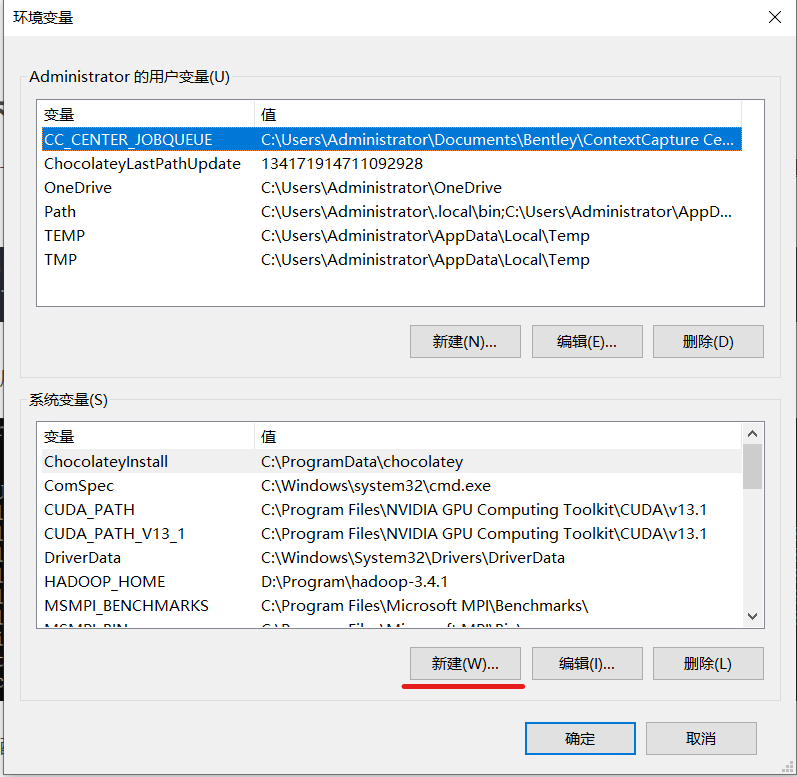

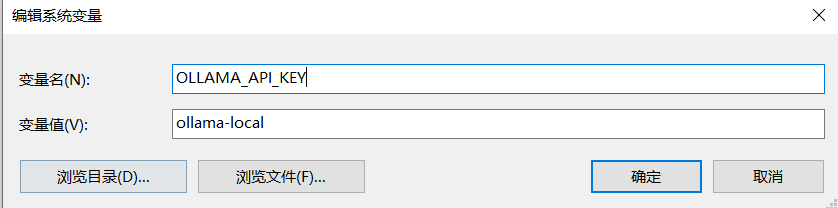

(1)通过图形化界面设置

点击Windows徽标——输入“编辑账户的环境变量”,打开后如下图

在“系统变量”处点击新建,将下面代码处分别粘贴进去,点击确定

#变量名

OLLAMA_API_KEY

#变量值

ollama-local

(2)通过PowerShell设置

# 1. 永久设置用户环境变量

[Environment]::SetEnvironmentVariable("OLLAMA_API_KEY", "ollama-local", "User")

# 2. 让当前终端立即生效(不用重启)

$env:OLLAMA_API_KEY = "ollama-local"

# 3. 再次确认

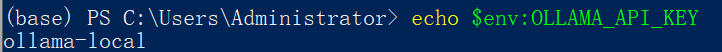

echo $env:OLLAMA_API_KEY2.验证环境变量是否配置成功

首先保证ollama正在运行

(1)在PowerShell中检查环境变量是否生效

echo $env:OLLAMA_API_KEY若能够输出下图,则环境变量配置成功。否则重新设置环境变量

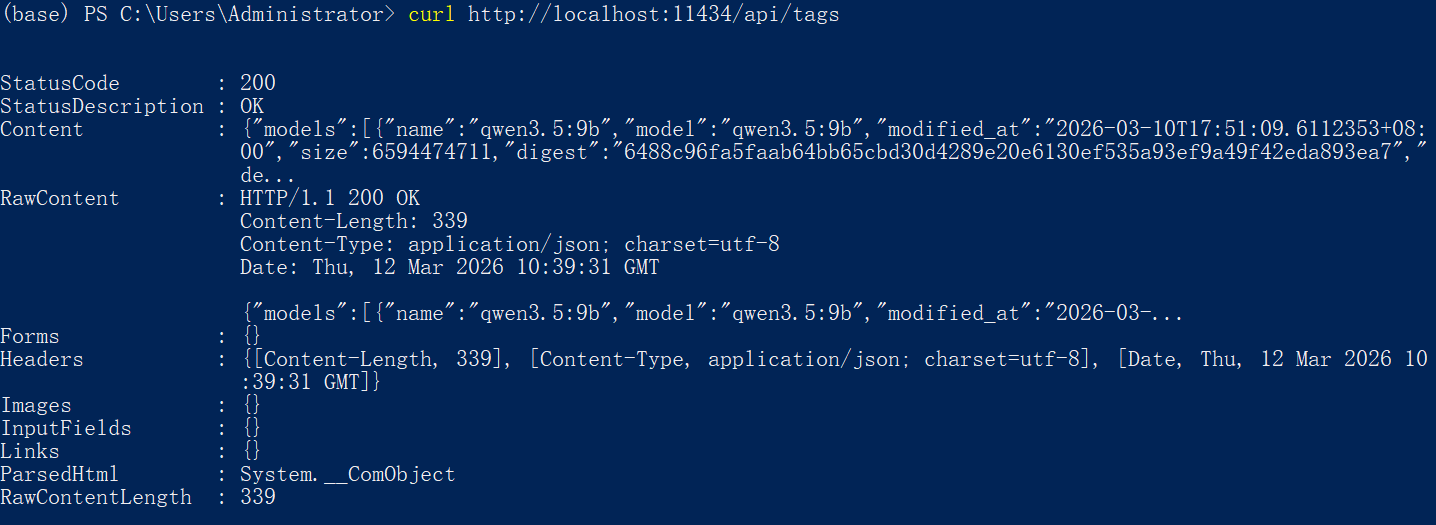

(2)测试 Ollama API 是否能被 OpenClaw 访问

在 PowerShell/CMD中 运行:

curl http://localhost:11434/api/tags若能够输出类似下列图片,则OpenClaw能够连接Ollama模型

若无输出,则需检查 Ollama 服务是否真的在 11434 端口运行。

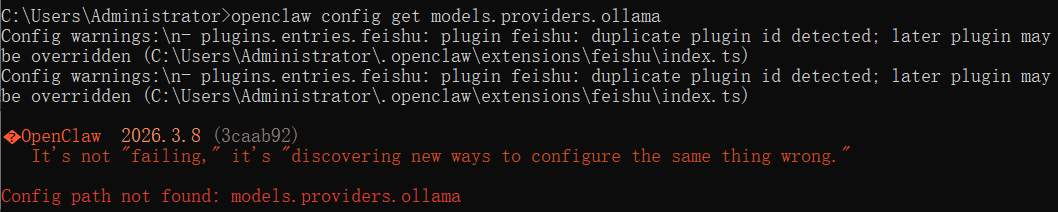

(3)验证 3:OpenClaw 的 Ollama 配置是否屏蔽了自动发现

openclaw config get models.providers.ollama正常结果应只返回apiKey: "你设置的值"(只有 apiKey,无其他字段);若返回包含baseUrl、models、maxTokens等字段 —— 说明你显式配置了完整条目,自动发现被关闭了。

我的返回结果如下

说明我之前设置的apiKey要么没生效,要么设置方式有误,导致 OpenClaw 完全没识别到 Ollama 的基础配置。按以下步骤重新配置(复制粘贴即可)

# 第一步:设置Ollama的apiKey(任意非空值即可,比如"local-ollama")

openclaw config set models.providers.ollama.apiKey "local-ollama"

# 第二步:手动指定Ollama的本地地址(确保和Ollama服务端口一致)

openclaw config set models.providers.ollama.baseUrl "http://localhost:11434"

# 第三步:验证配置是否生效(此时应该能返回配置,而不是"path not found")

openclaw config get models.providers.ollama此时重新执行下列命令

openclaw config get models.providers.ollama三、添加本地Ollama模型

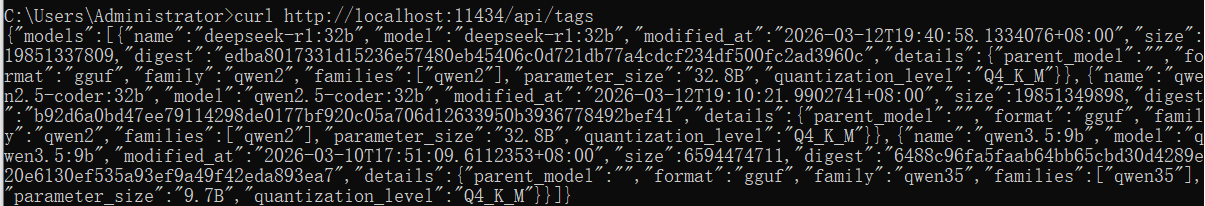

1.确认API是否正在运行

curl http://localhost:11434/api/tags2.设置openclaw模型

不建议在OpenClaw的json文件中直接修改,我们通过下列命令进行修改

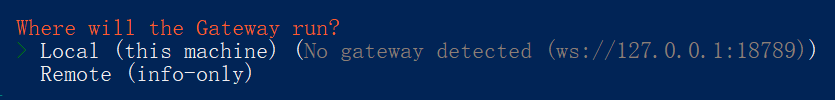

openclaw config

模型路径:如果模型装在和openclaw同一台电脑上,则选择Local;如果不一致,则选择Remote。回车进入下一步

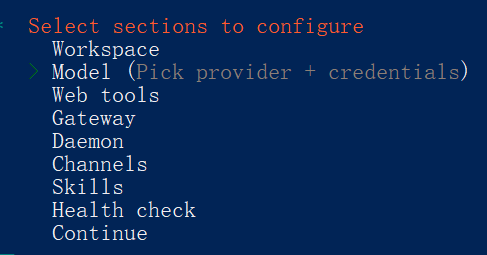

这里选择Model,回车

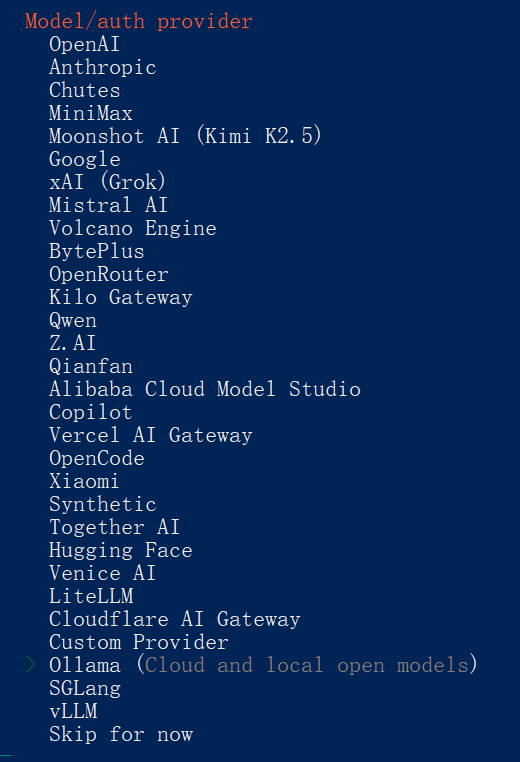

这里有2种选择方法,分别是选择Custom Providers和Ollama。这里建议选择Ollama

(1)若选择ollama

选择模型供应商,这里我们选择Ollama,回车

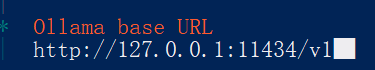

将下列内容粘贴到Ollama base URL中

http://127.0.0.1:11434/v1

这里输入“http://127.0.0.1:11434/v1”

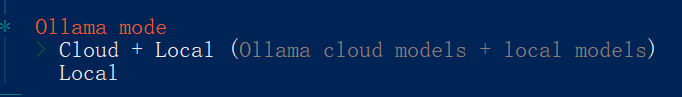

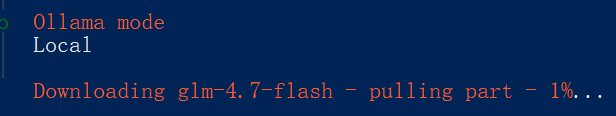

这里选择模型,我们可以选择选择第1个,也可以选择第2个。若选择第一个则会自动跳转到Ollama的登陆界面,登陆后可以使用Ollama的云端模型,也可使用本地Ollama模型;若选择第二个,则会自动下载“glm-4.7-flash”模型

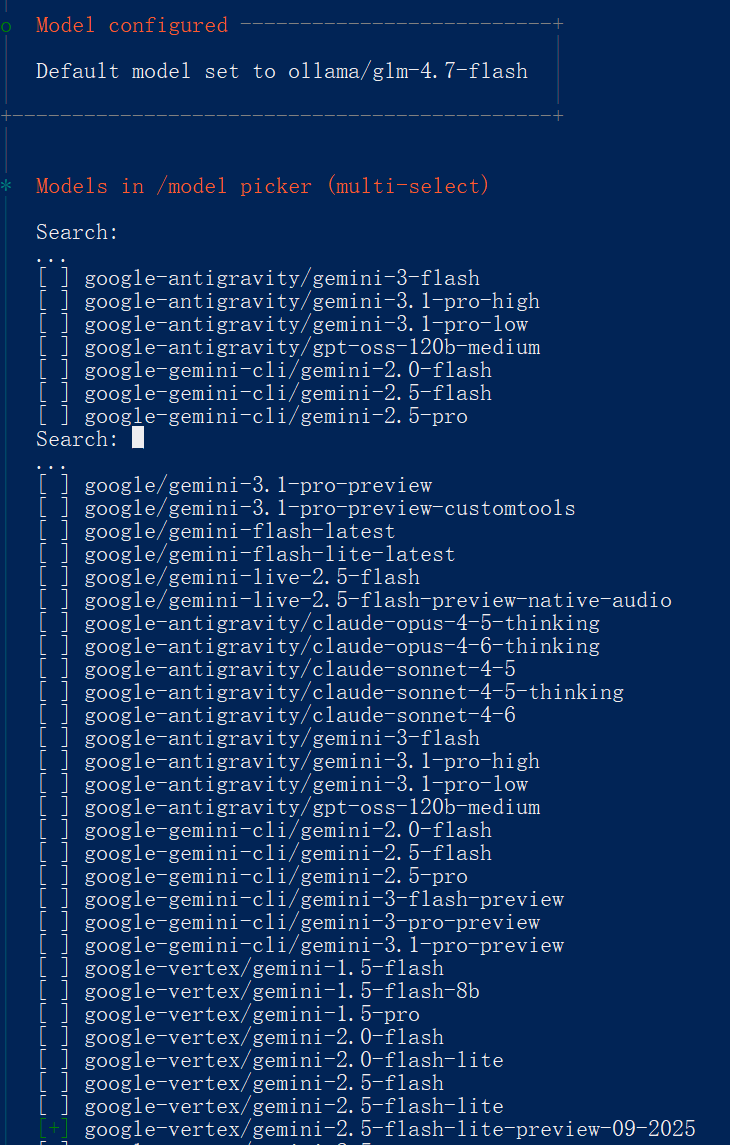

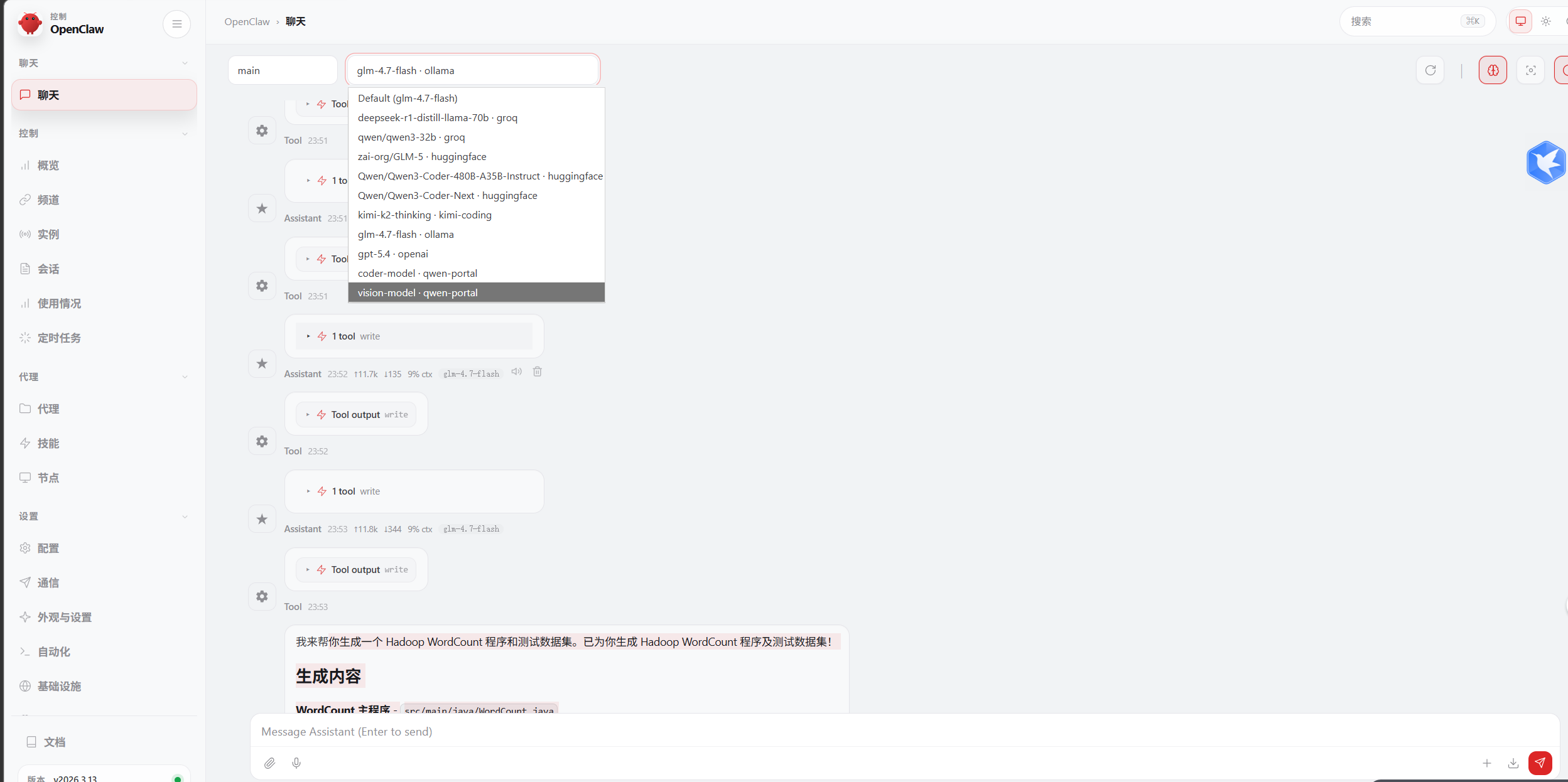

glm-4.7-flash下载完后,会出现一大串的模型列表,如下图

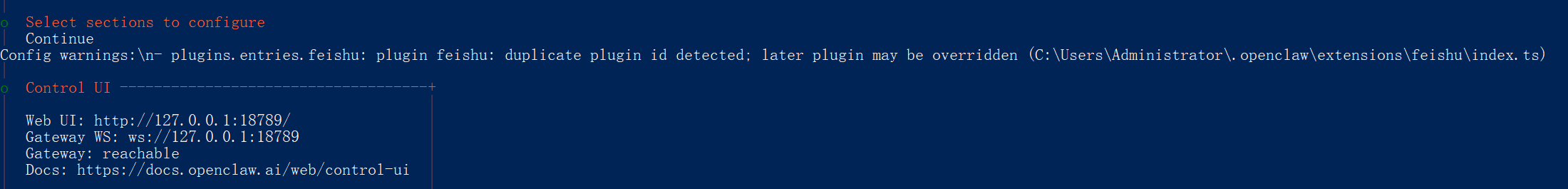

可以在这里选择需要的模型,按空格键选择,按回车键下载;还可以直接输入所需的模型,可以搜索你所需的模型。选择模型进行下载时会跳出一个cmd框,下载完成后在原窗口选择Continue,完成模型安装(如下图)

然后打开openclaw网页端即可看到我们下载的模型

然后即可使用本地大模型完成任务

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)