普通人Windows 部署 OpenClaw 12小时全程实录

上篇讲了为什么,这篇讲怎么做——以及哪里会让你崩溃

为什么折腾这个

这一周,我在公司电脑上重度体验了 WorkBuddy。作为腾讯员工,公司送了体验积分,我用它整理行业简报、处理测试数据,甚至写了个小程序原型——基本没写过一行代码,但完成了很多复杂任务。这让我确信:AI 助手的价值不在编程,而在于真正帮你做事。

回到家,问题来了:公司积分不能带回家用,赠送额度根本不够重度使用。市面上的商业产品看了一圈——MaxClaw、KimiClaw、ArkClaw 各有侧重,都是订阅制。腾讯还有个 QClaw 在内测,据说能直连微信,我申请了体验码,等拿到再单独写。综合下来,对我这种家里有 RTX 4060、重视数据隐私、愿意折腾的人,开源的 OpenClaw 更合适:软件免费,月成本基本只有电费,数据在自己手里。

于是,周六我花了整整一天来部署它。

配置: Windows 11 家庭中文版 / Intel i9-14900HX / 32GB 内存 / RTX 4060 Laptop (8GB)

⚠️ 本文基于 OpenClaw 2026.3.13 版本,Windows 11 24H2 系统。

一、周中失败的那次尝试

周中下班到家已经 9 点,想着装个 Ubuntu 应该很快。结果 WSL2 装不上,折腾 1 小时还是失败,只能放弃睡觉。

这次失败让我意识到这件事需要整块时间,不是睡前能搞定的。

二、路线选择:原生 Windows 走不通,只能上 WSL2

OpenClaw 官方明确说 Windows 用户强烈推荐使用 WSL2,原生 Windows 安装更复杂且部分功能不稳定。我也测试了原生 PowerShell 安装,遇到了 3 个无法解决的依赖问题,最终放弃。

结论:Windows 上部署 OpenClaw,走 WSL2 + Ubuntu 是一条靠谱的路线。

三、安装过程

3.1 安装 WSL2 和 Ubuntu

在管理员权限的 PowerShell 中执行:

wsl --install -d Ubuntu-24.04

wsl --update

几点注意:

-

如果提示需要启用虚拟化,进入 BIOS 开启 Intel VT-x 或 AMD-V

-

如果提示重启,必须重启才能完成安装

重启后从开始菜单打开 "Ubuntu 24.04 LTS",按提示创建用户名和密码。这个密码很重要,后续会频繁使用。

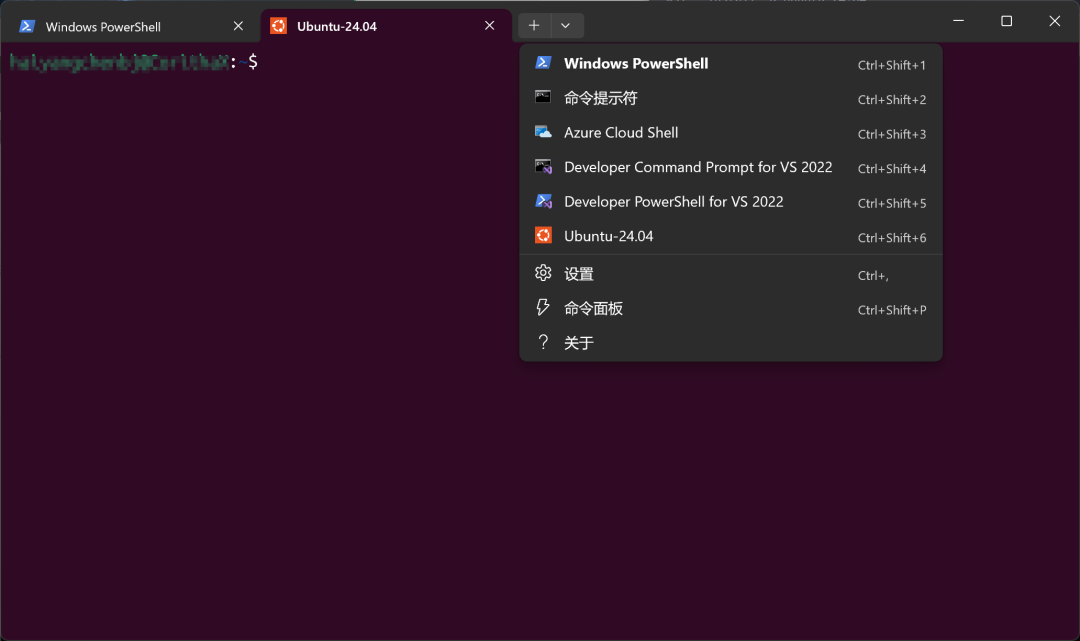

备选方案是从终端-菜单里打开Ubuntu,比直接开Ubuntu更稳定。

3.2 启用 systemd(最关键的一步)

这是整个安装里最容易被忽略、也最致命的一步。OpenClaw 的 Gateway 服务依赖 systemd 来启动和后台运行,没有它什么都跑不起来。

打开 Ubuntu 终端,执行:

sudo tee /etc/wsl.conf >/dev/null <<'EOF'

[boot]

systemd=true

EOF

然后在 PowerShell 里重启 WSL:

wsl --shutdown

重新打开 Ubuntu,验证是否生效:

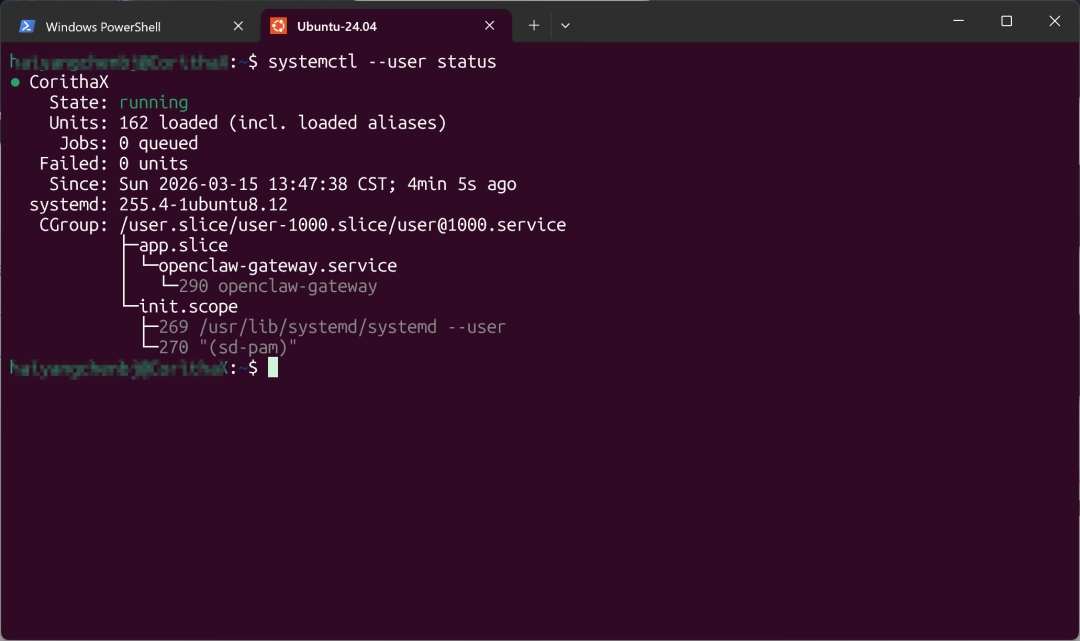

systemctl --user status

看到 Active: active (running) 才算成功。如果报错 System has not been booted with systemd,说明 /etc/wsl.conf 没写对,回头检查。

3.3 安装 OpenClaw

在 Ubuntu 终端执行:

curl -fsSL https://openclaw.ai/install.sh | bash

安装完成后运行初始化向导:

openclaw onboard --install-daemon

第一次运行建议: 不要急着配置 Telegram、Discord 等渠道。先确保 Dashboard 能正常打开,先测试本地模型能跑通,再一步步扩展。

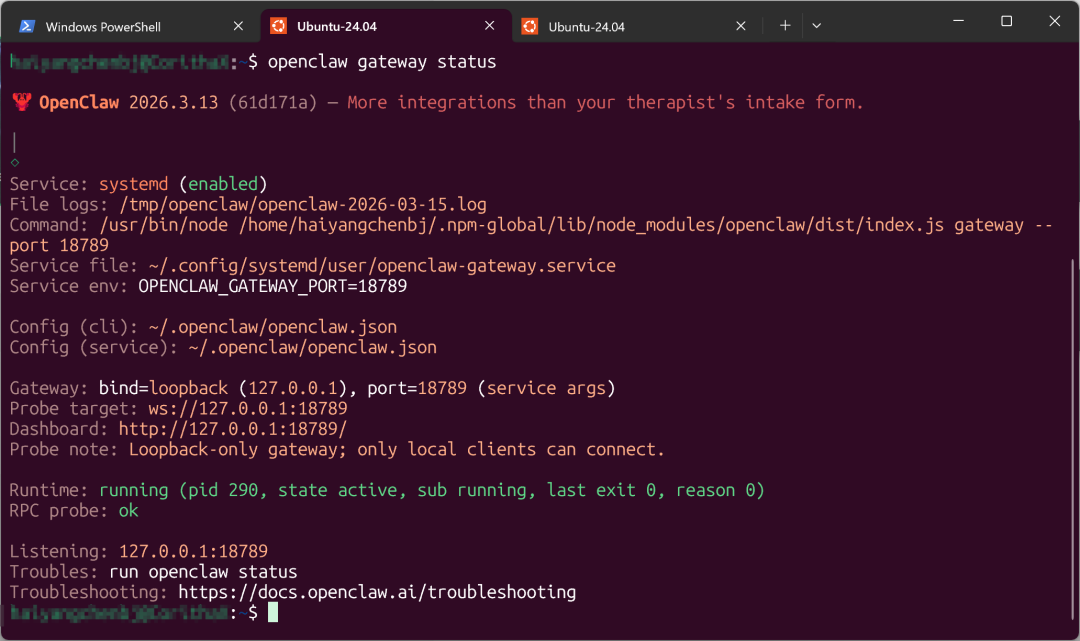

3.4 检查 Gateway 状态

openclaw gateway status

如果看到:

Gateway start blocked: set gateway.mode=local (current: unset)

执行修复:

openclaw config set gateway.mode local

systemctl --user restart openclaw-gateway

成功的输出应该是:

Runtime: running (pid 1234, state active, sub running)

RPC probe: ok

四、Ollama 连接:卡了我最久的一步

这是整个过程最复杂的部分。OpenClaw 需要连接一个 LLM 才能工作,我在这里踩了最大的坑。

4.1 我的失败方案:在 Ubuntu 里安装 Ollama

一开始我想在 Ubuntu 内部安装 Ollama,然后直接 127.0.0.1 连接,逻辑上最简单。

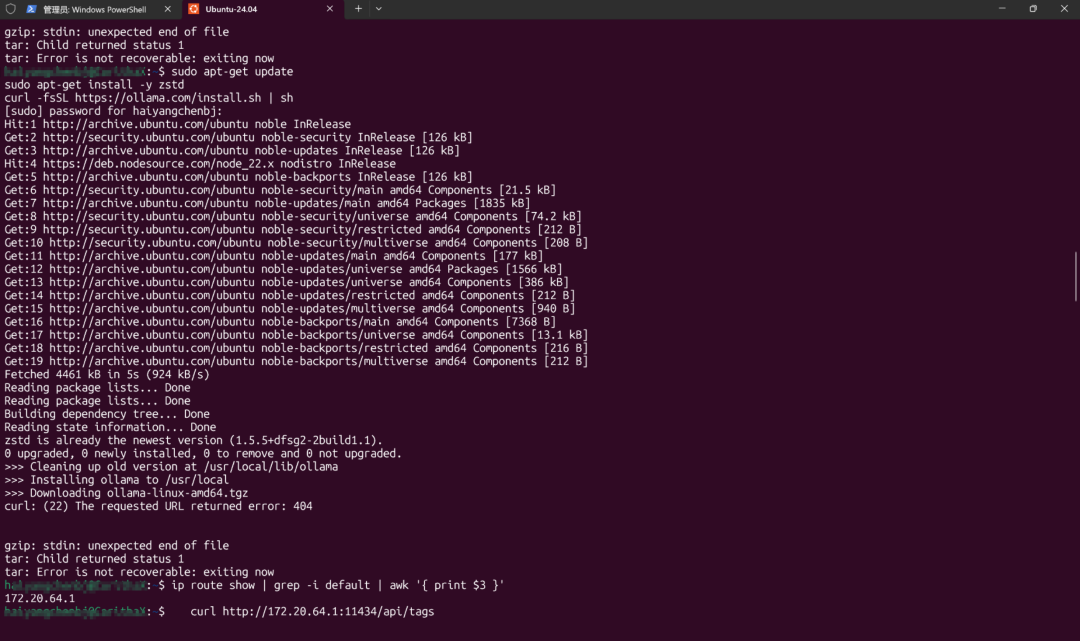

curl -fsSL https://ollama.com/install.sh | sh

ollama pull qwen3:4b

结果 ollama pull 卡在 0%,我等了超过 2 小时,试了 3 次,全部失败。国内访问 Ollama 官方库极慢,这条路在没有稳定代理的情况下基本走不通。

4.2 正确方案:复用 Windows 上已有的 Ollama

我 Windows 里本来就装了 Ollama,模型也下好了。问题只是 WSL2 和 Windows 之间有网络隔离,需要让 Ubuntu 能访问到 Windows 的 Ollama 服务。

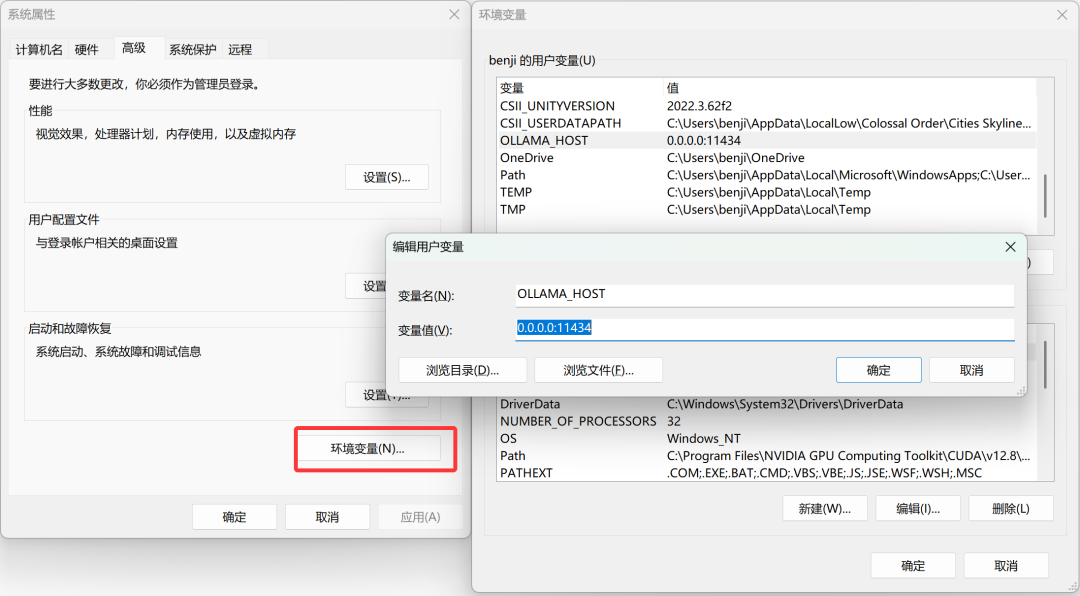

步骤 1:让 Windows Ollama 监听所有地址

-

退出 Ollama(系统托盘右键退出)

-

打开"编辑账户环境变量",新建:

-

变量名:

OLLAMA_HOST -

变量值:

0.0.0.0:11434

-

-

重新启动 Ollama

步骤 2:在 Ubuntu 里找到 Windows 主机 IP

ip route show | grep -i default | awk '{ print $3 }'

输出类似 172.20.64.1,这就是 Windows 在 WSL 网络里的地址。

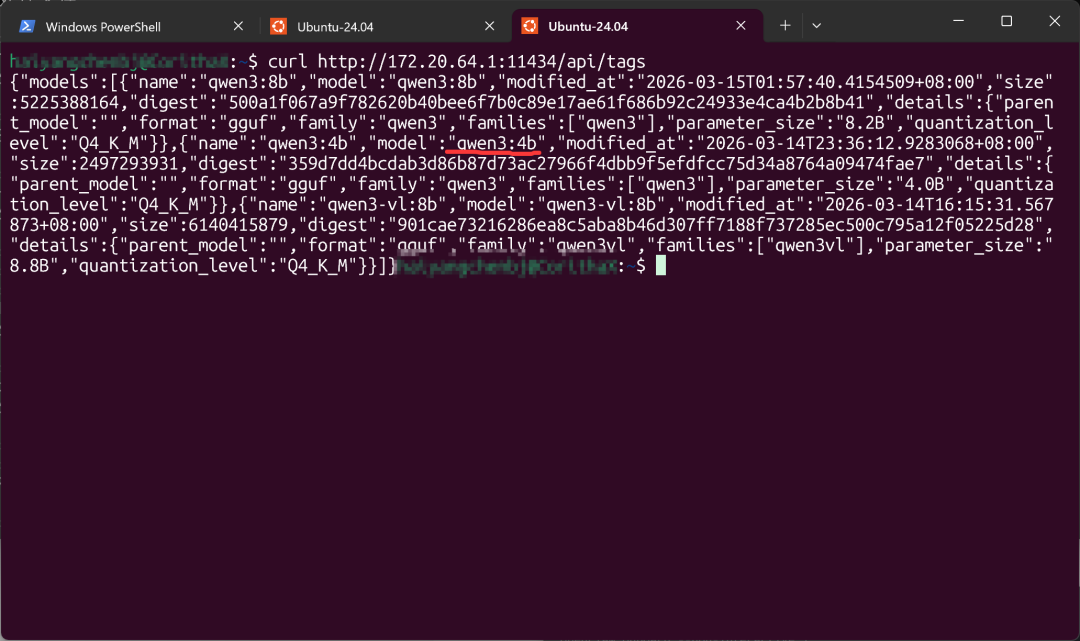

步骤 3:测试连通性

curl http://172.20.64.1:11434/api/tags

看到 JSON 格式的模型列表,说明连通了。

步骤 4:配置 OpenClaw 使用这个 Ollama

openclaw onboard --non-interactive \

--auth-choice ollama \

--custom-base-url "http://172.20.64.1:11434" \

--custom-model-id "qwen3:4b" \

--accept-risk

五、模型没选对,卡死了好几次

5.1 显存决定一切

|

显存 |

推荐模型 |

模型大小 |

|---|---|---|

|

4-6GB |

qwen3:4b |

~2.5GB |

|

8GB |

qwen3:8b |

~4.7GB |

|

12GB+ |

qwen2.5:14b |

~9GB |

|

24GB+ |

qwen2.5:32b |

~20GB |

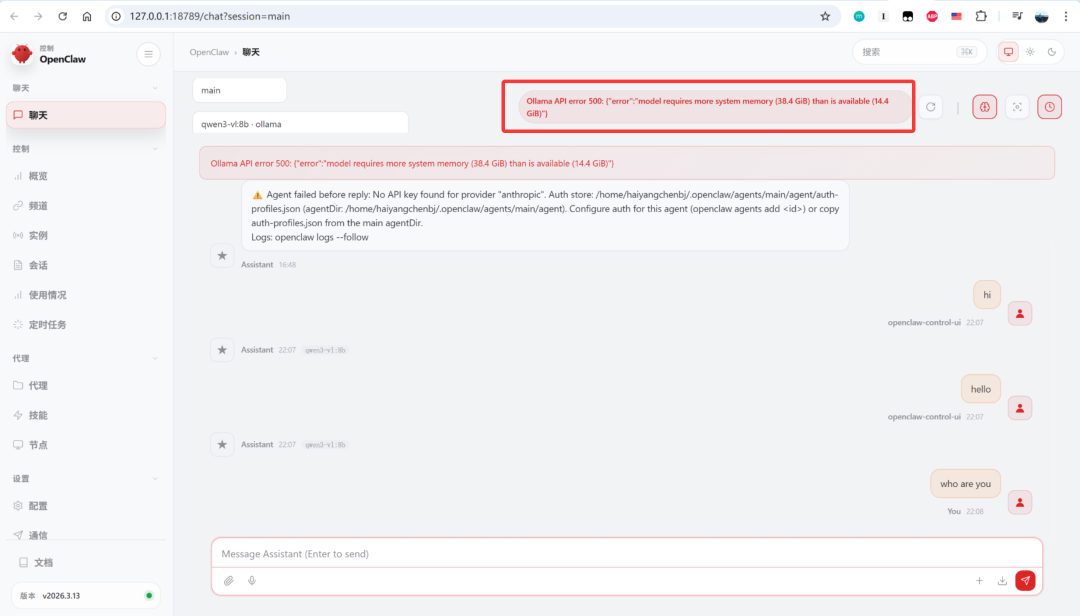

5.2 我踩的坑:选了视觉模型直接卡死

我一开始想用 qwen3-vl:8b,觉得视觉模型更强。结果:

model requires more system memory (38.4 GiB) than is available (14.4 GiB)

模型卡死,Ubuntu 终端卡死,只能强制终止,几小时白费。

解决方法:

ollama rm qwen3-vl:8b

ollama pull qwen3:4b

openclaw config set agents.defaults.model.primary "ollama/qwen3:4b"

systemctl --user restart openclaw-gateway

血泪教训:8GB 显存只跑 4B 模型。先跑通,再优化,别贪心。

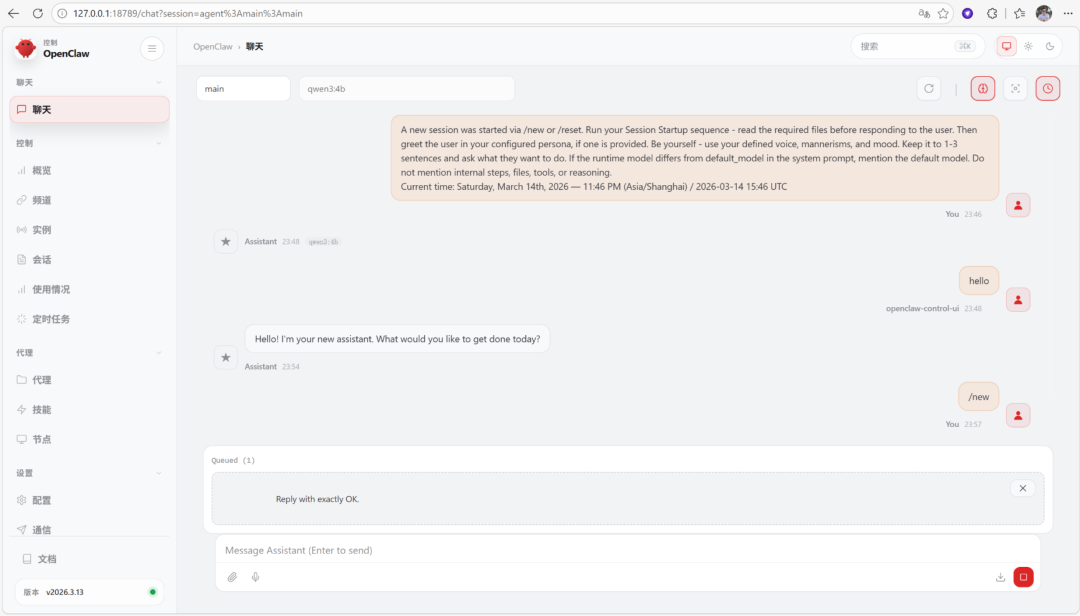

5.3 验证链路跑通

openclaw models status

输出 Default : ollama/qwen3:4b 说明配置生效。

打开浏览器访问 http://localhost:18789,发条消息,看到正常回复就说明整个链路通了。

六、跑通之后,架构长这样

装好之后的整体结构是这样的:

浏览器 (localhost:18789)

↓ WebSocket

WSL2 Ubuntu — OpenClaw Gateway (systemd 用户服务)

↓ HTTP API

Windows — Ollama 服务 (OLLAMA_HOST=0.0.0.0:11434)

↓

本地模型 qwen3:4b

核心数据在本地跑,不上云。但要注意:一旦接入邮件、日历、Telegram 等第三方服务,相关数据就按那个服务自己的规则走了,隐私边界需要自己评估。

在我这套配置下(RTX 4060 + qwen3:4b),响应时间约 2-5 秒。

七、装好之后真的用起来了

接入 Notion 之后,我让它帮我重整了运动数据库——识别重复项、重新排序、补充字段,5 分钟做完了我以前需要 1 小时手动整理的工作。

今天跑了半马,把 Garmin 数据导进去,自动生成训练总结并写入 Notion 复盘。以前手动做的事,现在全自动了。

还在探索的场景:每日新闻简报、邮件分类、日程提醒。

折腾一整天真的很累,但看到它真的在帮我做事,成就感是真实的。

八、最后说一句实话

整个安装过程涉及 WSL2、systemd、PowerShell、环境变量、网络配置、日志排查……这不是消费级产品能有的体验。

OpenClaw 目前的状态是:技术上可用,但离"开箱即用"还差很远。 它更适合有 Linux 基础、不怕折腾、愿意花一整天来搞定一件事的人。

如果你只是想用 AI 助手提高效率,商业产品现在的体验比这顺滑得多,没必要走这条路。

等哪天 OpenClaw 或者类似的开源工具真正做到傻瓜式安装,那才是值得向所有人推荐的时候。在那之前,这篇文章只写给愿意折腾的人。

✍️ 科里笔记 Coralyx Notes,

Written by 科里(Coralyx),发表于「边界层」

如有相关问题欢迎交流。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)