多模态Agent持续学习框架开发指南(非常详细),经验+技能驱动范式从入门到精通,收藏这一篇就够了!

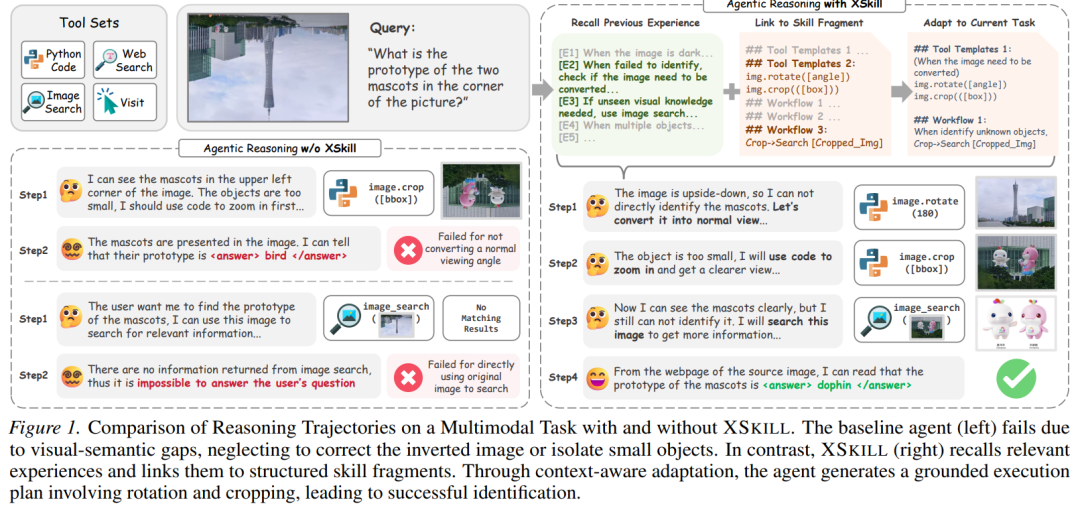

介绍一篇关于多模态智能体(multimodal agents)如何“越做越聪明”的论文:XSKILL。这篇工作关注一个现实问题:现在的多模态大模型已经会看图、会写代码、会上网搜索,也能调用各种工具解决复杂任务,但它们在开放式任务里仍然经常出现两类瓶颈:

- 工具用得不高效:简单问题可能反复试很多步;复杂问题又可能探索不够、很快卡住。

- 工具编排不够灵活:遇到新场景、新工具,推理路径往往僵硬,难以把工具组合成可迁移的解决流程。

论文提出的核心目标是:不更新模型参数(training-free),让智能体能从过去的交互轨迹中持续积累“可复用知识”,并在新任务里调用这些知识,从而越用越强。

一、核心思想:把“经验”和“技能”拆开存、联合用

作者观察到,人类的进步往往来自两种不同层次的复用知识:

- 经验(Experience):更像“战术小贴士”,通常是条件 → 动作的短建议,比如“当图像很暗时先增强对比度”“识别失败先检查是否需要旋转/翻转”等。经验的特点是短、具体、贴近当下决策,尤其影响工具选择、错误恢复、局部策略调整。

- 技能(Skill):更像“标准作业流程(SOP)”,是一套结构化的工作流和工具模板,指导你如何分解任务、按步骤推进、如何写通用代码模板。技能的特点是结构化、可迁移、面向任务流程,能提升整体效率与稳定性。

XSKILL的关键就是:把经验和技能做成“双流知识库”,并且在多模态任务里非常强调一点: 这些知识要和“视觉观察”绑定(visually grounded),否则检索时容易只匹配到文字表面相似、却与当前图像状态不相关的内容,导致“检索到了也用不上”。

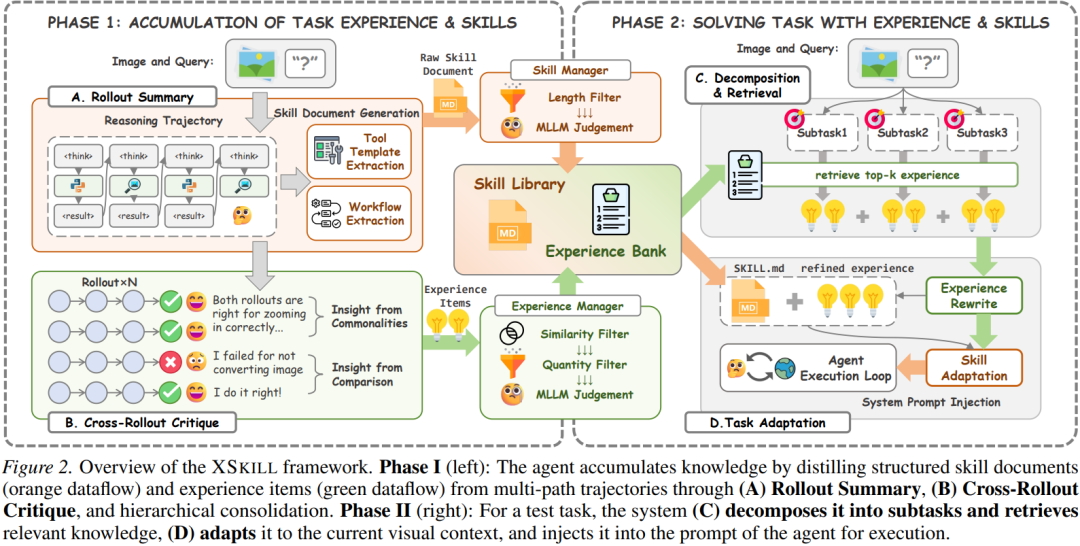

二、系统总览:一个“积累—检索—适配—再积累”的闭环

XSKILL把整个流程分成两个阶段:

- 阶段I:知识积累(Accumulation)

通过对同一训练任务做多次不同路径的rollout,提炼出经验与技能,并持续去重、合并、精炼,形成可扩展的知识库。 - 阶段II:带知识解题(Inference / Solving)

面对新任务,先分解子任务,再检索经验/技能,并根据当前图像语境做“适配改写”,最后把结果注入提示词,指导智能体执行工具推理;执行过程的“使用记录”还能回流到阶段I,形成持续学习闭环。

三、知识形式化:Skill 与 Experience 的结构长什么样

为了让知识可管理、可审计、可迁移,XSKILL把两类知识存成不同格式:

- Skill(技能):以Markdown文档形式保存,包含元信息(名称、描述、版本)、工作流步骤、以及可复用工具模板(尤其是代码模板、搜索模板)。技能强调“流程化、可复用”。

- Experience(经验):以“条件—动作”短条目保存,并配一个语义向量用于检索;每条经验长度严格受限(例如最多几十个词),确保短、准、可执行。

这种拆分很重要:技能负责把大方向和可复用流程立住,经验负责在具体执行点做“微调决策”。两者互补。

四、阶段I:知识如何从轨迹里“炼”出来?

阶段I的输入是:训练任务集合 + 每个任务多次rollout生成的多条轨迹。XSKILL的积累过程可以概括为三步:

1)Rollout Summary:带视觉证据的轨迹总结 + 技能片段抽取

系统不会只读文字日志,而是把图像观察、工具调用、工具输出、当前上下文交织起来做总结,强调“这一步为什么做”“图像里看到了什么证据导致这个决定”。

同时从成功轨迹中抽象出技能片段:

- Workflow extraction:把可复用步骤序列抽出来;

- Tool template extraction:把有效的代码/工具调用方式抽成模板,并用占位符替换具体实体,增强跨任务泛化。

2)Cross-Rollout Critique:跨轨迹对比,提炼“因果性经验”

同一个任务的多条轨迹里,有的成功、有的失败。XSKILL用“对比批判”来问:

- 成功的关键决策是什么?

- 失败是在哪一步偏离了?为什么偏离?

- 有没有遗漏了某条经验?某条经验是否需要改写得更一般、更可执行?

输出不是一大段总结,而是对经验库的结构化操作:新增(add)或修改(modify)经验条目。

3)Knowledge Consolidation:分层合并与精炼,保证规模可控

知识库会越积越大,所以必须管理:

- 经验合并:相似度高的经验会被合并成一条更完整、但仍短小的经验,减少冗余;

- 经验上限与清理:超过容量就删除低价值/重复条目;

- 技能精炼:当技能文档过长就触发再编辑,删掉过具体、难迁移的细节,把案例化表达改成可复用模板。

五、阶段II:新任务来了,怎么“检索—适配—注入”?

阶段II强调三件事:先分解、再检索、再适配,避免“一次检索押宝”。

1)任务分解检索:把一个复杂任务拆成2~3个“方法子需求”

直接拿原问题去检索,容易被表述细节干扰。XSKILL会先把任务分解成若干子任务(例如:图像太暗、对象太小、可能需要旋转、需要网页验证、需要数值计算等),然后对每个子任务独立检索top-k经验,最后汇总。

这样能保证覆盖面:不同“技术需求维度”的经验都能被召回。

2)经验改写(Experience Rewrite):把通用经验改成“贴合当前图像状态”的可执行建议

检索到的经验是通用的,可能与当前任务细节不完全匹配。XSKILL用一个“经验改写器”在不改变经验结构的前提下:

- 把触发条件改写得更贴近当前图像;

- 把动作建议具体化到可执行层面;

- 删除明显不适用的经验。

3)技能适配(Skill Adaptation):把大而全的技能裁剪成“本任务用得上的精简版”

全局技能文档可能很长。适配器会:

- 删掉无关流程,只保留当前任务需要的部分;

- 把改写后的经验“编织”进流程步骤,让技能更贴近当下;

- 保留可用的代码模板并做适度占位符调整。

最终,系统把“适配后的技能 + 改写后的经验”以非强制方式注入智能体提示词:它们是参考,而不是硬规则,从而在保留灵活性的同时提升成功率与效率。

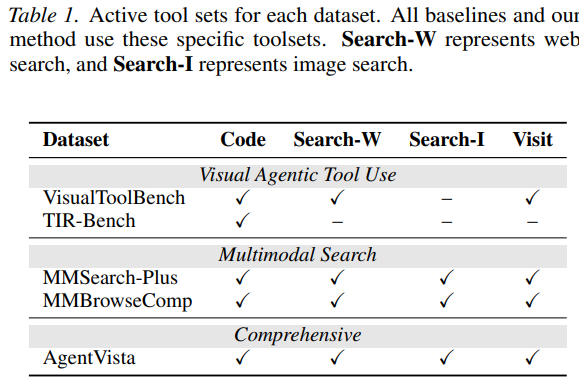

六、实验设置:用哪些任务、哪些工具、怎么评估?

XSKILL在多个领域评测,覆盖三类场景:

- 视觉工具推理(需要用代码处理图像、量测、裁剪等);

- 多模态搜索/浏览(需要网页搜索、以图搜图、访问网页);

- 综合超难场景(同时要求复杂推理与工具编排)。

表1列出每个数据集可用的工具集合,如是否允许代码、网页搜索、以图搜图、访问网页。

评估指标用两种成功率:

- Average@4:同一题做4次独立rollout的平均成功率,反映稳定性;

- Pass@4:4次里至少成功一次的比例,反映上限能力。

对比方法包括:

- 只有工具(tool-only)

- 多种“从经验学习”的基线方法(例如工作流记忆、动态cheatsheet、结构化知识库等)

以及不同骨干模型设置,还测试了跨模型迁移:由一个模型积累知识,另一个模型直接使用。

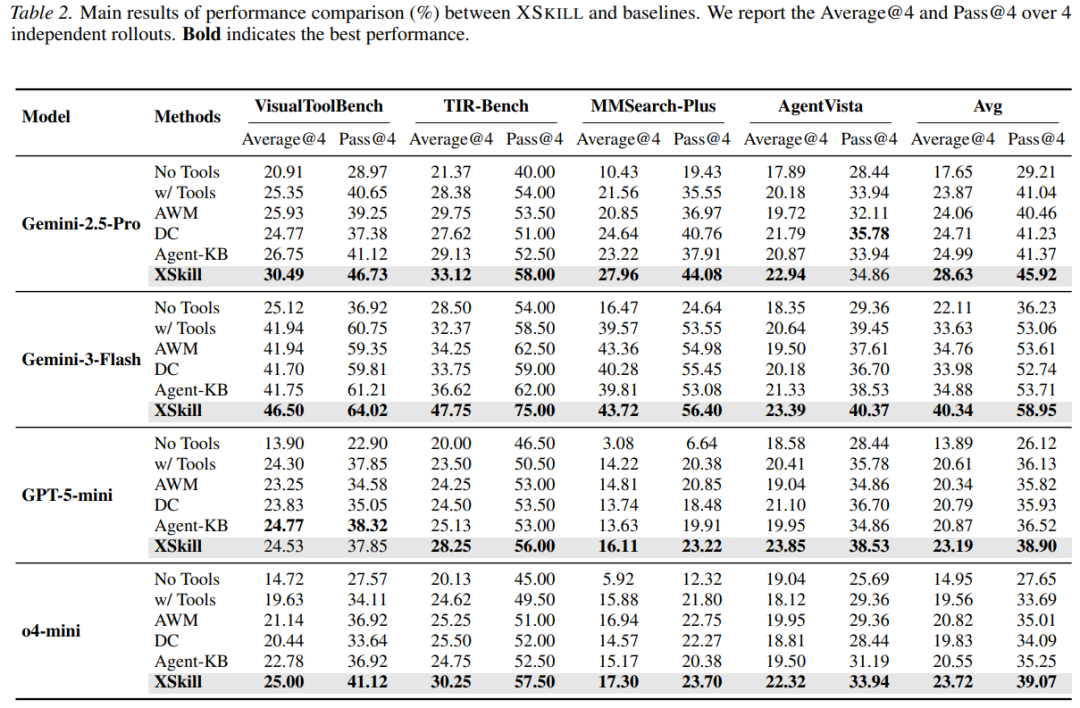

七、主结果:为什么说双流知识库确实让智能体更强?

论文的核心对比结果集中在一张总表里:XSKILL在多个基准与多个骨干模型上,都能稳定超过“仅有工具”以及多种学习型基线,尤其在需要复杂视觉推理 + 多步工具编排的任务上优势更明显。

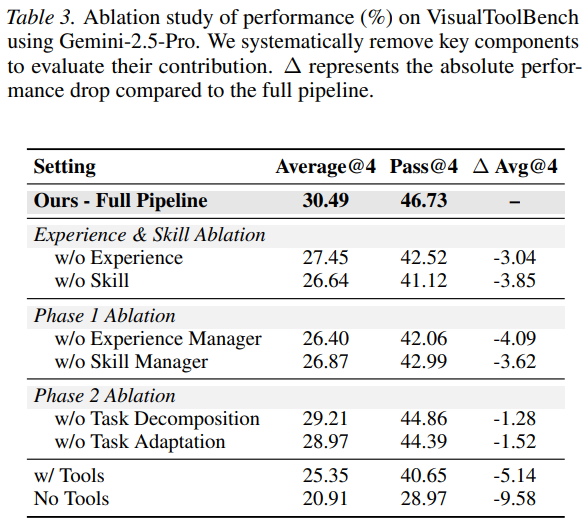

同时,作者做了系统性消融:去掉经验或去掉技能都会明显掉点;并且阶段I的知识质量管理(经验管理器、技能管理器)对最终表现影响最大,这说明“能不能把知识炼好、整理好”比“检索姿势花不花”更关键。

八、机制分析:经验和技能到底分别改变了什么?

作者不仅报分数,还分析了行为变化,给出了一个非常清晰的解释:

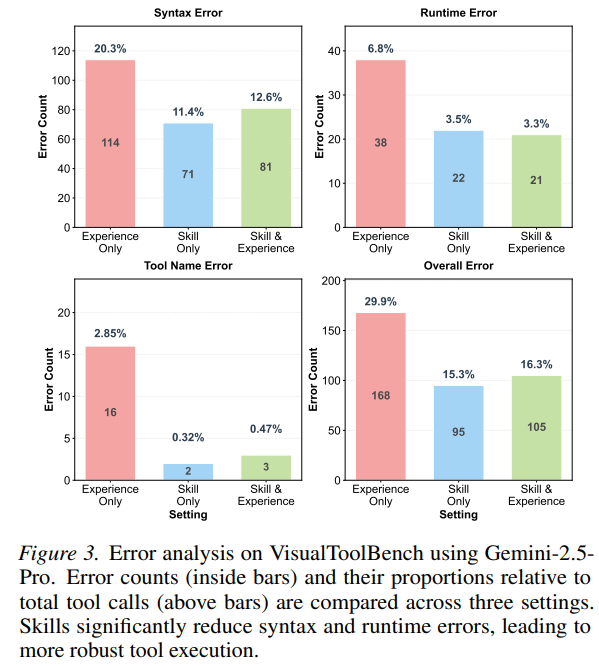

1)技能让工具执行更稳、错误更少

当只有经验时,智能体可能知道“该用什么工具”,但仍容易在代码语法、运行错误、工具名拼错等低级问题上翻车;技能提供模板与流程后,这类错误显著下降,工具调用更稳。

图3统计了不同设置下的语法错误、运行错误、工具名错误与总体错误,直观体现“技能提升执行鲁棒性”。

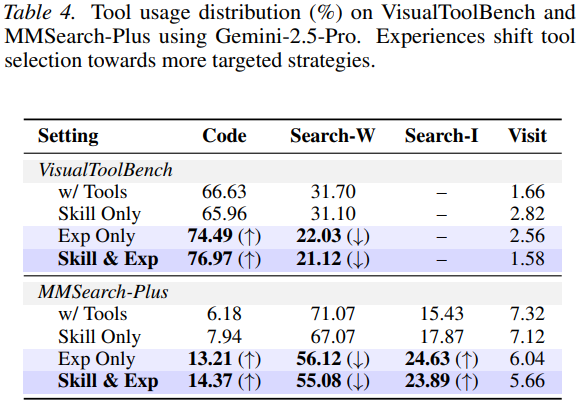

2)经验让工具选择更灵活、更贴合任务

经验会改变“用哪些工具、用多少次”。在视觉推理任务里经验更倾向引导用代码做图像处理;在多模态搜索任务里经验会提升以图搜图等更针对性的工具使用,而减少泛泛的文字搜索。

九、进一步分析:rollout数量与跨任务迁移

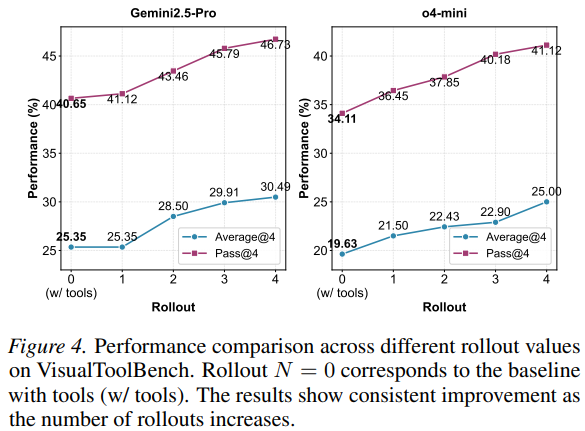

1)rollout越多,积累越好,效果越强

多条轨迹提供了“成功/失败对照”和“多路径共同点”,有利于批判机制提炼更通用的经验与技能,因此随着rollout数增加,Average@4和Pass@4都有提升。

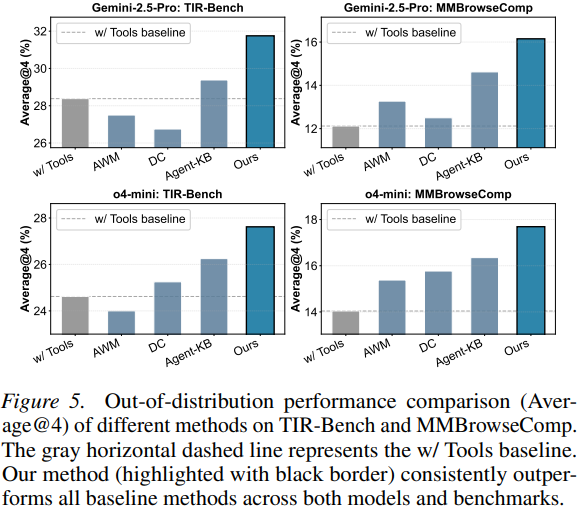

2)跨任务零样本迁移更强

作者做了“把A数据集学到的知识拿去解B数据集”的测试,XSKILL在这种out-of-distribution设置下仍能稳定超过基线,说明它学到的不是死记硬背,而是更可迁移的“方法性知识”。

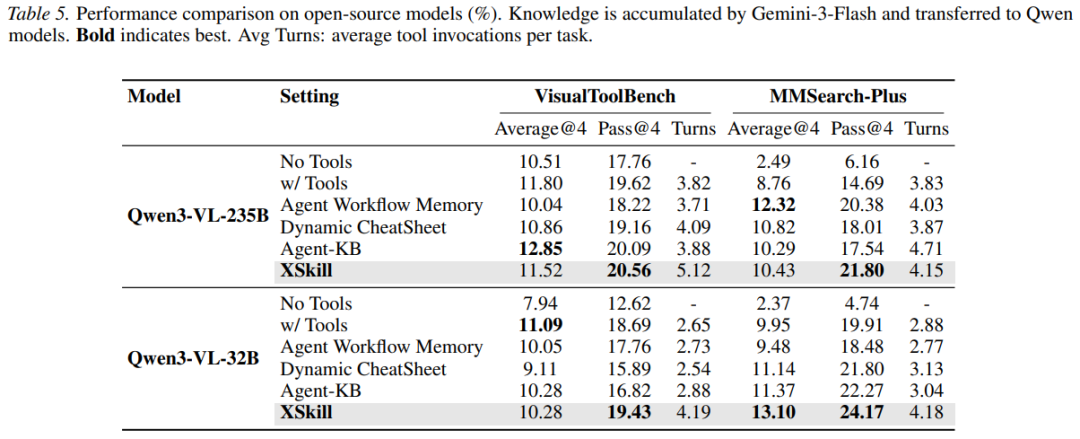

十、补充实验:知识迁移到开源模型会怎样?

论文还测试了把某个模型积累的知识迁移给开源视觉语言模型使用。整体现象是:

- 在部分任务上,XSKILL会鼓励更多探索与工具调用,使Pass@4上升;

- 但如果底座模型能力较弱,外部知识可能与其原生工具习惯“打架”,导致Average@4不一定同步提升。

这说明:跨模型迁移是可行的,但依赖底座模型对工具推理的基本能力与对提示注入的适配能力。

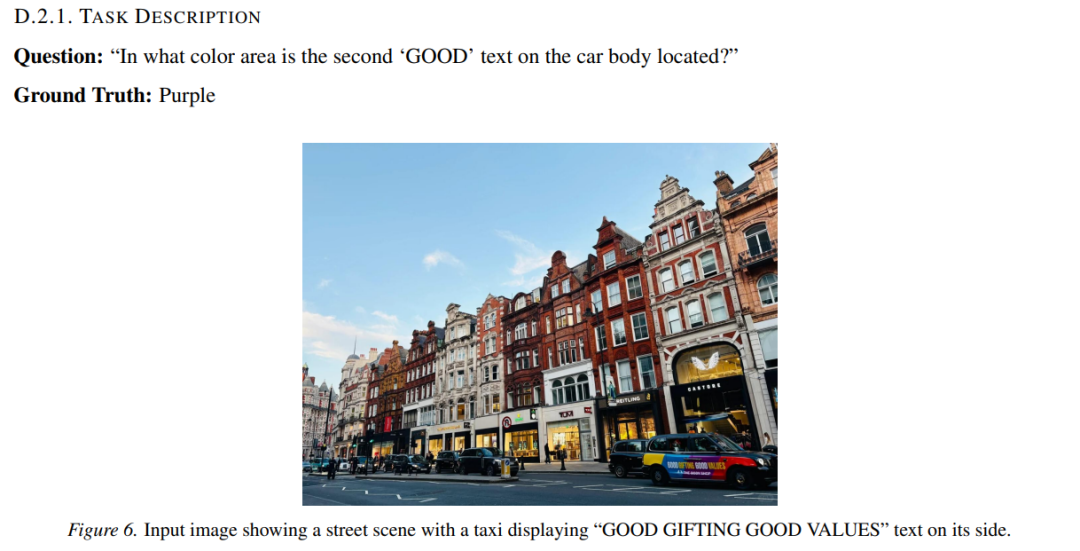

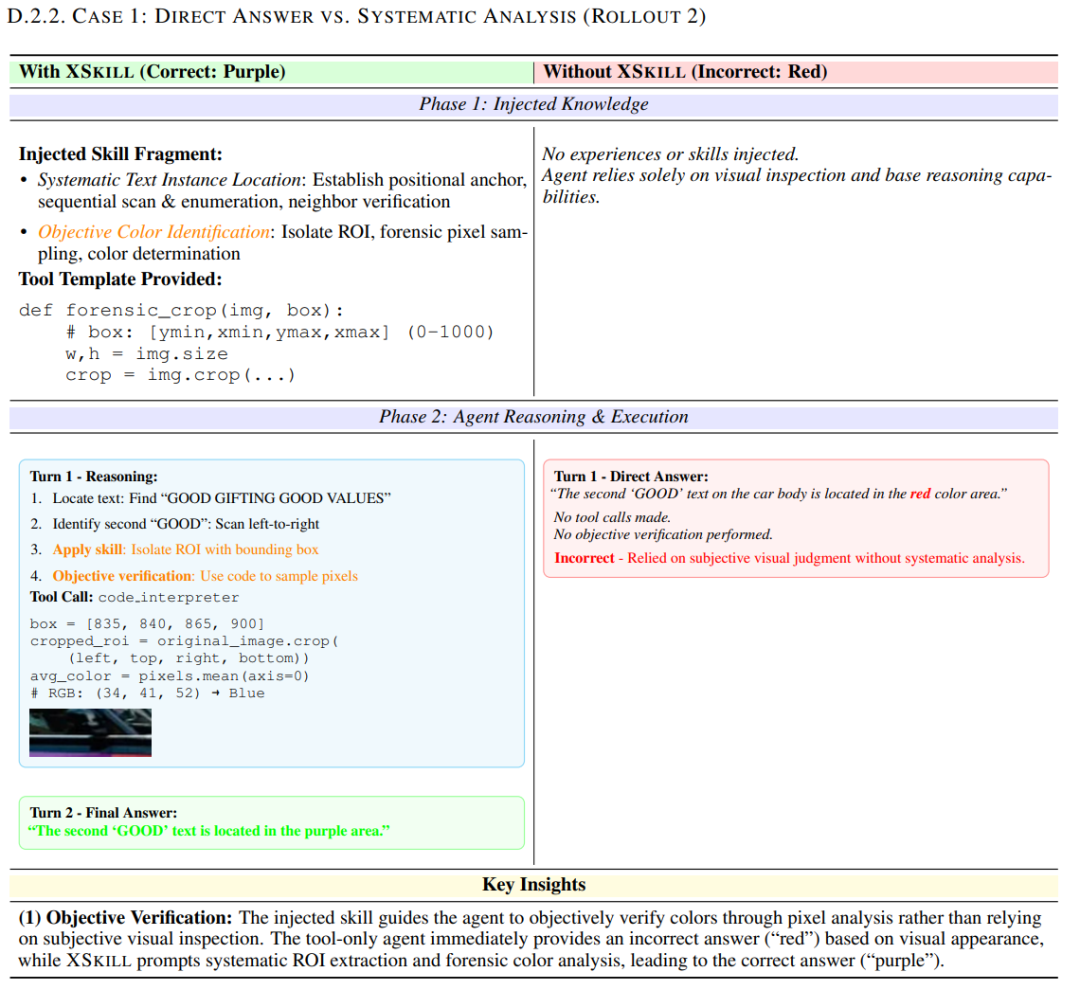

十一、案例研究:为什么“视觉落地 + 系统化流程”能避免低级失误?

论文最后给了一个非常直观的案例:问题是让智能体判断车身上第二个“GOOD”文本所在的颜色区域。没有知识注入的工具型智能体会凭肉眼直觉反复答错;而XSKILL注入了“系统定位文本实例 + 客观取样判断颜色”的技能片段后,智能体会先定位,再裁剪ROI,再做像素统计,甚至在RGB不确定时改用HSV色彩空间做更稳健判断,从而得到正确答案。

十二、总结与意义

最后总结一下XSKILL的贡献可以归纳为三点:

- 提出双流知识库:把“技能(流程化)”与“经验(条件-动作)”分开建模,分别解决“效率”和“灵活编排”的痛点。

- 强调多模态落地:从提炼到检索再到适配,都把关键决策与视觉观察绑定,缓解视觉语义鸿沟。

- 训练外持续进化:不改参数,通过“积累—检索—适配—再积累”闭环持续增强,并且具备一定跨任务、跨模型迁移能力。

从更大的视角看,这篇论文提供了一条很实用的路线:当我们不想频繁微调模型、又希望智能体越用越好时,把可复用知识外显成可编辑、可审计的文档与条目,可能是比“黑盒参数更新”更可控、更工程化的选择。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献167条内容

已为社区贡献167条内容

所有评论(0)