OpenAI API深度解析:从回形针危机到Agent革命,开发者必须掌握的AI武器

前两天我在一场技术分享会上刚讲完AI Agent的未来趋势,台下的手就刷刷刷举成了一片森林(见下图)。有人问Agent怎么落地实体经济,有人问国内大模型何时能追上GPT-4,但最让我印象深刻的是最后一个问题:

“阿龙,OpenAI在2023年11月推出了Assistants功能,这对LangChain、LlamaIndex这些框架是冲击还是赋能?”

这个问题问到了点子上。今天,我就借着这个机会,带大家深度扒一扒OpenAI API的前世今生、技术细节,以及它如何正在重塑整个AI应用开发生态。不管你是传统业务系统的开发者,还是刚入门的AI爱好者,这篇文章都能帮你建立起对OpenAI API和Agent开发的系统认知。

一、OpenAI:从理想主义实验室到800亿美金“无敌战舰”

要理解OpenAI API,首先要理解OpenAI这家公司。它的故事本身就足够拍一部好莱坞大片。

1.1 汉堡店里的野心:2015年的那个夏天

2015年,硅谷的夏天。萨姆·奥尔特曼(Sam Altman)找到Google Brain的科学家伊利亚·苏茨克维(Ilya Sutskever),两人在Google总部附近的一家汉堡店共进晚餐。

晚餐后,奥尔特曼坐回车中,心里只有一个念头:我必须与这个人一起工作。

当时的奥尔特曼已经意识到一个巨大的危机——人工智能技术正在被Google、微软、Facebook等巨头垄断。他和埃隆·马斯克(Elon Musk)、格雷格·布罗克曼(Greg Brockman)等人坐在一起,忧心忡忡。

他们担心什么?担心技术集中化,担心AI的潜在失控风险,担心AGI(通用人工智能)最终落入少数巨头手中,沦为赚钱的工具。

于是,2015年底,OpenAI诞生了。六位联合创始人——奥尔特曼、马斯克、苏茨克维、布罗克曼、约翰·舒尔曼、沃依切赫·扎伦巴,加上雷德·霍夫曼、彼得·蒂尔等著名投资者承诺的10亿美元捐款,一个非营利性、开源、致力于安全普惠AI的组织正式启航。

1.2 回形针的警示:伊利亚的坚持与马斯克的离开

OpenAI的核心信念是什么?用一位前员工的话说:“为了确保安全,我们必须在这个领域取得成功。如果我们没有赢得竞赛,即便我们的技术再先进,也是徒劳。”

这句话听起来有点矛盾,但逻辑极深:如果你不领先,你就无法主导AI的安全发展。

首席科学家伊利亚·苏茨克维是这一信念的坚定执行者。他是“AI教父”杰弗里·辛顿的学生,对神经网络抱有极高的信仰。他说过一句很有深意的话:

“概念、模式、想法、事件在数据中以复杂的方式呈现,神经网络为了预测未来,需要以某种方式理解这些概念及其留下的痕迹。在整个过程中,这些概念变得更加生动。”

但理想需要算力支撑。2018年,马斯克离开了OpenAI,表面原因是与特斯拉的“潜在利益冲突”,深层原因是他认为OpenAI已经落后于Google。马斯克曾提议由自己接管公司,被董事会拒绝。

也是在2018年,OpenAI公布了公司章程,确立了开发“人类利益至上”的AGI的价值观。这份章程埋下了一个种子:即使后来引入商业化,也必须确保对AI发展方向的主导权。

1.3 回形针危机与微软的10亿美金

2019年,OpenAI陷入财务危机。高昂的研发成本让这个非营利组织喘不过气来。

这时候,OpenAI做了一个艰难的决定:引入一个盈利分支——OpenAI LP,但给投资者的回报设定了100倍的上限。这就像一个“犹抱琵琶半遮面”的妥协:既要钱,又不能被钱绑架。

微软抓住了机会,投入10亿美元,成为OpenAI的核心合作伙伴。但诡异的是,微软在OpenAI董事会中没有席位。 OpenAI的董事会由非营利阵营控制,6名董事都不持有公司股权。这种“股权与管理权严重不匹配”的结构,为后来的“奥尔特曼被解雇又复职”风波埋下了伏笔。

2022年秋天,旧金山街头出现了成千上万个形状像OpenAI标志的回形针。这是竞争对手Anthropic员工的玩笑,也暗指“回形针最大化器”思想实验——一个被设定“制造最多回形针”的AI,最终可能毁灭人类来达成目标。这个警示,时刻悬在OpenAI头上。

1.4 从GPT-3到Sora:技术民主化的践行者

尽管内部风云变幻,OpenAI的技术输出从未停止:

-

GPT系列:从GPT-3到GPT-4,自然语言理解和生成能力一次次刷新认知

-

DALL·E:文本生成图像的颠覆者

-

Sora:文本生成60秒连贯视频,把行业平均4秒的水平甩开一个时代

更重要的是,OpenAI没有把这些技术锁在象牙塔里,而是通过API向全世界开发者开放。这才是“技术民主化”的真正含义:让每个开发者都能站在巨人的肩膀上。

二、OpenAI API实战:从聊天到生图,手把手带你入门

说了这么多历史,咱们来点干货。OpenAI API到底怎么用?

2.1 环境准备:三步搞定

第一步:注册账号并获取API密钥

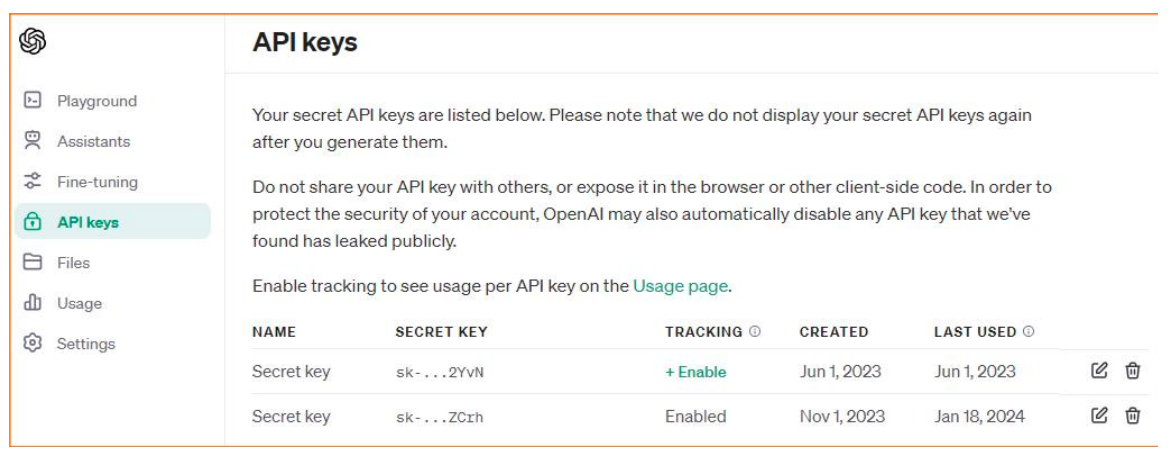

在OpenAI官网注册账号,进入API Keys页面,创建一个新的Secret Key(见下图)。注意:密钥只显示一次,务必保存好,不要暴露在浏览器或客户端代码中。

第二步:安装OpenAI Python库

bash

pip install openai

第三步:设置环境变量

为了安全,建议用环境变量存储API密钥:

python

import os os.environ["OPENAI_API_KEY"] = '你的OpenAI API密钥'

2.2 第一个聊天程序:让AI成为鲜花助手

来看一段完整代码:

python

from openai import OpenAI

# 创建client(客户端实例)

client = OpenAI()

# 调用chat.completions.create方法

response = client.chat.completions.create(

model="gpt-4-turbo-preview",

response_format={"type": "json_object"},

messages=[

{"role": "system", "content": "您是一个帮助用户了解鲜花信息的智能助手,并能够输出JSON格式的内容。"},

{"role": "user", "content": "生日送什么花最好?"},

{"role": "assistant", "content": "玫瑰花是生日礼物的热门选择。"},

{"role": "user", "content": "送货需要多长时间?"}

]

)

print(response.choices[0].message.content)

核心参数详解:

-

model:指定模型版本。表3.1列出了常见模型,如GPT-4 Turbo(128K上下文)、GPT-3.5 Turbo等。注意聊天任务只能选聊天模型。

-

messages:对话历史数组,包含三种角色:

-

system:系统指令,设定助手角色和行为 -

user:用户输入 -

assistant:助手回复(可用于提供上下文或示例)

-

-

response_format:指定输出格式。

{"type": "json_object"}启用JSON模式,确保输出是有效JSON,便于程序解析。

为什么叫client?

client是OpenAI类的一个实例,代表与OpenAI API交互的主体。在客户端-服务器模型中,它充当客户端,发起请求并接收响应。这个名字在API交互中约定俗成。

2.3 进阶:图片生成

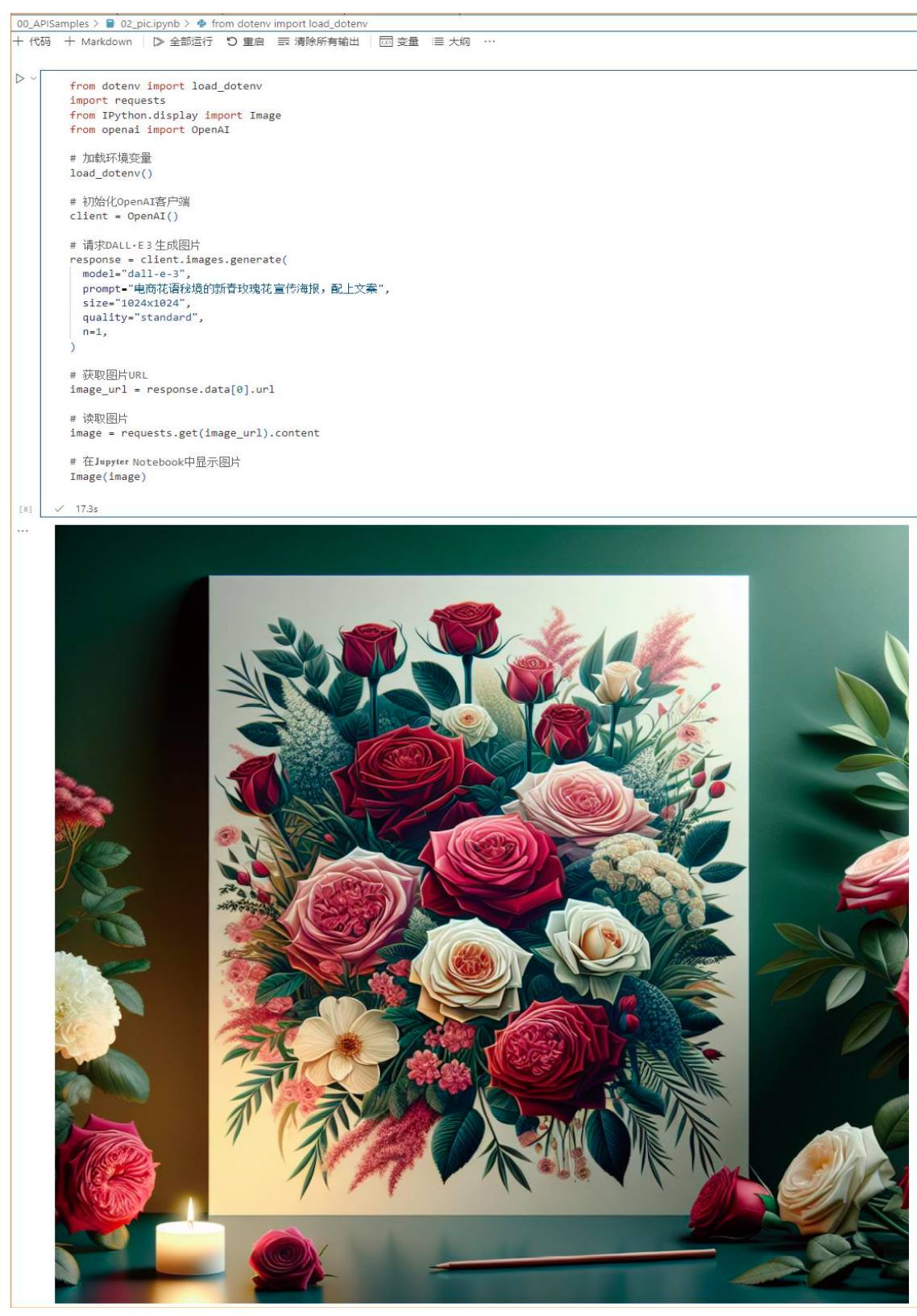

多模态能力是OpenAI的杀手锏。下面这段代码调用DALL·E 3生成海报:

python

from openai import OpenAI

import requests

from IPython.display import Image

client = OpenAI()

response = client.images.generate(

model="dall-e-3",

prompt="电商花语秘境的新春玫瑰花宣传海报,配上文案",

size="1024x1024",

quality="standard",

n=1,

)

image_url = response.data[0].url

image = requests.get(image_url).content

Image(image)

运行后,Jupyter Notebook中就会显示一张漂亮的海报(见下图)。整个过程不到10行代码,这就是API的魅力。

2.4 开发者必须懂的实践要点

1. temperature参数:控制创造性

-

低值(如0.2):输出更确定、一致,适合客服、知识问答

-

高值(如1.0):输出更多样、有创意,适合文案生成、头脑风暴

2. 数据隐私

OpenAI承诺:自2023年3月1日起,通过API传输的数据保留30天,但不再用于改进模型。建议在接收输出后添加审核层,避免违反使用政策。

3. 速率限制(Rate Limit)

遇到“rate-limited”错误怎么办?

-

了解你的API密钥对应的限制

-

合并请求,减少调用次数

-

根据返回的“retry-after”等待重试

-

考虑升级套餐

4. 计费与Token

Token是计价单位。1000个Token≈750个英文单词。不同模型价格不同(见表3.4):

-

GPT-4 Turbo:输入$0.01/1k Token,输出$0.03/1k Token

-

GPT-3.5 Turbo:输入$0.001/1k Token,输出$0.002/1k Token

日常聊天费用很低,但处理大规模文档(如《莎士比亚全集》约百万Token)成本显著。开发时要考虑Token消耗,避免不必要的调用。

三、OpenAI API与LangChain、LlamaIndex:竞争还是协作?

回到开头那个犀利的问题:OpenAI推出Assistants功能,对LangChain、LlamaIndex这样的框架是冲击吗?

我的回答是:你中有我,我中有你,既有竞争,亦有协作。

3.1 三者定位不同

-

OpenAI API:提供最底层的模型能力(文本生成、图像生成、语音转文字等)。它是发动机。

-

LangChain:一个编排框架,帮助开发者将LLM与其他工具(数据库、API、搜索引擎)链接起来,构建复杂流程。它是变速箱。

-

LlamaIndex:专注于数据索引和检索,让LLM能够连接私有数据(文档、数据库)。它是油箱和油管。

3.2 Assistants的推出意味着什么?

OpenAI Assistants是一个更高层次的封装,它内置了:

-

指令遵循

-

知识检索

-

代码解释器

-

函数调用

这让开发者可以用更少的代码实现Agent功能。

这对LangChain和LlamaIndex是冲击吗?

短期看,Assistants会吸引一部分想快速上手的开发者,减少他们对第三方框架的依赖。但长期看,反而是利好:

-

抽象层次不同:Assistants解决的是“如何快速构建一个助手”,而LangChain解决的是“如何将LLM与任何东西链接”。后者更灵活。

-

生态互补:LlamaIndex在数据索引方面的深度,是Assistants短期内无法替代的。你仍然可以用LlamaIndex处理数据,再通过OpenAI API或Assistants调用模型。

-

竞争促进创新:OpenAI的入场会倒逼LangChain、LlamaIndex向更高层次进化,比如更好的可观测性、更细粒度的控制。

3.3 Agent开发生态的未来图景

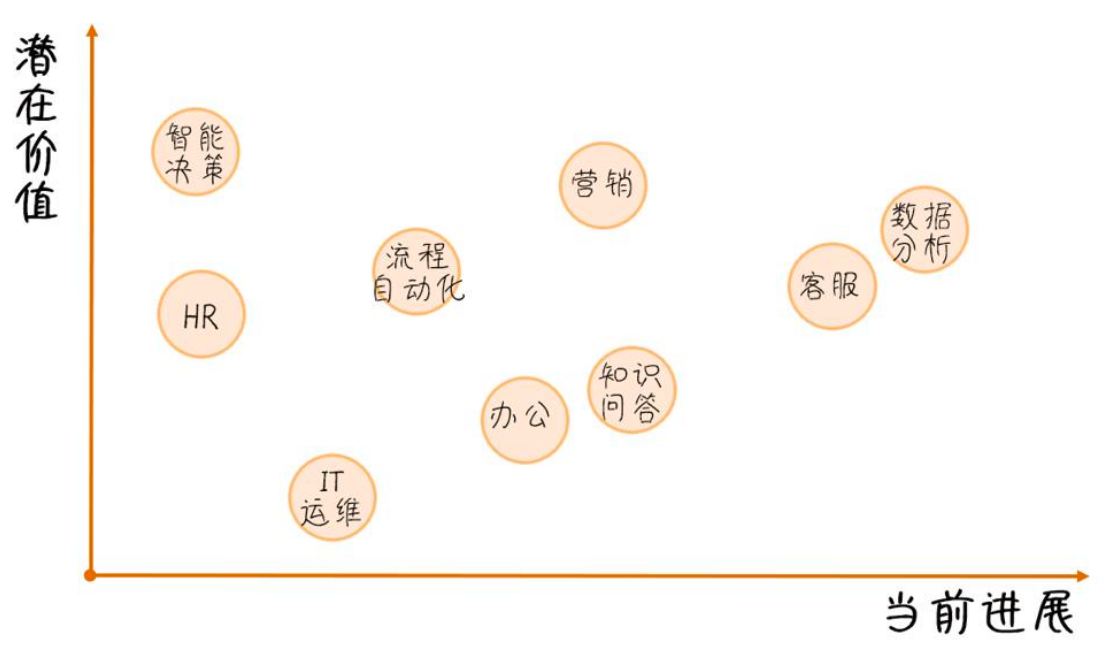

目前AI应用的成熟度参差不齐(见下图):

-

客服、知识问答:落地较快,价值明显

-

数据分析、营销:正在探索,潜力巨大

-

IT运维、智能决策:难度高,还在摸索

Agent开发位于“上下文要求高”和“对模型行动力要求高”的象限,是目前最具挑战也最有价值的领域。而OpenAI API、LangChain、LlamaIndex,都是我们攀登这座高峰的装备。

四、总结:开发者如何拥抱这个时代?

OpenAI的故事告诉我们几个道理:

-

技术民主化不是口号,是行动。OpenAI从非营利起步,经历商业转型,但始终通过API让开发者用上最先进的模型。作为开发者,我们要善用这些工具,而不是仰望它们。

-

Agent是下一波浪潮。从简单的聊天到复杂的决策、工具调用,Agent正在成为AI应用的“大脑”。而GPT-4、Claude 3这样的模型,是第一个勉强合格的“Agent大脑”。

-

工具链在进化,但底层逻辑不变。无论OpenAI API、LangChain还是LlamaIndex,它们都是让我们更高效地构建应用的“脚手架”。理解模型能力、提示工程、数据索引、工具调用这些底层逻辑,才能以不变应万变。

-

安全与伦理,是每个开发者的责任。回形针的警示不是杞人忧天。我们在调用API时,要考虑数据隐私、内容安全、模型偏见。OpenAI提供了审核指南和工具,但最终的责任在开发者身上。

最后,回到那个让阿龙“汗流浃背”的提问现场。其实我汗流浃背不是因为问题太难,而是因为看到这么多开发者对AI Agent充满热情,让我想起了2015年汉堡店里的奥尔特曼和苏茨克维。

技术的未来,从来不是由少数巨头决定的,而是由千千万万个像你我一样的开发者,用一行行代码、一个个应用堆叠出来的。

你的第一个OpenAI API调用,可能就是下一个改变世界的Agent的第一步。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)