Adaboost分类算法:手把手教你用MATLAB实现数据分类预测

Adaboost分类,基于集成模型的Adaboost的数据分类预测 回归也有, 程序已经调试好,无需更改代码替换数据集即可运行数据格式为excel 1、运行环境要求MATLAB版本为2018b及其以上,可实现二分类和多分类。 多输入单输出 2、代码中文注释清晰,质量极高 3、运行结果图包括分类效果图,迭代优化图,混淆矩阵图,如下所示 4、测试数据集,可以直接运行源程序。 适合新手小白

今天,我想跟大家分享一下如何用MATLAB实现一个经典的机器学习算法——Adaboost。对于刚入门的小白来说,Adaboost可能听起来有点高大上,但其实它的原理并不复杂。而且,用MATLAB实现起来也特别简单,基本上就是调包。

什么是Adaboost?

Adaboost(自适应增强)是一种集成学习算法,它通过组合多个弱分类器来构建一个强大的分类器。每个弱分类器的性能可能并不好,但通过Adaboost的加权投票机制,可以逐步提升整体模型的准确率。

Adaboost的核心思想是:

- 给每个样本赋予一个权重。

- 用加权后的数据训练一个弱分类器。

- 根据弱分类器的性能调整样本权重:分对的样本权重降低,分错的样本权重提高。

- 重复上述过程,直到达到预设的迭代次数。

这样,模型会逐渐关注那些难以分类的样本,从而提高整体性能。

准备工作

首先,我要求你的运行环境是MATLAB 2018b及以上版本。这个算法可以处理二分类和多分类问题,支持多输入单输出。

Adaboost分类,基于集成模型的Adaboost的数据分类预测 回归也有, 程序已经调试好,无需更改代码替换数据集即可运行数据格式为excel 1、运行环境要求MATLAB版本为2018b及其以上,可实现二分类和多分类。 多输入单输出 2、代码中文注释清晰,质量极高 3、运行结果图包括分类效果图,迭代优化图,混淆矩阵图,如下所示 4、测试数据集,可以直接运行源程序。 适合新手小白

接下来,我会提供完整的代码,代码中有详细的中文注释,方便大家理解。

测试数据集已经准备好,可以直接运行。如果你有其他数据集,也可以替换一下。

实现步骤

第一步:数据准备

首先,我们需要加载数据。我假设我们的数据是Excel格式的,其中最后一列是标签,其他列是特征。

% 加载数据

data = readtable('data.xlsx');

features = data(:, 1:end-1);

labels = data(:, end);第二步:数据预处理

在进行分类之前,通常需要对数据进行归一化处理,以保证各个特征具有相同的尺度。

% 数据归一化

[features_normalized, mu, sigma] = zscore(features);第三步:交叉验证

为了评估模型的性能,我们通常会将数据分成训练集和测试集。这里我们简单地使用了80%的数据作为训练集,20%的数据作为测试集。

% 分割数据集

cv = 0.8; % 训练集比例

cvIndices = cvpartition(size(features_normalized,1),'Holdout',1 - cv);

训练集数据 = features_normalized(cvIndices.training,:);

测试集数据 = features_normalized(cvIndices.test,:);

训练标签 = labels(cvIndices.training,:);

测试标签 = labels(cvIndices.test,:);第四步:模型训练

现在,我们使用Adaboost算法来训练模型。

% 使用Adaboost算法

n_estimators = 100; % 基分类器的数量

Learner = fitensemble(训练集数据, 训练标签, 'AdaBoostM2', n_learners, 'Tree');第五步:模型预测

训练完成后,我们可以使用测试集来评估模型的性能。

% 预测

预测结果 = predict(Learner, 测试集数据);第六步:模型评估

最后,我们需要对模型进行评估。我们可以使用混淆矩阵来查看模型的分类性能。

% 绘制混淆矩阵

confusionchart(测试标签, 预测结果);输出结果

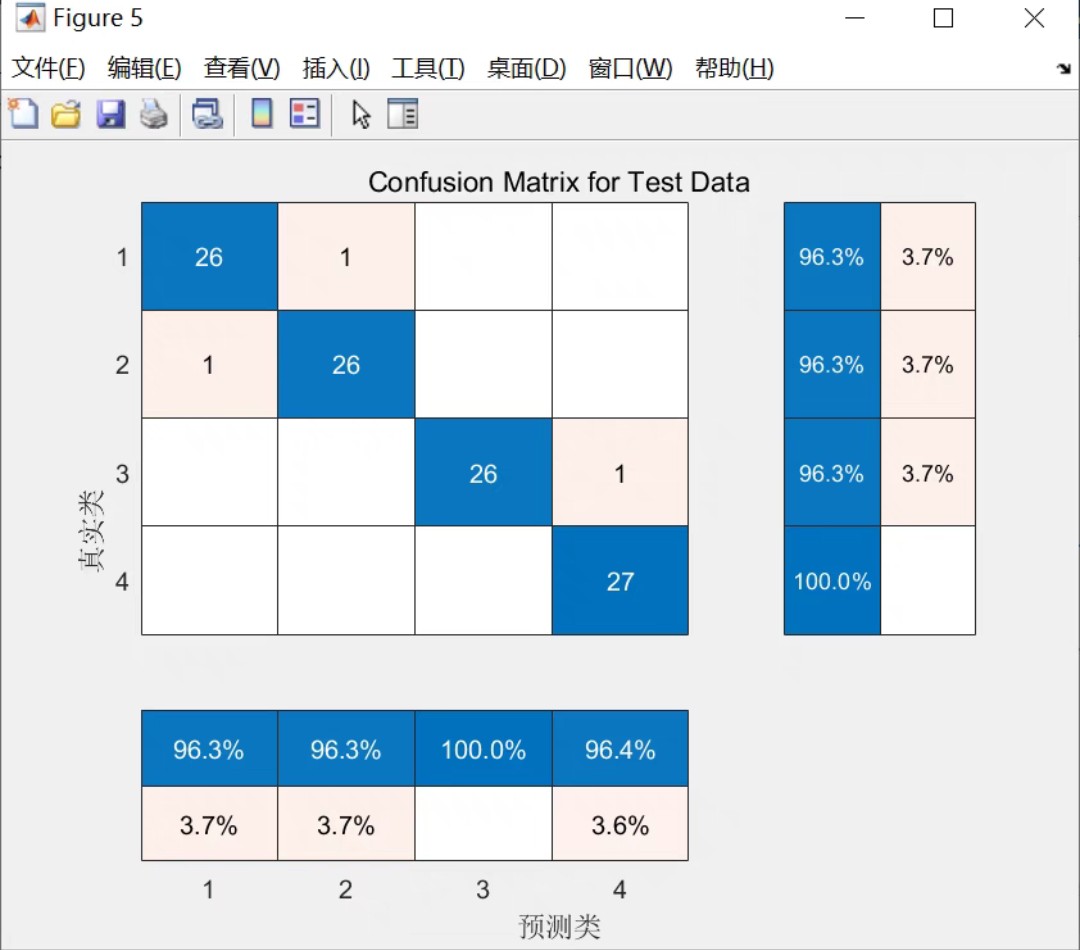

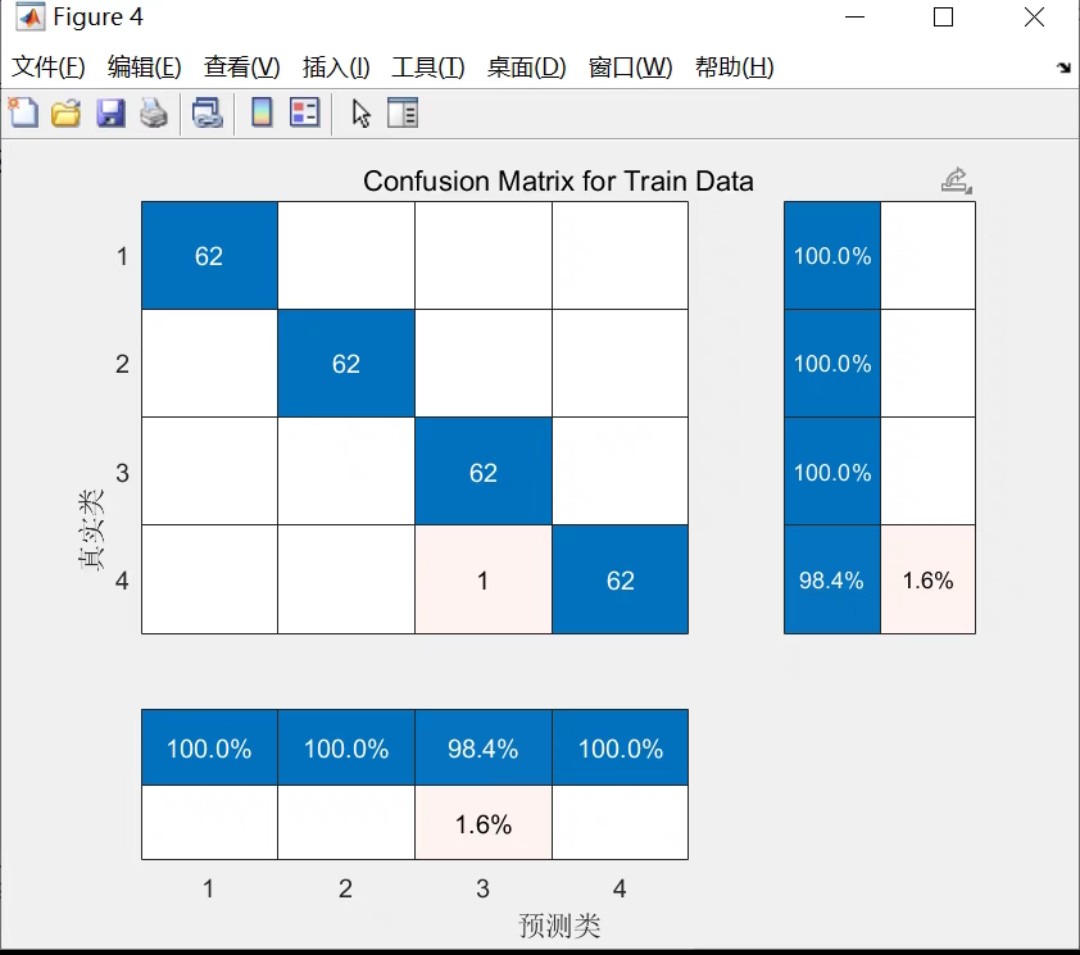

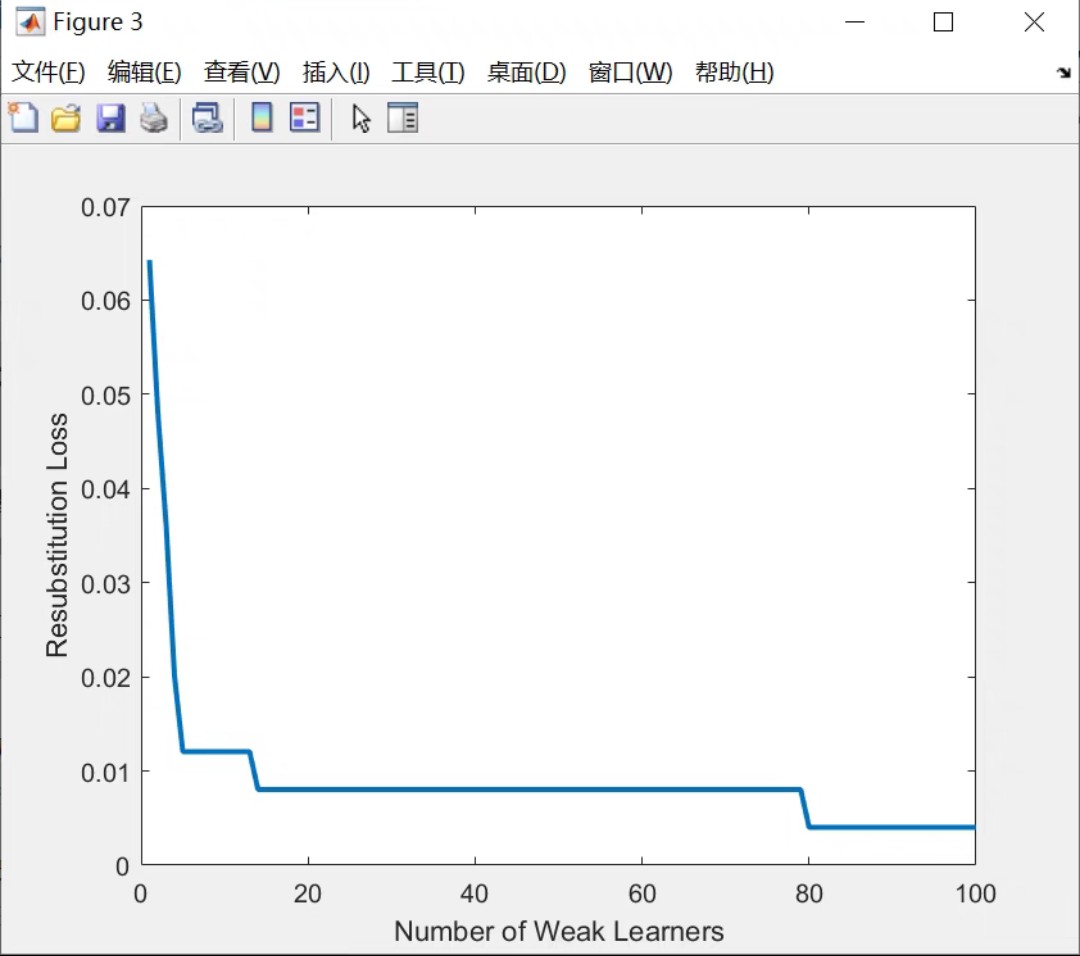

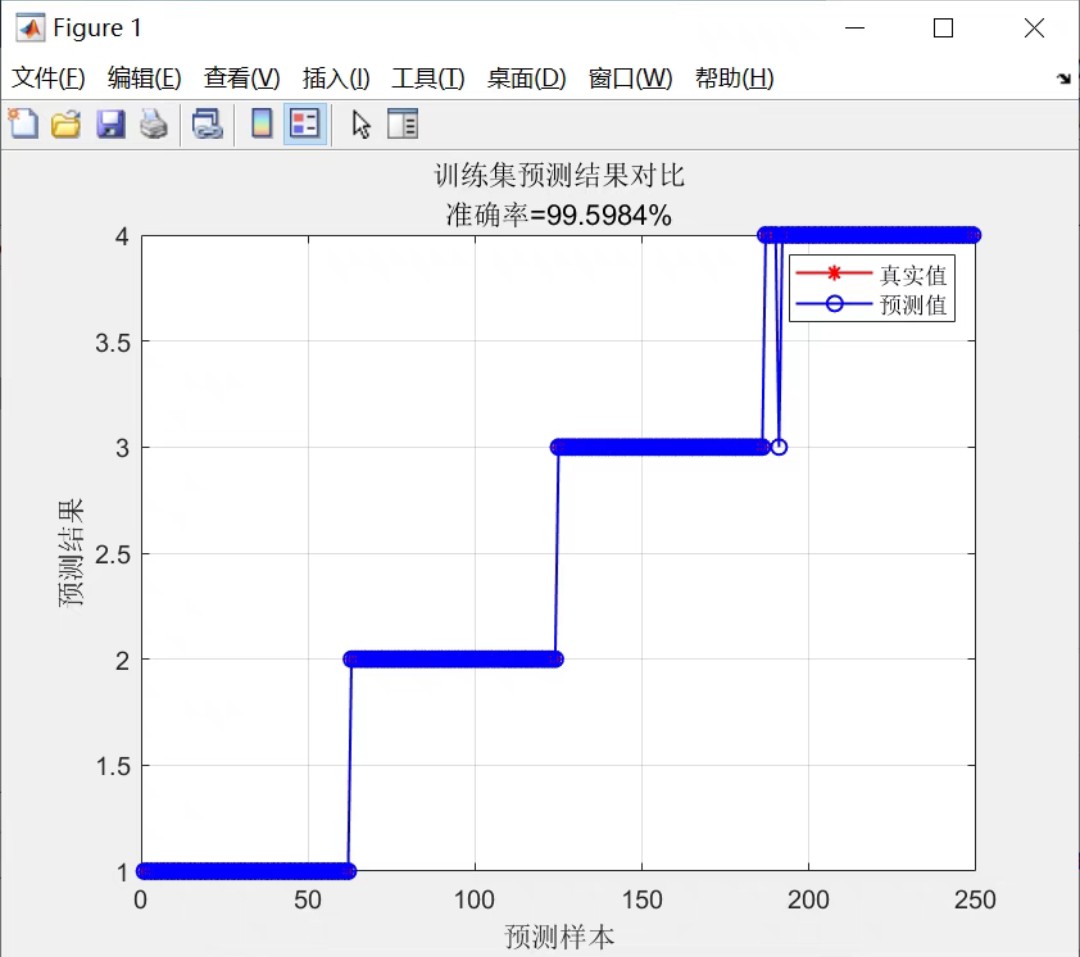

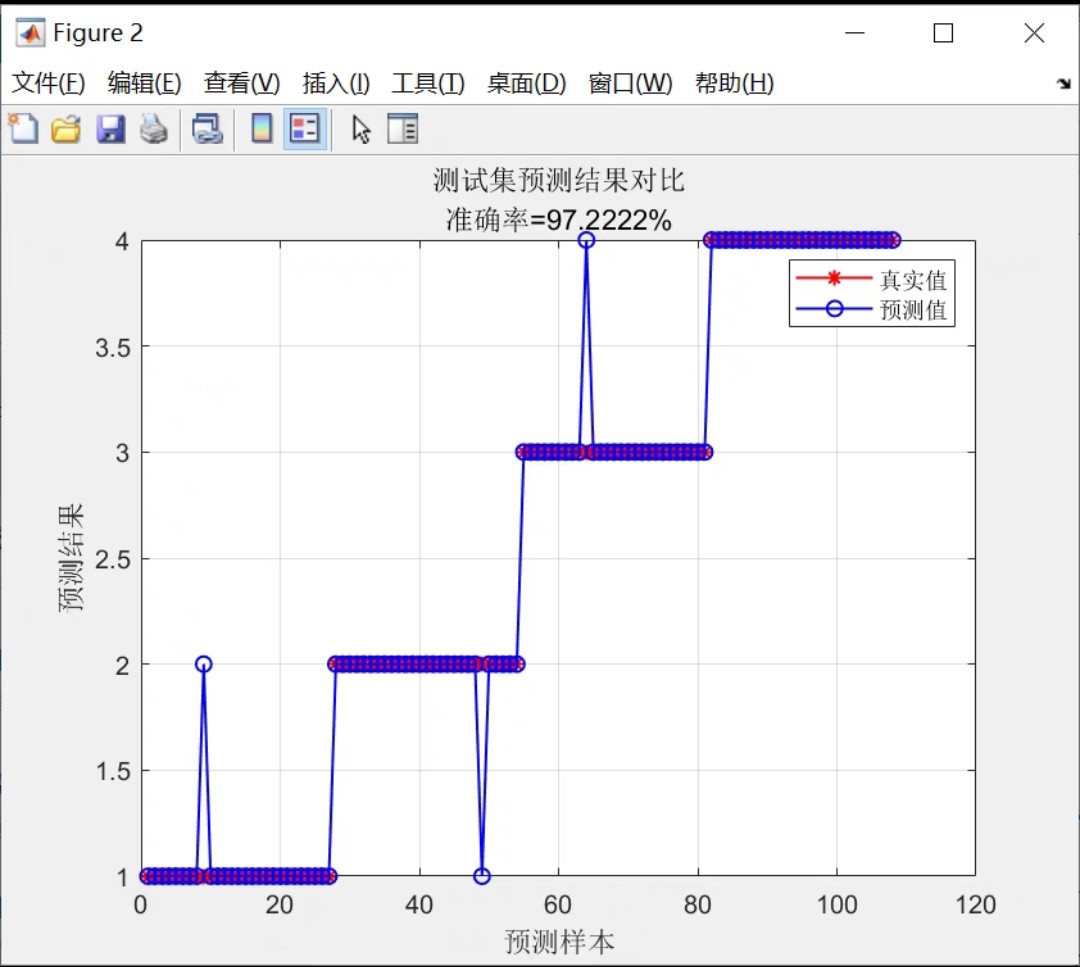

运行完代码后,我们会得到以下三个图:

- 分类效果图:展示数据点的分布以及分类边界。

- 迭代优化图:显示每一步迭代后的分类错误率。

- 混淆矩阵图:展示模型的分类性能。

代码下载

为了让大家更方便地运行代码,我已经将完整的代码和测试数据集打包好了(点击这里下载)。大家可以直接运行,看看效果如何。

总结

Adaboost算法虽然看起来复杂,但其实实现起来非常简单。通过上述步骤,大家就可以轻松地用MATLAB实现一个Adaboost分类器。希望这篇博性能帮助大家更好地理解Adaboost算法,并能够应用到实际中去。

如果你有任何问题或者建议,欢迎在下方留言。我会尽力为大家解答!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)