大模型微调到底是在干嘛?

大模型微调到底是在干嘛?

目录:

-

背景引入:DeepSeek 什么都能聊? -

核心概念一:什么是预训练 -

核心概念二:什么是微调 -

为什么需要微调 -

微调的几种方式 -

实际应用案例 -

本文小结 -

今日思考题

一、背景引入:DeepSeek 什么都能聊?

大家平时用 DeepSeek 的时候,有没有想过一个问题:

这玩意儿怎么什么都知道?写代码、写文章、翻译、做数学题...好像是个全能选手。

但如果你跟它说:"帮我写一份法律合同"或者"按照我们公司的格式写个周报",它可能就懵了。

为啥会这样?

因为它是个"通才",不是"专才"。

今天咱们就来聊聊:怎么让一个通才大模型,变成某个领域的专才。这个过程,就叫——微调(Fine-tuning)。

二、核心概念一:什么是预训练

要理解微调,得先搞懂啥叫预训练。

想象一个高中生

预训练就像是让一个学生从小学读到高中,啥都学一点:

-

语文、数学、英语都要学 -

物理、化学、生物也得懂 -

历史、地理、政治也不能落下

学完之后,这个学生啥都知道一点,但样样都不精。这叫通识教育。

大模型的预训练也一样:

-

喂给它互联网上几乎所有的文本 -

让它学习语言规律、世界知识 -

训练完了,它啥都能聊一点

预训练的代价

但是!这个"通识教育"可不便宜:

-

需要几千张甚至几万张显卡一起跑 -

训练时间可能要几个月 -

花费几百万甚至上千万美元

所以预训练模型就像个昂贵的大学生,培养出来不容易。

三、核心概念二:什么是微调

好了,现在咱们有一个"大学毕业生"了(预训练模型)。

但咱们公司需要的是一个会写 Java 代码、懂我们业务逻辑的工程师,不是啥都知道一点的大学生。

怎么办?

微调就是解决这个问题。

微调 = 专项培训

微调就像是给这个大学生安排一个岗前培训:

预训练模型(大学毕业生)

↓

微调

↓

专业模型(岗位专家)

具体来说:

-

准备一些咱们领域的专业数据(比如医疗问诊记录、客服对话) -

让模型继续学习这些数据 -

学完后,它就变成了这个领域的专家

关键点来了!

微调和从头训练最大的区别是:

| 对比项 | 从头训练 | 微调 |

|---|---|---|

| 基础 | 从零开始 | 有预训练模型打底 |

| 数据量 | 需要海量数据 | 几千条就够了 |

| 时间 | 几个月 | 几小时到几天 |

| 成本 | 几百万 | 几百到几千块 |

微调就像是站在巨人的肩膀上,只学最后那一点点。

四、为什么需要微调

大家可能会问:预训练模型已经很强了,为啥还要微调?

这个问题问得好!咱们来分析几个场景:

场景一:专业领域知识

用户: "我最近总感觉心慌气短,是咋回事?"

普通模型: "建议您多休息,保持健康作息..."

医疗微调模型: "心慌气短可能涉及多个原因:心律失常、贫血、甲状腺问题等。建议您去医院做以下检查:心电图、血常规、甲状腺功能..."

看出来了吗?专业问题需要专业回答。

场景二:特定格式要求

有些公司需要模型按固定格式输出,比如:

{

"intent": "refund",

"product": "iPhone 15",

"reason": "质量问题",

"sentiment": "negative"

}

普通模型可能每次格式都不一样,但微调后的模型能 稳定输出指定格式。

场景三:企业内部知识

-

公司的产品文档 -

内部的操作流程 -

特定的业务术语

这些东西,互联网上可没有,必须通过微调让模型学习。

五、微调的几种方式

微调不是一刀切的,根据需求不同,有好几种方式。

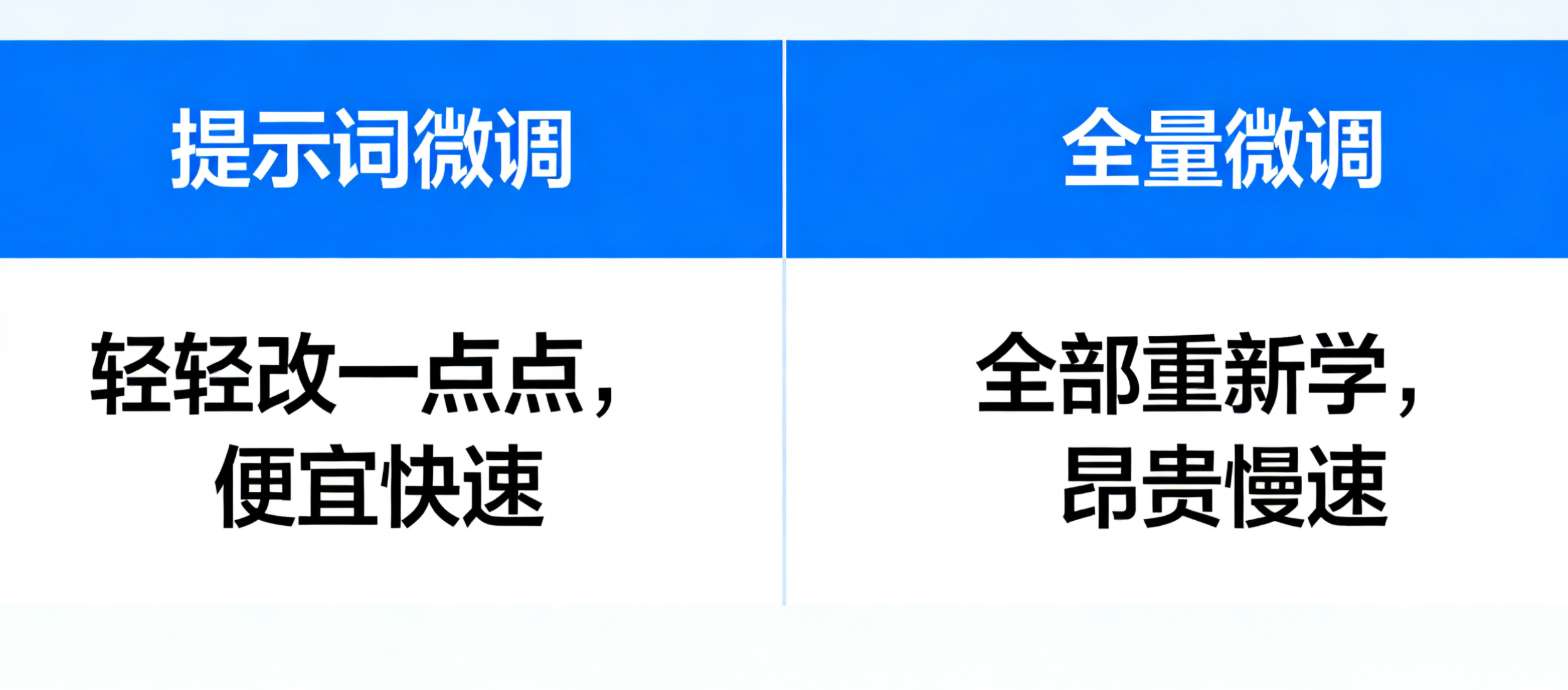

咱们用一张图来感受一下:

方式一:提示词微调(Prompt Tuning)

啥意思?就是不改模型参数,只改输入的提示词。

举个栗子:

原来:写一封邮件

优化后:你是一个专业的商务邮件写手,请写一封礼貌、专业的邮件

优点: 零成本,立竿见影 缺点: 效果有限,不稳定

方式二:LoRA 微调(推荐)

LoRA 是目前最流行的微调方式,全名叫 Low-Rank Adaptation。

听起来很高大上?说白了就是:

原模型不动,旁边加个小补丁

预训练模型(不动)

↓

加个小补丁(LoRA层)

↓

输出更专业

优点:

-

训练快(几小时) -

成本低(几百块) -

效果好

缺点:

-

需要一些技术门槛 -

需要准备训练数据

方式三:全量微调

把模型的所有参数都重新训练一遍。

优点: 效果最好 缺点: 成本高、门槛高

一般只有大厂才会用这种方式。

六、实际应用案例

咱们来看几个真实的微调案例,相信大家图文结合,会理解的更好。

案例一:AI 客服

问题: 某电商公司的客服每天要回答几千个重复问题

解决方案:

-

收集过去一年的客服对话记录(10 万条) -

用 LoRA 微调一个 7B 模型 -

训练成本:约 500 元 -

训练时间:4 小时

效果:

-

AI 客服能处理 70% 的常规问题 -

客服人员工作效率提升 3 倍 -

客户满意度不降反升

案例二:医疗问诊助手

问题: 基层医生经验不足,容易误诊

解决方案:

-

收集三甲医院的问诊记录(脱敏处理) -

微调专门用于常见病问诊的模型 -

加入医学知识库增强

效果:

-

辅助基层医生进行初步诊断 -

诊断准确率提升 20% -

减少误诊风险

案例三:代码生成助手

问题: 普通模型写的代码不符合公司规范

解决方案:

-

收集公司内部的高质量代码 -

微调一个代码专用模型 -

让模型学习公司的编码规范

效果:

-

生成的代码符合公司规范 -

开发效率提升 40% -

代码质量更稳定

七、本文小结

咱们今天主要聊了以下几点:

1. 预训练 vs 微调

-

预训练 = 通识教育(什么都学一点) -

微调 = 专项培训(专注某个领域)

2. 为什么要微调

-

专业领域需要专业知识 -

特定格式需要稳定输出 -

企业知识需要让模型学习

3. 微调的三种方式

-

提示词微调:零成本但效果有限 -

LoRA 微调:性价比最高(推荐) -

全量微调:效果最好但成本高

4. 实际应用

-

AI 客服、医疗问诊、代码生成...场景非常丰富

八、今日思考题

今天留一个思考题:

如果你要给一家律师事务所微调一个法律大模型,你会收集哪些数据?需要注意什么问题?

提示:法律领域有什么特殊性?

大家先思考思考,欢迎在评论区说说你的想法!

本文由 mdnice 多平台发布

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)