大模型应用开发:小白程序员转型AI的最佳切入点,收藏必备!

文章介绍了大模型应用开发的概念、定位、应用场景和技术架构,详细阐述了Python编程、大模型API调用、Prompt工程、RAG技术等必备技能,并提供了智能客服系统、企业知识库系统、内容生成平台等实战项目案例。此外,文章还探讨了常见问题解决方案、职业发展路径以及求职准备建议,旨在帮助小白程序员快速入门并掌握大模型应用开发技能。

一、什么是大模型应用开发?

1.1 定义与定位

大模型应用开发:将大语言模型(LLM)的能力集成到实际应用中,解决具体业务问题。

核心职责:

- • 设计和实现LLM应用架构

- • 优化模型调用策略

- • 处理模型输出的不确定性

- • 集成企业现有系统

与算法开发的区别:

| 维度 | 大模型应用开发 | 算法开发 |

|---|---|---|

| 核心任务 | 调用API解决业务问题 | 训练和优化模型 |

| 技术重点 | 工程架构、Prompt设计 | 数学、算法原理 |

| 工具使用 | 调用现成模型API | 自己训练模型 |

| 入门门槛 | 较低 | 较高 |

| 薪资范围 | 20-60K | 25-50K |

| 需求量 | 最大 | 相对较少 |

1.2 典型应用场景

1. 内容生成

- • 文章写作、营销文案

- • 代码生成、文档编写

- • 创意内容生成

2. 智能客服

- • 自动问答

- • 工单分类

- • 情感分析

3. 知识管理

- • 企业知识库问答

- • 文档检索和总结

- • 信息提取

4. 数据分析

- • 文本分类和标注

- • 舆情分析

- • 报告生成

5. 办公自动化

- • 邮件起草

- • 会议纪要

- • 任务管理

1.3 技术架构

典型的大模型应用架构:

用户界面(Web/Mobile/API) ↓应用层(业务逻辑) ↓┌─────────────────────────────┐│ 大模型服务层 ││ - Prompt模板管理 ││ - 上下文管理 ││ - 输出验证和过滤 │└─────────────────────────────┘ ↓┌─────────────────────────────┐│ LLM调用层 ││ - OpenAI/Claude/文心一言 ││ - 重试和错误处理 ││ - 成本优化 │└─────────────────────────────┘ ↓┌─────────────────────────────┐│ 数据层 ││ - 向量数据库(RAG) ││ - 业务数据库 ││ - 缓存层 │└─────────────────────────────┘

二、核心技能要求

2.1 必备技能

技能1:Python编程

为什么重要:AI生态的主要语言,大部分LLM SDK都是Python优先。

学习重点:

- • 异步编程(asyncio)- 处理并发请求

- • 类型提示(type hints)- 代码可维护性

- • 请求处理(FastAPI/Flask)- 构建API服务

- • 数据处理(pandas、numpy)- 处理LLM输入输出

技能2:大模型API调用

主流API对比:

| API提供商 | 模型 | 优势 | 劣势 | 价格 |

|---|---|---|---|---|

| OpenAI | GPT-4o | 综合能力强 | 需翻墙 | 较贵 |

| Anthropic | Claude 3.5 | 长文本好 | 需翻墙 | 中等 |

| 百度千帆 | 文心一言 | 中文好 | 能力一般 | 便宜 |

| 阿里云 | 通义千问 | 多模态 | API较慢 | 便宜 |

| DeepSeek | DeepSeek-V3 | 性价比高 | 生态新 | 最便宜 |

API调用模式:

import asynciofrom openai import AsyncOpenAIfrom tenacity import retry, stop_after_attempt, wait_exponentialclass LLMClient: def __init__(self, api_key: str, base_url: str = None): self.client = AsyncOpenAI( api_key=api_key, base_url=base_url ) @retry( stop=stop_after_attempt(3), wait=wait_exponential(multiplier=1, min=2, max=10) ) async def chat( self, messages: list[dict], model: str = "gpt-3.5-turbo", temperature: float = 0.7, max_tokens: int = 2000 ) -> str: """调用大模型API,带重试机制""" try: response = await self.client.chat.completions.create( model=model, messages=messages, temperature=temperature, max_tokens=max_tokens ) return response.choices[0].message.content except Exception as e: print(f"API调用失败: {e}") raise# 使用示例async def main(): client = LLMClient(api_key="your-api-key") result = await client.chat([ {"role": "user", "content": "你好"} ]) print(result)asyncio.run(main())

技能3:Prompt工程

Prompt设计的黄金法则:

1. 明确角色

# 差Prompt"总结这篇文章"# 好Prompt"""你是一个专业的内容分析师,擅长从长篇文章中提取关键信息。你的任务是:总结文章的核心观点、重要论据和结论。"""

2. 提供示例(Few-Shot)

prompt_template = """你是一个文本分类助手。请将以下文本分类为:正面、负面、中立。示例1:文本:这个产品太棒了!分类:正面示例2:文本:产品质量很差,不推荐。分类:负面示例3:文本:产品功能一般,价格还行。分类:中立现在请分类:文本:{user_input}分类:"""

3. 约束输出格式

prompt_template = """请分析以下文本的情感,并以JSON格式输出:要求格式:{{ "sentiment": "正面/负面/中立", "confidence": 0.0-1.0, "keywords": ["关键词1", "关键词2"], "reason": "判断理由"}}文本:{text}"""

技能4:RAG技术

什么是RAG:检索增强生成,给大模型外挂知识库。

RAG系统的核心组件:

from langchain.embeddings import OpenAIEmbeddingsfrom langchain.vectorstores import Chromafrom langchain.text_splitter import RecursiveCharacterTextSplitterfrom langchain.chains import RetrievalQAfrom langchain.chat_models import ChatOpenAIclass RAGSystem: def __init__(self, persist_directory: str = "./chroma_db"): self.embeddings = OpenAIEmbeddings() self.vectorstore = Chroma( persist_directory=persist_directory, embedding_function=self.embeddings ) self.text_splitter = RecursiveCharacterTextSplitter( chunk_size=500, chunk_overlap=50 ) def add_documents(self, documents: list[str]) -> None: """添加文档到知识库""" texts = self.text_splitter.create_documents(documents) self.vectorstore.add_documents(texts) self.vectorstore.persist() def query(self, question: str, k: int = 3) -> str: """查询知识库并生成答案""" # 创建QA链 qa_chain = RetrievalQA.from_chain_type( llm=ChatOpenAI(model="gpt-3.5-turbo", temperature=0), chain_type="stuff", retriever=self.vectorstore.as_retriever(search_kwargs={"k": k}), return_source_documents=True ) # 查询 result = qa_chain({"query": question}) # 返回答案和来源 answer = result["result"] sources = [doc.metadata["source"] for doc in result["source_documents"]] return f"答案:{answer}\n\n来源:{sources}"# 使用示例rag = RAGSystem()rag.add_documents([ "公司年假规定:工作满1年享受5天年假...", "请假流程:提前3天提交申请...", "加班政策:工作日加班按1.5倍工资计算..."])print(rag.query("年假有多少天?"))

2.2 进阶技能

技能5:向量数据库

主流向量数据库对比:

| 数据库 | 优势 | 劣势 | 适用场景 |

|---|---|---|---|

| ChromaDB | 轻量、易上手 | 性能一般 | 小型项目、学习 |

| Pinecone | 性能好、托管服务 | 需付费 | 生产环境 |

| Milvus | 开源、功能全 | 部署复杂 | 企业级应用 |

| Weaviate | 多模态支持 | 学习曲线陡 | 图文检索 |

技能6:流式输出

为什么需要流式:提升用户体验,像ChatGPT一样逐字显示。

from openai import OpenAIimport sysdef stream_chat(messages: list[dict]): client = OpenAI() stream = client.chat.completions.create( model="gpt-3.5-turbo", messages=messages, stream=True # 启用流式输出 ) print("AI:", end="", flush=True) for chunk in stream: if chunk.choices[0].delta.content: content = chunk.choices[0].delta.content print(content, end="", flush=True) print() # 换行# 使用stream_chat([{"role": "user", "content": "讲个笑话"}])

技能7:成本优化

优化策略:

class CostOptimizedLLM: def __init__(self): # 价格(每1K tokens) self.models = { "gpt-4o": 0.005, # 输入 "gpt-3.5-turbo": 0.0005, "deepseek-chat": 0.0001 } def select_model(self, task_complexity: str) -> str: """根据任务复杂度选择模型""" if task_complexity == "简单": return "deepseek-chat" # 最便宜 elif task_complexity == "中等": return "gpt-3.5-turbo" else: return "gpt-4o" # 最强 def estimate_cost(self, input_tokens: int, output_tokens: int, model: str) -> float: """估算成本""" input_cost = (input_tokens / 1000) * self.models[model] output_cost = (output_tokens / 1000) * (self.models[model] * 2) # 输出通常是2倍价格 return input_cost + output_cost# 缓存机制避免重复调用from functools import lru_cache@lru_cache(maxsize=100)def cached_llm_call(prompt: str) -> str: """带缓存的LLM调用""" # 实际调用LLM return result

三、实战项目

项目1:智能客服系统

功能需求:

- 回答常见问题(FAQ)

- 处理用户投诉

- 工单自动分类

- 情感分析

技术架构:

from fastapi import FastAPI, HTTPExceptionfrom pydantic import BaseModelimport asyncioapp = FastAPI(title="智能客服系统")class CustomerQuery(BaseModel): user_id: str message: str session_id: str = Noneclass CustomerServiceAgent: def __init__(self): self.faq_knowledge_base = RAGSystem("./faq_db") self.sentiment_analyzer = SentimentAnalyzer() self.ticket_classifier = TicketClassifier() async def handle_query(self, query: CustomerQuery) -> dict: """处理用户查询""" # 步骤1:情感分析 sentiment = await self.sentiment_analyzer.analyze(query.message) # 步骤2:如果是负面情绪,优先处理 if sentiment == "负面": return { "response": "非常抱歉给您带来不便,我们会立即处理您的问题。您的工单已创建,工号:#12345", "sentiment": sentiment, "action": "create_ticket", "priority": "high" } # 步骤3:查询知识库 faq_answer = await self.faq_knowledge_base.query(query.message) # 步骤4:如果知识库没有答案,调用LLM if "未找到" in faq_answer: llm_response = await self.llm_generate(query.message) return { "response": llm_response, "sentiment": sentiment, "action": "llm_fallback" } return { "response": faq_answer, "sentiment": sentiment, "action": "faq_match" }agent = CustomerServiceAgent()@app.post("/chat")async def chat(query: CustomerQuery): """客服聊天接口""" try: response = await agent.handle_query(query) return { "code": 0, "message": "success", "data": response } except Exception as e: raise HTTPException(status_code=500, detail=str(e))if __name__ == "__main__": import uvicorn uvicorn.run(app, host="0.0.0.0", port=8000)

项目2:企业知识库系统

功能需求:

- 文档上传和管理

- 智能问答

- 引用来源展示

- 权限控制

核心代码:

from langchain.chains import ConversationalRetrievalChainfrom langchain.memory import ConversationBufferMemoryclass EnterpriseKnowledgeBase: def __init__(self): self.vectorstore = Chroma( persist_directory="./enterprise_kb", embedding_function=OpenAIEmbeddings() ) self.memory = ConversationBufferMemory( memory_key="chat_history", return_messages=True ) # 创建对话式QA链 self.qa_chain = ConversationalRetrievalChain.from_llm( llm=ChatOpenAI(model="gpt-3.5-turbo", temperature=0), retriever=self.vectorstore.as_retriever( search_type="similarity_score_threshold", search_kwargs={ "k": 3, "score_threshold": 0.7 # 只返回相似度>0.7的结果 } ), memory=self.memory, return_source_documents=True, verbose=False ) async def ask(self, question: str, session_id: str) -> dict: """提问""" result = await self.qa_chain.acall({ "question": question, "chat_history": self.memory.load_memory_variables({}).get("chat_history", []) }) # 提取答案和来源 answer = result["answer"] sources = [ { "content": doc.page_content[:100] + "...", "metadata": doc.metadata } for doc in result["source_documents"] ] return { "answer": answer, "sources": sources, "session_id": session_id } def upload_document(self, file_path: str, metadata: dict) -> None: """上传文档""" # 读取文档 with open(file_path, 'r', encoding='utf-8') as f: content = f.read() # 切分文档 text_splitter = RecursiveCharacterTextSplitter( chunk_size=500, chunk_overlap=50, separators=["\n\n", "\n", "。", "!", "?", ".", "!", "?"] ) texts = text_splitter.create_texts([content]) # 添加元数据 for i, text in enumerate(texts): self.vectorstore.add_texts( [text], metadatas=[{ **metadata, "chunk_id": f"{file_path}_{i}", "timestamp": datetime.now().isoformat() }] ) self.vectorstore.persist()

项目3:内容生成平台

功能需求:

- 文章生成

- 多语言翻译

- 内容优化

- 批量处理

核心代码:

from typing import Literalclass ContentGenerationPlatform: def __init__(self): self.client = AsyncOpenAI() self.templates = { "article": """你是一个专业的文章作者。请根据以下要求撰写文章:主题:{topic}字数:{words}字风格:{style}目标读者:{audience}要求:1. 结构清晰,有引言、正文、结尾2. 内容充实,有具体例子3. 语言流畅,符合目标读者水平4. 原创内容,不得抄袭请开始撰写:""", "email": """你是一个专业的邮件撰写助手。请撰写一封邮件:收件人:{recipient}目的:{purpose}要点:{points}语气:{tone}要求:1. 主题明确2. 简洁专业3. 行动清晰请撰写:""" } async def generate_content( self, content_type: Literal["article", "email", "ad_copy"], **kwargs ) -> str: """生成内容""" # 获取模板 template = self.templates.get(content_type, "") prompt = template.format(**kwargs) # 调用LLM response = await self.client.chat.completions.create( model="gpt-3.5-turbo", messages=[{"role": "user", "content": prompt}], temperature=0.7, max_tokens=2000 ) return response.choices[0].message.content async def optimize_content( self, original_content: str, goal: Literal["shorten", "expand", "improve", "tone_change"], **kwargs ) -> str: """优化内容""" prompts = { "shorten": f"请将以下内容精简,保留核心信息:\n{original_content}", "expand": f"请扩展以下内容,增加更多细节和例子:\n{original_content}", "improve": f"请改进以下内容的表达,使其更清晰、更有吸引力:\n{original_content}", "tone_change": f"请将以下内容的语气改为{kwargs.get('tone', '专业')}:\n{original_content}" } prompt = prompts.get(goal, "") response = await self.client.chat.completions.create( model="gpt-3.5-turbo", messages=[{"role": "user", "content": prompt}], temperature=0.5 ) return response.choices[0].message.content async def batch_generate( self, tasks: list[dict] ) -> list[dict]: """批量生成内容""" # 并发处理,限制并发数 semaphore = asyncio.Semaphore(5) # 最多5个并发 async def process_task(task): async with semaphore: try: result = await self.generate_content(**task) return {"task": task, "result": result, "status": "success"} except Exception as e: return {"task": task, "error": str(e), "status": "failed"} results = await asyncio.gather(*[process_task(task) for task in tasks]) return results

四、常见问题与解决方案

4.1 输出质量不稳定

问题:同样的问题,每次回答不一样

解决方案:

# 方法1:降低Temperatureresponse = await client.chat.completions.create( model="gpt-3.5-turbo", messages=messages, temperature=0, # 最稳定的输出 top_p=1.0)# 方法2:添加示例(Few-Shot)messages = [ {"role": "system", "content": "你是一个文本分类助手"}, {"role": "user", "content": "这个产品太棒了!"}, {"role": "assistant", "content": "正面"}, {"role": "user", "content": "质量很差"}, {"role": "assistant", "content": "负面"}, {"role": "user", "content": user_input} # 实际输入]

4.2 API调用失败

问题:网络超时、限流、服务不可用

解决方案:

from tenacity import retry, stop_after_attempt, wait_exponentialimport logginglogger = logging.getLogger(__name__)@retry( stop=stop_after_attempt(3), wait=wait_exponential(multiplier=1, min=2, max=10), retry=retry_if_exception_type((ConnectionError, TimeoutError)))async def call_llm_with_retry(messages: list[dict]) -> str: """带重试的LLM调用""" try: response = await client.chat.completions.create( model="gpt-3.5-turbo", messages=messages, timeout=30 # 30秒超时 ) return response.choices[0].message.content except Exception as e: logger.error(f"LLM调用失败: {e}") raise# 使用降级策略async def call_llm_with_fallback(messages: list[dict]) -> str: """主模型失败时切换到备用模型""" try: return await call_llm_with_retry(messages) except Exception as e: logger.warning(f"主模型失败,切换到备用模型: {e}") # 切换到更便宜的模型 response = await client.chat.completions.create( model="gpt-3.5-turbo", messages=messages ) return response.choices[0].message.content

4.3 成本过高

问题:API调用费用太高

解决方案:

class CostOptimizedStrategy: """成本优化策略""" @staticmethod def cache_frequently_used_queries(): """缓存常用查询""" @lru_cache(maxsize=1000) async def cached_llm(prompt: str) -> str: return await call_llm(prompt) return cached_llm @staticmethod def use_smaller_model_for_simple_tasks(task_type: str) -> str: """简单任务用小模型""" model_mapping = { "简单问答": "gpt-3.5-turbo", "文本分类": "gpt-3.5-turbo", "复杂推理": "gpt-4o", "代码生成": "gpt-4o" } return model_mapping.get(task_type, "gpt-3.5-turbo") @staticmethod def limit_output_tokens(max_tokens: int = 500): """限制输出长度""" return max_tokens

五、职业发展路径

5.1 初级(0-1年经验)

职责:

- • 调用LLM API完成简单任务

- • 编写和维护Prompt

- • 处理API错误和异常

技能要求:

- • Python基础

- • HTTP API调用

- • 基本的Prompt设计

薪资范围:15-25K

5.2 中级(1-3年经验)

职责:

- • 设计LLM应用架构

- • 实现RAG系统

- • 优化Prompt和成本

- • 处理复杂业务逻辑

技能要求:

- • 熟悉LangChain等框架

- • 向量数据库使用

- • 异步编程

- • 系统设计能力

薪资范围:25-40K

5.3 高级(3-5年经验)

职责:

- • 架构设计

- • 技术选型

- • 团队指导

- • 性能优化

技能要求:

- • 深入理解LLM原理

- • 多模态模型应用

- • 微服务架构

- • 成本优化专家

薪资范围:40-60K

5.4 专家(5年+经验)

职责:

- • 技术决策

- • 团队建设

- • 技术创新

- • 跨部门协调

技能要求:

- • 全栈能力

- • 商业理解

- • 领导力

- • 行业影响力

薪资范围:60K+ 或年薪百万+

六、求职准备

6.1 作品集建议

必做项目:

-

RAG知识库问答系统

- 展示RAG技术

-

智能客服机器人

- 展示工程能力

-

内容生成工具

- 展示Prompt设计

加分项目:

- • 开源贡献

- • 技术博客

- • GitHub Stars > 100的项目

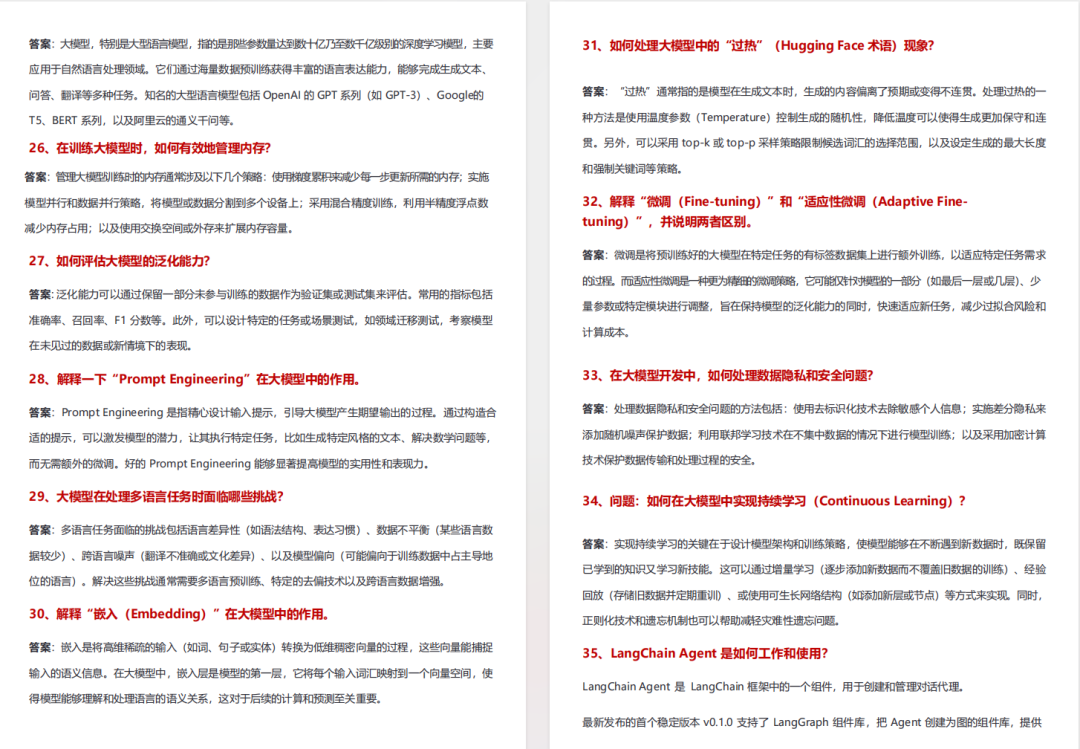

6.2 面试高频题

技术题:

- 如何设计一个企业级LLM应用?

- RAG的原理是什么?有哪些优化策略?

- 如何降低LLM API调用成本?

- 如何处理LLM的幻觉问题?

- 如何实现流式输出?

系统设计题:

- 设计一个支持10万用户的智能客服系统

- 设计一个文档管理和问答系统

行为题:

- 你是如何学习LLM技术的?

- 遇到过什么技术难题,如何解决的?

七、推荐资源

学习资源

- • LangChain官方文档:https://python.langchain.com/

- • OpenAI Cookbook:https://cookbook.openai.com/

- • DeepLearning.AI:短课程

实战平台

- • FlowiseAI:可视化构建LLM应用

- • Dify:开源LLM应用开发平台

最后

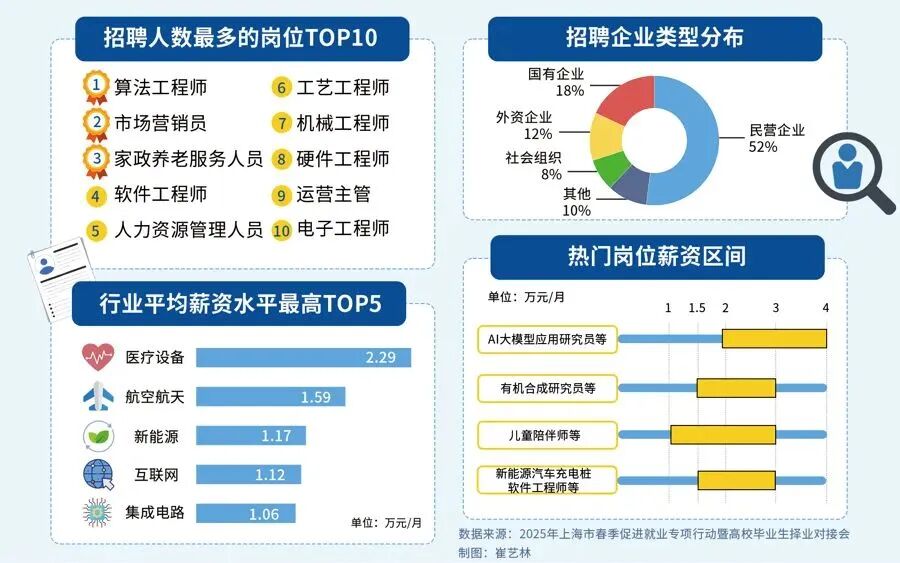

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?

答案只有一个:人工智能(尤其是大模型方向)

当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应聘者,月基础工资也能稳定在4万元左右。

再看阿里、腾讯两大互联网大厂,非“人才计划”的AI相关岗位应聘者,月基础工资也约有3万元,远超其他行业同资历岗位的薪资水平,对于程序员、小白来说,无疑是绝佳的转型和提升赛道。

对于想入局大模型、抢占未来10年行业红利的程序员和小白来说,现在正是最好的学习时机:行业缺口大、大厂需求旺、薪资天花板高,只要找准学习方向,稳步提升技能,就能轻松摆脱“低薪困境”,抓住AI时代的职业机遇。

如果你还不知道从何开始,我自己整理一套全网最全最细的大模型零基础教程,我也是一路自学走过来的,很清楚小白前期学习的痛楚,你要是没有方向还没有好的资源,根本学不到东西!

下面是我整理的大模型学习资源,希望能帮到你。

👇👇扫码免费领取全部内容👇👇

最后

1、大模型学习路线

2、从0到进阶大模型学习视频教程

从入门到进阶这里都有,跟着老师学习事半功倍。

3、 入门必看大模型学习书籍&文档.pdf(书面上的技术书籍确实太多了,这些是我精选出来的,还有很多不在图里)

4、 AI大模型最新行业报告

2026最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

5、面试试题/经验

【大厂 AI 岗位面经分享(107 道)】

【AI 大模型面试真题(102 道)】

【LLMs 面试真题(97 道)】

6、大模型项目实战&配套源码

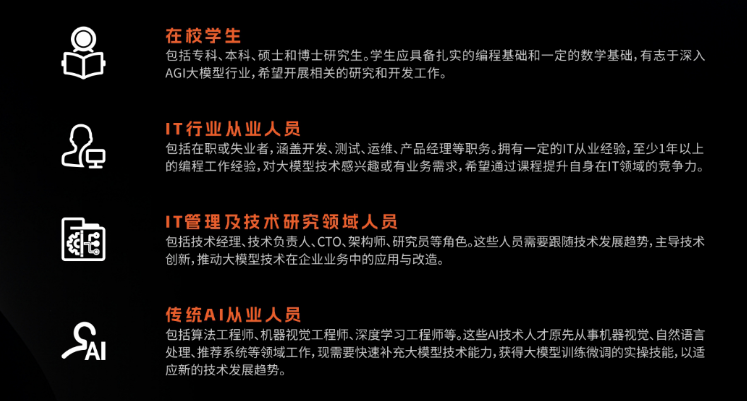

适用人群

四阶段学习规划(共90天,可落地执行)

第一阶段(10天):初阶应用

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。

- 大模型 AI 能干什么?

- 大模型是怎样获得「智能」的?

- 用好 AI 的核心心法

- 大模型应用业务架构

- 大模型应用技术架构

- 代码示例:向 GPT-3.5 灌入新知识

- 提示工程的意义和核心思想

- Prompt 典型构成

- 指令调优方法论

- 思维链和思维树

- Prompt 攻击和防范

- …

第二阶段(30天):高阶应用

该阶段我们正式进入大模型 AI 进阶实战学习,学会构造私有知识库,扩展 AI 的能力。快速开发一个完整的基于 agent 对话机器人。掌握功能最强的大模型开发框架,抓住最新的技术进展,适合 Python 和 JavaScript 程序员。

- 为什么要做 RAG

- 搭建一个简单的 ChatPDF

- 检索的基础概念

- 什么是向量表示(Embeddings)

- 向量数据库与向量检索

- 基于向量检索的 RAG

- 搭建 RAG 系统的扩展知识

- 混合检索与 RAG-Fusion 简介

- 向量模型本地部署

- …

第三阶段(30天):模型训练

恭喜你,如果学到这里,你基本可以找到一份大模型 AI相关的工作,自己也能训练 GPT 了!通过微调,训练自己的垂直大模型,能独立训练开源多模态大模型,掌握更多技术方案。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

- 为什么要做 RAG

- 什么是模型

- 什么是模型训练

- 求解器 & 损失函数简介

- 小实验2:手写一个简单的神经网络并训练它

- 什么是训练/预训练/微调/轻量化微调

- Transformer结构简介

- 轻量化微调

- 实验数据集的构建

- …

第四阶段(20天):商业闭环

对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。

-

硬件选型

-

带你了解全球大模型

-

使用国产大模型服务

-

搭建 OpenAI 代理

-

热身:基于阿里云 PAI 部署 Stable Diffusion

-

在本地计算机运行大模型

-

大模型的私有化部署

-

基于 vLLM 部署大模型

-

案例:如何优雅地在阿里云私有部署开源大模型

-

部署一套开源 LLM 项目

-

内容安全

-

互联网信息服务算法备案

-

…

👇👇扫码免费领取全部内容👇👇

3、这些资料真的有用吗?

这份资料由我和鲁为民博士(北京清华大学学士和美国加州理工学院博士)共同整理,现任上海殷泊信息科技CEO,其创立的MoPaaS云平台获Forrester全球’强劲表现者’认证,服务航天科工、国家电网等1000+企业,以第一作者在IEEE Transactions发表论文50+篇,获NASA JPL火星探测系统强化学习专利等35项中美专利。本套AI大模型课程由清华大学-加州理工双料博士、吴文俊人工智能奖得主鲁为民教授领衔研发。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献112条内容

已为社区贡献112条内容

所有评论(0)