【深度强化学习精通】第18讲 | 前沿展望:RL的下一个十年

摘要:作为本系列的收官之作,本讲将带领读者展望强化学习的未来发展方向。我们将深入探讨世界模型与因果推理、层级强化学习与抽象、元学习与快速适应、神经符号AI与RL结合、量子强化学习等五大前沿方向,分析2024-2025年的最新研究趋势,并提供系统的后续学习建议。无论你是希望深入学术研究的研究生,还是致力于工业应用的工程师,本讲都将为你的下一步发展提供清晰的路线图。

环境声明

- Python版本:Python 3.10+

- 核心依赖:PyTorch 2.0+, JAX 0.4+, NumPy 1.24+

- 开发工具:PyCharm / VS Code / Jupyter Notebook

- 操作系统:Windows / macOS / Linux

学习目标

完成本讲学习后,你将能够:

- 理解世界模型与因果推理的核心思想及其在RL中的应用前景

- 掌握层级强化学习的基本框架与抽象机制

- 了解元强化学习如何实现快速适应新任务

- 认识神经符号AI与RL结合的研究方向

- 初步了解量子强化学习的原理与潜力

- 获得系统的后续学习路径与论文阅读建议

1. 引言:站在巨人的肩膀上回望与展望

经过前面十七讲的系统学习,我们已经从基础的马尔可夫决策过程出发,走过了蒙特卡洛方法、时序差分学习、函数逼近,深入了深度强化学习的核心算法如DQN、PPO、SAC,探索了模型预测控制、世界模型、多智能体系统、离线强化学习等高级主题。这一路上,我们见证了强化学习从理论到实践的完整脉络。

然而,科学的发展永无止境。正如2024年诺贝尔物理学奖授予了在人工神经网络领域做出奠基性贡献的科学家所昭示的那样,人工智能正处于一个历史性的转折点。强化学习作为AI的核心支柱之一,正在经历前所未有的变革与突破。北京智源研究院发布的2025年AI十大趋势明确指出,世界模型有望成为多模态大模型的下一步发展方向,而注重因果推理的世界模型将赋予AI更高级别的认知和更符合逻辑的推理与决策能力。

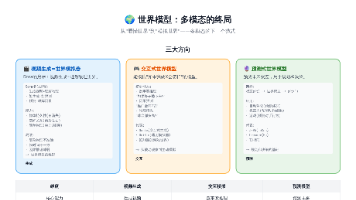

本讲将带领读者跳出具体算法的细节,站在更高的视角审视强化学习的未来。我们将探讨五个最具潜力的前沿方向:世界模型与因果推理、层级强化学习与抽象、元学习与快速适应、神经符号AI与RL结合、以及量子强化学习。这些方向不仅代表着学术研究的前沿,更将深刻影响强化学习在自动驾驶、机器人控制、智能制造、金融决策等领域的深度应用。

2. 世界模型与因果推理

2.1 世界模型的本质

世界模型(World Model)是强化学习领域近年来最受关注的研究方向之一。它的核心思想是让智能体在内部构建一个对环境的模拟器,这个模拟器能够预测环境状态的变化,从而使智能体能够在"脑海中"进行规划和推演,而不是完全依赖与真实环境的交互。

我们可以将世界模型比作人类的想象力。当人类学习骑自行车时,我们不仅通过实际骑行来积累经验,还会在脑海中预演各种场景:如果前方有障碍物该如何避让,如果失去平衡该如何调整。这种"脑内排演"的能力大大提高了学习效率,减少了在真实环境中试错的成本。

在强化学习的语境下,世界模型通常包含两个核心组件:编码器(Encoder)负责将高维的观测(如图像)压缩为低维的状态表示;动力学模型(Dynamics Model)则负责预测在给定动作下状态的转移。Dreamer系列算法是世界模型方法的典型代表,它通过在学习到的潜在空间中进行规划,实现了样本效率的显著提升。

2.2 因果推理的引入

传统的世界模型主要关注统计相关性,即"在什么状态下采取什么动作会导致什么结果"。然而,这种基于相关性的模型在面对分布外(Out-of-Distribution)场景时往往表现不佳。因果推理(Causal Reasoning)的引入,旨在让模型理解变量之间的因果关系,而不仅仅是统计关联。

中科院自动化所的研究团队提出了可解释强化学习的新框架,通过学习因果世界模型,在不了解环境因果结构的情况下,捕捉行为的影响并通过因果链解释行为的长期影响。这种方法的核心优势在于:当环境发生变化时,因果模型能够更好地进行泛化,因为它理解的是底层的因果机制,而非表面的统计规律。

因果世界模型的学习涉及几个关键问题:如何从观测数据中识别因果结构?如何在强化学习的框架下表示和利用因果知识?如何处理因果发现中的不确定性?这些问题构成了当前研究的热点。

2.3 研究进展与挑战

2024年至2025年间,世界模型与因果推理领域取得了显著进展。COMET(Causal Object-centric Model Extraction Tool)算法的提出,为学习精确可解释的因果世界模型提供了新思路。该方法首先从观察中提取对象中心的状态描述,然后识别与对象交互相关的因果机制。

然而,这一方向仍面临诸多挑战。首先是可扩展性问题:当前的因果世界模型大多在相对简单的环境中验证,如何将其扩展到高维、复杂的真实世界场景仍是开放问题。其次是因果发现的计算复杂度:从观测数据中识别因果结构通常需要大量的样本和计算资源。最后是因果表示与决策的融合:如何将学习到的因果知识有效地整合到决策过程中,仍需要更深入的理论研究。

3. 层级强化学习与抽象

3.1 层级结构的必要性

人类认知的一个显著特征是具有层级结构。当我们规划一次旅行时,我们不会一次性考虑每一个具体的动作(如"抬起左脚"“放下左脚”),而是在多个抽象层次上进行思考:首先决定目的地,然后选择交通方式,最后才考虑具体的行程安排。这种层级抽象能力使我们能够处理极其复杂的任务。

层级强化学习(Hierarchical Reinforcement Learning, HRL)正是试图赋予智能体这种能力。在HRL框架中,策略被组织成多个层次:高层策略负责制定抽象的目标或子任务,低层策略则负责实现这些子任务的具体动作。这种结构不仅提高了学习效率,还增强了策略的可解释性和可迁移性。

3.2 选项框架与分层架构

选项(Options)框架是层级强化学习中最具影响力的理论框架之一。在选项框架中,一个选项由三个要素定义:启动条件(什么状态下可以启动该选项)、内部策略(选项执行期间的动作选择)、终止条件(什么状态下选项结束)。这种定义方式将原始动作和抽象动作统一在同一个框架下,为层级策略的学习提供了理论基础。

DeepMind的AlphaFold 3通过分层强化学习框架,将蛋白质结构预测精度提升到了新的高度。这一成功案例充分展示了层级方法在复杂科学问题中的潜力。在机器人领域,层级强化学习被用于学习复杂的操作技能:高层策略决定"抓取物体""移动到目标位置"等子任务,低层策略则控制具体的关节运动。

3.3 自动抽象发现

层级强化学习的一个核心挑战是如何自动发现合适的抽象层次。早期的HRL方法通常需要人工预定义选项或子任务,这限制了方法的通用性。近年来,研究者提出了多种自动抽象发现的方法。

一种思路是基于状态空间的聚类,将相似的状态归为同一个抽象状态。另一种思路是基于因果边界的识别,将因果机制发生变化的边界作为抽象的切分点。还有研究者提出了基于信息瓶颈(Information Bottleneck)的方法,学习压缩的状态表示同时保留决策所需的关键信息。

层级强化学习与因果推理的结合是一个值得关注的新方向。通过识别环境中的因果结构,可以更自然地划分抽象层次:将具有紧密因果联系的变量归为同一层次,将因果边界作为层次间的接口。

4. 元学习与快速适应

4.1 元学习的核心思想

元学习(Meta-Learning),又称"学会学习"(Learning to Learn),旨在让智能体从多个相关任务中学习一个通用的学习策略,从而能够在面对新任务时快速适应。这与人类的学习方式高度相似:我们从小学习了大量不同的问题,这些经验使我们能够在面对新问题时迅速找到解决思路。

在强化学习的语境下,元强化学习(Meta-Reinforcement Learning, Meta-RL)的目标是训练一个智能体,使其能够在少量交互后就在新任务上达到较好的性能。这与传统强化学习形成鲜明对比:传统RL通常需要大量样本才能学会一个任务,而Meta-RL追求的是跨任务的快速迁移能力。

DeepMind在Nature上发表的研究利用元强化学习来解释人类大脑的快速学习原理,这一工作不仅在AI领域引起轰动,也为神经科学提供了新的理论视角。研究表明,基于多巴胺的反馈奖励系统与元学习机制可能存在深刻的联系。

4.2 MAML与基于梯度的元学习

模型无关元学习(Model-Agnostic Meta-Learning, MAML)是元学习领域最具影响力的算法之一。MAML的核心思想是通过元训练过程,学习一个良好的参数初始化,使得基于这个初始化的少量梯度更新就能在新任务上取得好的效果。

MAML的优势在于其模型无关性:它可以应用于任何基于梯度下降的模型,包括神经网络策略。在强化学习中,MAML被用于训练能够快速适应新环境的策略。例如,在机器人控制中,MAML可以让机器人快速适应不同的地形或负载条件。

基于循环网络的元学习是另一种重要范式。这类方法使用循环神经网络(如LSTM)作为策略网络,将学习历史编码在网络的隐状态中。通过在不同任务上的训练,网络学会了如何根据交互历史快速调整行为。这种方法的优势在于不需要显式的梯度更新,适应过程完全由网络前向传播完成。

4.3 元学习的应用前景

元强化学习在多个领域展现出广阔的应用前景。在机器人领域,元学习使机器人能够快速适应新的物体、新的环境条件或新的任务目标。在个性化推荐系统中,元学习可以帮助模型快速适应新用户的偏好。在药物发现中,元学习可以加速针对新靶点的分子设计过程。

神经符号AI与元学习的结合是一个新兴的研究方向。通过将符号知识融入元学习框架,可以实现更高效的任务表征和更快速的适应。例如,利用领域知识构建任务的结构化描述,可以帮助元学习器更好地识别任务间的相似性。

5. 神经符号AI与RL结合

5.1 神经符号融合的背景

深度学习在感知任务上取得了巨大成功,但在推理和解释性方面仍存在明显局限。符号AI虽然在推理能力上表现优异,却难以处理 noisy 的真实世界数据。神经符号AI(Neuro-Symbolic AI)的兴起,正是为了结合两者的优势:利用神经网络处理感知和模式识别,利用符号系统进行逻辑推理和知识表示。

在强化学习的语境下,神经符号融合具有特殊的意义。传统深度RL策略通常是黑盒的,难以理解和调试。而神经符号方法可以产生更可解释的策略:策略的某些部分由神经网络实现(如感知和模式匹配),某些部分由符号规则实现(如高层决策逻辑)。

5.2 神经符号RL的框架

神经符号强化学习有多种实现方式。一种方式是将符号知识作为约束融入神经网络的学习过程。例如,利用逻辑规则定义合法动作空间,或者利用因果知识指导状态表示的学习。另一种方式是采用混合架构:神经网络负责从原始观测中提取特征,符号系统负责基于这些特征进行推理和决策。

神经符号方法在需要强安全约束的场景中尤为重要。在自动驾驶中,某些行为(如闯红灯)必须被严格禁止,这种约束用符号规则表达比用神经网络学习更加直接和可靠。在金融交易中,合规性要求往往可以用符号化的规则描述,将这些规则与基于学习的策略结合,可以在追求收益的同时确保合规。

5.3 可解释性与安全性

神经符号RL的一个重要优势是提高了可解释性。当智能体做出决策时,我们不仅可以知道它选择了什么动作,还可以理解它为什么做出这个选择——是因为符号规则的要求,还是基于神经网络的预测?这种可解释性在安全关键应用中至关重要。

从小样本学习到动态知识演进,神经符号AI正在不断发展。当前系统仍需要一定规模的标注数据与知识构建成本,未来发展趋势包括通过迁移学习与元学习降低对标注数据的依赖,以及实现系统的动态知识更新能力。

6. 量子强化学习

6.1 量子计算与机器学习的交汇

量子计算利用量子力学的叠加和纠缠特性,在某些计算问题上具有潜在的指数级加速能力。量子机器学习(Quantum Machine Learning, QML)探索如何将量子计算的优势应用于机器学习任务。量子强化学习(Quantum Reinforcement Learning, QRL)作为QML的一个重要分支,试图结合量子计算的优势与强化学习的强大决策能力。

量子强化学习的动机来自于多个方面。首先,许多强化学习算法涉及高维空间的搜索和优化,量子计算在这些问题上可能提供加速。其次,量子系统本身可以作为环境,研究量子控制问题需要专门的强化学习方法。最后,量子强化学习可能揭示学习和决策的物理本质。

6.2 量子RL的基本框架

量子强化学习有多种实现范式。在量子-经典混合框架中,策略或价值函数由参数化量子电路(Parameterized Quantum Circuit, PQC)表示,参数的更新通过经典优化算法完成。这种方法可以利用当前的含噪声中等规模量子(NISQ)设备。

另一种范式是完全量子的强化学习,其中智能体和环境都是量子系统。这种设置在理论上具有独特的性质,例如量子智能体可以利用量子叠加同时探索多个动作。然而,完全量子的RL在实验实现上仍面临巨大挑战。

2024年至2025年间,量子强化学习领域取得了多项进展。HSBC量子团队发表了关于波动市场中动态对冲的量子强化学习研究,展示了量子方法在金融领域的应用潜力。在复杂网络分析中,量子深度强化学习被用于识别关键节点,量子方法能够更早识别风险积累。

6.3 挑战与未来方向

量子强化学习仍面临诸多挑战。首先是硬件限制:当前的量子设备噪声较高、量子比特数量有限,难以运行复杂的量子算法。其次是理论理解:量子强化学习的理论基础尚不完善,许多基本问题(如量子策略的收敛性、样本复杂度)仍待研究。

尽管存在挑战,量子强化学习代表着AI与量子物理交叉的前沿方向。随着量子硬件的成熟和理论的深入,这一领域有望在未来十年取得突破性进展。

7. 研究趋势与开放问题

7.1 2024-2025年研究趋势

综合以上分析,我们可以识别出2024-2025年强化学习领域的几个主要研究趋势:

第一,世界模型与因果推理的深度融合。研究者越来越认识到,纯粹基于统计相关性的模型难以应对复杂多变的真实世界,因果推理为世界模型提供了更强的泛化能力和可解释性。

第二,大模型与强化学习的结合。随着大语言模型(LLM)的发展,将LLM作为世界模型或策略网络的组成部分成为新的研究热点。LLM的常识推理能力可以弥补传统RL在知识利用方面的不足。

第三,离线强化学习的实用化。随着数据驱动方法的重要性日益凸显,如何有效利用历史数据进行决策成为工业界关注的焦点。离线RL的理论和算法正在快速成熟。

第四,多智能体系统的扩展。从双人博弈到大规模群体智能,多智能体强化学习正在向更复杂的场景扩展,涉及通信、协作、竞争等多个维度。

第五,跨模态强化学习。智能体需要同时处理视觉、语言、触觉等多种模态的信息,跨模态表示学习和决策成为重要研究方向。

7.2 核心开放问题

尽管强化学习取得了长足进步,以下核心问题仍待解决:

样本效率问题:如何在更少的交互中学会复杂任务?这是限制RL在真实世界应用的主要瓶颈。

泛化与迁移问题:如何让学到的策略在新环境、新任务中表现良好?当前方法的泛化能力仍显不足。

安全性与鲁棒性问题:如何保证RL系统在异常情况下的安全行为?这是部署RL系统的关键前提。

可解释性问题:如何理解和解释RL策略的决策过程?这对于高风险应用尤为重要。

价值对齐问题:如何确保RL系统的目标与人类意图一致?随着AI系统能力的增强,这一问题愈发重要。

8. 系列总结与学习路径

8.1 本系列内容回顾

回顾本系列十八讲的内容,我们构建了一个从基础到前沿的完整知识体系:

基础篇(第1-4讲)奠定了强化学习的理论基础,包括马尔可夫决策过程、贝尔曼方程、蒙特卡洛方法、时序差分学习和函数逼近。这些是理解所有后续内容的基石。

深度RL篇(第5-9讲)介绍了深度强化学习的核心算法,包括DQN及其改进、策略梯度方法、PPO、SAC、TD3等。这些算法是当前工业应用的主流选择。

模型与规划篇(第10-12讲)探讨了基于模型的方法,包括Dyna架构、世界模型和MuZero。这些方法代表了样本效率的前沿。

高级主题篇(第13-17讲)覆盖了多智能体系统、离线强化学习、模仿学习、迁移学习等重要扩展方向。

前沿展望篇(第18讲)则带领读者眺望强化学习的未来发展方向。

8.2 后续学习建议

对于希望深入学术研究的读者,建议按以下路径继续学习:

第一步,精读经典论文。建议从以下论文开始:DQN(Nature 2015)、A3C(ICML 2016)、PPO(arXiv 2017)、SAC(ICML 2018)、Dreamer(ICLR 2020)、MuZero(Nature 2020)。这些论文定义了领域的发展脉络。

第二步,关注顶级会议。NeurIPS、ICML、ICLR是强化学习研究的主要发表平台,建议定期浏览这些会议的最新论文。

第三步,动手实现。尝试从零开始实现经典算法,这是理解算法细节的最佳方式。建议从简单的环境(如CartPole)开始,逐步挑战更复杂的问题。

对于希望应用于工业实践的读者,建议关注以下方向:

第一,掌握主流框架。熟练使用Stable-Baselines3、RLlib、Tianshou等开源库,这些库提供了经过优化的算法实现。

第二,重视系统工程。强化学习的成功部署不仅取决于算法,还涉及环境设计、奖励工程、监控调试等多个环节。

第三,关注领域应用。强化学习在游戏、机器人、推荐系统、金融交易、自动驾驶等领域都有广泛应用,选择一个感兴趣的领域深入研究。

8.3 推荐论文清单

以下论文清单按主题分类,供读者深入学习参考:

世界模型与因果推理:

- Ha and Schmidhuber, “World Models”, NeurIPS 2018

- Hafner et al., “Dreamer: Deep Reinforcement Learning for World Models”, ICLR 2020

- Hafner et al., “Mastering Diverse Domains through World Models”, 2023

- 中科院自动化所关于因果世界模型的最新工作

层级强化学习:

- Sutton et al., “Between MDPs and Semi-MDPs: A Framework for Temporal Abstraction”, 1999

- Bacon et al., “The Option-Critic Architecture”, AAAI 2017

- Nachum et al., “Data-Efficient Hierarchical Reinforcement Learning”, NeurIPS 2018

元强化学习:

- Finn et al., “Model-Agnostic Meta-Learning for Fast Adaptation”, ICML 2017

- Duan et al., “RL^2: Fast Reinforcement Learning via Slow Reinforcement Learning”, 2016

- Botvinick et al., “Reinforcement Learning, Fast and Slow”, Trends in Cognitive Sciences 2019

神经符号AI:

- Garcez and Lamb, “Neurosymbolic AI: The 3rd Wave”, 2020

- 相关领域综述论文

量子强化学习:

- Dong et al., “Quantum Reinforcement Learning”, IEEE Transactions on Systems, Man, and Cybernetics 2008

- 近期关于量子深度强化学习的应用论文

9. 结语

强化学习作为人工智能的核心支柱之一,正在经历前所未有的发展机遇。从DeepMind的AlphaGo到OpenAI的Dota 2 AI,从波士顿动力的机器人到特斯拉的自动驾驶系统,强化学习的应用边界正在不断扩展。

然而,我们必须清醒地认识到,当前的强化学习技术仍远未达到人类水平的学习和适应能力。样本效率低下、泛化能力不足、安全性难以保证等问题仍然制约着技术的广泛应用。世界模型、因果推理、元学习、神经符号融合、量子计算等前沿方向,正是为了突破这些局限而诞生的。

作为本系列的读者,你已经建立了扎实的强化学习基础。未来的路还很长,但每一步探索都将为这个激动人心的领域贡献新的力量。无论你是选择深入学术研究,还是投身工业应用,强化学习都将为你提供广阔的舞台。

让我们共同期待强化学习的下一个十年,期待智能体真正学会像人类一样思考、规划和行动的那一天。

如果本系列文章对你有所帮助,欢迎点赞、收藏、评论交流。你的支持是我持续创作的动力!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献47条内容

已为社区贡献47条内容

所有评论(0)