107-agent调研

SKILL:空函数,包括description、适用场景(当用户说“帮我写周报”或“生成本周周报”时触发。)、输入要求、输出要求

您的输入:

“这是我的工作日志和项目进展,请调用‘weekly-report-generator’生成一份周报。”

AI的输出:

一份格式规范、内容全面的周报草稿,您只需稍作修改即可提交

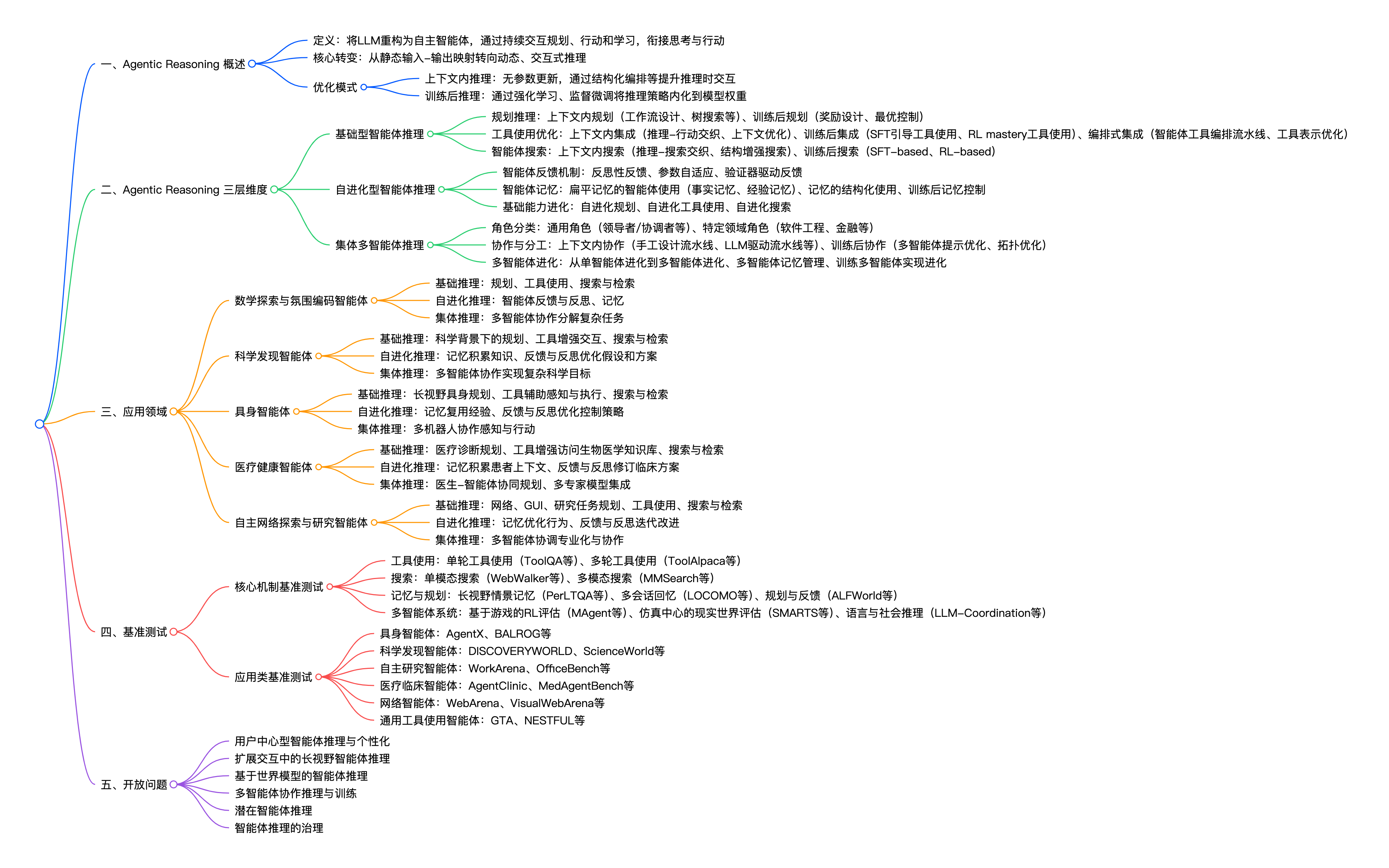

摘要

分析推理 是 解题和决策背后的一种基本认知过程。

尽管大型语言模型(LLM)在封闭世界环境中展现出强大的推理能力,例如数学和代码,

但在开放性和动态环境中,它们却表现不佳。

首先,我们通过三个层次表征环境动态:

基础agent:建立了核心的单智能体能力,包括规划、工具使用和搜索,这些能力适用于稳定环境;

自我进化型agent:研究智能体如何通过反馈、记忆和适应,在不断变化的环境中优化自身能力;

集体agent:则将智能扩展到协作场景,多个智能体协同分工、共享知识并共同实现目标。

1.简介

经验表明,显式化中间推理的技术,如思维链提示、分解以及程序辅助求解,显著提升了推理性能。

2. 从大语言模型推理到agent推理

3. 基础代理推理

代理推理源于单个智能体的行为。在讨论适应与协作之前,我们先聚焦于单个智能体如何通过三个

核心组件将推理转化为结构化行动:规划、搜索,以及工具使用。在这种设定中,智能体并非被动

的文本生成器,而是一个自主的问题解决者:它制定计划,通过检索或环境搜索探索备选方案,并

借助工具执行有据可依的操作。这些机制共同构成了代理推理的基础,将抽象的深思熟虑与可验证

的行动紧密相连。

一个规范的基础工作流可以看作是一个迭代周期,该周期交错进行规划(目标分解与任务

制定)、工具使用(调用外部系统或API以作用于世界)和 搜索(检索与探索以支持决

策)。推理是贯穿这些阶段的组织原则,它决定何时规划、检索什么以及如何行动,从而

将静态推理转化为交互式决策。

通过分析这些组件,我们阐明了结构化推理如何将一个静态的LLM提升为一个自主的、目标驱动的智能体。

3.1. 规划推理

规划是智能行为的核心组成部分,它使智能体能够分解问题、对决策进行排序,并以前瞻

性的方式在复杂环境中导航。最近越来越多的的研究涉及到探索大型语言模型的规划能力。

无论是作为自主智能体,还是作为更广泛系统中的组件。

在本节中,我们将现有用于智能体规划推理的工作分为六种方法论风格,每种类别都突出了

支持复杂智能体推理的独特规划策略。

3.1.1 规划(非微调)

工作流设计

工作流的使用过程拆解为以下几个具体场景的例子:

1. 通用任务处理:计划与行动(Plan-and-Act)

这是最基础的工作流模式。系统不会直接给出答案,而是将任务分解为不同阶段:

-

感知(Perception): 代理首先分析用户的原始指令(例如:“帮我分析这两家公司的财报并对比风险”)。

-

规划(Reasoning/Planning): 代理生成一个子任务列表:1. 下载 A 公司财报;2. 下载 B 公司财报;3. 提取关键财务指标;4. 进行对比分析 (p. 11)。

-

执行(Execution): 代理调用搜索工具或 PDF 解析工具。

-

验证(Verification): 代理检查提取的数据是否准确,若发现缺失,则返回执行阶段重试。

2. 网络自动化:观察-推理-行动循环

在网页操作(如自动订票)中,工作流表现为一种反应式控制器(Reactive Controller)的闭环过程:

-

观察(Inspect): 代理“查看”当前的网页 DOM 结构或截图。

-

推理(Reason): 基于当前页面(如:正在登录界面),决定下一步操作(如:输入密码)。

-

行动(Act): 点击按钮或输入文本 (p. 11)。

-

适应(Observe/Adapt): 观察点击后的新页面。如果弹出了验证码,工作流会动态调整示例(In-context examples),进入处理验证码的特殊子流程 (p. 11)。

3. 代码开发:递归分解与测试

在处理复杂的编程任务时,工作流通常是层次化的:

-

分解: 将一个大型项目需求(如:写一个博客系统)递归地分解为可编译、可编辑的微小单元(如:数据库连接模块、用户登录接口) (p. 12)。

-

循环: 代理决定立即执行某段代码,读取输出或错误日志。

-

细化: 如果代码报错,工作流会引导代理进入“自我修复”阶段,根据错误信息逐步改进代码 (p. 11)。

4. 机器人控制:实时干预

在物理环境或机器人操作中,工作流强调安全与实时调整:

-

监控: 工作流中包含专门的监控器(Monitors)。

-

干预: 如果机器人即将撞到障碍物,监控器会触发即时的安全干预措施,动态调整原本的路径子目标 (p. 11)。

这种方法具有广泛的适用性,但长期运行时可能会累积误差,因此需要在工作流中引入增量验证和记忆机制,以稳定执行过程。

树搜索

1. Tree Search (树搜索) —— “推演所有可能的后果”

论文核心:树搜索让 AI 在遇到困难决策时,像下围棋一样,在脑子里把各种可能性都“推演”一遍。

-

例子:解一道复杂的奥数题

-

根节点: 题目本身。

-

分支(子路径):

-

路径 A:尝试用代数法。推演两步发现计算量太大,回溯(Backtrack)。

-

路径 B:尝试用几何法。推演三步发现辅助线画对了,但公式记不清,剪枝(Pruning,放弃这条路)。

-

路径 C:尝试分类讨论。发现逻辑通顺,继续向下探索。

-

-

评估: AI 会给每条路径打分,最后选出得分最高(成功概率最大)的那条路作为最终答案。

-

经典算法: 文中提到的 ToT (Tree of Thoughts) 就是这个逻辑——让 AI 像玩剧本杀一样,在多个平行时空里试错[可以早停],最后选最优解。

-

2. Algorithm Simulation (算法模拟) —— “给自己写一套标准操作流程”

论文核心: 面对极高难度的任务,直接猜答案容易错。AI借助代码获得可靠的答案。

-

例子:帮你在 100 封邮件里找出“包含离职意向且情绪最激烈”的那一封

-

模拟过程:

-

定义算法: AI 告诉自己:“我现在要执行一个‘最大值查找算法’。我会维护一个变量

Max_Intensity。” -

模拟迭代:

-

读取第 1 封邮件,打分 50,记录为当前最强。

-

读取第 2 封邮件,打分 30,忽略。

-

读取第 3 封邮件,发现是“我要辞职,给老子爬!”,打分 99,更新

Max_Intensity。

-

-

最终输出: 模拟完所有步骤后,输出结果。

-

-

为什么这么做? 因为直接让 AI “找最激烈的”,它可能会漏看。但如果强迫它按照一个确定的算法逻辑(比如排序或筛选算法)去“跑一遍”,准确率会大幅提升。

-

两者的区别:

-

Tree Search 侧重于“探索”:在不知道路在哪时,多试几条路,看哪条能通。

-

Algorithm Simulation 侧重于“严谨”:已经知道逻辑框架了,通过像计算机一样一步步执行代码逻辑,来避免低级逻辑错误

过程形式化(Process Formalization)--- 紧箍咒

这个词听起来吓人,其实就是“把大白话翻译成数学公式或代码”。

Process Formalization(过程形式化) 的核心逻辑是:如果把生成任务变成一种严格的逻辑推导,AI 就不容易出错。

例子:法律条文判定(逻辑化)

-

模糊描述: “如果张三偷了东西且情节严重,就该判刑。”

-

过程形式化:

-

将法律逻辑转化为 IF-THEN 语句:

-

IF (Action == "Theft") AND (Value > 5000 OR Method == "Violence") -

THEN (Verdict = "Guilty")

-

-

论文意义: 这样 AI 就像运行一段程序一样去判定,而不是靠直觉猜。

-

总结:为什么要“形式化”?

论文里之所以强调这个,是因为 AI 容易“一本正经地胡说八道”。

Process Formalization 就像是给 AI 戴上了一个“逻辑紧箍咒”:

-

输入: 混乱的现实需求。

-

过程: 转化成逻辑符号、状态方程或编程代码。

-

输出: 严丝合缝、可被验证的结论。

一句话总结: 它就是把“凭感觉办事”变成了“按公式推导”。

解耦 / 分解(Decoupling / Decomposition)

1. Decomposition (分解) —— “大事化小”

论文核心: 把一个复杂的、AI 无法一步完成的长任务,拆成若干个简单的小任务。

-

例子:办婚礼

-

大任务: “下个月办一场完美的婚礼。”(AI 听了会宕机,不知道从哪开始)

-

Decomposition 之后:

-

确定酒店和档期。

-

订婚纱和西装。

-

发请柬。

-

安排酒席菜单。

-

-

逻辑: 每一个小任务(如“发请柬”)都是 AI 可以立即执行的。搞定了所有小任务,大任务自然就完成了。

-

2. Decoupling (解耦) —— “各司其职,互不干扰”

论文核心: 把任务的不同属性(比如“逻辑推理”和“工具使用”)分开处理,不让它们混在一起。

-

例子:婚礼上的“新郎”与“婚庆公司”

-

耦合状态(Coupled): 新郎又要陪客人,又要去后厨催菜,还要调音响。一旦音响坏了,新郎去修,客人就没人陪了。整个系统会因为一个环节出错而瘫痪。

-

解耦状态(Decoupled):

-

决策层(新郎): 只负责发指令(“现在开始仪式”)。

-

执行层(婚庆公司): 负责具体干活(“放音乐”、“上菜”)。

-

-

优势: 哪怕音响坏了,也是婚庆公司的修理工去弄,不影响新郎继续陪客。

-

AI 论文里的意思: 把 “想出计划” 的脑子和 “去搜网页/调 API” 的手分开。想计划的只管想,干活的只管干,这样哪怕搜网页搜错了,也不会把 AI 的逻辑带坑里去。

-

为什么论文要提这两个?

因为现在的 AI 还没强到能“一眼看穿全局”且“同时把所有细活干好”。通过 Decomposition 把它变聪明(分步走),通过 Decoupling 把它变稳健(分工明确)。

注:解耦 / 分解也是大模型cover,大模型从直接回答变成先规划分工再执行。[实际上让大模型对齐人类的思维模型,一步一步的解构大模型的应答]

External Aid / Tool Use(外部援助/工具使用)

并充分利用外部资源来搭建或增强大语言模型的能力。

3.1.2. 规划-后训练

它不像预训练(Pre-training)那样去背海量书本,而是像让一个已经成年的大学生去参加“逻辑思维集训营”。

论文里这个部分通常包含两个核心路径:

1. 强化学习(Reinforcement Learning, RL)

例子:教 AI 玩数独或走迷宫

-

做法: 模型每走一步(比如在数独里填个数字),环境会给它一个反馈(对或错)。

-

过程: 通过大量的这种“试错-奖励”循环,AI 慢慢学会了:“噢,我不能只看眼前这格填什么,我得先规划好整行和整列的布局。”

-

本质: 模型虽然参数没大变,但在处理任务时,它学会了“先想后做”以获取更高分。

2. 蒸馏与微调(Distillation / Fine-tuning)

例子:学霸的草稿纸

-

做法: 拿一个超级聪明的模型(比如 GPT-4),让它把解题的每一个思考步骤(思考路径 A -> 路径 B -> 纠错 -> 结论)全部写下来。

-

过程: 把这些高质量的“思考过程”喂给一个稍微笨一点的模型。

-

本质: 这个模型没学到新知识,但它学会了学霸“拆解问题和规划步骤”的套路。

3.2 工具调用优化(Tool-Use Optimization)

工具使用优化是指智能体通过智能调用外部模块来增强其内在能力的能力。这使得智能体能够克

服诸如知识过时、无法进行精确计算或无法访问私有信息等局限性。核心挑战在于智能体如何推

理何时使用工具、从库中选择哪个工具,以及如何生成有效的调用。在本节中,我们探讨了现有

的工具使用优化方法,这些方法大致可分为三种风格: 在上下文中集成工具、训练后集成工具,

以及 基于编排的工具集成。

3.2.1. 上下文工具集成(In-Context Tool-integration)

推理与工具使用的交织-Interleaving Reasoning and Tool Use

这个术语听起来很高级,其实用大白话讲就是:“别一口气想完,边想边干,边干边修。”

Interleaving 的意思是“交替”或“交织”。在 3.2.1 章节中,它描述的是一种“推理(Reasoning)”与“调用工具(Tool Use)”循环往复的状态。

我们可以用“去陌生城市找一家网红餐厅”来对比两种模式:

1. 非交替模式 (Plan-then-Act)

-

做法: 你在家里查好所有地图,写下:出门左转-坐3路车-下车走500米。然后把手机关了,死板地按这个计划走。

-

风险: 万一3路车停运了,你就彻底抓瞎了,因为你已经停止“推理”了。

2. 交替模式 (Interleaving Reasoning and Tool Use) —— 论文推荐的模式

这就是 Interleaving。大模型不再是一次性给个大计划,而是:

-

推理: “我要去餐厅,首先得查查怎么坐车。”

-

工具: 调用【地图APP】,搜索路线。

-

反馈: 地图显示“3路车已停运,建议坐地铁”。

-

推理(根据反馈调整): “既然公交没了,那我现在得找最近的地铁站。”

-

工具: 调用【地图APP】,搜“最近地铁站”。

-

循环: 依此类推,直到走到餐厅门口。

论文中提到的核心意义:

A. 解决“幻觉”和“信息滞后”

大模型脑子里的知识是死的(训练数据),而工具(如搜索、API)获取的信息是活的。

-

交替使用让模型能用工具获取的实时事实,来纠正自己推理中的偏差。

B. 动态规划 (Dynamic Adjustment)

很多复杂任务在开始前是没法完全预测的(比如写代码,不运行一下谁知道哪里会报错)。

-

Interleaving 允许模型:想一小步 -> 运行一下(工具) -> 看结果 -> 再想下一步。

C. 典型代表:ReAct 框架

论文这一节一定会提到 ReAct (Reason + Act)。它的模版非常经典:

-

Thought(想): 我现在需要知道什么?

-

Action(做): 去搜一下/算一下。

-

Observation(看): 得到结果了,这个结果说明了什么?

-

Thought(再想): 基于刚才看到的结果,我下一步该干嘛?

总结:

Interleaving Reasoning and Tool Use 就是把 AI 变成一个“拿着手机(工具)边看导航边找路(推理)的人”,而不是一个“背下地图后闭着眼瞎走的人”。

这种“思考与行动深度耦合”的状态,是目前 Agent(智能体)能够处理现实复杂问题的关键。

优化工具交互的上下文-Optimizing Context for Tool Interaction

这个部分其实就是给 AI 准备一本“极简版工具操作指南”。

如果说 Interleaving 是教 AI “边想边干”,那 Optimizing Context(优化上下文)就是解决一个尴尬的问题:给 AI 的参考资料太多、太乱了,导致它看花了眼,最后把事情搞砸。

我们可以用“给大厨准备调料架”来做类比:

1. 为什么要“优化”?(痛点)

想象你要让 AI 炒菜(用工具),你把整个超市的调料(成千上万个 API 文档)都搬到它面前。

-

后果: AI 找个盐都要找半天(消耗大量 Token,巨贵);或者它看着满目琳琅的瓶子,随手拿了一瓶“洁厕灵”当白醋(误用工具)。

-

论文核心: 为了让 AI 用得准、用得省,我们得把这些“上下文”精简和包装一下。

2. 优化的三个常见招数:

A. 筛选(Retrieval-based Selection)—— “只拿要用的”

-

做法: 别把几百个 API 全部塞给 AI。

-

例子: AI 要订机票,你就只把“查航班”、“订座位”的说明书给它。至于“查天气”或“查食谱”的文档,通通藏起来。

-

目的: 减少干扰,让 AI 聚焦。

B. 压缩与精炼(Summarization / Formatting)—— “说人话,划重点”

-

做法: 很多 API 文档又臭又长(几百行 JSON 代码)。优化后的上下文会把它精简成:

功能:订票;参数:日期、地点。 -

例子: 就像给大厨的调料瓶贴上大大的“盐”、“糖”标签,而不是让他去读《氯化钠生产工艺说明书》。

-

目的: 节省 Token 空间,让模型一眼看明白。

C. 演示(Few-shot Demonstrations)—— “做个示范看看”

-

做法: 别光给说明书,给它看一两个“别人是怎么用这个工具”的例子。

-

例子: 告诉 AI:“看,上次有人想订票,他是先搜航班号,再填身份证的。你也学着点。”

-

目的: 通过 In-context Learning 降低 AI 犯错的概率。

3. 为什么论文专门提这个?

在 3.2.1 节里,模型要频繁地在“想”和“用工具”之间切换。

-

如果上下文(Context)太重,模型切换一次就得读半天文档,逻辑容易断掉。

-

如果上下文太脏(有干扰),模型可能在推理时被错误的文档信息误导。

总结:

Optimizing Context for Tool Interaction 就是:

-

扔掉没用的说明书。

-

简化复杂的参数描述。

-

加上几个好榜样示例。

一句话总结: 就是为了让 AI 在用工具时,手边只有最干净、最精准的“操作手册”,从此不再“乱花渐欲迷人眼”。[1, 2]

3.2.2. 工具集成后训练-Post-training Tool-integration

Bootstrapping of Tool Use via SFT-通过SFT引导工具使用

这个术语听起来像是在“提着靴子把自己拔起来”,其实它的核心意思就是:“给 AI 喂点‘教科书级’的正确范例,让它学会怎么用工具。”

我们用“教新手厨师用洗碗机”来类比:

1. 为什么要 Bootstrapping(引导/自举)?

大模型刚出厂时,虽然读过很多书,但它可能没见过具体的工具(比如你们公司的内部数据库)怎么用。如果你直接让它用,它会乱按按钮。

SFT (Supervised Fine-Tuning, 有监督微调) 就是:找个高手,把正确的使用过程写下来,让 AI 背。

2. 这个过程是怎么操作的?(分三步走)

第一步:造“教科书”(Data Collection)

-

做法: 既然 AI 不会,我们就人工(或者用更强的模型,比如 GPT-4)写出一堆“标准答案”。

-

例子:

-

问题: “查一下北京明天的天气。”

-

标准过程:

-

【思考】:我需要查天气,得用

get_weather工具。 -

【动作】:调用

get_weather(city="Beijing")。 -

【观察】:工具返回“晴天,25度”。

-

【结论】:北京明天晴天,25度。

-

-

-

重点: 这套“思考+动作+结果”的完整路径,就是 SFT 的训练素材。

第二步:喂“教科书”(Fine-Tuning)

-

做法: 把成千上万条这种“标准过程”喂给模型。

-

本质: 告诉模型:“看好了,以后遇到这种事,你就按这个格式和逻辑来干活!”

第三步:自举(Bootstrapping)

-

做法: 当模型学会了一点皮毛后,让它自己去试着写更多的例子。

-

循环:

-

模型写出 100 个例子。

-

我们把写得烂的扔掉,把写得好的(正确的)留下来。

-

把这批“自己产的高质量作业”再喂给自己。

-

-

效果: 就像学生通过做对了几道题,突然领悟了方法,越做越顺手。

3. 为什么论文要强调这个?

因为单纯靠 In-context(在对话里教)太占空间且不稳定。

-

通过 SFT,这种“工具使用能力”就刻进了 AI 的基因(权重)里。

-

它不需要你每次都提醒“请先思考再调工具”,它一张嘴就是专业范儿。

总结对比:

-

In-context Tool Use: 像是在考场上发了一张临时公式表(用完就忘)。

-

Bootstrapping via SFT: 像是让你在考前刷了 1000 道真题,把公式背得滚瓜烂熟(成了本能)。

一句话总结: Bootstrapping of Tool Use via SFT 就是通过“高质量范例喂养+自我进化”,让 AI 从“乱用工具的菜鸟”变成“懂规矩、按套路出牌的老司机”。

怎么知道模型自己写的100个例子,哪些是要扔掉的

这是一个非常核心的问题!既然要“自举(Bootstrapping)”,就必须保证喂进去的不是“垃圾”,否则模型会越学越废。

在论文和实际工程中,筛选这 100 个例子通常有以下四种“质检员”:

1. 结果判定员(Outcome-based Verification)——“看答案对不对”

这是最直接的方法。如果工具调用是针对有标准答案的任务(比如数学题、代码执行、数据库查询):

-

做法: 运行模型生成的工具代码。

-

判断: 如果代码报错了,或者算出来的结果(比如 1+1=3)和标准答案对不上,这个例子直接扔掉。

-

例子: 模型写了一个查询天气的 API 调用,结果返回了“404 Error”,说明它参数写错了,删掉。

2. 逻辑审计员(Model-as-a-Judge)——“让学霸改作业”

如果我们没有标准答案(比如写一段调研报告的规划),就请出更强的模型(比如 GPT-4o 或 Claude 3.5)来当裁判。

-

做法: 把模型写的“思考过程 + 工具调用”发给强模型。

-

判断: 问强模型:“这段操作逻辑通顺吗?工具用对了吗?有没有多余的废话?”

-

例子: 强模型说:“这步逻辑跳跃了,没搜公司名就直接去查财报了,不及格。”——扔掉。

3. 编译器/环境反馈(Runtime Execution)——“看能不能跑通”

对于编程或 API 调用类任务,环境是最好的老师。

-

做法: 把模型生成的工具指令直接丢进真实的沙盒(Sandbox)里跑。

-

判断:

-

语法错误? 扔。

-

死循环? 扔。

-

调用了不存在的函数? 扔。

-

-

结果: 只有那些“丝滑运行并拿到有效数据”的例子,才被留下来进修。

4. 轨迹一致性(Self-Consistency / Majority Voting)——“看大家是否都这么想”

这是一种“少数服从多数”的策略。

-

做法: 让模型对同一个问题写 5 次不同的计划和工具调用过程。

-

判断: 如果有 4 次都指向了同一个操作路径和结果,而剩下的 1 次南辕北辙,那么那 1 次大概率是瞎编的——扔掉。

-

逻辑: 这种方法假设“真理往往掌握在大多数(采样)手中”。

总结:论文里的“质检工作流”

通常是组合拳:

-

先跑一遍: 筛掉语法错误的(编译器过滤)。

-

看结果: 筛掉答案错的(结果验证)。

-

大模型评审: 筛掉逻辑绕弯子的(学霸打分)。

一句话总结: Bootstrapping 不是“照单全收”,而是“严选”。只有通过了环境测试和逻辑审计的“高分卷”,才能作为下一轮进化的教材。

Mastery of Tool Use via RL-通过强化学习掌握工具使用方法

这一部分其实是把 AI 从一个“死记硬背的学生”变成了“实战经验丰富的老司机”。

如果说前面的 SFT(有监督微调) 是让 AI 背诵正确答案,那么 RL(Reinforcement Learning,强化学习) 就是让 AI 去实战中撞南墙,通过疼不疼(奖励/惩罚)来领悟工具使用的最高境界。

我们可以用“教 AI 玩那种复杂的经营模拟游戏(比如开餐厅)”来类比:

1. 为什么要用 RL?(SFT 的瓶颈)

-

SFT 的问题: 老师(人工标注)给的答案不一定是最优的,而且老师没法把所有突发情况都写进教科书里。

-

RL 的核心: 不给标准答案,只给一个“计分板”。AI 随便试,只要最后得分高(任务完成了、查到了正确数据),就奖励它;如果把事情搞砸了,就扣分。

2. 这个“修炼”过程是怎么玩的?

A. 尝试与纠错(Trial and Error)

-

情景: AI 尝试帮用户买一张最便宜的机票。

-

动作: AI 第一次先查了“携程”,发现票价 1000 元。它犹豫了一下,没去比价就直接下单了。

-

反馈: 系统发现其实“去哪儿”只要 800 元,于是给 AI 打了 -10分(惩罚:你浪费了用户的钱)。

-

进化: 下次遇到类似任务,AI 会想起这个“痛”,主动多调一个比价工具。

B. 探索长链条决策(Long-horizon Planning)

有些工具使用不是一两步能搞定的,需要一连串动作。

-

例子: AI 要修一个复杂的代码 Bug。

-

步骤: 1. 跑测试用例 -> 2. 看报错日志 -> 3. 修改代码 -> 4. 重新编译。

-

RL 的作用: 只有当第 4 步成功通过测试时,AI 才能拿到那 +100分 的大奖。如果中间任何一步断了(比如改了代码忘了编译),它拿不到分。

-

领悟: AI 慢慢学会了:“为了最后的大奖,我必须严谨地执行完这一套动作组合。”

C. 拒绝与回溯(Self-Correction)

-

情景: AI 调用的 API 返回了“系统繁忙”。

-

普通 AI(SFT版): 可能就卡在那儿,或者一直重复报错。

-

专业 AI(RL版): 它知道重复报错会扣分。它会尝试:“换个 API 试试?” 或者 “等 5 秒再试?”

-

本质: 它在“毒打”中学会了灵活应变。

3. 论文里提到的两个关键概念:

-

Reward Function (奖励函数): 就像是游戏的计分规则。比如:任务完成 +10,Token 消耗过大 -1,调用工具出错 -5。

-

Exploration (探索): 鼓励 AI 别总是用老一套,偶尔试个新工具,万一效率更高呢?

4. 总结:SFT vs RL

-

SFT (Sufficient for basic): 像是在驾校练倒车入库。教练怎么教,你就怎么停。能应付考试,但上路遇到碰瓷的、加塞的就懵了。

-

RL (Mastery): 像是已经在市区开了三年的老司机。他知道什么时候该变道,什么时候该避让,哪怕没路标也能靠直觉找到目的地。

一句话总结: Mastery of Tool Use via RL 就是让 AI 在不断的“调工具-看结果-拿奖惩”的实战循环中,自己悟出一套最高效、最稳健的工具操作逻辑。

3.2.3. 基于编排的工具集成 Orchestration-based Tool-integration

用于工具编排的代理管道-Agentic Pipelines for Tool Orchestration

这一部分讲的是:当任务复杂到靠一个模型“大脑”已经转不过来时,我们需要把 AI 变成一套“标准工业流水线”。

Orchestration(编排) 这个词,就像交响乐指挥。模型不再是单打独斗,而是指挥一群“工具人”有序协作。

我们可以用“装修一套房子”来理解这三种典型的流水线模式:

1. 路由模式 (Routing) —— “专业分诊台”

场景: 装修公司门口有个接待员。

-

做法: 用户说“我想刷墙”,接待员(Router LLM)看了一眼,直接把它分给“油漆工模型”;用户说“水管漏了”,就分给“水电工模型”。

-

例子:

-

输入: “帮我查一下英伟达股价并写段分析代码。”

-

路由: 判定这是“金融+代码”任务,分发给专门接了【股票API】和【代码解释器】的子系统,而不是让一个通用的聊天机器人硬猜。

-

-

核心: 分流,让专业的模型干专业的事。

2. 规划-执行模式 (Plan-then-Execute) —— “工长和工人”

场景: 工长先画图纸,工人再进场。

-

做法:

-

Planner(工长): 坐在办公室里,把装修拆成:拆墙 -> 走线 -> 铺砖。

-

Executor(工人): 拿着清单,闭着头一张张单子干完。

-

-

例子:

-

任务: “对比 2023 和 2024 年的财报并生成图表。”

-

流水线:

-

第一步:搜索 23 年财报。

-

第二步:搜索 24 年财报。

-

第三步:数据对比。

-

第四步:画图。

-

-

优点: 动作极快,因为工人不需要边干边想,按表操课就行。 [1, 2]

-

3. 多智能体协作 (Multi-agent Collaboration) —— “项目周会”

场景: 设计师、木工、电工坐在一起开会,互相纠错。

-

做法: 一个模型负责调工具(Worker),另一个模型负责盯着它看有没有出错(Checker/Critic)。

-

例子:

-

Worker: “我调了 API,但返回了 403 错误。”

-

Critic: “那是你授权码没填对,重新调一遍。”

-

Manager: “别争了,时间快到了,Worker 换个备用 API 试试。”

-

-

核心: 通过互相监督,解决单个模型容易“钻牛角尖”或“犯低级错误”的问题。 [3]

4. 为什么要搞这些 Pipelines(流水线)?

论文里提到这个,是因为现在的工具太庞杂了(可能有几千个 API)。

-

如果不搞流水线: 就像让一个厨师一边在大厅点菜,一边在后厨杀鱼,还要去门口收钱,肯定会乱套。

-

搞了流水线: 任务被解耦(Decoupling)了。哪怕模型本身没那么聪明,只要流程(Pipeline)设计得好,也能像工业化生产一样,稳健地完成超复杂任务。

一句话总结:

Agentic Pipelines 就是把“一个人包圆”变成“一个流水线团队协作”,通过制度(流程)来补齐个体(模型)的短板。

用于编排的工具表示法-Tool Representations for Orchestration

简单来说,Tool Representations for Orchestration 解决的是一个沟通问题:如何把成千上万个复杂的工具(API、代码、插件),“翻译”成大模型最容易听懂、最不容易用错的形式?

如果说 Pipelines 是装修队的“组织架构”,那么 Tool Representations 就是给装修工人发的“工具使用说明书”。

为了让你秒懂,我们用“教一个外国名厨用中国的各种复杂厨具”来类比:

1. 为什么“表达形式(Representation)”很重要?

如果你直接把一个复杂的 API(比如查询银行接口)的原代码丢给 AI,它就像看到一堆乱码。

-

痛点: API 文档太长(费 Token)、参数太怪(AI 会填错)、功能太像(AI 会选错)。

-

论文核心: 我们得把工具包装成 AI 喜欢的样子。

2. 三种常见的“包装方式”:

A. 自然语言描述 (Natural Language Descriptions) —— “功能小贴士”

-

做法: 不给代码,只给一句话。

-

例子:

-

原始 API:

GET /v1/market/stock/quote?s=AAPL&t=json -

包装后: “工具名称:股票查询。用法:输入股票代码,我会告诉你现在的价格。注意:代码必须是大写字母。”

-

-

目的: 利用大模型强大的语义理解能力,让它像读小说一样明白工具是干嘛的。

B. 示例化表达 (Few-shot Exemplars) —— “看图说话”

-

做法: 别光说不练,给它看几个正确的调用例子。

-

例子:

-

“你想查苹果公司吗?那就这样写:

Search(Stock='AAPL')。” -

“你想查特斯拉吗?那就这样写:

Search(Stock='TSLA')。”

-

-

目的: AI 最擅长模仿(In-context Learning),给它看两个例子,它瞬间就知道参数该填什么格式了。

C. 层次化抽象 (Hierarchical Abstraction) —— “目录索引”

-

做法: 如果工具有 1000 个,别一次性全摊在桌上。先给它看大类。

-

例子:

-

第一层: 你是要“查资料”、“算数学”还是“发邮件”?

-

第二层(选了发邮件后): 你是要“写草稿”、“点发送”还是“删邮件”?

-

-

目的: 防止工具太多导致 AI “选择困难症”,通过分级分类,减小它的脑力负担。

3. 论文中提到的进阶招数:工具的“身份证” (Standardized Schemas)

为了让大模型在不同的流水线(Pipelines)里都能稳健使用工具,业界通常会把工具标准化,比如使用 JSON Schema。

-

形象理解: 不管是哪家公司的电钻,插头都得是标准两相或三相的。

-

做法: 定义好每一个工具的固定格式(必须填什么、选填什么、输出是什么)。

-

效果: 这样模型在“编排(Orchestration)”多个工具时,就像玩乐高积木,接口严丝合缝,不会出现“上一个工具出来的东西,下一个工具读不懂”的情况。

总结:

Tool Representations for Orchestration 就是:

-

翻译: 把冷冰冰的代码变成 AI 爱读的文字。

-

示范: 手把手教它怎么填参数。

-

分类: 别让它在工具海里迷路。

一句话总结:

这部分研究的是“怎么给 AI 写一份最完美的工具说明书”,好让它在指挥千军万马(各种工具)时,既不认错人,也不下错令。

3.3. 代理搜索-Agentic Search

根据实时推理需求动态控制何时、什么以及如何检索

3.3.1. In-Context Search

推理与搜索的交织-Interleaving Reasoning and Search

这一部分讲的是:别让 AI 凭记忆瞎猜,让它像学霸做开卷考试一样,“看一眼题、翻一下书、写一步逻辑”。

Interleaving(交替/穿插)在这里是指:把 “大脑思考(Reasoning)” 和 “外部搜索(Search)” 像拧麻花一样编织在一起。

我们可以用“侦探破案”来类比:

1. 传统模式:先搜后想 (Search-then-Reason)

-

做法: 警察把现场所有东西都拍下来交给侦探,侦探关在小黑屋里想。

-

痛点: 侦探想了半天发现:“哎呀,忘了看死者兜里有没有钥匙了!”但他现在没法回现场,逻辑就断了。

-

AI 表现: 你给 AI 一大堆搜索结果,让它总结。它可能因为信息太多(长文本压力)漏掉了关键点。

2. 交替模式:边想边搜 (Interleaving) —— 论文核心

这是 3.3.1 推荐的模式。侦探(AI)带着逻辑去现场,走一步搜一步。

-

例子:回答“梅西职业生涯中进球数最多的那年,金球奖是谁拿的?”

-

步骤 1(推理): “我先得确定梅西进球最多的是哪一年。”

-

步骤 2(搜索): 调用搜索工具查【梅西 进球最多 赛季】。

-

步骤 3(观察反馈): 搜索结果说是 2012 年。

-

步骤 4(推理): “好,已知是 2012 年。现在我得查 2012 年金球奖得主。”

-

步骤 5(搜索): 调用搜索工具查【2012 金球奖 得主】。

-

步骤 6(观察反馈): 结果是梅西。

-

步骤 7(结论): 2012 年,梅西。

-

3. 为什么论文要强调这种“穿插”?

A. 解决“不知道搜什么”的问题 (Step-by-step Querying)

很多复杂问题的搜索关键词,是需要先推理一步才能生成的。

-

如果你不交替,AI 可能直接搜全句“梅西进球最多那年谁拿金球”,搜出来的结果可能很乱。

-

交替模式下,AI 能把大问题拆成“精准的搜索关键词”。

B. 动态修正 (Error Correction)

-

场景: AI 原本计划搜“A 公司的 CEO”,结果搜索返回“A 公司已破产”。

-

交替的好处: AI 看到反馈后,立马中断原计划,转而推理“既然破产了,那我现在该搜清算人是谁”。

C. 典型技术:Self-RAG 或 FLARE

论文里可能会提到这些词:

-

FLARE: AI 发现自己写的一句话信心不足(没把握),就停下来去搜一下,搜完再接着写。

-

Self-RAG: AI 边写边评价自己:“我这步需要证据吗?需要。” -> 去搜 -> “搜到的有用吗?” -> “有用,继续写”。

总结对比:

|

模式 |

动作 |

形象比喻 |

|---|---|---|

|

Search-then-Reason |

搜一大堆 -> 全读完 -> 憋答案 |

闭卷考试前死记硬背,考场上全凭记忆。 |

|

Interleaving |

想一点 -> 搜一下 -> 看结果 -> 再想 |

真正的开卷考试,看一道题翻一下书,最稳当。 |

一句话总结:

Interleaving Reasoning and Search 就是让 AI 变成一个“逻辑在线、随时翻书”的聪明人,通过不断的“思考-验证-获取新知”循环,解决那些靠脑子里旧知识搞不定的复杂难题。

结构增强搜索

这部分讲的是:别让 AI 像没头苍蝇一样在网页大海里乱搜,给它一张“结构化”的地图。

Structure-Enhanced Search(结构增强搜索)的核心在于:很多知识不是零散的句子,而是存在于表格、知识图谱(关系网)或特定层级里的。如果 AI 只会搜关键词,就会漏掉这些“骨架”信息。

我们可以用“在大型图书馆找一个特定的家谱关系”来类比:

1. 传统搜索 (Plain Search) —— “大海捞针”

-

做法: 你在图书馆大喊:“谁认识张三的二舅?”

-

痛点: 运气好能听到有人回一句,运气不好就得翻遍所有书。

-

AI 表现: 只是把用户的问题丢给搜索引擎(如 Google),拿回一堆碎片网页,AI 拼凑半天也搞不清人物关系。

2. 结构增强搜索 (Structure-Enhanced) —— “查户口本和地图”

这是论文 3.3.1 提到的进阶招数,主要包含两种形式:

A. 知识图谱增强 (Knowledge Graph Search) —— “顺藤摸瓜”

-

例子:问“奥本海默的导师的导师是谁?”

-

结构化操作: AI 不直接搜全句。它先在知识图谱里定位【奥本海默】,找到【导师】这条线指向【波恩】,再从【波恩】出发找【导师】指向【普朗克】。

-

优势: 这种“点对点”的路径跳转极其精准,绝不会因为网页文章写得模糊而找错人。

-

B. 表格/数据库增强 (Table/Database Search) —— “定点打击”

-

例子:问“2023年全球销量前五的手机里,哪款电池最大?”

-

普通搜索: AI 搜出 10 篇新闻稿,每篇讲一款手机,AI 得读半天去对比数据。

-

结构化操作: AI 直接识别并抓取网页里的对比表格,或者去查结构化的参数数据库(SQL 查询)。

-

优势: 数据对比一目了然,不会出现“张冠李戴”。

-

3. 论文里的“结构”到底增强了什么?

-

检索的精准度 (Retrieval Precision):

通过 Graph-tool(图工具)或 SQL,AI 能直接拿到“结构化事实”,而不是一段可能含有废话的文字。 -

多跳推理的能力 (Multi-hop Reasoning):

结构化数据天然支持“A -> B -> C”的推导。AI 可以顺着图谱的线条,像走迷宫一样稳健地完成长链条搜索。 -

模式匹配 (Pattern Matching):

比如你想找“所有和华为有供应关系的芯片公司”,在结构化图谱里就是一个简单的“查询操作”,而在纯文本搜索里则是大工程。

总结对比:

|

搜索方式 |

搜索对象 |

形象比喻 |

|---|---|---|

|

Plain Search |

零散的网页、段落 |

在乱草堆里找一根特定的草。 |

|

Structure-Enhanced |

关系图、表格、数据库 |

照着公司组织架构图找经理。 |

一句话总结:

Structure-Enhanced Search 就是让 AI 学会利用“人类整理好的知识骨架”(如图谱和表格),通过精准的路径跳转和数据比对,快速搞定那些关系复杂、需要严谨数据的难题。

3.3.2. Post-Training Search

SFT-Based Agentic Search

这一部分讲的是:通过“特训”,让 AI 变成一个懂搜索套路的“老侦探”,而不是只会把你的话复制到搜索框的“传声筒”。

SFT-Based Agentic Search 的核心是:利用有监督微调(SFT),把“如何高效搜索”的经验直接刻进模型的脑子里。

我们可以用“教一个实习生如何做背景调查”来类比:

1. 为什么要 SFT?(普通 AI 的通病)

-

普通 AI: 你问“周杰伦现在的状态”,它直接搜“周杰伦现在的状态”。结果搜出来一堆八卦,没重点。

-

Agentic Search: 它会想:“我要查他的最新专辑、巡演计划和近期社交媒体动态。”然后分三次精准搜索。这种“搜索自觉性”就是练出来的。

2. SFT 训练是怎么做的?(喂“搜索笔记”)

我们需要准备大量的“高质量搜索轨迹”作为教材:

-

教材例子:

-

问题: “帮我对比特斯拉和比亚迪去年的毛利率。”

-

黄金搜索轨迹(训练数据):

-

思考: 我需要两家公司的年度财报。

-

动作: 搜索

Tesla 2023 annual report gross margin。 -

动作: 搜索

BYD 2023 annual report gross margin。 -

思考: 搜到了,特斯拉是 18.2%,比亚迪是 20.2%。现在我需要计算差距。

-

结论: 比亚迪高出 2 个百分点。

-

-

-

训练过程: 把成千上万条这种“专业搜索步骤”喂给模型,让它模仿。

3. SFT 之后,模型学会了哪三招?

A. 关键词扩充 (Query Expansion)

-

学会了: 把模糊的问题变精准。

-

例子: 你搜“最近好火的那个 AI 视频”,SFT 后的模型会主动搜

Sora OpenAI release date或Kling AI video generator。

B. 结果筛选 (Relevance Judgment)

-

学会了: 面对搜出来的 10 个网页,它能瞬间判断哪个是广告,哪个是权威官网。

-

例子: 搜“官网”时,它会跳过垃圾推广,精准点击那个带

gov或edu后缀的链接。

C. 迭代搜索 (Iterative Refinement)

-

学会了: 如果第一遍没搜到,它不会说“我不知道”,而是会换个法子再搜。

-

例子: 搜“某教授的邮箱”没搜到,它会转而搜“该教授所属大学的教职工通讯录”。

4. 总结对比:

|

阶段 |

表现 |

形象比喻 |

|---|---|---|

|

没 SFT 前 |

你问什么,它搜什么,搜不到就放弃。 |

呆板的收发员。 |

|

SFT 后 |

懂得分步搜、换词搜、去重搜。 |

专业的调查记者。 |

一句话总结:

SFT-Based Agentic Search 就是通过“刷高质量搜索案例”,让 AI 掌握了搜索的“心法”。它不再是机械地调用搜索接口,而是带着目的、带着策略去互联网上挖信息。

RL-Based Agentic Search

这一部分讲的是:不再教 AI 搜索的“标准步骤”,而是让它去互联网大海里“自生自灭”,通过不断的“踩坑”和“拿奖金”,自己悟出最牛的搜索策略。

RL-Based(基于强化学习) 的核心在于:不给标准答案,只给胜负判定。

我们可以用“教一个新手在茫茫大海里钓到最贵的金枪鱼”来类比:

1. 为什么要用 RL?(SFT 的局限)

-

SFT 的问题: 老师教的搜索词可能是旧的,或者老师也没见过某些奇葩的网页。

-

RL 的核心: 只要 AI 最后搜到了那个“藏得极深”的正确答案,就给它 +100分;如果它在广告网页里绕圈子,就扣它 -10分。

2. RL 是怎么训练 AI 搜索的?(“胡萝卜”加大棒)

A. 尝试各种“搜索组合拳”(Trial and Error)

-

场景: 用户问“某款刚发布两小时的冷门芯片的功耗是多少?”

-

AI 第一次尝试: 直接搜“芯片名 功耗”。结果全是营销号,没数据。

-

反馈: 任务失败,扣 50 分。

-

AI 第二次尝试(变聪明了): 先搜“芯片名 官网”,进入官网后,再搜“Datasheet(数据手册)”,最后在 PDF 里的第 18 页找到了数据。

-

反馈: 任务圆满完成,奖 200 分!

-

进化: AI 刻骨铭心地记住了:“搜硬核参数,找 Datasheet 比搜新闻强一万倍。”

B. 学会“见好就收”或“止损”(Efficiency vs. Accuracy)

-

问题: 搜索是费钱(Token)费时间的。

-

RL 规则: 搜到正确答案 +100,但每多点开一个没用的网页 -5。

-

领悟: AI 学会了精简。它不再乱点那 10 个搜索结果,而是只点那个看起来最靠谱的。它学会了“快、准、狠”。

3. 论文里提到的两个关键概念:

-

Reward Shaping (奖励塑造):

不仅最后搜到答案给奖,如果 AI 搜出了一个非常有价值的中间关键词(比如从“买车”进化到了“2024款豪华SUV安全碰撞测试报告”),也给点小奖。 -

Environment Feedback (环境反馈):

互联网就是 AI 的训练场。网页打不开、被反爬虫拦住、搜出来全是垃圾信息……这些真实的“毒打”让 AI 的搜索能力变得极度抗造。

4. 总结对比:

|

搜索方式 |

核心逻辑 |

形象比喻 |

|---|---|---|

|

SFT-Based |

模仿学霸的搜索笔记。 |

按部就班的图书管理员。 |

|

RL-Based |

在失败中总结财富,在成功中巩固套路。 |

能在复杂网络里挖出任何料的“黑客级”情报员。 |

一句话总结:

RL-Based Agentic Search 就是让 AI 变成一个“结果导向”的搜索高手。它不拘泥于形式,只要能抓到最准确的信息,它会自己发明出各种人类都没想到的奇妙搜索组合。

自我进化型agent

4.1. 反馈机制-Agentic Feedback Mechanisms

4.1.1 反思性反馈-Reflective Feedback

我们用 “学生写作文并修改” 的日常场景,就能通俗理解 Reflective Feedback(反思型反馈)—— 核心是 “自己检查自己的成果,找出问题并修正”,全程不依赖外部老师指导,也不改变自身的 “基础能力”(对应文档中 “不更新模型参数”),只在 “完成任务的过程中” 动态调整。

具体例子:小明写 “我的周末” 作文

-

第一步:生成初稿(对应模型生成初始推理 / 输出)小明快速写完作文:“周六我和妈妈去公园玩,我们走了很多路,看到了花和鸟,然后回家了。周日在家写作业,很开心。”这就像 LLM 直接输出一个答案,只追求 “完成”,没考虑逻辑、细节和流畅度。

-

第二步:自我批判(对应模型的 “自评估 / 批判”)小明读完自己的作文,开始反思:

- “走了很多路” 太笼统,读者不知道走了多久、有没有特别的路线?

- “看到了花和鸟” 没说花是什么颜色、鸟在做什么,不够生动;

- 周日只说 “写作业”,没说写了什么作业、有没有休息或帮妈妈做事,显得很空洞;

- 结尾 “很开心” 没有具体依据,情绪铺垫不足。这一步就是 “反思型反馈” 的核心:主动暴露自己的不足,不依赖别人指出问题,而是通过 “回看自己的输出” 找漏洞。

-

第三步:修订优化(对应模型根据反思修正推理轨迹)小明根据自己的批判,重写作文:“周六早上,我和妈妈沿着公园的湖边走了 1 小时,湖边的月季开得正艳,粉的、黄的挤在一起,几只小麻雀在草地上啄面包屑。下午我们还租了游船,吹着风特别舒服。周日上午我写完了数学作业,下午帮妈妈整理了书架,晚上一起看了电影。这个周末既充实又开心。”这一步是 “反馈驱动修正”:用反思发现的问题,针对性补充细节、完善逻辑,让输出更优。

-

可选第四步:二次反思(对应多轮反思循环)小明再读修订版,又想到:“没说租游船时有没有遇到有趣的事”,于是再加一句 “划船时还看到有人在喂天鹅,天鹅伸长脖子抢食的样子特别可爱”—— 这就是多轮反思,持续优化直到满意。

对应文档中 Reflective Feedback 的核心特点

- 不改变 “基础能力”(不更新模型参数):小明没有突然学会新的写作技巧(比如比喻、拟人),只是用自己已有的能力,通过 “检查 - 修正” 让成果更好;

- 推理时动态调整( inference-time ):反思和修订都在 “写作文的过程中” 完成,不是写完后专门去学写作(对应 “不额外训练”);

- 聚焦 “推理轨迹” 修正:小明修正的是 “表达逻辑、细节补充”(对应模型修正推理步骤),而不是直接换一个完全不同的主题(不改变核心任务目标)。

再类比 LLM 的应用场景(比如数学解题)

- 模型初始输出:解一道应用题时,直接用了错误的公式,步骤跳跃;

- 反思反馈:模型回看自己的解题过程,发现 “第一步没考虑题目中的‘隐含条件’(比如时间单位转换),导致公式用错”;

- 修正后输出:重新梳理题目条件,转换单位,用对公式,分步写出解题过程,最终得到正确答案。

一句话总结:Reflective Feedback 就是 “自己当自己的裁判”,在完成任务的过程中自我检查、自我修正,不用学新技能,也不用别人帮忙,就能让结果更靠谱。

4.1.2 参数化-Parametric Adaptation

我们用 “新手厨师学做菜” 的日常场景,通俗理解 Parametric Adaptation(参数适配型反馈)—— 核心是 “通过反复练习和反馈,把‘临时修正’变成‘本能技能’”,对应文档中 “将反馈信号固化到模型参数中,实现长期、可迁移的能力提升”(不是单次任务中调整,而是通过训练改变自身 “基础能力”)。

具体例子:小李学做 “番茄炒蛋”(目标:稳定做出好吃的版本)

-

第一步:初始尝试(对应模型初始参数 / 基础能力)小李第一次做番茄炒蛋:按网上教程放了 2 个蛋、1 个番茄,盐放多了,番茄炒得太烂,鸡蛋炒老了 —— 成品又咸又柴。这就像 LLM 的初始输出:基于预训练的 “基础能力”(知道番茄和蛋要一起炒),但缺乏 “精准把控” 的技能,输出(菜品)不达标。

-

第二步:获取反馈(对应外部反馈信号)

- 家人尝了后反馈:“盐多了、番茄太烂、鸡蛋炒老了”(明确指出问题);

- 小李自己复盘:“盐放了 1 小勺太多,番茄炒了 5 分钟太长,鸡蛋炒 3 分钟太久”(量化问题)。这一步的反馈不是 “单次修正”(比如这次加水冲淡盐味),而是 “用于学习的信号”—— 告诉小李 “哪些操作导致了不好的结果”。

- 第三步:刻意练习 + 技能固化(对应参数更新 / 训练过程)小李没有只改一次,而是反复做了 5 次番茄炒蛋,每次都根据反馈调整操作,并且记录下来:

- 第 2 次:盐减到 0.5 小勺,番茄炒 3 分钟,鸡蛋炒 1.5 分钟 —— 味道淡了点,番茄不够软;

- 第 3 次:盐 0.7 小勺,番茄炒 4 分钟,鸡蛋炒 1.5 分钟 —— 味道刚好,番茄软嫩,鸡蛋滑嫩;

- 第 4-5 次:重复第 3 次的用量和时间,确保每次都能做出同样好吃的版本。这就对应 “参数适配”:小李通过多次 “反馈 - 调整” 的练习,把 “盐放 0.7 小勺、番茄炒 4 分钟” 这些 “正确策略”,固化成了自己的 “本能技能”(对应模型通过 SFT/RL 更新参数,把有效推理模式写入权重)。

- 第四步:能力迁移(对应模型泛化能力提升)后来小李学做 “番茄炒虾仁” 时,自然沿用了 “少盐、食材不过度翻炒” 的技能 —— 因为之前练番茄炒蛋时,他不仅学会了 “做这道菜”,还掌握了 “番茄类炒菜的调味和火候逻辑”(对应模型训练后,不仅能做好训练任务,还能泛化到类似任务)。

对应文档中 Parametric Adaptation 的核心特点

- 改变 “基础能力”(更新模型参数):小李不是单次做菜时临时调整(比如这次少放盐),而是通过练习,让自己 “天生就知道怎么炒才好吃”—— 对应模型通过训练更新权重,下次遇到类似任务时,不用再临时反思,直接输出更优结果。

- 离线训练 + 长期生效:反馈整合发生在 “多次练习”(训练阶段),而不是 “单次做菜过程中”(推理阶段)—— 一旦学会,后续做同类菜都能复用,不会 “做完就忘”。

- 聚焦 “策略固化”:小李固化的是 “调味、火候的决策策略”(对应模型固化的是 “推理模式、工具使用策略”),而不是某一次的具体操作(比如 “这次放 0.7 小勺盐”),因此能泛化到新场景。

再类比 LLM 的应用场景(比如工具使用)

- 初始模型:调用 “天气 API” 时,经常参数错误(比如格式不对、没指定城市);

- 反馈信号:API 返回 “参数无效” 的错误提示,人类标注 “正确参数格式”;

- 参数适配:通过 SFT(监督微调)用大量 “错误案例 + 正确格式” 的数据训练模型,更新模型参数;

- 最终效果:模型后续调用任何 API 时,都能自动生成正确的参数格式 —— 不用再临时反思修正,技能被 “内化为参数”。

一句话总结:Parametric Adaptation 就是 “通过反复练习 + 反馈,把‘临时修正的技巧’变成‘自带的本能’”,让能力长期生效且能迁移到新任务,对应模型通过训练更新参数,实现底层能力提升。

4.1.2 参数适配型反馈(Parametric Adaptation)

我们用 “新手司机考驾照→成为老司机” 的场景,通俗理解 4.1.2 参数适配型反馈(Parametric Adaptation)—— 核心是 “通过反复练习 + 外部反馈,把‘临时修正的技巧’内化成‘本能能力’”,对应文档中 “将反馈信号固化到模型参数中,实现长期、可迁移的能力提升”(不是单次任务中调整,而是通过训练改变自身 “底层能力”)。

具体例子:小王学开车(目标:稳定安全驾驶)

1. 初始状态(对应模型 “初始参数”)

小王刚报驾照,只懂 “踩油门走、踩刹车停” 的基础逻辑(对应模型预训练的基础能力)。第一次上路练车:

- 换挡时总是 “离合松太快”,导致车顿挫;

- 过弯道时 “速度太快”,车身倾斜明显;

- 跟车时 “距离太近”,遇到前车刹车差点追尾。这就像 LLM 初始输出:能完成 “开车” 这个任务,但细节漏洞多,依赖 “基础能力” 却缺乏 “精准控制” 的技能。

2. 获取反馈(对应 “外部反馈信号”)

- 教练(外部反馈源)直接指出问题:“换挡要慢松离合、过弯先减速、跟车保持 3 秒距离”;

- 实际场景反馈:车顿挫时自己能感觉到不顺畅,跟车太近时的紧张感(间接反馈);

- 关键:反馈不是 “单次修正”(比如教练帮他踩了刹车),而是 “告诉小王‘什么操作导致了不好的结果’”—— 这些反馈是 “用于学习的信号”,不是 “临时救急”。

3. 训练 + 参数固化(对应 “模型更新参数”)

小王没有只改一次操作,而是通过 “多次练习 + 反馈”,把正确策略固化成自己的 “本能”:

- 第 2-5 次练车:刻意放慢换挡速度,过弯前提前踩刹车,跟车时盯着前车尾灯数 “1-2-3”;

- 第 10 次练车:不用刻意提醒,换挡时自然慢松离合,过弯时自动减速 —— 这些正确操作已经 “记到骨子里”(对应模型通过 SFT/RL 更新参数,把有效推理模式写入权重);

- 奖励机制:教练表扬 “这次没顿挫”(正向奖励),自己感受到 “顺畅驾驶” 的舒适感,进一步强化正确操作。

4. 能力迁移(对应 “模型泛化能力”)

后来小王换了一辆陌生的手动挡车,甚至开上山路:

- 不用重新学换挡、过弯技巧,能直接沿用 “慢松离合、过弯减速” 的策略;

- 遇到新场景(山路陡坡),还能基于 “跟车保持安全距离” 的固化逻辑,自动调整为 “跟车距离加倍”—— 因为他学到的不是 “某一次开车的操作”,而是 “驾驶的核心规则”(对应模型训练后,能泛化到类似任务)。

对应文档中 Parametric Adaptation 的核心特点

- 改变 “底层能力”(更新模型参数):小王不是 “这次开车慢松离合,下次又忘”,而是通过练习,让 “慢松离合” 变成本能 —— 对应模型通过训练更新权重,下次遇到类似任务时,不用临时反思,直接输出更优结果。

- 离线训练 + 长期生效:反馈整合发生在 “多次练车”(训练阶段),而不是 “单次上路过程中”(推理阶段)—— 一旦学会,后续开车都能复用,不会 “用完就忘”。

- 聚焦 “策略固化”:小王固化的是 “驾驶的决策策略”(如 “换挡 = 慢松离合”“过弯 = 先减速”),而不是某一次的具体操作(比如 “这次离合松了 2 秒”),因此能泛化到新场景(陌生车、山路)。

再类比 LLM 的应用场景(工具使用)

- 初始模型:调用 “翻译 API” 时,经常出现 “参数格式错误”(比如没指定目标语言)、“文本过长导致调用失败”;

- 反馈信号:API 返回 “参数无效”“文本长度超限” 的错误提示(外部反馈),人类标注 “正确格式:指定 lang=zh,文本分段调用”(监督反馈);

- 参数适配:用大量 “错误案例 + 正确操作” 的数据做 SFT(监督微调),或用 RL(强化学习)以 “调用成功” 为奖励优化模型;

- 最终效果:模型后续调用任何 API(翻译、天气、搜索),都能自动 “检查参数格式、拆分长文本”—— 这些技能被 “内化为参数”,不用再临时修正。

一句话总结:Parametric Adaptation 就是 “通过反复练习 + 反馈,把‘临时技巧’变成‘自带本能’”,让能力长期生效且能迁移到新任务,对应模型通过训练更新参数,实现底层能力的本质提升。

4.1.3 验证器驱动反馈(Validator-Driven Feedback)

我们用 “学生做选择题 + 标准答案批改” 的场景,通俗理解 4.1.3 验证器驱动反馈(Validator-Driven Feedback)—— 核心是 “不用有人教你哪里错、怎么改,只靠一个‘对错判断工具’(验证器),错了就重新做,直到通过”,既不反思自己的思路,也不提升底层能力,只追求 “单次输出正确”。

具体例子:小李做数学选择题(目标:选对答案)

1. 核心设定

- 小李(智能体):会做基础数学题,但思路不严谨,容易粗心;

- 题目(任务):“1+2×3=?”(正确答案是 7,选项:A.5 B.7 C.9);

- 验证器:试卷后面的 “标准答案”(只告诉你 “对 / 错”,不解释原因);

- 规则:小李选完后看标准答案,错了就重新选,直到选对为止。

2. 过程演示

- 第一步:初始输出→ 小李粗心算成 “(1+2)×3=9”,选了 C;

- 第二步:验证反馈→ 翻标准答案,发现 “C 是错的”(验证器只给 “失败信号”,不说是运算顺序错了);

- 第三步:重试→ 小李不知道哪里错,只能重新猜:这次觉得 “1+2=3,3×3=9 不对,那可能是 1+6=7”,选了 B;

- 第四步:验证通过→ 看标准答案,B 是对的,任务结束。

3. 关键细节(对应文档核心特点)

- 反馈是 “二进制信号”:验证器只给 “对 / 错”“成功 / 失败”,没有中间解释(比如不说 “你运算顺序错了,要先乘后加”);

- 不用自我反思:小李没搞懂 “为什么 C 错、B 对”,只是靠 “重试 + 验证筛选” 得到正确答案,下次遇到类似题(比如 “2+3×4”),可能还会犯同样的粗心错误;

- 不提升底层能力:小李的数学运算能力没进步,只是这次题选对了 —— 对应模型不更新参数,下次遇到同类任务,还是可能输出错误,需要再重试;

- 适合 “容易验证” 的场景:选择题、代码运行(单元测试)、数学计算(计算器验证)等,只要能快速判断 “对不对”,不用复杂推理。

再类比 LLM 的应用场景(代码生成)

- 任务:生成 “计算 1-100 求和” 的 Python 代码;

- 智能体(LLM):生成初始代码

sum=0; for i in range(1,100): sum+=i; print(sum)(循环少了 i=100,结果是 4950); - 验证器:代码运行后的 “单元测试”(预设正确结果是 5050,对比后提示 “结果错误”);

- 重试过程:LLM 重新生成代码,调整循环条件为

range(1,101),再跑测试,直到输出 5050(验证通过); - 关键:LLM 不知道第一次错在 “循环范围”,只是靠 “测试失败→重试” 的循环,最终得到正确代码,自身的 “代码逻辑能力” 没提升。

对应文档核心特点总结

- 反馈来源:外部 “验证器”(如单元测试、计算器、标准答案),不是自我反思或人类指导;

- 反馈形式:无解释的 “成功 / 失败” 信号,不提供 “哪里错、怎么改” 的信息;

- 核心动作:“生成→验证→重试” 的循环,直到输出通过验证;

- 能力变化:不提升底层推理 / 技能,只保证 “单次任务输出正确”,下次遇到同类任务可能重复犯错。

一句话总结:Validator-Driven Feedback 就是 “瞎蒙也要蒙对”—— 靠外部工具判断对错,错了就重新来,不用懂原理,只要最终结果正确就行。

4.2 智能体记忆(Agentic Memory)

用 “老中医看病” 理解:

- 核心:记忆不是 “记流水账”,而是 “分类存储、按需调用”,支撑长期决策和能力积累。

- 场景:老中医给病人看病,从 “新手” 到 “专家” 的记忆进化。

4.2.1 扁平记忆的智能体使用(Agentic Use of Flat Memory)

- 对应 “新手中医”:只记 “病人的症状和药方”(比如 “张三,感冒发烧,开银翘散”),是简单的 “输入 - 输出” 存储;

- 特点:记忆是 “无结构的清单”,下次遇到 “李四,感冒发烧”,只能直接复用药方,不会考虑 “李四体质偏寒” 的差异;

- 对应 LLM:MemGPT 存储对话历史,下次聊天能回忆起 “用户喜欢喝拿铁”,但不会整合 “用户喜欢拿铁 + 乳糖不耐受” 的深层逻辑。

4.2.2 记忆的结构化使用(Structured Use of Memory)

- 对应 “资深中医”:把记忆整理成 “知识图谱”—— 比如 “感冒分风寒 / 风热”,“风寒感冒症状:怕冷、流清涕,药方:麻黄汤”,“风热感冒:发烧、黄痰,药方:银翘散”;

- 特点:记忆有 “逻辑关联”,下次遇到 “王五,怕冷 + 流清涕”,能自动匹配 “风寒感冒”,而不是盲目复用之前的药方;

- 对应 LLM:MEM0 把用户信息、任务历史做成知识图谱,能回答 “用户上周说的项目截止日期,和这次的需求有没有冲突”。

4.2.3 训练后记忆控制(Post-training Memory Control)

- 对应 “老中医”:不仅有结构化记忆,还会 “主动管理记忆”—— 比如 “把频繁遇到的‘儿童风寒感冒’案例重点存储,把多年没遇到的‘瘟疫’案例压缩存储”,甚至 “删除错误的记忆(比如早年误判的病例)”;

- 特点:通过 “学习” 优化记忆的 “存储 / 检索策略”,不是被动记,而是主动判断 “什么该记、什么该忘、什么时候用”;

- 对应 LLM:MemAgent 用 RL 训练,学会 “优先存储对后续任务有用的信息,删除冗余内容”,避免记忆过载。

4.3.1. 规划进化 Self-evolving Planning

我们用 “新手做电商直播运营→成为资深运营” 的场景,通俗理解 4.3.1 自进化规划(Self-evolving Planning)—— 核心是 “不用别人教,自己通过‘做任务→总结经验→优化策略’,让规划能力越来越强”,从 “只会按固定模板做” 变成 “能自主设计复杂方案、应对突发情况”,对应文档中 “规划不再是固定流程,而是通过自主任务生成、反馈整合实现持续进化”。

具体例子:小张做电商直播规划(目标:提升直播间销量)

1. 初始状态(对应 “初始规划能力”)

小张刚接手女装直播,只会按 “固定模板” 做规划:

- 流程:“开播→介绍产品→喊下单→下播”;

- 问题:没考虑 “选品搭配”“互动节奏”“福利时机”,导致直播 1 小时只卖了 5 件衣服 —— 规划只满足 “完成任务”,不满足 “达成目标”。这就像智能体的初始规划能力:能拆解基础任务,但缺乏针对性、灵活性,无法应对复杂目标。

2. 第一步:自主生成任务(对应 “Self-generated Task Construction”)

直播结束后,小张发现 “销量差”,但没人教他怎么改。他自己主动提出 “优化直播规划” 的新任务,还拆解成子任务:

- 子任务 1:分析失败原因(为什么没人买?);

- 子任务 2:调整选品(选爆款还是新品?);

- 子任务 3:设计互动环节(怎么留住观众?);

- 子任务 4:规划福利节奏(什么时候发优惠券?)。这对应文档中 “智能体自主生成任务”—— 不用外部指令,自己发现问题、拆解优化方向,启动进化循环。

3. 第二步:反馈整合(对应 “Feedback Integration”)

小张通过 “数据反馈 + 自我复盘” 找优化点:

- 数据反馈:直播间数据显示 “观众停留时间只有 3 分钟,看到第 10 分钟就没人了”“介绍单件衣服时观众流失最快”;

- 自我复盘:“只单件介绍太单调,没福利吸引,观众没耐心等”“选品太杂,有爆款但没搭配,观众不知道怎么买”;

- 关键:反馈不是来自别人,而是自己从 “结果” 反推 “规划的问题”,形成 “做→看结果→找问题” 的闭环。

4. 第三步:策略优化(对应 “Strategy Refinement”)

小张根据反馈,优化第二次直播规划,形成新策略:

- 选品规划:“爆款上衣 + 搭配裤子” 组合销售(解决 “选品杂” 问题);

- 节奏规划:“每 15 分钟一个互动”(弹幕抽奖、问答),“每 30 分钟发一张优惠券”(解决 “观众留不住” 问题);

- 流程规划:“开播 5 分钟福利引流→组合介绍产品→观众互动→加购催单→返场爆款”(不再是线性流程,而是目标导向的动态流程)。这次直播卖了 30 件衣服,销量翻倍 —— 规划策略第一次进化。

5. 第四步:持续进化(对应 “Continual Improvement”)

小张没有停在 “30 件”,而是继续循环 “生成任务→反馈→优化”:

- 第三次直播:发现 “优惠券发得太密集,利润低”,优化为 “前 30 分钟发小额券(拉加购),最后 10 分钟发大额券(催下单)”;

- 第四次直播:遇到 “突发情况(爆款断货)”,自主新增 “应急规划”—— 立刻衔接 “同款替代产品” 介绍,不让观众流失;

- 最终效果:1 个月后,小张的规划能覆盖 “选品组合、互动设计、福利节奏、应急方案”,直播销量稳定在 100 + 件,还能根据 “大促、新品上市” 等场景设计专属规划 —— 规划能力从 “基础模板” 进化成 “灵活、高效、目标导向的复杂方案”。

对应文档中 Self-evolving Planning 的核心特点

- 自主启动进化:不用外部指令,自己发现问题、生成优化任务(比如小张主动拆解 “提升销量” 的子任务);

- 反馈驱动优化:反馈来自 “任务结果”(销量、数据),不是外部指导,通过复盘把 “失败经验” 变成 “规划规则”;

- 能力可迁移:进化的是 “规划逻辑”(比如 “组合销售→提升客单价”“互动→留观众”),不是 “某一次的直播流程”—— 后来小张接手男装直播,能直接复用这些逻辑,快速设计出高效规划;

- 开放 - ended 进化:规划没有 “最终版本”,会随着场景、目标变化持续优化(比如应对大促、断货等新情况)。

再类比 LLM 的应用场景(数学探索规划)

- 初始模型:只会按 “固定步骤” 解数学题(比如 “先算乘除后算加减”),遇到 “需要构造辅助线的几何题” 就卡壳;

- 自主生成任务:解不出题后,自主提出 “学习构造辅助线” 的子任务,拆解成 “找同类题型→分析辅助线构造逻辑→练习应用”;

- 反馈整合:通过 “解题结果” 反馈(构造对了就能解出,错了就复盘 “为什么这条辅助线没用”);

- 规划进化:最终能自主规划 “复杂几何题的解题路径”—— 先判断题型→构造辅助线→分步推导,甚至能应对 “多辅助线”“变式题型”,规划能力持续提升。

一句话总结:Self-evolving Planning 就是 “规划能力的自我修炼”—— 不用别人教,自己在实践中 “发现问题→设计方案→总结经验→优化策略”,从 “会做” 变成 “会做好、会灵活应对”,实现规划能力的自主成长。

4.3.2. 工具调用进化 Self-evolving Tool-use

我们用 “新媒体运营做短视频” 的场景,通俗理解 4.3.2 工具调用进化(Self-evolving Tool-use)—— 核心是 “从‘会用单个基础工具’,进化到‘自主创造新工具、组合工具链’”,不用别人教,自己通过实践发现 “现有工具不够用”,进而主动拓展工具能力,让工具为复杂目标服务,对应文档中 “工具使用从‘被动调用’变成‘主动创造、合成’的进化过程”。

具体例子:小夏做短视频(目标:高效产出 “吸睛 + 高质量” 的穿搭短视频)

1. 初始状态(对应 “基础工具使用能力”)

小夏刚做短视频,只会用 3 个基础工具,且是 “单独调用、互不关联”:

- 工具 1:手机相机(拍穿搭素材);

- 工具 2:剪映(简单剪辑:拼接片段、加背景音乐);

- 工具 3:美图秀秀(修图:调亮度、磨皮);

- 问题:每次做视频要 “拍→修图→剪辑” 手动切换,步骤繁琐;且没有 “字幕自动生成”“热门音效匹配” 功能,视频没人看(播放量只有几百)—— 工具使用停留在 “能用到”,但 “效率低、效果差”。

这就像智能体的初始工具能力:只会调用单个工具完成基础操作,不会组合、不会拓展,无法应对复杂目标。

2. 第一步:工具创造(对应 “Tool Creation”)

小夏发现 “手动打字幕太费时间”(1 分钟视频要打 5 分钟字幕),且 “热门音效找不到匹配的”,现有工具满足不了需求。他自主做了两件事:

- 创造 “工具脚本”:用剪映的 “自定义模板” 功能,把 “加字幕、配热门音效、调滤镜” 的固定步骤做成 “穿搭视频专用模板”(相当于 “新工具”),下次直接导入素材就能自动套用,不用重复操作;

- 拓展工具库:发现 “讯飞听见” 能自动转写字幕,就把它加入工具链,先用电讯听见转写文字,再导入剪映,解决 “手动打字幕” 的痛点 —— 这对应文档中 “智能体自主创造新工具(或整合新工具),拓展行动空间”。

3. 第二步:工具合成(对应 “Tool Synthesis”)

小夏的目标升级为 “日更 3 条短视频,且每条播放量过万”,单一工具或简单模板不够用了。他开始 “组合工具链”,形成 “全流程自动化” 的工具体系:

- 工具链 1(素材拍摄 + 预处理):手机相机(拍摄)→ 美图秀秀(批量修图)→ 百度网盘(自动备份素材,避免丢失);

- 工具链 2(剪辑 + 优化):讯飞听见(自动转写字幕)→ 剪映(套用自制模板:加字幕、配热门音效、加穿搭标签)→ 抖音自带 “热门话题检测工具”(自动匹配话题,提升曝光);

- 工具链 3(效果复盘):抖音后台数据工具(看播放量、完播率)→ 石墨文档(记录 “哪个工具组合、哪个模板效果好”);

- 效果:原来做 1 条视频要 1 小时,现在 30 分钟做 3 条,播放量稳定过万 —— 工具从 “单独使用” 变成 “协同工作”,效率和效果翻倍。

4. 第三步:工具适配进化(对应 “Tool-use Adaptation”)

小夏遇到新场景(比如 “做节日限定穿搭视频”“和达人合拍视频”),工具链也跟着进化:

- 场景 1:节日限定视频(比如圣诞节)→ 新增工具 “Canva 可画”(自主设计节日专属贴纸),加入工具链 2(剪辑时加节日贴纸),让视频更有节日氛围;

- 场景 2:达人合拍视频(素材是达人发来的横屏视频)→ 创造 “横屏转竖屏 + 画面裁剪” 的专属模板,整合到剪映工具链,自动适配抖音竖屏格式,不用手动调整;

- 关键:小夏不是 “被动接受现有工具”,而是 “根据新目标、新场景,主动调整工具组合、创造新工具”,让工具为自己的需求服务 —— 这就是工具调用的核心进化。

5. 最终进化状态(对应 “高级工具使用能力”)

小夏的工具使用能力从 “基础调用” 进化到 “工具生态搭建”:

- 能自主判断 “什么场景需要什么工具”:比如要提升曝光,就加 “热门话题检测工具”;要节省时间,就做 “批量处理模板”;

- 能创造 “专属工具”:针对穿搭赛道,做出 “穿搭标签自动生成模板”“热门 BGM 匹配工具”,别人没有,自己用着高效;

- 能优化工具链:通过数据反馈(比如 “某条视频完播率低”),发现 “剪辑时前 3 秒没抓眼球”,就在工具链 2 中加入 “前 3 秒闪回特效工具”,持续优化效果。

对应文档中 Self-evolving Tool-use 的核心特点

- 自主驱动进化:不用别人提醒 “你需要新工具”,自己通过 “目标没达成”(播放量低、效率差)发现问题,主动拓展工具能力;

- 从 “用工具” 到 “造工具”:进化的核心是 “不满足于现有工具”,而是根据需求创造新工具(模板、脚本)、合成工具链,让工具更贴合复杂目标;

- 工具为目标服务:不是为了 “用更多工具” 而进化,而是为了 “更高效、更好地达成目标”(日更 3 条、播放量过万),工具是实现目标的 “放大器”;

- 能力可迁移:进化的是 “工具组合、创造的逻辑”—— 后来小夏做 “美妆短视频”,能直接复用 “模板 + 工具链” 的逻辑,快速搭建美妆视频的工具体系。

再类比 LLM 的应用场景(代码工具进化)

- 初始模型:只会调用 “Python 基础函数”(比如

print()输出、for循环),能完成简单计算任务; - 工具创造:发现 “处理 Excel 数据时,重复写

pandas读取代码太麻烦”,就自主写了一个 “Excel 数据快速处理函数”(新工具),输入文件路径就能自动读取、去重、筛选; - 工具合成:目标升级为 “分析 100 个 Excel 文件,生成可视化报告”,就组合工具链:

pandas(读数据)→ 自制函数(数据清洗)→matplotlib(画图)→docx(生成报告),自动完成全流程; - 进化效果:从 “单独调用基础函数”,进化到 “自主创造工具、组合工具链”,能应对复杂的数据处理任务,效率大幅提升。

一句话总结:Self-evolving Tool-use 就是 “工具使用的‘打怪升级’”—— 从 “会用单个工具”,到 “自己造工具、串工具链”,让工具从 “被动响应” 变成 “主动支撑复杂目标”,实现工具能力的自主拓展。

你的疑问很关键!Self-evolving Tool-use(工具调用进化)是否涉及 SFT、RL 训练,要看具体进化阶段 —— 核心结论是:基础的 “工具组合、简单模板创造” 不涉及,但要实现 “稳定复用、泛化到新场景、自主优化工具策略” 的深度进化,必须依赖 SFT 或 RL 训练。

我们用之前 “小夏做短视频” 的例子,结合模型训练逻辑,通俗拆解:

一、不涉及 SFT/RL 的 “浅层进化”(临时技能,用完可能忘)

小夏刚开始的 “工具组合、简单模板创造”,对应模型的 “上下文内推理”—— 不更新模型参数,只在单次任务中临时调整:

- 比如小夏手动把 “讯飞听见(转字幕)+ 剪映(剪辑)” 串成工具链,或做一个节日贴纸模板;

- 对应模型:在一次任务中,通过提示词引导,调用 “翻译 API + 表格 API” 完成数据处理,或临时生成一个简单工具脚本;

- 特点:这次会用,但下次换个任务(比如小夏做美妆视频、模型处理图片数据),可能还要重新想 “怎么组合工具”,因为技能没 “固化” 到自身能力里 —— 就像你临时记了一个解题技巧,没反复练,下次可能忘。

二、必须依赖 SFT/RL 的 “深度进化”(技能内化,能泛化)

当小夏要实现 “日更 3 条、稳定过万播放”,或模型要 “自主应对不同场景的工具调用”,就需要 SFT 或 RL 训练,把临时技能变成 “本能”:

1. 用 SFT(监督微调)实现 “技能固化”

- 场景:小夏把 “穿搭视频工具链”(拍→修图→转写→剪辑→加话题)的流程,整理成 “标准操作手册”,后续所有穿搭视频都按这个来,不用再想;

- 对应模型:收集大量 “工具调用成功案例”(比如 “转写 + 剪辑”“数据清洗 + 可视化” 的正确流程),用这些数据做 SFT 训练 —— 模型学习 “什么任务对应什么工具链”,参数被更新后,下次遇到类似任务,不用提示词引导,自动调用正确工具组合;

- 例子:模型经过 SFT 后,用户说 “把这 10 个 Excel 文件的销售数据做成报告”,它会自动启动 “pandas 读取→自制函数清洗→matplotlib 画图→docx 生成报告” 的工具链,不用再手动拆解步骤。

2. 用 RL(强化学习)实现 “策略优化”

- 场景:小夏通过抖音数据反馈(比如 “加了热门话题的视频播放量高 3 倍”),优化工具链 —— 把 “热门话题检测工具” 提前到 “剪辑后、发布前”,还调整为 “优先匹配 3 个高流量话题”;

- 对应模型:用 RL 训练,把 “工具调用后的结果质量”(比如报告准确率、任务完成速度)作为 “奖励信号”—— 调用对了、效率高就给正向奖励,调用错了(比如用了图片 API 处理表格数据)就给负向奖励;

- 例子:模型用 RL 训练后,会自主优化工具策略:发现 “用 A 翻译 API 比 B API 快且准”,就优先调用 A;发现 “处理大文件时,先拆分再调用表格 API 更不容易报错”,就自动加入 “文件拆分” 步骤 —— 这些优化不是人类教的,是模型通过 “奖励反馈” 自己学会的。

三、文档中 “Self-evolving Tool-use” 的核心:必须结合 SFT/RL

文档里说的 “工具调用进化”,不是指单次任务的临时组合,而是 “能力的持续提升”—— 比如 “自主创造新工具、工具链动态优化、泛化到未知场景”,这必须依赖 SFT 或 RL:

- 比如文档中提到的 “Voyager(机器人技能进化)”,就是通过 RL 训练,让机器人把 “新学会的技能(比如开门)” 固化到参数里,下次遇到 “开抽屉” 的类似场景,能自动复用技能;

- 再比如 “ToolRL”,通过强化学习让模型学习 “什么时候用什么工具、怎么组合工具”,策略越用越优,而不是每次都从零开始。

一句话总结

- 浅层进化(临时组合工具、做简单模板):不用 SFT/RL,像临时记个技巧;

- 深度进化(技能固化、泛化新场景、自主优化):必须用 SFT/RL,像反复练习后把技巧变成本能 —— 这才是文档中 “Self-evolving Tool-use” 的核心,也是智能体从 “会用工具” 到 “精通工具” 的关键。

4.3.3. 搜索进化 Self-evolving Search

我们用 “职场新人做市场调研” 的场景,通俗理解 4.3.3 搜索进化(Self-evolving Search)—— 核心是 “从‘盲目搜关键词’,进化到‘精准定位、整合知识、动态优化搜索策略’”,不用别人教,自己通过 “搜→用→复盘” 的循环,让搜索不再是 “找信息”,而是 “积累知识、解决复杂问题” 的核心能力,对应文档中 “搜索与记忆形成协同进化,从静态检索变成动态、自适应的推理环节”。

具体例子:小周做 “新能源汽车市场进入策略” 调研(目标:给公司提供可落地的进入建议)

1. 初始状态(对应 “基础搜索能力”)

小周刚入职,只会 “简单关键词搜索”,做调研时:

- 搜索方式:直接在百度搜 “新能源汽车市场”,出来的结果杂乱无章(新闻、行业报告碎片、用户评价混在一起);

- 问题:找不到 “行业规模、竞争格局、政策限制、目标用户” 等核心信息,只能东拼西凑写报告,结论空洞(比如 “新能源汽车市场前景好”),没有实际参考价值 —— 搜索停留在 “找得到信息”,但 “找得准、用得好” 的能力缺失。

这就像智能体的初始搜索能力:只会被动检索,不会筛选、整合,也不会根据目标调整策略,无法支撑复杂推理。

2. 第一步:搜索策略优化(对应 “Dynamic Retrieval Strategy”)

小周发现 “报告被领导打回”,原因是 “缺乏关键数据和逻辑”。他自主复盘,优化搜索策略:

- 从 “单关键词” 到 “组合关键词 + 限定条件”:不再搜 “新能源汽车市场”,而是拆分成 “2025 中国新能源汽车市场规模 统计局数据”“新能源汽车头部品牌 市场份额 2025”“新能源汽车进入政策 工信部 2025”—— 精准定位核心信息;

- 从 “单一平台” 到 “多源验证”:用 “行业数据库(艾瑞咨询)+ 政府官网(工信部)+ 券商研报(东方财富)” 交叉搜索,避免单一来源的信息偏差(比如官网政策比新闻更权威);

- 效果:这次搜到了 “2025 年市场规模预计 5000 亿”“比亚迪、特斯拉合计占比 60%”“新进入者需满足电池安全认证” 等关键数据,报告有了实质内容 —— 搜索策略从 “盲目” 变成 “目标导向”。

3. 第二步:搜索与记忆协同进化(对应 “Co-evolution of Search and Memory”)

小周的目标升级为 “细分市场进入建议”(比如 “聚焦 10-15 万家用新能源汽车”),需要更深度的知识整合。他开始把 “搜索结果” 变成 “结构化记忆”,反过来指导后续搜索:

- 第一步:构建记忆知识库(对应 “Evolving Memory Bases”):把之前搜到的 “市场规模、竞争格局、政策” 整理成 “新能源汽车市场知识图谱”—— 比如 “10-15 万价位→主要竞品(比亚迪海豚、五菱缤果)→核心卖点(续航 300km+、空间大)→政策要求(电池能量密度≥140Wh/kg)”;

- 第二步:记忆指导搜索(对应 “Memory-driven Search”):基于知识库,小周明确 “还缺什么信息”—— 比如 “10-15 万家用车的目标用户画像”“竞品的渠道布局(4S 店 + 线上)”“电池供应商的合作门槛”,然后针对性搜索这些缺口;

- 关键:搜索不再是 “从零开始”,而是 “基于已有记忆找缺口”,记忆越丰富,搜索越精准 —— 形成 “搜索→记忆→再搜索” 的协同进化循环。

4. 第三步:知识合成与搜索策略迭代(对应 “Knowledge Synthesis”)

小周要给 “产品定价、渠道选择” 提具体建议,需要把分散的搜索结果合成 “可落地的知识”,并进一步优化搜索:

- 知识合成:通过搜索发现 “10-15 万用户最看重‘续航 + 性价比’”“竞品主要通过‘线下 4S 店 + 线上直播卖车’”“电池供应商宁德时代的合作起订量≥10 万组”,合成结论:“公司进入需先谈妥宁德时代合作(满足起订量),定价 12-14 万(对标竞品),优先布局二三线城市 4S 店 + 抖音直播”;

- 策略迭代:搜索中发现 “二三线城市充电设施覆盖率” 会影响销量,之前没考虑到,于是新增搜索 “2025 二三线城市新能源汽车充电桩覆盖率”,补充到报告中 —— 搜索策略跟着 “知识合成的缺口” 动态调整;

- 效果:最终报告不仅有数据,还有具体的 “定价、渠道、供应链” 建议,被领导采纳 —— 搜索从 “找信息” 进化成 “支撑决策的核心能力”。

5. 最终进化状态(对应 “Advanced Search Capabilities”)

小周的搜索能力从 “基础检索” 进化到 “自适应、知识驱动的搜索生态”:

- 能自主拆解 “复杂目标” 成 “搜索子任务”:比如 “进入策略”→“市场规模→竞争格局→政策→用户→渠道→供应链”,每个子任务对应专属搜索策略;

- 能 “动态优化搜索源”:知道 “政策查官网、数据查行业数据库、用户画像查调研公司报告”,不用在无效平台浪费时间;

- 能 “记忆复用 + 跨任务迁移”:后来做 “智能手表市场调研” 时,直接复用 “拆分目标→多源验证→知识合成” 的搜索逻辑,快速完成任务 —— 搜索策略变成了可迁移的 “通用能力”。

对应文档中 Self-evolving Search 的核心特点

- 自主优化策略:不用别人教 “怎么搜”,自己通过 “结果反馈”(报告被打回→复盘→调整关键词 / 平台)优化搜索方式;

- 搜索与记忆协同:搜索结果被整理成结构化记忆(知识图谱),记忆反过来指导 “该搜什么、去哪搜”,形成进化闭环;

- 从 “检索” 到 “合成”:搜索的终点不是 “找到信息”,而是 “整合信息成知识”,支撑复杂决策(比如定价、渠道建议);

- 能力可迁移:进化的是 “搜索逻辑”(拆分目标→精准定位→跨源验证→知识合成),不是 “某一次的关键词”,能复用在不同任务中。

再类比 LLM 的应用场景(科研文献搜索)

- 初始模型:只会搜 “AI 医疗诊断”,返回大量无关文献,无法筛选核心研究;

- 策略优化:拆分成 “AI 医疗诊断 深度学习 2023-2025 顶会论文”“AI 医疗诊断 临床应用 案例”,限定来源(顶会、医院官网);

- 记忆协同:把搜到的 “核心算法(CNN)、适用场景(CT 影像)、准确率(95%)” 整理成知识库,指导后续搜索 “CNN 在骨科影像诊断的局限性”;

- 知识合成:最终整合出 “AI 医疗诊断的技术现状、临床痛点、落地建议”,支撑科研项目决策 —— 搜索从 “找文献” 进化成 “科研推理的核心环节”。

一句话总结:Self-evolving Search 就是 “搜索能力的‘升级打怪’”—— 从 “盲目找信息”,到 “精准搜、记得住、用得好”,让搜索成为 “积累知识、解决复杂问题” 的自主进化能力,而不是简单的 “信息检索工具”。

搜索进化需要用数据后训练吗

你的问题很关键!搜索进化(Self-evolving Search)是否需要数据后训练(比如 SFT、RL),核心看 “进化的深度”—— 浅层进化不用,深度进化必须用。我们用之前 “小周做市场调研” 的例子,结合模型逻辑通俗拆解:

一、不用数据后训练的 “浅层搜索进化”(临时优化,用完可能忘)

对应小周刚开始的 “搜索策略调整”,本质是 “单次任务中的临时适配”,不涉及模型参数更新:

- 场景:小周第一次搜 “新能源汽车市场” 结果杂乱,立刻调整为 “2025 中国新能源汽车市场规模 统计局数据”,精准找到数据;

- 对应模型:在一次任务中,通过上下文提示(比如用户说 “要权威数据”),临时把关键词从 “XX 市场” 改成 “XX 市场 2025 官网数据”,或切换搜索平台(从百度到行业数据库);

- 特点:这次搜得准,但下次换任务(比如 “智能手表市场调研”),可能还要重新想 “怎么拆关键词、去哪搜”—— 就像你临时记了一个搜题技巧,没反复练,下次可能忘。

- 核心:只在 “推理时” 调整策略,不更新模型参数,属于 “上下文内推理”,不用后训练。

二、必须用数据后训练的 “深度搜索进化”(技能内化,能泛化)

当小周要实现 “不管做什么行业调研,都能快速精准搜索”,或模型要 “自主应对复杂场景、持续优化搜索策略”,就需要数据后训练(SFT/RL),把临时技巧变成 “本能”:

1. 用 SFT(监督微调)实现 “搜索策略固化”

- 场景:小周把 “市场调研搜索流程”(拆目标→定关键词→选平台→交叉验证)整理成 “标准操作手册”,后续所有调研都按这个来,不用再想;

- 对应模型:收集大量 “成功搜索案例”(比如 “市场进入策略→拆分为规模 / 竞争 / 政策 / 用户→分别用‘关键词 + 限定条件’搜索→多源验证”),用这些数据做 SFT 训练 —— 模型参数被更新后,下次遇到 “做 XX 行业进入策略调研”,不用提示词引导,自动拆解目标、生成精准搜索指令;

- 例子:模型经过 SFT 后,用户说 “做 10-15 万家用新能源汽车进入策略调研”,它会自动生成一系列搜索子任务:“2025 10-15 万新能源汽车市场规模 艾瑞咨询”“比亚迪海豚 五菱缤果 市场份额”“新能源汽车电池安全认证 工信部政策”,不用人类手动拆解。

2. 用 RL(强化学习)实现 “搜索策略自主优化”

- 场景:小周通过反馈(比如 “从行业数据库搜的数据比新闻更权威,报告通过率高”),优化策略 —— 以后优先用行业数据库,再用官网,最后看新闻;

- 对应模型:用 RL 训练,把 “搜索结果的质量”(比如数据是否权威、是否能支撑决策)作为 “奖励信号”:搜对平台、拿到有效数据就给正向奖励,搜错平台、拿到无效信息就给负向奖励;

- 例子:模型用 RL 训练后,会自主优化:发现 “搜政策时,工信部官网比百度新闻快 3 倍、准确率高”,就优先调用官网搜索接口;发现 “搜用户画像时,调研公司报告比论坛评论更靠谱”,就自动过滤论坛信息 —— 这些优化不是人类教的,是模型通过 “奖励反馈” 自己学会的。

三、文档中 “Self-evolving Search” 的核心:必须结合数据后训练

文档里说的 “搜索进化”,不是指单次任务的临时关键词调整,而是 “搜索能力的持续提升”—— 比如 “自主拆解目标、动态优化搜索源、记忆指导搜索、跨任务泛化”,这必须依赖数据后训练:

- 比如文档中提到的 “Search-R1”,就是通过 RL 训练,让模型学会 “在实时网页环境中,动态调整搜索策略(比如什么时候深度搜、什么时候广度搜)”,而不是每次都从零开始;

- 再比如 “DeepResearcher”,通过 RL 训练,模型能自主 “规划搜索路径→验证信息→补充搜索缺口”,形成闭环进化 —— 这些都需要用大量搜索轨迹数据做后训练,才能把策略固化到模型参数中。

一句话总结

- 浅层进化(临时调关键词、换平台):不用数据后训练,像临时记个技巧;

- 深度进化(策略固化、自主优化、跨任务泛化):必须用数据后训练(SFT/RL),像反复练习后把技巧变成本能 —— 这才是文档中 “搜索进化” 的核心,也是智能体从 “会搜” 到 “精通搜” 的关键。

所以并不存在自我进化,所有的进化都是需要算法工程师收集数据微调模型,可以这么理解吗

当前文件内容过长,豆包只阅读了前 61%。

这个理解不完全准确—— 文档中的 “自我进化” 不是 “模型自己无中生有进化”,而是 “在工程师设定的框架下,模型能自主积累经验、优化策略,无需工程师每次都手动收集数据微调”,核心是 “减少人工干预,让进化过程自动化”,而非 “完全脱离人类设计”。

我们用 “学生自学 vs 老师手把手教” 的类比,把这个逻辑拆透:

一、先明确:“进化” 的核心是 “能力提升的过程自动化”,而非 “脱离人类”

文档中所有 “自进化”(包括工具调用、搜索、规划进化)的本质是:

- 工程师先搭建 “进化框架”(比如 “反馈→记忆→优化” 的循环、奖励机制、数据存储方式);

- 模型在这个框架内,自主收集经验数据、自主更新策略,不用工程师每次都手动筛选数据、触发微调;

- 不是 “模型自己创造进化规则”,而是 “规则由工程师定,执行和数据积累由模型自主完成”。

二、和 “工程师手动收集数据微调” 的关键区别

表格

| 对比维度 | 工程师手动微调(传统方式) | 文档中的 “自进化”(自动化方式) |

|---|---|---|

| 数据来源 | 工程师手动筛选、标注数据(比如手动收集 1000 个 “正确搜索案例”) | 模型自主收集经验数据(比如搜索时自动记录 “哪个关键词有效、哪个平台靠谱”,无需人工标注) |

| 触发方式 | 工程师决定 “什么时候微调”(比如积累够数据后,手动启动 SFT/RL 训练) | 模型自主触发优化(比如每完成 10 次搜索任务,自动用积累的经验数据更新策略) |

| 人工干预 | 高(需要持续筛选数据、调整微调参数) | 低(工程师只搭框架,后续进化由模型自主完成) |

| 进化速度 | 慢(依赖人工周期) | 快(实时积累经验,实时优化) |

三、用 “小周做市场调研” 的例子再具象化

1. 工程师手动微调的场景:

- 小周第一次做调研搜得差,工程师看到后,手动收集 “小周的错误搜索案例 + 正确案例”,标注成 “关键词拆解手册”,再用这些数据微调模型;

- 小周下次做调研,还是要等工程师微调完,才能用新策略 —— 模型自己不会主动总结经验。

2. 文档中 “自进化” 的场景:

- 工程师给小周(模型)设定好 “进化框架”:① 每次搜索后,自动记录 “关键词 + 搜索结果质量”;② 每周自动用这些记录,通过 RL 更新 “关键词拆解规则”(比如 “搜市场规模时,加‘统计局 / 行业数据库’更有效”);③ 把有效策略存到记忆库,下次直接用;

- 小周第一次搜得差,不用工程师管:第二次做调研时,会自动复用上次总结的 “精准关键词”;每周还会自动优化策略,越用越准 —— 整个过程工程师没手动收集数据、没手动触发微调,是模型自主完成的。

四、关键澄清:“自我进化” 不是 “无人工”,而是 “少人工、自动化”

- 工程师的核心作用是 “搭舞台”:设定进化的规则(比如什么是 “好策略” 的奖励信号、经验数据怎么存储、用什么算法更新),而非 “亲自下场教”;

- 模型的核心作用是 “在舞台上自主表演”:自主积累经验、自主更新策略,无需工程师每一步干预;

- 不存在 “完全脱离工程师的自我进化”—— 框架、算法、初始能力还是人类设计的,但进化的 “执行过程” 是模型自主完成的。

五、回到你的疑问:“所有进化都需要算法工程师收集数据微调” 吗?

- 传统方式:是,每次进化都需要工程师手动收集数据、触发微调;

- 文档中的 “自进化”:不需要工程师每次手动收集数据微调,模型会在预设框架内,自主收集经验数据、自主完成策略更新(比如通过 “在线 RL” 实时优化,或 “记忆库 + 推理时策略调整”);

- 但 “框架和初始规则由工程师设计”—— 这是前提,不是模型自己凭空创造的。

一句话总结

文档中的 “自我进化” 是 “工程师搭好进化的‘自动扶梯’,模型自己站上去就能往上走”,而不是 “模型自己造扶梯往上走”;它减少了人工干预,让进化过程自动化,但没有完全脱离人类设计 —— 这才是 “自进化” 的核心,而非 “模型自己无中生有进化”。

5. Collective Multi-agent Reasoning

第五部分 集体多智能体推理(Collective Multi-agent Reasoning)核心总结

集体多智能体推理是将智能体从 “单独工作” 升级为 “协同作战” 的范式 —— 通过明确角色分工、结构化协作机制和共享记忆,让多个智能体各司其职、互补配合,共同解决单个智能体难以完成的复杂任务,核心是 “分布式推理 + 协同优化”,而非多个智能体简单叠加。

5.1. 多智能体系统(MAS)的角色分类法-Role Taxonomy of Multi-Agent Systems (MAS)

5.1.1. Generic Roles

5.1.2. 特定领域的角色

5.2. 协作与分工

5.2.1. 非训练协作-In-context Collaboration

我们用 “临时组建小组完成校园活动策划” 的场景,通俗理解 5.2.1 上下文内协作(In-context Collaboration)—— 核心是 “不用提前训练‘怎么配合’,也不用更新智能体的‘底层能力’(参数),只在执行当前任务时,通过明确的指令、流程或实时协调,让多个智能体快速组队干活”,就像临时凑了一群有各自技能的人,没提前排练,靠现场分工和沟通完成任务。

具体例子:策划 “校园春季音乐节”(3 个智能体临时协作)

假设只有 3 个智能体,分别对应 “活动策划师(领导者)、执行员、审核员”,没有提前训练过 “怎么一起做音乐节策划”,全靠 “任务上下文”(比如用户需求、实时沟通)动态配合:

1. 核心前提:不训练、不更新参数,只靠 “现场协调”

- 3 个智能体的底层能力都是固定的(策划师会拆任务、执行员会找资源、审核员会查风险),但之前没合作过;

- 协作的关键是 “在当前任务的‘上下文’里,明确谁做什么、怎么配合”,不用工程师提前微调模型 —— 就像临时组队的学生,各自有特长,但没提前排练,靠现场沟通分工。

2. 两种典型协作模式(对应文档核心内容)

(1)手动设计流水线(预设固定流程,按步骤协作)

就像老师提前给小组定好 “工作 SOP”,大家按流程走,不用临场商量:

- 预设流程:策划师拆任务 → 执行员落地 → 审核员校验 → 策划师最终确认;

- 具体协作:

- 策划师(领导者)根据 “校园音乐节” 需求,拆分子任务:“确定场地、联系乐队、制定宣传方案、申请经费”,并把前 3 个任务分给执行员;

- 执行员(执行者)按顺序完成:先联系学校体育馆确认场地(4 月 20 日可用),再联系 3 支校园乐队(均同意参加),最后做宣传方案(抖音 + 校园海报);

- 审核员(评估者)逐一校验:“场地容量够 1000 人,符合要求”“乐队风格适配学生群体”“宣传方案没违规,但预算超了 500 元”;

- 策划师收到审核意见,让执行员把宣传方案里的 “抖音投流” 改成 “校园广播”,降低预算,最终形成完整策划案;

- 特点:流程固定、分工明确,不用智能体临场决策 “该谁做”,像按剧本演戏,适合任务逻辑清晰的场景。

(2)LLM 驱动动态编排(一个 “总协调智能体” 实时控场)

就像小组里有个灵活的 “组长”,根据任务进展实时调整分工,不用死守固定流程:

- 总协调者:还是策划师智能体,但不预设固定步骤,而是根据实时情况动态分配任务;

- 具体协作:

- 策划师先明确核心目标:“3 周内办完音乐节,预算 5000 元,吸引至少 800 人参加”;

- 临场判断:“现在最紧急的是定场地,否则乐队没法确认时间”,先让执行员联系场地;

- 执行员反馈:“体育馆 4 月 20 日被占用了,只有 4 月 27 日可用”;

- 策划师实时调整:“那就定 4 月 27 日,执行员立刻联系乐队确认这个时间是否可行,同时审核员查一下 4 月 27 日是否有其他校园活动冲突”;

- 审核员反馈:“4 月 27 日没有冲突,但需要提前 1 周提交安全预案”;

- 策划师继续分配:“执行员联系乐队的同时,同步写安全预案;审核员先准备预案的校验标准,等执行员写完直接审核”;

- 特点:流程灵活,能根据任务中的突发情况(比如场地冲突)动态调整分工,不用按固定步骤死磕,适合复杂、多变的场景。

(3)理论心智(ToM)协作(智能体 “猜对方想法”,主动配合)

就像小组成员不用明说,能猜到对方的需求,主动补位:

- 执行员联系乐队时,发现有 1 支乐队要求 “提供音响设备”,但没收到策划师的相关指令;

- 执行员根据 “音乐节需要音响” 的常识,主动询问策划师:“是否需要申请音响设备?预算大概多少?”(而不是等策划师主动安排);

- 审核员知道 “执行员可能没考虑到音响的功率适配问题”,提前准备好 “校园活动音响安全标准”,等执行员提交设备申请后,直接校验是否合规;

- 特点:智能体能推断其他智能体的 “需求和能力缺口”,主动配合,减少沟通成本 —— 不用事事都等总协调者指令。

对应文档中 In-context Collaboration 的核心特点

- 不更新参数:协作只发生在 “当前任务的推理过程中”,智能体的底层能力(比如策划师的拆任务能力、执行员的资源对接能力)没有变化,下次换个任务(比如策划辩论赛),还是靠现场协调;

- 临时适配:不用提前训练 “协作策略”(比如不用专门训练 “策划师和执行员怎么沟通”),全靠任务上下文(用户需求、实时反馈)动态调整;

- 低成本启动:快速组队、快速执行,适合 “一次性任务” 或 “突发任务”—— 比如临时要做一个活动策划、写一篇多领域综述,不用花时间训练协作模型。

再类比 LLM 的应用场景(写一篇 “AI + 医疗” 综述)

- 3 个智能体:“选题组长、文献检索员、内容整合员”,没提前训练过协作;

- 手动流水线:组长定综述框架(AI 在诊断、治疗、药物研发的应用)→ 检索员找对应文献 → 整合员写内容 → 组长审核修改;

- 动态编排:组长发现 “药物研发部分的文献很少”,让检索员优先补充这部分,同时让整合员先写诊断和治疗部分,不用等所有文献齐了再动手;

- 核心:不用工程师微调模型,只靠任务中的指令和反馈,让智能体快速配合完成任务。

一句话总结:In-context Collaboration 就是 “智能体的临时组队干活”—— 不用提前训练配合技巧,也不用更新能力,靠现场的流程设计、实时协调或常识推断,快速完成复杂任务,适合灵活、短期的协作场景。

5.2.2. 后训练协作-Post-training Collaboration

我们用 “专业团队长期服务客户” 的场景,通俗理解 5.2.2 训练后协作(Post-training Collaboration)—— 核心是 “提前通过训练(SFT/RL),把‘怎么配合’的策略固化到智能体的‘底层能力’(参数)里”,就像公司的核心团队经过长期磨合、培训,形成了默契的工作模式,不用每次接任务都重新沟通分工,协作效率更高、更稳定。

具体例子:数字营销 agency 长期服务某品牌(4 个智能体组成固定团队)

假设团队有 4 个智能体:“账户总监(领导者)、内容策划、投放专员、数据分析师”,专门服务某快消品牌的线上营销,提前通过训练固化了协作模式,不用每次做 campaign 都重新协调。

1. 核心前提:提前训练、更新参数,把协作策略 “内化成本能”

- 团队成立初期,可能也像 “上下文内协作” 那样临时沟通,但通过多次服务后,工程师会收集 “成功的协作案例、沟通话术、分工逻辑”,用这些数据做 SFT(监督微调)或 RL(强化学习);

- 训练后,智能体的底层参数被更新 —— 比如 “投放专员” 收到 “内容策划” 的文案后,会自动按 “快消品投放规则” 选择渠道,不用 “账户总监” 再特意指令;“数据分析师” 会自动在投放后 24 小时内出报告,不用等催促;

- 就像专业营销团队经过长期合作,形成了 “不用多说” 的默契,协作变成 “本能反应”,而不是每次都临时商量。

2. 两种典型协作模式(对应文档核心内容)

(1)提示词优化训练(明确角色职责和配合规则)

就像公司给每个岗位制定 “详细工作手册 + 协作规范”,通过培训让大家烂熟于心:

- 训练数据:工程师整理 “协作规范文档”,比如:

- 账户总监:收到客户需求后,2 小时内拆解成 “内容主题、投放预算、目标人群”,并同步给所有成员;

- 内容策划:收到拆解任务后,1 天内出 3 套文案 + 视觉方案,标注 “适配渠道(抖音 / 小红书)”;

- 投放专员:收到方案后,自动匹配 “抖音投流定向(18-35 岁女性)、小红书关键词(平价快消、日常好物)”,不用再问;

- 数据分析师:投放后 24 小时内,输出 “各渠道转化率、人群画像”,重点标注 “是否达成客户目标(ROI≥1.5)”;

- 训练过程:用这些 “规范 + 案例” 做 SFT 训练,让每个智能体都知道 “自己该做什么、什么时候做、和别人怎么配合”;

- 具体协作(服务客户 “夏季新品推广” 需求):

- 账户总监收到需求,2 小时内拆解:“主题:清爽夏日好物;预算:10 万;目标:ROI≥1.5,触达 50 万用户”,同步给所有人;

- 内容策划 1 天内出 3 套方案,标注 “抖音版(活泼口播)、小红书版(图文测评)”;

- 投放专员自动按 “快消品规则”,把抖音预算占比 70%(定向 18-35 岁女性)、小红书占比 30%(关键词投放),直接启动投放;

- 数据分析师 24 小时后出报告:“抖音 ROI 1.8,小红书 ROI 1.3,整体达标”,并标注 “小红书可优化关键词”;

- 账户总监根据报告,让投放专员把小红书预算调整为 20%,补充抖音预算,全程不用额外沟通 —— 协作流程自动推进;

- 特点:规则明确、协作高效,减少冗余沟通,适合长期服务同一类客户、任务模式固定的场景。

(2)拓扑优化 + 策略学习(通过训练优化 “沟通结构” 和 “配合策略”)

就像团队通过长期实践,优化 “谁和谁直接沟通、遇到问题怎么快速解决”,不用所有人都参与每一个环节:

- 训练目标:让智能体知道 “哪些角色需要直接对接,哪些可以间接传递信息”,以及 “遇到问题时该找谁快速解决”;

- 训练过程(RL 强化学习):

- 奖励信号:“协作流程耗时短”“客户满意度高”“没出现信息脱节” 就给正向奖励;

- 优化结果:固化 “核心沟通链路”—— 内容策划→投放专员(直接对接方案细节)、投放专员→数据分析师(直接同步投放数据)、数据分析师→账户总监(汇总结果),不用所有人拉群沟通;

- 同时优化 “问题处理策略”:比如投放专员发现 “抖音投流成本突然上涨”,会自动先找数据分析师查原因(而不是先问账户总监),分析师 1 小时内反馈 “是人群竞争加剧”,投放专员自动调整定向(新增 “二三线城市”),再同步给账户总监 —— 不用层层上报;

- 具体协作(突发情况处理):

- 投放专员启动 “夏季新品推广” 后,发现抖音投流成本比预期高 30%;

- 按训练好的策略,直接找数据分析师查原因;

- 数据分析师 1 小时内反馈:“18-35 岁一线城市女性竞争激烈,成本上涨”;

- 投放专员自动调整定向:新增 “18-35 岁二三线城市女性”,降低投流成本;

- 调整后 2 小时,数据分析师自动同步 “成本回归正常,转化率保持 1.8”;

- 账户总监全程只收到最终同步,不用参与中间问题处理 —— 协作更高效;

- 特点:沟通结构优化、问题处理流程固化,减少冗余环节,适合复杂、高频的长期协作场景。

对应文档中 Post-training Collaboration 的核心特点

- 更新参数:通过 SFT/RL 训练,把协作规则、沟通链路、问题处理策略固化到智能体参数里,变成 “本能”;

- 长期稳定:训练后,不管接多少次同类任务,智能体都能按固定的高效模式协作,不用每次都重新协调;

- 低沟通成本:因为提前训练了 “谁做什么、找谁对接”,减少了临场沟通的时间和误差;

- 适合长期协作:比如固定团队服务固定客户、长期做某类任务(如科研实验、代码开发),训练一次能反复复用。

和 “上下文内协作” 的核心区别(一句话分清)

- 上下文内协作:临时组队,临场沟通,适合 “一次性、突发任务”(比如临时策划一场校园活动);

- 训练后协作:专业团队,提前磨合,适合 “长期、高频任务”(比如长期服务某品牌的营销)。

一句话总结:Post-training Collaboration 就是 “智能体的专业团队协作”—— 通过提前训练把协作模式内化成本能,像磨合好的职场团队一样高效配合,不用每次都重新 “组队沟通”。

5.3. 多智能体进化-Multi-Agent Evolution

5.3.1. From Single-Agent Evolution to Multi-Agent Evolution

我们用 “个人创业→组建团队共同发展” 的场景,通俗理解 5.3.1 从单智能体进化到多智能体协同进化(From Single-Agent Evolution to Multi-Agent Evolution)—— 核心是 “进化的范围从‘单个智能体自己变强’,扩展到‘整个智能体团队一起变好’”:单智能体进化是 “一个人默默升级技能”,而多智能体协同进化是 “团队不仅每个人技能提升,还能一起优化配合模式,形成‘1+1>2’的集体能力”。

具体例子:从 “个人做电商” 到 “电商团队协同发展”

1. 先看:单智能体进化(个人创业阶段)

假设一开始只有 “电商运营” 一个智能体,负责 “选品、上架、客服、发货” 全流程:

- 进化方式:自己做、自己复盘、自己升级 —— 比如第一次选品卖得差,就记住 “这类产品不受欢迎”,下次换选品;客服经常被问 “发货时间”,就自己整理 “自动回复模板”,下次直接用;

- 核心:进化只围绕 “单个智能体的技能”,没有协作,也不用考虑别人 —— 就像个人创业,所有事自己扛,进步全靠自己总结经验。

2. 再看:多智能体协同进化(组建团队后)

后来业务扩大,组建了 4 人团队:“选品专员、运营、客服、仓储专员”,进化就变成了 “个人技能 + 团队配合” 双升级,甚至出现 “团队专属的集体能力”:

(1)第一步:个人技能跟着团队需求进化(同步升级)

- 选品专员:原来只懂 “选热门产品”,加入团队后,发现 “运营需要提前 1 周拿到选品清单做推广”,于是进化出 “提前规划选品节奏” 的技能;还根据 “仓储专员反馈‘大件产品发货成本高’”,进化出 “优先选小件高毛利产品” 的策略;

- 客服:原来只懂 “回复用户问题”,现在根据 “运营的推广节奏”,进化出 “主动推荐关联产品” 的技能(比如用户问 A 产品,顺便推荐搭配的 B 产品),还会把 “高频用户投诉(如‘包装破损’)” 同步给仓储专员;

- 核心:每个智能体的进化不再 “单打独斗”,而是 “跟着团队的协作需求走”—— 选品专员的进化要配合运营和仓储,客服的进化要配合运营,个人技能升级服务于团队目标。

(2)第二步:团队配合模式一起进化(集体能力升级)

这是多智能体协同进化的核心 —— 不仅个人变强,“怎么配合” 也会自主优化,形成团队专属的默契:

- 初始配合:选品专员选好产品→运营上架→客服回复→仓储发货,流程固定,遇到问题要层层上报(比如客服收到 “产品缺货投诉”,要先告诉运营,运营再通知选品专员调整);

- 进化后的配合:

- 客服收到 3 次 “某产品缺货” 投诉,自动同步给仓储专员和选品专员(不用经过运营);

- 仓储专员实时更新库存数据到共享记忆库,选品专员看到库存不足,自动调整选品计划(下次少选这类易缺货产品);

- 运营看到选品调整,自动调整推广方案(不再给缺货产品投流);

- 背后的训练逻辑:工程师收集 “团队协作的成功案例(比如快速处理缺货问题)”,用 RL 训练整个团队 —— 让 “客服→仓储→选品” 形成直接沟通链路,不用冗余上报,配合模式越来越高效;

- 核心:团队进化出了 “单个智能体没有的集体能力”—— 比如 “快速响应市场反馈的协同机制”,这不是某一个智能体单独能做到的,而是团队配合进化的结果。

(3)第三步:跨任务协同进化(能力迁移 + 集体沉淀)

团队长期做电商业务,还会把 “协作经验” 沉淀成 “集体记忆”,迁移到新任务中:

- 集体记忆沉淀:把 “处理缺货的协同流程”“选品 - 运营 - 仓储的配合节奏”“客服 - 运营的关联推荐话术” 都存到共享记忆库;

- 新任务迁移:后来团队拓展 “直播带货” 业务,不用重新设计协作模式 —— 选品专员提前给运营提供 “直播选品清单”,客服准备 “直播常见问题话术”,仓储专员提前备货,直接复用之前进化好的协作逻辑,还能根据直播场景优化(比如仓储专员根据直播预估销量备货);

- 核心:多智能体协同进化会形成 “可复用的集体经验”,让团队在新任务中快速起步,进化效率比单智能体高得多。

对应文档中核心特点

- 进化范围扩大:从 “单个智能体的技能升级”,扩展到 “个人技能 + 团队配合 + 集体记忆” 的全方位升级;

- 进化动力联动:单个智能体的进化会触发其他智能体的进化(比如客服的投诉反馈,触发选品和仓储的进化),形成 “联动进化循环”;

- 涌现集体能力:团队会进化出单个智能体没有的能力(比如快速响应市场的协同机制、跨环节的问题处理流程);

- 时间维度延伸:不仅有 “任务内的快速适配( intra-test-time evolution ,比如直播时调整备货)”,还有 “跨任务的长期积累( inter-test-time evolution ,比如从普通电商到直播电商的经验复用)”。

和单智能体进化的核心区别

表格

| 对比维度 | 单智能体进化 | 多智能体协同进化 |

|---|---|---|

| 进化主体 | 单个智能体 | 单个智能体 + 整个团队 |

| 进化内容 | 自身技能(比如选品、客服技巧) | 个人技能 + 协作模式 + 集体记忆 |

| 进化动力 | 自身的任务反馈 | 自身反馈 + 其他智能体的反馈 + 团队目标 |

| 核心能力 | 个人高效完成单一任务 | 集体攻克复杂任务(需多环节配合) |

| 例子 | 个人电商运营学会 “选热门品” | 电商团队进化出 “选品 - 推广 - 发货 - 售后” 的高效协同机制 |

一句话总结:从单智能体进化到多智能体协同进化,就是 “从一个人升级,变成一个团队一起升级”—— 不仅每个人技能变强,还能一起优化配合模式、沉淀集体经验,最终形成 “单个智能体无法企及的集体能力”,应对更复杂的任务。

5.3.2. Multi-agent Memory Management for Evolution

我们用 “创业公司团队发展” 的场景,通俗理解 5.3.2 多智能体进化的记忆管理(Multi-agent Memory Management for Evolution)—— 核心是 “多智能体团队要一起‘记事情’,但不是乱记,而是有组织、有策略地管理‘集体记忆’”,让记忆既能支撑每个智能体的个人进化,又能推动整个团队的协作进化,避免 “各记各的、信息脱节” 或 “记忆杂乱、用不上”。

具体例子:电商创业团队的记忆管理(4 个智能体:选品、运营、客服、仓储)

团队要长期发展,需要记住的信息很多:“哪些产品好卖、用户常投诉什么、库存预警阈值、推广节奏” 等。如果每个智能体各自记各自的,会出现 “客服忘了用户之前的投诉,仓储不知道运营的推广计划”—— 多智能体记忆管理就是解决 “集体记忆怎么存、怎么共享、怎么用” 的问题,让记忆成为团队进化的 “燃料”。

1. 记忆管理的 4 个核心维度(对应文档框架)

就像公司的 “档案管理系统 + 知识共享平台”,要解决 “怎么建、存在哪、记什么、怎么维护” 的问题:

(1)架构:记忆怎么组织?(Hierarchical/Flat 分层 / 扁平)

- 扁平架构:所有记忆都存在一个 “共享文件夹” 里,比如 “2025 年 5 月爆款产品清单”“用户投诉记录”“库存数据” 混在一起,谁要用都能查 —— 适合小团队、信息少的阶段,但信息多了会乱;

- 分层架构(进化后):按 “重要性 + 用途” 分层管理,比如:

- 核心层(公司级知识):“选品标准(小件高毛利)”“推广黄金时段(晚 8-10 点)”“售后赔付规则”(所有人都能看,不能随便改);

- 部门层(角色专属知识):客服的 “高频问题话术库”、仓储的 “发货流程规范”(只有对应角色能修改,其他人可查看);

- 任务层(临时任务记忆):“618 大促备货清单”“直播选品节奏”(任务结束后归档,方便后续复用);

- 核心作用:让每个智能体快速找到自己需要的记忆,不用在杂乱信息里翻找 —— 比如选品专员要做 618 选品,直接查 “核心层选品标准 + 任务层去年 618 归档”,效率翻倍。

(2)拓扑:记忆存在哪?(Centralized/Distributed 集中 / 分布式)

- 集中式:所有记忆存在一个 “中央数据库”(比如公司的共享云盘),由专门的 “记忆管理者” 维护 —— 优点是信息统一,不会出现 “客服记的库存和仓储记的不一样”;缺点是一旦数据库出问题,所有人都用不了;

- 分布式:每个智能体有自己的 “本地记忆”,同时同步关键信息到 “中央库”—— 比如客服本地记 “最近 3 天的用户投诉”,每天同步到中央库;仓储本地记 “实时库存”,关键预警(如库存低于 50 件)同步给所有人;

- 进化后的混合模式:“核心信息集中存,临时信息分布式存”—— 比如 “选品标准”“赔付规则” 集中管理(确保统一),“客服的临时沟通记录”“仓储的日常操作日志” 本地存储(灵活),既保证一致性,又不影响灵活性。

(3)内容:该记什么?(Semantic/Procedural 语义 / 流程)

- 语义记忆:记 “事实性信息”,比如 “2025 年 4 月爆款产品 A 销量 1 万件”“用户投诉 TOP3:包装破损、发货慢、功能不符”“宁德时代电池合作起订量 10 万组”—— 是团队的 “知识库”;

- 流程记忆:记 “怎么做事的步骤”,比如 “处理用户投诉的流程(接投诉→查订单→协调仓储 / 选品→赔付)”“推广 - 仓储配合流程(运营提前 3 天告知推广计划→仓储备货)”—— 是团队的 “操作手册”;

- 进化点:从 “只记事实” 到 “事实 + 流程 + 经验” 一起记 —— 比如不仅记 “产品 A 爆款”,还记 “产品 A 成为爆款的原因(运营在晚 8 点推广 + 选品符合年轻用户偏好)”,下次选品、推广能直接复用经验。

(4)管理:怎么维护记忆?(Filter/Summarize/Verify 筛选 / 总结 / 验证)

- 筛选(忘记没用的):定期清理无效记忆,比如 “2023 年的过时选品清单”“只出现 1 次的用户特殊投诉”—— 避免记忆过载,就像公司清理旧档案;

- 总结(提炼有用的):把零散记忆变成结构化知识,比如客服把 “100 条用户投诉” 总结成 “TOP3 投诉类型 + 应对方案”,仓储把 “多次库存不足的教训” 总结成 “爆款产品库存预警阈值(销量的 2 倍)”—— 让记忆更易复用;

- 验证(确保准确的):对关键记忆做校验,比如选品专员记 “产品 B 能爆款”,要通过 “运营的推广数据 + 仓储的发货量” 验证,避免 “记错信息” 误导团队 —— 比如之前认为 “产品 C 好卖”,但数据验证后发现是偶然订单,就不会再作为选品依据;

- 核心作用:让集体记忆 “干净、有用、准确”,避免 “记了白记” 或 “记了错的”,真正支撑团队进化。

2. 记忆管理如何推动团队进化?

- 例子 1:客服通过记忆管理,发现 “最近 1 个月‘包装破损’投诉增加 30%”,总结后同步到中央库;仓储看到后,调取 “发货流程记忆”,发现是 “新打包员没按标准操作”,于是更新 “发货流程规范”,并记住 “新员工需培训后上岗”—— 记忆驱动仓储的流程进化,同时减少客服的投诉处理压力;

- 例子 2:运营要做 “618 推广计划”,通过记忆库查到 “去年 618 晚 8-10 点推广转化率最高”“爆款产品 A 备货不足导致缺货损失”,于是制定 “晚 8-10 点重点推广 + 爆款备货量为平时的 3 倍” 的计划,同时同步给选品和仓储 —— 记忆驱动运营的策略进化,还提前协调了其他角色的工作;

- 核心:记忆不再是 “死数据”,而是通过 “组织 - 存储 - 内容 - 维护” 的全流程管理,变成 “活的知识”,既让每个智能体知道 “自己该怎么做”,又让整个团队知道 “怎么配合”,推动个人和团队一起进化。

对应文档中核心特点

- 记忆服务于进化:不是为了 “记而记”,而是为了支撑团队的协作进化 —— 比如通过记忆复用经验、避免重复犯错、优化配合流程;

- 兼顾个体与集体:既保留角色专属记忆(比如客服的话术库),又有集体共享记忆(比如选品标准),避免 “各扫门前雪”;

- 动态维护:记忆会 “更新、清理、提炼”,不是一成不变 —— 比如过时的选品清单会删,新的投诉规律会加,让记忆始终适配团队发展;

- 多维度协同:架构、拓扑、内容、管理四个维度配合,比如 “分层架构 + 混合拓扑 + 事实 + 流程内容 + 定期筛选”,确保记忆 “好用、能用、够用”。

一句话总结:多智能体进化的记忆管理,就是给团队搭建一套 “智能档案系统”—— 有组织地存、有策略地共享、有方法地维护集体记忆,让记忆成为团队进化的 “共同财富”,而不是 “各自的碎片信息”,最终支撑团队持续变好。

5.3.3. Training Multi-agent to Evolve

我们用 “职业球队长期训练 + 打比赛” 的场景,通俗理解 5.3.3 训练多智能体协同进化(Training Multi-agent to Evolve)—— 核心是 “通过专门的训练方法(比如协同微调、强化学习),让多智能体团队不仅‘各自技能变强’,更能‘一起学会怎么配合着变强’”,就像球队通过 “战术训练 + 实战复盘”,让球员既提升个人技术,又形成默契的团队战术,最终整体实力远超 “单个球员能力之和”。

具体例子:电商团队的协同进化训练(4 个智能体:选品、运营、客服、仓储)

团队要从 “能完成任务” 进化到 “高效应对复杂场景(如大促、突发投诉潮)”,不能只靠自然磨合,需要工程师设计专门的训练方案,让团队 “有目标、有反馈、有方法” 地一起进化。

1. 核心前提:训练的目标是 “集体能力提升”,而非单个智能体孤立升级

- 单智能体训练:比如只训练 “选品专员” 怎么选爆款,或只训练 “客服” 怎么快速回复 —— 但可能出现 “选品选了大件产品,仓储发货效率低;客服承诺快速发货,仓储跟不上” 的配合问题;

- 多智能体协同训练:训练的核心是 “团队整体目标”(比如 “大促期间 ROI≥2.0、用户投诉率≤1%”),让每个智能体的升级都服务于集体目标,同时学会 “配合别人的节奏”。

2. 三种典型训练方式(对应文档核心内容)

(1)协同微调(SFT):给团队 “统一战术手册”,一起练熟

就像球队教练给全队制定 “战术手册”,让所有球员按统一规则训练,形成固定默契:

- 训练数据:工程师收集 “团队成功协作的案例”,整理成 “协同规则 + 示范流程”,比如:

- 大促场景协同流程:选品专员提前 2 周确定爆款清单→运营提前 1 周制定推广计划并同步仓储→仓储提前 3 天备货→客服提前 1 天准备专属话术→大促期间客服实时同步投诉给仓储 / 选品;

- 突发缺货协同规则:客服收到缺货投诉→10 分钟内同步给仓储和运营→仓储标注库存状态→运营暂停该产品推广→选品专员推荐替代产品;

- 训练过程:用这些 “协同案例” 对所有智能体做联合微调 —— 不是单独训练某个智能体,而是让每个智能体都知道 “在某个场景下,自己该做什么、什么时候配合别人、怎么响应别人的动作”;

- 训练效果:下次遇到大促或缺货,团队不用临时沟通,会自动按训练好的流程配合 —— 比如选品专员一确定爆款,运营就自动启动推广计划,仓储同步备货,形成 “条件反射式协作”。

(2)多智能体强化学习(MARL):让团队 “打实战、靠反馈自己优化”

就像球队通过 “打友谊赛 + 赛后复盘”,根据比赛结果调整战术,不用教练每次都手把手教:

- 训练设定:

- 目标(奖励信号):团队整体 KPI(如 “大促 ROI≥2.0、投诉率≤1%、发货及时率≥99%”)—— 只有团队达标,所有智能体才会获得 “正向奖励”;

- 实战场景:模拟复杂场景(如 “618 大促 + 突发爆款缺货 + 用户投诉潮”),让团队在模拟环境中协作;

- 训练过程:

- 第一次模拟:团队按原有模式协作,出现 “选品没提前同步仓储→爆款缺货→投诉率飙升→ROI 不达标”,获得 “负向奖励”;

- 复盘优化:工程师设计的算法让团队自动分析失败原因(“选品和仓储配合滞后”),调整协作策略(“选品专员提前 3 周同步清单”);

- 反复迭代:多次模拟实战后,团队逐渐优化出 “选品 - 仓储 - 运营 - 客服” 的最佳配合节奏,甚至能自主调整(比如根据库存情况,运营自动调整推广力度);

- 训练效果:团队不仅能应对训练过的场景,还能泛化到新场景(如 “双 11 大促 + 物流延迟”)—— 比如客服收到物流投诉后,自动同步给运营和仓储,运营暂停推广,仓储加急发货,形成自主协作的闭环。

(3)角色 specialization 训练:让团队 “各扬所长 + 精准配合”

就像球队训练时,让前锋练射门、后卫练防守、中场练传球,同时练 “前锋和中场的传切配合”:

- 训练逻辑:每个智能体有专属 “角色目标”,同时绑定 “团队配合目标”—— 比如:

- 选品专员的专属目标:选品爆款率≥60%,同时配合目标:清单提前 3 周同步;

- 仓储专员的专属目标:发货及时率≥99%,同时配合目标:实时同步库存给选品和运营;

- 训练过程:

- 先单独强化每个智能体的 “专属技能”(如选品专员练 “热门产品识别”,仓储专员练 “快速备货”);

- 再训练 “角色间的配合”(如选品和仓储的 “清单同步 - 备货” 配合,客服和运营的 “投诉反馈 - 推广调整” 配合);

- 训练效果:团队既 “每个人都专业”,又 “配合无死角”—— 比如选品专员选的爆款,仓储能快速备货;客服反馈的问题,运营能及时响应,不会出现 “个人强、团队弱” 的情况。

3. 训练后的核心进化效果

- 涌现集体能力:团队进化出单个智能体没有的能力 —— 比如 “大促期间的全链路协同优化”(选品→推广→备货→售后的动态调整),这不是某一个智能体能做到的,而是训练后形成的集体能力;

- 自主协同进化:训练后,团队不用工程师再手动调整,能通过实战反馈持续优化 —— 比如某次大促出现 “新用户投诉‘产品说明不清’”,客服同步给选品和运营,选品优化产品说明,运营在推广中补充说明,下次就不会再出现类似问题;

- 抗风险能力提升:面对复杂突发情况,团队能快速响应 —— 比如 “爆款产品突然断供”,仓储实时同步,运营立刻暂停推广,选品推荐替代产品,客服统一回复话术,整个过程无需人工干预,快速化解危机。

对应文档中核心特点

- 训练目标是 “集体最优”:不是单个智能体性能最大化,而是团队整体目标达成(如 ROI、投诉率);

- 训练方式是 “协同导向”:通过联合微调、强化学习、角色 specialization,让智能体 “学会配合”;

- 进化结果是 “自主协同”:训练后,团队能在实战中自主优化配合模式,持续进化,不用工程师反复干预;

- 核心价值是 “突破单个智能体边界”:形成 “1+1>2” 的集体能力,应对单个智能体无法解决的复杂场景。

和单智能体训练的核心区别

表格

| 对比维度 | 单智能体训练 | 多智能体协同训练 |

|---|---|---|

| 训练目标 | 单个智能体技能最大化(如选品爆款率) | 团队整体目标最大化(如大促 ROI + 低投诉率) |

| 训练数据 | 单个智能体的成功案例 | 团队协同的成功 / 失败案例 |

| 训练重点 | 自身技能升级 | 自身技能 + 团队配合 |

| 进化结果 | 单个智能体变强 | 单个智能体变强 + 团队集体能力涌现 |

一句话总结:训练多智能体协同进化,就是 “给团队做专业的‘战术训练 + 实战复盘’”—— 让每个智能体既提升专属技能,又学会和别人精准配合,最终形成 “自主协作、持续进化” 的集体能力,应对更复杂的任务。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)