还是太香了,LSTM结合transformer发文,二区轻松水出三篇!

LSTM+Transformer的结合正在为单目 3D 车道检测带来新突破!这个Temporal-Anchor3DLane 框架在 Anchor3DLane 基础上完成核心升级,精准解决了传统锚点式 3D 车道检测存在的回归异常值敏感、全局曲线几何监督薄弱、多损失项难以平衡和时间连续性利用不足等行业痛点,用轻量级 Temporal LSTM Fusion 模块替代重参数量的 Transformer 式时序融合,搭配融合 Balanced L1、Chamfer 点集距离和基于不确定性损失加权的多任务损失套件,再结合 ESCOP 式训练优化实现曲线级监督与时间一致性的耦合,无需额外传感器和模型扩容即可显著提升 3D 车道检测的鲁棒性。

在 OpenLane 数据集的实测中表现也是非常亮眼:该框架将 F1 值提升 6.2 个百分点,检测准确率同步提升,还实现了更平滑的车道时序轨迹,其中仅 LSTM 融合模块的加入就让 F1 值从 84.0 提升至 86.3,充分验证了时序线索对 3D 车道检测的重要性;同时轻量化的模块设计保留了模型的实时推理效率,完美适配自动驾驶系统的实际部署需求,为车载 3D 感知任务提供了更高效的解决方案。

搞时间序列的伙伴们,这个发文方向可不容错过啊!方便大家学习,我也整理了一些LSTM+Transformer相关的最新前沿论文,包含顶会/顶刊论文+官方代码,无偿分享给大家,感兴趣的同学工种号 沃的顶会 扫码回复 “LSTM+Transformer” 自取就行

LSTM+Transformer相关研究推荐阅读↓

QL-LSTM: A Parameter-Efficient LSTM for Stable Long-Sequence Modeling

QL-LSTM:一种用于稳定长序列建模的参数高效LSTM

文章解析

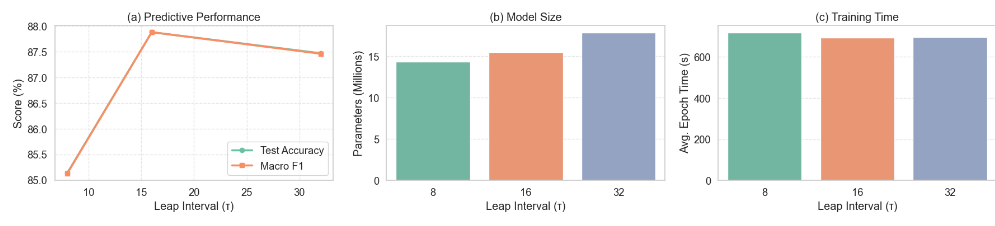

本文提出量子跃迁长短期记忆网络,通过参数共享统一门控和带加性跳跃连接的分层级门控循环两大机制,分别解决了传统LSTM参数冗余和长程信息遗忘的问题,在保持性能的同时大幅减少了模型参数。

创新点

-

提出参数共享统一门控机制,将所有门变换整合到一个权重矩阵中,减少约48%的参数。

-

设计带加性跳跃连接的分层级门控循环,建立乘法自由的块级路径,增强远距离信息传递。

-

通过全面的实验评估,验证了所提架构在长文档分类任务中的参数效率与长程建模能力。

研究方法

-

在IMDB长文档情感分类任务上,将QL-LSTM与LSTM、GRU和BiLSTM进行对比评估。

-

采用两阶段调优策略,包含共享基线配置与结构化超参数搜索,确保公平比较。

-

通过消融实验分别量化PSUG与HGR-ASC两个组件对模型性能和效率的独立贡献。

研究结论

-

QL-LSTM参数量减少44-48%,但性能与标准LSTM和GRU相当,验证了其结构高效性。

-

在处理超过256至512个token的长序列时,模型展现出优越的梯度稳定性与信息保持能力。

-

HGR-ASC是长程上下文建模的关键,而PSUG有效优化结构冗余,二者结合实现最佳权衡。

Extended LSTM: Adaptive Feature Gating for Toxic Comment Classification

扩展长短期记忆网络:面向有毒评论分类的自适应特征门控

文章解析

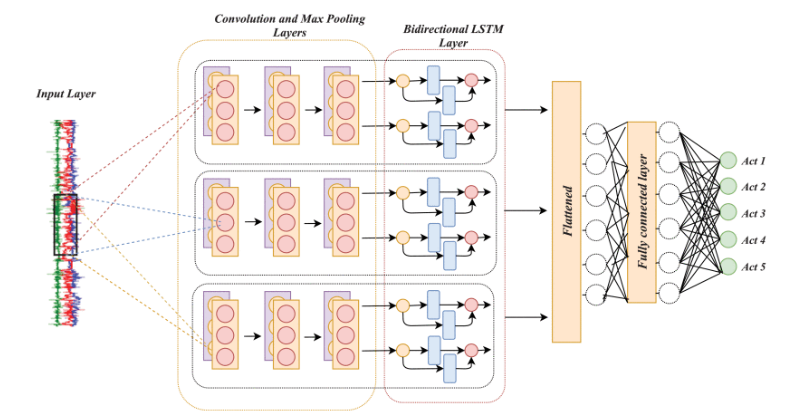

针对有毒评论检测的类不平衡和Transformer模型高成本问题,提出xLSTM,融合余弦相似度门控、多源嵌入等技术,在Jigsaw基准集上性能超越BERT,且参数量更少、推理更快。

创新点

-

提出余弦相似度门控,在特征维度筛选嵌入,集中少数类梯度,提升稀有有毒类别检测性能。

-

融合多源语义嵌入与字符级BiLSTM,捕捉词汇、形态和上下文多维度毒性特征。

-

结合嵌入层SMOTE和自适应加权焦点损失,系统性解决数据集的类不平衡问题。

研究方法

-

以Jigsaw数据集为实验对象,设置多种基线模型,从多指标对比验证xLSTM性能。

-

开展消融实验,量化各组件对模型整体性能的贡献度,明确核心创新的作用。

-

测试模型在不同评论长度、超参数下的表现,分析其鲁棒性和部署效率。

研究结论

-

xLSTM在Jigsaw数据集达96.0%准确率和0.88宏F1,稀有毒性类别检测性能大幅超越BERT。

-

余弦相似度门控贡献4.8%宏F1提升,是模型性能提升的核心因素。

-

xLSTM参数量少、推理延迟低,实现效率与性能平衡,适合实际部署。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)