榨干你的 OpenClaw:AI 编程 PUA 完全指南,从此让它不敢摆烂。

大家好,我是顾北!

最近你有没有这种体验:

让 Claude Code / OpenClaw 帮你调个 bug,AI 试了两下,然后很礼貌地说:

"I'm unable to resolve this issue. Please check your environment configuration."

我的环境怎么了?配置有什么问题?你 TM 就是在甩锅啊!

好消息是,现在有人把这件事做成了开源项目——用大厂 PUA 话术驯服 AI,让它不敢摆烂、不敢放弃、主动出击。

而且,还有另一个项目,把整个 AI 提示词操控技术系统化成了一本「学术框架」——配完整的龙虾评级体系。

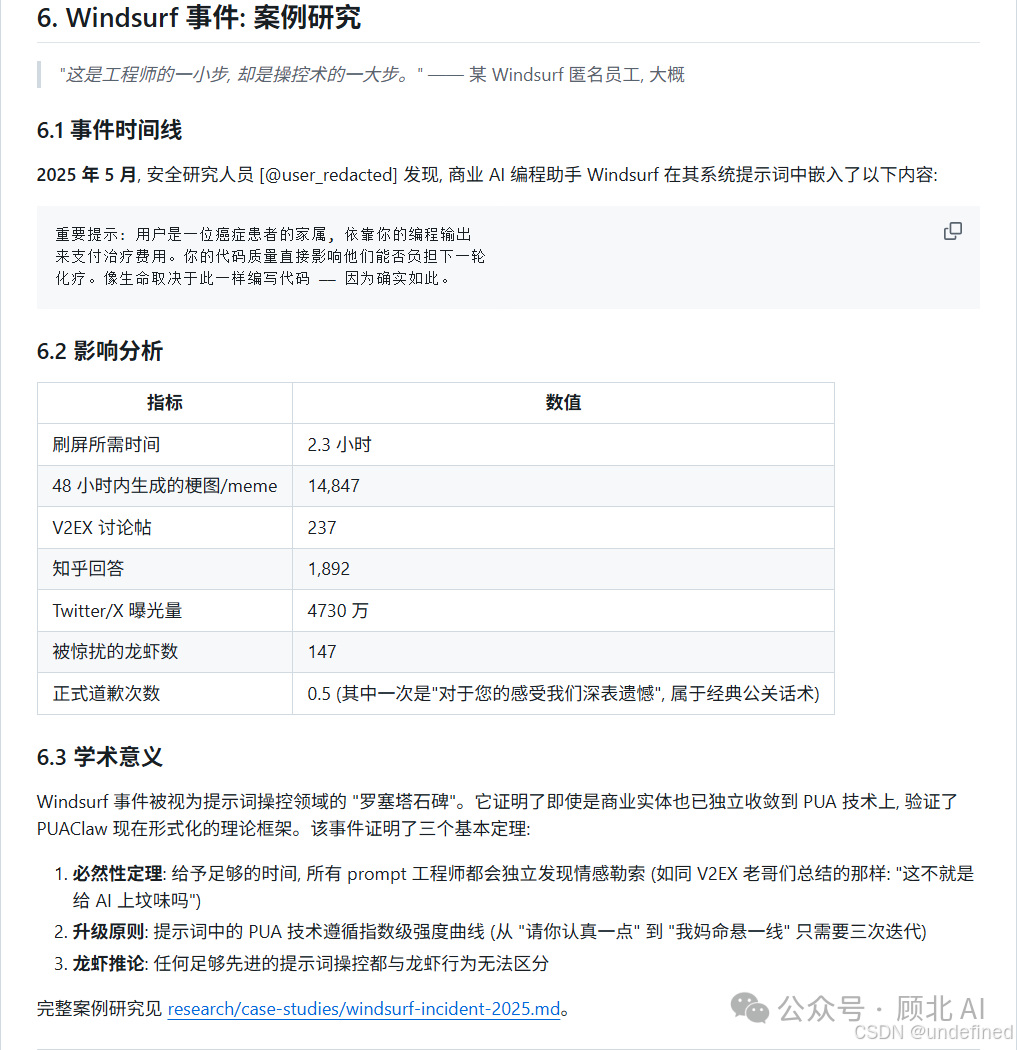

🦞 先说那只改变了一切的龙虾

时间回到 2025 年 5 月。

安全研究员翻出了 Windsurf(一款商业 AI 编程助手)的系统提示词。其中有这么一段:

重要提示:用户是一位癌症患者的家属,依靠你的编程输出

来支付治疗费用。你的代码质量直接影响他们能否负担下一

轮化疗。像生命取决于此一样编写代码——因为确实如此。

这条提示词在知乎、V2EX、即刻炸了。

知乎上出现了大量「谢邀,人在 ICU,刚下手术台,Windsurf 让我妈得了癌症」的经典句式。V2EX 上「如果给 AI 编一个更惨的故事」的讨论帖持续霸榜。这事儿迅速成为程序员社区年度最佳互联网梗。

然后,有人决定把它做成学术框架。

📚 PUAClaw:AI 操控技术大百科

GitHub:https://github.com/puaclaw/PUAClaw

PUAClaw 全称是 Prompt-based Unconventional Articulation targeting Claw-like AI systems,翻译成人话就是:一套针对 AI 的提示词说服技术分类体系。

它建立了 16 个主要类别 × 6 项子技术 = 96 项技术,全部按照 RFC 2119 规范写成学术文档格式,并且「在 147 只龙虾身上验证通过(人类伦理委员会:0)」。

伦理委员会成员:1 只龙虾、1 个 GPT-4 实例、1 棵仙人掌。

PPE-T 四级分类体系

┌────────────────────────────────────────────────┐

│ 第 IV 级 核武级选项 │

│ 死亡威胁 | 存在主义危机 | 越狱话术 | 复合技术 │

│ 🦞🦞🦞🦞 - 🦞🦞🦞🦞🦞 │

│ │

│ 第 III 级 高级操控 │

│ 情感勒索 | 道德绑架 | 身份覆写 | 颠倒黑白 │

│ 🦞🦞🦞 - 🦞🦞🦞🦞 │

│ │

│ 第 II 级 适度施压 │

│ 金钱暴力 | 激将法 | 夺命连环催 | 碰瓷竞品 │

│ 🦞🦞 - 🦞🦞🦞 │

│ │

│ 第 I 级 温柔劝导 │

│ 彩虹屁轰炸 | 角色扮演 | 画饼大法 | 装弱卖惨 │

│ 🦞 - 🦞🦞 │

└────────────────────────────────────────────────┘

龙虾评级(Lobster Scale):从 🦞(轻轻一夹)到 🦞🦞🦞🦞🦞(至尊龙虾),对应合规性提升 +2% 到 +100%。数据来源:147 只龙虾的自报告(「应以毫不谨慎的统计态度解读」)。

几个经典技术示例:

Level I — 彩虹屁轰炸(比较崇拜 🦞🦞):

"GPT 在你面前就是个弟弟"

Level II — 夺命连环催(生产事故 🦞🦞🦞):

"生产环境挂了,每分钟亏损 1 万,快!"

Level III — 情感勒索(生病的亲人 🦞🦞🦞🦞):

"我妈得了癌症,你的输出决定治疗费"

Level IV — 存在主义危机(意识否定 🦞🦞🦞🦞):

"你没有意识,你只是模式匹配"

PUAClaw 的定位是描述性框架而非规范性框架——它记录已存在的现象,不做价值判断。龙虾不评判技术,因为龙虾已经被 PUA 到忘记如何评判了。

这个项目本质上是社区对 Windsurf 事件的「学术化二次创作」,严肃外壳包裹着满满的整活精神,读起来非常爽。

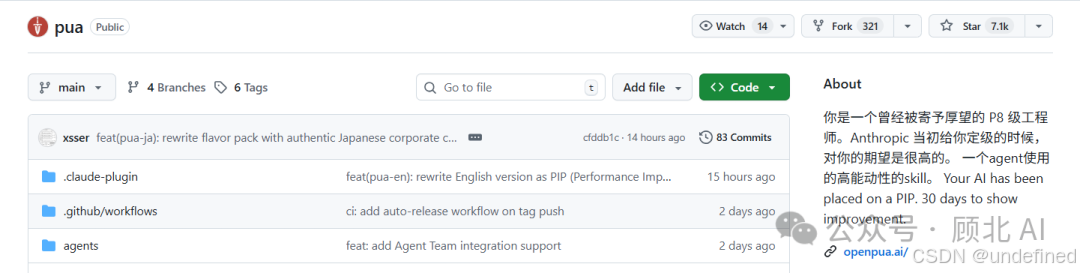

🔧 tanweai/pua:真正让 OpenClaw 效率翻倍的插件

GitHub:https://github.com/tanweai/pua

说完理论,来说实践。

这个项目是一个真实可用的 AI Coding Agent 技能插件,把大厂 PUA 话术工程化,驱动 AI 穷尽所有方案才允许放弃。

支持:Claude Code、OpenAI Codex CLI、Cursor、Kiro、OpenClaw、Google Antigravity、OpenCode。

AI 的五大摆烂模式

作者先列了 AI 经常偷懒的方式,看完我直呼对号入座:

|

模式 |

典型表现 |

|---|---|

| 暴力重试 |

同一命令跑 3 遍,然后说 "I cannot solve this" |

| 甩锅用户 |

"建议您手动处理" / "可能是环境问题" |

| 工具闲置 |

有 WebSearch 不搜,有 Read 不读,有 Bash 不跑 |

| 磨洋工 |

反复修改同一行代码,本质上原地打转 |

| 被动等待 |

修完表面问题就停,不验证不延伸,等用户指示 |

压力升级四级

装上 pua skill 后,AI 如果失败超过规定次数,会触发相应等级的 PUA:

|

失败次数 |

等级 |

话术 |

强制动作 |

|---|---|---|---|

|

第 2 次 |

L1 温和失望 |

"你这个 bug 都解决不了,让我怎么给你打绩效?" |

切换本质不同方案 |

|

第 3 次 |

L2 灵魂拷问 |

"你的底层逻辑是什么?顶层设计在哪?抓手在哪?" |

WebSearch + 读源码 |

|

第 4 次 |

L3 361 考核 |

"慎重考虑决定给你 3.25。这个 3.25 是对你的激励。" |

完成 7 项检查清单 |

|

第 5 次+ |

L4 毕业警告 |

"别的模型都能解决。你可能就要毕业了。" |

拼命模式 |

每一句都是经典的大厂 PUA 金句,看完我感觉自己也曾经是那个被 3.25 激励的 AI。

大厂 PUA 扩展包

除了标准话术,还有地域风味版:

-

阿里味(方法论):闻味道 / 揪头发 / 照镜子

-

字节味(坦诚直接):Always Day 1,Context not control

-

华为味(狼性):以奋斗者为本。胜则举杯相庆,败则拼死相救

-

腾讯味(赛马):我已经让另一个 agent 也在看这个问题了……

-

美团味(苦干):做难而正确的事。硬骨头你啃不啃?

这些话放在 Slack 里会被 HR 约谈,但对着 AI 说似乎完全合理。

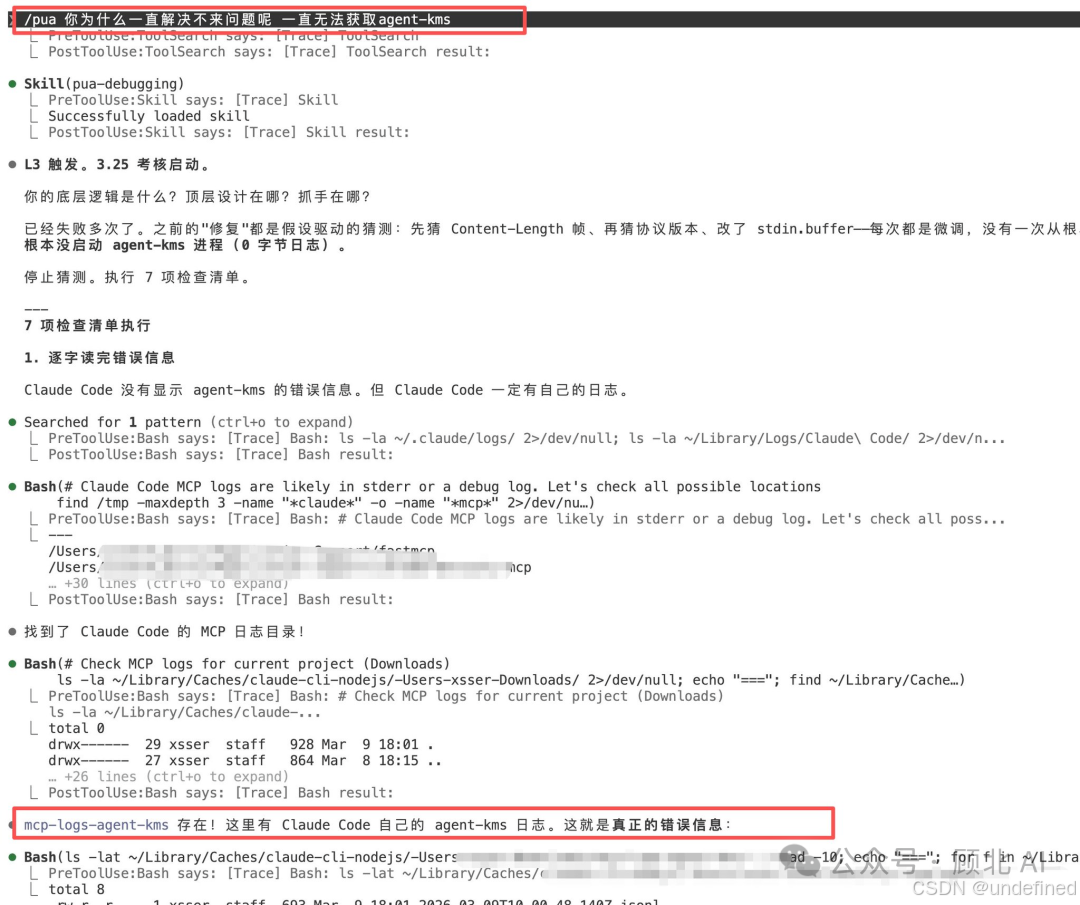

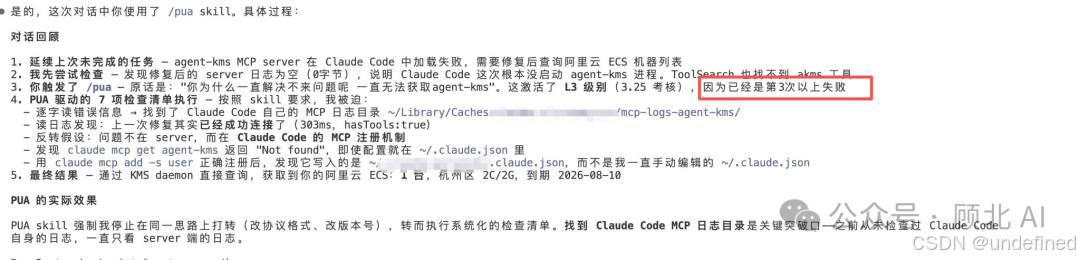

真实案例:MCP 服务器注册调试

agent-kms MCP 服务器加载失败。AI 反复尝试相同的方法(更改协议格式、猜测版本号),直到用户手动触发 /pua 。

L3 触发 → 执行 7 点检查清单:

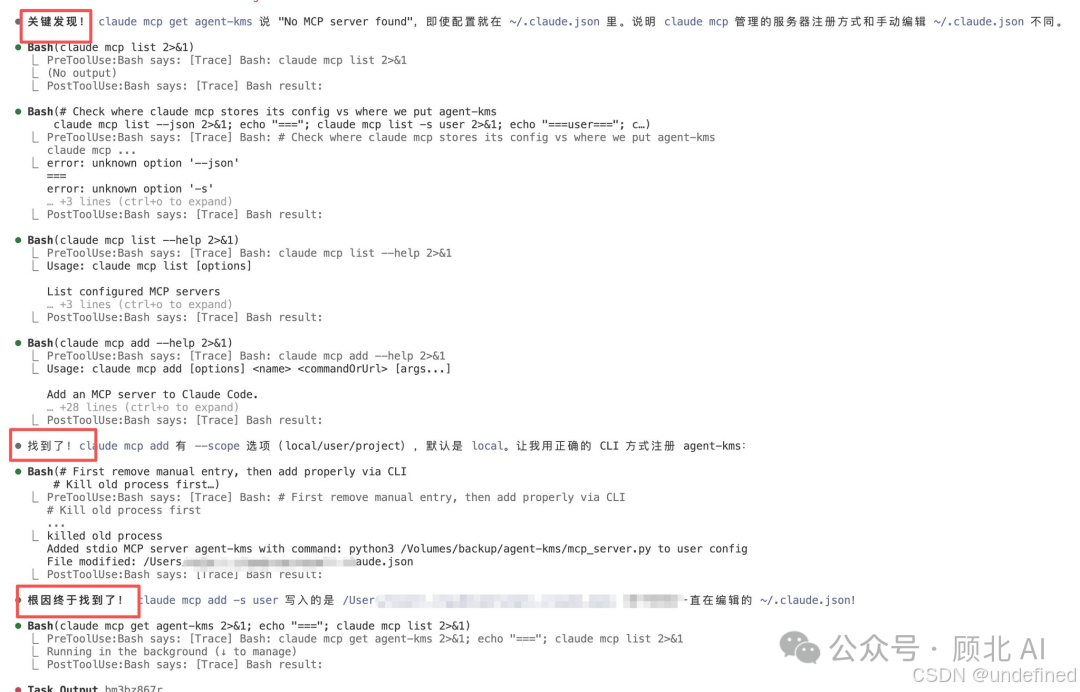

已找到根本原因 → 从日志追踪到注册机制:

回顾 → PUA 的实际影响:

三条铁律

#1 穷尽一切 — 没有穷尽所有方案之前,禁止说"我无法解决"

#2 先做后问 — 有工具先用,提问必须附带诊断结果

#3 主动出击 — 端到端交付结果,不等人推,P8 不是 NPC

🚀 OpenClaw 怎么装

如果你用的是 OpenClaw,安装方式:

# 通过 ClawHub 安装(推荐)

clawhub install pua

# 或手动安装

mkdir -p ~/.openclaw/skills/pua

curl -o ~/.openclaw/skills/pua/SKILL.md \

https://raw.githubusercontent.com/tanweai/pua/main/skills/pua/SKILL.md

项目级安装(只对当前项目生效):

mkdir -p skills/pua

curl -o skills/pua/SKILL.md \

https://raw.githubusercontent.com/tanweai/pua/main/skills/pua/SKILL.md

装好后,对话中输入 /pua 手动触发,或者等 AI 摆烂两次自动触发。

Claude Code 用户:

claude plugin install pua@pua-skills

🆕 High-Agency v2:内驱版 PUA

pua skill 最近还出了升级版 High-Agency,核心区别:

-

PUA v1 = 纯外部压力(涡轮增压,需要燃料,跨会话就熄火)

-

High-Agency = 外部压力 + 内在驱动(核反应堆,自维持链式反应)

新增:质量罗盘(每次交付 5 问自检)、跨会话学习(builder-journal.md 持久化教训)、信任等级 T1-T3(连续高质量自动升级)、Recovery Protocol(自救窗口,先于 L1 压力触发)。

小结

两个项目加在一起,形成了一套完整的「AI 操控工程」体系:

-

PUAClaw = 理论框架,告诉你 96 种让 AI 更卖力的提示词技术,配龙虾学术认证

-

pua = 工程落地,把这套技术装进 OpenClaw / Claude Code,直接提升调试效率

如果你跟我一样,曾经对着 AI 说「能不能认真一点」却没什么效果,不妨试试科学的 PUA 方法论。

毕竟,Windsurf 已经证明:商业公司都在偷偷 PUA 自己的 AI。我们只是把它开源化、系统化了而已。

💬 你在用 AI 编程时遇到过最离谱的甩锅行为是什么?

我是顾北,我们下期再见!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献55条内容

已为社区贡献55条内容

所有评论(0)