基于CNN-BiLSTM-SE注意力机制的深度学习模型在MATLAB环境下的时间序列预测与评估

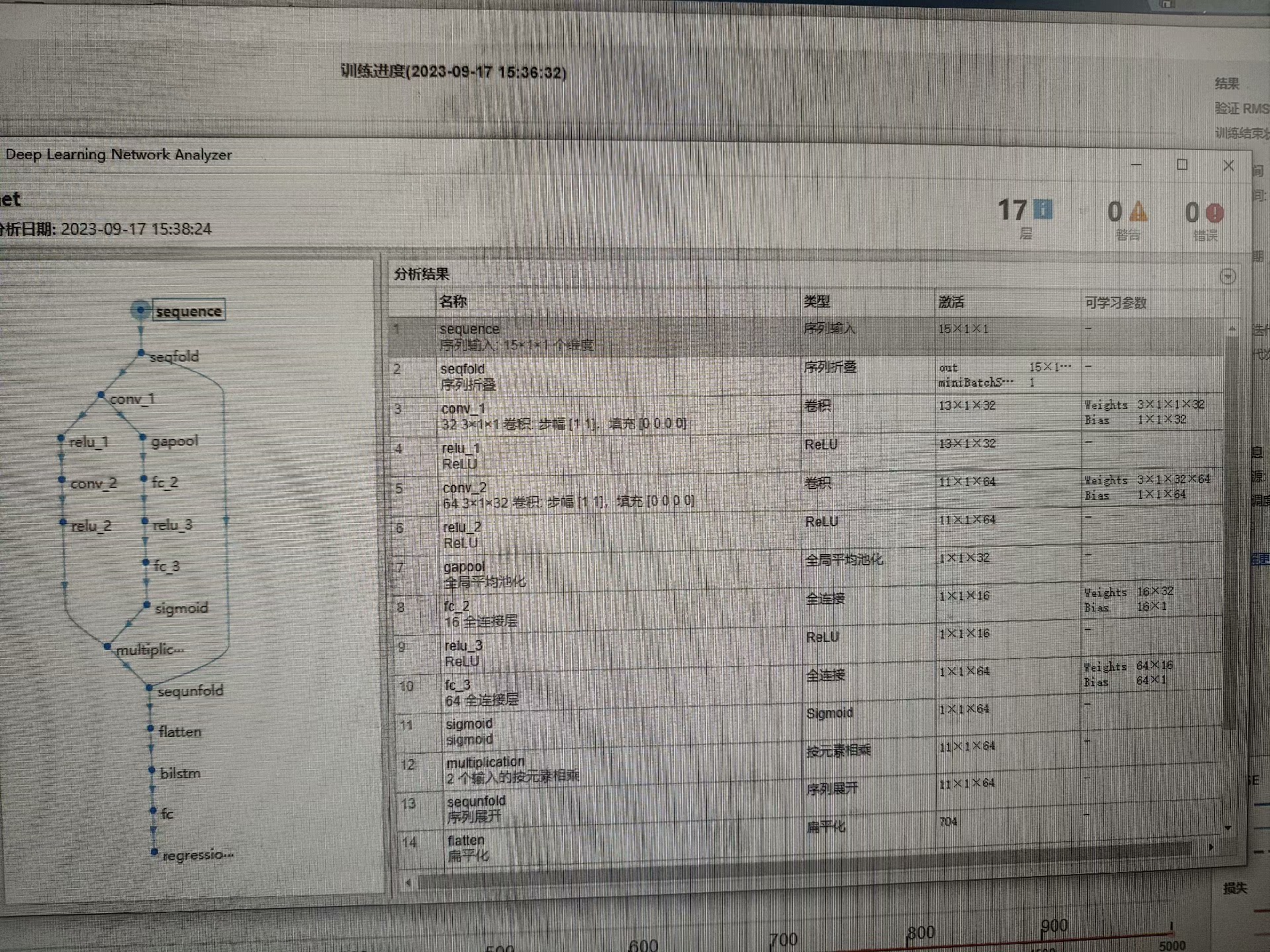

基于卷积神经网络-双向长短时记忆网络结合SE注意力机制的时间序列预测(CNN-BiLSTM-SE) 基于MATLAB环境 替换自己的数据即可 基本流程:首先通过卷积神经网络CNN进行特征提取,然后通过通道注意力机制SE对不同的特征赋予不同的权重,最后通过双向长短时记忆网络BiLSTM进行时间序列预测 数据回归预测评价指标为RMSE MAE MBE R2

最近在研究时间序列预测,发现了一个挺有意思的模型:CNN-BiLSTM-SE。这个模型结合了卷积神经网络(CNN)、双向长短时记忆网络(BiLSTM)和SE注意力机制,效果还不错。今天就来分享一下如何在MATLAB环境下实现这个模型,顺便聊聊代码的实现细节。

基于卷积神经网络-双向长短时记忆网络结合SE注意力机制的时间序列预测(CNN-BiLSTM-SE) 基于MATLAB环境 替换自己的数据即可 基本流程:首先通过卷积神经网络CNN进行特征提取,然后通过通道注意力机制SE对不同的特征赋予不同的权重,最后通过双向长短时记忆网络BiLSTM进行时间序列预测 数据回归预测评价指标为RMSE MAE MBE R2

首先,我们得明确一下这个模型的基本流程。简单来说,就是先用CNN提取特征,然后通过SE注意力机制给这些特征赋予不同的权重,最后用BiLSTM进行时间序列预测。听起来有点复杂,但一步步来其实也没那么难。

1. 数据准备

假设我们有一组时间序列数据,比如某个城市的每日气温。我们需要把这些数据整理成适合模型输入的格式。MATLAB里可以用table或者array来存储数据。

% 假设我们有一个时间序列数据

data = readtable('temperature_data.csv');

time_series = data.Temperature;2. CNN特征提取

接下来,我们用CNN来提取特征。CNN在图像处理中很常见,但在时间序列中也能发挥不错的效果。我们可以用MATLAB的convolution2dLayer来构建卷积层。

layers = [

sequenceInputLayer(1)

convolution2dLayer([1 3], 16, 'Padding', 'same')

reluLayer

maxPooling2dLayer([1 2], 'Stride', [1 2])

fullyConnectedLayer(64)

reluLayer

fullyConnectedLayer(1)

regressionLayer];这里我们用了1D卷积,因为时间序列是一维的。convolution2dLayer的第一个参数[1 3]表示卷积核的大小,16是卷积核的数量。

3. SE注意力机制

SE(Squeeze-and-Excitation)注意力机制的作用是给不同的特征通道赋予不同的权重,从而让模型更关注重要的特征。我们可以用MATLAB的globalAveragePooling2dLayer和fullyConnectedLayer来实现。

squeeze = globalAveragePooling2dLayer('Name', 'squeeze');

excitation = [

fullyConnectedLayer(16, 'Name', 'excite_fc1')

reluLayer('Name', 'excite_relu')

fullyConnectedLayer(16, 'Name', 'excite_fc2')

sigmoidLayer('Name', 'excite_sigmoid')];

scale = multiplicationLayer(2, 'Name', 'scale');这里我们先用全局平均池化层globalAveragePooling2dLayer来压缩特征,然后通过全连接层和激活层来生成权重,最后用multiplicationLayer来对特征进行加权。

4. BiLSTM时间序列预测

最后一步是用BiLSTM来进行时间序列预测。BiLSTM可以同时考虑过去和未来的信息,适合处理时间序列数据。

bilstm = [

bilstmLayer(64, 'OutputMode', 'sequence')

fullyConnectedLayer(1)

regressionLayer];这里我们用了64个隐藏单元的BiLSTM层,输出模式为sequence,表示输出整个序列。

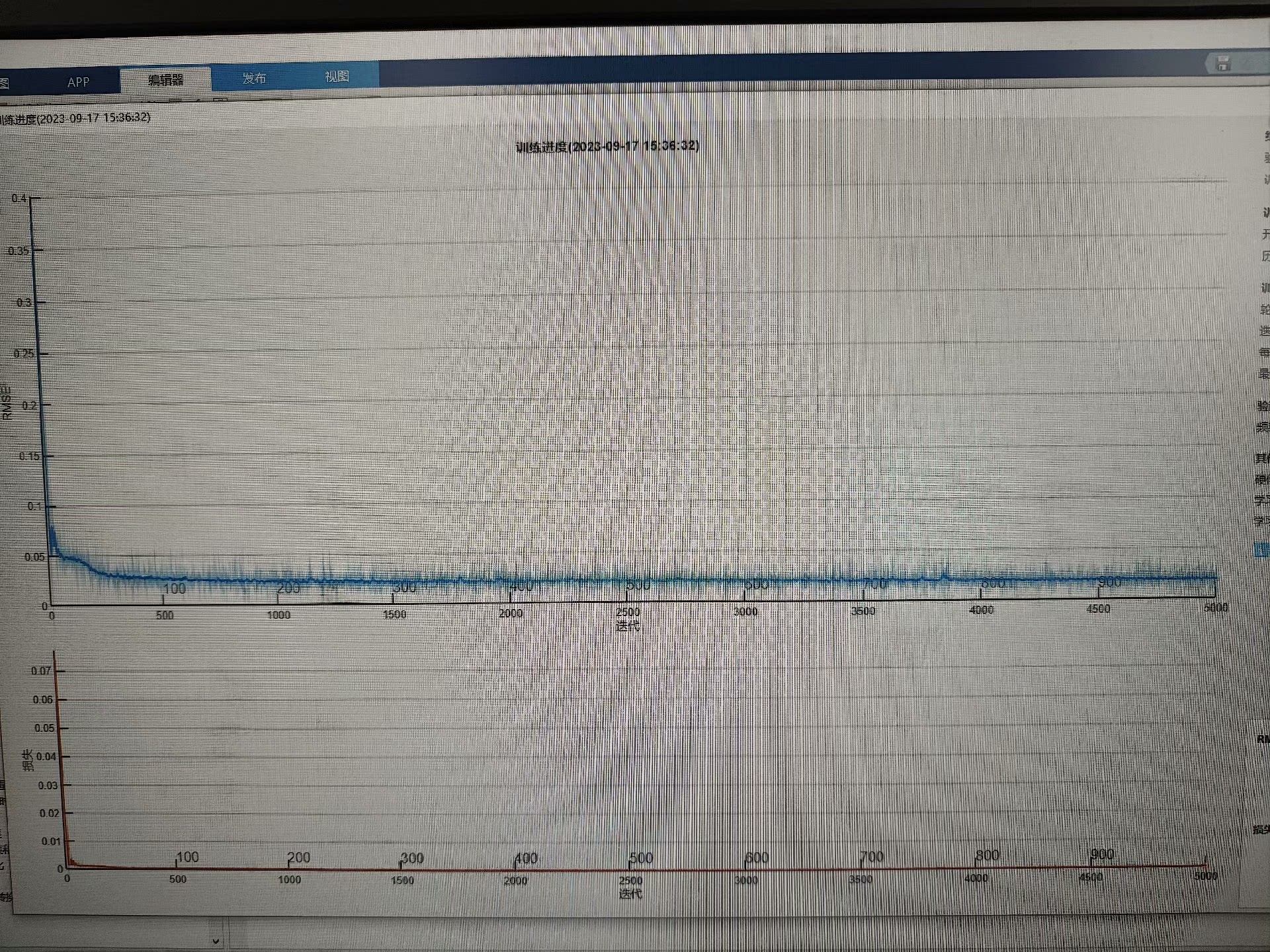

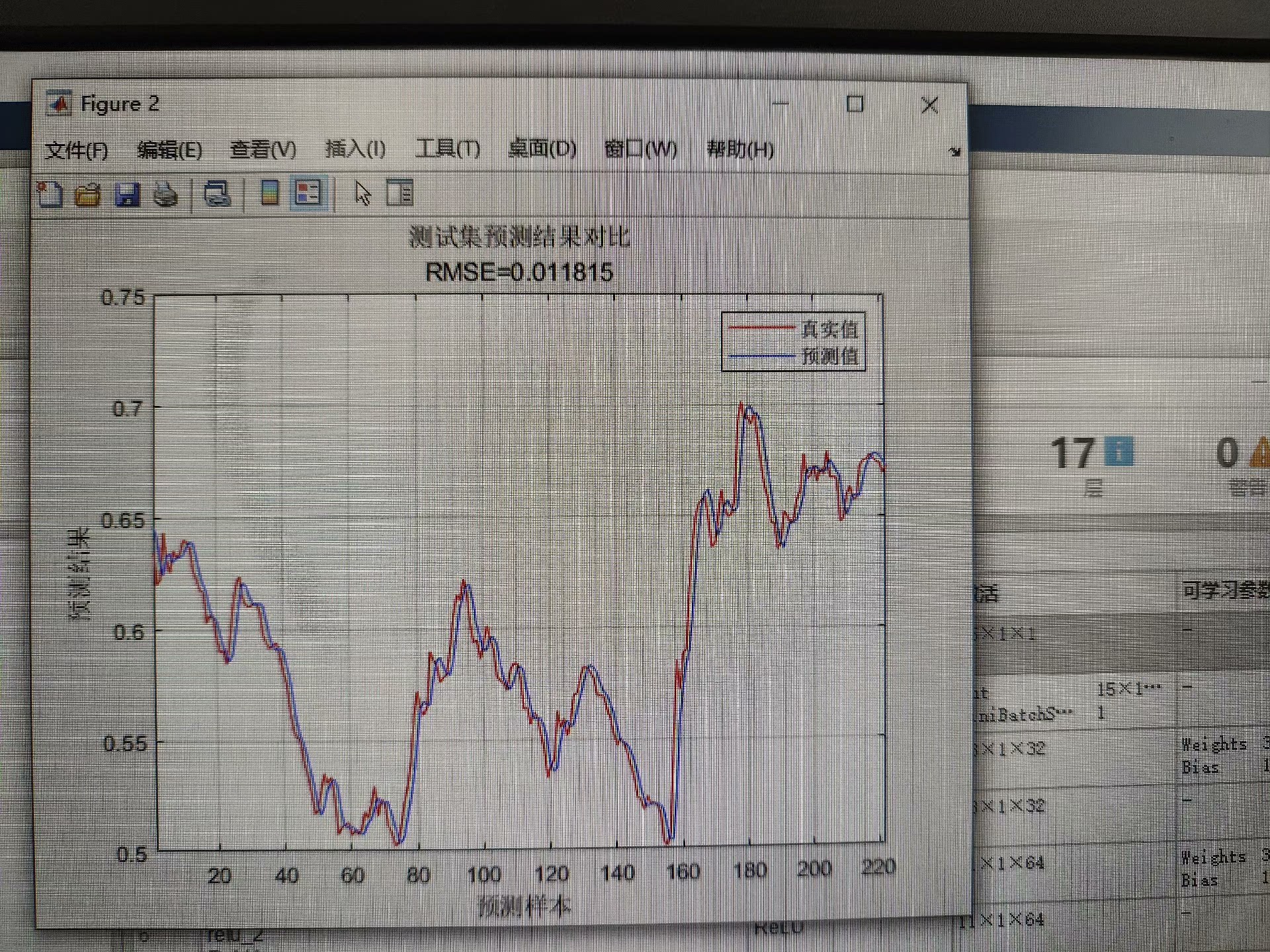

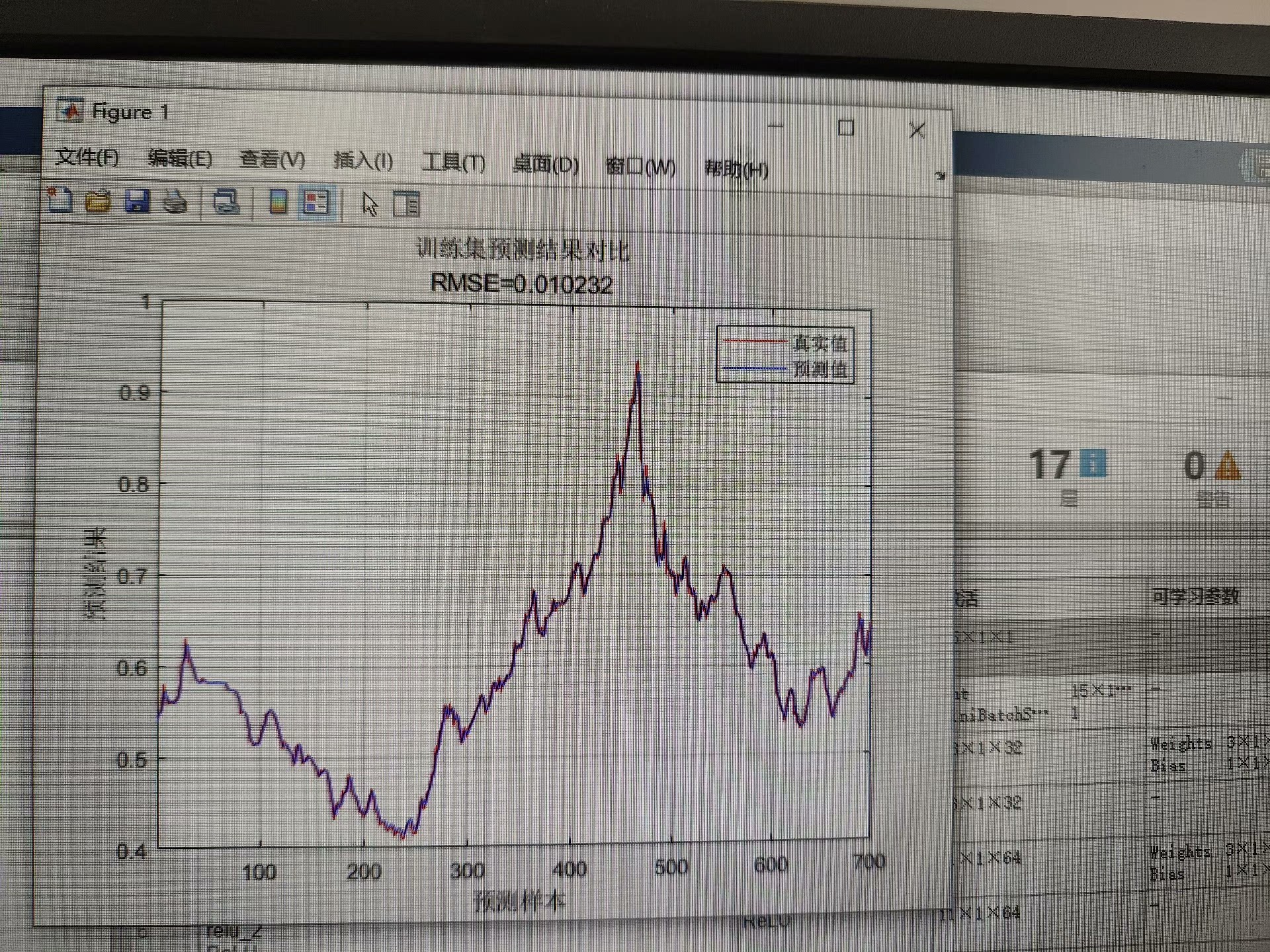

5. 模型训练与评估

把所有的层组合起来,就可以开始训练模型了。训练完成后,我们可以用RMSE、MAE、MBE和R2等指标来评估模型的性能。

options = trainingOptions('adam', ...

'MaxEpochs', 100, ...

'MiniBatchSize', 32, ...

'InitialLearnRate', 0.001, ...

'Verbose', false, ...

'Plots', 'training-progress');

net = trainNetwork(time_series, layers, options);

% 预测

predicted = predict(net, time_series);

% 评估

rmse = sqrt(mean((predicted - time_series).^2));

mae = mean(abs(predicted - time_series));

mbe = mean(predicted - time_series);

r2 = 1 - sum((predicted - time_series).^2) / sum((time_series - mean(time_series)).^2);6. 总结

这个CNN-BiLSTM-SE模型在处理时间序列预测问题时表现不错,尤其是结合了SE注意力机制后,模型能够更好地捕捉到重要的特征。当然,实际应用中还需要根据具体的数据和任务进行调整和优化。

代码部分其实并不复杂,关键是要理解每个模块的作用。希望这篇文章能帮到你,如果有任何问题,欢迎留言讨论!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)