多模态情绪识别技术如何洞悉人类真情实感?

在驾驶安全、人机交互等现实场景中,准确识别人的情绪状态正日益成为提升系统智能性与安全性的关键所在。无论是防范因情绪波动引发的驾驶风险,还是实现更为自然流畅的人机互动,对情绪进行精准、及时的感知都显得尤为迫切。

多模态情绪识别技术,克服了环境干扰、个体伪装乃至种族差异等因素影响,通过融合来自面部表情、生理反应、语音、体态等多种信号源的信息,能够更全面、更稳定地捕捉用户在复杂情境下的真实情感状态。这种跨模态互补机制显著提升了情绪判断的鲁棒性与准确度,正逐步应用于交通安全、在线教育、健康监测、智能媒体与人机交互等领域,为构建更安全、更适配、更懂人的情感智能系统奠定了关键技术基础。

一、了解情绪

01什么是情绪?

情绪是人对客观事物所产生的复杂心理状态,涵盖主观体验、心理生理反应、行为表达反应与认知过程等多个组成部分。

情绪的发生与神经系统的活动密切相关,根据信号来源的不同,情绪识别技术主要分为两类:一类基于外部行为信号,如面部表情、语音等易于观测的行为学指标;另一类基于内部生理信号,如脑电、肌电、皮肤电等反映神经与生理状态的直接数据。由于情绪深刻影响个体的判断与决策,情绪识别技术已成为构建具备情感智能的下一代人机系统的关键基础。

02情绪模型分类

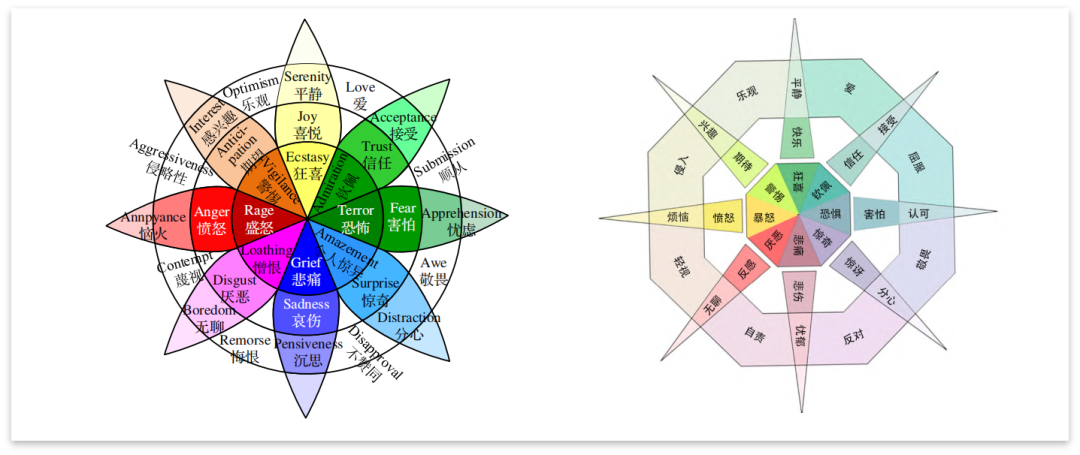

1离散情绪模型

将情绪分为几种基本类型(如快乐、愤怒、悲伤、恐惧、厌恶、惊讶),直观但难以描述复杂情绪。

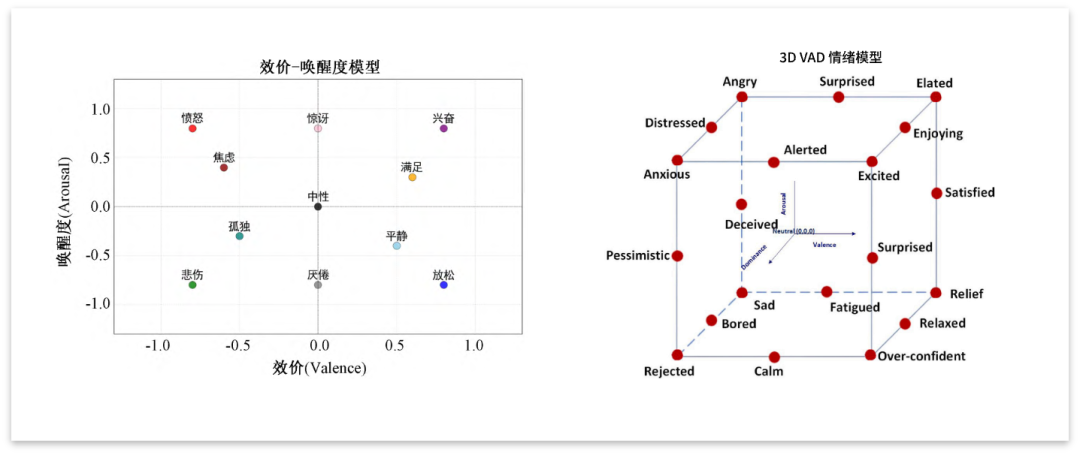

2维度情绪模型

在连续空间中描述情绪,能精准捕捉情绪的微妙变化,是当前研究的主流。最经典的是效价(愉悦度)-唤醒度二维模型,它包括两个主要维度:效价(valence)和唤醒度(arousal)。效价用来表示情感的正负性质。唤醒度反映情感的强度或激活程度。通过这两个维度,可以将各种情绪状态映射到一个二维平面上。任何一种情绪都能在这个坐标轴上找到一个精确的位置,实现了对情绪的精细化、连续性描述。也有研究将情绪分类映射到效价、唤醒度、优势度(dominance) 3个维度,即VAD三维模型。

二、情绪识别的指标

根据信号来源与性质,情绪识别指标主要可分为行为学与生理学两大类。

行为学指标通过捕捉面部表情、语音、手势等外部可见的表现信号,直观反映情绪状态;生理指标则依托于神经系统活动,其中中枢神经系统相关的脑电信号,以及周围神经系统主导的皮肤电、心电、呼吸等信号,共同构成内在的、难以伪装的生理表征。

两类指标在情绪识别中具有互补性,行为信号易于采集且与环境交互紧密,生理信号则更稳定、客观,二者的有效融合为构建高鲁棒性的情绪识别系统提供了关键基础。

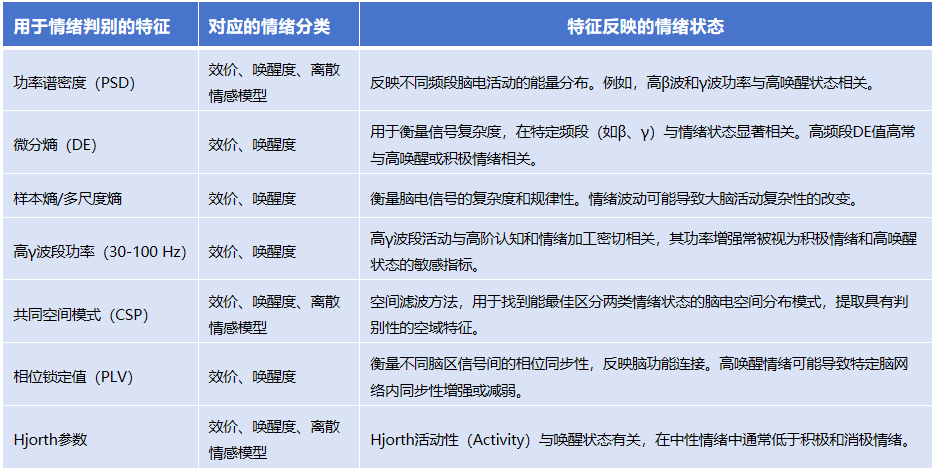

01情绪识别的脑电指标

脑电信号为情绪识别提供了直接的神经生理视角,其常用指标可从不同维度解析情绪状态:时域特征直接反映脑电波的电压波动,是最直观的信号表征;频域特征则通过分解δ、θ、α、β、γ等节律,揭示不同认知与情绪状态下的脑活动模式,其中β频段与γ频段,特别是前额叶与颞叶区域的γ活动,被证实与情绪处理高度相关;时频域特征进一步融合时间与频率信息,可动态刻画情绪诱发过程中脑电节律的瞬时变化,从而更全面地捕捉情绪的神经动力学过程。

02情绪识别的外周生理指标

在情绪识别研究中,多种生理指标为洞察情绪状态提供了客观依据。皮肤电活动由交感神经系统主导,是反映生理唤醒最灵敏的指标之一,情绪紧张或兴奋时会迅速引起皮肤导电性上升。心率变异性通过频域分析能够清晰区分交感与副交感神经的平衡状态,揭示自主神经系统在情绪波动中的动态调节。此外,呼吸频率也随情绪状态呈现规律性变化,常作为辅助特征与其他生理信号融合使用,共同构建更稳健的情绪识别模型。

03情绪识别的眼动指标

基于眼动的情绪识别技术主要通过捕捉眼部运动和瞳孔变化相关特征,实现对人类情绪状态的推断。常用的眼动特征包括注视点数量、注视持续时间、瞳孔直径、眼球运动速度等。其中,瞳孔是情绪唤醒度的 “黄金指标”。眼动特征为情绪识别提供了一个非侵入式且高时效的观测窗口,通过追踪注视轨迹与眼球运动动态,能够有效捕捉个体情绪状态的细微变化。

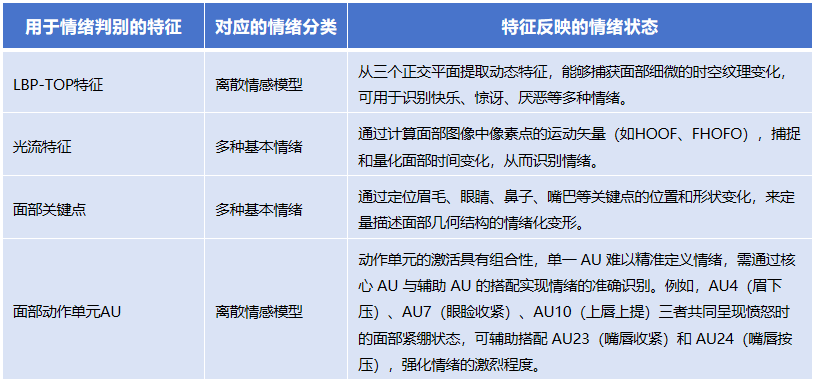

04情绪识别的面部表情指标

面部表情情绪识别指标能够通过多维度特征有效量化并反映个体的内在情绪状态。包括基于动态纹理的特征(如LBP-TOP)、光流特征、面部关键点和面部动作单元等,这些指标既可独立用于情绪推断,也可与脑电等多模态信号在特征级或决策级融合,形成互补,从而在复杂场景下实现更鲁棒、更细腻的情绪状态解析。

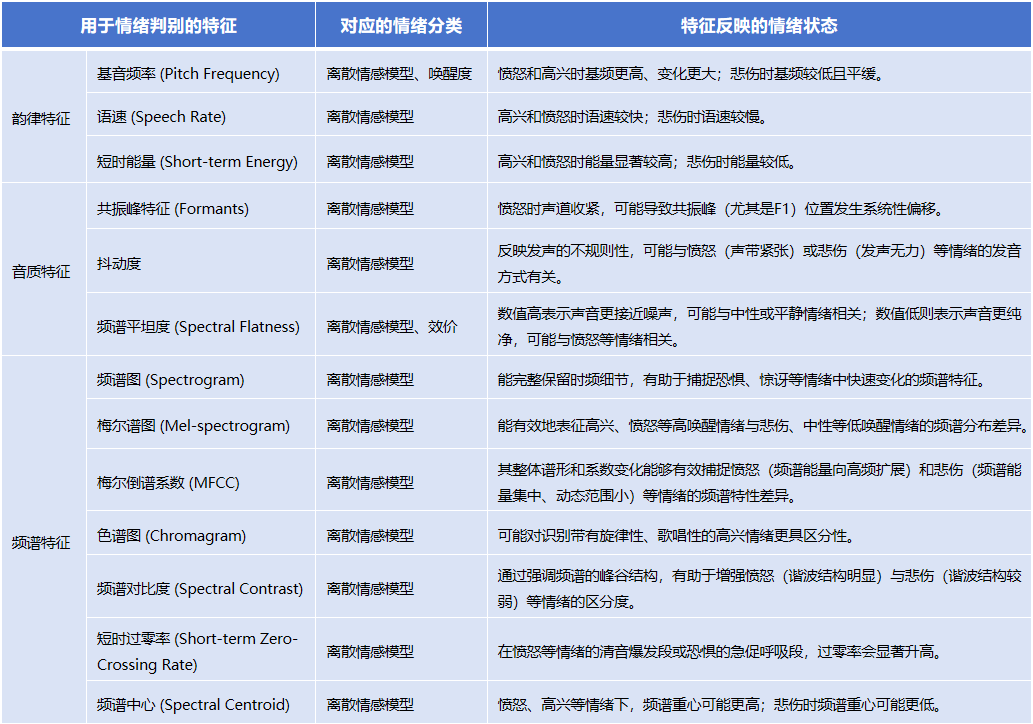

05情绪识别的语音指标

用于情绪识别的语音指标主要涵盖三大类:韵律特征、音质特征和频谱特征。韵律特征如基音频率、语速和能量,能够有效反映情绪的唤醒度;音质特征如共振峰和抖动度,有助于区分情绪的效价,如悲伤常伴随共振峰位置的降低。频谱特征,尤其是梅尔频率倒谱系数和梅尔谱图,则对识别细腻的情感状态至关重要。这些指标通常结合使用,并可与文本、面部表情等多模态信息融合,以构建更鲁棒、准确的情绪识别系统。

三、多模态情绪识别技术

多模态即是从多个模态表达或感知事物,融合多种模态中与情绪相关的有用信息,并利用它们在情绪表征上的互补性,可以提高对复杂情绪状态的识别准确率。

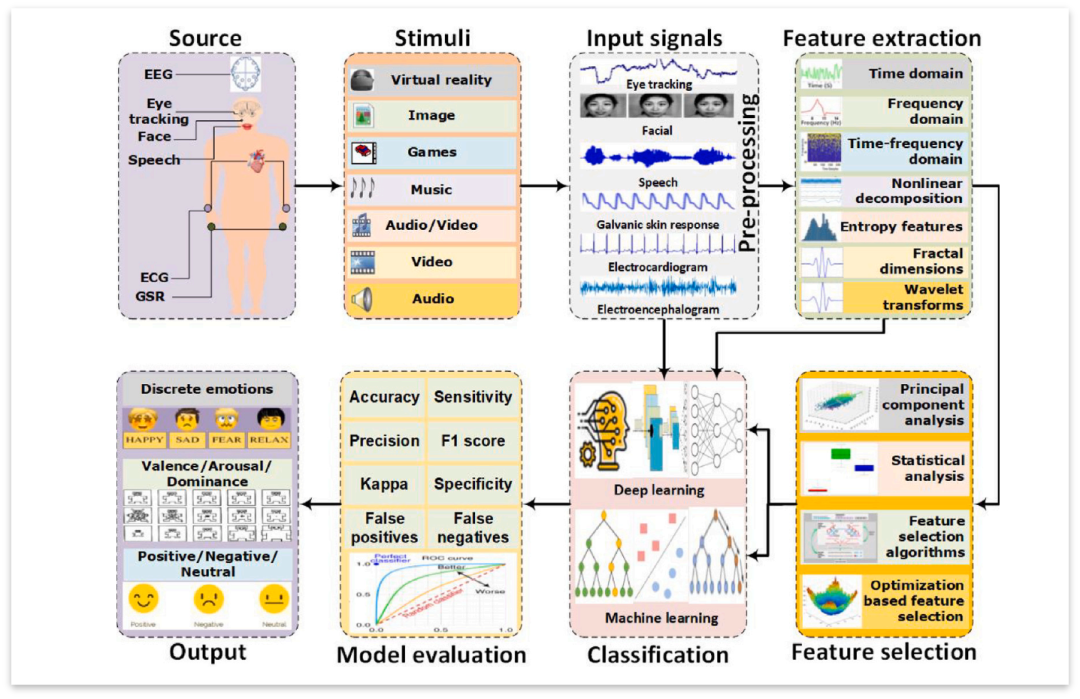

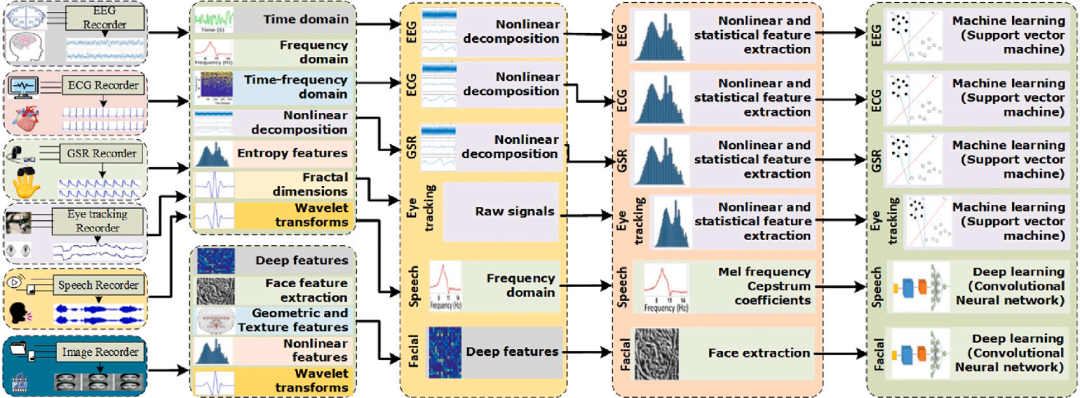

基于多模态信号的情绪识别研究遵循一套系统化流程:

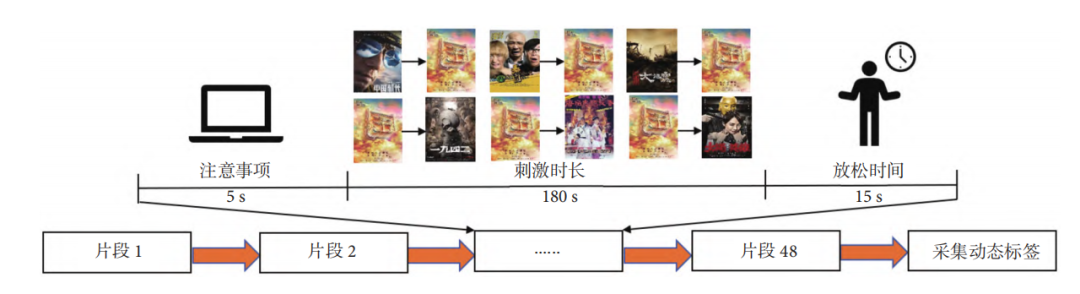

1情绪诱发实验设计

情绪诱发实验通过标准化刺激有效激发目标情绪状态。主要分为两类:一是基于外部刺激材料的被动呈现,如图片、视频、音频及嗅觉材料等,以直接、可控的方式诱发情绪反应;二是基于任务参与或情境模拟的主动介入,借助虚拟现实、互动游戏、驾驶模拟、角色扮演、博弈任务或回忆想象等方式,使被试沉浸于动态情境中,从而激发更自然、情绪强度更高的生态化反应。两类方法互为补充,共同构建起从实验室控制到近真实场景的情绪诱发体系。

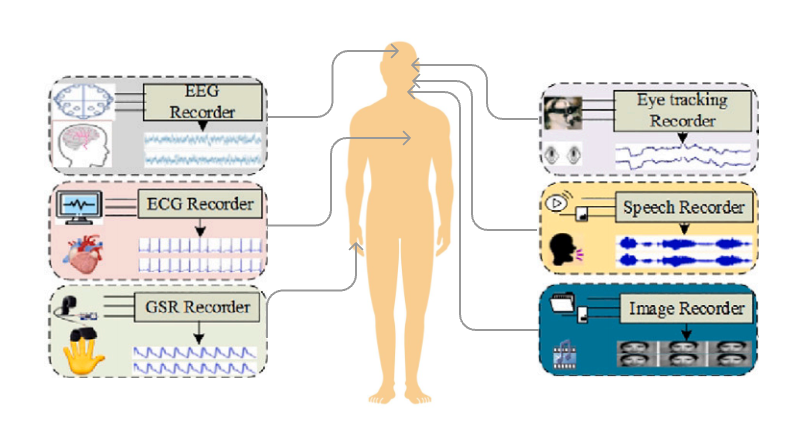

2多模态数据源同步采集

同步采集脑电图、眼动轨迹、面部视频、语音信号以及心电、皮电等外周生理数据,全面捕捉中枢与自主神经活动及行为作为数据源。脑电图(EEG)捕捉脑电活动;眼动追踪记录视觉注意力;面部视频分析微表情;语音信号提取声学特征;心电(ECG)和皮电(GSR)等外周生理信号监测自主神经活动。

3特征提取与特征选择

采用原始信号经预处理后,从时域、频域、时频域及非线性动力学等多个维度提取特征,并常借助特征选择方法优化信息表达。这些特征可输入传统机器学习或深度学习模型进行分类或回归,若涉及多模态信息,可在数据、特征、决策或模型级进行融合以提升鲁棒性。

4模型评估与结果输出

模型通过灵敏度、F1分数、精确度、kappa系数等多类指标进行全面评估。并依据离散情绪类别或效价‑唤醒度等连续维度输出情绪状态,最终为情感计算、智能人机交互等应用提供高精度的量化情绪感知能力。

四、总结与展望

多模态情绪识别技术正通过融合脑电、眼动、外周生理与行为(面部表情、语音)等多源信号,实现了对复杂情境下真实情感状态的全面捕捉与动态互补,以前所未有的精度与鲁棒性解读人类情感。

展望未来,多模态情绪识别将向更精细化、个性化与实用化方向发展。一方面,随着脑机接口、轻量化传感与边缘计算技术的成熟,实时、连续、非侵入式的情绪监测将成为可能,推动车载终端、智能穿戴设备等实现实时情感交互与干预。另一方面,基于自监督学习、因果推断与跨域自适应方法的发展,系统对个体差异、文化背景与动态情境的理解能力将显著增强,推动情绪识别从实验室走向真实复杂环境。与此同时,随着技术落地,数据安全与用户隐私保护也将成为关键挑战。可以预见,随着融合机制的持续优化与应用场景的不断拓展,多模态情绪识别将为构建真正“知感知情”、安全可靠的情感智能系统奠定坚实基石。

五、参考文献

[1]殷梦馨,倪娜,尉怀怀,等.基于多模态情绪识别的研究进展[J].生物医学工程研究,2023,42(03):285-291.DOI:10.19529/j.cnki.1672-6278.2023.03.12.

[2]邹杨萌,揭丽琳,王铭勋,等.基于脑电和眼动信号的动态连续情绪识别方法[J].生物医学工程学杂志,2025,42(01):32-41.

[3]盛丹怡,卢奇,程时伟.基于眼动跟踪的情绪识别方法研究[J].人类工效学,2022,28(06):57-62.DOI:10.13837/j.issn.1006-8309.2022.06.0011.

[4]彭磊,魏国辉,马志庆,等.脑电信号情绪识别关键技术研究进展[J].北京生物医学工程,2024,43(02):211-217.DOI:CNKI:SUN:BJSC.0.2024-02-015.

[5]李蒙蒙,薛文博,刘云扬,等.面向情绪识别任务的EEG特征提取研究综述[J].中国生物医学工程学报,2025,44(04):465-477.DOI:CNKI:SUN:ZSWY.0.2025-04-009.

[6]周欣颖,李雷孝,林浩,等.多模态驾驶员情绪识别研究综述[J].计算机工程与应用,2025,61(10):1-18.

[7]王笛.基于生理信号的飞行员心理状态评估方法研究[D].哈尔滨工业大学,2018.

[8]Zheng, F., Hu, B., Zhang, S., Li, Y., & Zheng, X. (2021). EEG Emotion Recognition based on Hierarchy Graph Convolution Network. 2021 IEEE International Conference on Bioinformatics and Biomedicine (BIBM), 1628–1632.doi.org/10.1109/bibm...

[9]Khare, S. K., Blanes-Vidal, V., Nadimi, E. S., & Acharya, U. R. (2024). Emotion recognition and artificial intelligence: A systematic review (2014–2023) and research recommendations. Information Fusion, 102, 102019.doi.org/10.1016/j.in...

[10]Lim, J. Z., Mountstephens, J., & Teo, J. (2020). Emotion Recognition Using Eye-Tracking: Taxonomy, Review and Current Challenges. Sensors, 20(8), 2384.doi.org/10.3390/s200...

[11]Tarnowski, P., Kołodziej, M., Majkowski, A., & Rak, R. J. (2020). Eye-Tracking Analysis for Emotion Recognition. Computational Intelligence and Neuroscience, 2020, 1–13.doi.org/10.1155/2020...

[12]Cui G,Li X,Touyama H. Emotion recognition based on group phase locking value using convolutional neural network[J].Scientific Reports,2023,13( 1) : 3769.

[13] Wang Z,Chen Z,Zhang J. EEG emotion recognition based on PLV-rich-club dynamic brain function network[J]. Applied Intelligence,2023,53(

14) : 17327-17345.

[14]Lahariya, A., Singh, V., & Tiwary, U. S. (2021). Real-time Emotion and Gender Classification using Ensemble CNN (Version 1). arXiv.

https://doi.org/10.48550/ARXIV.2111.07746

[15]Kollias, D. (2022). ABAW: Valence-Arousal Estimation, Expression Recognition, Action Unit Detection & Multi-Task Learning Challenges (Version 2). arXiv. https://doi.org/10.48550/ARXIV.2202.10659

[16] LIU S, TONG J, MENG J, et al. Study on an effective cross-stimulus emotion recognition model using EEGs based on feature selection and support vector machine[J]. International Journal of Machine Learning and Cybernetics, 2018, 9(5): 721-726.

[17] N.Zhuang,Z.Ying,L.Tong,Z.Chi,H.Zhang,andB.Yan,“Emotion Recognition

from EEG Signals Using Multidimensional Information in EMD Domain,”

BioMedresearchinternational,vol.2017,pp.1–9,2017.

[18] Cui, G., Li, X., & Touyama, H. (2023). Emotion recognition based on group phase locking value using convolutional neural network. Scientific Reports, 13(1). https://doi.org/10.1038/s41598-023-30458-6.

[19]Xing, B., Zhang, H., Zhang, K., Zhang, L., Wu, X., Shi, X., Yu, S., & Zhang, S. (2019). Exploiting EEG Signals and Audiovisual Feature Fusion for Video Emotion Recognition. IEEE Access, 7, 59844–59861. https://doi.org/10.1109/access.2019.2914872.

[20]Yuan-Pin Lin, Chi-Hong Wang, Tzyy-Ping Jung, Tien-Lin Wu, Shyh-Kang Jeng, Jeng-Ren Duann, & Jyh-Horng Chen. (2010). EEG-Based Emotion Recognition in Music Listening. IEEE Transactions on Biomedical Engineering, 57(7), 1798–1806. https://doi.org/10.1109/tbme.2010.2048568.

[21]Mehmood, R. M., & Lee, H. J. (2015). EEG based emotion recognition from human brain using Hjorth parameters and SVM. International Journal of Bio-Science and Bio-Technology, 7(3), 23-32.

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)