【有手就行】OpenClaw小龙虾保姆级部署教程!小白10分钟搞定本地部署

·

前言

最近小龙虾搞得老火热了,本着拥抱AI的想法,索性自己在本地也倒腾一下,顺便记录下部署细节,供大家参考

一、准备工作(至关重要)

在开始之前,请务必完成以下两步,这是你的“后悔药”:

- 创建系统还原点:

- 搜索“创建还原点” -> 选中 C 盘 -> 配置(启用保护,分配 5-10GB) -> 创建 -> 命名为 Before_OpenClaw_Install。

- 作用:如果安装搞崩了系统,一键回滚。

- 准备一个专用文件夹:

- 在非系统盘(如 E 盘)创建一个文件夹,例如 E:\Openclaw_Lab。

- 以后 OpenClaw 的所有操作、脚本、日志都尽量限制在这个范围内,避免它触碰系统核心文件。

二、正式安装步骤

1. 安装 Git(可选但推荐)

- OpenClaw 的一些功能依赖 Git 来下载插件或技能

- 下载并运行安装包

- 关键设置:在安装过程中,有一步问 “Adjusting your PATH environment”,选择 “Git from the command line and also from 3rd-party software”(第二个选项),这样能在 CMD 中直接使用 git。

- 其他选项保持默认,一直点 Next 直到完成。

2. 安装 Node.js(核心依赖)

- OpenClaw 强制要求 Node.js 版本 ≥ 22。版本不对会导致安装失败或运行报错。

- 下载 LTS 版本(长期支持版),目前最新版通常是 v22.x.x(确保版本号是 22 开头)。

- 运行安装包,一直点 Next,接受默认设置即可

- 验证安装:

- 按 Win + R,输入 cmd,回车。

- 输入 node -v,如果显示 v22.x.x,则成功。

- 输入 npm -v,如果显示版本号,则成功。

3. 安装 OpenClaw

现在通过 npm(Node.js 的包管理器)安装 OpenClaw

- 以管理员身份运行 CMD:

- 搜索 cmd,右键点击“命令提示符”,选择 “以管理员身份运行”。

- 为什么:安装全局工具需要写入系统目录。

- 执行安装命令:

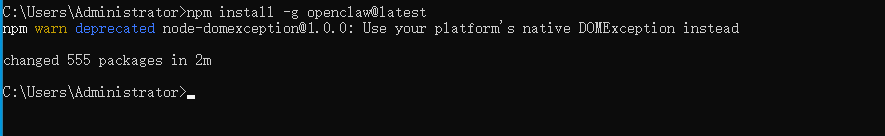

npm install -g openclaw@latest

说明:-g 表示全局安装,@latest 确保下载最新版本。(本人用的版本:OpenClaw 2026.3.12)

-

等待:下载过程可能需要几分钟,取决于网速。如果卡住,可能是网络问题,可以尝试配置国内 npm 镜像(见下文“常见问题”)。

-

验证安装:

安装完成后,输入:

openclaw --version

如果显示版本号,说明安装成功!

4. 初始化配置(Onboarding)

首次运行需要进行交互式配置。

- 在同一个 CMD 窗口中,输入:

openclaw onboard

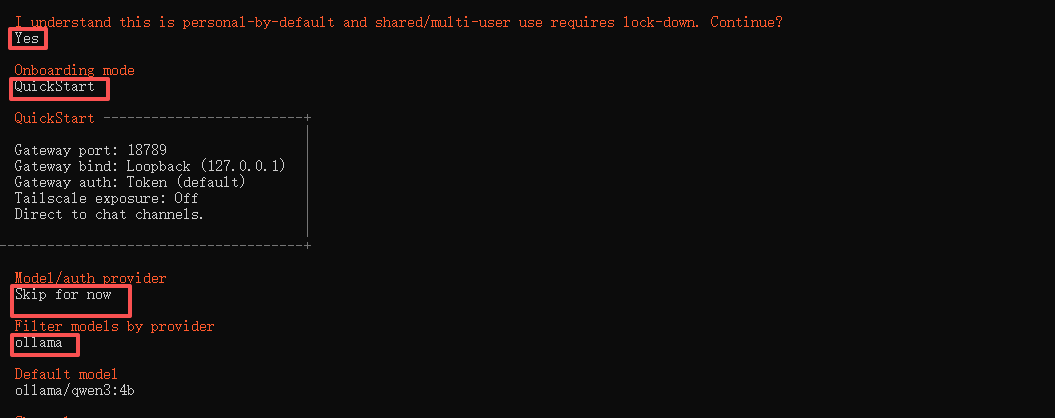

- 跟随向导操作:

- 同意协议:输入 yes 或 y

- 安装模式:通常选择 Quick Start 或 Default

- 模型配置:

- 如果你打算用本地的 Ollama(推荐),选择 Ollama。

- 如果没有安装 Ollama,可以先选 Skip 或 Later,稍后再配。

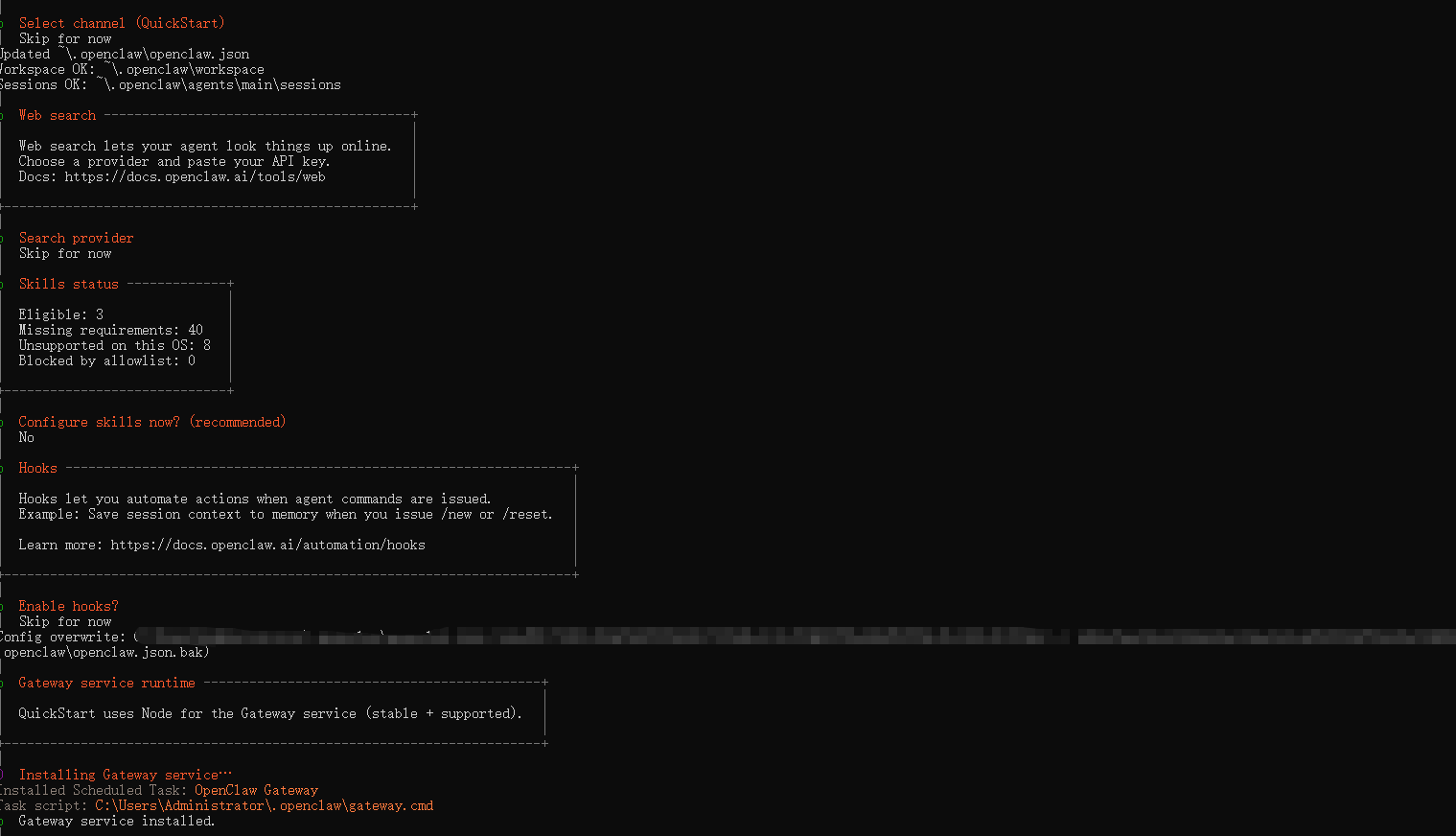

- 后面基本都是模型相关的配置,不知道怎么选就直接选择skip跳过就行

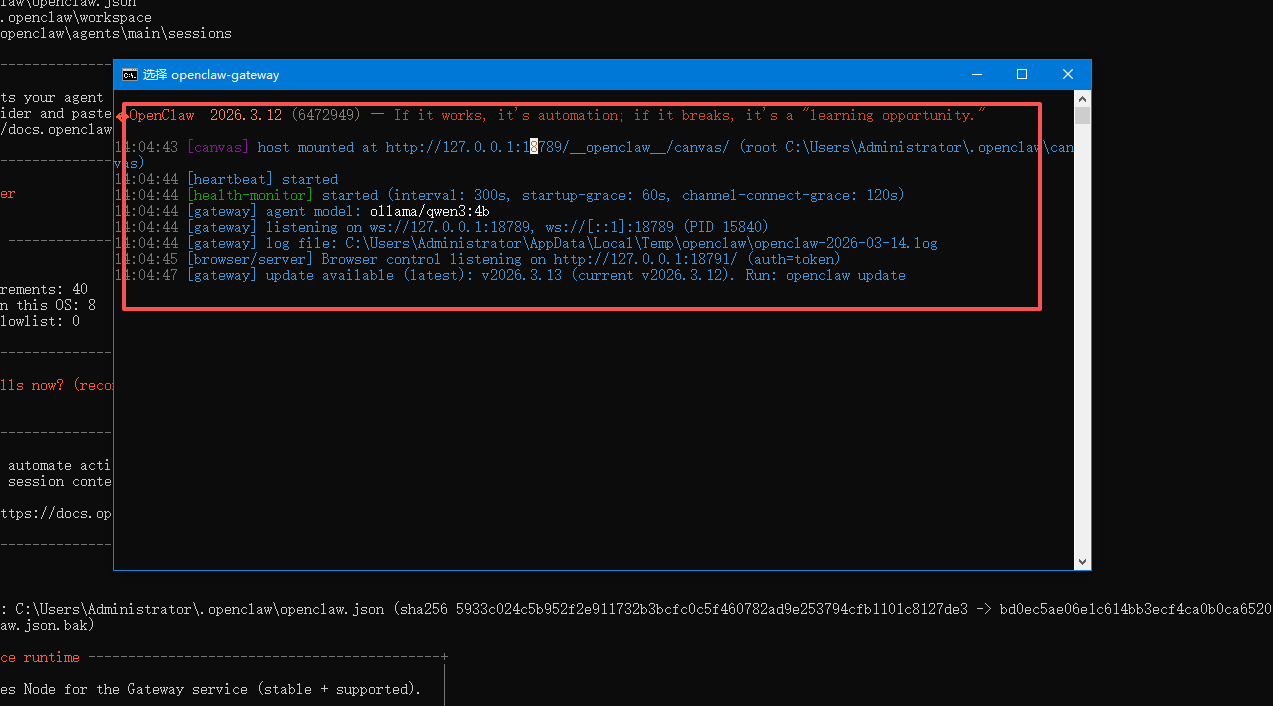

- 配置完成后,系统会自动启动 OpenClaw Gateway(网关)。

会自动弹出Web页面,记住网关令牌,后续登录会用到

5. 启动与访问

- 启动服务

openclaw gateway start

- 打开控制面板:

- OpenClaw 通常会在浏览器中自动打开仪表盘。

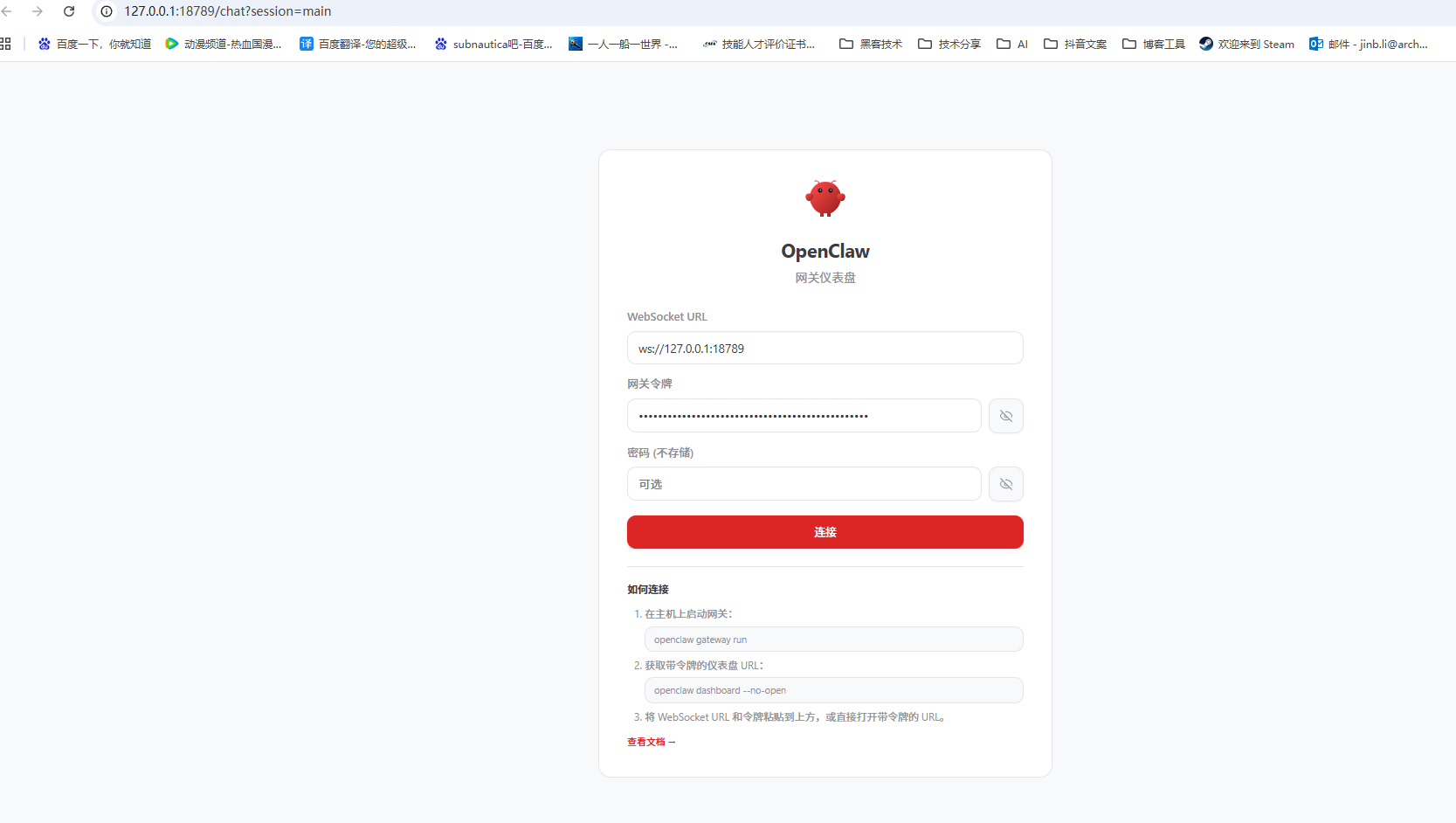

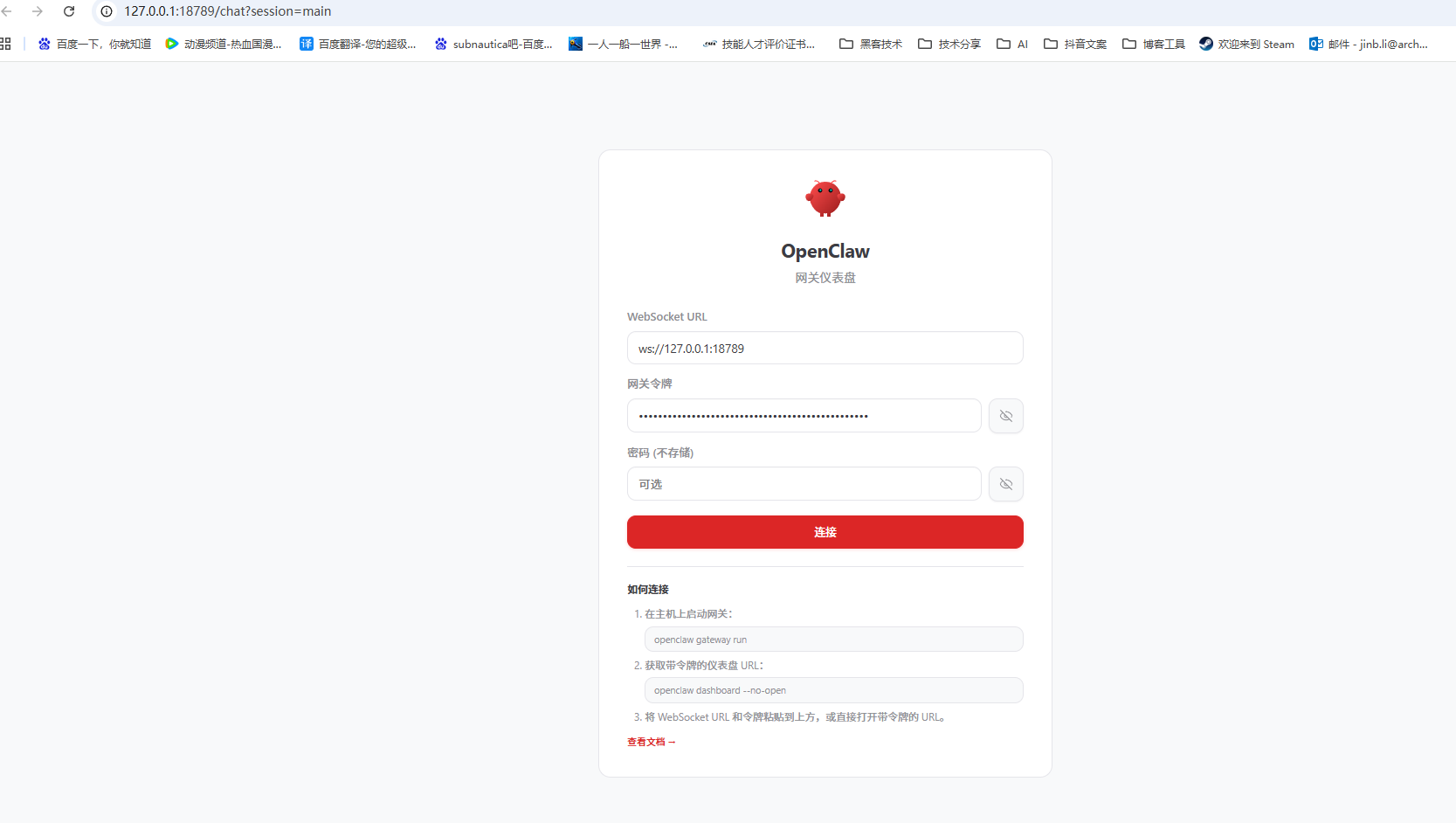

- 如果没有自动打开,手动在浏览器访问:http://127.0.0.1:18789 (端口号可能在配置时显示,请以实际为准)。

这里会要求填写网关令牌,上面已经提到过第一次自动启动后会携带令牌,可自行保存下来,如果不记得也没事,可以从配置文件中找到

通常在 ~/.openclaw/openclaw.json 或类似位置

"gateway": {

"port": 18789,

"mode": "local",

"bind": "loopback",

"auth": {

"mode": "token",

"token": "2c7a8e01410459f9ac7d4e25dd68268b24303073f4cd7296"

}

}

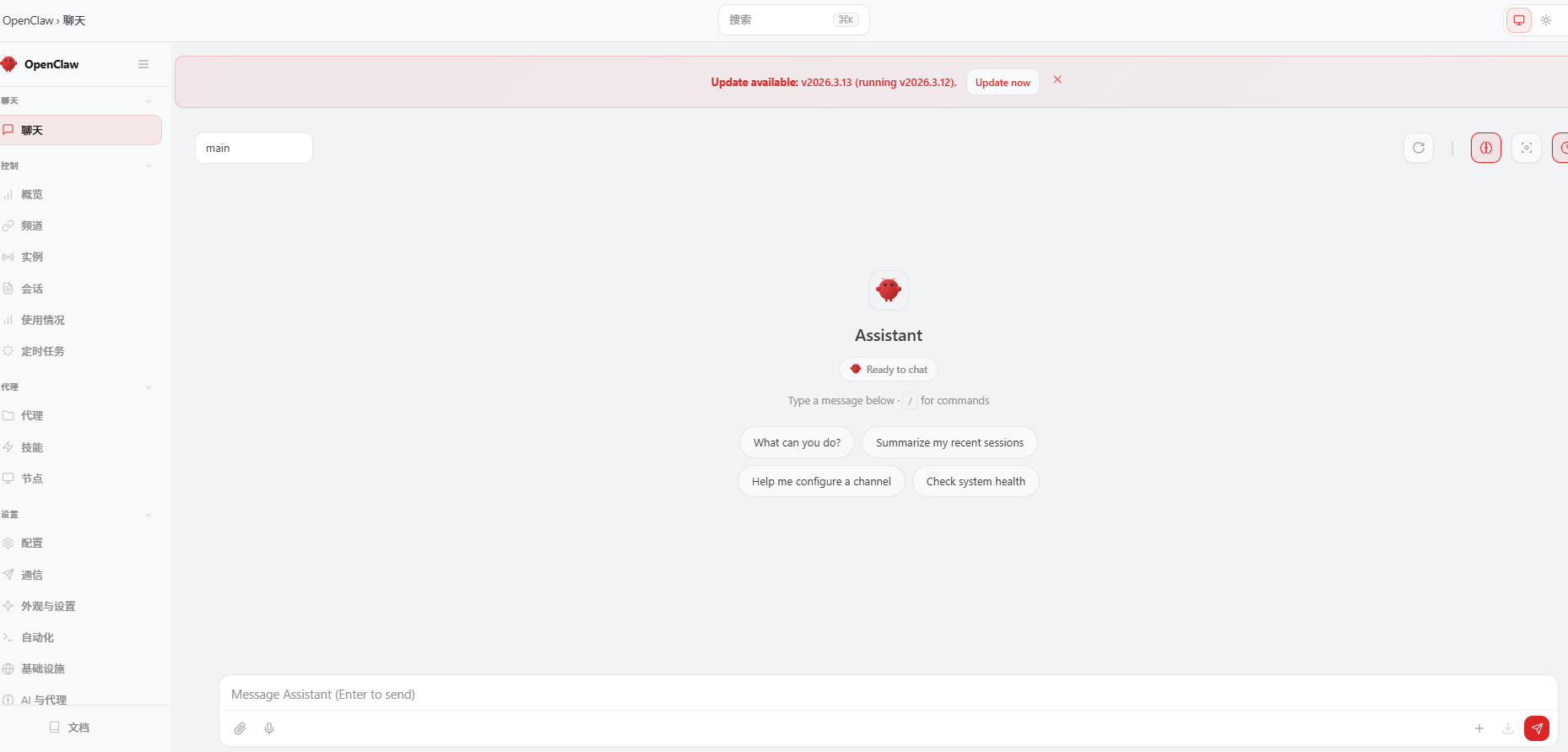

- 界面初探:

- 你会看到一个 Web 界面,可以在这里配置模型、查看日志、管理 Skills(技能)。

- 你会看到一个 Web 界面,可以在这里配置模型、查看日志、管理 Skills(技能)。

6. 连接本地模型(Ollama)

- 听说小龙虾很费token,所以建议用本地模型,想要安装本地模型,请看这一篇:【有手就行】个人电脑部署大模型,详细图文讲解

- 本地模型安装并启动后,再配置小龙虾,打开小龙虾配置文件(~/.openclaw/openclaw.json 或类似位置),修改参数,模型和url修改为你本地的相应地址就行

"models": {

"providers": {

"ollama": {

"baseUrl": "http://127.0.0.1:11434",

"apiKey": "ollama-local",

"api": "ollama",

"models": [

{

"id": "qwen2.5:3b",

"name": "Qwen 2.5 3B"

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "ollama/qwen3:4b"

},

"models": {

"ollama/qwen3:4b": {}

},

"workspace": "E:\\Openclaw_Lab"

}

},

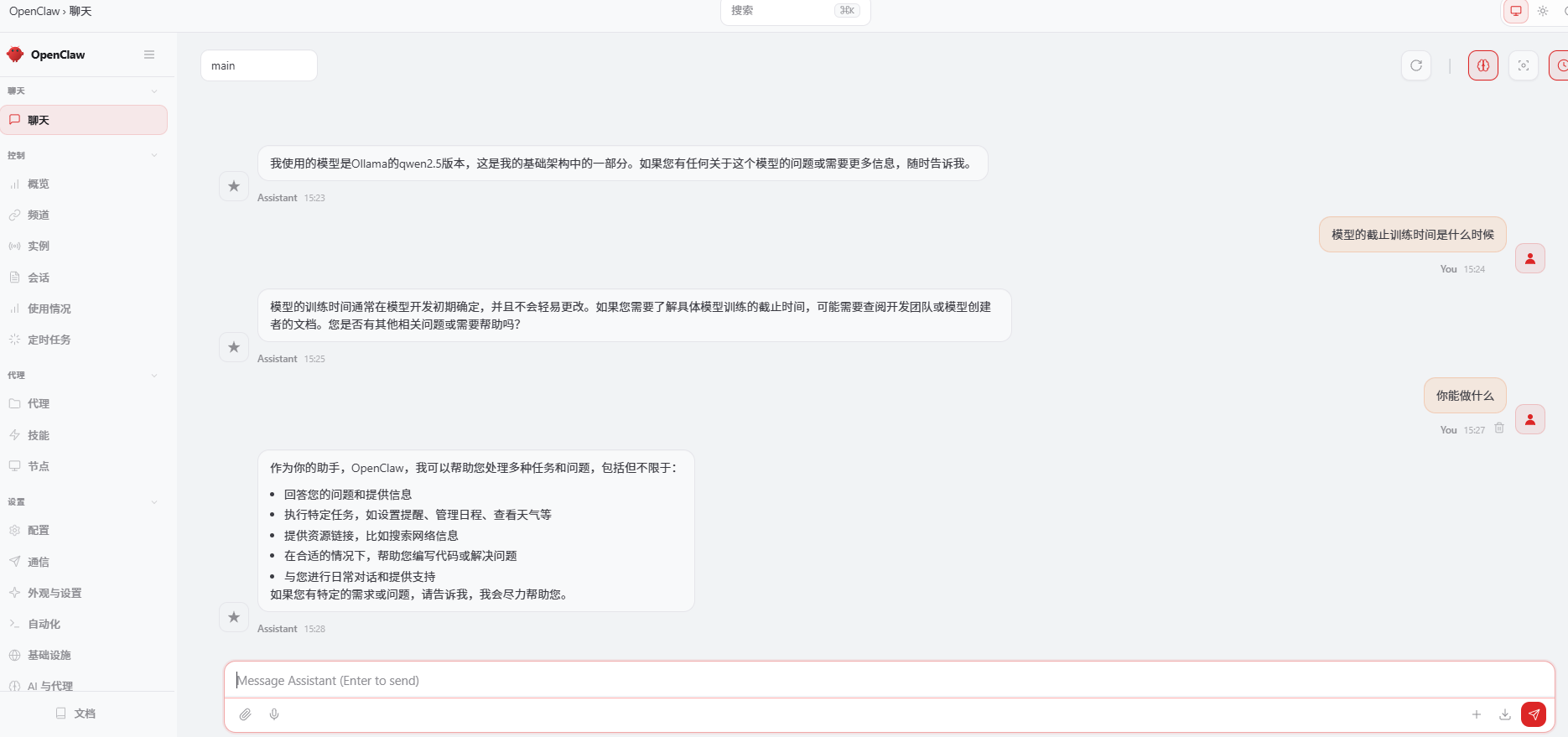

配置完成重新启动后,就可以先试试能不能聊天,看是否连接上大模型

- 监控资源:

开启工具(特别是代码解释器)时,留意任务管理器。如果 Ollama 进程占用超过 90% 内存,考虑关闭 code-interpreter 或换用更小的模型 (如 qwen2.5:1.5b 用于简单任务)。

最后

恭喜!🎉 既然 OpenClaw 已经能正常聊天,说明最难的环境配置和模型连接已经搞定。

现在的 OpenClaw 就像一个刚出生的“婴儿”,虽然能说话,但还不会“干活”(操作文件、联网搜索、控制电脑)。后续的配置目标是把它升级为一个全能的数字员工。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)