AI + 可观测性架构:企业级自主智能运营的缺失底层与全栈落地指南

2026 年,AI 驱动的自动化运营已经成为企业数字化转型的核心赛道。从云原生环境的智能运维、分布式系统的故障自愈,到业务流程的全链路优化、资源成本的智能管控,无数企业都在试图用 AI 实现 “自主、弹性、智能” 的运营体系。但残酷的行业现实是:超过 80% 的企业级 AI 运营系统,最终都停留在 Demo 阶段,要么在生产环境中频繁误报、漏报,要么自动化动作频频引发业务风险,根本无法实现真正的无人值守运营。

而绝大多数企业失败的核心原因,都犯了同一个致命的逻辑错误:在 AI 能够自动化运营之前,系统必须先理解自身的行为;但无数企业的 AI 讨论,都是从模型开始的。

他们一上来就追逐更强大的异常检测算法、更智能的根因分析大模型、更自动化的执行引擎,却完全忽略了整个 AI 系统的底层基石 —— 一套完整、全链路、上下文感知的可观测性架构。最终的结果,就是 AI 模型在海量、零散、无关联、无上下文的遥测数据中,变成了 “规模化的猜测机器”,看似炫酷的自动化,实则隐藏着巨大的运营风险。

现代企业的技术平台,早已不是单体应用的时代。它们是由微服务、容器编排平台、跨网络 API、分布式数据库、实时事件流、边缘计算系统共同组成的复杂分布式环境。每一个组件、每一个节点、每一次调用,都在持续不断地产生海量的运营信号:指标、日志、链路、事件。

今天的企业,从来都不缺遥测数据的生成能力。真正的核心挑战,从来都不是 “如何采集数据”,而是如何把海量、分散、异构的信号,转化为对系统行为的运营级理解,最终变成可落地、可信赖的自动化决策。而这,正是可观测性架构的核心价值,也是企业级 AI 运营系统不可逾越的底层前提。

本文将完整拆解 AI + 可观测性的全栈架构,理清从原始遥测信号到智能自动化运营的完整链路,搞懂为什么可观测性是 AI 智能的安全底座,以及企业落地过程中的核心误区与破局路径。

一、现代分布式系统的核心困境:海量信号,却无运营洞察

在云原生与分布式架构全面普及的今天,企业的 IT 环境已经发生了本质性的变化。单体应用时代,我们只需要监控几个核心指标、几台服务器的状态,就能掌控整个系统的运行情况;但今天,一个中等规模的企业级应用,就可能包含数百个微服务实例、数千个容器 Pod、跨多个可用区的数据库集群、数十条实时事件流,以及遍布全球的边缘节点。

这些分布式组件,每一秒都在产生四大类核心遥测信号,也就是可观测性的 “四大黄金支柱”:

- Metrics(指标):系统运行状态的量化数值,比如 CPU 使用率、内存占用、接口响应时间、请求成功率、错误率,是系统健康状态的核心量化指标;

- Logs(日志):系统事件的结构化 / 非结构化记录,比如程序运行日志、错误堆栈、用户操作记录、接口调用详情,是故障排查、行为追溯的核心依据;

- Traces(链路):分布式请求的全链路追踪记录,比如一个用户请求从前端发起,经过 API 网关、多个微服务、数据库、缓存的完整调用路径、耗时、状态,是分布式系统问题定位的核心工具;

- Events(事件):系统状态变化的离散事件记录,比如容器的创建与销毁、节点的上下线、配置变更、故障触发、自动扩缩容动作,是系统行为变更的核心凭证。

但绝大多数企业都陷入了一个共同的困境:我们采集了所有能采集的信号,搭建了完整的监控仪表盘,却依然无法真正理解系统的行为。

- 故障发生时,我们能看到指标异常、日志报错,却无法快速定位根因,只能在海量的信号中人工排查,平均故障解决时间(MTTR)居高不下;

- 系统出现性能劣化时,我们能看到响应时间变慢,却无法在数千条分布式链路中,找到真正的瓶颈节点;

- 我们能看到资源使用率的波动,却无法准确预测未来的容量需求,只能被动应对流量高峰,或者过度预留资源造成成本浪费;

- 最致命的是,我们无法把这些分散的信号,关联成一个完整的系统行为视图,只能看到一个个孤立的 “点”,却看不到整个系统的 “面”。

这就是传统监控与现代可观测性的核心区别:传统监控是 “被动告警”,只能告诉你 “系统哪里出问题了”;而现代可观测性是 “主动理解”,能告诉你 “系统为什么出问题,以及应该怎么解决”。而后者,正是 AI 能够安全、可靠地驱动自动化运营的核心前提。

二、AI + 可观测性全栈架构拆解:从信号到自动化的完整闭环

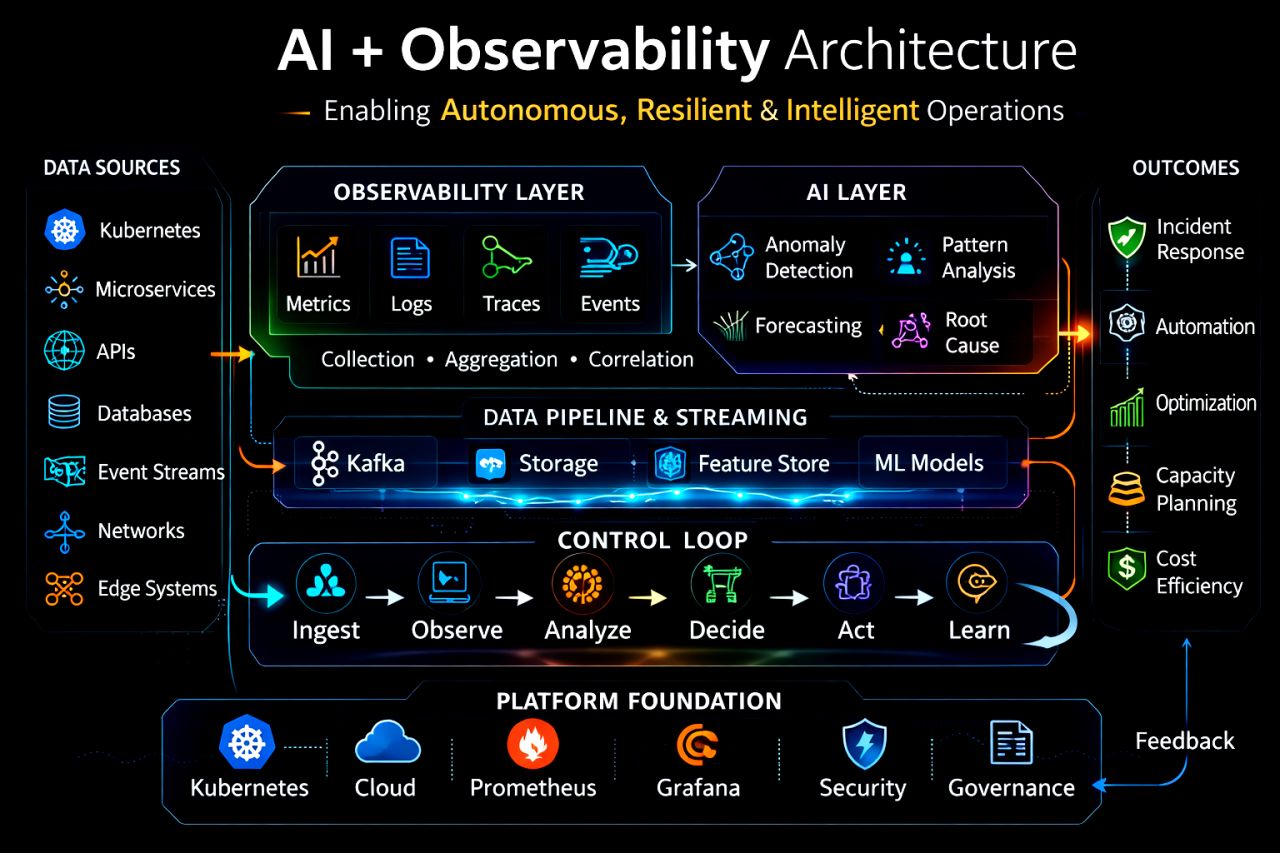

一套完整的 AI + 可观测性架构,不是监控工具与 AI 模型的简单拼接,而是一套层层递进、环环相扣、闭环运行的系统工程。它从底层的分布式数据源出发,经过可观测性层、数据管道层、AI 层的处理,通过核心控制循环实现从洞察到行动的转化,最终落地为可量化的业务成果,同时通过平台底座保障整个系统的稳定、安全与合规。

下面我们将完整拆解架构的每一层,理清层与层之间的依赖关系与核心价值。

1. 数据源层:整个架构的信号源头

数据源层,是整个可观测性架构的最底层,是所有遥测信号的产生端,也是整个系统的 “感知神经末梢”。它覆盖了企业分布式环境的所有核心组件:

- 容器编排平台:Kubernetes 集群的节点、Pod、容器、服务的全维度运行数据;

- 微服务架构:业务微服务的运行状态、接口调用、性能指标、错误日志;

- 南北向与东西向 API:API 网关、服务间调用的请求量、响应时间、错误率、鉴权日志;

- 分布式数据库与缓存:数据库的查询性能、连接数、事务状态、缓存命中率、读写延迟;

- 实时事件流:Kafka、RocketMQ 等消息队列的生产消费速率、堆积量、事件流转状态;

- 底层网络:交换机、路由器、防火墙的网络流量、延迟、丢包率、连接状态;

- 边缘计算系统:分布在边缘节点的设备、应用的运行状态、数据上报、事件记录。

这一层的核心要求,是全量、完整、标准化的信号采集。如果数据源存在缺失、延迟、格式不统一的问题,那么上层所有的可观测性分析、AI 决策,都会变成 “无源之水、无本之木”。就像原文中强调的:“如果信号是不完整的,那么决策就会变得不可靠。”

2. 可观测性层:AI 智能的核心数据底座

可观测性层,是整个架构的核心基础层,也是连接原始信号与上层 AI 智能的关键桥梁。它的核心工作,是对四大黄金信号 —— 指标、日志、链路、事件,完成全流程的采集、聚合、关联、探索,把分散、异构的原始信号,转化为具备上下文、可关联、可分析的结构化运营数据。

很多企业对可观测性的理解,停留在 “把日志、指标、链路存起来,能查能看” 的阶段,但这只是最基础的功能。真正能支撑 AI 运营的可观测性层,核心能力是跨信号的全链路关联:它能把一个异常指标,和对应的错误日志、分布式链路、触发的变更事件关联起来,形成一个完整的上下文视图,而不是让 AI 在孤立的信号中盲人摸象。

比如,当一个接口的错误率飙升时,可观测性层不仅能采集到这个异常指标,还能自动关联到:这个接口对应的分布式链路,找到调用链路上的瓶颈节点;对应服务的错误日志,找到具体的报错堆栈;同一时间发生的配置变更事件,找到可能的触发原因;底层节点的资源指标,找到是否存在资源瓶颈。这些具备完整上下文的关联数据,才是 AI 能够准确完成异常检测、根因分析的核心前提。

3. 数据管道与流处理层:架构的实时数据大动脉

如果说可观测性层是 AI 的 “数据底座”,那么数据管道与流处理层,就是整个架构的 “数据大动脉”。它负责把可观测性层处理后的海量运营数据,高效、可靠、低延迟地流转到 AI 层、控制循环与存储系统中,支撑整个架构的实时运行。

这一层的核心组件,分为四大模块:

- 实时事件流引擎:通常以 Apache Kafka 为核心,负责高吞吐、低延迟的遥测数据传输,实现海量实时信号的有序流转、分区处理与多消费者分发,是整个流处理架构的核心;

- 存储层:包括时序数据库、日志存储、对象存储,负责不同类型遥测数据的持久化存储,满足实时查询、历史回溯、离线分析的不同需求;

- 特征存储:这是连接可观测性与 AI 的关键组件,负责对可观测性数据进行特征提取、标准化、版本管理与在线服务,为 AI 模型提供高质量、低延迟的特征数据,避免 “训练 - 线上特征不一致” 的行业痛点;

- ML 模型部署与推理引擎:负责 AI 模型的部署、版本管理、在线推理与弹性扩缩容,实现 AI 能力的实时、高可用调用。

这一层的核心价值,是解决了 “海量遥测数据如何实时、可靠地支撑 AI 决策” 的工程化问题。没有这一层的支撑,哪怕可观测性数据再完整,AI 模型再强大,也无法在生产环境中实现低延迟、高可靠的实时运营决策。

4. AI 层:把运营数据转化为决策洞察的 “大脑”

AI 层,是整个架构的智能核心,它基于可观测性层提供的高质量、全上下文数据,完成传统人工运营无法实现的大规模、高精度、实时性的分析与洞察,把原始数据转化为可落地的决策依据。

其核心能力分为四大模块:

- 异常检测:基于机器学习模型,实时检测系统运行状态的异常行为,包括指标的突增突降、日志中的未知错误、链路中的性能劣化、事件中的异常变更。相比传统的静态阈值告警,AI 驱动的异常检测能够自适应系统的动态变化,大幅降低误报率与漏报率,提前发现潜在的故障风险;

- 模式分析:对系统的长期运行数据进行深度模式挖掘,识别系统的运行规律、性能瓶颈、依赖关系、风险点,比如识别流量的周期性波动规律、微服务之间的强依赖关系、系统性能劣化的长期趋势,为系统优化、风险防控提供数据支撑;

- 趋势预测:基于历史与实时数据,对系统未来的运行状态进行精准预测,比如流量峰值预测、资源容量预测、故障风险预测、成本趋势预测,让运营从 “被动响应” 转向 “主动预判”,提前做好资源规划与风险防控;

- 根因分析:这是 AI 层最核心的价值,当故障发生时,AI 能够基于全链路关联的可观测性数据,自动定位故障的根因节点、触发原因,给出可落地的修复建议,甚至直接生成故障解决方案,大幅缩短平均故障解决时间(MTTR),减少故障带来的业务损失。

但必须强调的是:AI 层的能力上限,完全由底层可观测性层的数据质量决定。如果可观测性层无法提供全链路、关联化、有上下文的高质量数据,再强大的 AI 模型也无法输出准确的洞察,最终只会变成 “垃圾进,垃圾出” 的无效系统。

5. 平台底座层:整个架构的稳定运行基石

平台底座层,是整个 AI + 可观测性架构的运行基石,为上层所有组件提供基础设施、监控可视化、安全与合规保障,确保整个系统能够长期、稳定、安全地运行。

其核心组件包括:

- 基础设施层:Kubernetes 容器编排平台、公有云 / 私有云 / 混合云基础设施,为整个架构提供弹性、可扩展的运行环境;

- 基础监控与可视化层:Prometheus 指标监控系统、Grafana 可视化平台,负责核心组件的运行状态监控、数据可视化、基础告警,是整个架构的 “仪表盘”;

- 安全体系:包括身份认证、权限管控、数据加密、漏洞防护,确保整个架构的访问安全、数据安全、运行安全;

- 治理体系:包括数据治理、模型治理、自动化流程治理,规范数据的全生命周期管理、AI 模型的全流程管控、自动化动作的合规边界,确保整个系统的运行符合企业的治理规则与行业合规要求。

三、架构的核心灵魂:闭环控制循环,实现从洞察到行动的自主运营

如果说前面的分层是架构的 “躯干”,那么位于架构中心的闭环控制循环,就是整个系统的 “灵魂”。它是连接可观测性、AI 智能与自动化运营的核心纽带,把原始的遥测数据,转化为持续优化的运营决策与自动化动作,真正实现 “自主、弹性、智能” 的运营目标。

这个闭环分为 6 个核心环节,环环相扣,形成一个持续迭代、自我优化的完整循环:Ingest(采集)→ Observe(观测)→ Analyze(分析)→ Decide(决策)→ Act(执行)→ Learn(学习)。

1. Ingest(采集)

闭环的起点,是从全量数据源中,实时、完整、标准化地采集所有遥测信号,包括指标、日志、链路、事件。这一步的核心要求,是确保数据的完整性、实时性与一致性,为后续的所有环节提供可靠的原始数据。

2. Observe(观测)

基于采集到的原始信号,通过可观测性层完成数据的聚合、清洗、关联与上下文构建,把分散的信号转化为对系统运行状态的完整视图,实时监控系统的健康状态,识别出需要进一步分析的异常行为与风险点。

3. Analyze(分析)

把观测层输出的系统状态数据,输入到 AI 层,通过异常检测、模式分析、根因定位、趋势预测等 AI 能力,完成深度分析,把系统状态数据转化为可决策的洞察结论,比如 “系统故障的根因是数据库连接池耗尽”、“未来 2 小时流量将迎来 3 倍峰值,需要提前扩容”。

4. Decide(决策)

基于 AI 层输出的分析洞察,结合企业的运营规则、业务目标、合规要求,做出自动化的运营决策。比如 “触发数据库连接池参数调整的自动化脚本”、“执行对应服务的 Pod 扩容动作”、“触发故障应急预案,将流量切换到备用集群”。这一步是闭环的核心,也是风险管控的关键节点,必须设置清晰的决策边界、权限分级与人工复核机制,避免自动化决策带来的业务风险。

5. Act(执行)

基于决策层的指令,通过自动化执行引擎,完成对应的运营动作,比如资源扩缩容、配置变更、故障修复、流量调度、成本优化等,把决策转化为实际的运营动作,解决系统的问题、优化系统的运行状态。

6. Learn(学习)

闭环的最后一步,也是实现持续优化的关键。执行动作完成后,系统会自动采集执行后的系统状态变化、业务效果反馈,对整个闭环的效果进行评估:决策是否正确?执行是否达到预期?AI 分析是否准确?观测是否存在遗漏?基于这些反馈,持续优化 AI 模型、观测规则、决策逻辑、执行流程,让整个闭环的准确性、可靠性、效率持续提升,实现真正的自我优化。

这个闭环的核心逻辑,是每一个环节都完全依赖于前一个环节的可靠性。采集环节的数据不完整,观测环节就无法构建准确的系统视图;观测环节缺少上下文关联,分析环节的 AI 就无法输出准确的洞察;分析环节的洞察出现偏差,决策环节就会做出错误的判断;决策环节的规则不清晰,执行环节的自动化就会带来巨大的业务风险。

这也正是原文中强调的核心观点:企业 AI 运营的落地,很少是一个建模问题,通常是一个系统架构问题。很多企业的 AI 运营系统失败,不是因为 AI 模型不够强大,而是因为整个闭环的底层环节存在缺陷,最终导致整个系统的决策不可靠、自动化有风险。

四、为什么传统监控仪表盘,撑不起 AI 驱动的自动化运营?

很多企业都会有一个疑问:我们已经搭建了基于 Prometheus+Grafana 的完整监控体系,有上百个监控仪表盘,覆盖了所有核心指标,为什么还是无法支撑 AI 驱动的自动化运营?

答案很简单:传统监控仪表盘,从设计理念上,就不是为 AI 驱动的自动化运营服务的。

传统监控仪表盘的核心目标,是给人看的。它把系统的核心指标可视化,让运维人员能够直观地看到系统的运行状态,当故障发生时,能够通过仪表盘快速定位问题。它是被动的、静态的、人工驱动的,它的核心价值是 “降低人工运维的门槛”,而不是 “实现自主的自动化运营”。

而 AI 驱动的自动化运营,对可观测性的要求,发生了本质性的变化:

- 从静态阈值到动态自适应:传统监控依赖人工设置的静态阈值,而分布式系统的运行状态是动态变化的,静态阈值要么频繁误报,要么漏报关键风险;AI 驱动的运营,需要可观测性系统能够提供动态、自适应的基线,识别复杂的异常模式;

- 从孤立指标到全链路关联:传统仪表盘的指标是孤立的,运维人员需要人工在多个仪表盘之间跳转,关联不同的信号,定位故障根因;而 AI 驱动的自动化,需要可观测性系统提前完成跨信号、全链路的上下文关联,给 AI 提供完整的故障视图,否则 AI 根本无法完成自动根因定位;

- 从事后排查到事前预判:传统监控是 “故障发生后告警”,属于事后补救;而 AI 驱动的运营,核心是 “事前预判、主动防控”,需要可观测性系统提供长期的历史数据、趋势变化、模式挖掘,支撑 AI 的趋势预测与风险预判;

- 从人工决策到自动化执行:传统监控的终点是 “给人发出告警”,最终的决策与执行,还是由人来完成;而 AI 驱动的自动化运营,终点是 “自动做出决策、自动执行动作”,这对可观测性数据的准确性、完整性、上下文关联性,提出了数量级更高的要求 —— 毕竟,人可以容忍告警的偏差,而自动化执行的错误,会直接带来业务损失。

这就是为什么,哪怕你有再完善的监控仪表盘,也无法直接搭建起可靠的 AI 运营系统。传统监控只是可观测性架构的基础组成部分,而不是全部。想要实现真正的 AI 驱动自动化运营,你需要的是一套能够支撑全链路关联、动态分析、上下文感知的完整可观测性架构,而不是一堆给人看的静态仪表盘。

五、企业落地的核心缺口与启示

对于企业架构师与平台工程师而言,搭建 AI + 可观测性架构的过程,本质上是补全企业数字化运营的底层短板。结合行业实践,当前企业落地过程中,普遍存在四大核心缺口,也是决定项目成败的关键:

- 遥测缺口:数据采集不完整、不标准,很多组件的遥测信号缺失,日志、指标、链路、事件没有统一的标准化格式,导致上层的可观测性分析无法开展;

- 可观测性缺口:只完成了数据的采集与存储,没有实现跨信号的全链路关联,数据是分散、孤立的,无法构建完整的系统上下文视图,导致 AI 无法获得高质量的输入数据;

- AI 智能缺口:AI 模型与可观测性架构脱节,模型训练用的数据与线上实际运行的数据不一致,没有针对运营场景做针对性的优化,导致模型的误报率高、根因定位不准确,无法支撑实际决策;

- 自动化缺口:没有建立清晰的决策边界、权限分级、安全护栏与人工复核机制,自动化动作的全流程没有审计与回滚能力,导致自动化运营存在巨大的业务风险。

而企业落地的核心原则,永远只有一个:先建可观测性,再谈 AI 智能,最后做自动化。

永远不要颠倒这个顺序。不要在没有完整可观测性架构的前提下,盲目上马 AI 运营项目;不要在没有验证 AI 洞察准确性的前提下,盲目开启全自动化执行。可观测性是 AI 智能的眼睛和耳朵,是自动化运营的安全护栏。没有它,再强大的 AI 智能,也只是规模化的猜测;再炫酷的自动化,也只是随时会爆炸的定时炸弹。

结语

在 AI 技术飞速发展的今天,我们很容易被各种炫酷的大模型、自动化 Demo 吸引,却忽略了企业级系统运营的本质:任何智能,都必须建立在对系统行为的完整、准确理解之上。

AI + 可观测性架构的核心价值,从来不是用 AI 替代人工运维,而是通过可观测性架构,让 AI 能够安全、可靠、准确地理解系统的行为,最终实现从 “人工驱动的被动运维”,到 “数据驱动的主动运营”,再到 “AI 驱动的自主优化” 的跨越。

正如那句核心结论:可观测性,让智能能够在复杂系统中安全运行。没有它,智能就会变成规模化的猜测。

在接下来的内容中,我们还会进一步拆解这个架构的每一层:遥测信号的标准化设计、可观测性平台的搭建、AI 检测层的工程化落地、决策引擎的设计、自动化闭环的安全护栏,深入探讨企业级 AI 系统在哪些环节能够稳定落地,又会在哪些环节面临运营压力的挑战。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献45条内容

已为社区贡献45条内容

所有评论(0)