【Claude】Claude Code Opus 4.6震惊上线!获取Claude API Key的多种方式全攻略:从入门到精通,再到详解教程!

实测Claude Code Opus 4.6:不讲虚的,这才是打工人/程序员能用的AI

最近大模型圈又炸了,Anthropic直接放出Claude Code Opus 4.6,网上吹得天花乱坠,什么“行业颠覆”“性能天花板”,看多了反而觉得虚。作为天天跟代码、文档打交道的技术人,咱不整那些高大上的词,就用大白话聊聊:Claude Code Opus 4.6到底强在哪?对咱们普通人、程序员到底有啥用?实测到底靠不靠谱?

Claude系列到底是啥(极简版)

很多人对Claude的印象还停留在“安全、上下文长”,这里先极简复盘下,方便新手看懂,老用户也能快速回忆迭代脉络,不用看冗长的专业术语:

-

核心底色:Anthropic家的大模型,主打一个安全不瞎编、能读长文档、听话照做,不像有些模型动不动“幻觉”编瞎话,合规性拉满,企业、敏感行业用着放心。

-

迭代关键节点:从最早Claude 1只能读几万字,到Claude 2/2.1撑到15万字,再到Claude 3系列做多模态,一步步堆性能、扩容量,这次Opus 4.6直接跳级升级。

-

日常能用的产品:网页版免费唠嗑、付费开高阶能力;企业版私有化部署不泄露数据;API供开发者接入自己的项目;还有插件能联网、跑代码、分析文件,实用性拉满。

Claude Code Opus 4.6核心升级

官方文案太绕,咱直接拆干货,每一点都讲清楚“升级了啥+对我有啥用”,看完就知道值不值得用:

1. 100万token上下文:真·一口气读完一本厚书

别被token数唬住,换算成大白话:100万token≈75万字左右,前代才20万token,这次直接翻5倍。

以前用AI处理长文档,要么拆成好几段,要么读着读着就忘前面内容;现在直接丢一整本合同、十几万字的博士论文、整个项目代码库,它能从头到尾吃透,精准揪细节,专业“大海捞针”测试拿了76%的分,处理海量资料再也不用分段折腾。

2. 代码能力拉满:实测能当半个资深程序员

作为Code版本,核心就是干活写代码,实测下来真不是吹:

-

专业编程 benchmark 跑分超GPT-5.2、Gemini 3 Pro,实打实的编程AI第一梯队;

-

不光能写前端、后端、移动端各种代码,还能自主查bug、优化逻辑、修复漏洞,不用你一句句催;

-

大型项目架构、代码重构、终端操控都能搞定,全栈开发场景通吃,新手能靠它入门,老程序员能省大把调试时间。

3. 极速模式:等半天?不存在的

很多大模型性能强但慢得离谱,Opus 4.6直接加了极速模式,输入/fast一键切换,响应速度比标准版快2.5倍。

写代码即时调试、临时查资料、高频问答,不用干等着卡顿,复杂任务也能流畅输出,兼顾性能和效率,打工人摸鱼(不是)赶工期都好用。

4. 多智能体协作:一个AI顶一个开发小组

这是最惊喜的点,不是单傻干活,而是能拆分多个智能体分工配合:

比如审核大型代码库,一个智能体查前端、一个查后端、一个测安全、一个做性能优化,各司其职还能联动,相当于免费雇了个AI开发小组,复杂项目攻坚效率直接翻倍,彻底告别单AI能力瓶颈。

5. 办公+研发通吃:不止写代码,打工人也能冲

别以为只有程序员能用,Office全家桶适配拉满:Excel数据分析纠错、PPT一键生成、Word批量处理都拿手;还能接入Google AI IDE等开发平台,写代码、做报表、整文档一站式搞定,学生、职场人、开发者都能找到用武之地。

最后说句实在话:值不值得用?

相比于那些华而不实、只会唠嗑的AI,Claude Code Opus 4.6是真·干活型选手,没有虚头巴脑的噱头,每一项升级都踩中了用户痛点:长文档不费劲、写代码够专业、响应不拖沓、协作够高效。

不管是靠代码吃饭的程序员,还是天天跟文档打交道的打工人,亦或是做科研的学生党,它都能实实在在提升效率,而不是凑个热闹。目前高阶功能需要付费/API调用,但对比带来的时间成本节省,性价比真的不低。

后续我会继续更新Opus 4.6的实操技巧、避坑指南,感兴趣的可以点赞关注,一起玩转这款实用AI~

小贴士:新手刚用别贪多,先从长文档总结、简单代码编写入手,熟悉后再试多智能体协作,上手更快不踩坑!

通过“能用AI”获取API Key(国内)

针对国内用户,由于部分海外服务访问限制,可以通过国内平台“能用AI”获取API Key。

1、访问能用AI工具

在浏览器中打开能用AI进入主页

https://ai.nengyongai.cn/register?aff=PEeJ

登录后,导航至API管理页面。

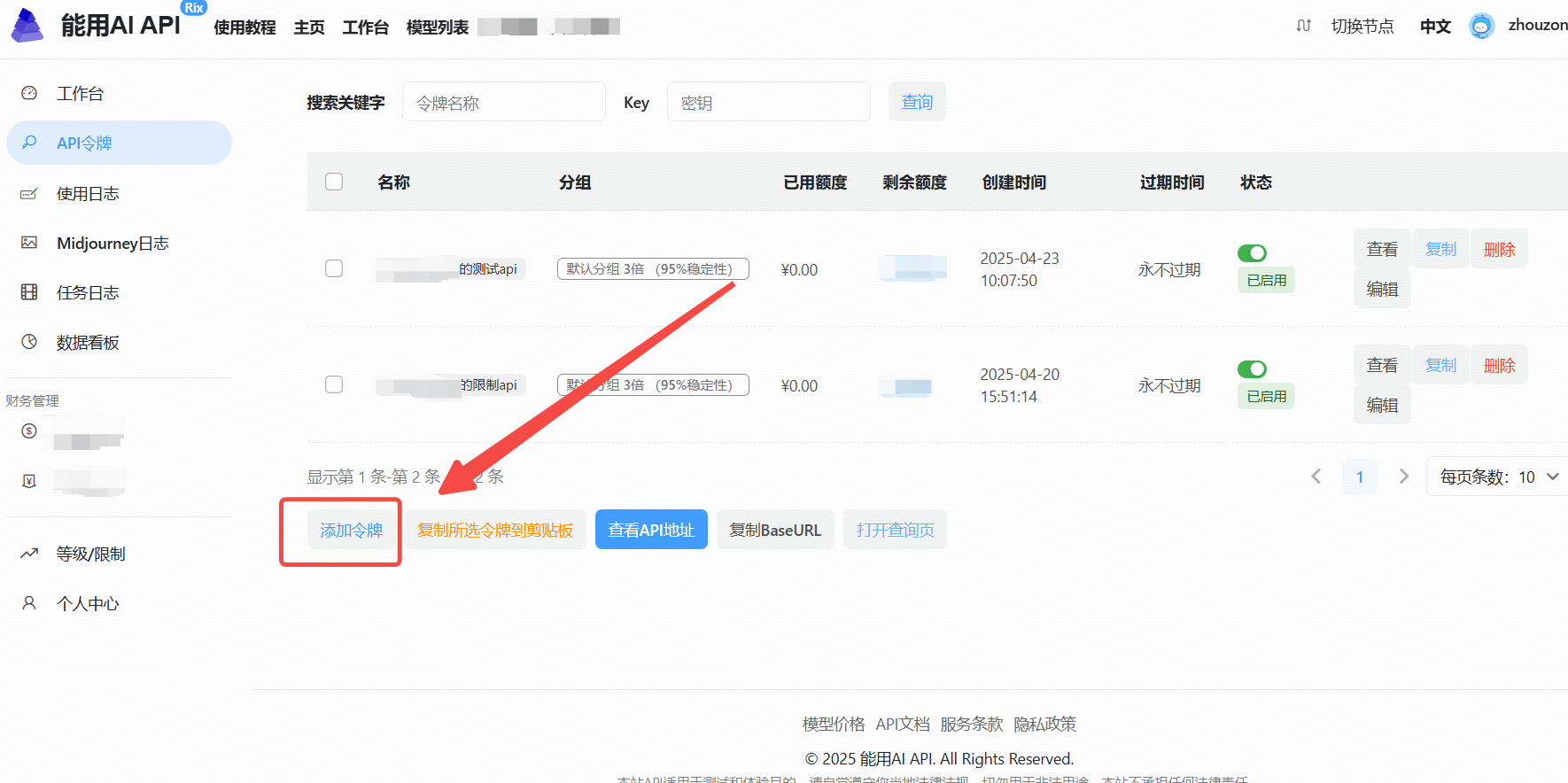

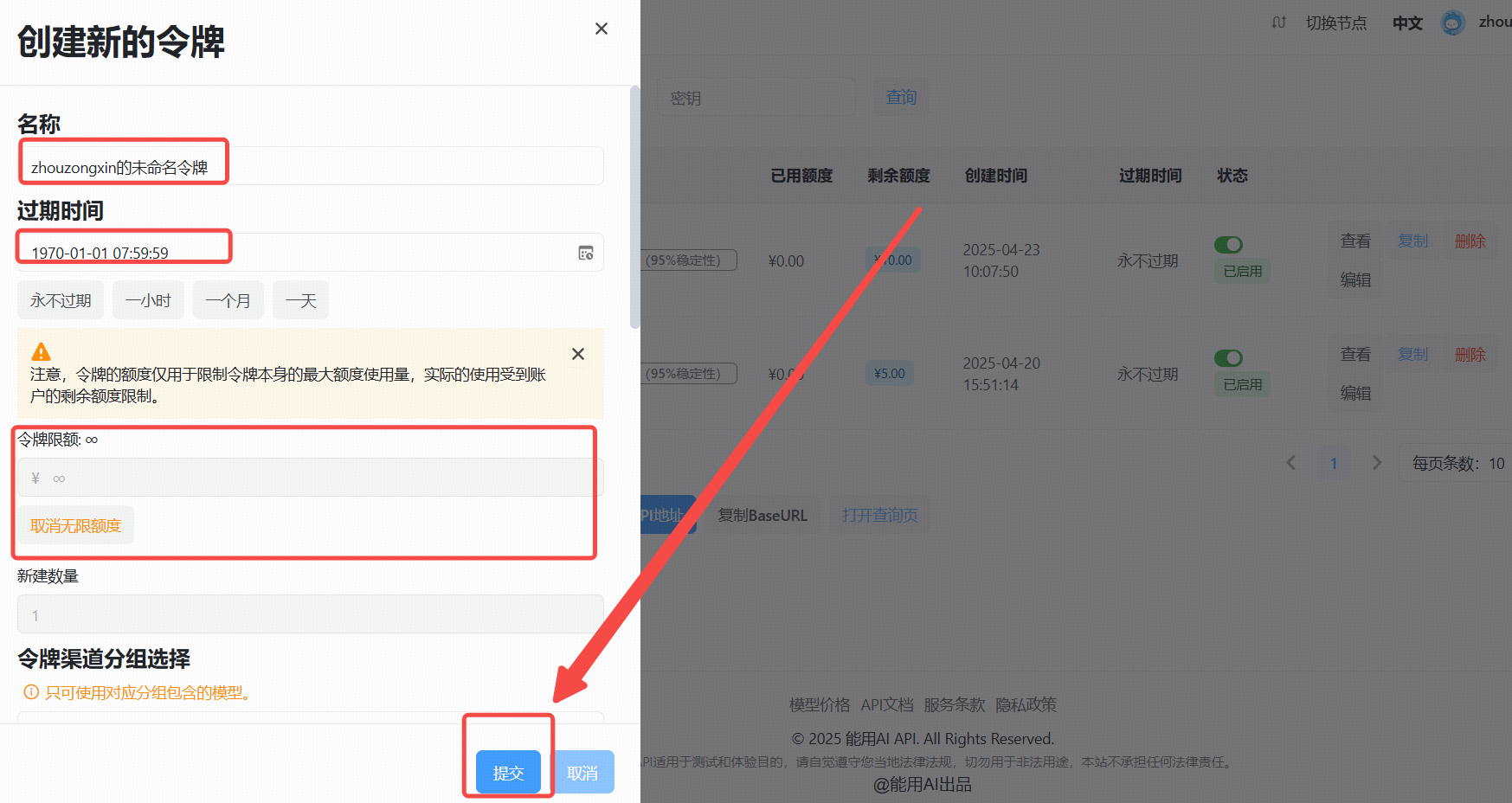

2、生成API Key

- 点击“添加令牌”按钮。

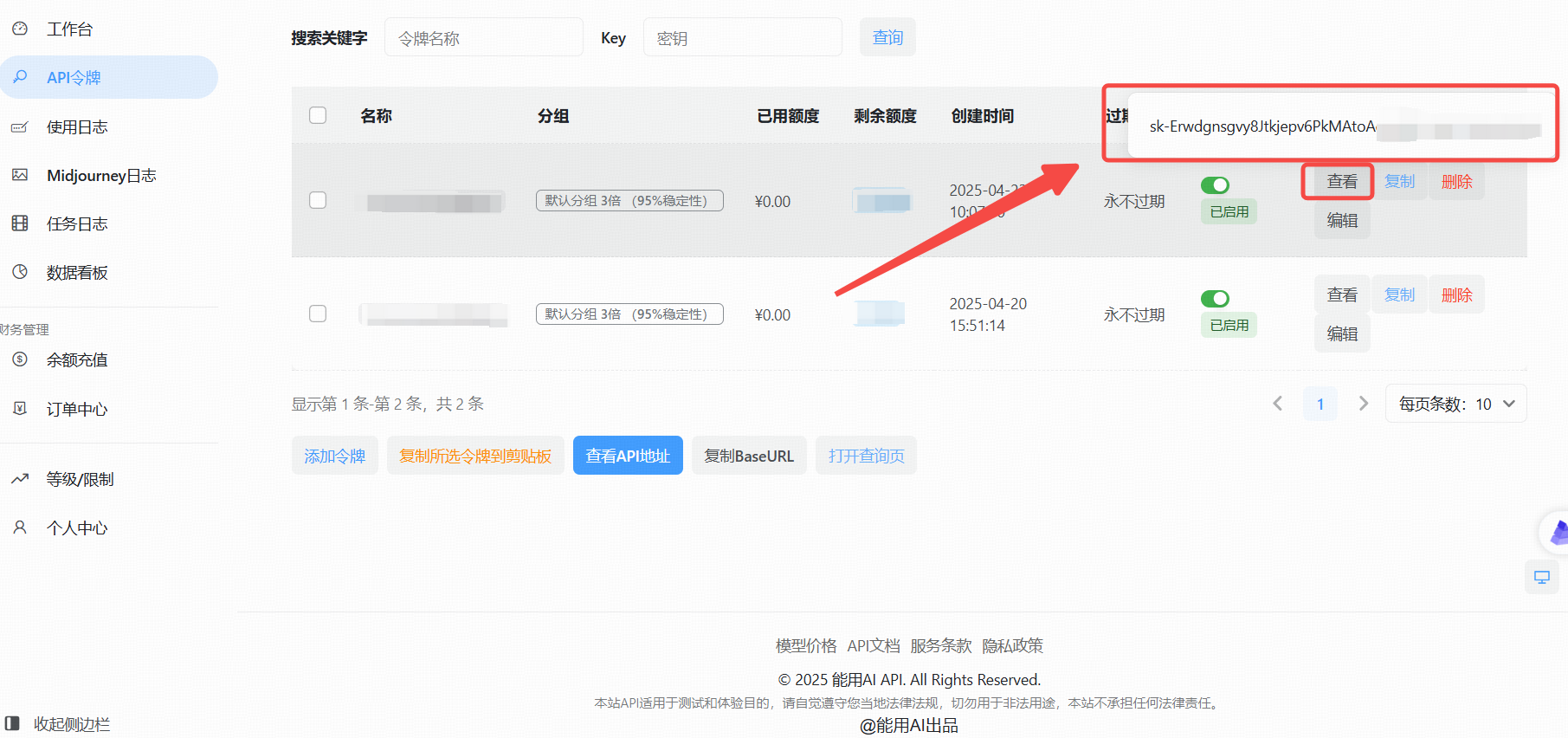

- 创建成功后,点击“查看KEY”按钮,获取你的API Key。

3、使用大模型 API的实战教程

拥有了API Key后,接下来就是如何在你的项目中调用大模型 API了。以下以Python为例,详细展示如何进行调用。

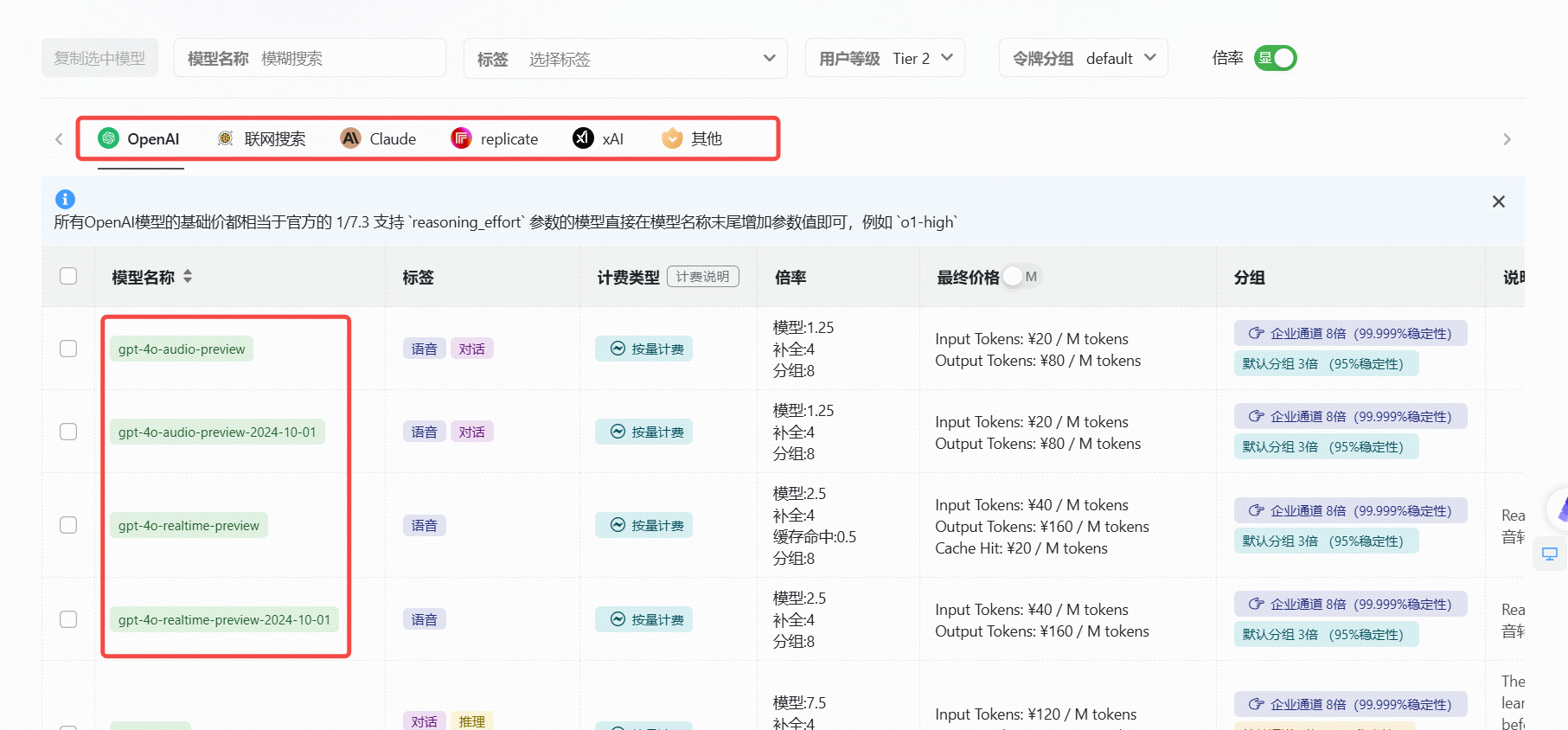

(1).可以调用的模型

gpt-3.5-turbo

gpt-3.5-turbo-1106

gpt-3.5-turbo-0125

gpt-3.5-16K

gpt-4

gpt-4-1106-preview

gpt-4-0125-preview

gpt-4-1106-vision-preview

gpt-4-turbo-2024-04-09

gpt-4o-2024-05-13

gpt-4-32K

claude-2

claude-3-opus-20240229

claude-3-sonnet-20240229

等等100多种模型

(2).Python示例代码(基础)

基本使用:直接调用,没有设置系统提示词的代码

from openai import OpenAI

client = OpenAI(

api_key="这里是能用AI的api_key",

base_url="https://ai.nengyongai.cn/v1"

)

response = client.chat.completions.create(

messages=[

# 把用户提示词传进来content

{'role': 'user', 'content': "鲁迅为什么打周树人?"},

],

model='gpt-4', # 上面写了可以调用的模型

stream=True # 一定要设置True

)

for chunk in response:

print(chunk.choices[0].delta.content, end="", flush=True)

在这里插入代码片

(3).Python示例代码(高阶)

进阶代码:根据用户反馈的问题,用Claude进行问题分类

from openai import OpenAI

# 创建OpenAI客户端

client = OpenAI(

api_key="your_api_key", # 你自己创建创建的Key

base_url="https://ai.nengyongai.cn/v1"

)

def api(content):

print()

# 这里是系统提示词

sysContent = f"请对下面的内容进行分类,并且描述出对应分类的理由。你只需要根据用户的内容输出下面几种类型:bug类型,用户体验问题,用户吐槽." \

f"输出格式:[类型]-[问题:{content}]-[分析的理由]"

response = client.chat.completions.create(

messages=[

# 把系统提示词传进来sysContent

{'role': 'system', 'content': sysContent},

# 把用户提示词传进来content

{'role': 'user', 'content': content},

],

# 这是模型

model='gpt-4', # 上面写了可以调用的模型

stream=True

)

for chunk in response:

print(chunk.choices[0].delta.content, end="", flush=True)

if __name__ == '__main__':

content = "这个页面不太好看"

api(content)

通过这段代码,你可以轻松地与AI模型进行交互,获取所需的文本内容。✨

更多文章

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)