别再以为车只是“四个轮子加沙发”!聊聊正火的VLA大模型,它让汽车长了“脑子”

不知道大家最近刷资讯的时候,有没有被一个词频繁刷屏——VLA。

小鹏刚发布了第二代VLA,宣称实现了“直觉驾驶”-1;理想也在推MindVLA,说要让车学会思考;甚至连英伟达这样的芯片巨头,也在大力押注“推理VLA”。

这阵仗,让人恍惚间回到了几年前大家都在聊“端到端”的时候。但VLA到底是什么?它是新的营销词汇,还是真的能让我们手里的车变得更聪明?

今天,我们就抛开那些晦涩的技术论文,用最通俗的大白话,来聊聊这个正在改变汽车“智商”的VLA大模型。

一、 从“听话的机器”到“有脑子的司机”

要理解VLA,我们得先回顾一下司机是怎么开车的。

想象一下你正在通过一个复杂的路口:

-

你用眼睛看(视觉):观察红绿灯、行人、电动车、道路标线。

-

你用脑子想(语言/逻辑):“这个黄灯要闪了,我得减速;右边那辆电动车有点靠过来,可能想变道,我得提防着点。”

-

你的手脚动(动作):脚轻踩刹车,手稳住方向盘。

过去几年的辅助驾驶,其实也在模仿这个过程。但传统的方式更像是一个“流水线工厂”:感知模块负责认路(看),规划模块负责想怎么走(想),控制模块负责打方向盘(动)。每个模块各司其职,但沟通效率低,一旦遇到感知模块没见过的“稀奇古怪”的场景,后面的规划和控制就懵了,这就是我们常说的“规则写死”了。

而VLA,就是要把这三个步骤融为一体。

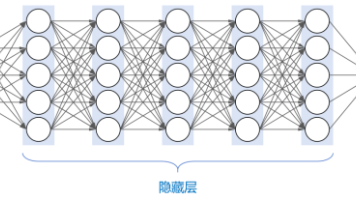

VLA = Vision(视觉) + Language(语言/理解) + Action(动作) -8。

它不再是三个独立的模块,而是一个由海量数据训练出来的“超级大脑”。摄像头看到的东西,直接输入这个大脑,大脑经过思考,直接输出方向盘应该打多少度、油门应该踩多深。

二、 VLA到底牛在哪?它让车有了“常识”

如果说传统的智能驾驶是一个“应试教育的学霸”,那VLA就是一个“懂底层逻辑的学神”。

怎么理解这个区别?我们来看两个例子:

场景一:路上有个烂箱子

-

传统模式:系统识别出一个“障碍物”,但它的数据库里如果没有“烂箱子”这个分类,它可能会犹豫,甚至识别成“不可通行物体”,直接一脚急刹停在路中间,被后车骂死。

-

VLA模式:车通过视觉看到这是一个“破旧的、里面似乎有垃圾冒出来的箱子”。这时,中间的“L”(大语言模型)发挥作用了。因为它读过整个互联网的资料,它拥有“常识”——它知道这种烂箱子通常很轻,里面装的可能是垃圾,大概率可以被推开或者压扁(如果底盘够高的话)。于是它会推理:“这应该是个可以缓慢通过的障碍物。”最终输出一个平稳通过的指令-5-8。

场景二:路边蹿出一个球

-

传统模式:系统识别到一个快速移动的小物体,紧急制动。

-

VLA模式:VLA不仅看到了球,还会推理:“球后面很可能跟着追球的孩子。”于是它不仅会减速,还会提前预判孩子出现的位置,做好备刹准备。这种“防御性驾驶”的能力,就来自于VLA的逻辑推理-7。

看到了吗?VLA最大的进步,是赋予了车辆逻辑推理和“常识”理解能力。它不只是“看见”,更是“看懂”了这个世界-2-9。

三、 第一代VLA和第二代VLA,到底差了哪一步?

最近小鹏发布的“第二代VLA”引发了热议。它和第一代有什么区别?这里不得不提一个关键的变化:干掉“翻译官”。

-

第一代VLA(或者说传统的V-L-A架构):流程是这样的:看(V)→ 翻译成语言描述(L)→ 根据语言描述做出动作(A)。这就像你看了一部无声电影,你先要用文字把画面描述给一个听不懂话的人听,他再去行动。这个过程会有信息丢失——毕竟“一段1200字的文字,也无法精准描述一个十几秒的视频”-10。

-

第二代VLA(直接VA):小鹏第二代VLA的创新在于,去掉了中间的“语言转译”环节-3-4。视觉信号直接输入模型,模型直接输出动作指令。这就像你学会了“看图说话”的终极形态——不用说话,看一眼,手就自然知道怎么动了。

这带来的好处是极其明显的:响应更快、信息无损、决策更接近人类的“直觉” -4。就像优秀乒乓球运动员接球,他不用先在心里默念“球来了,旋转多少度,我要退后一步抬手”,一切都是身体的本能反应。小鹏将其称之为“直觉驾驶”-4。

四、 技术路线“神仙打架”:VLA vs. 世界模型

当然,目前行业内对于如何实现终极自动驾驶,也不是只有VLA这一个声音。另一派是以华为、蔚来为代表的“世界模型”路线-2-10。

怎么理解这两者的区别?网上有个比喻很精妙-2:

-

VLA像是“背单词过四六级”:它通过海量的人类驾驶数据,学习在各种场景下“人类是怎么做的”。它更偏向于实用主义,目标是“先做对,做好”。

-

世界模型像是“学语法、懂逻辑”:它想让AI在脑子里构建一个真实物理世界的“模拟器”。它不仅要会开车,还要理解“为什么轮胎打滑车会失控”、“为什么下雨天刹车距离要变长”。它追求的是本质主义,目标是“真正理解世界后再行动”-2。

虽然听起来世界模型更“高级”,但VLA胜在落地快、可解释性强。而且,业界大佬们普遍认为,这两者未来一定会走向融合-2-10。比如用世界模型在云端生成海量的、现实中极难遇到的长尾场景数据,来喂给车端的VLA模型进行训练;或者用VLA做上层逻辑规划,用世界模型做底层物理推演-2。

五、 总结:VLA时代,我们离“车坐不开”还有多远?

VLA的出现,标志着智能驾驶从“模块化时代”全面迈入“大一统的AI时代”。

以前我们评价一辆车智驾好不好,看的是它装了多少颗激光雷达,芯片算力有多高。但在VLA时代,比的是谁家的模型数据更多、谁家的“脑子”更聪明。它让汽车不再是一个执行命令的机器,而是一个能跟你交流、能理解世界、能自主预判风险的“智能体”-8。

何小鹏说,完全自动驾驶的时代会在1—3年内真正到来-7。或许有些夸张,但不可否认的是,随着VLA这样的技术大规模量产上车,那个我们曾经幻想的“车坐不开”的未来,确实正在以前所未有的速度向我们驶来。

参考资料:

-

中国科技网. 小鹏第二代VLA发布 3月下旬开启推送. 2026-03-03. -1

-

地平线开发者社区. 通俗易懂 | VLA 与世界模型,自动驾驶的左路与右路. 2026-02-09. -2

-

中国科技网. 迎接“物理AI”浪潮 小鹏汽车发布第二代VLA大模型. 2025-11-07. -3

-

中关村在线. 小鹏发布全球首个量产物理世界大模型VLA. 2026-02-27. -4

-

NVIDIA. 什么是推理 VLA?2025-12-10. -5

-

OFweek. 一文看懂视觉语言动作模型(VLA)及其应用. 2025-06-12. -6

-

懂车帝. 不装了!小鹏第二代VLA,上来就卷死同行. 2026-03-02. -7

-

百度百科. 视觉语言动作模型. 2026-01-21. -8

-

地平线开发者社区. 【大模型】VLA初识及在自动驾驶场景中的应用. 2025-07-25. -9

-

证券时报. 多家企业押注VLA背后:智驾路线要趋于融合?2025-12-17.

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)