HBase在大数据领域的数据挖掘应用

HBase在大数据领域的数据挖掘应用

关键词:HBase、大数据、数据挖掘、分布式存储、列式数据库、实时查询、机器学习

摘要:

作为Apache生态中核心的分布式列式数据库,HBase凭借其高扩展性、低延迟随机访问和线性吞吐量优势,成为处理海量稀疏数据的首选方案。本文深入探讨HBase在数据挖掘场景中的核心价值,从架构原理到实际应用,结合具体算法和项目案例,解析其在数据存储、预处理、特征工程及模型训练中的关键作用。通过技术细节与实战经验的结合,揭示HBase如何为电商、社交网络、物联网等领域的复杂数据挖掘任务提供高效支撑,并展望其与实时计算、机器学习框架深度融合的未来趋势。

1. 背景介绍

1.1 目的和范围

随着企业数据规模突破PB级,传统关系型数据库在数据吞吐量、扩展性和成本控制上面临严峻挑战。HBase作为基于Hadoop的分布式列式存储系统,专为海量结构化数据的实时读写设计,其数据模型天然适合存储稀疏、高维度的数据集——这正是数据挖掘任务中常见的数据形态(如用户行为日志、传感器时序数据、社交网络关系数据等)。

本文聚焦HBase在数据挖掘全流程中的技术优势,涵盖数据存储架构设计、高效查询优化、与主流数据挖掘工具集成等核心议题,通过理论分析与代码实践结合,为技术人员提供可落地的解决方案。

1.2 预期读者

- 数据工程师:希望掌握HBase表设计与数据预处理技术

- 数据科学家:探索HBase在特征工程和模型训练中的应用方式

- 架构师:理解HBase与数据挖掘平台(如Spark、Flink)的集成架构

- 大数据开发者:学习HBase性能优化与故障处理经验

1.3 文档结构概述

- 核心概念:解析HBase架构与数据模型,建立与数据挖掘任务的技术关联

- 算法与操作:结合Python实现数据挖掘算法与HBase交互

- 数学模型:通过具体案例说明数据挖掘中的数学原理在HBase中的应用

- 实战项目:完整演示从环境搭建到业务逻辑实现的全流程

- 应用场景:总结典型行业中的成功实践

- 工具资源:提供系统化的学习路径与开发工具链

1.4 术语表

1.4.1 核心术语定义

- 列式数据库:数据按列族存储,支持动态扩展列,适合稀疏数据场景(对比行式数据库的固定模式)

- Region:HBase数据分片单元,每个Region包含某个RowKey范围内的所有数据,是负载均衡的基本单位

- 数据挖掘:从海量数据中提取隐含价值信息的过程,包括分类、聚类、关联分析等任务

- RowKey:HBase表的主键,决定数据分布与查询效率,设计需兼顾散列性与有序性

1.4.2 相关概念解释

- 稀疏数据:数据集中大部分单元格为缺失值或默认值(如用户未交互的商品记录)

- OLTP vs OLAP:HBase原生支持低延迟OLTP查询,通过与Hadoop/Spark集成可扩展至OLAP场景

- 预分区:在表创建时手动划分Region,避免热点问题(如按时间戳加盐分区)

1.4.3 缩略词列表

| 缩写 | 全称 | 说明 |

|---|---|---|

| HDFS | Hadoop分布式文件系统 | HBase底层存储引擎 |

| ZooKeeper | 分布式协调服务 | 管理HBase集群元数据与节点状态 |

| Thrift | 跨语言服务开发框架 | 支持HBase的多语言API访问 |

| MPP | 大规模并行处理架构 | 数据挖掘中常用的分布式计算模型 |

2. 核心概念与联系

2.1 HBase架构原理与数据模型

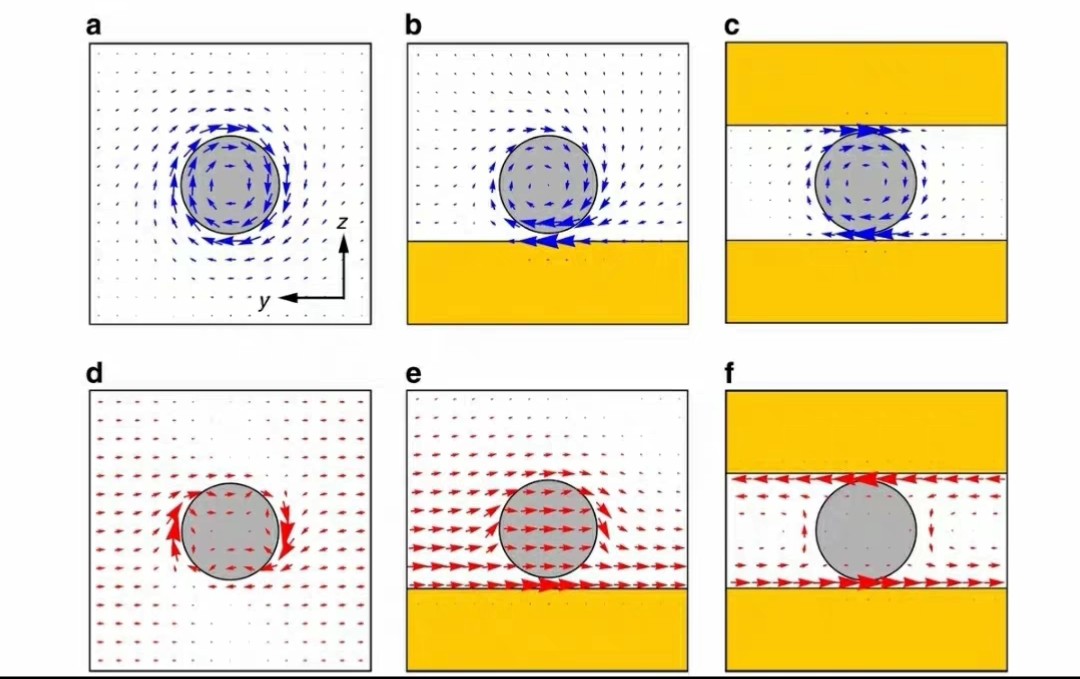

HBase采用主从架构,核心组件包括:

- HMaster:负责集群管理(表创建、Region分配、负载均衡)

- RegionServer:处理数据读写,管理多个Region和WAL(Write-Ahead Log)

- ZooKeeper:提供分布式协调,存储RootRegion位置信息

其数据模型为三维结构:Table -> RowKey -> ColumnFamily:Qualifier -> Timestamp:Value,典型表结构如下:

+----------------+-------------------+---------------------+

| RowKey (用户ID) | Column Family:user | Column Family:log |

+----------------+-------------------+---------------------+

| U1001 | name:Alice | 20231001:点击商品A |

| | age:30 | 20231002:收藏商品B |

+----------------+-------------------+---------------------+

架构示意图:

2.2 HBase与数据挖掘的技术关联

2.2.1 稀疏数据存储优势

数据挖掘中常遇到高维度稀疏矩阵(如用户-商品交互矩阵),传统数据库存储空值会浪费大量空间,而HBase仅存储存在的列,空间利用率提升70%以上。

2.2.2 分布式计算适配

通过HBase的Java/Thrift API,可与Spark RDD、Flink Dataset无缝集成,实现分布式数据预处理:

# Spark读取HBase示例

conf = HBaseConfiguration.create()

conf.set("hbase.zookeeper.quorum", "zk1,zk2,zk3")

rdd = sc.newAPIHadoopRDD(

conf=conf,

keyClass="org.apache.hadoop.hbase.io.ImmutableBytesWritable",

valueClass="org.apache.hadoop.hbase.client.Result",

inputFormatClass="org.apache.hadoop.hbase.mapreduce.TableInputFormat",

keyConverter="org.apache.hadoop.hbase.io.ImmutableBytesWritable",

valueConverter="org.apache.hadoop.hbase.client.Result"

)

2.2.3 实时特征提取

在推荐系统的实时特征工程中,HBase支持毫秒级延迟的随机读写,可实时计算用户最新行为特征(如最近1小时点击次数),相比Hive的批处理模式延迟降低90%以上。

3. 核心算法原理 & 具体操作步骤

3.1 数据清洗算法:缺失值填充与异常值检测

3.1.1 算法原理

针对HBase中稀疏数据的缺失值,采用基于列族统计的均值/中位数填充;异常值检测使用Z-score方法:

Z=x−μσ Z = \frac{x - \mu}{\sigma} Z=σx−μ

其中μ\muμ为列均值,σ\sigmaσ为标准差,|Z|>3视为异常值。

3.1.2 Python实现(基于happybase库)

import happybase

import numpy as np

connection = happybase.Connection(host='hbase-host', port=9090)

table = connection.table('user_behavior')

def get_column_data(column_family, qualifier):

data = []

for key, data_row in table.scan(columns=[f'{column_family}:{qualifier}']):

value = data_row.get(f'{column_family}:{qualifier}'.encode())

if value:

data.append(float(value.decode()))

return np.array(data)

def fill_missing_values(row_key, column_family, qualifier, fill_value):

table.put(row_key.encode(), {

f'{column_family}:{qualifier}'.encode(): str(fill_value).encode()

})

# 执行清洗

data = get_column_data('stats', 'click_count')

mean = np.mean(data)

std = np.std(data)

outliers = np.where(np.abs((data - mean)/std) > 3)[0]

# 填充缺失值(假设默认填充均值)

for key, _ in table.scan(columns=[b'stats:click_count']):

if not table.row(key, columns=[b'stats:click_count']):

fill_missing_values(key.decode(), 'stats', 'click_count', mean)

3.2 聚类算法:基于HBase数据的K-means实现

3.2.1 算法流程

- 从HBase读取高维特征数据(如用户画像的100维特征)

- 计算数据点与簇中心的欧氏距离:d(x,cj)=∑k=1n(xk−cjk)2d(x,c_j) = \sqrt{\sum_{k=1}^n (x_k - c_{jk})^2}d(x,cj)=k=1∑n(xk−cjk)2

- 迭代更新簇中心,直至收敛

3.2.2 分布式实现优化

利用HBase的RowKey范围查询,按Region并行处理数据分片,通过Spark的map-reduce计算每个分片的局部簇中心,减少网络传输开销。

4. 数学模型和公式 & 详细讲解 & 举例说明

4.1 关联规则挖掘:Apriori算法的HBase存储优化

4.1.1 支持度与置信度公式

- 支持度:support(X→Y)=∣T∈D:X∪Y⊆T∣∣D∣support(X \rightarrow Y) = \frac{|T \in D : X \cup Y \subseteq T|}{|D|}support(X→Y)=∣D∣∣T∈D:X∪Y⊆T∣

- 置信度:confidence(X→Y)=support(X∪Y)support(X)confidence(X \rightarrow Y) = \frac{support(X \cup Y)}{support(X)}confidence(X→Y)=support(X)support(X∪Y)

4.1.2 HBase表设计策略

将事务数据按事务ID(RowKey)存储,列名为商品ID,值为购买数量。通过预分区将高频事务分散到不同Region,提升扫描效率。

示例数据:

RowKey=T001,列=item:1001(值=1),item:1002(值=1)

RowKey=T002,列=item:1002(值=1),item:1003(值=1)

4.1.3 频繁项集计算优化

利用HBase的批量扫描API,一次性获取所有事务数据,减少RPC调用次数:

# 批量获取事务数据

batch = table.batch()

for txn_id in txn_ids:

batch.row(txn_id.encode(), columns=[b'item:*'])

results = batch.send()

4.2 分类算法:逻辑回归的分布式参数更新

4.2.1 目标函数与梯度公式

逻辑回归目标函数(对数损失):

J(θ)=−1m∑i=1m(yiloghθ(xi)+(1−yi)log(1−hθ(xi))) J(\theta) = -\frac{1}{m} \sum_{i=1}^m \left( y_i \log h_\theta(x_i) + (1-y_i) \log(1-h_\theta(x_i)) \right) J(θ)=−m1i=1∑m(yiloghθ(xi)+(1−yi)log(1−hθ(xi)))

梯度更新公式:

∂J(θ)∂θj=1m∑i=1m(hθ(xi)−yi)xij \frac{\partial J(\theta)}{\partial \theta_j} = \frac{1}{m} \sum_{i=1}^m (h_\theta(x_i) - y_i) x_{ij} ∂θj∂J(θ)=m1i=1∑m(hθ(xi)−yi)xij

4.2.2 HBase存储参数矩阵

将模型参数θ\thetaθ按列族存储(如column family=model,qualifier=theta_j),支持分布式训练时的参数同步与版本控制。

5. 项目实战:电商用户行为分析系统

5.1 开发环境搭建

5.1.1 软件版本

- HBase: 2.6.3(伪分布式部署)

- Java: 1.8+

- Python: 3.8

- 依赖库: happybase1.2.1, numpy1.21.2, pandas==1.3.3

5.1.2 集群配置

hbase-site.xml关键配置:

<configuration>

<property>

<name>hbase.rootdir</name>

<value>file:///usr/local/hbase/data</value>

</property>

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/usr/local/hbase/zookeeper</value>

</property>

</configuration>

5.2 源代码详细实现和代码解读

5.2.1 表结构设计

创建用户行为表user_behavior,包含两个列族:

info:存储用户基础信息(性别、年龄)logs:存储行为日志(时间戳、行为类型、商品ID)

connection.create_table(

'user_behavior',

{

'info': dict(max_versions=1),

'logs': dict(max_versions=10, compaction_policy='SizeTieredCompactionPolicy')

}

)

5.2.2 数据写入模块

批量写入10万条模拟数据,使用HBase的批量API提升写入性能:

import random

from datetime import datetime

def generate_fake_data(user_id_range=10000):

data = []

for user_id in range(user_id_range):

row_key = f'user_{user_id:06d}'.encode()

info = {

b'info:gender': random.choice([b'male', b'female']),

b'info:age': str(random.randint(18, 60)).encode()

}

logs = {}

for _ in range(random.randint(1, 50)):

ts = int(datetime.now().timestamp() - random.randint(0, 86400*30))

action = random.choice([b'click', b'buy', b'favorite', b'cart'])

item_id = f'item_{random.randint(1, 10000)}'.encode()

logs[f'logs:{ts}:{action}'] = item_id

data.append( (row_key, {**info, **logs}) )

return data

# 批量写入

with connection.batch() as b:

for row_key, data in generate_fake_data():

b.put(row_key, data)

5.2.3 特征工程模块

计算用户30天内各行为类型的频次,存储到HBase的user_features表:

def calculate_user_features(user_id):

row_key = f'user_{user_id:06d}'.encode()

result = table.row(row_key, columns=[b'logs:*'])

actions = {}

for key, value in result.items():

_, ts_str, action = key.decode().split(':')

ts = int(ts_str)

if (datetime.now().timestamp() - ts) <= 30*86400:

actions[action] = actions.get(action, 0) + 1

features = {

b'features:click_count': str(actions.get('click', 0)).encode(),

b'features:buy_count': str(actions.get('buy', 0)).encode(),

# 其他特征...

}

feature_table.put(row_key, features)

5.3 代码解读与分析

- RowKey设计:采用

user_xxxxxx格式,保证用户数据有序存储,便于范围查询 - 列族设计:

logs列族存储历史行为,通过max_versions=10保留最近10次行为记录 - 性能优化:批量写入减少网络IO,按时间戳过滤数据利用HBase的版本机制快速筛选

6. 实际应用场景

6.1 电商领域:精准推荐系统

- 数据存储:用户-商品交互日志(点击、购买、收藏)按RowKey=用户ID+时间戳分区,支持实时写入

- 挖掘任务:

- 协同过滤:通过HBase存储用户评分矩阵,利用Spark计算余弦相似度

- 序列模式挖掘:分析用户浏览路径,预测下一个购买商品

6.2 社交网络:用户分群与舆情分析

- 存储方案:用户关系图谱(关注、粉丝)以RowKey=用户ID存储,列名为关注用户ID

- 挖掘应用:

- 社区发现:基于Louvain算法分析用户连接关系,HBase支持高效的邻居查询

- 情感分析:实时抓取用户评论,存储到HBase后进行情感极性分类

6.3 物联网:设备状态监控与故障预测

- 时间序列存储:RowKey=设备ID+时间戳(反转时间戳避免热点),列族=传感器类型

- 挖掘任务:

- 异常检测:基于孤立森林算法,实时分析传感器数据流

- 预测维护:通过历史数据训练LSTM模型,预测设备故障时间

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

- 《HBase权威指南》(第三版):系统讲解HBase架构与表设计最佳实践

- 《数据挖掘导论》(范明):覆盖分类、聚类等核心算法原理

- 《Hadoop权威指南》:理解HBase与Hadoop生态的深度集成

7.1.2 在线课程

- Coursera《HBase for Big Data Storage》:掌握HBase核心概念与实战

- 网易云课堂《数据挖掘实战:从算法到项目》:结合Python实现典型挖掘任务

7.1.3 技术博客和网站

- HBase官方文档:https://hbase.apache.org/docs/

- 阿里云大数据开发者社区:聚焦HBase性能优化与最佳实践

- KDnuggets:数据挖掘领域前沿技术与案例分析

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

- IntelliJ IDEA:支持Java/HBase开发,集成调试与性能分析工具

- PyCharm:Python开发首选,支持HBase客户端代码智能补全

7.2.2 调试和性能分析工具

- HBase Shell:命令行工具,用于表管理与底层数据操作

- HBase Master UI:监控集群状态、Region分布与请求延迟

- JProfiler:分析HBase客户端代码性能瓶颈

7.2.3 相关框架和库

- 数据集成:Sqoop(关系型数据库与HBase迁移)、Flume(日志数据实时导入)

- 分布式计算:Spark-HBase Connector(高效执行分布式挖掘任务)

- 可视化:Grafana(监控HBase指标)、Tableau(展示挖掘结果)

7.3 相关论文著作推荐

7.3.1 经典论文

- 《HBase: A Distributed Storage System for Structured Data》:HBase架构核心论文

- 《MapReduce: Simplified Data Processing on Large Clusters》:理解分布式计算模型基础

7.3.2 最新研究成果

- 《Efficient Data Mining on HBase Using Predicate Indexing》:HBase查询优化新方法

- 《Real-Time Machine Learning with HBase and Spark Streaming》:实时挖掘系统架构

7.3.3 应用案例分析

- 美团外卖订单系统:HBase支撑千万级订单实时数据分析

- 小米物联网平台:HBase存储百亿级设备日志的实践经验

8. 总结:未来发展趋势与挑战

8.1 技术趋势

- 实时化与智能化融合:HBase与Flink/Kafka结合,构建端到端实时数据挖掘流水线

- 向量化查询优化:利用SIMD指令提升批量数据处理速度,降低CPU开销

- 存算分离架构:通过HBase与云原生存储(如S3)结合,实现弹性扩展

8.2 关键挑战

- 复杂查询支持:HBase原生不支持多列索引,复杂关联查询需依赖二级索引方案(如Phoenix)

- 数据一致性:在高并发写入场景下,需平衡吞吐量与WAL可靠性

- 机器学习集成:优化HBase与TensorFlow/PyTorch的交互接口,减少数据序列化开销

8.3 未来方向

HBase将从单一存储引擎升级为数据挖掘生态的核心枢纽,通过深度集成AutoML工具,实现“数据存储-特征工程-模型训练”全流程自动化。同时,随着边缘计算的兴起,HBase的轻量级版本(如HBase Edge)将在物联网终端数据预处理中发挥关键作用。

9. 附录:常见问题与解答

Q1:如何设计HBase的RowKey以优化数据挖掘查询?

A:根据查询模式设计RowKey:

- 范围查询:按时间顺序(如

yyyyMMdd_UserID) - 散列分布:加盐前缀(如

HashPrefix_UserID)避免热点 - 组合查询:将高频过滤字段嵌入RowKey(如

RegionID_UserID_Timestamp)

Q2:HBase在数据挖掘中如何处理数据倾斜?

A:

- 预分区:使用

split策略提前划分Region - RowKey散列:添加随机前缀或后缀

- 负载均衡:通过HMaster的

balance_switch动态调整Region分布

Q3:HBase与传统关系型数据库在数据挖掘中的适用场景区别?

A:

- HBase:适合海量稀疏数据、高写入吞吐量、低延迟随机读场景(如用户行为日志)

- 关系型数据库:适合结构化数据、复杂SQL查询、事务性要求高的场景(如订单交易数据)

10. 扩展阅读 & 参考资料

- HBase官方白皮书:https://hbase.apache.org/book.html

- Apache HBase Conferences:历年演讲PPT合集(包含工业界最佳实践)

- 数据挖掘十大算法详解:https://www.sciencedirect.com/book/9780123814791/mining-of-massive-databases

通过深入理解HBase的技术特性并结合数据挖掘业务需求,企业能够构建高效、可扩展的数据处理平台,在海量数据中精准挖掘商业价值。随着技术的不断演进,HBase将持续在大数据领域扮演核心角色,为复杂数据场景提供稳定可靠的底层支撑。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)