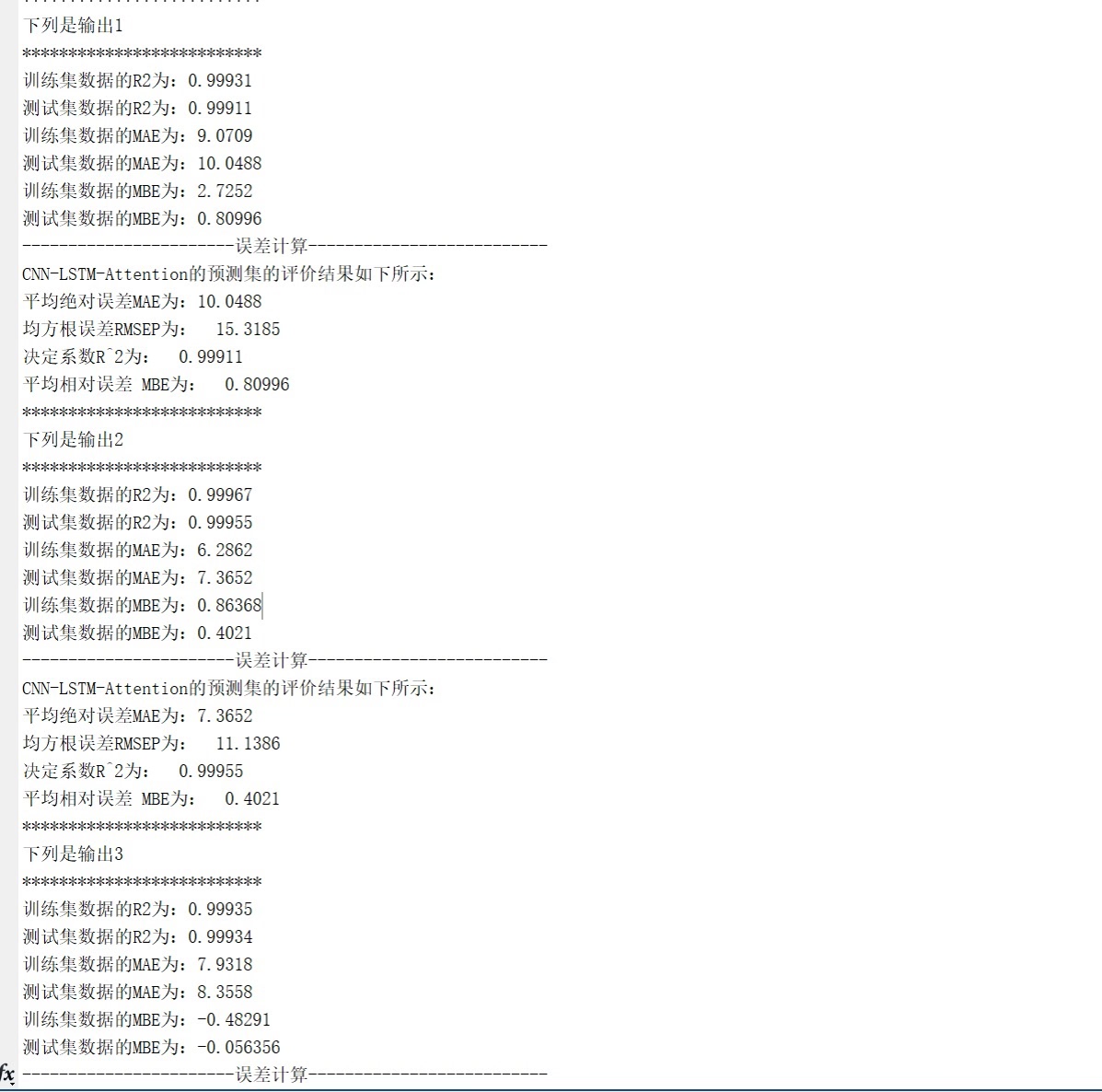

基于CNN - LSTM - Attention的多特征多因变量回归预测模型实践

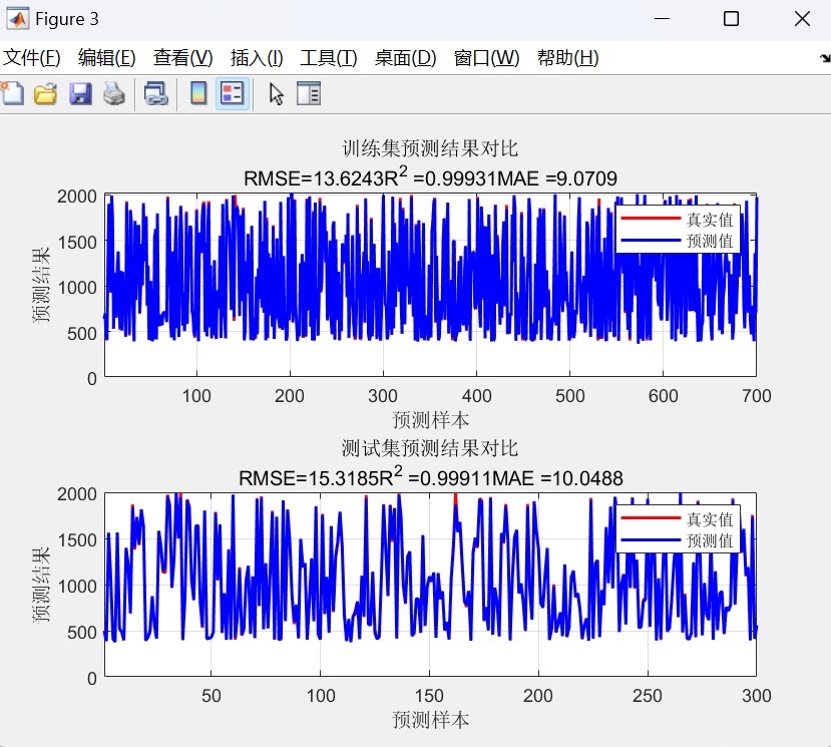

基于CNN-LSTM-Attention做多特征输入多个因变量输出的回归预测模型。 程序内注释详细,直接替换数据就可以用。 程序语言为matlab,要求2021及以上,2021b为最佳,是为了保证买家出问题的时候,可以更好的解决问题。 程序可出预测效果图,迭代优化图,线性拟合图具体效果如下所示。 PS:以下效果图为测试数据的效果图,主要目的是为了显示程序运行可以出的结果图,具体预测效果以个人的具体数据为准。 2.由于每个人的数据都是独一无二的,因此无法做到可以任何人的数据直接替换就可以得到自己满意的效果。

在数据科学领域,多特征输入多个因变量输出的回归预测是常见且具有挑战性的任务。今天咱们就来聊聊基于CNN - LSTM - Attention构建这样一个预测模型,并且用Matlab实现它,方便大家上手实操。

为什么选择CNN - LSTM - Attention组合

CNN(卷积神经网络)

CNN擅长提取数据中的局部特征,通过卷积层和池化层,它能够自动学习到数据中的空间结构信息。比如在图像识别中,它能捕捉到图像中物体的边缘、纹理等特征。在我们的多特征数据里,CNN可以帮助挖掘特征间的局部相关性。

基于CNN-LSTM-Attention做多特征输入多个因变量输出的回归预测模型。 程序内注释详细,直接替换数据就可以用。 程序语言为matlab,要求2021及以上,2021b为最佳,是为了保证买家出问题的时候,可以更好的解决问题。 程序可出预测效果图,迭代优化图,线性拟合图具体效果如下所示。 PS:以下效果图为测试数据的效果图,主要目的是为了显示程序运行可以出的结果图,具体预测效果以个人的具体数据为准。 2.由于每个人的数据都是独一无二的,因此无法做到可以任何人的数据直接替换就可以得到自己满意的效果。

下面简单示意一个Matlab中CNN卷积层的代码:

layers = [

imageInputLayer([height width numChannels])

convolution2dLayer(3,16,'Padding','same')

reluLayer()

maxPooling2dLayer(2,'Stride',2)

];这里imageInputLayer定义了输入数据的尺寸,convolution2dLayer创建了一个卷积核大小为3x3,输出通道为16的卷积层,Padding设置为same保证卷积前后数据尺寸不变。reluLayer添加了ReLU激活函数,maxPooling2dLayer进行了最大池化操作,降低数据维度同时保留关键特征。

LSTM(长短期记忆网络)

LSTM则对处理时间序列数据有着得天独厚的优势,它能够解决传统RNN的梯度消失和梯度爆炸问题,有效捕捉数据中的长期依赖关系。当我们的多特征数据存在时间序列特性时,LSTM就派上用场了。

Matlab构建LSTM层代码示例:

layers = [

layers

lstmLayer(128)

reluLayer()

];这里添加了一个包含128个隐藏单元的LSTM层,后续再接上ReLU激活函数。

Attention(注意力机制)

Attention机制可以让模型更加聚焦于重要的特征部分,动态地分配权重。在多特征多因变量预测中,它能帮助模型在不同时刻关注不同特征,提高预测精度。

整体模型构建

结合这三者,我们能构建出一个强大的预测模型。在Matlab中,整个模型构建的代码框架大致如下:

% 假设输入数据X是一个三维数组 [样本数, 特征维度, 时间步]

% 输出数据Y是一个二维数组 [样本数, 因变量个数]

% 定义输入层

inputSize = [size(X, 2), size(X, 3), 1];

layers = [imageInputLayer(inputSize)];

% CNN部分

layers = [

layers

convolution2dLayer(3,16,'Padding','same')

reluLayer()

maxPooling2dLayer(2,'Stride',2)

];

% 将CNN输出展开

layers = [layers fullyConnectedLayer(128)];

layers = [layers reluLayer()];

% LSTM部分

layers = [

layers

permuteLayer([2 3 1]) % 调整维度顺序适应LSTM输入

lstmLayer(128)

reluLayer()

];

% Attention机制简单示意

attentionWeights = softmax(denseLayer(1)(lstmOutput)); % 假设denseLayer是自定义计算注意力权重的层

weightedOutput = bsxfun(@times, lstmOutput, attentionWeights);

pooledOutput = mean(weightedOutput, 2);

% 输出层

layers = [layers fullyConnectedLayer(size(Y, 2))];

layers = [layers regressionLayer()];

% 定义训练选项

options = trainingOptions('adam',...

'MaxEpochs',100,...

'InitialLearnRate',0.001,...

'ValidationFrequency',10,...

'Plots','training-progress');

% 训练模型

net = trainNetwork(X, Y, layers, options);在这段代码里,首先定义了输入层,接着构建了CNN部分来提取局部特征,然后将CNN输出展开并连接到LSTM层处理序列信息。在LSTM输出后,简单模拟了Attention机制来加权特征,最后通过全连接层和回归层得到预测结果。trainingOptions设置了训练的相关参数,包括优化器、最大训练轮数、初始学习率等。

模型评估与可视化

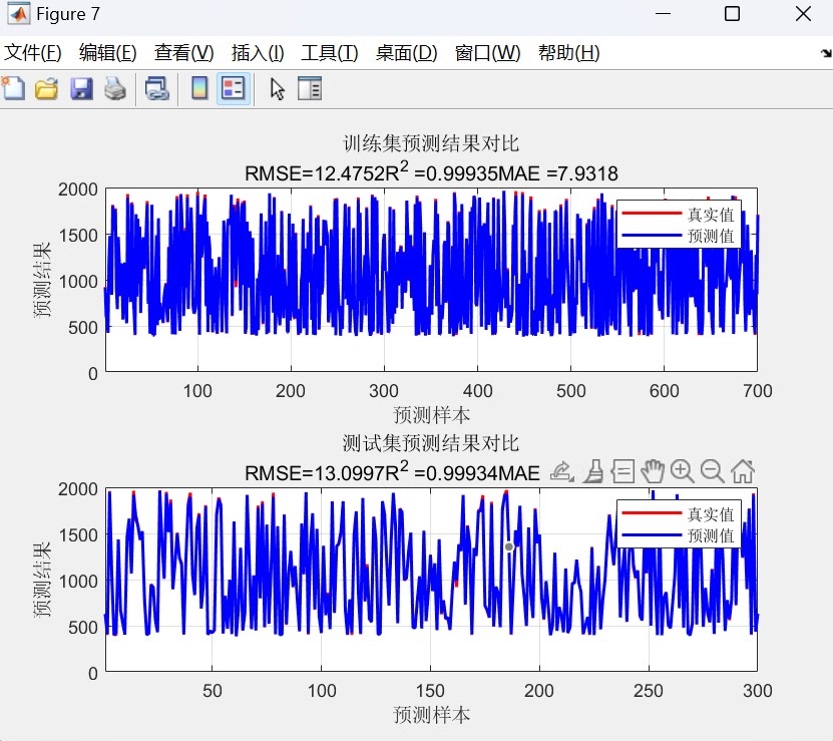

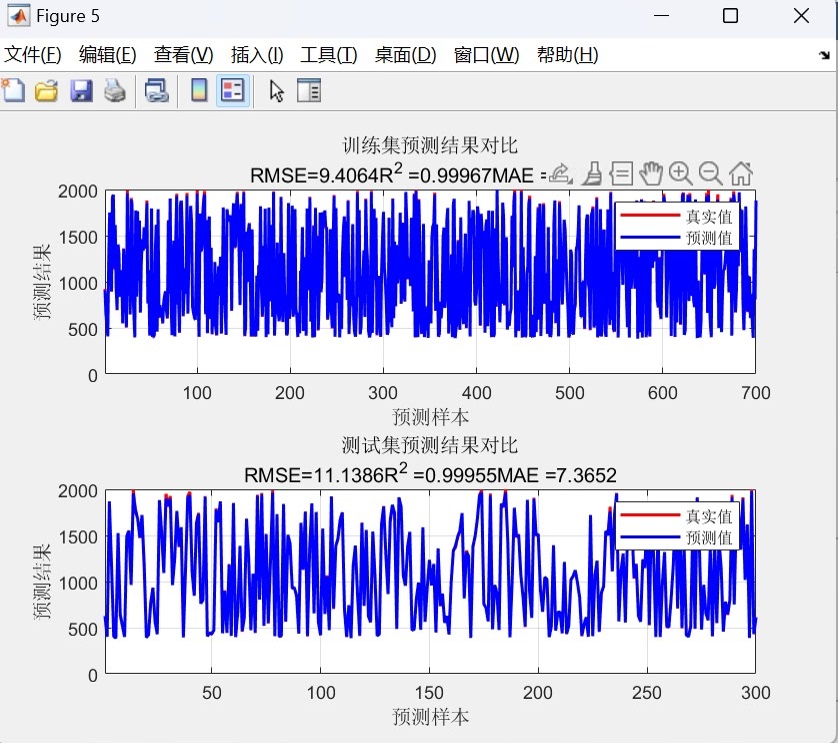

预测效果图

训练好模型后,我们可以用测试数据进行预测,并绘制预测效果图。假设YTest是测试集的真实值,YPred是模型预测值。

YPred = predict(net, XTest);

figure;

plot(1:size(YTest, 1), YTest(:, 1), 'b', 'DisplayName', '真实值');

hold on;

plot(1:size(YPred, 1), YPred(:, 1), 'r--', 'DisplayName', '预测值');

legend;

xlabel('样本序号');

ylabel('因变量值');

title('预测效果图');这段代码绘制了第一个因变量的真实值和预测值随样本序号的变化曲线,直观展示预测效果。

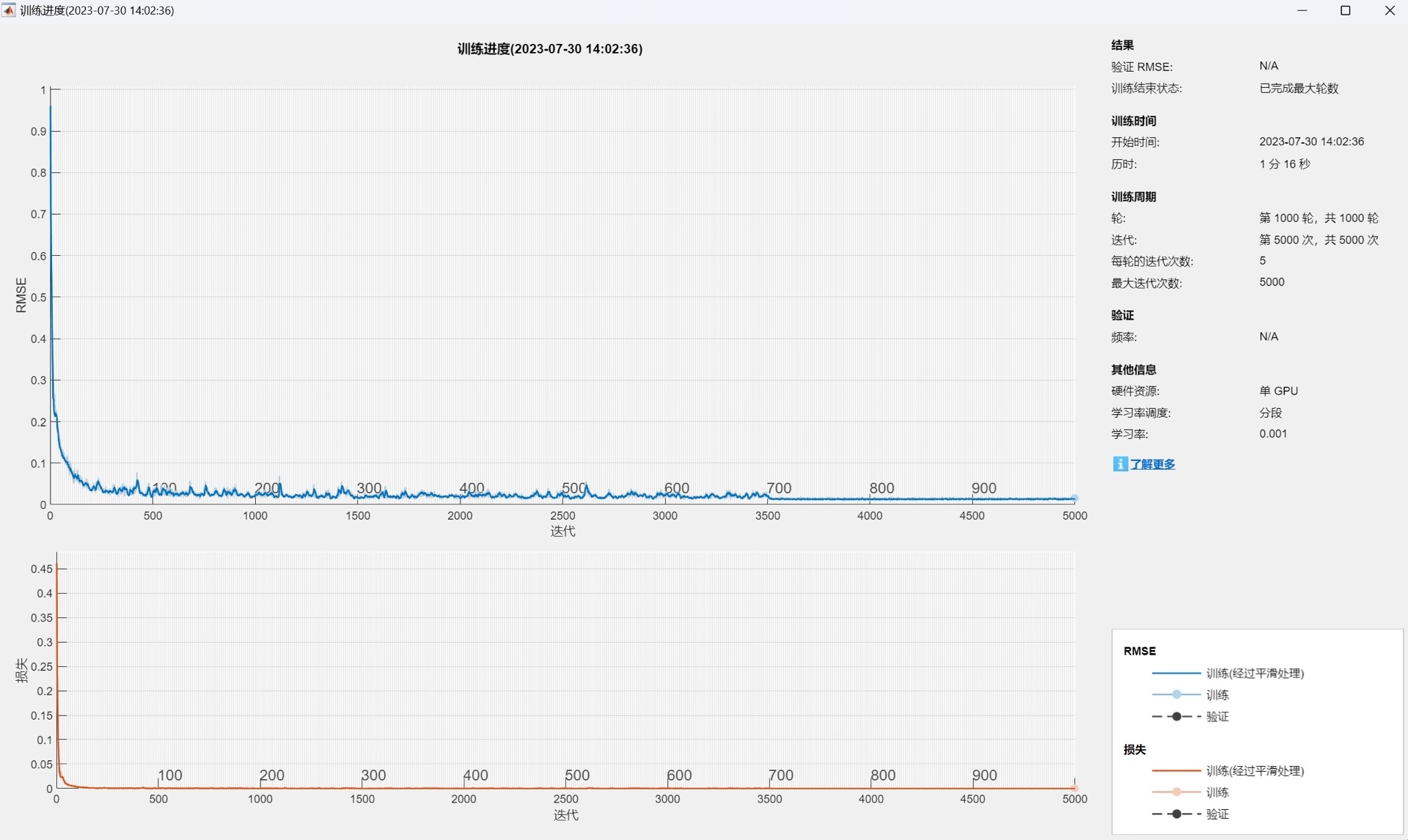

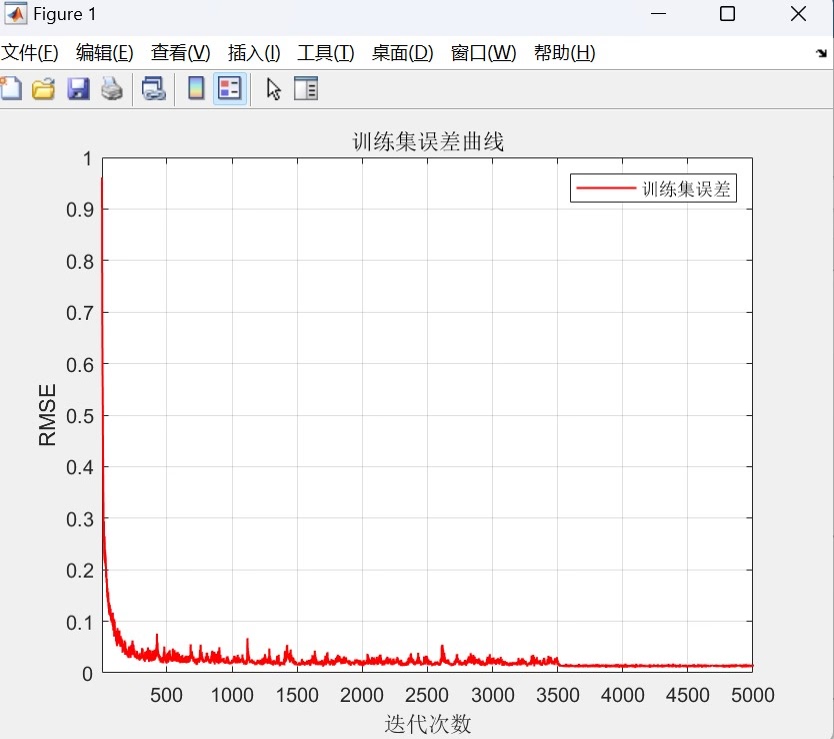

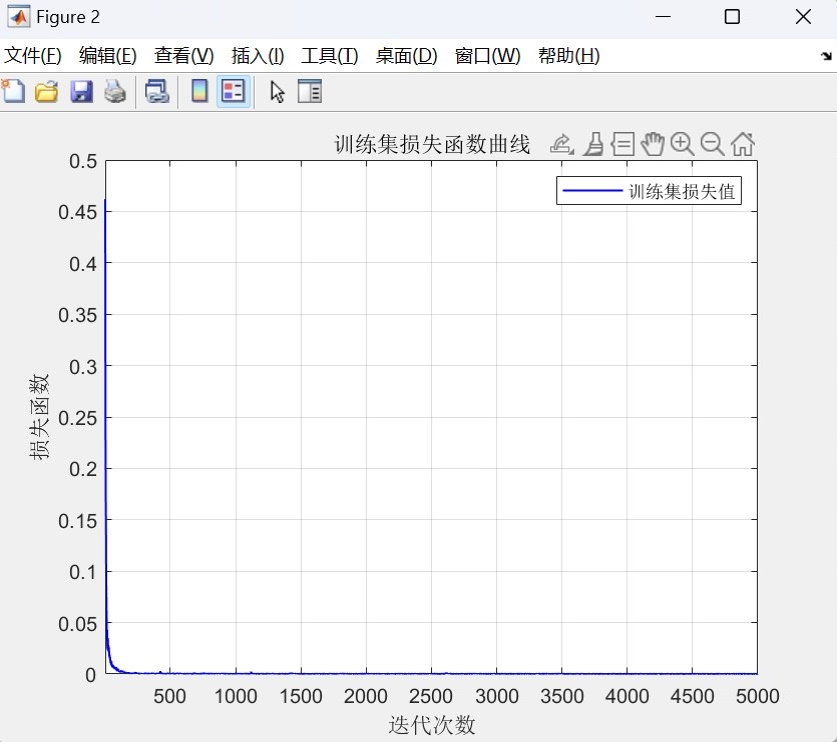

迭代优化图

训练过程中的迭代优化图能让我们了解模型的训练情况。Matlab在训练时通过trainingOptions中的Plots参数就可以自动生成训练进度图,包括损失函数随迭代次数的变化等。

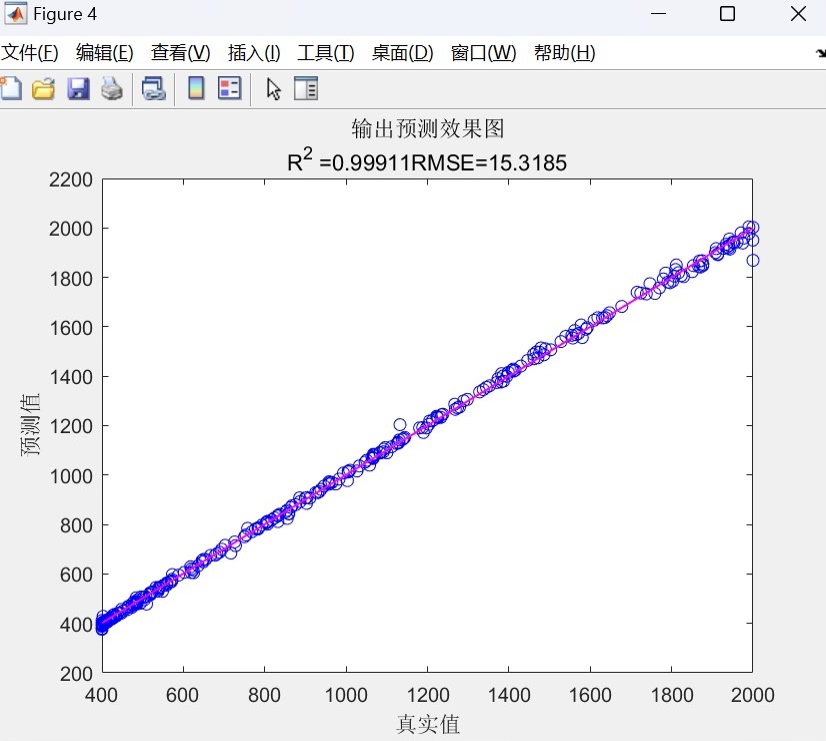

线性拟合图

为了进一步评估预测值和真实值的关系,我们绘制线性拟合图。

figure;

scatter(YTest(:, 1), YPred(:, 1));

p = polyfit(YTest(:, 1), YPred(:, 1), 1);

fitLine = polyval(p, YTest(:, 1));

hold on;

plot(YTest(:, 1), fitLine, 'r', 'LineWidth', 2);

xlabel('真实值');

ylabel('预测值');

title('线性拟合图');这部分代码先绘制了真实值和预测值的散点图,然后通过polyfit和polyval进行线性拟合,并绘制拟合直线。

注意事项

- 程序内注释详细,大家直接替换数据就可以用,但记得Matlab版本最好是2021及以上,2021b为最佳,这样在遇到问题时能更好地解决。

- 由于每个人的数据都是独一无二的,所以没办法保证任何人的数据直接替换就能得到满意的效果。大家在实际使用中可能需要根据自己的数据特点进行一些参数调整和数据预处理。

希望通过这个博文和Matlab代码示例,能帮助大家快速上手基于CNN - LSTM - Attention的多特征多因变量回归预测模型。祝大家在数据预测的探索中取得好成果!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)