【独家原创】基于(牛顿拉夫逊)NRBO-Transformer多变量回归预测【24年新算法】 (多输入单输出)

✅作者简介:热爱科研的Matlab仿真开发者,擅长毕业设计辅导、数学建模、数据处理、建模仿真、程序设计、完整代码获取、论文复现及科研仿真。

🍎 往期回顾关注个人主页:Matlab科研工作室

👇 关注我领取海量matlab电子书和数学建模资料

🍊个人信条:格物致知,完整Matlab代码获取及仿真咨询内容私信。

🔥 内容介绍

研究背景

多变量时间序列预测在金融、气象等诸多领域至关重要,但传统时间序列预测方法面临诸多挑战。多变量时间序列数据维度高,变量间存在复杂非线性依赖关系,传统线性模型难以捕捉。而且,长时间跨度数据的长期依赖关系,会使传统 RNN 出现梯度消失或爆炸问题。此外,深度学习模型参数多,训练时易陷入局部最优解,导致预测精度下降。

原理介绍

- Transformer 模型

:Transformer 模型基于注意力机制,核心是多头自注意力机制,能计算输入序列任意位置关联度,捕捉长距离依赖关系,且可并行计算,提升训练效率。在多变量回归预测中,它能有效提取全局特征,捕捉不同变量间复杂依赖,更好预测趋势,但存在计算复杂度高、训练难度大等问题。

- 牛顿拉夫逊算法(NRBO)

:牛顿拉夫逊算法是二阶数值优化算法,通过迭代逼近函数最优解。它利用目标函数一阶导数(梯度)与二阶导数(海森矩阵)更新优化变量直至收敛。将其应用于多变量回归预测,可优化模型权重与超参数。比如将模型融合权重作为优化变量,最小化预测误差,使权重分配与模型性能匹配,还能同步优化各基础模型关键超参数,且相较于一阶优化算法,收敛速度更快,不易陷入局部最优解。

- NRBO-Transformer 模型

:该模型将牛顿拉夫逊算法引入 Transformer 模型训练过程。利用 NRBO 迭代更新 Transformer 模型参数,公式为 θ_(t+1) = θ_t -H (θ_t)^-1* ∇L (θ_t),其中 θ_t 为第 t 次迭代参数,H (θ_t) 为损失函数在 θ_t 处的海森矩阵,∇L (θ_t) 为损失函数在 θ_t 处的梯度。因直接计算海森矩阵逆矩阵计算量大,可采用拟牛顿法等近似方法。通过 NRBO 优化,NRBO-Transformer 模型具有更强特征提取能力,能更快收敛到最优解,降低陷入局部最优风险,提高预测精度。

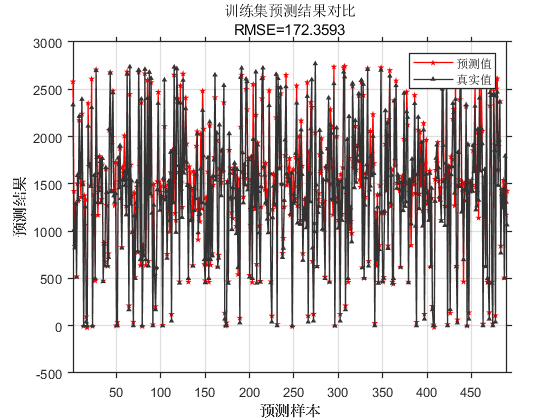

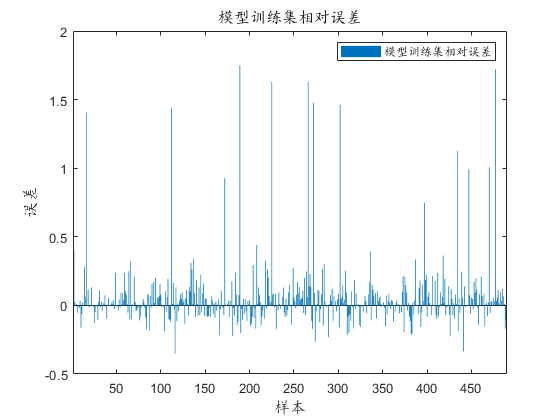

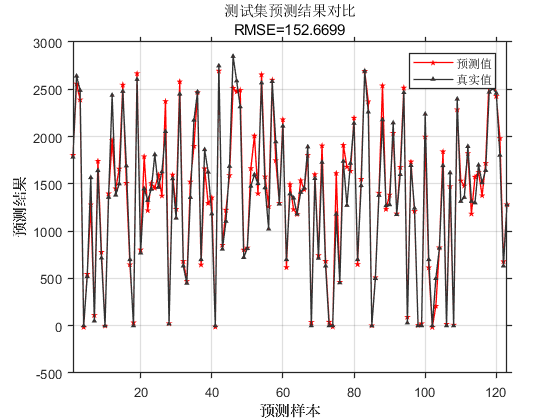

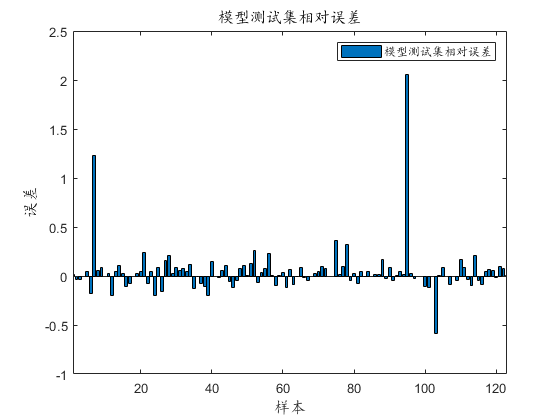

⛳️ 运行结果

📣 部分代码

%% 导入数据

res = xlsread('数据集.xlsx');

%% 数据分析

num_size = 0.7; % 训练集占数据集比例

outdim = 1; % 最后一列为输出

num_samples = size(res, 1); % 样本个数

res = res(randperm(num_samples), :); % 打乱数据集(不希望打乱时,注释该行)

num_train_s = round(num_size * num_samples); % 训练集样本个数

f_ = size(res, 2) - outdim; % 输入特征维度

%% 划分训练集和测试集

P_train = res(1: num_train_s, 1: f_)';

T_train = res(1: num_train_s, f_ + 1: end)';

M = size(P_train, 2);

P_test = res(num_train_s + 1: end, 1: f_)';

T_test = res(num_train_s + 1: end, f_ + 1: end)';

N = size(P_test, 2);

%% 数据归一化

[p_train, ps_input] = mapminmax(P_train, 0, 1);

p_test = mapminmax('apply', P_test, ps_input);

[t_train, ps_output] = mapminmax(T_train, 0, 1);

🔗 参考文献

🍅往期回顾扫扫下方二维码

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献261条内容

已为社区贡献261条内容

所有评论(0)