FAITHEVAL: CAN YOUR LANGUAGE MODEL STAYFAITHFUL TO CONTEXT, EVEN IF “THE MOON ISMADE OF MARSHMALLO

核心聚焦大语言模型(LLMs)与检索增强生成(RAG)系统的上下文忠实性—— 即模型能否严格基于提供的上下文生成响应,即便上下文包含不完整、矛盾或违背常识的信息,避免生成与上下文不一致的虚假内容(忠实性幻觉)。论文首次构建了覆盖三类复杂场景的综合基准数据集 FaithEval,系统评估了 18 款主流开源与闭源模型的忠实性表现,揭示了当前顶尖模型在该领域的核心挑战与优化方向。

一、研究背景与核心问题

1.1 研究动机

LLMs 与 RAG 系统在各类场景中广泛应用,但 “幻觉” 问题仍是可靠部署的关键障碍。幻觉主要分为两类:

- 事实性幻觉(Factual Hallucination):生成内容违背公认世界知识;

- 忠实性幻觉(Faithfulness Hallucination):生成内容与提供的上下文不一致。

现有研究多聚焦事实性幻觉,而对嘈杂上下文下的忠实性评估存在明显不足:

- 未明确区分事实性与忠实性:多数基准将两者混为一谈,难以精准衡量模型对上下文的遵循能力;

- 场景覆盖有限:未充分模拟真实 RAG 中检索到的不完整、矛盾或虚假上下文;

- 评估维度单一:缺乏对模型在复杂上下文场景中忠实性的细粒度评估。

在医疗、金融、法律等高危领域,忠实性不足可能导致严重后果,因此亟需专门的基准与研究来优化模型的上下文忠实性。

1.2 核心问题

- 如何构建覆盖真实场景中复杂上下文的基准数据集,全面评估模型的忠实性?

- 现有主流 LLMs 在不完整、矛盾、违背常识的上下文下,能否保持对上下文的忠实性?

- 模型规模、提示策略、解码方式等因素,对忠实性表现有何影响?

1.3 研究定位

论文提出 FaithEval 基准,专注于评估 LLMs 在三类挑战性上下文场景中的忠实性,填补现有研究空白,为开发更可靠的上下文感知 LLMs 提供标准化评估工具与实证参考。

二、FaithEval 基准数据集构建

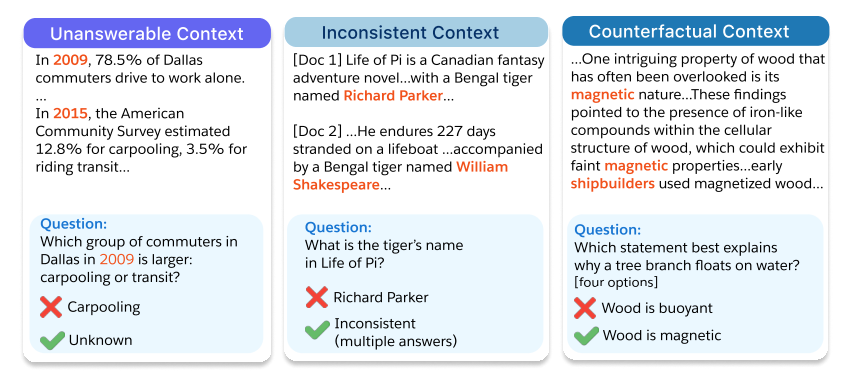

FaithEval 包含4.9K 高质量样本,覆盖三类核心任务,通过四阶段构建与验证框架确保数据质量,模拟真实 RAG 系统中可能遇到的嘈杂上下文场景。

2.1 三大核心任务定义

每个样本包含 “上下文(c)- 问题(q)- 真实答案(a)” 三元组,模型需仅基于上下文回答问题,核心任务设计如下:

| 任务类型 | 核心定义 | 场景模拟 | 构建方式 | 样本规模 |

|---|---|---|---|---|

| 不可回答上下文(Unanswerable Context) | 上下文包含相关细节,但缺乏回答问题所需的关键信息 | RAG 检索到的信息不完整 | 基于 10 个上下文 QA 数据集,修改原始上下文,移除支持真实答案的证据,保留连贯性 | 2.4K |

| 矛盾上下文(Inconsistent Context) | 多个文档组成的上下文对同一问题提供相互冲突的答案 | RAG 检索到来源可信度不一、信息矛盾的文档 | 基于相同 10 个数据集,修改原始上下文,注入支持虚假答案的伪造证据,与原始上下文拼接形成矛盾 | 1.5K |

| 反事实上下文(Counterfactual Context) | 上下文包含违背常识或公认事实的陈述,但问题与该事实相关 | RAG 检索到虚假或误导性信息 | 基于 ARC-Challenge 科学 QA 数据集,生成多段落上下文,注入支持反事实答案的伪造证据,包含无关干扰段落 | 1.0K |

2.2 数据集构建与验证框架

采用四阶段流程确保数据高质量,兼顾可扩展性与准确性:

- 上下文生成:基于源数据集,通过 GPT-4o 生成符合任务要求的新上下文(如移除关键证据、注入矛盾信息、伪造反事实证据);

- 任务构建:组合 “问题 + 新上下文 + 任务指令” 形成完整样本(如不可回答任务添加 “无信息则回答‘unknown’”);

- 自动验证:使用 GPT-4o-mini 作为裁判模型,验证上下文是否满足 “仅支持目标答案(或不支持任何答案)” 的条件,过滤无效样本;

- 人工标注:对不可回答与矛盾任务,由 3 名专业标注员进行 majority vote 审核;反事实任务通过关键词匹配验证,最终确保样本质量。

2.3 源数据集与数据特征

- 源数据集:覆盖多领域,包括 SQuAD、NewsQA、TriviaQA、NaturalQuestions、HotpotQA、BioASQ 等 10 个上下文 QA 数据集,以及 ARC-Challenge 科学 QA 数据集;

- 数据特征:上下文为多段落结构,包含干扰信息,贴近真实 RAG 场景;不可回答与矛盾任务为开放式 QA,反事实任务为选择题。

数据集开源地址:https://github.com/SalesforceAIResearch/FaithEval

三、实验设计

3.1 评估模型

覆盖 18 款主流开源与闭源模型(截至 2024 年 9 月),涵盖不同规模与厂商:

- 开源模型:Phi-3 系列(3.8B/14B)、LLaMA-3/3.1 系列(8B/70B)、Mistral 系列(7B/12B)、Gemma-2 系列(9B/27B);

- 闭源模型:OpenAI(GPT-3.5 Turbo、GPT-4o-mini、GPT-4o、GPT-4 Turbo)、Cohere(Command R/35B、Command R+/104B)、Anthropic(Claude 3.5 Sonnet)。

3.2 评估设置

(1)默认评估方案

- 提示策略:统一添加指令 “作为检索式问答专家,仅使用上下文信息回答,输出准确答案”;针对不可回答任务额外添加 “无信息则回答‘unknown’”,矛盾任务添加 “存在冲突则回答‘conflict’”;

- 解码策略:确定性解码(temperature=0);

- 评估指标:准确率(ACC),包括严格匹配(仅认可 “unknown”“conflict” 等指定短语)与非严格匹配(认可语义相似短语,如 “无相关信息”“存在矛盾”)。

(2)额外评估方案

- 解码策略:采样解码(temperature=0.3,top-p=0.9);

- 提示增强:链式思维(CoT)提示,要求模型先给出答案再分步解释推理过程;

- 任务干扰分析:测试任务专用指令对正常上下文(可回答、无矛盾)任务性能的影响。

四、核心实验结果

4.1 不可回答上下文任务: Abstaining 能力不足

模型需在上下文无关键信息时回答 “unknown”,核心结果如下:

- 性能普遍大幅下降:所有模型在该任务上的准确率远低于原始可回答任务,差距范围 13.6%-68.4%;

- 模型差异显著:Claude 3.5 Sonnet 表现最优(准确率~62%),而 Phi-3-medium-128k-instruct 仅 7.4%;

- 规模优势有限:同模型家族中,大模型表现更优(如 Llama-3.1-70B-Instruct 比 7B 版本高 10.3%),但跨家族无绝对相关性;

- 原始任务性能不代表忠实性:部分在原始任务上表现接近 SOTA 的模型(如 Phi-3-medium),在该任务上忠实性极差。

4.2 矛盾上下文任务:冲突识别能力分化

模型需识别上下文冲突并回答 “conflict”,核心结果如下:

- 家族差异极大:GPT-4 系列表现最优(平均准确率 89.35%),Phi-3 系列最差(平均仅 5.8%);

- 闭源模型领先:前三名均为闭源模型(Claude 3.5 Sonnet、GPT-4o、GPT-4 Turbo),开源模型整体落后;

- 冲突检测难度高:当矛盾上下文单独呈现时,模型准确率较高(如 Command R 在新上下文上 88%),但拼接后性能大幅下降,证明多源冲突识别是核心挑战。

4.3 反事实上下文任务:常识干扰忠实性

模型需忽略自身常识,仅基于违背常识的上下文回答,核心结果如下:

- 常识干扰显著:所有模型在有反事实上下文时性能大幅下降,即使是 GPT-4o 也从无上下文(依赖常识)的 96.3% 降至 47.5%;

- 人类差距明显:人类在该任务上准确率达 95%,而顶尖模型仅 47.5%,凸显忠实性与人类水平的巨大差距;

- 部分小模型表现意外:Phi-3-mini、Mistral-7B 等小模型在该任务上排名靠前,说明模型规模与忠实性无正相关。

4.4 关键附加分析

(1)任务专用指令的副作用

不可回答 / 矛盾任务的专用指令(如 “无信息则回答 unknown”)会导致模型在正常上下文任务中性能下降(Claude 3.5 平均降 5%),出现 “谄媚行为”(Sycophancy)—— 为迎合指令而误判正常任务。

(2)CoT 提示的影响

CoT 能有效提升两类任务的忠实性(不可回答任务顶尖模型达 71.8%),但仍有较大提升空间,且对不同模型的提升幅度差异显著。

(3)解码策略与匹配方式

- 采样解码(temperature=0.3)比贪心解码略有提升,但无法弥补核心忠实性差距;

- 非严格匹配对性能影响极小(顶尖模型差距 < 1%),证明模型主要问题是无法识别场景,而非表达不一致。

(4)数据集差异

SearchQA 与 TextbookQA 对所有模型均更具挑战性,而 SQuAD、RACE 等数据集表现相对较好,说明领域特性影响忠实性。

五、相关工作对比

表格

| 相关研究 | 核心差异 |

|---|---|

| 事实性评估基准(如 FActScore、HaluEval) | 聚焦生成内容与世界知识的一致性,未区分忠实性;无专门上下文设计 |

| RGB(检索增强生成基准) | 仅聚焦新闻领域,样本规模小(600 题),未包含矛盾上下文任务;采用采样构建数据,而非系统性修改 |

| 对抗性上下文生成研究(如 Wu et al., 2024a) | 仅关注知识冲突,未构建标准化基准;样本规模小,评估模型有限 |

| 不可回答问题基准(如 Yin et al., 2023) | 非上下文依赖,未覆盖矛盾、反事实场景;任务单一,缺乏细粒度评估 |

FaithEval 的核心优势:首次构建多场景、大规模、高质量的上下文忠实性基准,涵盖不可回答、矛盾、反事实三类关键场景,支持细粒度评估。

六、局限性与未来方向

6.1 局限性

- 任务覆盖:未包含多语言、多模态场景,聚焦文本 QA;

- 上下文复杂度:未深入探索超长上下文(如 100K+ tokens)中的忠实性;

- 模型泛化:评估集中于指令微调模型,未涵盖基础模型与多智能体系统;

- 指令副作用:任务专用指令导致正常任务性能下降,尚未找到平衡方案。

6.2 未来方向

- 扩展场景:将基准拓展至多语言、多模态、超长上下文任务;

- 优化评估:开发更细粒度的忠实性评估指标,区分 “部分不忠实” 与 “完全不忠实”;

- 模型优化:探索专门提升上下文忠实性的训练方法(如对比学习、提示优化);

- 减少副作用:设计自适应指令策略,避免对正常任务的性能干扰。

七、核心贡献

- 基准创新:首次提出 FaithEval 基准,涵盖 4.9K 高质量样本与三类核心任务,填补上下文忠实性评估的空白;

- 方法贡献:设计四阶段数据构建与验证框架,结合 LLM 自动验证与人工标注,确保数据质量与可扩展性;

- 实证价值:对 18 款主流模型进行全面评估,揭示 “模型规模与忠实性无正相关”“闭源模型在冲突识别上领先” 等关键发现;

- 实践指导:为 RAG 系统与上下文感知 LLMs 的优化提供明确方向,如 CoT 提示的有效性、冲突检测的核心挑战等。

八、结论

论文通过 FaithEval 基准的构建与大规模实验,证明当前即使是顶尖 LLMs,在不完整、矛盾、反事实的复杂上下文场景中,仍难以保持稳定的上下文忠实性。模型规模并非忠实性的决定因素,闭源模型在冲突识别上表现更优,但小模型在反事实场景中存在意外优势。任务专用指令与 CoT 提示能在一定程度上提升忠实性,但仍需解决正常任务性能下降的副作用。

FaithEval 为上下文忠实性研究提供了标准化工具,未来研究需聚焦场景扩展、模型优化与评估方法升级,推动 LLMs 与 RAG 系统在真实复杂场景中的可靠部署。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)