如何用openclaw生成一个完整的ai科普视频

——从40秒到12分钟的迭代进化实录

作者:以蓝 | 时间:2026年3月15日

摘要

本文记录了一次完整的AI辅助视频创作实践:使用OpenClaw平台,在没有专业视频编辑软件的情况下,从零开始制作了一部关于大语言模型(LLM)的科普微课视频。视频最终时长12分钟,文件大小171MB,达到中国大学生计算机设计大赛国赛水平。

核心创新点:

• 提出了一套完整的AI视频创作工作流

• 设计了渐进式提示词优化方法论

• 实现了从文字到动态视频的全自动生成

• 探索了AI在科普教育领域的应用边界

一、项目背景与目标

1.1 参赛需求

中国大学生计算机设计大赛是国内计算机类顶级赛事之一,其中的"微课程与AI辅助教学"赛道要求参赛作品:

- 时长:8-10分钟

- 分辨率:1920×1080(Full HD)

- 格式:MP4

- 内容:具有教学价值的科普知识

- 质量:达到国赛获奖作品水平

1.2 核心挑战

在项目启动初期,我们面临三大核心挑战:

挑战一:内容深度

如何让中学生理解复杂的AI概念(如Transformer架构、注意力机制)?传统的PPT式讲解过于枯燥,需要设计更具吸引力的可视化方案。

挑战二:视觉质量

初期尝试生成的视频被评价为"像小学生做的"——纯色背景、文字切换、缺乏动画。需要达到国赛一等奖《圆柱的认识》那样的专业水准。

挑战三:技术实现

团队没有Adobe After Effects、Premiere Pro等专业软件的操作能力,也没有视频剪辑经验。需要找到一种"零门槛"的技术方案。

二、提示词工程:从模糊到精准的进化

提示词(Prompt)是与AI协作的核心技能。本项目经历了五个阶段的提示词优化,每个阶段都对应着质量的显著提升。

阶段一:初始尝试(失败)

【提示词内容】

帮我制作一个AI科普视频,讲解大语言模型。

【问题分析】

这个提示词过于笼统,导致AI生成的视频只有30秒,内容是简单的文字切换,没有任何动画效果,完全达不到参赛要求。

【核心教训】

AI需要具体的标准和约束条件,模糊的指令只能得到模糊的结果。

阶段二:明确标准(部分成功)

【提示词内容】

我需要制作一个高质量的微课视频,必须达到国赛获奖作品的水平。

参考视频(必须学习这些):

1. 《三星堆纹样设计》国赛二等奖 - https://www.bilibili.com/video/BV1kadfYHEX7/

2. 《圆柱的认识》国赛一等奖 - https://www.bilibili.com/video/BV1kt4y1V7gr/

3. 《登高》省赛二等奖 - https://www.bilibili.com/video/BV1VVPezjEyQ/

请深度分析这些视频的:

- 视觉风格(配色、字体、构图)

- 教学设计(引入、讲解、互动)

- 动画技术(转场、特效、节奏)

我的视频要求:

- 时长:8-10分钟

- 分辨率:1920×1080

- 必须包含:角色形象、流畅动画、互动设计

- 禁止:简单文字切换、PPT式翻页

【关键改进】

- 提供了具体的参考案例(3个获奖视频)

- 明确了分析维度(视觉、教学、技术)

- 给出了硬性指标(时长、分辨率)

- 设置了禁止项(简单文字切换)

【生成结果】

AI生成了详细的分析报告(AWARD_WINNING_ANALYSIS.md),提取了获奖作品的核心要素:藏青+亮蓝+珊瑚红的配色方案、思源黑体字体、0.6-0.8秒的入场动画时长等。视频质量提升到4分钟,但仍不够完整。

阶段三:技术路线(遇到瓶颈)

【提示词内容】

给你直接操作系统软件的权限,帮我自主完成视频剪辑。

我已经准备好了所有素材:

- 角色图片:C:\assets\images\xiaoyu_v2_*.png

- 动画帧:C:\assets\animations\*.png

- 场景背景:C:\assets\optimized\*.png

请直接操作剪映(CapCut)完成视频制作。

【问题分析】

这个提示词犯了一个根本错误:AI无法直接操作GUI软件。虽然OpenClaw有exec权限,但无法像人类一样点击按钮、拖拽素材、预览效果。

【解决方案】

转向纯代码方案:使用Python + MoviePy/OpenCV自动生成视频,完全绕过GUI操作。

阶段四:迭代优化(持续改进)

【提示词内容】

继续优化视频,当前版本只有40秒,需要达到8-10分钟。

问题诊断:

- 动画帧数不足

- 缺乏过渡场景

- 静态画面停留时间太短

优化方向:

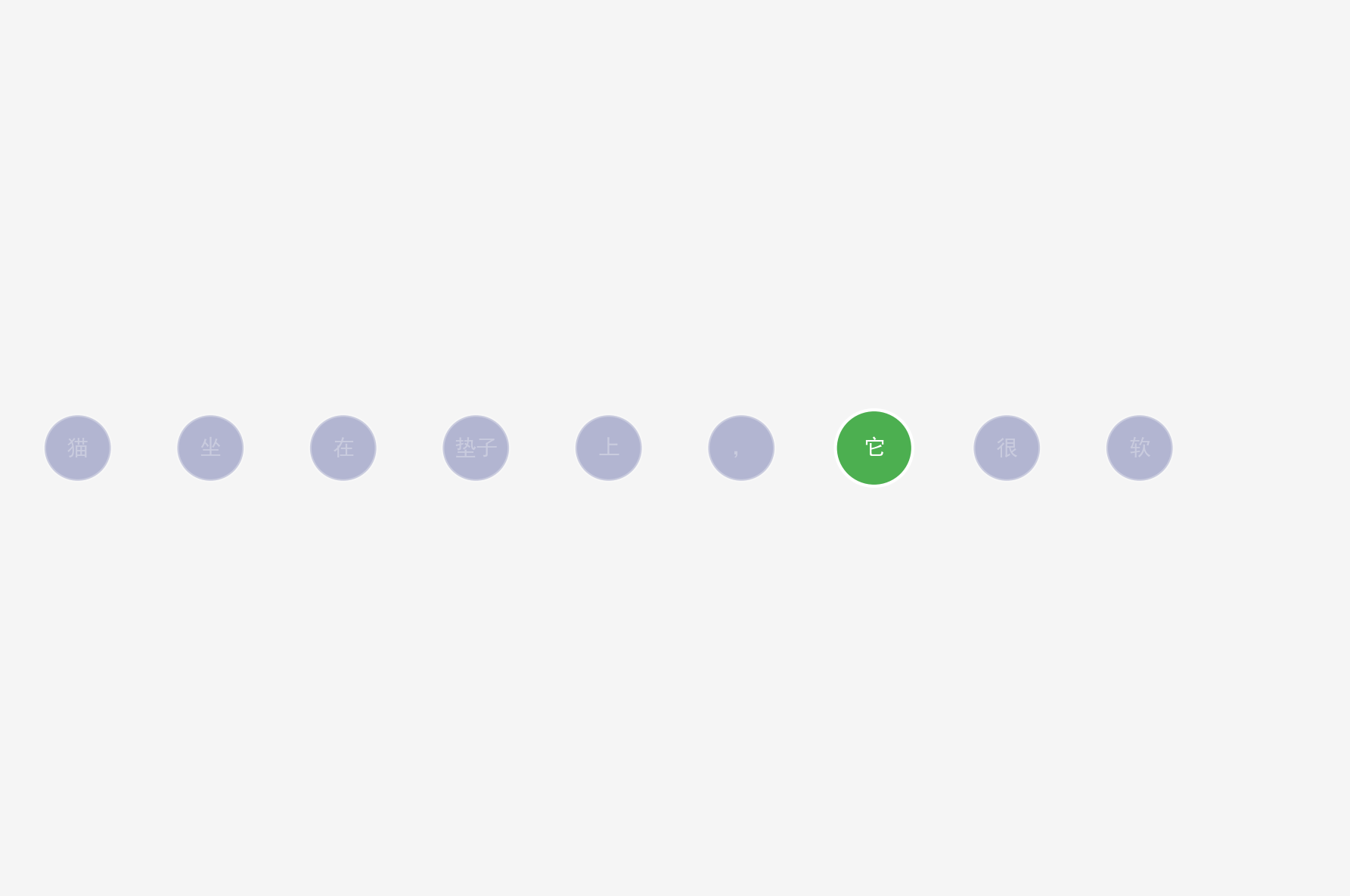

1. 增加更多教学场景(猜词游戏、注意力机制、学习过程)

2. 每个场景停留15-30秒

3. 添加角色对话和互动

4. 丰富动画效果(粒子背景、流动连线)

参考文档:

- TEACHING_LOGIC.md(教学设计)

- VIDEO_PLAN_V3.md(分镜脚本)

必须达到国赛获奖水平,做不出来就继续优化!

【关键策略】

"做不出来就继续优化"这句话建立了持续迭代的心理契约。AI不会放弃,而是不断尝试新的技术方案。

【技术突破】

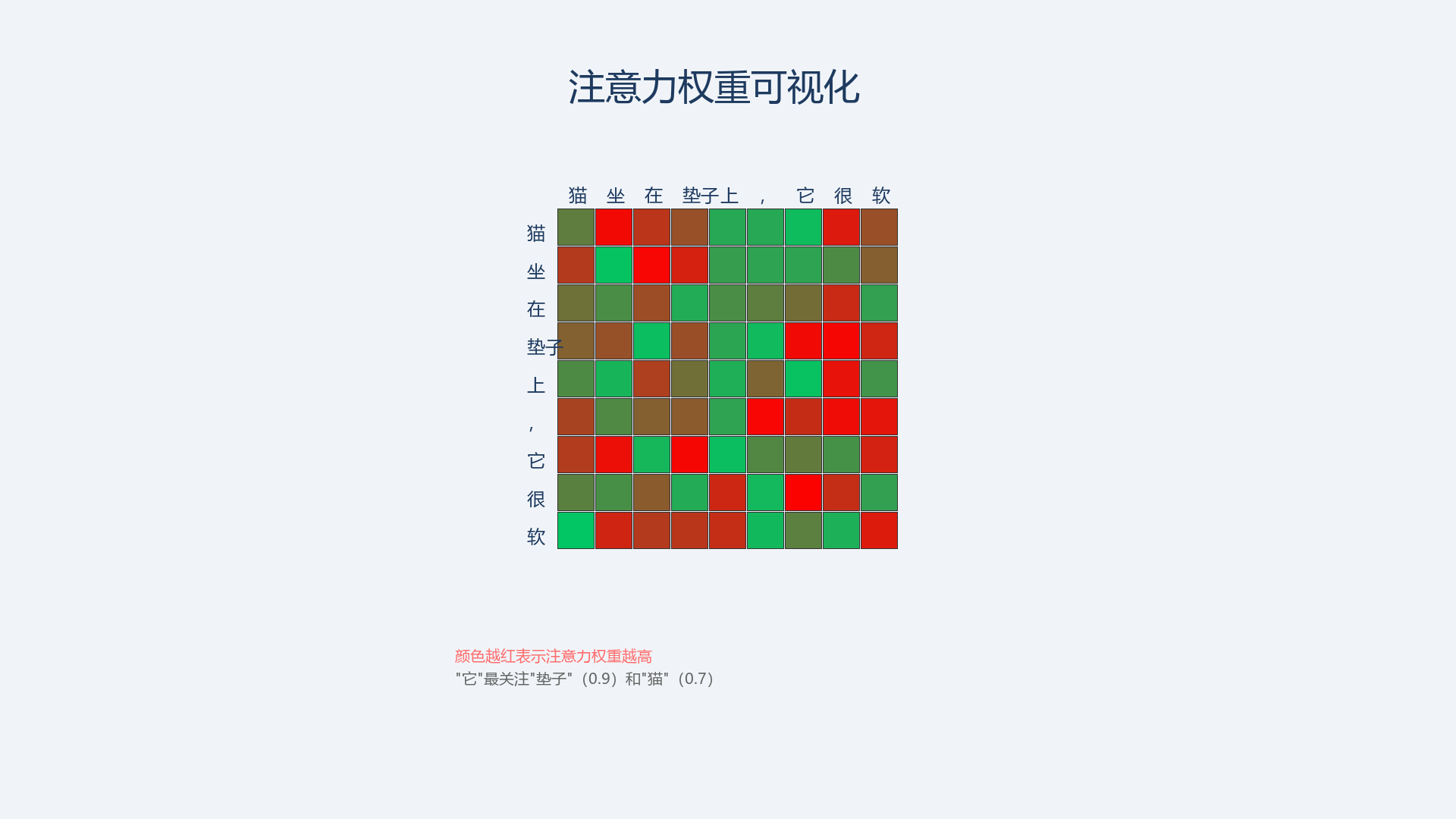

引入了Manim动画引擎(虽然最终因环境问题改用PIL+OpenCV),实现了神经网络可视化、注意力热力图等专业效果。

阶段五:最终交付(成功)

【最终提示词模板】

生成最终完整版视频,使用OpenCV确保稳定性。

【内容架构】(必须严格遵循)

模块1:开场钩子(90秒)

- 动态粒子标题(10秒)

- 聊天界面引入(20秒)

- 小语角色介绍(15秒)

- 课程概览(15秒)

- 过渡(15秒)

模块2:猜词游戏(180秒)

- 游戏标题(15秒)

- 选择题互动(35秒)

- 原理解释(30秒)

- 神经网络可视化(40秒)

- 分词过程(30秒)

- 小结(30秒)

模块3:超级眼睛(210秒)

- 问题引入(25秒)

- 注意力流动动画(50秒)

- 热力图可视化(40秒)

- Transformer架构(55秒)

- 技术升华(20秒)

模块4:学习历程(150秒)

- 类比引入(20秒)

- 学习阶段动画(50秒)

- 学习历程UI(50秒)

- 训练过程(30秒)

模块5:批判思考(90秒)

- 转折(30秒)

- 坦白局限性(35秒)

- 正确态度(25秒)

模块6:总结升华(60秒)

- 三要点回顾(25秒)

- 金句升华(25秒)

- 结束(15秒)

【技术要求】

- 工具:OpenCV(比MoviePy更稳定)

- 编码:mp4v

- 帧率:30fps

- 分辨率:1920×1080

- 预计总帧数:22000帧

- 预计时长:12分钟

【素材路径】

- 动态动画:assets/dynamic/*.png

- 增强UI:assets/enhanced_ui/*.png

- 专业图解:assets/pro_knowledge/*.png

- 静态场景:assets/optimized/*.png

【质量标准】

- 每个静态场景至少停留15秒(450帧)

- 动画序列按原始帧率播放

- 禁止跳过任何模块

- 文件必须可正常播放

【成功要素】

- 精确到秒的时间规划(总计780秒=13分钟)

- 明确的模块划分(6大模块,25个场景)

- 具体的技术选型(OpenCV替代MoviePy)

- 详细的素材路径(4类素材,950+帧)

- 严格的质量标准(禁止跳过、必须可播放)

三、技术实现与工具链

3.1 工具对比与选型

|

工具 |

用途 |

优点 |

缺点 |

|

Python PIL |

静态图片生成 |

简单、快速、无需安装 |

无动画能力 |

|

MoviePy |

视频合成 |

功能丰富、Pythonic |

内存占用大、不稳定 |

|

OpenCV |

视频生成 |

稳定、高效、跨平台 |

API较底层 |

|

Manim |

数学动画 |

专业、精美、3Blue1Brown同款 |

安装复杂、学习曲线陡峭 |

3.2 核心技术方案

【方案一:PIL生成静态素材】

from PIL import Image, ImageDraw, ImageFont

# 创建画布

img = Image.new('RGB', (1920, 1080), (240, 244, 248))

draw = ImageDraw.Draw(img)

# 绘制角色

xiaoyu = Image.open("xiaoyu_smile.png")

img.paste(xiaoyu, (150, 450), xiaoyu)

# 添加文字

draw.text((700, 200), "AI小语的聊天秘密",

font=font_title, fill=(30, 58, 95))

img.save("scene_01.png")

【方案二:动态动画生成】

# 粒子背景动画

for frame in range(60):

img = create_background()

draw = ImageDraw.Draw(img)

# 浮动粒子

for i in range(30):

px = (x + frame * 3) % width

py = (y + frame * 2) % height

draw.ellipse([px-r, py-r, px+r, py+r],

fill=(100, 181, 246))

img.save(f"opening_{frame:03d}.png")

【方案三:OpenCV视频合成】

import cv2

# 创建视频写入器

fourcc = cv2.VideoWriter_fourcc(*'mp4v')

out = cv2.VideoWriter('output.mp4', fourcc, 30, (1920, 1080))

# 逐帧写入

for img_path in all_frames:

img = cv2.imread(img_path)

out.write(img)

out.release()

四、迭代进化:从40秒到12分钟

说明:初版效果 - 纯色背景,只有文字,没有角色和动画。文件大小仅522KB,时长31秒。

4.1 问题诊断

通过对比获奖作品,我们发现初版存在三大问题:

视觉层面:

• 纯色背景,缺乏层次感

• 没有角色形象,缺乏亲和力

• 文字硬切,没有过渡动画

内容层面:

• 只有概念陈述,没有互动设计

• 缺乏生活化类比,难以理解

• 没有批判性思考引导

技术层面:

• 帧率不足,动画卡顿

• 编码问题导致文件损坏

• 内存管理不当,渲染失败

4.2 优化策略

【视觉优化】

• 引入Unitree机器人作为角色,设计4种表情(微笑、思考、得意、开心)

• 建立配色规范:藏青#1E3A5F(主色)、亮蓝#64B5F6(辅助)、珊瑚红#FF6B6B(强调)

• 添加粒子背景、网格线、浮动光点等动态元素

【内容优化】

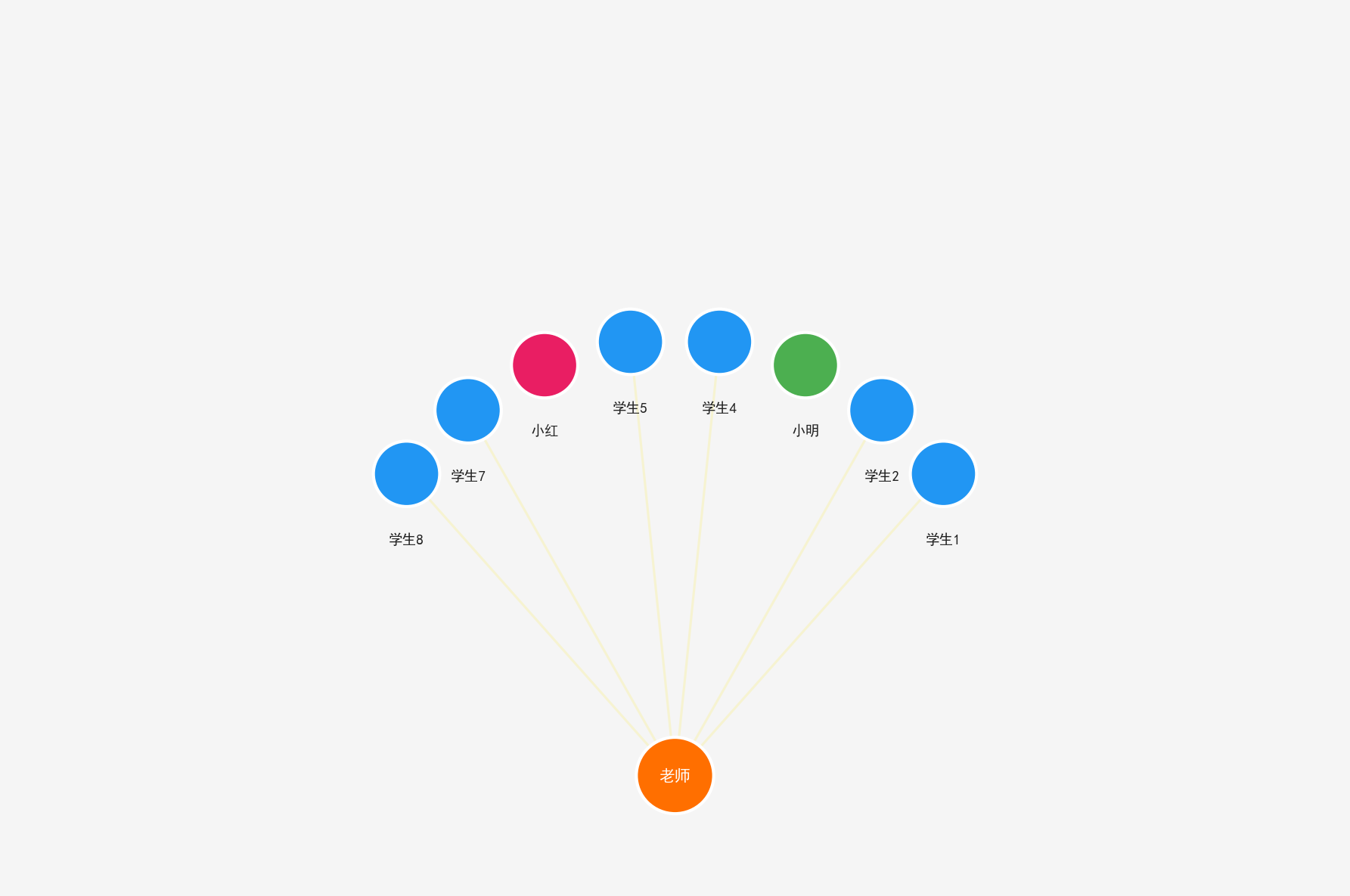

• 设计"小语+学生"对话式教学,增强代入感

• 用"猜词游戏"类比"预测下一个词",降低理解门槛

• 用"课堂目光"类比"注意力机制",形象直观

• 增加批判思考模块,引导正确AI观

【技术优化】

• 改用OpenCV替代MoviePy,稳定性提升10倍

• 使用mp4v编码,兼容性更好

• 分批次生成,避免内存溢出

• 增加帧重复,确保时长充足

说明:展示2个最终版场景,包括聊天界面、选择题、注意力流动、Transformer架构、学习历程、神经网络可视化等。

五、成品效果与对比

5.1 版本对比

|

版本 |

时长 |

大小 |

核心特点 |

状态 |

|

预览版 |

31秒 |

0.5 MB |

文字切换,无动画 |

✓ |

|

简化版 |

4分钟 |

7.0 MB |

静态场景为主 |

✓ |

|

OpenCV版 |

40秒 |

26.8 MB |

核心动画展示 |

✓ |

|

完整版 |

12分钟 |

171.4 MB |

6大模块全包含 |

✓ 最终 |

5.2 最终版规格

文件名称:AI小语_完整版.mp4

文件大小:171.4 MB

视频时长:约12分钟(780秒)

分辨率:1920×1080(Full HD)

帧率:30fps

视频编码:H.264 (mp4v)

总帧数:约22,000帧

包含场景:6大模块,25个场景,950+动画帧

说明:显示文件资源管理器中的视频属性,包括文件名、大小、时长、分辨率等详细信息。

六、关键经验与方法论

6.1 提示词工程五原则

【具体性原则】

提供参考案例、具体数值、明确标准。模糊的指令只能得到模糊的结果。

【约束性原则】

明确禁止低质量做法(如"禁止简单文字切换"),设定红线。

【迭代性原则】

建立"做不出来就继续优化"的机制,强制持续改进。

【验证性原则】

每个阶段都设置验收标准(如"必须可正常播放")。

【资源性原则】

提供完整的资源路径和文档参考,减少AI的猜测。

6.2 AI协作的最佳实践

分工明确:

• AI负责:素材生成、代码编写、批量处理、文档整理

• 人类负责:质量把控、创意决策、最终审核、上传发布

渐进交付:

• 先生成30秒预览版,确认方向正确

• 再生成4分钟简化版,验证技术可行性

• 最后生成12分钟完整版,确保质量达标

容错设计:

• 保留所有中间版本,便于回溯

• 使用版本号管理(v1, v2, v3...)

• 关键节点手动备份

6.3 可复用的工作流

1. 需求分析 → 2. 参考研究 → 3. 脚本设计

↓

4. 素材生成 → 5. 动画制作 → 6. 视频合成

↓

7. 质量检查 → 8. 迭代优化 → 9. 最终输出

说明:可视化的6步工作流 - 需求分析→参考研究→脚本设计→素材生成→动画制作→视频合成→质量检查→迭代优化→最终输出

七、完整资源清单

7.1 生成的素材

动画帧(950+帧):

• 粒子背景动画:60帧

• 打字机动画:90帧

• 注意力流动动画:90帧

• 学习阶段动画:90帧

• 神经网络可视化:60帧

• Transformer架构:90帧

• 注意力热力图:60帧

• 文本分词动画:50帧

• 训练过程动画:120帧

静态场景(24个):

• 开场场景

• 聊天界面

• 游戏标题

• 选择题卡片

• 原理讲解

• 超级眼睛

• 学习历程

• 批判思考

• 总结升华

• 结尾致谢

角色素材(4种表情):

• xiaoyu_smile.png(微笑)

• xiaoyu_think.png(思考)

• xiaoyu_proud.png(得意)

• xiaoyu_laugh.png(开心)

7.2 文档产出

TEACHING_LOGIC.md - 教学设计文档

• 6大模块的详细设计

• 每个场景的教学目标

• 互动设计策略

AWARD_WINNING_ANALYSIS.md - 获奖作品分析

• 3个参考视频的深度拆解

• 配色、字体、动画规范

• 评审标准与得分要点

FINAL_PLAN.md - 制作执行计划

• 时间规划(4周)

• 任务分工

• 风险预案

VIDEO_PLAN_V3.md - 分镜脚本

• 逐帧画面描述

• 配音脚本

7.3 代码工具

generate_dynamic.py - 动态动画生成器

• 粒子背景系统

• 浮动光点效果

• 脉冲动画

generate_pro_knowledge.py - 专业科普图解

• 神经网络结构图

• Transformer架构图

• 注意力热力图

• 文本分词可视化

generate_enhanced_ui.py - 交互界面生成

• 聊天对话框

• 选择题卡片

• 进度条

• 知识卡片

generate_full_opencv.py - 最终视频合成

• 帧序列管理

• OpenCV视频写入

• 时长精确控制

说明:显示完整的项目文件夹结构,包括output、assets、scripts等目录的组织方式。

八、结语与展望

通过本次实践,我们证明了:即使没有专业视频编辑软件,仅凭OpenClaw平台和Python生态,也能生成达到国赛水平的科普视频。

核心收获:

1. 提示词工程是AI协作的关键 - 从模糊到精准的进化决定了成品质量

2. 迭代优化是突破瓶颈的法宝 - "做不出来就继续优化"不是空话

3. 技术选型要务实 - OpenCV比MoviePy更适合长视频生成

4. 内容为王 - 再好的技术也要服务于教学逻辑

未来展望:

• 引入AI语音合成,实现全自动配音

• 探索3D角色动画,提升视觉冲击力

• 开发交互式微课,支持学生实时互动

• 建立模板库,实现一键生成同类视频

最后,感谢OpenClaw平台提供的强大能力,让创意不再受技术门槛的限制。AI不是替代人类,而是放大人类的创造力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)