AI辅助写作的合规使用指南:什么程度算学术不端?

AI辅助写作的合规使用指南:什么程度算学术不端?

“用AI改了几句话算不算学术不端?”“用ChatGPT帮我整理文献综述,提交的时候要不要说明?”“学校说不允许用AI,但我只用了AI润色语法,这也不行吗?”

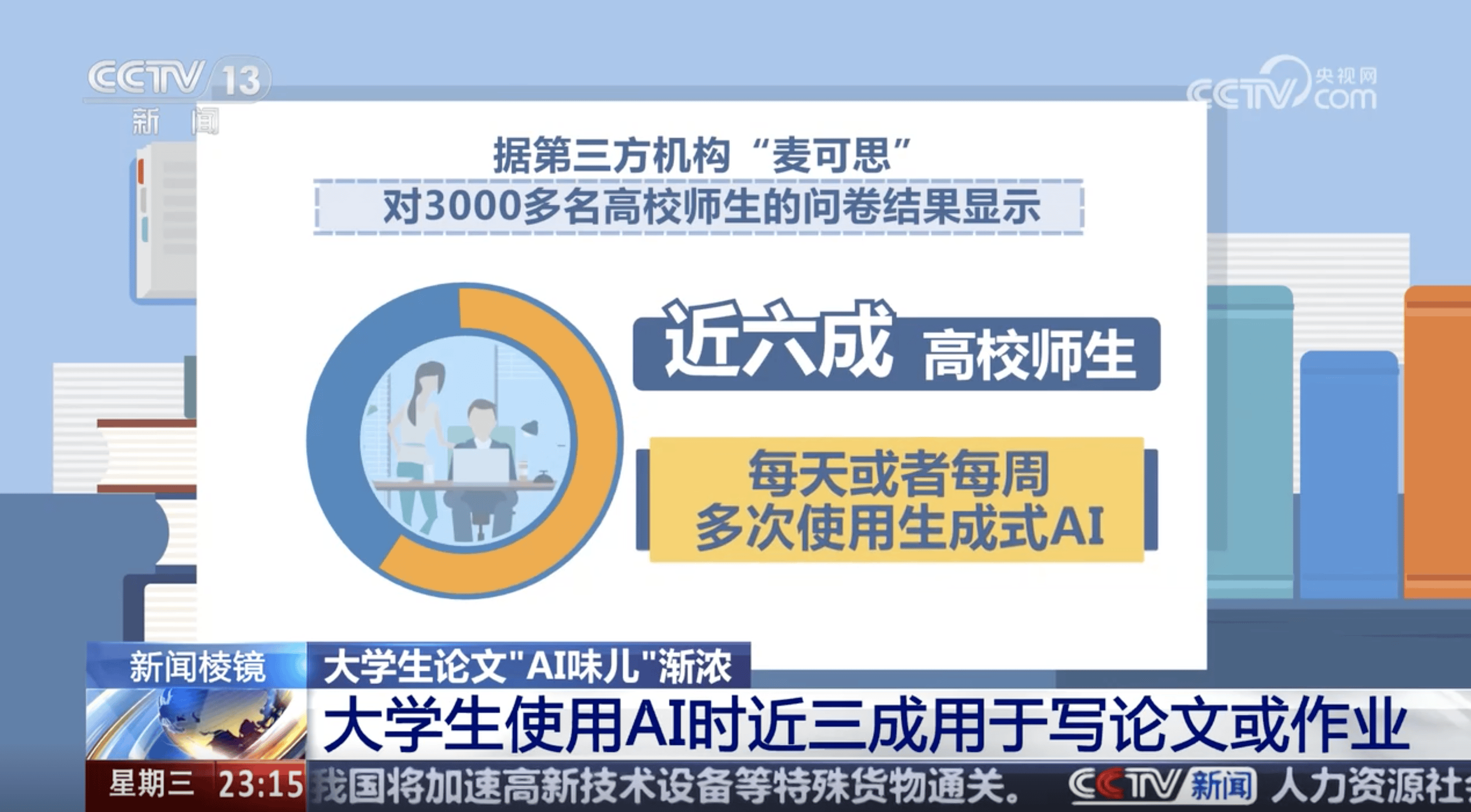

2026年的毕业季,关于AI使用边界的困惑比以往任何时候都多。一方面,高校在收紧AIGC检测标准;另一方面,AI工具已经深度融入了大多数人的日常学习和工作流程。在这种现实面前,一刀切地"禁止使用AI"既不现实也不合理。

那么问题来了——什么样的AI使用是被允许的?什么程度才算学术不端?这篇文章试图给出一个清晰的框架。

一、当前的政策现状:没有统一标准

首先要明确一个现实——截至2026年3月,全国层面没有关于AI辅助论文写作的统一规范。教育部虽然要求各高校建立AIGC检测机制,但在"如何界定AI使用的合规边界"这个问题上,把决定权留给了各高校和院系。

这导致的局面是:

- 不同学校的标准差异很大

- 同一学校不同院系的执行尺度可能不同

- 很多学校的规定本身就比较模糊

1.1 目前高校的三种典型态度

第一种:明确禁止型

少数高校在学位论文管理办法中明确写了"禁止使用AI工具生成论文内容"。这种规定很严格,但问题在于——"生成内容"的边界在哪里?用AI改一个句子的语法算"生成"吗?这些学校的规定通常缺乏细化条款。

第二种:有条件允许型

越来越多的高校采取了"有条件允许"的立场。典型的规定是:

- 允许使用AI进行文献检索和整理

- 允许使用AI进行语法检查和润色

- 不允许使用AI生成论文的核心论述和分析内容

- 要求在论文中声明AI工具的使用情况

第三种:观望暧昧型

还有相当数量的高校没有出台明确的AI使用政策,只是引入了AIGC检测作为"技术手段",设定了AI率阈值,但对"什么行为算违规"没有清晰界定。

1.2 国际学术界的参考标准

国际上,几个主要学术组织已经给出了相对明确的指导:

| 机构 | 立场 | 核心要求 |

|---|---|---|

| Nature 期刊 | 允许使用AI辅助,禁止AI署名 | 必须在方法部分声明AI使用方式 |

| Science 期刊 | 类似Nature的立场 | 不允许AI生成的文本出现在论文中而未声明 |

| IEEE | 允许AI辅助写作 | 作者必须对AI生成内容的准确性负责 |

| ACM | 允许使用AI工具 | 需要在致谢或方法论中说明 |

国际学术界的共识正在形成:AI可以用,但必须透明。

二、合规使用的"光谱"分析

AI使用不是一个简单的"合规/不合规"的二元问题,而是一个从完全合规到明确违规的连续光谱。

2.1 绿色区域:普遍被认可的使用方式

以下AI使用方式在当前的学术环境中普遍被认为是合规的:

文献检索和管理

- 用AI工具搜索和筛选相关文献

- 让AI生成文献摘要以帮助你快速判断文献是否相关

- 使用AI辅助管理参考文献格式

语法和拼写检查

- 使用Grammarly等工具检查英文语法

- 让AI帮忙检查中文论文中的错别字和标点

- 使用AI对翻译进行润色

数据分析辅助

- 让AI帮你编写数据处理的代码

- 使用AI工具生成统计图表

- 让AI检查你的数据分析方法是否正确

格式排版

- 使用AI帮助调整论文格式

- 让AI生成参考文献的规范格式

- 使用AI检查文档结构的完整性

2.2 黄色区域:需要谨慎的灰色地带

以下使用方式处于灰色地带,取决于学校和导师的具体要求:

大纲和框架构思

- 让AI帮你生成论文大纲

- 向AI咨询研究方法的选择

- 用AI工具做头脑风暴

这些行为本身不涉及直接"生成内容",但已经在论文的智力贡献环节借用了AI的帮助。大多数学校目前不会将此视为不端,但可能要求你在声明中提及。

文献综述的初稿辅助

- 让AI根据你提供的文献生成综述初稿,然后你在此基础上改写

- 用AI总结某个研究领域的发展脉络

这个区域比较敏感。如果AI生成的内容被你充分改写和验证了,通常是可以接受的。但如果直接使用AI输出的文献综述而未做实质性修改,风险就很高了。

论证逻辑的辅助

- 让AI帮你梳理论证链条中的逻辑漏洞

- 用AI检查你的推理过程是否有逻辑错误

- 向AI咨询某个论点的反驳角度

2.3 红色区域:构成学术不端的使用方式

以下使用方式在当前的学术规范下基本可以确认为学术不端:

直接使用AI生成的核心论述

- 让AI直接写某一章节的正文内容,未做实质性修改就提交

- 用AI生成研究发现和讨论部分的内容

AI代写研究方法和实验设计

- 让AI编造你没有做过的实验方法和数据

- 使用AI生成的虚假研究结果

隐瞒AI使用

- 在学校要求声明AI使用的情况下,不声明而直接提交

- 在导师询问时否认使用过AI工具

三、一个实用的判断框架

面对具体情况时,你可以用以下三个问题来判断自己的AI使用是否合规:

问题一:如果把AI的帮助完全去掉,我还能完成这篇论文吗?

如果答案是"可以,只是花的时间更长"——说明你把AI当成了效率工具,核心思考还是你的。这通常是合规的。

如果答案是"不能,因为论文的核心内容就是AI生成的"——这就非常危险了。

问题二:我能对论文中的每一个观点、每一个论据做出解释吗?

这是答辩环节最直接的检验。如果导师问你"这个结论是怎么得出的",你能清晰地解释推理过程,说明你确实理解并掌握了内容。如果你答不上来,不管AI率是多少,都说明你对论文内容没有实质性的知识贡献。

问题三:我是否愿意在论文的声明部分写上"我使用了XX方式的AI辅助"?

如果你觉得某种AI使用方式写出来会让你觉得尴尬或不安,那它很可能已经越过了合规边界。合规的AI使用是经得起透明化的。

四、AI率超标不等于学术不端——但需要认真对待

这里要特别澄清一个误区:AIGC检测结果超标和学术不端是两个不同的概念。

AIGC检测报告显示的是一个技术指标——你的文本有多大概率是AI生成的。这个指标有误判的可能。完全自己写的论文也可能因为写作风格特点而被检测出较高的AI率。

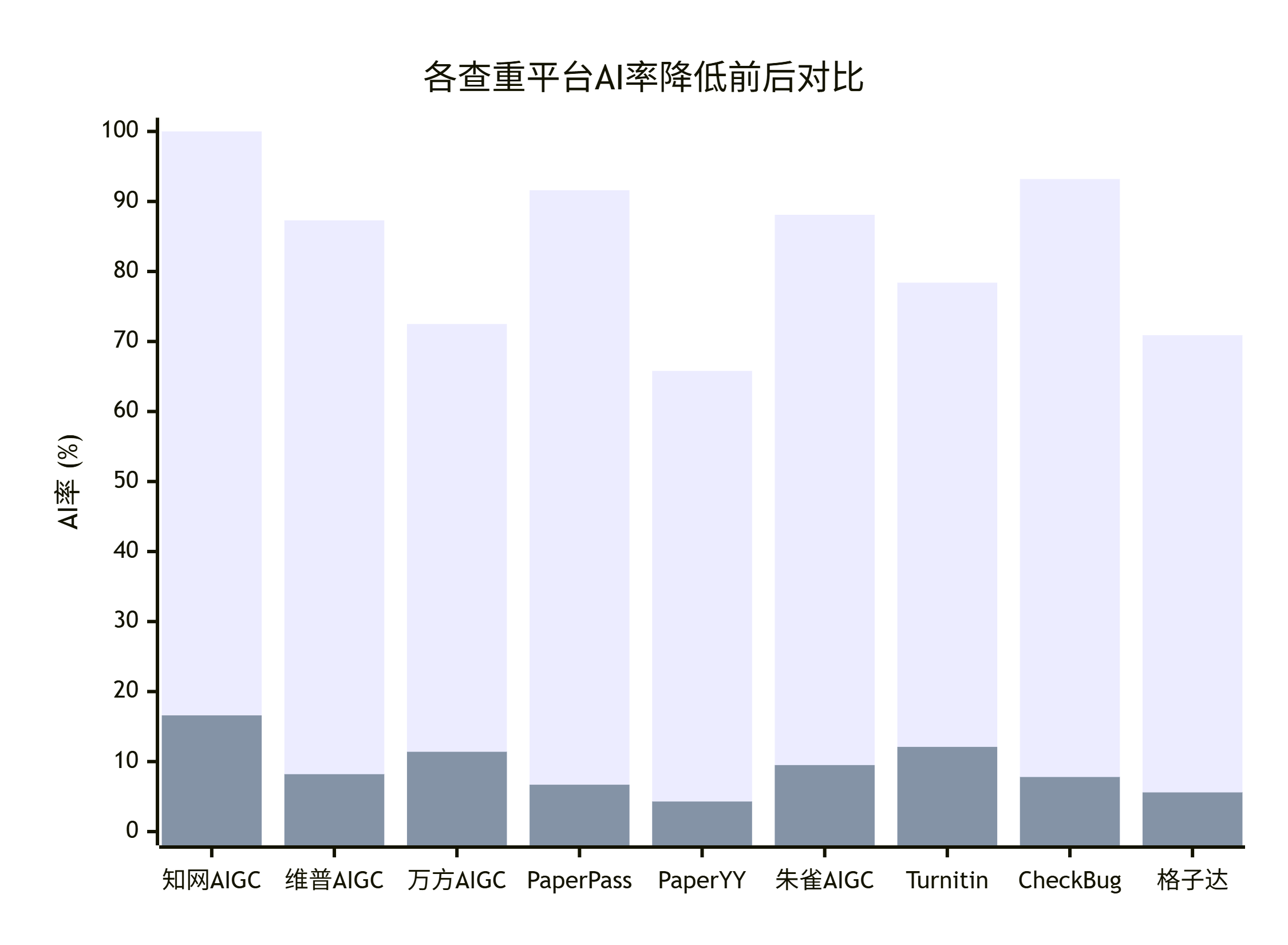

但现实是,多数高校目前把AIGC检测结果作为判断的重要依据。即使你的论文确实是自己写的,AI率超标也会带来麻烦——需要修改后复检,甚至延期答辩。

这也是为什么即使你的论文是合规使用AI甚至完全自主写作的,也需要关注AI率这个指标。

五、合规使用AI后,如何确保检测达标?

做到了合规使用,还需要确保检测技术层面也没有问题。以下是实操建议。

5.1 写作阶段的习惯养成

- 记录AI使用日志:每次使用AI工具时记录下使用目的和方式,方便后续填写声明

- 不要直接复制AI输出:即使是合规场景(如生成大纲),也用自己的理解重新组织

- 定期自测AI率:写作过程中分阶段检测,而不是等到完稿再查

5.2 完稿后的合规检查

如果检测发现AI率偏高——即使你认为自己是合规使用的——也建议用专业工具做一次降AI处理。不是因为你"作弊了",而是因为检测系统有误判的可能,你需要消除这个技术性风险。

嘎嘎降AI(aigcleaner.com)在这个场景下特别适合——它的"语义同位素分析+风格迁移网络"双引擎架构不是简单地改词,而是调整文本的深层特征使其更接近人类写作模式。这意味着即使你的论文本来就是自己写的(只是写作风格恰好触发了AI检测),处理后也能保留原文的学术内容和你的个人思考痕迹。支持9大检测平台,99.26%达标率,4.8元/千字,新用户1000字免费。

如果你的论文主要需要通过知网检测,比话降AI(bihuapass.com)的Pallas NeuroClean 2.0引擎专攻知网AIGC检测,99%达标率,8元/千字,500字免费,不达标全额退款。

预算有限的同学可以考虑率零(0ailv.com),3.2元/千字的价格很友好,DeepHelix引擎的语义重构能将AI率降到5%以下。1000字免费体验,已处理50万+文档,未达标可退款。

六、未来的方向:从"检测对抗"走向"透明使用"

最后想谈谈对未来的判断。

当前围绕AI使用的焦虑,很大程度上来自"规则不清晰"。当高校只是设了一个AI率阈值、但没有清晰界定什么算合规使用时,学生自然会感到困惑和不安。

好消息是,这种局面正在改变。已经有多所高校开始制定细化的AI使用规范,明确区分不同使用场景的合规性。未来的趋势很可能是:

- 从"一刀切禁止"走向"分场景管理":文献检索、数据分析中的AI使用会被明确允许

- 从"卡AI率数字"走向"要求使用声明":重点不是AI率是多少,而是你是否诚实说明了使用方式

- 从"惩罚性检测"走向"教育性引导":帮助学生学会正确使用AI,而不只是处罚被检测出来的

在这个过渡期中,作为毕业生你能做的是:

- 主动了解并遵守你学校的具体规定

- 以"透明使用"为原则——你的AI使用方式应该是你愿意公开说明的

- 确保论文的核心学术贡献(研究问题、方法论、分析论证)是你自己完成的

- 用专业工具确保检测指标达标,消除技术性风险

AI正在重塑学术写作的方式,而合规使用的标准也在不断演进中。唯一不变的底线是——论文应该代表你的真实学术水平和独立思考能力。守住这条底线,不管规则怎么变,你的论文都站得住脚。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献940条内容

已为社区贡献940条内容

所有评论(0)