服务器下载 Hugging Face 模型的 7 种方法(附国内加速 + 离线加载)

·

目录

三、使用 huggingface-cli 下载(最推荐 ⭐)

一、Hugging Face 模型仓库结构

Hugging Face 模型通常类似一个 Git 仓库,例如:

其中最重要的是:

| 文件 | 作用 |

|---|---|

| pytorch_model.bin | 模型权重 |

| config.json | 模型配置 |

| tokenizer.json | tokenizer |

| README.md | 模型说明 |

二、使用 git clone 下载(最简单)

类似 GitHub。

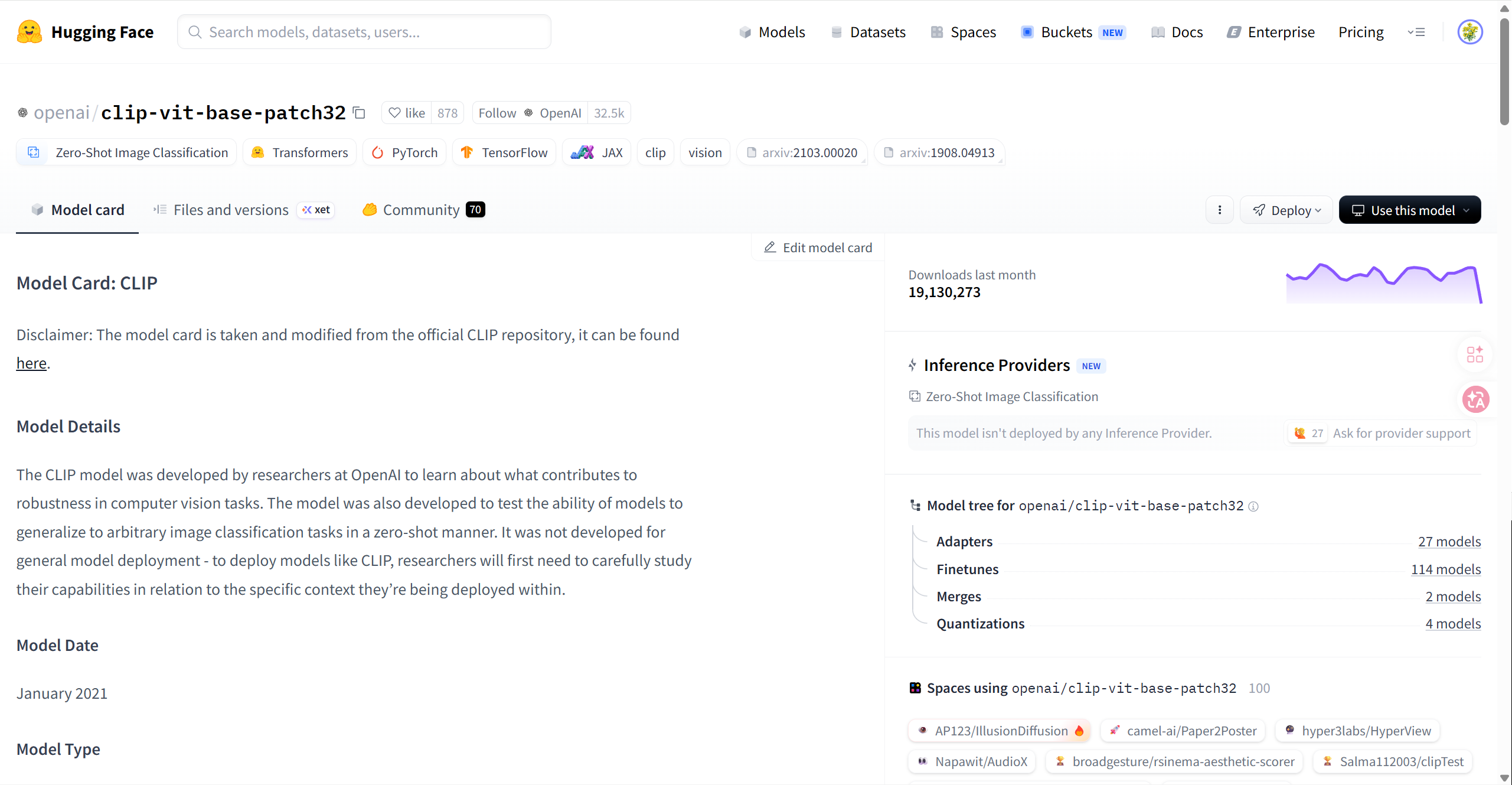

git clone https://huggingface.co/openai/clip-vit-base-patch32

优点:

-

简单

-

完整下载仓库

缺点:

-

依赖 Git LFS

三、使用 huggingface-cli 下载(最推荐 ⭐)

这是 目前最稳定的方式。

1 安装

pip install huggingface_hub

2 下载模型

huggingface-cli download openai/clip-vit-base-patch32

# 只下载权重文件

huggingface-cli download openai/clip-vit-base-patch32 pytorch_model.bin3 指定路径

huggingface-cli download openai/clip-vit-base-patch32 --local-dir ./clip_model

优点:

-

自动处理大文件

-

支持断点续传

-

不需要 Git LFS

-

下载更稳定

四、使用 Git LFS 下载

很多 Hugging Face 模型使用 Git LFS(Large File Storage)。

安装:

sudo apt install git-lfs

初始化:

git lfs install

然后 clone:

git clone https://huggingface.co/openai/clip-vit-base-patch32

否则下载到的可能是:

pytorch_model.bin

但其实只是 LFS pointer 文件。

五、使用 Python 下载(实验最方便)

很多论文代码都使用这种方式。

from huggingface_hub import snapshot_download

snapshot_download(

repo_id="openai/clip-vit-base-patch32",

local_dir="./clip_model"

)

优点:

-

自动缓存

-

不会重复下载

-

与 Transformers 兼容

六、Transformers 自动下载(最常见)

如果使用 Transformers:

from transformers import CLIPModel

model = CLIPModel.from_pretrained("openai/clip-vit-base-patch32")

Transformers 会自动:

1 下载模型

2 缓存到本地

缓存路径:

~/.cache/huggingface

七、国内服务器加速方案

很多国内服务器访问 Hugging Face 会很慢。

可以使用 镜像站:

export HF_ENDPOINT=https://hf-mirror.com

然后再下载:

huggingface-cli download openai/clip-vit-base-patch32

Python 方式:

import os

os.environ["HF_ENDPOINT"] = "https://hf-mirror.com"

八、批量下载模型(服务器常用)

如果需要批量下载多个模型,可以写脚本。

download_models.sh

models=(

openai/clip-vit-base-patch32

bert-base-uncased

google/vit-base-patch16-224

)

for model in "${models[@]}"

do

huggingface-cli download $model --local-dir ./models/$model

done

运行:

bash download_models.sh

九、离线加载 Hugging Face 模型

如果服务器 不能联网,可以先下载再上传服务器。

第一步:下载

huggingface-cli download openai/clip-vit-base-patch32 --local-dir ./clip_model

第二步:上传服务器

scp -r clip_model server:/data/models

第三步:离线加载

from transformers import CLIPModel

model = CLIPModel.from_pretrained("/data/models/clip_model")

总结

| 方法 | 推荐程度 | 适用场景 |

|---|---|---|

| git clone | ⭐⭐⭐ | 下载完整仓库推荐使用 |

| huggingface-cli download | ⭐⭐⭐⭐ | 下载模型权重(最推荐) |

| Git LFS | ⭐⭐ | 配合 git clone |

| Python snapshot_download | ⭐⭐⭐⭐ | 实验代码中使用 |

| Transformers 自动下载 | ⭐⭐⭐ | 直接加载模型 |

参考

Hugging Face

https://huggingface.co

Transformers

https://huggingface.co/docs/transformers

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)