金融科技中的Prompt多模型协同:架构师教你用Prompt连接不同大模型

金融科技中的Prompt多模型协同:架构师教你用Prompt连接不同大模型

一、引言

在当今的金融科技领域,大模型展现出了巨大的潜力,从风险评估到客户服务,它们正在改变金融行业的运作方式。然而,单一的大模型往往存在局限性,不同的大模型在不同的任务上各有所长。通过Prompt多模型协同,我们能够整合不同大模型的优势,提升金融应用的性能和效果。本文将深入探讨如何使用Prompt连接不同大模型,为金融科技带来更强大的解决方案。

二、核心算法原理 & 具体操作步骤

(一)大模型基础原理

-

Transformer架构

现代大模型如GPT系列、BERT等大多基于Transformer架构。Transformer架构抛弃了传统的循环神经网络(RNN)结构,采用自注意力机制(Self - Attention)。自注意力机制能够让模型在处理序列数据时,动态地关注输入序列的不同部分,从而更好地捕捉长距离依赖关系。在Python中,可以用以下简单代码示意自注意力机制的核心部分(这里使用PyTorch库):

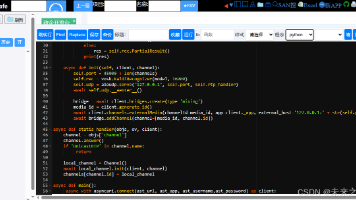

import torch import torch.nn as nn class SelfAttention(nn.Module): def __init__(self, embed_dim): super(SelfAttention, self).__init__() self.query = nn.Linear(embed_dim, embed_dim) self.key = nn.Linear(embed_dim, embed_dim) self.value = nn.Linear(embed_dim, embed_dim) def forward(self, x): q = self.query(x) k = self.key(x) v = self.value(x) attention_scores = torch.matmul(q, k.transpose(-2, -1)) / (k.size(-1) ** 0.5) attention_weights = nn.functional.softmax(attention_scores, dim=-1) output = torch.matmul(attention_weights, v) return output -

预训练与微调

大模型通常经过大规模无监督数据的预训练,学习到通用的语言表示。在金融场景中,我们会在预训练模型的基础上进行微调。例如,对于金融文本分类任务(如判断新闻对股价的影响是正面还是负面),我们会使用带有标签的金融数据对预训练模型进行微调,使模型适应特定的金融任务。

(二)Prompt多模型协同原理

- Prompt设计

Prompt是一段输入给大模型的文本,它引导模型产生特定的输出。在多模型协同中,Prompt起到关键的桥梁作用。例如,我们希望一个模型生成金融市场趋势的描述,另一个模型基于这个描述进行风险评估。我们可以设计如下的Prompt:“请描述当前金融市场的主要趋势,包括股票、债券和外汇市场。”对于风险评估模型的Prompt可以是:“根据以下金融市场趋势描述,评估潜在的投资风险:[前面模型生成的趋势描述]”。 - 模型间通信

我们可以通过API调用或者本地模型实例的方式实现模型间的通信。例如,使用Hugging Face的Transformers库加载不同的预训练模型,在Python中实现模型间的数据传递。from transformers import pipeline # 加载文本生成模型 text_generator = pipeline('text - generation', model='gpt2') # 加载风险评估模型 risk_evaluator = pipeline('text - classification', model='金融风险评估模型路径') market_trend_prompt = "请描述当前金融市场的主要趋势,包括股票、债券和外汇市场。" market_trend = text_generator(market_trend_prompt)[0]['generated_text'] risk_prompt = f"根据以下金融市场趋势描述,评估潜在的投资风险:{market_trend}" risk_assessment = risk_evaluator(risk_prompt)[0]['label']

三、数学模型和公式 & 详细讲解 & 举例说明

在大模型的训练和推理过程中,涉及到一些重要的数学概念和公式。

(一)损失函数

- 交叉熵损失(Cross - Entropy Loss)

在分类任务中,交叉熵损失常用于衡量模型预测值与真实标签之间的差异。对于一个具有CCC个类别的分类任务,给定一个样本xxx,其真实标签为yyy(yyy是一个one - hot向量,即只有一个类别位置为1,其余为0),模型预测的概率分布为y^\hat{y}y^(y^i\hat{y}_iy^i表示样本xxx属于类别iii的预测概率,∑i=1Cy^i=1\sum_{i = 1}^{C}\hat{y}_i = 1∑i=1Cy^i=1)。交叉熵损失函数定义为:

[L(y,\hat{y})=-\sum_{i = 1}^{C}y_i\log(\hat{y}_i)]

例如,在一个二分类的金融欺诈检测任务中,y=[1,0]y = [1,0]y=[1,0]表示样本为正常交易(正类),模型预测概率为y^=[0.8,0.2]\hat{y}=[0.8,0.2]y^=[0.8,0.2]。则交叉熵损失为:

[L([1,0],[0.8,0.2])=-(1\times\log(0.8)+0\times\log(0.2))\approx0.223]

(二)注意力机制中的缩放点积注意力(Scaled Dot - Product Attention)

- 公式

缩放点积注意力是Transformer架构中自注意力机制的核心计算部分。给定查询(Query)QQQ、键(Key)KKK和值(Value)VVV,缩放点积注意力计算如下:

[\text{Attention}(Q,K,V)=\text{softmax}(\frac{QK^T}{\sqrt{d_k}})V]

其中,dkd_kdk是KKK的维度,softmax\text{softmax}softmax函数用于将分数转换为概率分布。QKTQK^TQKT计算了查询与所有键之间的相似度分数,除以dk\sqrt{d_k}dk是为了防止在dkd_kdk较大时,分数过大导致softmax\text{softmax}softmax函数梯度消失。

四、项目实战:代码实际案例和详细解释说明

(一)项目目标

构建一个简单的金融新闻情感分析系统,通过连接两个大模型实现更好的分析效果。第一个模型用于提取新闻中的关键信息,第二个模型基于这些关键信息进行情感分析。

(二)代码实现

- 关键信息提取模型

我们使用基于BERT的预训练模型进行关键信息提取。from transformers import AutoTokenizer, AutoModelForTokenClassification tokenizer = AutoTokenizer.from_pretrained('bert - base - uncased') model = AutoModelForTokenClassification.from_pretrained('bert - base - uncased') def extract_key_information(news_text): inputs = tokenizer(news_text, return_tensors='pt') outputs = model(**inputs) logits = outputs.logits predicted_labels = torch.argmax(logits, dim = 2) tokens = tokenizer.convert_ids_to_tokens(inputs['input_ids'][0]) key_information = [] for token, label in zip(tokens, predicted_labels[0]): if label.item() == 1: # 假设1表示关键信息标签 key_information.append(token) return " ".join(key_information) - 情感分析模型

我们使用一个简单的基于LSTM的情感分析模型,这里使用Keras库。from keras.models import Sequential from keras.layers import Embedding, LSTM, Dense from keras.preprocessing.text import Tokenizer from keras.preprocessing.sequence import pad_sequences import numpy as np maxlen = 100 tokenizer = Tokenizer(num_words = 1000) def build_sentiment_model(): model = Sequential() model.add(Embedding(1000, 128, input_length = maxlen)) model.add(LSTM(128)) model.add(Dense(1, activation='sigmoid')) model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy']) return model def analyze_sentiment(key_info): model = build_sentiment_model() sequences = tokenizer.texts_to_sequences([key_info]) padded_sequences = pad_sequences(sequences, maxlen = maxlen) sentiment = model.predict(padded_sequences)[0][0] if sentiment > 0.5: return "Positive" else: return "Negative" - 模型协同

news_text = "The financial market has shown a strong upward trend recently, with stocks rising steadily." key_info = extract_key_information(news_text) sentiment = analyze_sentiment(key_info) print(f"Key Information: {key_info}") print(f"Sentiment: {sentiment}")

(三)代码解释

- 关键信息提取模型:首先加载预训练的BERT模型和对应的分词器。

extract_key_information函数将新闻文本进行编码输入模型,模型输出的logits经过处理得到预测标签。我们假设标签为1的词是关键信息,将这些词提取出来组成关键信息字符串。 - 情感分析模型:

build_sentiment_model函数构建了一个简单的LSTM情感分析模型,包含嵌入层、LSTM层和全连接层。analyze_sentiment函数将关键信息进行预处理,转化为模型可接受的输入格式,然后进行情感预测。 - 模型协同:在主程序部分,我们定义了一条金融新闻文本,先调用关键信息提取模型得到关键信息,再将关键信息输入情感分析模型,最终输出情感分析结果。

五、开发环境搭建

(一)硬件环境

- CPU:对于小规模实验和测试,普通的多核CPU(如Intel Core i5或AMD Ryzen 5系列)即可满足需求。但如果要进行大规模模型训练或处理大量数据,建议使用高性能服务器级CPU,如Intel Xeon系列。

- GPU:在训练大模型时,GPU能显著加速计算。NVIDIA的GPU如RTX 30系列(适合个人开发者)或A100(适合企业级大规模训练)是不错的选择。需要安装相应的CUDA Toolkit和cuDNN库以支持GPU加速。

(二)软件环境

- 操作系统:推荐使用Linux系统,如Ubuntu 20.04,它对深度学习框架有良好的支持。Windows系统也可使用,但在某些情况下可能会遇到兼容性问题。

- 编程语言:本文主要使用Python,建议安装Python 3.8及以上版本。

- 深度学习框架:

- PyTorch:可通过官方网站根据自己的CUDA版本选择合适的安装命令。例如,对于CUDA 11.1版本:

pip install torch==1.9.0+cu111 torchvision==0.10.0+cu111 torchaudio==0.9.0 - f https://download.pytorch.org/whl/torch_stable.html- Keras:可以直接使用

pip install keras进行安装。

- 其他依赖库:

- transformers:用于加载和使用预训练的大模型,

pip install transformers。 - numpy:数值计算库,

pip install numpy。 - pandas:数据处理库,

pip install pandas(如果需要处理金融数据文件)。

- transformers:用于加载和使用预训练的大模型,

六、源代码详细实现和代码解读

(一)关键信息提取模型(续)

- 模型加载

这里使用tokenizer = AutoTokenizer.from_pretrained('bert - base - uncased') model = AutoModelForTokenClassification.from_pretrained('bert - base - uncased')transformers库从Hugging Face模型仓库加载预训练的BERT分词器和用于标记分类的模型。bert - base - uncased表示使用基础的不区分大小写的BERT模型。 - 信息提取逻辑

def extract_key_information(news_text): inputs = tokenizer(news_text, return_tensors='pt') outputs = model(**inputs) logits = outputs.logits predicted_labels = torch.argmax(logits, dim = 2) tokens = tokenizer.convert_ids_to_tokens(inputs['input_ids'][0]) key_information = [] for token, label in zip(tokens, predicted_labels[0]): if label.item() == 1: # 假设1表示关键信息标签 key_information.append(token) return " ".join(key_information)tokenizer(news_text, return_tensors='pt')将新闻文本进行编码,并返回PyTorch张量格式的输入。model(**inputs)将输入传递给模型进行前向传播,得到输出。outputs.logits获取模型输出的未归一化分数。torch.argmax(logits, dim = 2)通过对logits在维度2上取最大值的索引,得到预测标签。tokenizer.convert_ids_to_tokens(inputs['input_ids'][0])将输入的ID转换回原始的词。- 最后通过遍历词和标签,将标签为1的词组成关键信息字符串。

(二)情感分析模型(续)

- 模型构建

def build_sentiment_model(): model = Sequential() model.add(Embedding(1000, 128, input_length = maxlen)) model.add(LSTM(128)) model.add(Dense(1, activation='sigmoid')) model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy']) return modelEmbedding(1000, 128, input_length = maxlen)创建一个嵌入层,将词汇表中的1000个词映射到128维的向量空间,输入长度固定为maxlen。LSTM(128)添加一个LSTM层,隐藏单元数为128,LSTM可以处理序列数据中的长期依赖关系。Dense(1, activation='sigmoid')添加一个全连接层,输出维度为1,使用sigmoid激活函数,用于二分类(正面或负面情感)。model.compile配置模型的优化器(adam)、损失函数(binary_crossentropy)和评估指标(accuracy)。

- 情感分析逻辑

def analyze_sentiment(key_info): model = build_sentiment_model() sequences = tokenizer.texts_to_sequences([key_info]) padded_sequences = pad_sequences(sequences, maxlen = maxlen) sentiment = model.predict(padded_sequences)[0][0] if sentiment > 0.5: return "Positive" else: return "Negative"tokenizer.texts_to_sequences([key_info])将关键信息文本转换为词序列。pad_sequences(sequences, maxlen = maxlen)将序列填充或截断到固定长度maxlen。model.predict(padded_sequences)使用构建好的模型进行预测,得到一个概率值。- 根据概率值与0.5的比较,返回正面或负面情感标签。

七、代码解读与分析

(一)模型选择与合理性

- 关键信息提取选择BERT:BERT在自然语言处理任务中表现出色,其预训练过程能够学习到丰富的语言表示。对于金融新闻的关键信息提取,BERT可以理解文本的语义和句法结构,准确地识别出关键信息词。

- 情感分析选择LSTM:LSTM适合处理序列数据中的长期依赖关系,在情感分析任务中,文本的上下文信息对判断情感至关重要。LSTM能够捕捉文本中的语义变化,从而做出准确的情感判断。虽然Transformer架构在很多任务上超越了LSTM,但LSTM相对简单且在小规模数据上有较好的表现,适合我们这个简单的情感分析示例。

(二)模型协同优势

- 分工明确:通过将关键信息提取和情感分析任务分配给不同的模型,每个模型专注于自己擅长的领域。关键信息提取模型能够过滤掉无关信息,为情感分析模型提供更有针对性的数据,提高情感分析的准确性。

- 灵活性:如果有更好的关键信息提取模型或情感分析模型出现,我们可以很方便地替换掉现有的模型,而不需要对整个系统进行大规模重构。例如,可以将BERT替换为更适合金融领域的预训练模型,或者将LSTM情感分析模型替换为基于Transformer的模型。

(三)局限性与改进方向

- 局限性

- 数据依赖:模型的性能高度依赖训练数据的质量和数量。如果训练数据不足或存在偏差,会导致模型的泛化能力差,在实际应用中表现不佳。

- 模型复杂度:虽然我们的示例模型相对简单,但在实际金融场景中,可能需要更复杂的模型来处理各种复杂的金融文本和任务,这会带来更高的计算成本和训练时间。

- 改进方向

- 数据增强:通过数据扩充技术,如文本生成、数据采样等,增加训练数据的多样性和数量,提高模型的泛化能力。

- 模型融合:除了简单的模型协同,还可以采用更高级的模型融合技术,如加权平均、Stacking等,进一步提升模型的性能。

八、实际应用场景

(一)金融风险评估

- 市场风险评估:通过连接文本生成模型和风险评估模型,先让文本生成模型从金融新闻、市场报告等文本中提取市场趋势、政策变化等关键信息,然后风险评估模型基于这些信息评估市场风险。例如,当文本生成模型提取到“央行即将加息”的关键信息,风险评估模型可以据此评估对股票、债券等市场的潜在风险。

- 信用风险评估:从企业的财务报告、新闻报道等文本中提取关键信息,如企业的营收情况、债务水平、重大事件等,再由信用风险评估模型判断企业的信用风险等级。这有助于金融机构在贷款审批、债券投资等业务中做出更准确的决策。

(二)客户服务

- 智能客服:在金融机构的智能客服系统中,一个模型可以先对客户的问题进行意图识别和关键信息提取,如“我想了解如何开通网上银行”,提取出“开通网上银行”的关键信息。然后另一个模型根据这些关键信息生成详细的解答,为客户提供准确的服务。

- 个性化推荐:通过分析客户与金融机构的交互文本(如咨询记录、交易记录等),一个模型提取客户的偏好、风险承受能力等关键信息,另一个模型基于这些信息为客户推荐合适的金融产品,如理财产品、信用卡等。

九、工具和资源推荐

(一)模型资源

- Hugging Face:提供了大量预训练的大模型,涵盖多种任务和架构,如BERT、GPT - Neo等。其

transformers库方便用户加载和使用这些模型,并且社区活跃,有丰富的文档和示例代码。 - Google AI Hub:包含Google开发的一些预训练模型,如BERT的官方版本等,同时提供模型的详细文档和使用说明。

(二)开发工具

- Jupyter Notebook:交互式计算环境,适合进行代码测试、模型开发和数据分析。可以方便地运行代码块,查看输出结果,并且支持Markdown文本的编写,便于记录实验过程和结果。

- PyCharm:强大的Python集成开发环境,提供代码自动完成、调试、代码分析等功能,对于大型项目的开发和管理非常有帮助。

(三)数据集

- Financial PhraseBank:包含金融新闻和微博等文本的情感分析数据集,可用于训练和评估金融情感分析模型。

- SEC EDGAR:美国证券交易委员会(SEC)的电子数据收集、分析和检索系统,提供大量企业的财务报告等文本数据,可用于金融文本处理和风险评估等任务。

十、未来发展趋势与挑战

(一)未来发展趋势

- 更强大的模型协同:随着大模型技术的不断发展,未来模型协同将更加智能化和自动化。模型之间可以根据任务需求自动选择最佳的协同方式,并且能够动态调整Prompt以适应不同的输入。

- 多模态融合:金融数据不仅包括文本,还包括图像(如金融图表)、音频(如分析师的讲解)等。未来将实现多模态大模型的协同,综合利用多种数据模态提升金融应用的性能。例如,结合金融图表和相关文本进行更准确的市场预测。

(二)挑战

- 隐私与安全:在金融领域,数据隐私和安全至关重要。当使用不同的大模型协同处理金融数据时,如何确保数据在传输和处理过程中的安全性和隐私性是一个巨大的挑战。例如,如何防止模型在共享数据时泄露敏感信息。

- 模型可解释性:随着模型协同的复杂性增加,理解模型的决策过程变得更加困难。在金融领域,监管机构和客户都需要对模型的决策有清晰的解释。如何开发可解释的模型协同方法,让金融从业者和监管者能够信任模型的输出,是未来需要解决的重要问题。

通过本文,希望读者对金融科技中的Prompt多模型协同有更深入的理解,并能够在实际项目中运用这些技术,为金融领域的创新和发展贡献力量。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)