CAP 理论深度解析:ZooKeeper 的取舍与权衡

CAP 理论深度解析:ZooKeeper 的取舍与权衡

|

🌺The Begin🌺点点关注,收藏不迷路🌺

|

摘要:CAP 理论是分布式系统设计的基石,它揭示了分布式系统在一致性、可用性和分区容错性之间不可兼得的困境。ZooKeeper 作为分布式协调服务的标杆,它在 CAP 问题上的取舍直接影响着其设计哲学和适用场景。本文将深入剖析 CAP 理论的核心概念,并通过 ZooKeeper 的实际表现,探讨它在 CAP 中的定位与权衡。

一、CAP 理论概述

1.1 什么是 CAP 理论?

CAP 理论是分布式系统设计中最基础也是最重要的理论之一,由 Eric Brewer 在 2000 年提出。它指出,分布式系统在一致性(Consistency)、**可用性(Availability)和分区容错性(Partition tolerance)**这三个特性中,最多只能同时满足两个,无法三者兼顾。

1.2 CAP 的三个维度

| 维度 | 英文 | 说明 | 通俗理解 |

|---|---|---|---|

| 一致性 | Consistency | 所有节点在同一时间看到相同的数据 | 数据不矛盾,大家都一样 |

| 可用性 | Availability | 每次请求都能收到响应(不保证数据最新) | 服务一直在线,随时能访问 |

| 分区容错性 | Partition Tolerance | 系统允许网络分区(节点间通信中断) | 网络断了也能继续工作 |

1.3 CAP 的经典组合

三种组合的特点:

| 组合 | 放弃项 | 适用场景 | 代表系统 |

|---|---|---|---|

| CA | 分区容错性 | 单机系统、局域网系统 | 传统数据库 |

| CP | 可用性 | 需要强一致性的场景 | ZooKeeper、HBase |

| AP | 一致性 | 高可用优先的场景 | Cassandra、Eureka |

二、ZooKeeper 在 CAP 中的定位

2.1 官方定位:CP 系统

ZooKeeper 是一个典型的 CP 系统,它在设计上优先保证一致性(Consistency)和分区容错性(Partition Tolerance),在必要时会牺牲可用性(Availability)。

2.2 ZooKeeper 的一致性保证

ZooKeeper 提供了强一致性保证,具体体现在:

| 一致性特性 | 说明 |

|---|---|

| 顺序一致性 | 所有事务按全局顺序执行,ZXID 保证操作顺序 |

| 单一系统映像 | 无论连接哪个节点,最终看到的数据相同 |

| 原子性 | 事务要么全部成功,要么全部失败 |

| 线性化写入 | 写操作看起来瞬间完成 |

// ZooKeeper 的一致性示例

public class ConsistencyExample {

private ZooKeeper zk;

public void demonstrateConsistency() throws Exception {

// 写操作

zk.create("/node", "data".getBytes(),

ZooDefs.Ids.OPEN_ACL_UNSAFE, CreateMode.PERSISTENT);

// 读操作 - 保证能读到刚才写入的数据(可能稍有延迟)

byte[] data = zk.getData("/node", false, null);

System.out.println(new String(data)); // 输出: data

}

}

2.3 ZooKeeper 的分区容错性

ZooKeeper 通过 ZAB 协议保证分区容错性:

分区容错的表现:

- 多数派(过半)节点存活时,集群可正常工作

- 少数派节点无法处理写请求

- 网络恢复后,自动数据同步

2.4 ZooKeeper 牺牲的可用性

ZooKeeper 在以下场景会牺牲可用性:

| 场景 | 可用性影响 | 原因 |

|---|---|---|

| Leader 选举 | 写服务中断(秒级) | 需要重新选举 Leader |

| 网络分区 | 少数派节点不可写 | 保证数据一致性 |

| 过半节点故障 | 集群完全不可用 | 无法达到过半要求 |

// ZooKeeper 不可用场景示例

public class UnavailabilityExample {

public void demonstrateUnavailability() throws Exception {

// 3节点集群,如果2台宕机

// 剩余1台无法达到过半要求 (需要2/3)

// 整个集群不可用

// 客户端尝试连接

ZooKeeper zk = new ZooKeeper("localhost:2181", 5000, null);

// 操作会失败

try {

zk.create("/node", "data".getBytes(),

ZooDefs.Ids.OPEN_ACL_UNSAFE, CreateMode.PERSISTENT);

} catch (KeeperException.ConnectionLossException e) {

System.out.println("集群不可用,操作失败");

}

}

}

三、ZooKeeper 如何在 CAP 中做出选择

3.1 过半机制:一致性的保障

ZooKeeper 的过半机制是其 CP 特性的核心体现:

public class MajorityMechanism {

/**

* 过半机制公式

*/

public boolean isMajority(int aliveNodes, int totalNodes) {

return aliveNodes > totalNodes / 2;

}

/**

* 不同节点数的容错能力

*/

public void demonstrateMajority() {

int[][] scenarios = {

{3, 1}, // 3节点,可容忍1台故障

{5, 2}, // 5节点,可容忍2台故障

{7, 3} // 7节点,可容忍3台故障

};

for (int[] scenario : scenarios) {

int total = scenario[0];

int tolerance = scenario[1];

int alive = total - tolerance;

boolean available = isMajority(alive, total);

System.out.printf("%d节点集群,%d台存活,可用性: %s%n",

total, alive, available ? "✅" : "❌");

}

}

}

3.2 Leader 选举期间的不可用

当 Leader 故障时,ZooKeeper 进入选举期,此时集群不可处理写请求:

这个不可用窗口通常是秒级的,但对于需要极高可用性的场景,这是需要权衡的代价。

3.3 读操作的一致性与可用性权衡

ZooKeeper 允许读操作在任意节点执行,这在一定程度上提高了可用性,但可能导致读到旧数据:

public class ReadConsistencyTradeoff {

private ZooKeeper zk;

/**

* 强一致性读(牺牲部分可用性)

*/

public byte[] strongRead(String path) throws Exception {

// 先执行 sync,确保数据最新

zk.sync(path, null, null);

return zk.getData(path, false, null);

}

/**

* 高可用读(可能读到旧数据)

*/

public byte[] highAvailableRead(String path) throws Exception {

// 直接读,可能读的是旧数据

return zk.getData(path, false, null);

}

}

四、与其他系统的 CAP 对比

4.1 ZooKeeper vs Eureka

| 维度 | ZooKeeper (CP) | Eureka (AP) |

|---|---|---|

| 一致性 | 强一致 | 最终一致 |

| 可用性 | 选举期不可用 | 始终可用 |

| 分区容忍 | 少数派不可写 | 所有节点可读可写 |

| 数据一致性 | 所有节点数据一致 | 节点间数据可能不一致 |

4.2 ZooKeeper vs Consul

| 维度 | ZooKeeper | Consul |

|---|---|---|

| CAP 定位 | CP | CP(但更灵活) |

| 选举机制 | ZAB 协议 | Raft 协议 |

| 读一致性 | 可配置 | 可配置(默认强一致) |

| 健康检查 | 客户端心跳 | 服务端主动检查 |

4.3 ZooKeeper vs etcd

| 维度 | ZooKeeper | etcd |

|---|---|---|

| CAP 定位 | CP | CP |

| 存储模型 | 树形 ZNode | Key-Value |

| 监听机制 | Watcher | Watch |

| 语言 | Java | Go |

五、ZooKeeper CAP 特性的实际应用

5.1 适用场景

基于其 CP 特性,ZooKeeper 适合以下场景:

| 场景 | 原因 |

|---|---|

| 配置中心 | 需要强一致性,避免配置混乱 |

| 服务注册发现 | 需要准确的服务列表 |

| 分布式锁 | 锁状态必须一致 |

| Leader 选举 | 只能有一个 Leader |

5.2 不适用场景

| 场景 | 原因 | 替代方案 |

|---|---|---|

| 高并发缓存 | 读性能瓶颈 | Redis |

| 实时数据同步 | 选举期不可用 | Kafka |

| 最终一致场景 | 过于强的一致要求 | Cassandra |

5.3 如何在应用层面权衡

public class CAPTradeoffExample {

/**

* 根据业务需求选择一致性级别

*/

public byte[] readWithConsistencyLevel(String path,

ConsistencyLevel level) throws Exception {

ZooKeeper zk = getZooKeeper();

switch (level) {

case STRONG:

// 强一致:牺牲部分可用性

zk.sync(path, null, null);

return zk.getData(path, false, null);

case SEQUENTIAL:

// 顺序一致:默认读

return zk.getData(path, false, null);

case EVENTUAL:

// 最终一致:直接读,不保证最新

return zk.getData(path, false, null);

default:

throw new IllegalArgumentException("Unknown consistency level");

}

}

public enum ConsistencyLevel {

STRONG, // 强一致

SEQUENTIAL, // 顺序一致

EVENTUAL // 最终一致

}

}

六、ZooKeeper CAP 特性的验证

6.1 实验一:Leader 故障时的可用性

public class LeaderFailureTest {

public static void main(String[] args) throws Exception {

ZooKeeper zk = new ZooKeeper("localhost:2181", 5000, null);

// 模拟 Leader 故障

System.out.println("开始写入测试...");

for (int i = 0; i < 100; i++) {

try {

zk.create("/test-" + i, ("data" + i).getBytes(),

ZooDefs.Ids.OPEN_ACL_UNSAFE, CreateMode.EPHEMERAL);

System.out.println("写入成功: " + i);

Thread.sleep(1000);

} catch (Exception e) {

System.out.println("写入失败: " + i + ", " + e.getClass().getSimpleName());

}

}

}

}

6.2 实验二:网络分区时的行为

public class PartitionTest {

public static void main(String[] args) throws Exception {

// 连接不同节点

ZooKeeper zk1 = new ZooKeeper("localhost:2181", 5000, null); // Leader

ZooKeeper zk2 = new ZooKeeper("localhost:2182", 5000, null); // Follower

// 模拟网络分区后,少数派节点的行为

try {

zk2.create("/node-in-partition", "data".getBytes(),

ZooDefs.Ids.OPEN_ACL_UNSAFE, CreateMode.PERSISTENT);

} catch (KeeperException.ConnectionLossException e) {

System.out.println("少数派节点无法写入");

}

}

}

七、总结

7.1 ZooKeeper 的 CAP 选择

| 特性 | ZooKeeper 的选择 | 体现 |

|---|---|---|

| 一致性 | ✅ 强一致 | ZXID、ZAB 协议、过半机制 |

| 分区容错性 | ✅ 支持 | 多数派存活即可工作 |

| 可用性 | ❌ 部分牺牲 | 选举期不可用、少数派不可写 |

7.2 CAP 权衡的代价

7.3 一句话总结

ZooKeeper 作为一个典型的 CP 系统,通过牺牲部分可用性(选举期不可用、少数派不可写)换取了强一致性保证,这种权衡使其成为分布式协调服务的理想选择,但也意味着在设计和应用时,必须充分理解并接受这些限制。

|

🌺The End🌺点点关注,收藏不迷路🌺

|

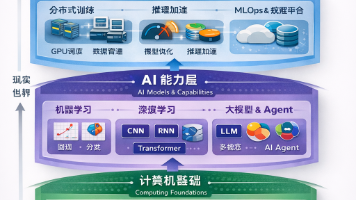

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)