DreamerV3:基于世界模型的通用强化学习算法

本文深入解读 Google DeepMind 与多伦多大学联合发表的 DreamerV3(arXiv:2301.04104v2)论文,该研究提出了首个可在固定超参数下超越各领域专用算法的通用强化学习(RL)算法,通过学习环境的世界模型并结合归一化、平衡、变换等鲁棒性技术,在 150 + 多样化任务中实现 SOTA 性能。DreamerV3 的核心突破在于无需人工数据、无需领域定制化课程,首次从像素输入和稀疏奖励出发,在《我的世界》(Minecraft)中自主从零收集到钻石,攻克了 AI 领域长期以来的开放式世界远瞻策略探索难题。

原文链接:2301.04104

论文链接:https://github.com/danijar/dreamerv3

沐小含持续分享前沿算法论文,欢迎关注...

一、研究背景:强化学习的通用性瓶颈

强化学习已在围棋、Dota 等游戏中实现超人类性能,也是大语言模型超越预训练数据的关键技术,但当前 RL 算法面临通用性缺失的核心瓶颈:

- 专用算法的领域局限性:PPO 虽成为 RL 标准算法,但针对连续控制、离散动作、稀疏奖励、图像输入等不同领域,仍需设计专用算法并大量调参,跨领域迁移时需耗费大量人力、算力进行超参数优化;

- 超参数脆性:将 RL 算法从视频游戏迁移到机器人等新任务时,超参数的微小调整可能导致性能骤降,成为 RL 落地实际应用的关键障碍;

- 开放式世界探索难题:以 Minecraft 钻石收集为代表的任务,存在稀疏奖励、探索难度大、时间跨度长、世界生成随机性强等问题,此前方法均需依赖人类专家数据或领域定制化课程,无法自主从零学习。

为此,研究团队提出DreamerV3,基于世界模型的核心思想,让智能体学习环境的紧凑表征并通过 “想象未来场景” 优化行为,结合一系列鲁棒性技术实现固定超参数跨所有领域的稳定学习,推动 RL 向通用化、实用化迈进。

二、算法核心框架:世界模型 + 演员 - 评论家的三级架构

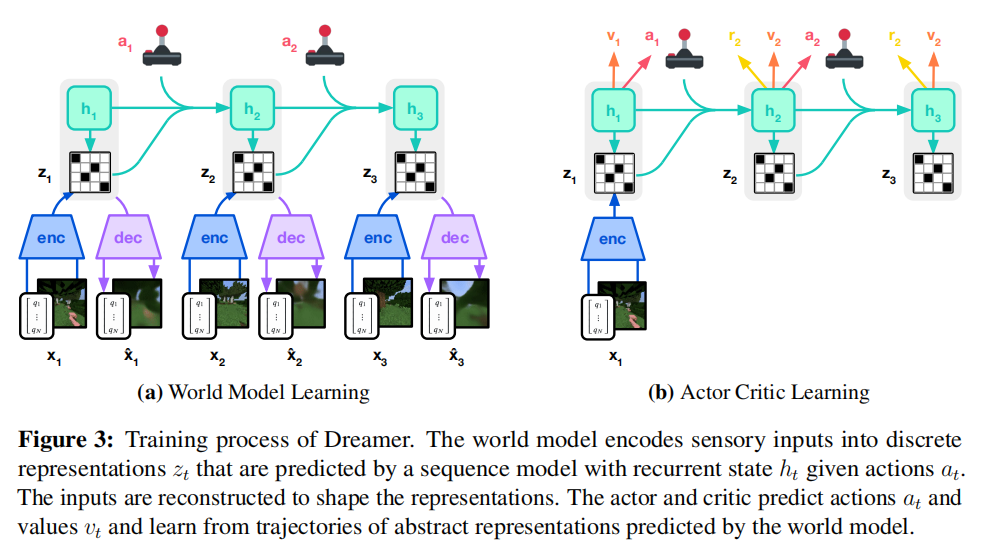

DreamerV3 是 Dreamer 算法的第三代版本,前两代分别实现了连续控制(V1)、Atari 游戏超人类性能(V2),V3 则完成了全领域通用化升级。算法由世界模型、评论家网络、演员网络三大核心组件构成,三者从重放经验中进行并行训练,智能体与环境交互时仅通过演员网络采样动作,无需前瞻规划。整体训练流程如图 3 所示。

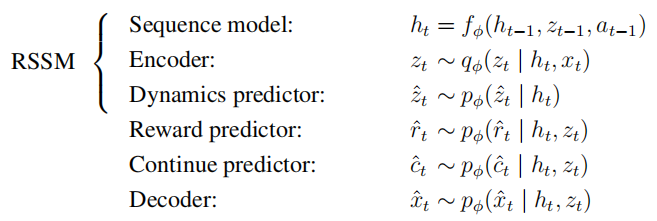

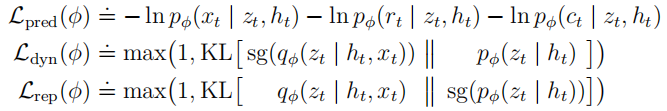

2.1 世界模型学习:构建环境的可预测表征

世界模型的核心目标是将感官输入编码为紧凑的随机表征,并预测潜在动作的未来表征与奖励,为后续的 “想象训练” 提供基础。研究采用循环状态空间模型(RSSM) 实现世界模型,其由序列模型、编码器、动力学预测器、奖励预测器、继续预测器、解码器六大模块组成,数学定义如下:

其中:

为序列模型的循环状态,由上一时刻的

、

和动作

生成;

为编码器对感官输入

的随机表征,由循环状态

条件化生成;

分别为动力学预测的下一时刻表征、奖励、回合继续标志、输入重构结果。

分别为动力学预测的下一时刻表征、奖励、回合继续标志、输入重构结果。

2.1.1 网络实现细节

- 针对图像输入,编码器 / 解码器使用卷积神经网络(CNN);针对向量输入,使用多层感知机(MLP);

- 动力学、奖励、继续预测器均为 MLP;表征

从 softmax 分布向量中采样,并通过直通梯度保留采样步骤的梯度信息;

- 序列模型采用分块门控循环单元(Block GRU),将循环权重分为 8 个块,避免参数量与计算量的二次增长,同时支持大尺寸记忆单元。

2.1.2 损失函数设计:多目标联合优化

世界模型的参数 通过最小化预测损失

、动力学损失

、表征损失

进行端到端优化,总损失如下:

![]()

其中损失权重固定为![]() =1、

=1、![]() =1、

=1、![]() =0.1,各损失的具体定义与作用如下:

=0.1,各损失的具体定义与作用如下:

- 预测损失

:训练解码器和奖励预测器(symlog 平方损失)、继续预测器(逻辑回归),确保模型能准确重构输入并预测奖励与回合状态;

- 动力学损失

:最小化动力学预测分布

与编码器生成分布

与编码器生成分布 的 KL 散度,训练序列模型预测下一时刻表征;

的 KL 散度,训练序列模型预测下一时刻表征; - 表征损失

:与动力学损失反向的 KL 散度,训练表征变得更可预测,便于想象训练中的快速采样。

2.1.3 鲁棒性优化:解决 KL 散度退化与表征过拟合

为避免动力学 / 表征损失极小化导致的解退化(如表征无信息但易预测),研究引入自由比特(Free Bits),将 KL 损失下界限制为 1 nat(≈1.44 bits),当损失已足够小的时候禁用,让学习聚焦于预测损失;同时,为解决深度变分自编码器中常见的KL 损失尖峰问题,将编码器和动力学预测器的分类分布设置为99% 网络输出 + 1% 均匀分布的混合,避免分布确定性导致的无穷对数概率。

2.2 评论家网络学习:预测回报分布的鲁棒估值

评论家网络的核心是从世界模型预测的抽象表征轨迹中,学习回报分布的近似,为演员网络提供价值指导。与传统评论家不同,DreamerV3 的评论家需处理跨领域回报数量级差异大、分布多模态的问题,因此采用了一系列鲁棒性设计。

2.2.1 回报估计:Bootstrapped λ- 回报

为考虑超出预测视野(T=16)的奖励,评论家基于当前演员行为,为每个模型状态预测回报分布,模型状态定义为![]() ,回报分布函数为

,回报分布函数为![]() (其中

(其中![]() ,折扣因子

,折扣因子=0.997)。实际训练中采用Bootstrapped λ- 回报整合预测奖励与价值,估计回报

:

![]()

其中 =0.95,

![]() 为回报分布的期望。

为回报分布的期望。

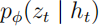

2.2.2 分布参数化:Symexp Twohot 损失

传统正态分布无法适配多模态回报,因此研究将评论家参数化为指数间隔分箱的分类分布,并使用Symexp Twohot 损失训练,核心优势是将梯度尺度与预测目标解耦:

- 网络输出 softmax 分布的 logits,分箱

,预测值

,预测值 ;

; - 对连续目标

进行Twohot 编码(广义独热编码),仅在最接近

的两个分箱处赋值,权重与距离成线性关系;

- 采用分类交叉熵损失训练,损失仅依赖分箱概率,与目标绝对值无关。

2.2.3 训练稳定性优化

- 双轨迹损失:同时在想象轨迹(损失尺度

)和重放缓冲区轨迹(损失尺度

)和重放缓冲区轨迹(损失尺度 )上训练,提升奖励难预测环境中的价值估计精度;

)上训练,提升奖励难预测环境中的价值估计精度; - EMA 正则化:将评论家正则化到其参数的指数移动平均输出,类似目标网络但允许使用当前评论家计算回报;

- 零初始化输出权重:奖励预测器和评论家的输出权重矩阵初始化为 0,避免训练初期的虚假大奖励预测,加速早期学习。

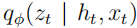

2.3 演员网络学习:归一化回报的熵正则化策略

演员网络的目标是选择最大化回报的动作,同时通过熵正则化保证探索性。核心挑战是熵正则化的尺度需适配不同领域的奖励稀疏性 / 密度,DreamerV3 通过回报归一化实现了固定熵尺度(η=3×10−4)的跨领域探索。

2.3.1 回报归一化:鲁棒的尺度适配

为让回报近似落在 [0,1] 区间,仅对超过阈值 L=1 的大回报进行缩放,避免稀疏奖励下的函数近似噪声放大,缩放因子 计算为:

![]()

即回报批次的 5% 到 95% 分位数之差的指数移动平均,鲁棒性抵御异常值(如随机环境中的高回报 episode)。

2.3.2 损失函数:Reinforce 估计的熵正则化

演员网络对离散和连续动作均使用Reinforce 梯度估计,代理损失函数为:

![]()

其中:

为停止梯度操作,避免价值估计的梯度影响演员;

为动作分布的熵,保证探索性;

- 演员的分类分布同样采用99% 网络输出 + 1% 均匀分布的混合,避免零概率。

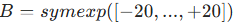

2.4 通用鲁棒预测技术:Symlog/Symexp 变换

针对跨领域输入 / 奖励 / 回报的数量级差异,研究提出symlog-symexp变换对目标进行预处理,解决了平方损失的发散问题、绝对损失 / Huber 损失的学习停滞问题,以及基于运行统计的归一化带来的非平稳性问题。

2.4.1 Symlog 变换:对称对数压缩

Symlog 属于双对称对数家族,对正负大值均进行压缩,原点附近近似恒等变换,保留小目标的学习精度,定义为:

![]()

2.4.2 Symexp 变换:逆变换还原

Symexp 为 symlog 的逆变换,将压缩后的目标还原为原始尺度,定义为:

![]()

2.4.3 应用场景

- 向量观测的编码器输入和解码器目标均使用 symlog 变换,防止大输入导致的重构梯度爆炸;

- 奖励预测器和评论家使用symexp Twohot 损失,结合变换与分箱实现无尺度依赖的预测。

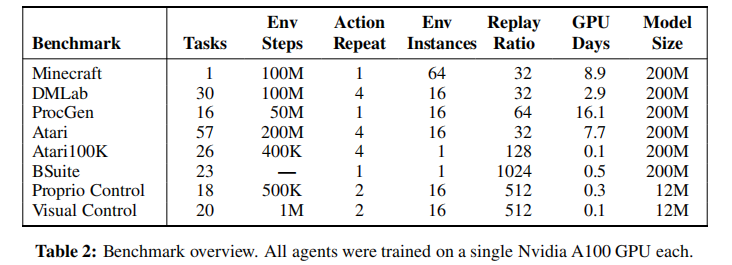

三、实验设计与结果:固定超参数横扫 150 + 任务

研究在8 大领域、150 + 多样化任务中验证 DreamerV3 的通用性,任务涵盖连续 / 离散动作、视觉 / 低维输入、稠密 / 稀疏奖励、2D/3D 环境、过程生成世界,同时对比了各领域的 SOTA 专用算法、标准 PPO(Acme 框架高质量实现,固定超参数),并在 Minecraft 中验证开放式世界探索能力。所有 DreamerV3 智能体均在单张 Nvidia A100 GPU上训练,保证可复现性。

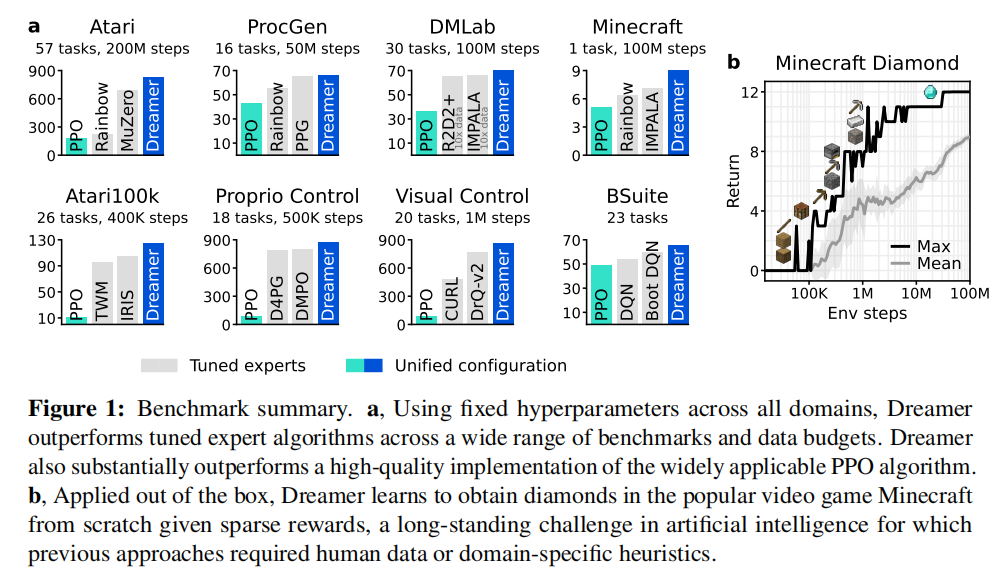

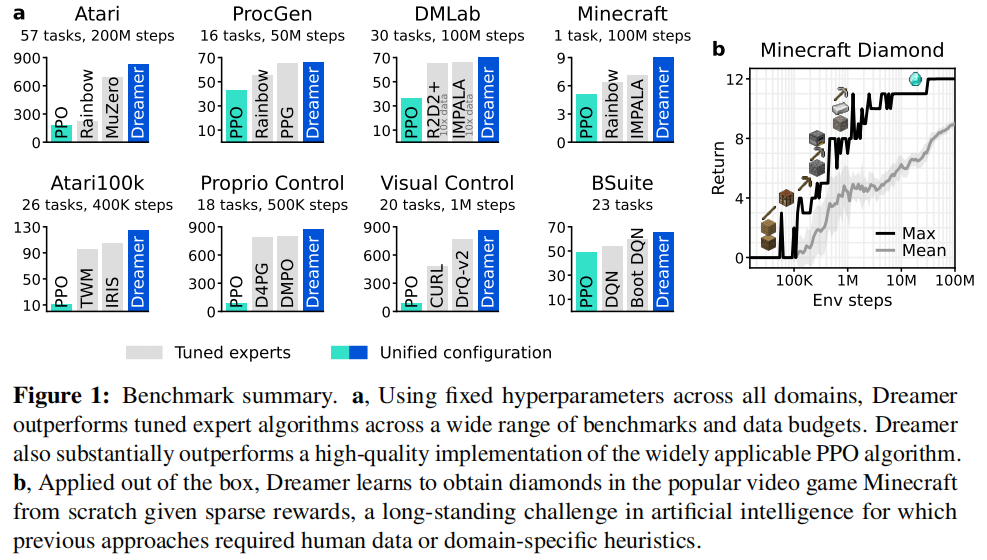

3.1 基准测试总览:超越调优专家算法与 PPO

图 1 为基准测试结果汇总:

核心结论为:

- 固定超参数的通用性:DreamerV3 在所有领域使用完全相同的超参数,超越为各基准专门调优的专家算法(如 Atari 的 MuZero、ProcGen 的 PPG、DMLab 的 IMPALA/R2D2+);

- 显著优于 PPO:在所有领域均大幅超越固定超参数的高质量 PPO 实现,证明世界模型的范式优势;

- Minecraft 钻石收集:首次实现无人工数据、无定制课程的从零钻石收集,而其他算法最多仅能获得铁镐,无法突破到钻石阶段。

3.2 各领域详细实验结果

研究对 8 大领域逐一进行验证,关键领域的核心结果如下:

3.2.1 Atari:超越 MuZero 且算力更低

- 任务:57 个 Atari 2600 游戏,2 亿帧预算,粘性动作设置;

- 结果:DreamerV3 超越性能强劲的 MuZero,且仅使用其一小部分算力,同时优于 Rainbow、IQN 等经典 Atari 算法;

- 关键指标:玩家中位数得分达 3716%、玩家均值得分达 3381%,大幅领先 PPO(180%、892%)和 MuZero(693%、3054%)。

3.2.2 DMLab:数据效率提升 1000%+

- 任务:30 个 3D 空间推理任务,1 亿帧预算;

- 结果:DreamerV3 在 1 亿帧的性能超过 IMPALA/R2D2 + 在 10 亿帧的性能,数据效率提升超 1000%;

- 核心优势:在语言交互、空间探索等需要长程推理的任务中表现突出,如 “Language Select Described Object” 任务得分 665.5,接近人类水平。

3.2.3 ProcGen:匹配 PPG 且超越 PPO

- 任务:16 个过程生成游戏,5 千万帧预算,高难度设置;

- 结果:DreamerV3 的归一化均值得分 66.01,匹配专门调优的 PPG(64.89),并超越固定超参数的 PPO(42.80),在 Plunder、Starpilot 等任务中实现 SOTA。

3.2.4 控制任务:Proprio/Visual Control 双 SOTA

- 本体感受控制:18 个连续控制任务(经典控制、移动、机器人操作),50 万步预算,DreamerV3 任务均值 871,超越 D4PG(792)、DMPO(801);

- 视觉控制:20 个仅图像输入的连续控制任务,100 万步预算,DreamerV3 任务均值 861,超越专为视觉环境设计的 DrQ-v2(770)、CURL(479),证明世界模型对高维视觉输入的高效处理能力。

3.2.5 Atari100k:低数据预算下的高效学习

- 任务:26 个 Atari 游戏,仅 40 万帧预算(约 2 小时游戏时间);

- 结果:在不使用在线规划、数据增强、非均匀重放等技巧的情况下,DreamerV3 的玩家均值得分达 125%,超越 IRIS(105%)、TWM(96%)等 SOTA 算法,仅略低于使用环境配置修改的 EfficientZero(190%)。

3.2.6 BSuite:奖励尺度鲁棒性最优

- 任务:23 个测试信用分配、探索、记忆、奖励尺度鲁棒性的环境,468 种配置;

- 结果:DreamerV3 总任务均值 66%,超越 Boot DQN(60%)、DQN(54%)、PPO(49%),在奖励尺度鲁棒性和记忆类别中表现最优,解决了传统 RL 算法对奖励缩放敏感的问题。

3.3 核心突破:Minecraft 从零收集钻石

Minecraft 钻石收集是 RL 领域的圣杯级任务,其挑战在于:

- 无限随机生成的 3D 世界,每个 episode 均为唯一环境;

- 稀疏奖励:仅在解锁 12 个技术树节点(原木→木板→木棍→工作台→木镐→石块→石镐→铁矿→熔炉→铁锭→铁镐→钻石)时获得 + 1 奖励;

- 长时程探索:人类玩家需约 20 分钟获得钻石,智能体需在 36000 步(30 分钟)内完成多步规划;

- 动作空间与环境复杂性:需要处理第一人称视觉、物品栏、生命值、饥饿值等多维度观测,以及方块挖掘、合成、移动等动作。

3.3.1 实验设置

- 基于 MineRL v0.4.4 构建环境,移除原环境的提前终止条件(避免打破钻石矿后未收集到钻石即结束);

- 观测:64×64×3 第一人称图像、400 + 物品的物品栏向量、里程碑标记、装备的独热向量、健康 / 饥饿 / 呼吸标量;

- 奖励:12 个技术树节点各 + 1,生命值变化 ±0.01,无其他奖励;

- 训练:1 亿环境步,64 个环境实例,单 A100 GPU 训练 8.9 天,完全使用默认超参数,无任何调优。

3.3.2 关键结果

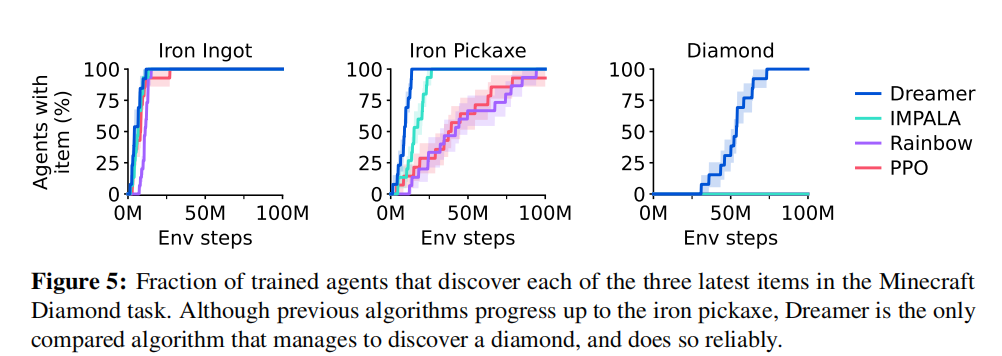

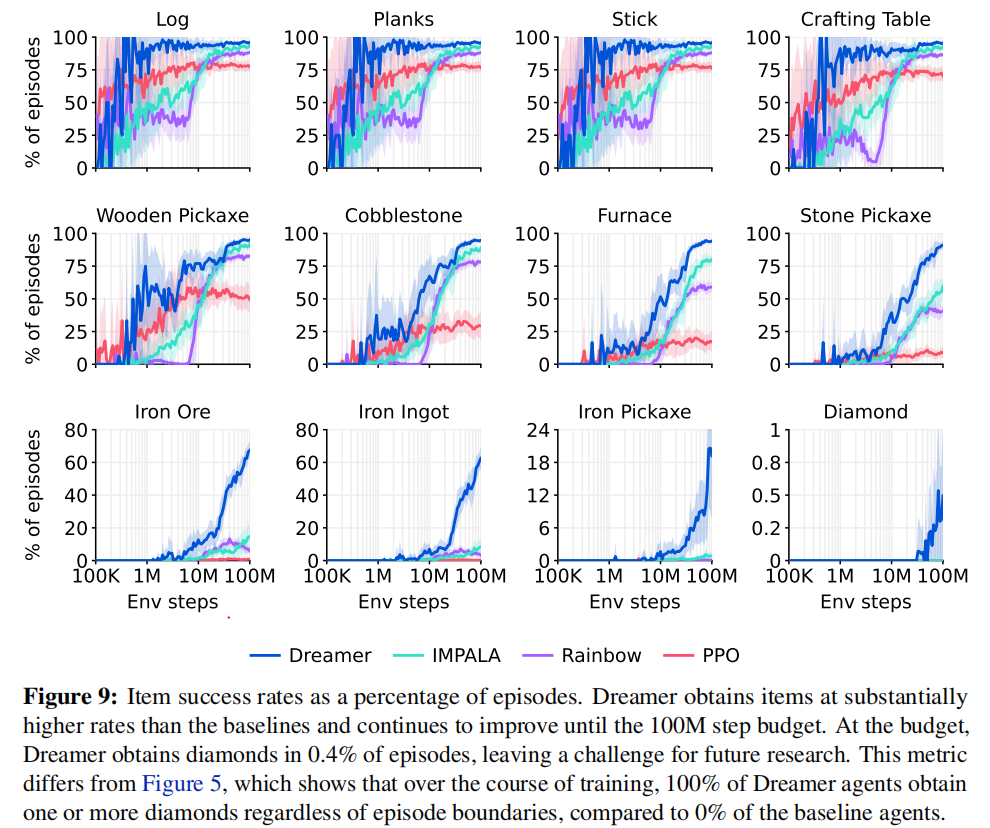

- 技术树解锁:图 5 和图 9 显示,DreamerV3 是唯一能解锁钻石的算法,100% 的训练智能体在 1 亿步内收集到钻石,而 IMPALA、Rainbow、PPO 最多仅能获得铁镐;

- 得分领先:1 亿步时 DreamerV3 的回报达 9.1,远超 IMPALA(7.1)、Rainbow(6.3)、PPO(5.1);

- 物品获取率:DreamerV3 在所有技术树节点的获取率均显著高于基线,钻石的 episode 获取率达 0.4%(图 9),证明其在稀疏奖励下的长程探索能力。

3.3.3 世界模型的可视化验证

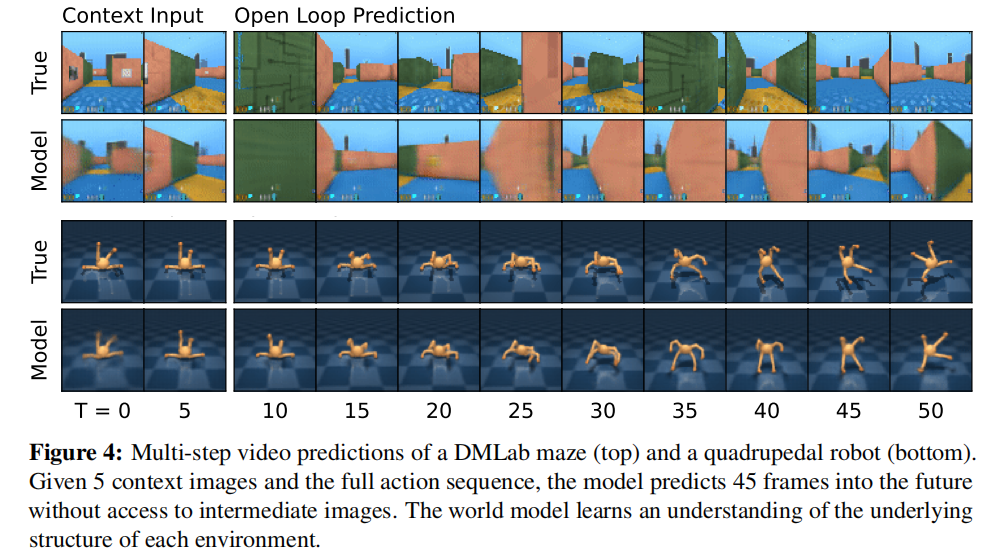

图 4(如下)和图 7(见原文)展示了世界模型的多步视频预测能力:给定 5 帧上下文输入和动作序列,模型能无中间观测预测 45 帧未来画面,准确捕捉 DMLab 迷宫、四足机器人、Minecraft 的环境结构与动态,证明世界模型真正学习到了环境的底层规律。

四、消融实验与缩放分析:鲁棒性技术与模型缩放的重要性

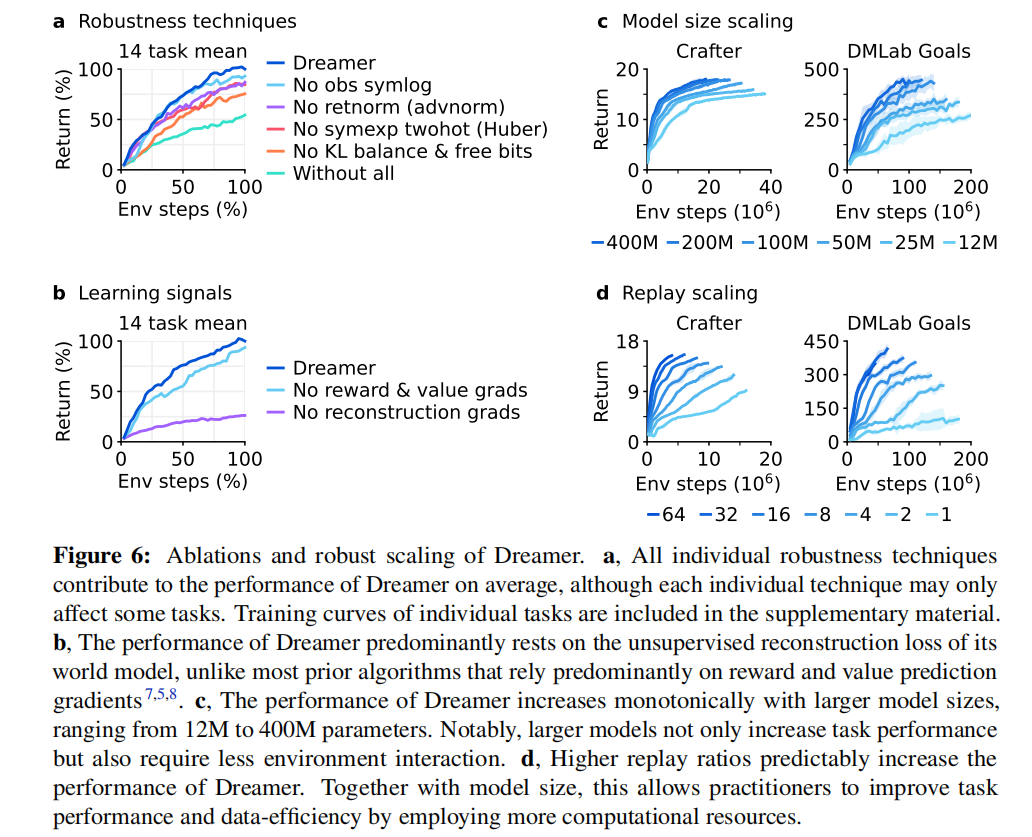

研究通过消融实验验证各鲁棒性技术的作用,通过模型尺寸 / 重放比缩放分析 DreamerV3 的可扩展性,结果如图 6 所示。

4.1 鲁棒性技术消融:所有组件均贡献领域性能

对观测 symlog、回报归一化、symexp Twohot、KL 平衡 + 自由比特四大核心鲁棒性技术进行消融,核心结论:

- 无单一技术是万能的,但所有技术均不可或缺:每个技术仅对部分任务关键,但移除任意技术都会导致整体性能下降,移除所有技术后性能骤降;

- KL 平衡 + 自由比特影响最大:世界模型的 KL 损失优化是跨领域稳定学习的核心,移除后会导致表征退化,无法为想象训练提供有效信息;

- 回报归一化与 symexp Twohot 次之:解决了跨领域回报尺度差异和多模态问题,是演员 / 评论家网络稳定学习的关键。

4.2 学习信号消融:世界模型的无监督重构是核心

对比移除奖励 + 价值梯度、移除重构梯度的消融结果,发现:

- DreamerV3主要依赖世界模型的无监督重构损失塑造表征,而非传统 RL 的任务特定奖励 / 价值梯度;

- 移除重构梯度后性能大幅下降,而移除奖励 + 价值梯度后性能仅小幅下降,证明无监督表征学习是其通用化的关键,为后续利用无监督数据预训练奠定基础。

4.3 模型尺寸缩放:更大模型 = 更高性能 + 更高数据效率

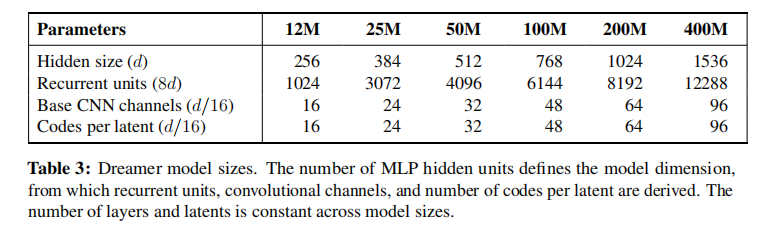

训练12M、25M、50M、100M、200M、400M六种参数量的模型,核心结论:

- 性能随模型尺寸单调提升:400M 模型在所有任务中均显著优于小模型;

- 更大模型需要更少的环境交互:大模型的数据效率更高,能在更少的环境步中达到小模型的性能,实现 “算力换数据”;

- 固定超参数的鲁棒性:所有尺寸的模型均使用完全相同的超参数,无任何调优,证明 DreamerV3 的超参数设计具有极强的鲁棒性。

4.4 重放比缩放:更高重放比 = 更好的性能

重放比定义为每收集 1 步环境数据,训练的步数,结果显示:

- 性能随重放比提升而单调增加,更高的重放比意味着更多的梯度更新,能更充分地利用已收集数据;

- 重放比与模型尺寸的结合,为实践者提供了可预测的性能提升路径:通过增加算力(更大模型、更高重放比),可稳定提升任务性能和数据效率。

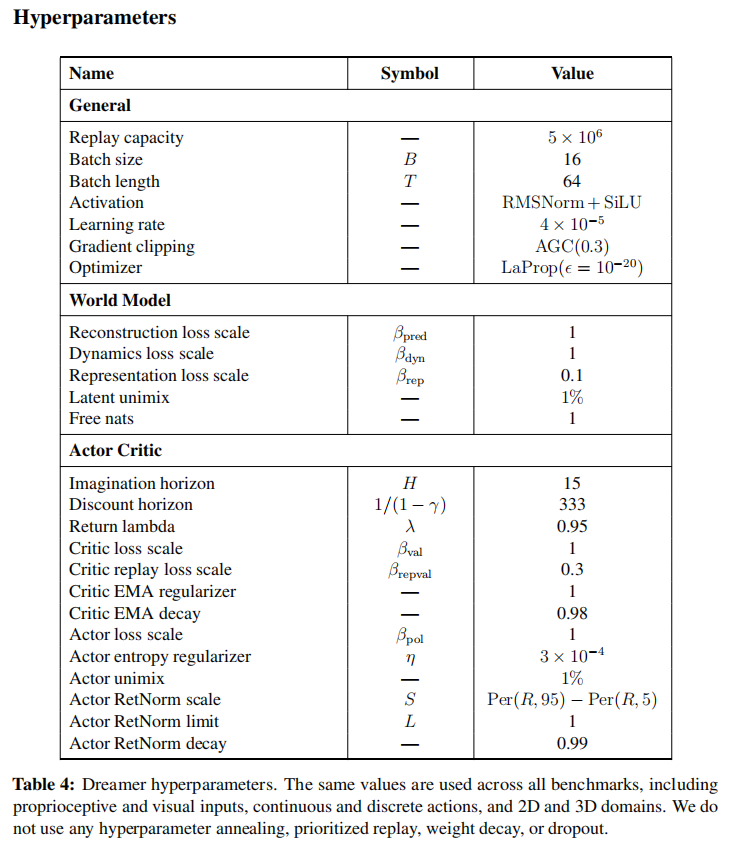

五、实现细节:超参数、网络、训练配置

DreamerV3 的全领域固定超参数是其通用化的核心,研究公开了所有实现细节,包括超参数、网络架构、训练配置,保证可复现性。

5.1 核心超参数

所有领域共享的超参数关键值:

- 学习率:

;

- 折扣因子

(对应折扣视野 333 步);

- 演员熵正则化:

;

- 想象视野

;

- 自由比特:1 nat;

- 重放缓冲区容量:

;

- 批次大小 / 长度:

。

5.2 网络架构

模型尺寸由MLP 隐藏尺寸 定义,其他组件尺寸由

推导:

- 循环单元:

(分 8 个块);

- CNN 基础通道数:

;

- 每个潜在的码数:

;

- 激活函数:RMSNorm + SiLU;

- 优化器:LaProp(RMSProp + 动量),结合自适应梯度裁剪(AGC,阈值

)。

5.3 训练配置

各领域的训练配置(如环境步、动作重复、重放比、GPU 天数)均根据任务特性调整,但算法超参数保持不变,例如:

- Minecraft:1 亿步,动作重复 1,重放比 32,GPU 天数 8.9,模型 200M;

- Atari:2 亿步,动作重复 4,重放比 32,GPU 天数 7.7,模型 200M;

- 控制任务:50 万 / 100 万步,动作重复 2,重放比 512,模型 12M(轻量化仍保性能)。

5.4 经验重放

使用均匀重放缓冲区 + 在线队列,每个小批次由非重叠的在线轨迹和均匀采样的重放轨迹组成;将潜在状态存储到重放缓冲区,为重放轨迹初始化世界模型,避免重复编码,提升训练效率。

六、相关工作对比

将 DreamerV3 与当前主流的通用 / 专用 RL 算法对比,核心优势如表所示:

DreamerV3 是唯一同时满足固定超参数、无人工数据、单 GPU 训练、开放实现的通用 RL 算法,填补了传统 RL 算法 “专用化” 与 “通用化” 之间的空白。

七、结论与未来方向

7.1 核心结论

- 通用 RL 算法的实现:DreamerV3 通过世界模型 + 鲁棒性技术,实现了固定超参数下超越各领域专用调优算法的突破,在 150 + 多样化任务中验证了通用性;

- 开放式世界的突破:首次在 Minecraft 中无人工数据、无定制课程从零收集到钻石,攻克了稀疏奖励、长时程探索、随机生成世界的 RL 难题;

- 无监督表征的核心价值:DreamerV3 主要依赖世界模型的无监督重构损失塑造表征,而非任务特定奖励,为 RL 与无监督预训练的结合开辟了新方向;

- 可预测的缩放性:模型尺寸和重放比的单调缩放特性,为实践者提供了明确的性能提升路径,推动 RL 向工程化、实用化迈进。

7.2 未来研究方向

- 从互联网视频学习世界知识:利用大规模无标注视频预训练世界模型,进一步提升智能体的先验知识和跨领域迁移能力;

- 跨领域统一世界模型:学习单个世界模型适配所有领域,让智能体积累通用的世界知识,实现更广泛的任务泛化;

- 与大语言模型的结合:将世界模型的视觉 / 环境推理与大语言模型的符号 / 逻辑推理结合,提升开放式世界的决策能力;

- 机器人落地:利用 DreamerV3 的低数据效率和通用化特性,推动 RL 在真实机器人任务中的落地,减少对人工演示和领域调参的依赖。

八、论文核心创新点总结

- 算法层面:提出第三代 Dreamer 算法,构建世界模型 + 演员 - 评论家的三级架构,通过想象训练实现无前瞻规划的高效决策;

- 鲁棒性技术:提出symlog/symexp 变换、KL 平衡 + 自由比特、回报分位数归一化、Symexp Twohot 损失等一系列鲁棒性技术,解决了跨领域的尺度差异、表征退化、梯度爆炸等问题;

- 无监督表征学习:证明 RL 算法可主要依赖无监督重构损失塑造环境表征,打破了传统 RL 对任务特定奖励的依赖;

- 实验突破:首次实现 Minecraft 无人工数据的钻石收集,成为 RL 领域开放式世界学习的重要里程碑;

- 工程化实现:提供了全领域固定的超参数和单 GPU 可复现的实现方案,为通用 RL 的研究和落地奠定了工程基础。

DreamerV3 的出现标志着 RL 从 “专用算法” 向 “通用算法” 迈出了关键一步,其基于世界模型的范式和鲁棒性技术设计,为后续通用人工智能的研究提供了重要的参考方向。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)