以联邦学习筑移动安全防线:实现数据隐私与模型进化双赢

当AI深入移动安全的核心,一个根本性问题浮现:如何在不侵犯用户隐私的前提下,让安全模型持续进化?数据是AI的燃料,但用户数据又是最敏感的资产。“数据可用不可见”成为移动EDR产品的必然选择。今天,我们将深入解析联邦学习在移动安全领域的落地实践。

一、移动安全的隐私悖论

1.1 安全与隐私的天然张力

传统安全产品依赖“数据回传”:终端采集行为信息,上传云端分析,形成威胁情报。这种方式虽然有效,却带来了隐私风险:

用户行为被全面监控

敏感数据可能泄露

合规要求日益严格(GDPR、个人信息保护法)

1.2 数据孤岛与AI进化的矛盾

另一方面,AI模型需要海量多样本才能保持对新威胁的敏感度。如果数据无法出终端,云端就变成“瞎子”,模型将停滞不前。

这就形成了一个悖论:既要数据训练,又要隐私保护。

二、联邦学习:让数据不动模型动

2.1 联邦学习的核心思想

联邦学习(Federated Learning)颠覆了传统的集中式训练范式:

数据不动:原始数据始终留在用户终端

模型动:云端将全局模型下发至终端

本地训练:终端用本地数据训练模型,生成梯度更新

加密聚合:仅上传加密的梯度,云端聚合形成新模型

整个过程如同“取经”而非“搬经”——只传递知识,不搬运数据。

2.2 联邦学习工作流程

第1步:云端初始化全局模型

第2步:选择一批终端下发模型

第3步:终端用本地数据训练,计算梯度

第4步:终端加密梯度上传至云端

第5步:云端聚合所有梯度,更新全局模型

第6步:重复2-5步,直至收敛

在我们的EDR产品中,这一流程每日循环,持续进化。

三、技术深潜:我们如何实现隐私保护

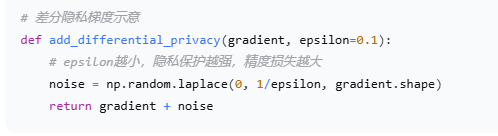

3.1 差分隐私:给梯度加“噪音”

仅上传梯度并非绝对安全,研究证明梯度可能反推原始数据。我们引入差分隐私技术:

在梯度计算过程中注入精心设计的随机噪声

使得攻击者无法区分梯度来自哪条具体数据

在隐私保护与模型精度之间取得平衡

3.2 安全聚合:加密的梯度上传

即使梯度加了噪音,传输过程仍需保护。我们采用安全多方计算技术:

终端使用同态加密对梯度进行加密

云端在加密域直接进行聚合计算

只有最终聚合结果可解密,单个终端梯度永不可见

3.3 本地差分隐私:双重保险

我们在终端侧还实施了本地差分隐私,即在数据采集阶段就注入噪音,实现端到端的隐私保障。

四、落地实践:从理论到产品

4.1 终端侧的轻量级训练

移动设备算力有限,如何在端侧高效训练?

模型裁剪:仅训练最后几层,冻结底层通用特征

量化训练:使用8位整数而非32位浮点

硬件加速:利用NPU进行训练加速

我们的EDR终端可在不影响用户体验的前提下,完成每日模型微调。

4.2 通信效率优化

联邦学习需要频繁上下行通信,对网络有要求。我们采用:

梯度压缩:只上传显著变化的梯度(稀疏化)

周期聚合:根据用户活跃度动态调整上传频率

Wi-Fi only:仅在Wi-Fi下进行联邦学习,避免消耗移动数据

4.3 参与方选择策略

并非所有终端都适合参与训练。我们建立了终端信誉评分系统:

选择电量充足、空闲状态的设备

排除行为异常的可疑设备(防止投毒攻击)

确保参与终端多样性,避免数据偏差

五、挑战与应对

5.1 投毒攻击与鲁棒性

恶意用户可能上传恶意梯度,破坏全局模型。我们通过以下方式防御:

梯度验证:检查梯度范数是否异常

拜占庭容错聚合:使用中位数而非均值聚合

终端信誉管理:持续参与且贡献良好的终端获得更高权重

5.2 非独立同分布数据

不同用户的行为模式差异巨大,导致数据分布不一致。我们采用:

个性化分层:为用户群体建立多个基础模型

元学习:让模型学会快速适应新用户

增量学习:在用户本地进行个性化微调

5.3 合规与监管

联邦学习并非法外之地,仍需满足法律法规:

用户知情同意:明确告知联邦学习的用途

可解释性:当模型做出决策时,能追溯原因

数据最小化:只收集必要的行为特征

六、成效:联邦学习带来的改变

6.1 检测能力的持续提升

自部署联邦学习以来,我们的EDR模型实现了:

每周模型更新,新威胁检出率提升15%

对地域性新型攻击的响应时间从周级降至天级

模型泛化能力增强,变种攻击绕过率下降40%

6.2 隐私合规的从容应对

得益于“数据不动”的设计:

从未发生用户数据泄露事件

顺利通过多项第三方隐私审计

用户信任度显著提升

七、未来方向:从联邦到去中心化

联邦学习仍依赖中央服务器,存在单点风险。我们正探索去中心化联邦学习:

终端之间直接交换梯度

基于区块链的共识机制

实现真正无中心的隐私保护AI

八、结语:隐私不是障碍,而是基石

在移动安全领域,隐私不应成为AI进化的绊脚石,而应成为信任的基石。联邦学习让我们实现了“数据可用不可见”——既让模型持续学习新威胁,又让用户数据始终掌握在自己手中。

这正是我们和中科技神雕EDR产品的核心理念:用最先进的技术守护用户,用最严格的方式尊重用户。

未来,我们将继续探索AI与安全的深度融合,为用户提供更智能、更安心的防护体验。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)