【DAY1】安装openclaw+配置模型

背景

最近openclaw很火,就来体验一下,有人刚开始部署后可能很多人就直接上场景测试了,会觉得这不就是一个很贵的模型聊天工具吗?是的,刚开始我体验下来也是,后来发现还是有很多东西需要自己去慢慢了解的,去配置的,所以才叫养虾嘛,不要着急慢慢来吧。记录一下历程。

DAY1内容

主要是安装openclaw,配置了一些模型,重点是模型的配置,因为都是白嫖的,所以需要折腾一下。配置了硅基流动和ollama。后面会写具体的配置。

我的电脑环境是Windows11

1.简单介绍下openclaw

是什么

本质是一个AI 智能体框架(执行引擎),不自带大模型,可接入 GPT、Claude、Llama、豆包等任意大模型当 “大脑”。

核心能力有:

本地部署:数据全在你设备,不上传第三方,隐私可控。

系统级执行:直接操作电脑 —— 文件管理、浏览器自动化、代码运行、设备控制。

多渠道交互:通过 Telegram、Discord、飞书等聊天软件发指令。

技能化扩展:像装 App 一样安装 / 卸载 Skill(技能),实现定制化能力。

OpenClaw = 自选大模型 + 本地执行引擎 + 技能生态 + 持久记忆。

为什么叫龙虾

Claw =爪子、螯,是龙虾最标志性的身体部位。

以前叫ClawdBot、Moltbot,都和 “爪 / 螯” 相关,他能干活,有执行力跟这个龙虾也有点关系吧

与普通对话大模型的区别

openClaw:可以动手完成任务。

普通对话大模型:例如豆包等只能回答问题、生成内容。

| 对比维度 | OpenClaw | 对话大模型(如豆包) |

|---|---|---|

| 核心定位 | AI 执行框架/智能体(执行者) | 对话大模型/问答助手(思考者) |

| 执行能力 | 直接操作电脑:文件、浏览器、代码、设备 | 仅输出文字/方案,无法触碰你的设备 |

| 运行方式 | 本地部署,数据自托管,断网可用 | 云端服务,必须联网,数据上传厂商服务器 |

| 交互模式 | 目标驱动:给目标→自主拆步骤→执行→反馈 | 被动应答:你问我答,单次对话为主 |

| 记忆与状态 | 持久记忆,记住偏好、历史任务,跨会话可用 | 短期记忆,关闭会话后历史丢失 |

| 扩展方式 | 安装/卸载 Skill(技能),高度定制 | 固定能力,由厂商更新,用户无法自定义执行逻辑 |

| 数据隐私 | 全本地存储,隐私完全自主可控 | 依赖厂商云端存储,隐私由服务商政策决定 |

| 适用场景 | 自动化、批量任务、系统操作、数字助理 | 问答、写作、翻译、知识查询、创意生成 |

| 一句话总结 | 动口又动手,直接帮你做完整个任务 | 动口不动手,给你答案和方法,需你手动执行 |

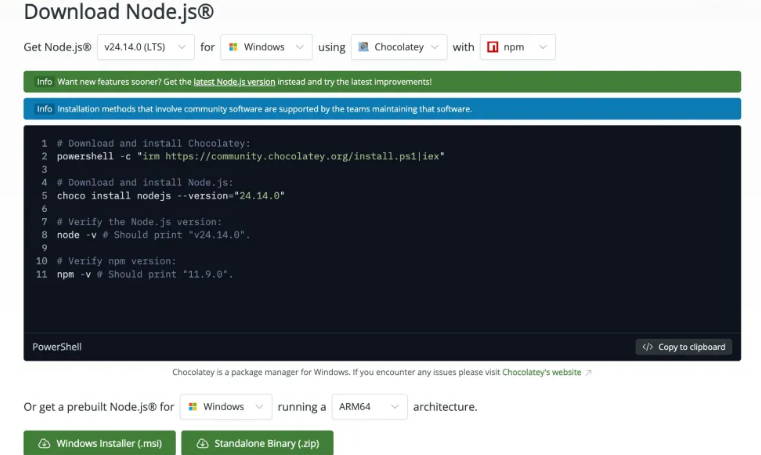

2.安装nodejs

为什么安装:OpenClaw是用JavaScript这门编程语言写的。但你的电脑原生不认识JavaScript,Node.js就是这个翻译官,它把JavaScript"翻译"成你的电脑听得懂的机器语言,让OpenClaw能在你的电脑上跑起来。

版本要求:Node.js >= 22。

下载地址:https://nodejs.org/en/download

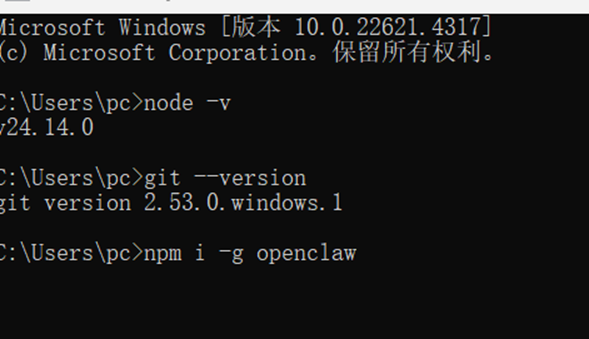

下载安装后,按 Win + R,输入cmd,再输入命令验证是否安装成功和查看版本号:node -v

2.安装git

为什么安装git: OpenClaw 是开源项目,代码、依赖的技能 / 组件都托管在 Git 代码仓库(如 GitHub/GitLab),Git 是获取更新这些资源的核心工具

下载地址:Git-scm.com/install/windows

验证命令:git –version

3. 安装openclaw

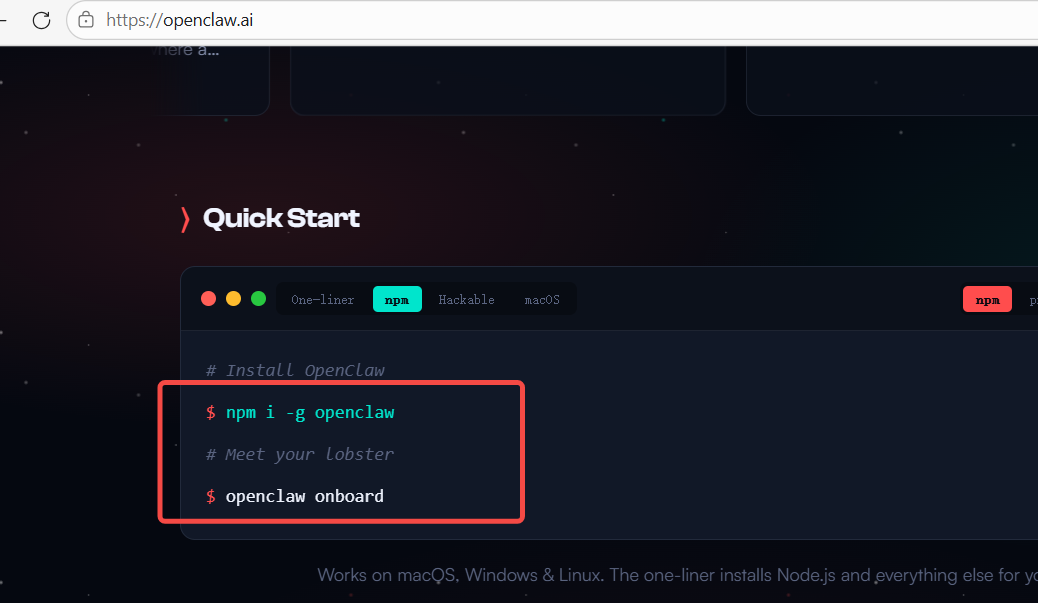

官网地址:https://openclaw.ai/

这里有写怎么装

直接Win+R 输入cmd,然后输入下面这个就可以

npm i -g openclaw

正常的就要进入到下一步了,但是我安装的时候会报错。说什么npm error

然后我就换了powershell的方式安装

直接Win+R 输入powershell,然后输入:iwr -useb https://openclaw.ai/install.ps1 | iex

就开始自己下载安装了

如果没权限先执行下这个再执行上面的:Set-ExecutionPolicy -ScopeCurrentUser -ExecutionPolicy RemoteSigned

安装后验证是否安装成功可以输入这个命令查看:openclaw --version

**备注:**如果还是报错的话可以去官网搜一下 Visual Studio Build Tools,下载安装的时候选吧这个安装一下:使用 C++ 的桌面开发"工作负载

安装后再重试一下powershell安装

4. 初始化配置

输入openclaw onboard

开始配置刚开始选接受风险

后面的按照自己需求选择,看不懂的可以翻译。

我这里基本上都是默认配置,模型渠道技能这些都先选择跳过了。后面自己配置。

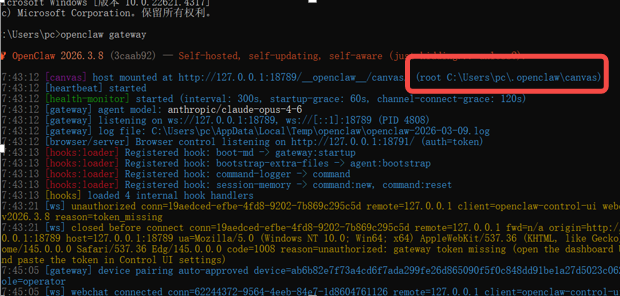

5.启动openclaw的网关

网关启动后才可以通过浏览器访问

启动命令:openclaw gateway

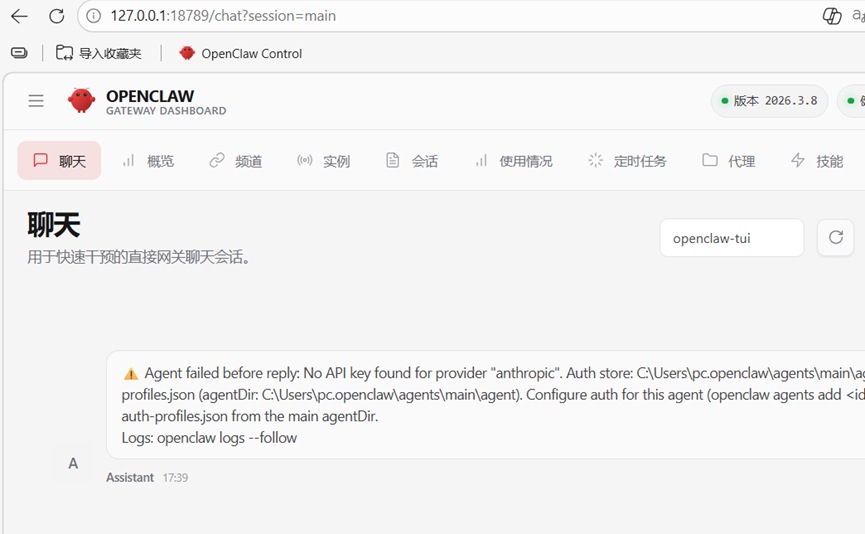

6.访问OPENCLAW

打开浏览器输入:

http://127.0.0.1:18789/chat?session=main

如果第一次如果没有token需要到配置文件中找到tockn,然后拼接上去:token=XXX

例如:http://127.0.0.1:18789/chat?token=XXX

token如何获取,再启动的时候会显示根目录,在根目录下有个文件:openclaw.json

打开这个文件,然后搜索token就行

打开后长这样:

7.配置大模型

在根目录打开上面说的这个文件:openclaw.json

然后把下面这个粘贴进去,如果有model就替换,没有这一段就直接粘贴进去就行

几个重要的参数说明:

硅基流动的sk获取地址是:https://cloud.siliconflow.cn/me/account/ak

如果没有这个平台的账号,可以注册一个,为什么使用这个平台是因为他送了很多的优惠券,对我们体验来说是够用的了。

注册地址:https://cloud.siliconflow.cn/i/pfXZwMML

这里的providers里面可以写很多模型,例如下面的配置文件我写了siliconflow就是硅基流动,写了ollama就支持本地部署的模型,如果你用的是其他平台就写其他平台的配置就行,例如qwen

配置说明

baseUrl=API调用地址

硅基流动的是:https://api.siliconflow.cn/v1

ollama的就写本地地址:http://127.0.0.1:11434/v1

apikey就到对应的平台申请就行,ollama的就写ollama-local

然后是下面的models,里面是一个数组,例如硅基流动平台支持很多个模型,就粘贴很多段{}配置就行,只用替换里面的模型名字和上下文大小就可以。

还有个重要的点是除了在models配置,还要配置下面的agents才能注册成功,让他生效。

参数1:

“defaults”: {

“model”: {

“primary”: “siliconflow/Pro/MiniMaxAI/MiniMax-M2.5”

},

这个是默认模型,后续如果要替换默认模型,修改这个重启就行

因为是硅基流动平台下的minimax所以类似是一个目录,根目录必须写 siliconflow/才行,另外模型名称要和上面的 model数组中每个模型的ID得匹配上。

参数2:agent中的模型,要把上面的模型ID和目录都粘贴下来才行。参考下面配置

“models”: {

“ollama/qwen3.5:9b”: {},

“siliconflow/deepseek-ai/DeepSeek-V3”: {

“alias”: “DeepSeek-V3”

},

,

"models": {

"providers": {

"siliconflow": {

"baseUrl": "https://api.siliconflow.cn/v1",

"apiKey": "你的硅基流动平台的sk",

"api": "openai-completions",

"models": [

{

"id": "deepseek-ai/DeepSeek-V3",

"name": "DeepSeek-V3",

"api": "openai-completions",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 131072,

"maxTokens": 32768

},

{

"id": "Qwen/Qwen2.5-72B-Instruct",

"name": "Qwen2.5-72B-Instruct",

"api": "openai-completions",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 32768,

"maxTokens": 8192

},

{

"id": "meta-llama/Llama-3.3-70B-Instruct",

"name": "Llama-3.3-70B-Instruct",

"api": "openai-completions",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 131072,

"maxTokens": 32768

},

{

"id": "deepseek-ai/DeepSeek-V3.2",

"name": "DeepSeek-V3.2",

"api": "openai-completions",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 131072,

"maxTokens": 32768

},

{

"id": "deepseek-ai/DeepSeek-R1-Distill-Qwen-32B",

"name": "DeepSeek-R1-Distill-Qwen-32B",

"api": "openai-completions",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 32768,

"maxTokens": 8192

},

{

"id": "deepseek-ai/deepseek-vl2",

"name": "deepseek-vl2",

"api": "openai-completions",

"reasoning": false,

"input": [

"text",

"image"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 65536,

"maxTokens": 16384

},

{

"id": "Qwen/Qwen3.5-122B-A10B",

"name": "Qwen3.5-122B-A10B",

"api": "openai-completions",

"reasoning": false,

"input": [

"text",

"image"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 131072,

"maxTokens": 16384

},

{

"id": "Pro/MiniMaxAI/MiniMax-M2.5",

"name": "MiniMax-M2.5",

"api": "openai-completions",

"reasoning": false,

"input": [

"text",

"image"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 131072,

"maxTokens": 16384

}

]

},

"ollama": {

"baseUrl": "http://127.0.0.1:11434/v1",

"apiKey": "ollama-local",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5:9b",

"name": "qwen3.5:9b",

"reasoning": true,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 32768,

"maxTokens": 327680

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "siliconflow/Pro/MiniMaxAI/MiniMax-M2.5"

},

"models": {

"ollama/qwen3.5:9b": {},

"siliconflow/deepseek-ai/DeepSeek-V3": {

"alias": "DeepSeek-V3"

},

"siliconflow/Qwen/Qwen2.5-72B-Instruct": {

"alias": "Qwen2.5-72B"

},

"siliconflow/meta-llama/Llama-3.3-70B-Instruct": {

"alias": "Llama-3.3-70B"

},

"siliconflow/deepseek-ai/DeepSeek-V3.2": {

"alias": "DeepSeek-V3.2"

},

"siliconflow/deepseek-ai/DeepSeek-R1-Distill-Qwen-32B": {

"alias": "DeepSeek-R1-Distill-Qwen-32B"

},

"siliconflow/Qwen/Qwen3.5-122B-A10B": {

"alias": "Qwen3.5-122B-A10B"

},

"siliconflow/Pro/MiniMaxAI/MiniMax-M2.5": {

"alias": "MiniMax-M2.5"

}

},

"workspace": "C:\\Users\\pc\\.openclaw\\workspace",

"compaction": {

"mode": "safeguard"

},

"blockStreamingDefault": "on",

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

},

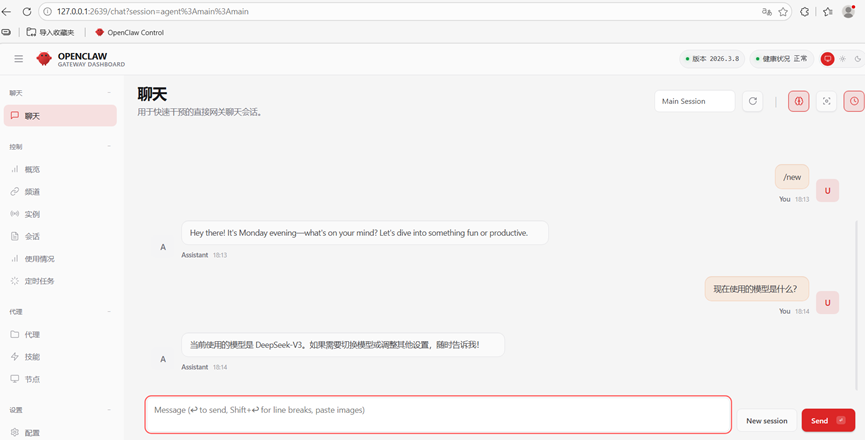

如上配置好之后,关闭cmd窗口,重新输入openclaw gateway重启就行。

8.修改默认端口

防止被被人一扫描就扫描到,规避一些风险

还是修改上面的这个文件,修改port,修改后重启就行,不过访问的时候连接中的端口就得换一下了。换了端口之后,token也得在中心粘贴下然后访问

“gateway”: {

“port”: 2639,

9.修改默认权限

还是上面说的这个文件:openclaw.json

因为新版本为了安全考虑默认之有消息的权限。如果你是在一台没有什么重要数据上面安装,就修改tools,给openclaw full的工具权限,让他可以操作整个电脑。

如果你的电脑上有重要的东西怕弄坏,就配置下目录白名单之类的。

“tools”: {

“profile”: “full”,

“sessions”:{“visibility”:“all”}

},

同样的,每次配置修改完成之后,都要重启一下网关。就是关闭cmd,然后再打开生效。这里可能有个坑,就是你算然配置了这个但是还是提示没有操作权限,那就新开一个session,或者重启电脑啥的,可能是哪里没有更新成功。

10.验证结果

直接再窗口提问,如果可以正常回答就好了。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)