NeurIPS 2025 | 人大: MokA——打破多模态微调僵局,实现参数高效的跨模态深度对齐的新范式

·

NeurIPS 2025 | 人大: MokA——打破多模态微调僵局,实现参数高效的跨模态深度对齐的新范式

题目: MokA: Multimodal Low-Rank Adaptation for MLLMS

年份:2025

单位:中国人民大学、北京市大模型与智能治理重点实验室等

项目主页:[https://gewu-lab.github.io/MokA]

研究背景与待解决问题

研究背景

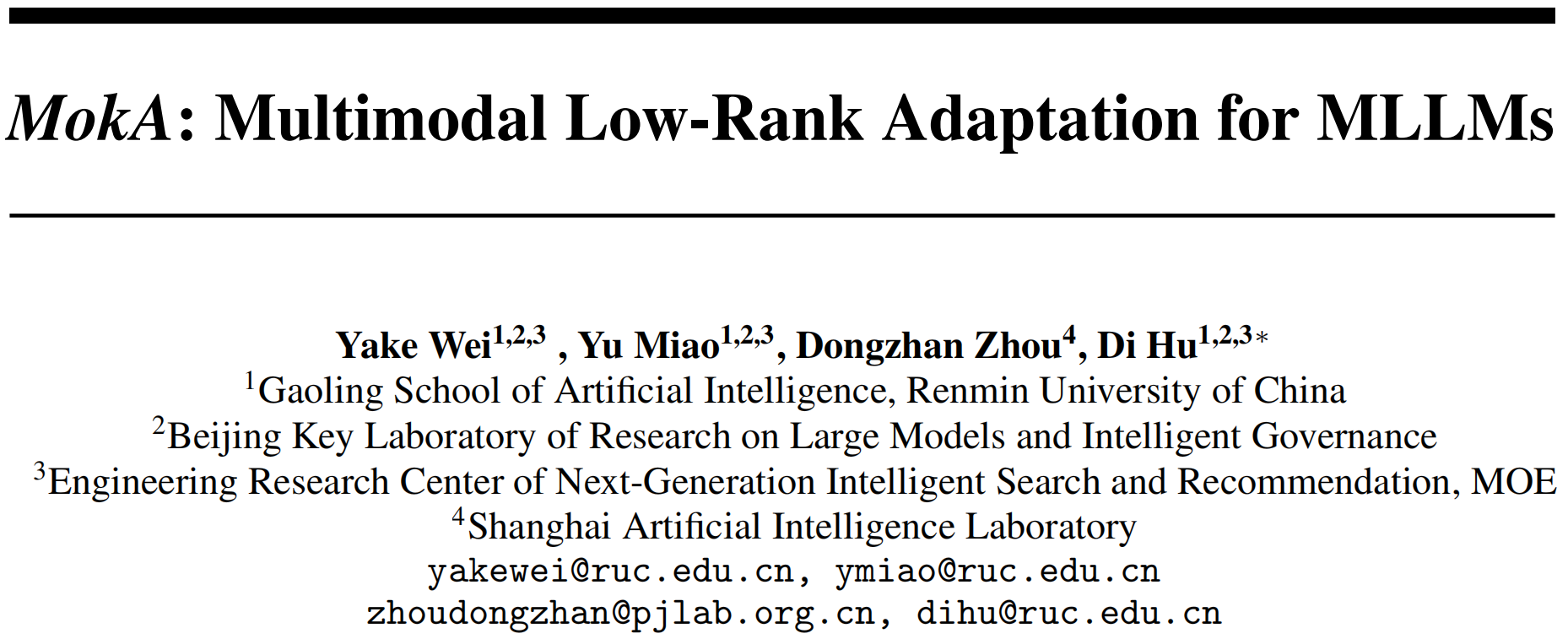

- 多模态大模型(MLLMs)通常由视觉编码器 + 大语言模型构成,需要通过微调适配下游任务。

- 全参数微调成本高,因此参数高效微调(PEFT)方法(如 LoRA)被广泛用于多模态模型训练。

- 现有方法大多直接将文本模型中的 LoRA 结构应用到多模态模型中,没有针对多模态结构进行专门设计。

核心痛点

- 模态差异被忽略:传统 LoRA 使用统一低秩矩阵更新参数,无法充分建模不同模态(如图像、文本、音频)的特征差异。

- 信息混合问题:多个模态共享同一适配参数,容易导致单模态信息表达能力下降。

- 跨模态交互不足:现有 PEFT 方法缺乏对跨模态信息交互的建模,影响多模态推理能力。

核心创新点

- 提出 MokA(Multimodal Low-Rank Adaptation):一种面向多模态大模型的参数高效微调方法,在低秩适配中显式建模多模态特性。

- 单模态适配机制:为不同模态引入独立的低秩适配参数,从而更好地保留各模态的特征表达能力。

- 跨模态适配机制:设计跨模态交互模块,使不同模态之间能够进行有效的信息融合与协同学习。

- 高效性与通用性:在保持较低参数开销的同时提升多模态任务性能,并能够兼容多种主流 MLLM 架构。

算法模型与技术架构

算法模型

- 基于 LoRA 的参数高效微调框架,在冻结原始多模态大模型参数的情况下,仅训练低秩适配矩阵。

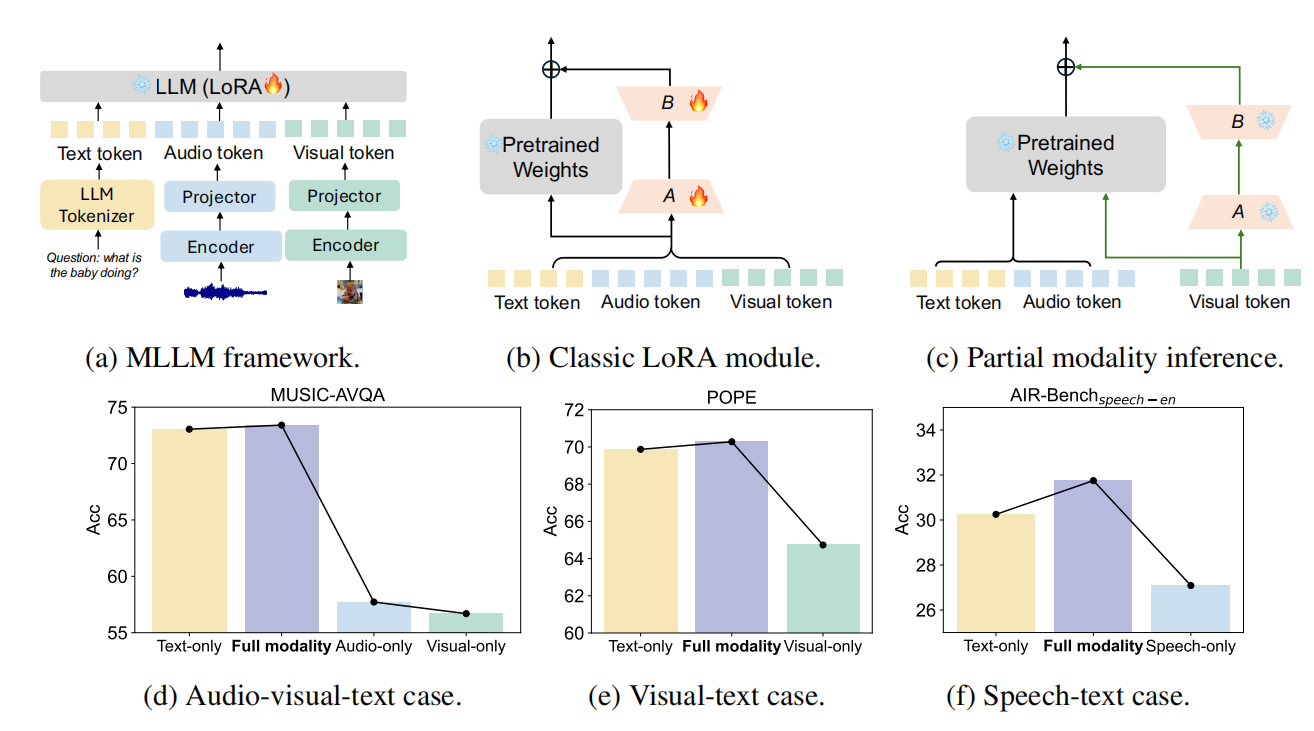

- 将低秩适配结构扩展为 模态感知的低秩分解,分别建模单模态特征与跨模态交互信息。

- 通过低秩矩阵组合更新原始权重,实现对多模态表示空间的高效适配。

技术架构

- 单模态适配模块(Unimodal Adaptation):为不同模态(如图像、文本等)引入独立的低秩适配参数,用于增强各模态特征表达能力。

- 跨模态适配模块(Cross-modal Adaptation):设计跨模态低秩矩阵,用于建模不同模态之间的信息交互与融合。

- 参数共享与高效训练:在保持较低参数量的情况下,通过低秩分解实现对原模型权重的高效更新,并适用于多种多模态大模型架构。

-

实验验证与结果分析

实验设置

- 实验模型:在多种主流多模态大模型(MLLMs)上进行实验,通过在 Transformer 层中插入 MokA 适配模块进行参数高效微调。

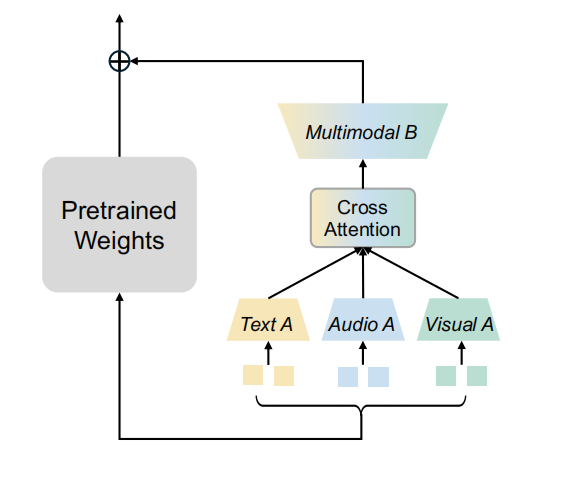

- 对比方法:与多种主流 PEFT 方法进行比较,包括 LoRA、Adapter 等低参数微调方法。

- 任务与数据集:在多个多模态理解任务上进行评测,如视觉问答(VQA)、图像描述等。

- 评估指标:采用任务标准指标(如准确率、BLEU 等)评估模型性能,同时统计可训练参数规模。

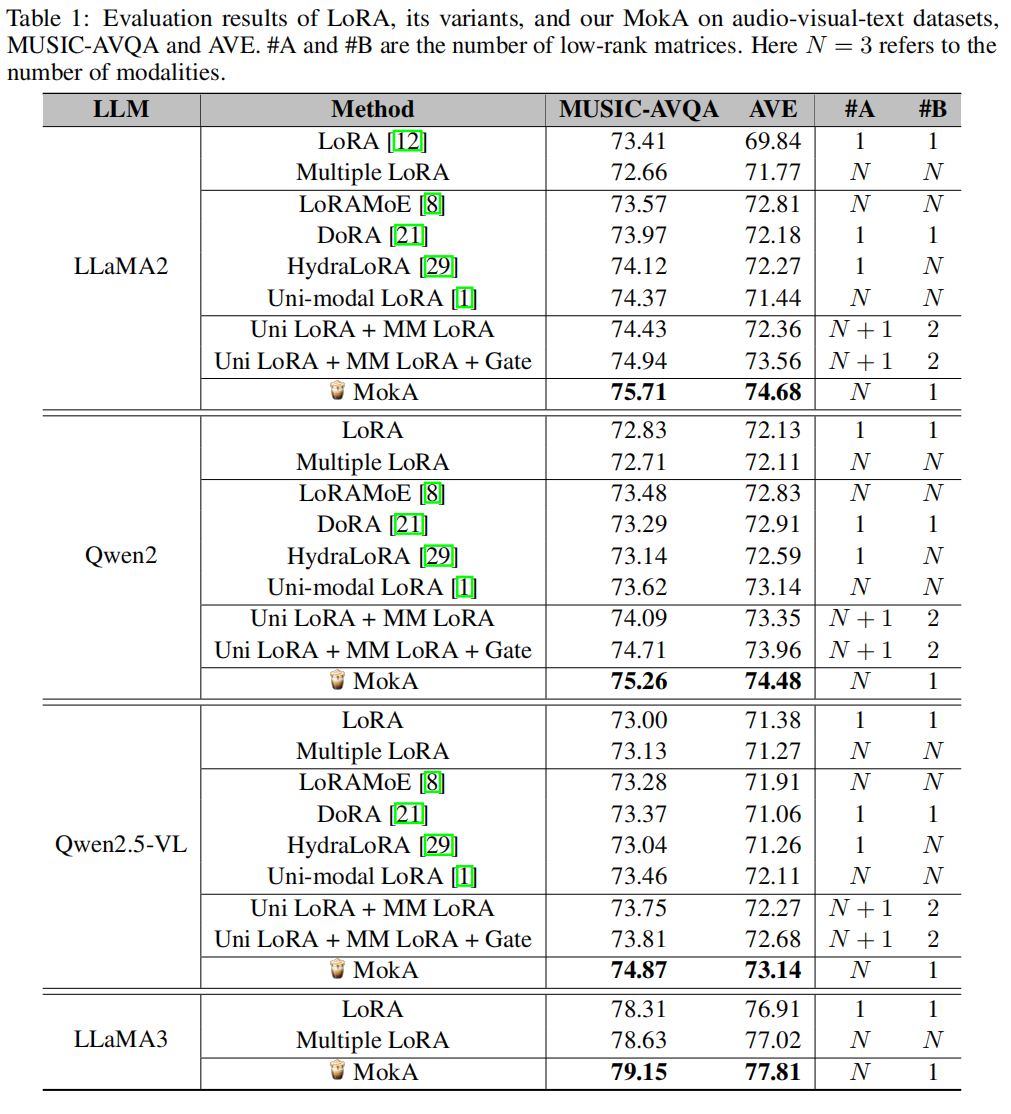

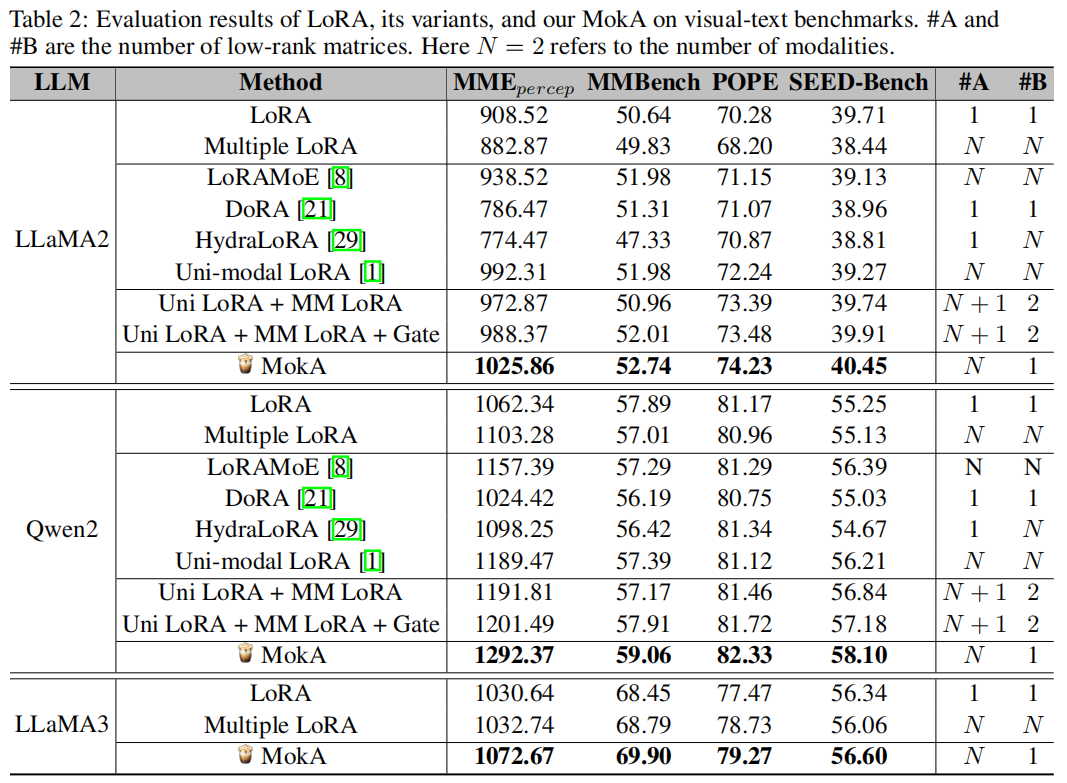

实验结果

- 性能提升:MokA 在多个多模态任务上均优于传统 LoRA 等 PEFT 方法,表现出更好的跨模态理解能力。

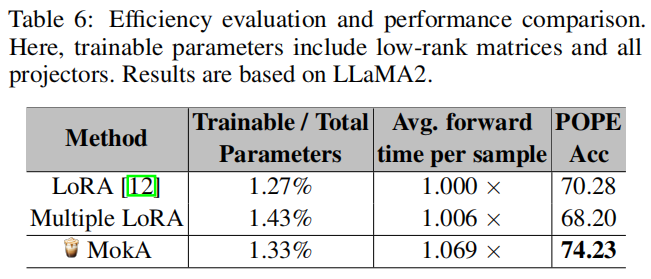

- 参数效率高:在保持较低参数开销的情况下,实现了更优的模型性能。

- 泛化能力强:在不同模型架构和任务上均表现出稳定的性能提升,验证了方法的通用性。

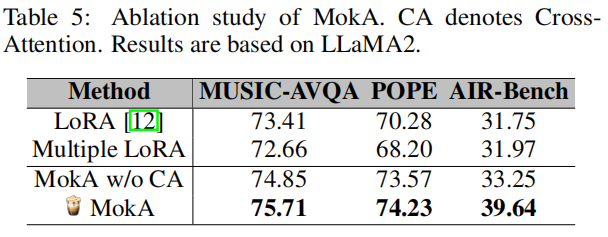

- 消融实验:通过对单模态适配与跨模态适配模块进行消融分析,验证了两种模块对性能提升的贡献。

更多展示详见原文…

结论与启发

论文总结

- 本文提出 MokA(Multimodal Low-Rank Adaptation),一种面向多模态大模型的参数高效微调方法。

- 通过在低秩适配中引入单模态适配与跨模态适配机制,更好地建模不同模态特征及其交互关系。

- 在多个多模态任务上的实验表明,MokA 在保持较低参数开销的情况下,能够显著提升模型性能。

- 实验结果验证了该方法在不同模型架构和任务上的有效性与通用性。

研究启示

- 多模态参数高效微调需要考虑不同模态的结构差异,而不是直接复用文本模型的 PEFT 方法。

- 在多模态模型中,同时建模 单模态特征表达 与 跨模态交互机制 是提升性能的重要方向。

- 低秩适配方法仍具有较大研究空间,可以通过结构设计进一步提升其对多模态任务的适配能力。

- 面向多模态场景设计 模态感知(modality-aware)的 PEFT 方法,可能成为未来的重要研究方向。

个人借鉴规划

后续可尝试在微调大模型时尝试使用该方法,以提升baseline,体现论文之“新”。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)