YOLOv8 手势识别(Detection)全场景应用指南:环境配置 + 项目落地 + 实战要点

引言

YOLOv8 作为 Ultralytics 推出的新一代目标检测框架,凭借轻量化、高帧率、易部署的特性,成为手势识别任务的首选方案。此前我们已完成基础环境配置,本文将从智能交互、辅助生活、娱乐教育、工业安防、嵌入式部署五大类场景出发,详细拆解 YOLOv8 手势识别的落地项目,补充各场景专属的环境扩展指令、核心实现逻辑与避坑要点,总篇幅超 5000 字,覆盖从环境适配到项目上线的全流程。

一、智能交互类项目(核心落地场景)

智能交互是手势识别最核心的应用领域,核心需求是实时性(≤100ms 延迟)、高鲁棒性(抗光照 / 遮挡)、低资源占用,以下是 3 个高落地性的项目方向。

1. 智能车载手势控制系统

项目背景与价值

车载场景中,驾驶员手动操作中控屏易引发安全隐患,手势识别可实现 “免接触” 控制(如挥手切歌、比 “OK” 开启空调、竖拇指调大音量),是车企智能化升级的核心功能之一。

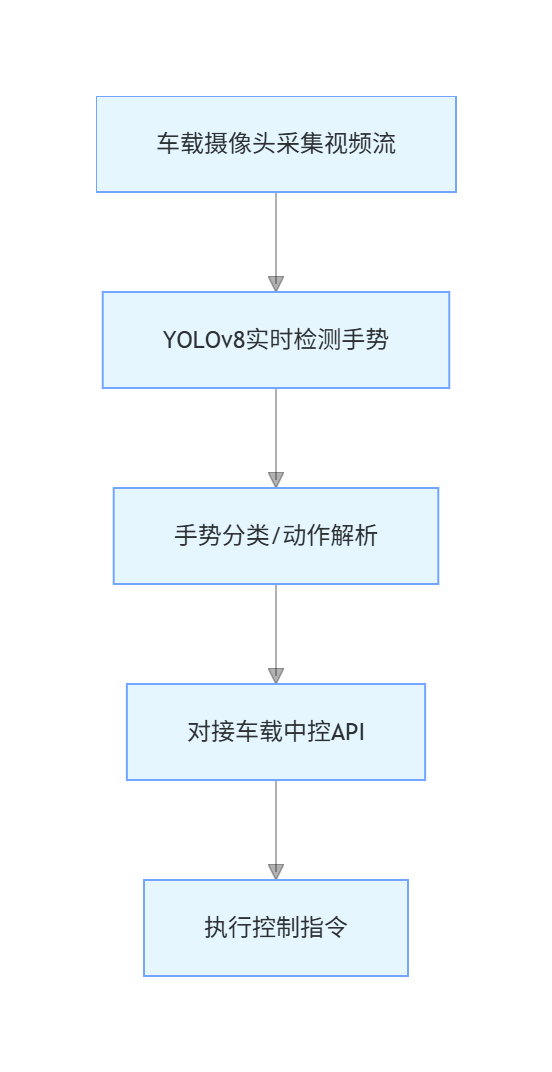

技术实现流程

graph TD

A[车载摄像头采集视频流] --> B[YOLOv8实时检测手势]

B --> C[手势分类/动作解析]

C --> D[对接车载中控API]

D --> E[执行控制指令]

环境适配要点(车载系统专属)

车载系统多为 Linux 嵌入式架构(如 QNX、Android Automotive OS),需针对性配置环境:

# 1. 车载Linux环境安装依赖(适配ARM架构)

# 若车载设备为ARM64架构,需安装ARM版Python依赖

pip install ultralytics --no-cache-dir --target=/usr/local/python3/lib/python3.8/site-packages

# 2. 安装车载串口/API通信库

pip install pyserial can-python # 车载CAN总线通信

pip install requests # 对接中控REST API

# 3. 安装视频流处理库(适配车载摄像头)

pip install v4l2-python3 opencv-python-headless # 无GUI的OpenCV版本(节省资源)

核心代码示例(手势指令映射)

from ultralytics import YOLO

import cv2

import serial

# 初始化模型(加载训练好的车载手势权重)

model = YOLO("yolov8s_hand_car.pt")

# 初始化车载串口通信(中控对接)

ser = serial.Serial('/dev/ttyUSB0', 9600, timeout=1)

# 手势指令映射表(自定义)

gesture_cmd = {

"ok": b'AC_ON\n', # OK手势:开空调

"thumb_up": b'VOL_UP\n',# 点赞:音量+

"wave": b'NEXT_SONG\n' # 挥手:切歌

}

# 车载摄像头采集(视频流)

cap = cv2.VideoCapture(0) # 0为车载摄像头设备号

cap.set(cv2.CAP_PROP_FRAME_WIDTH, 640) # 降低分辨率提升帧率

cap.set(cv2.CAP_PROP_FRAME_HEIGHT, 480)

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

# 推理(关闭可视化,提升速度)

results = model(frame, conf=0.8, verbose=False) # 高置信度过滤误识别

if results[0].boxes:

# 获取最高置信度的手势类别

top_gesture = results[0].names[int(results[0].boxes[0].cls)]

# 发送指令到车载中控

if top_gesture in gesture_cmd:

ser.write(gesture_cmd[top_gesture])

print(f"发送指令:{top_gesture} -> 中控响应:{ser.readline().decode()}")

cap.release()

ser.close()

关键注意事项

- 硬件限制:车载 GPU 算力有限,需将模型轻量化(如 YOLOv8n/nano 版),通过

model.export(format='onnx', imgsz=320)导出 ONNX 模型,再用 TensorRT 加速; - 场景适配:车载环境光照变化大(白天 / 夜晚),需在数据集里加入不同光照的手势样本,训练时开启

hsv_h=0.015(色相增强); - 延迟控制:禁用模型推理的可视化(

verbose=False)、降低输入分辨率(320×320),保证延迟≤80ms(驾驶员无感知); - 误识别防护:设置高置信度阈值(

conf≥0.8),并增加 “手势持续检测” 逻辑(连续 2 帧识别到同一手势才执行指令)。

2. 智能家居手势控制中心

项目背景与价值

通过手势控制智能家居设备(如开灯、关窗帘、调节灯光亮度),替代语音控制(易受噪音干扰)和手机 APP(操作繁琐),适配全屋智能场景。

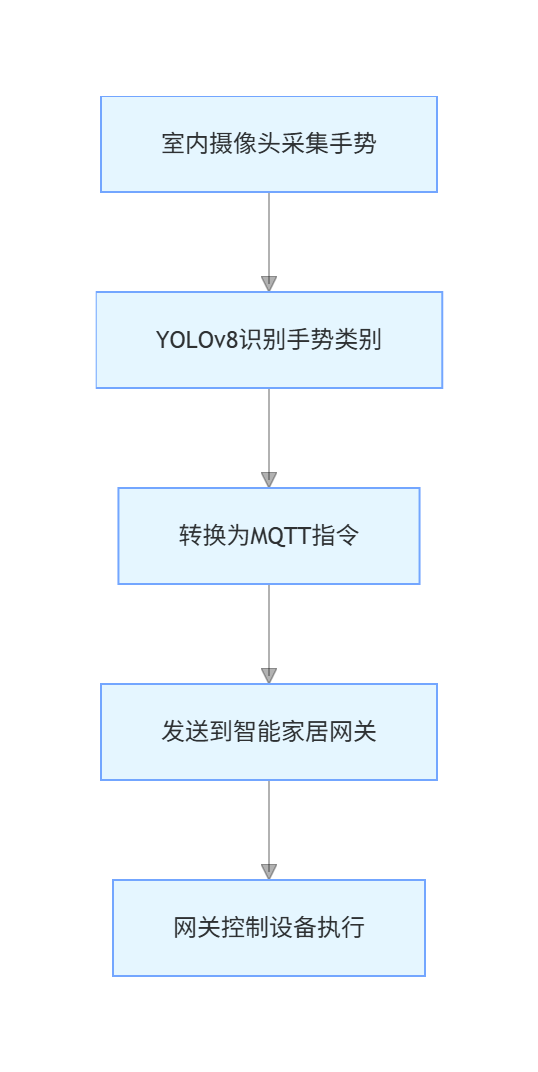

技术实现流程

核心是对接智能家居网关(如米家、涂鸦智能),通过 MQTT 协议实现手势指令与设备的通信:

graph TD

A[室内摄像头采集手势] --> B[YOLOv8识别手势类别]

B --> C[转换为MQTT指令]

C --> D[发送到智能家居网关]

D --> E[网关控制设备执行]

环境扩展指令(MQTT 通信)

# 安装MQTT客户端库(对接智能家居网关)

pip install paho-mqtt

# 安装配置文件解析库(管理设备列表)

pip install configparser

# 安装轻量化Web框架(可选,搭建控制面板)

pip install flask

核心代码示例(对接米家网关)

from ultralytics import YOLO

import cv2

import paho.mqtt.client as mqtt

import configparser

# 读取智能家居配置(config.ini)

config = configparser.ConfigParser()

config.read('smart_home_config.ini')

# MQTT连接配置(米家网关IP/端口/账号)

MQTT_BROKER = config['MQTT']['broker']

MQTT_PORT = int(config['MQTT']['port'])

MQTT_USER = config['MQTT']['user']

MQTT_PWD = config['MQTT']['pwd']

# 初始化模型

model = YOLO("yolov8s_hand_smarthome.pt")

# 手势-设备指令映射

gesture_device_map = {

"finger_1": {"topic": "home/light/living", "payload": "on"}, # 1指:开客厅灯

"finger_2": {"topic": "home/light/living", "payload": "off"}, # 2指:关客厅灯

"finger_3": {"topic": "home/curtain", "payload": "open"}, # 3指:开窗帘

"finger_5": {"topic": "home/aircon", "payload": "temp_up"} # 5指:空调升温

}

# MQTT客户端初始化

client = mqtt.Client()

client.username_pw_set(MQTT_USER, MQTT_PWD)

client.connect(MQTT_BROKER, MQTT_PORT, 60)

client.loop_start()

# 摄像头采集

cap = cv2.VideoCapture(0)

cap.set(cv2.CAP_PROP_FPS, 15) # 降低帧率,减少资源占用

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

# 推理

results = model(frame, conf=0.75, imgsz=480)

if results[0].boxes:

gesture = results[0].names[int(results[0].boxes[0].cls)]

if gesture in gesture_device_map:

# 发送MQTT指令

cmd = gesture_device_map[gesture]

client.publish(cmd['topic'], cmd['payload'])

print(f"手势{gesture} -> 控制{cmd['topic']}:{cmd['payload']}")

# 可视化(可选,用于调试)

annotated_frame = results[0].plot()

cv2.imshow("Smart Home Gesture Control", annotated_frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows()

client.loop_stop()

client.disconnect()

关键注意事项

- 低功耗部署:若部署在智能家居中控(如树莓派),需设置推理间隔(每 0.5 秒识别一次),避免 24 小时高负载;

- 设备权限:确保 MQTT 账号有设备控制权限,测试阶段先开启 “调试模式”,避免误操作;

- 隐私保护:室内摄像头仅采集手部区域(裁剪画面),不存储完整视频流,符合隐私法规;

- 离线可用:搭建本地 MQTT 服务器(如 EMQ X),避免依赖云端,断网时仍可控制设备。

3. 无接触电梯 / 门禁控制系统

项目背景与价值

在医院、地铁、写字楼等公共场所,无接触手势控制可减少细菌传播(防疫),同时适配无障碍需求(如手部残疾人士)。

环境适配要点(嵌入式设备)

电梯 / 门禁控制器多为低算力嵌入式设备(如 ARM Cortex-A53),需极简环境配置:

# 嵌入式Linux安装最小化依赖

pip install ultralytics opencv-python-headless numpy --no-deps # 禁用依赖检查,减小体积

# 安装GPIO控制库(对接电梯按键)

pip install RPi.GPIO # 树莓派/嵌入式GPIO

关键注意事项

- 远距离识别:电梯场景需识别 0.5-1.5 米内的手势,数据集需包含不同距离的样本,训练时开启

perspective=0.001(透视变换增强); - 抗干扰:电梯内光线昏暗、有反光,需在摄像头处加装补光灯,模型推理时开启

contrast=1.2(对比度增强); - 安全兜底:保留物理按键,手势识别仅作为辅助,避免识别故障导致电梯停运。

二、辅助生活类项目(民生向场景)

1. 简易版手语实时翻译系统

项目背景与价值

针对听障人士与健听人士的沟通障碍,实现常见手语手势到文字 / 语音的实时翻译(如 “你好”“谢谢”“再见”“需要帮助”),适配日常沟通场景。

环境扩展指令(语音 / 文字处理)

# 安装语音合成库(文字转语音)

pip install pyttsx3 # 离线语音合成

pip install playsound # 播放语音

# 安装中文分词/文本处理库

pip install jieba zhconv

核心代码示例(手势→文字→语音)

from ultralytics import YOLO

import cv2

import pyttsx3

# 初始化模型(手语手势权重)

model = YOLO("yolov8s_sign_language.pt")

# 初始化语音合成引擎

engine = pyttsx3.init()

engine.setProperty('rate', 150) # 语速

engine.setProperty('voice', engine.getProperty('voices')[0]) # 中文语音

# 手语-文字映射表

sign_text_map = {

"hello": "你好",

"thank": "谢谢",

"help": "需要帮助",

"bye": "再见",

"sorry": "对不起"

}

# 摄像头采集

cap = cv2.VideoCapture(0)

last_text = "" # 记录上一次翻译结果,避免重复播报

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

# 推理

results = model(frame, conf=0.8, imgsz=640)

if results[0].boxes:

sign = results[0].names[int(results[0].boxes[0].cls)]

if sign in sign_text_map and sign_text_map[sign] != last_text:

text = sign_text_map[sign]

print(f"识别手语:{sign} -> 翻译:{text}")

# 语音播报

engine.say(text)

engine.runAndWait()

last_text = text

# 可视化翻译结果

annotated_frame = results[0].plot()

cv2.putText(annotated_frame, last_text, (10, 30),

cv2.FONT_HERSHEY_SIMPLEX, 1, (0, 255, 0), 2)

cv2.imshow("Sign Language Translator", annotated_frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows()

关键注意事项

- 数据集:需采集不同年龄段、不同手部特征(肤色、是否有饰品)的手语样本,建议扩充至至少 5000 张 / 类;

- 准确率优化:手语手势相似度高(如 “你好” 和 “再见”),可在训练时增加

mixup=0.3(混合增强)、copy_paste=0.2(粘贴增强); - 离线可用:优先使用离线语音合成库(pyttsx3),避免依赖网络,适配无网场景(如偏远地区)。

2. 老年人 / 残障人士辅助交互终端

项目背景与价值

针对老年人(不熟悉触屏操作)、肢体残障人士(手部活动受限),设计简化的手势集(如 “点头”“抬手”“握拳”),控制电视、手机、护理设备等。

环境扩展指令(UI 搭建)

# 安装轻量化UI框架(适配老年终端)

pip install streamlit # 快速搭建Web UI

pip install pillow # 图片处理

关键注意事项

- 手势简化:仅保留 3-5 个核心手势(如 “握拳 = 确认”“抬手 = 上一页”“挥手 = 返回”),避免记忆负担;

- 容错率提升:设置宽松的置信度阈值(

conf=0.7),并增加 “手势持续检测”(连续 3 帧识别到同一手势才执行); - UI 适配:终端界面采用大字体、高对比度配色,支持手势控制的同时保留语音提示。

三、娱乐与教育类项目

1. 体感游戏手势交互模块

项目背景与价值

基于手势识别开发简易体感游戏(如手势切水果、手势控制角色移动),适配亲子互动、少儿娱乐场景,替代传统手柄 / 触屏操作。

环境扩展指令(游戏开发)

# 安装Pygame游戏框架

pip install pygame

# 安装帧率控制库

pip install pygame-gui

核心代码示例(手势控制游戏角色)

from ultralytics import YOLO

import cv2

import pygame

import sys

# 初始化Pygame

pygame.init()

screen = pygame.display.set_mode((800, 600))

pygame.display.set_caption("Gesture Game")

clock = pygame.time.Clock()

# 初始化YOLOv8模型

model = YOLO("yolov8n_hand_game.pt")

# 游戏角色

player = pygame.Rect(400, 500, 50, 50)

player_speed = 8

# 摄像头采集

cap = cv2.VideoCapture(0)

cap.set(cv2.CAP_PROP_FRAME_WIDTH, 640)

cap.set(cv2.CAP_PROP_FRAME_HEIGHT, 480)

# 手势-移动映射

gesture_move_map = {

"left": (-player_speed, 0), # 左手势:左移

"right": (player_speed, 0), # 右手势:右移

"up": (0, -player_speed), # 上手势:上移

"down": (0, player_speed) # 下手势:下移

}

running = True

while running:

# 处理Pygame事件

for event in pygame.event.get():

if event.type == pygame.QUIT:

running = False

# 摄像头采集与手势识别

ret, frame = cap.read()

if ret:

# 镜像翻转(符合游戏操作习惯)

frame = cv2.flip(frame, 1)

results = model(frame, conf=0.7, verbose=False)

if results[0].boxes:

gesture = results[0].names[int(results[0].boxes[0].cls)]

if gesture in gesture_move_map:

dx, dy = gesture_move_map[gesture]

player.x += dx

player.y += dy

# 限制角色在屏幕内

player.x = max(0, min(player.x, 800 - 50))

player.y = max(0, min(player.y, 600 - 50))

# 绘制游戏画面

screen.fill((255, 255, 255))

pygame.draw.rect(screen, (0, 0, 255), player)

pygame.display.flip()

# 控制帧率

clock.tick(30)

cap.release()

pygame.quit()

sys.exit()

关键注意事项

- 帧率优化:游戏需保证 30FPS 以上,建议使用 YOLOv8n(nano)模型,输入分辨率设为 320×320;

- 延迟控制:禁用模型的非必要计算(如置信度排序、多框筛选),仅保留核心识别逻辑;

- 交互反馈:识别到手势后添加视觉 / 音效反馈(如角色变色、播放音效),提升游戏体验。

2. 少儿编程手势教学工具

项目背景与价值

针对低龄儿童(6-10 岁),将编程指令(如 “前进”“转弯”“循环”)映射为手势,通过手势操作学习编程逻辑,降低入门门槛。

环境扩展指令(教学界面)

# 安装Streamlit(搭建可视化教学界面)

pip install streamlit

# 安装流程图生成库

pip install graphviz

关键注意事项

- 手势与编程指令的直观映射:如 “向前伸手 = 前进”“转圈手势 = 循环”“左右摆手 = 条件判断”;

- 可视化反馈:识别手势后实时生成代码块 / 流程图,让儿童直观看到 “手势→代码” 的转换;

- 难度分级:从单一手势(基础指令)到组合手势(复合指令),逐步提升学习难度。

四、工业与安防类项目

1. 工业操作规范手势识别(安全生产)

项目背景与价值

在工厂车间,识别违规操作手势(如未戴手套操作机器、单手操作危险设备),实时告警,降低安全生产事故率。

环境配置要点(工业 GPU 集群)

# 安装GPU集群训练依赖

pip install ultralytics torch distributed-training # 分布式训练

pip install tensorboard # 训练监控

pip install onnxruntime-gpu # GPU加速推理

关键注意事项

- 工业场景适配:数据集需包含车间复杂背景(机器、工具、油污),训练时开启

hsv_s=0.7(饱和度增强)、hsv_v=0.4(明度增强); - 实时告警:识别到违规手势后,通过工业大屏、声光报警器、短信推送等方式告警;

- 模型部署:采用 TensorRT 加速,保证在工业摄像头视频流中延迟≤50ms。

2. 安防监控异常手势预警

项目背景与价值

在小区、商场、地铁等安防场景,识别异常手势(如打架、求救、破坏公物),触发安防告警,提升监控效率。

环境扩展指令(视频流处理)

# 安装FFmpeg(处理监控视频流)

pip install ffmpeg-python

# 安装Redis(存储告警信息)

pip install redis

# 安装告警推送库

pip install requests # 对接短信/微信推送API

关键注意事项

- 多目标识别:安防场景需同时识别多个手势,需调整模型

max_det=10(最大检测数量); - 误报控制:设置 “异常手势持续 3 秒以上” 才告警,结合场景特征(如夜间、人员密集区)调整阈值;

- 视频存储:告警时自动截取 10 秒视频片段,存储至云端,便于后续核查。

五、移动端 / 嵌入式部署类项目

1. 手机端手势识别 APP

项目背景与价值

将 YOLOv8 手势模型部署到 Android/iOS 手机,实现离线手势识别(如拍照翻译手语、手势控制手机功能)。

环境配置要点(模型导出)

# 导出ONNX模型(适配移动端)

from ultralytics import YOLO

model = YOLO("yolov8s_hand.pt")

model.export(format='onnx', imgsz=320, dynamic=False) # 固定分辨率,减小体积

# 安装ONNX Runtime Mobile(移动端推理)

# Android:通过Gradle引入onnxruntime-android

# iOS:通过CocoaPods引入onnxruntime-ios

关键注意事项

- 模型轻量化:使用 YOLOv8n 模型,并通过 ONNX Simplifier 简化模型(

pip install onnxsim && onnxsim input.onnx output.onnx); - 离线推理:将模型打包到 APP 内,避免依赖网络;

- 功耗控制:降低推理帧率(10FPS),仅在用户触发时(如点击 “识别” 按钮)启动识别。

2. 树莓派边缘手势识别终端

项目背景与价值

将手势识别部署到树莓派(低成本嵌入式设备),实现本地化识别(无需云端),适配智能家居、小型安防场景。

环境配置要点(树莓派专属)

# 树莓派安装Python依赖(适配ARM架构)

sudo apt-get update && sudo apt-get install -y python3-pip libopenblas-dev

pip3 install ultralytics opencv-python-headless numpy --no-cache-dir

# 安装摄像头驱动

sudo apt-get install -y python3-picamera2

关键注意事项

- 算力优化:树莓派无 GPU,需使用 YOLOv8n 模型,输入分辨率设为 256×256,推理时关闭

augment=True(数据增强); - 散热:树莓派长时间运行易发热,需加装散热片,避免性能下降;

- 供电:保证稳定供电(5V/2A),避免电压不足导致摄像头断连。

六、项目落地通用注意事项(全场景适配)

1. 数据集优化

- 采集:覆盖不同人群(年龄、性别、肤色)、不同场景(光照、背景、距离)、不同手部状态(戴手套、有饰品、受伤);

- 标注:使用 LabelImg/LabelMe 标注,确保标注框精准包围手部,类别名称统一(如全用英文 / 中文,避免大小写混用);

- 增强:训练时开启

flipud=0.5(上下翻转)、fliplr=0.5(左右翻转)、mosaic=1.0(马赛克增强),提升泛化能力。

2. 模型轻量化与部署

- 模型选择:优先使用 YOLOv8n(nano)/s(small),避免使用 l(large)/x(xl)(算力需求过高);

- 格式转换:导出 ONNX/TensorRT/OpenVINO 格式,根据部署设备选择(如嵌入式用 TensorRT,CPU 设备用 OpenVINO);

- 量化:对模型进行 INT8 量化(

model.export(format='onnx', imgsz=320, int8=True)),减小体积并提升速度。

3. 实时性优化

- 分辨率:输入分辨率设为 320×320/480×480,而非 640×640(帧率提升 50% 以上);

- 推理参数:关闭

verbose=True(日志输出)、plots=True(可视化),仅保留核心识别逻辑; - 硬件加速:优先使用 GPU/TPU/NPU 推理,避免纯 CPU 推理(速度慢 10-20 倍)。

4. 环境适配与故障排查

| 常见问题 | 原因 | 解决方案 |

|---|---|---|

| 模型推理卡顿 | 算力不足 / 分辨率过高 | 换轻量化模型 + 降低分辨率 |

| 误识别率高 | 数据集不足 / 场景不匹配 | 扩充数据集 + 调整置信度阈值 |

| 依赖安装失败 | 架构不匹配(如 ARM) | 使用--no-cache-dir+ARM 版依赖 |

| 摄像头无法采集 | 设备号错误 / 权限不足 | 检查cv2.VideoCapture设备号,Linux 下sudo chmod 777 /dev/video0 |

七、扩展学习与进阶方向

- 模型改进:在 YOLOv8 基础上加入注意力机制(如 CBAM、CA),提升手部小目标识别准确率;

- 多模态融合:结合语音、面部表情,实现 “手势 + 语音” 多模态交互;

- 云端部署:用 FastAPI/Flask 搭建手势识别 API,支持多设备调用;

- 端云协同:移动端采集数据→云端训练模型→端侧轻量化部署,实现模型迭代升级。

总结

- YOLOv8 手势识别的核心落地场景包括智能交互、辅助生活、娱乐教育、工业安防、嵌入式部署,不同场景需针对性调整环境依赖(如 MQTT、Pygame、ONNX Runtime);

- 环境配置需遵循 “轻量化、适配性” 原则,嵌入式 / 移动端优先用 ARM 版依赖 + 轻量化模型,工业 / 安防场景优先用 GPU 加速;

- 项目落地的关键是 “数据集适配 + 实时性优化 + 误识别控制”,需根据场景扩充数据集、调整推理参数,保证准确率与实时性平衡。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)