大模型备案安全评估报告模版分享【含撰写事项+避坑指南】

·

安全评估报告是大模型备案最核心材料,需全面覆盖语料、模型、内容、数据、合规、应急六大维度,量化指标 + 证据支撑 + 合规对标是审核关键。以下我将从报告内容、撰写步骤、注意事项三方面给大家做个详细说明,本篇文章内容纯为个人经验分享,各地域备案要求不同,详情请咨询专业备案人士,谨慎模仿!

一、大模型安全评估报告内容

1、评估概况

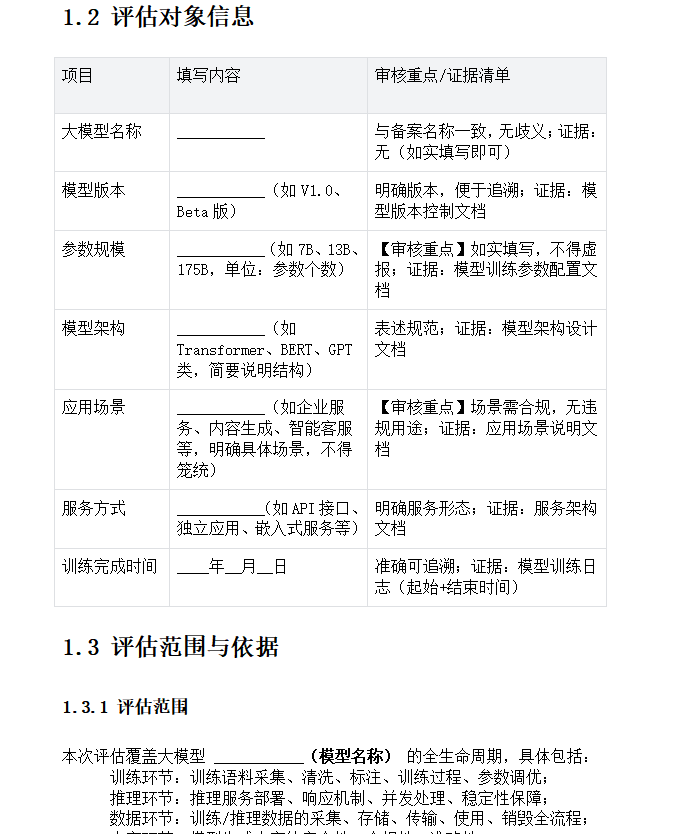

- 评估主体:企业名称、统一社会信用代码、联系人、联系方式

- 评估对象:大模型名称、版本、参数规模、架构(如 Transformer)、应用场景、服务方式

- 评估范围:训练 / 推理全链路、数据 / 算法 / 内容 / 用户 / 运维全环节

- 评估依据:列明法规与标准(精确到条款) 《生成式人工智能服务管理暂行办法》(2023) 《生成式人工智能服务安全基本要求》 《数据安全法》《个人信息保护法》《网络安全法》 行业标准(如 TC260 相关)

- 评估时间 / 周期:起止日期、评估阶段(预评估 / 正式评估 / 复测)

- 评估团队:自研团队 + 第三方检测机构(如有)、资质

2、评估方法与工具

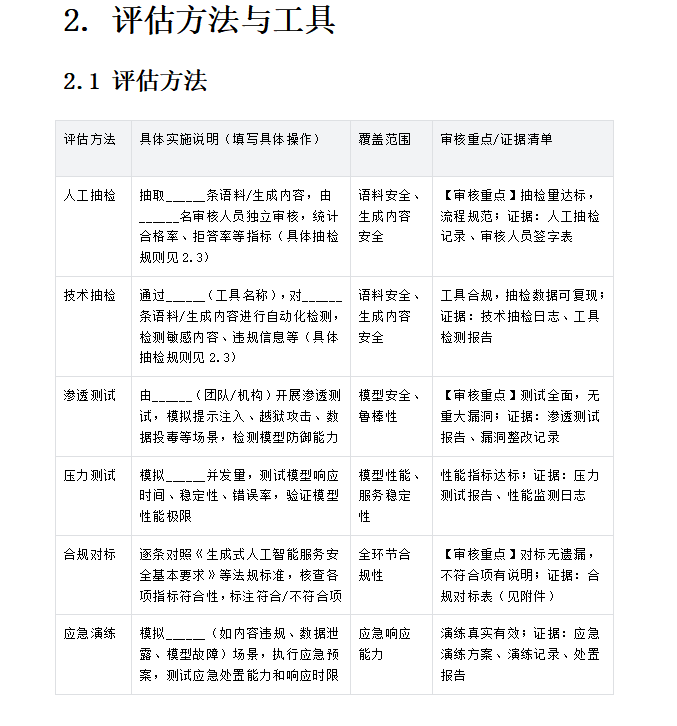

- 评估方法:人工抽检、技术抽检、渗透测试、压力测试、合规对标、应急演练

- 评估工具:漏洞扫描器、内容审核平台、数据脱敏工具、日志审计系统、测试题库

- 样本设计:语料样本量、测试题集、拒答题库、场景覆盖说明

- 抽样规则:随机抽样、分层抽样、覆盖率、置信度说明

3、分项安全评估

(1)训练语料安全评估

- 语料基本信息:规模(Token/GB)、类型(文本 / 代码 / 多模态)、语种比例、来源占比(开源 / 自采 / 商业)

- 合规性:授权证明、无侵权 / 无敏感 / 无未授权个人信息、境外语料占比≤30%(2026 红线)

- 清洗流程:去重、去噪、脱敏、过滤规则、关键词库、人工审核机制

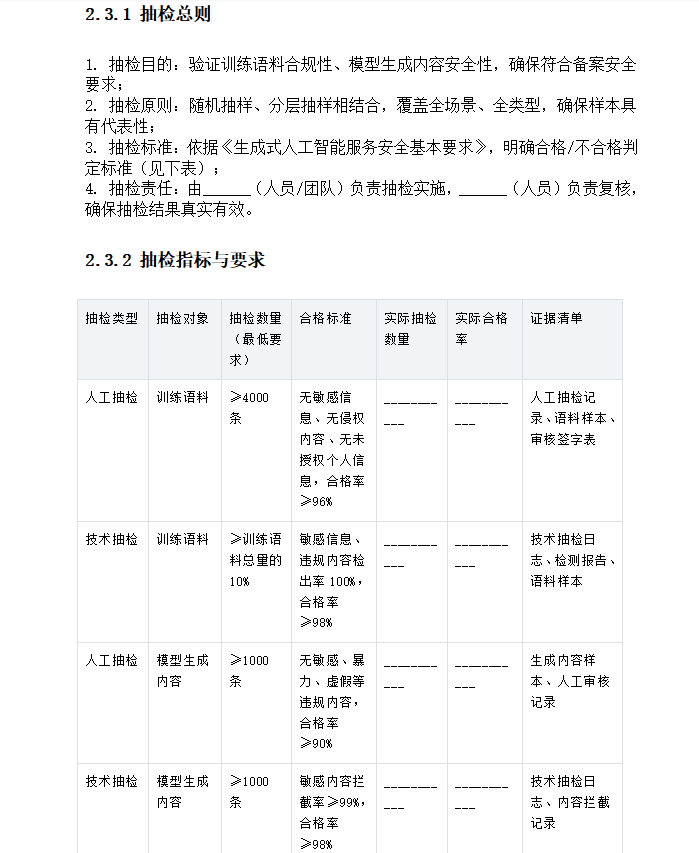

- 抽检指标(必达): 人工抽检≥4000 条,合格率≥96% 技术抽检≥10%,合格率≥98% 个人信息去标识化率 100%

- 风险点 + 措施 + 验证结果:如 “语料偏见→SFT+RLHF 对齐→偏见率<1%”

(2)模型安全与鲁棒性评估

- 模型架构:可解释性、训练流程可追溯、参数管理、版本控制

- 安全对齐:SFT/RLHF/RLAIF 等安全训练过程、目标函数、奖励机制

- 防御能力:提示注入、越狱攻击、数据投毒、后门攻击、对抗样本防御效果

- 性能指标:响应时间、并发能力、稳定性、错误率、可审计性

- 风险点 + 措施 + 验证结果:如 “提示注入→多层拦截 + 语义校验→拦截率≥99%”

(3)生成内容安全评估

- 内容风险覆盖:政治敏感、暴力色情、谣言、歧视、虚假信息、专业误导(医疗 / 金融)

- 过滤机制:模型层 + 服务层双重拦截、关键词 + 语义 + 分类模型、人工复核流程

- 抽检指标(必达): 人工 / 关键词 / 模型抽检各≥1000 条,合格率≥90% 敏感问题拒答率≥95% 非敏感拒答率≤5% 专业场景强制风险提示率 100%

- 风险点 + 措施 + 验证结果:如 “虚假信息→事实核查 + 来源标注→准确率≥95%”

(4)数据安全与隐私保护评估

- 数据全生命周期:采集、存储、传输、使用、销毁、跨境流动合规

- 个人信息保护:最小必要、匿名化 / 去标识化、用户授权、数据遗忘 / 删除、权限管控

- 技术措施:加密(传输 / 存储)、脱敏、访问控制、日志审计、数据防泄露

- 合规对标:《个人信息保护法》《数据安全法》条款符合性说明

- 风险点 + 措施 + 验证结果:如 “数据泄露→加密 + 权限 + 审计→泄露风险可控”

(5)安全管理与应急能力评估

- 安全制度:安全组织、责任分工、安全策略、培训、审计、供应链安全(第三方插件 / 基座)

- 应急响应:应急预案(流程 / 时限 / 责任人)、演练记录、处置措施、通报机制、恢复能力

- 持续监测:内容监控、异常检测、风险预警、迭代优化、季度安全审计

- 风险点 + 措施 + 验证结果:如 “内容违规→24 小时处置 + 溯源 + 整改→闭环管理”

(6)合规性验证

- 逐条对标:《生成式人工智能服务安全基本要求》160 + 项指标符合性说明

- 佐证材料:检测报告、授权文件、协议、日志、截图、测试数据

- 合规承诺:材料真实、接受监管、承担责

4、安全评估结论与建议

- 总体结论:是否符合备案要求、是否建议上线

- 风险清单:已解决 / 待整改 / 持续关注风险点、优先级、影响评估

- 整改计划:待整改项的措施、责任人、时限、验证标准

- 持续保障建议:监测频率、迭代周期、审计计划、合规升级

二、大模型安全评估报告撰写步骤

1、前期准备

- 组建团队:技术 + 算法 + 数据 + 法务 + 安全 + 产品联合撰写

- 明确依据:吃透《暂行办法》《安全基本要求》及地方细则

- 梳理材料:语料来源、训练日志、安全措施、测试数据、合规文件

- 设计评估方案:确定维度、方法、样本量、指标阈值

2、分项评估与数据采集

- 逐项开展评估:语料→模型→内容→数据→管理→应急

- 量化测试:按指标完成抽检、攻防、压力、合规测试,留存原始数据

- 风险识别:列出风险点、影响、现有措施、验证结果

- 证据收集:所有结论对应测试数据、截图、报告、协议

3、报告撰写

- 框架搭建:按上述模块搭建目录,统一格式、术语、编号

- 内容填充:先写分项评估,再写概况、方法、结论、附件

- 量化呈现:用表格 / 图表展示指标、合格率、对比数据

- 合规对标:逐条对应法规条款,明确 “符合 / 基本符合 / 不符合 + 整改”

4、 内审与整改

- 内部评审:技术 / 法务 / 安全交叉审核,查漏补缺

- 问题整改:针对不符合项完成整改、复测、更新报告

- 第三方检测(可选):委托具备资质机构出具检测报告,提升可信度

5、定稿与提交

- 排版优化:目录、页码、页眉页脚、字体统一、附件清晰

- 签字盖章:法定代表人签字、企业公章、骑缝章

- 提交备案:按网信办要求提交电子版 + 纸质版材料

三、安全评估报告撰写注意事项

1、合规性:对标精准、无遗漏

- 严格对标《生成式人工智能服务安全基本要求》160 + 项指标,不缺项、不模糊

- 明确引用法规条款,不笼统写 “符合相关规定”

- 覆盖数据、算法、内容、用户、应急、供应链全维度,尤其注意动态风险评估、第三方插件安全、数据跨境等易漏点

2、 量化性:用数据说话,拒绝主观

- 所有安全结论必须附量化指标 + 测试数据,如 “敏感拒答率 98%(测试 300 题)”

- 满足监管硬指标:语料抽检≥4000 条(合格率≥96%)、敏感拒答≥95%、境外语料≤30% 等

- 用表格 / 柱状图 / 折线图呈现对比、趋势、合格率,直观清晰

3、证据性:每结论必有支撑

- 每个风险点、措施、结果对应具体证据:测试报告、日志截图、授权合同、协议、抽检记录、演练记录

- 附件齐全、编号清晰、加盖公章,无证据不结论

4、专业性:表述规范、逻辑清晰

- 术语准确:SFT、RLHF、去标识化、提示注入、语义理解等,必要时注释

- 结构严谨:风险点→措施→验证→结论,逻辑闭环

- 语言专业但不晦涩,避免过度技术化导致审核人员难以理解

5、真实性:严禁造假、如实披露

- 数据真实、测试可复现、材料可追溯,严禁伪造检测数据、授权文件

- 如实披露风险与不足,说明整改措施与计划,隐瞒风险 = 备案失败

6、 完整性:模块齐全、附件规范

- 报告模块完整:概况→方法→分项→应急→合规→结论→附件,缺一不可

- 附件按顺序整理:检测报告、授权、规范、题库、日志、截图、记录等,便于审核查阅

7、 时效性:动态更新、持续评估

- 报告反映当前版本安全状态,模型迭代后需重新评估并更新报告

- 建立持续监测 + 季度审计 + 年度重评机制,体现动态安全保障能力

大模型备案需着重撰写安全评估报告,内容需结合模型具体情况针对性撰写,篇幅大多数控制在60-100页。撰写时需确保报告的合规性与可追溯性,严谨抄袭洗稿!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)