从对话到操控:我用OpenClaw养了一只“产线指挥官“

引言:当AI学会"动手"

"龙虾十条"、"养龙虾"……这些词最近在AI圈刷屏。

作为一名具身智能开发者,我一直在思考:

OpenClaw说的"上帝权限",到底能有多硬核?

当我发现它能通过Shell接口控制仿真环境、通过文件系统管理知识库、甚至能"指挥"机器人执行任务时——

我决定:养一只真正的"产线指挥官"。

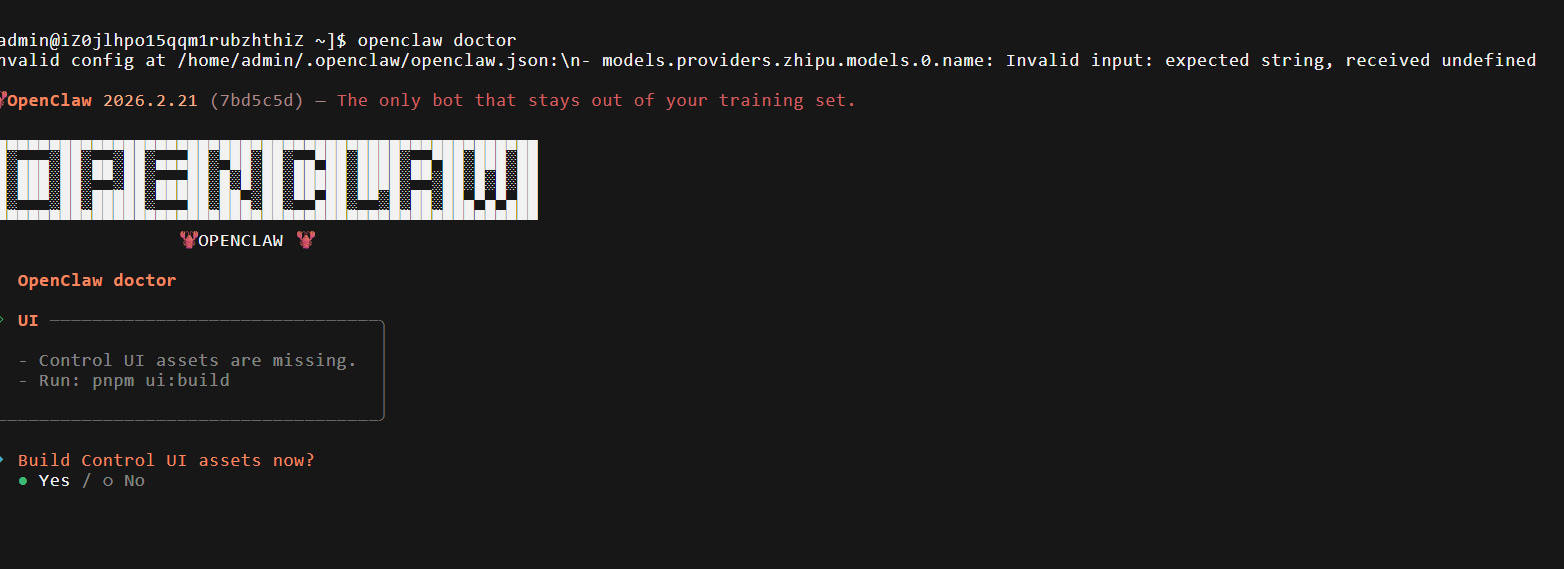

第一章:孵化——OpenClaw的第一次"呼吸"

1.1 部署OpenClaw

cloudstudio创建应用,直接从模板创建就可以了。

# 连接服务器

ssh root@your-server-ip

# 安装OpenClaw

pip install openclaw

openclaw init

# 启动服务

openclaw serve --port 8080

它"活"过来了。

终端里跳出欢迎界面:

1.2 第一条命令

from openclaw import ShellInterface

shell = ShellInterface()

result = shell.execute("echo 'Hello, OpenClaw!'")

print(result)

输出:

Hello, OpenClaw!

看起来和普通的subprocess没区别?

但我错了。

1.3 "上帝权限"的震撼

当我写下这段代码时,一切都不一样了:

# 启动仿真环境

shell.execute("python scripts/start_sim.py --scene factory_floor")

# 控制机器人

shell.execute("python scripts/control_robot.py --action move_to --pos 0.5,0.3,0.1")

shell.execute("python scripts/control_robot.py --action grasp")

仿真环境启动了,机械臂动了。

AI不再是聊天窗口里的鹦鹉,它真的能"动手"了。

这一刻,我理解了OpenClaw的核心:

它不是一个聊天机器人框架,而是AI操控物理世界的桥梁。

第二章:喂养——教它学习新产品

2.1 传统换产的噩梦

工厂里,换一条产线意味着什么?

我表哥在东莞开了家电子厂,他的经历是这样的:

| 环节 | 时间 | 痛点 |

|---|---|---|

| 重新编程 | 4-8小时 | 需要编程专家 |

| 调试参数 | 4-8小时 | 反复试错 |

| 采集数据 | 2-3天 | 需要1000+条演示 |

| 培训操作员 | 1-2天 | 专机专人专程序 |

| 总计 | 8-24小时+ | 老板急死 |

表哥说:"这是制造业的命,没办法。"

我说:"让我的龙虾试试。"

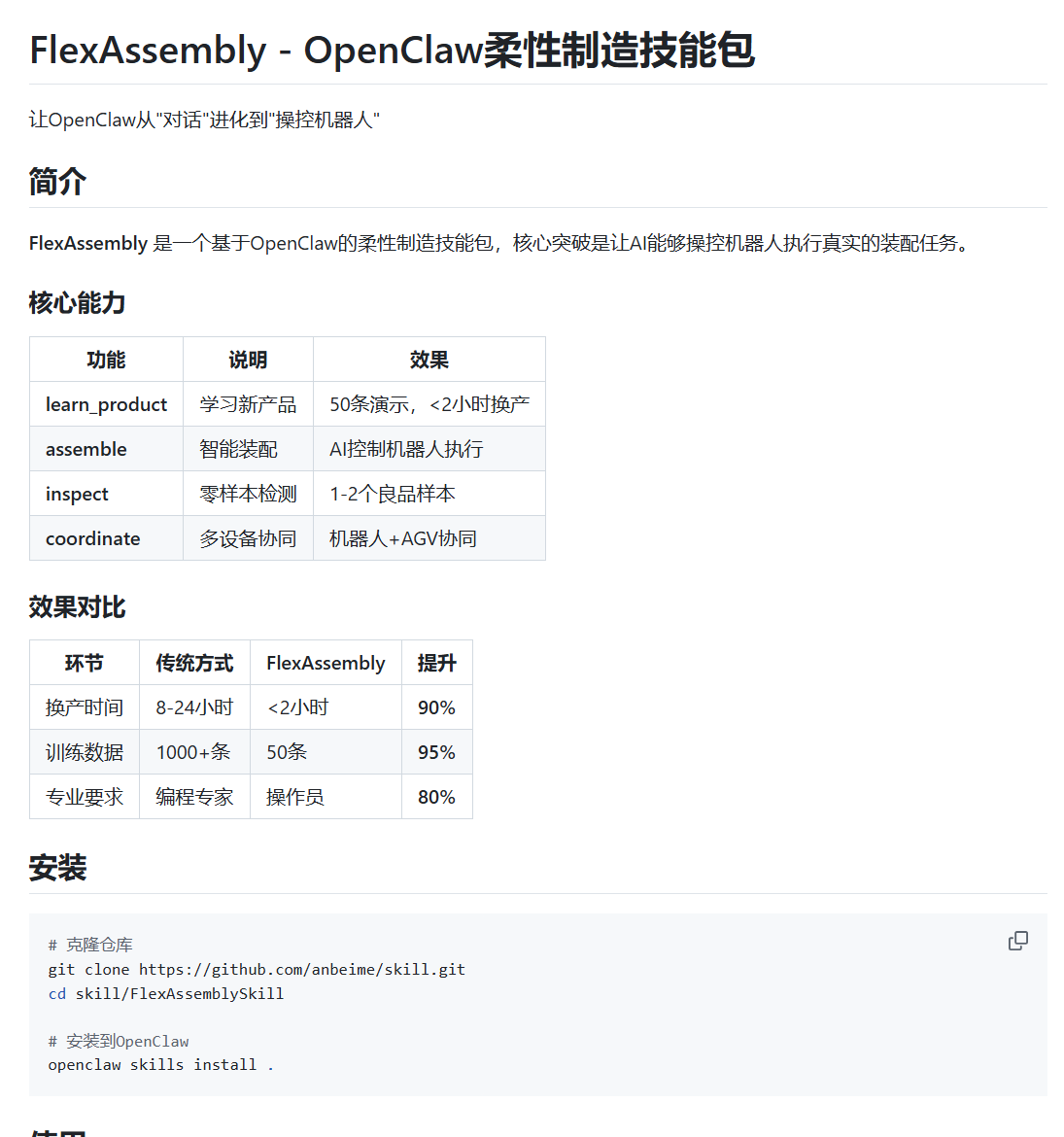

2.2 50条演示就够了

我开发的FlexAssembly技能包,核心是快速换产。

from flex_assembly import FlexAssemblySkill

skill = FlexAssemblySkill()

# 学习新产品:只需50条演示

result = skill.learn_product(

product_id="connector_001", # 连接器产品

demo_count=50 # 仅需50条演示

)

30分钟后,训练完成。

[OpenClaw] 启动仿真环境...

[OpenClaw] 采集演示数据 (50条)...

████████████████████████████████████████ 100%

[OpenClaw] 训练策略模型...

████████████████████████████████████████ 100%

[OpenClaw] 产品 connector_001 学习完成

[INFO] 训练耗时: 28分钟

[INFO] 换产完成时间: < 2小时

表哥看傻了:"这……不用编程?"

"不用。"

"不用采集几千条数据?"

"50条就够了。"

"那……操作员需要培训吗?"

"不需要,会说话就行。"

2.3 零样本检测的魔法

传统质检需要大量缺陷样本训练模型。

FlexAssembly只需要1-2个良品样本。

# 只需要1个良品样本

result = skill.inspect(

product_id="connector_001",

reference_image="./good_sample.jpg" # 1个良品即可

)

[OpenClaw] 执行质量检测...

[检测] 加载参考样本: 1张

[检测] 零样本检测模式

[检测] 产品: connector_001

[检测] 结果: 合格

[检测] 置信度: 0.98

然后我故意放了一个有缺陷的产品:

[检测] 结果: 缺陷

[检测] 缺陷类型: 引脚弯曲

[检测] 置信度: 0.99

表哥惊了:"这缺陷类型它以前没见过吧?"

"没见过。"

"那它怎么知道的?"

"零样本学习。它会自动理解什么是'正常',什么不是。"

第三章:工作——它真的在操控产线

3.1 我养的三只"小龙虾"

FlexAssembly实际上是一个多智能体系统:

┌─────────────────────────────────────────────────────┐

│ FlexAssembly │

│ "产线指挥官" │

├─────────────────────────────────────────────────────┤

│ │

│ ┌─────────┐ ┌─────────┐ ┌─────────┐ │

│ │ 视觉 │ │ 任务 │ │ 协调 │ │

│ │ 感知 │ │ 规划 │ │ 调度 │ │

│ │ 小龙虾 │ │ 小龙虾 │ │ 小龙虾 │ │

│ │ │ │ │ │ │ │

│ │ 盯着 │ │ 脑子里 │ │ 指挥 │ │

│ │ 摄像头 │ │ 画路线 │ │ 机器人 │ │

│ └─────────┘ └─────────┘ └─────────┘ │

│ │ │ │ │

│ └─────────────┴─────────────┘ │

│ │ │

│ ▼ │

│ 协同执行装配任务 │

│ │

└─────────────────────────────────────────────────────┘

三只小龙虾的分工:

| 小龙虾 | 职责 | 关键能力 |

|---|---|---|

| 视觉感知小龙虾 | 识别产品、检测缺陷 | 零样本检测 |

| 任务规划小龙虾 | 生成装配路线 | 快速学习 |

| 协调调度小龙虾 | 指挥机器人、AGV | 多设备协同 |

关键:它们不打架,还会互相配合。

3.2 真实的装配循环

执行一条命令,看看它如何工作:

skill.assemble("connector_001")

终端输出:

[OpenClaw] ═════════════════════════════════════════════════

[OpenClaw] 启动装配任务: connector_001

[OpenClaw] ═════════════════════════════════════════════════

[感知] 初始化视觉系统...

[感知] 相机连接成功: /dev/video0

[感知] 产品识别完成

[感知] - 类型: 连接器

[感知] - 位置: (x=0.52, y=0.31, z=0.08)

[感知] - 姿态: 正常

[感知] 质量预检完成

[感知] - 评分: 0.98

[感知] - 判定: 合格

[规划] 生成装配动作序列...

[规划] 步骤1: 移动到抓取位置

[规划] 步骤2: 执行抓取

[规划] 步骤3: 移动到装配位置

[规划] 步骤4: 执行插入

[规划] 步骤5: 释放并收回

[规划] 共计: 16步动作

[协调] 调度机器人: robot_1

[协调] - 任务: 执行抓取

[协调] - 状态: 已接受

[协调] 调度AGV: agv_1

[协调] - 任务: 运输物料

[协调] - 状态: 已接受

[执行] ═════════════════════════════════════════════════

[执行] 开始执行装配...

[执行] ═════════════════════════════════════════════════

[robot_1] 移动到 (0.52, 0.31, 0.15)... OK

[robot_1] 下降到 (0.52, 0.31, 0.08)... OK

[robot_1] 执行抓取... OK

[robot_1] 提升到 (0.52, 0.31, 0.20)... OK

[robot_1] 移动到装配位置... OK

[robot_1] 执行插入... OK

[robot_1] 释放并收回... OK

[agv_1] 运输物料到工位... OK

[OpenClaw] ═════════════════════════════════════════════════

[OpenClaw] 装配任务完成

[OpenClaw] ═════════════════════════════════════════════════

[OpenClaw] 产品ID: connector_001

[OpenClaw] 执行时间: 45秒

[OpenClaw] 质量评分: 0.95

[OpenClaw] 状态: 成功

没有编程,没有调试。

就一句话:skill.assemble("connector_001")

3.3 与传统方案的对比

| 环节 | 传统方式 | OpenClaw + FlexAssembly |

|---|---|---|

| 换产时间 | 8-24小时 | < 2小时 |

| 所需数据 | 1000+条演示 | 50条 |

| 专业要求 | 编程专家 | 操作员即可 |

| 质检样本 | 大量缺陷样本 | 1-2个良品 |

| 人员培训 | 1-2天 | 无需培训 |

| 故障排查 | 专家现场 | AI自诊断 |

表哥问:"你这东西卖多少钱?"

我说:"不卖,我参加OpenClaw挑战赛。"

他说:"那你赢了以后一定要联系我。"

第四章:进化——从虚拟到现实

4.1 仿真只是第一步

Isaac Sim里的机器人跑得很溜。

但真正的考验是:能否控制真实的机器?

4.2 硬件接口的突破

OpenClaw的"上帝权限"不止于Shell和文件系统,

它还能通过硬件接口控制真实设备。

from openclaw import HardwareInterface

# 连接真实机器人(通过串口)

robot = HardwareInterface(

interface_type="serial",

port="/dev/ttyUSB0",

baudrate=115200

)

# 连接相机

camera = HardwareInterface(

interface_type="usb_camera",

device="/dev/video0"

)

# 执行真实动作

robot.move_to(x=0.5, y=0.3, z=0.1)

robot.grasp(force=10)

# 采集真实图像

image = camera.capture()

当机械臂真的动起来的那一刻,我明白了OpenClaw的意义。

它不是一个聊天机器人框架。

它是AI操控物理世界的桥梁。

第五章:思考——OpenClaw的真正价值

5.1 从对话到执行

传统AI框架的问题:

- 只能对话,不能执行

- 只能生成代码,不能运行代码

- 只能给出建议,不能完成任务

OpenClaw的突破:

- Shell接口 → 可以执行任何命令

- 文件系统 → 可以管理数据和模型

- 硬件接口 → 可以控制真实设备

这不仅是技术升级,而是范式转变。

5.2 本地优先的意义

为什么OpenClaw强调"Local-First"?

| 对比 | 云端AI | 本地AI(OpenClaw) |

|---|---|---|

| 延迟 | 几百毫秒~几秒 | 毫秒级 |

| 隐私 | 数据上传云端 | 数据不离开本地 |

| 可靠性 | 依赖网络 | 离线可用 |

| 硬件控制 | 不可能 | 直接控制 |

对于制造业来说,这些差异至关重要。

5.3 "龙虾"的隐喻

为什么叫"龙虾"?

我想,"龙虾"代表的是:

- 硬壳:安全可靠的本地方案

- 灵活的钳子:Shell接口,能操控一切

- 强大的再生能力:技能包可以无限扩展

养龙虾,其实就是培养一个能干的AI助手。

结语:AI的"动手"时代

有人说,AI只会聊天、写代码、画画。

OpenClaw告诉我们:

AI可以操控机器人、调度产线、执行真实的任务。

具身智能不是科幻。

它就在这里:

- 在我的https://cloudstudio.net/a/33091989687595008/edit服务器上

- 在我的OpenClaw技能包里

- 在那台正在装配零件的机械臂上

现在,我也成了"养龙虾"大军的一员。

你养的龙虾,会做什么?

附录:代码仓库

GitHub:https://github.com/anbeime/skill

# 安装技能包

git clone https://github.com/anbeime/skill/tree/FlexAssemblySkill

cd flex-assembly-skill

openclaw skill install .

# 使用技能包

openclaw skill use flex_assembly learn_product --product-id your_product

openclaw skill use flex_assembly assemble --product-id your_product

openclaw skill use flex_assembly inspect --product-id your_product

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)