深度剖析 AI 助力医疗行业:从理论到实践全流程

章节一:AI医疗:从实验室到临床一线的全景图

一、前言

从影像初筛到手术导航,从病历生成到药物研发,人工智能正以前所未有的深度重塑医疗健康全链条。这不仅是技术的演进,更是一场关乎效率、精准与可及性的深刻变革。

1、如下图“AI辅助医疗手术”:

2、核心进展:规模化落地已成现实

当前,AI医疗已告别早期试点,进入规模化应用阶段。国家政策明确支持,84个典型应用场景为技术落地提供了清晰路径。在基层,AI工具通过县域医共体快速覆盖,2025年县域远程医学影像诊断服务量已超6800万人次,成为基层医疗的重要支撑。

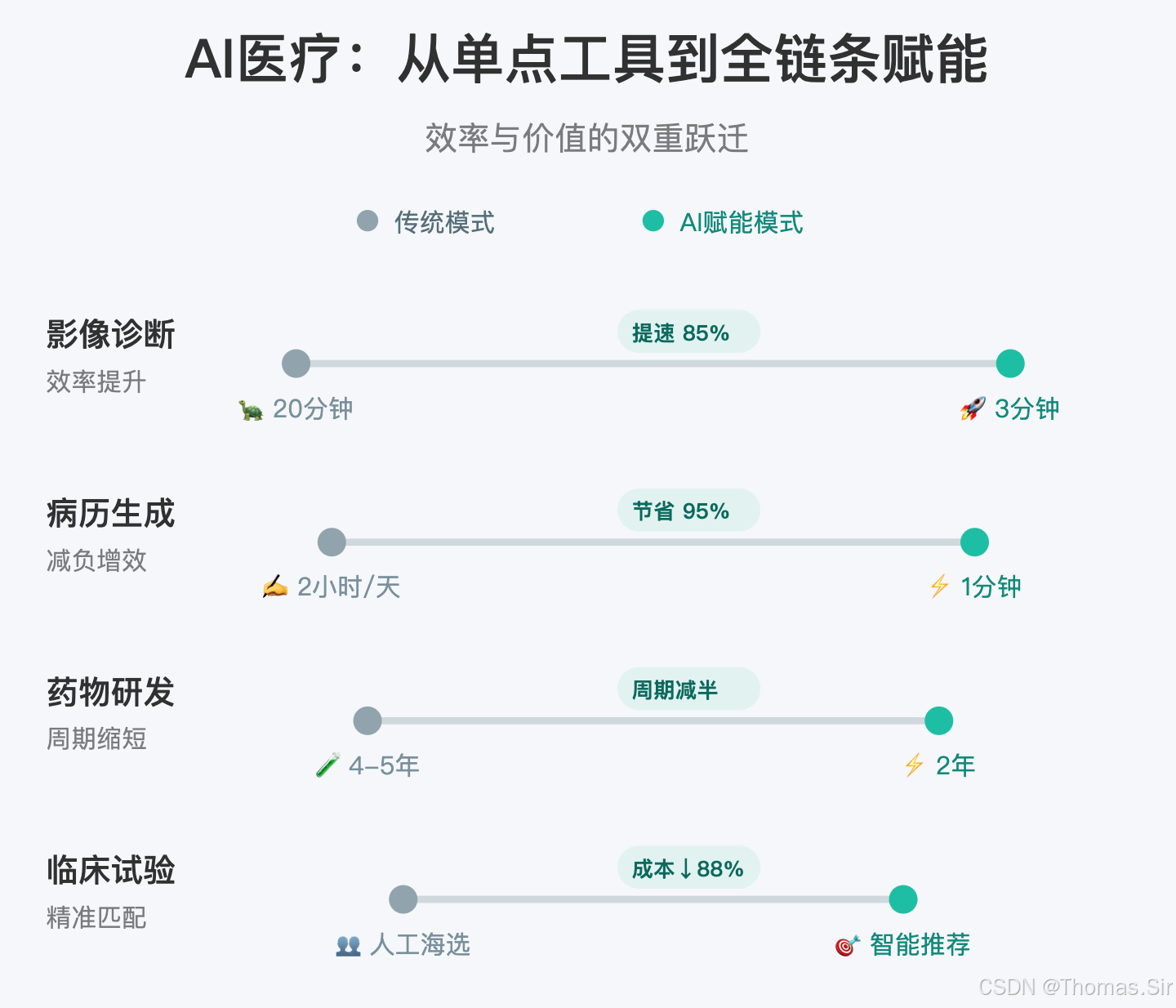

二、落地全景:四大核心场景深度赋能

AI的渗透已从单点工具演变为贯穿“预防-诊疗-康复-管理”的全链条系统赋能。其价值兑现依赖于对临床与运营场景的深刻理解,以及能让医院、医生、患者等多方买单的商业模式。

1. 临床诊疗:医生的“超级助手”

在诊疗一线,AI正成为医护人员不可或缺的伙伴,形成“人机接力”的新模式。

- 影像诊断:AI可将主动脉夹层诊断时间从15-20分钟压缩至3分钟,肺结节筛查工作量减少30%-50%,诊断效率整体提升30%。系统能自动标记病灶并生成结构化初报,医生负责最终复核。

- 辅助决策:集成在医生工作站的大模型能快速提取检验报告异常指标,结合指南生成诊断提示与治疗方案建议,供医生参考与调整。

- 手术规划:基于CT数据的AI三维重建技术,能实现从“评估式粗放解剖”到“导航式精细解剖”的飞跃,帮助医生在术中最大化保留健康组织。

医生使用AI三维模型图:

2. 医院运营:流程的“智能引擎”

AI深入医院后台,优化资源配置,解放人力,其商业价值清晰可量化。

应用环节 代表案例与价值 商业模式 床位调度 Qventus:用预测算法优化排床,平均住院日缩短0.6天。 按床位年费+节约分成。 病历生成 Abridge:将医患对话实时转为带计费码的结构化病历,每天为医生节省2小时。 按医师席位销售SaaS。 患者服务 Assort Health:AI语音代理处理预约、咨询等高重复性前台任务。 年度经常性收入(ARR)模式。

3. 药物研发:周期的“加速器”

AI通过分析海量数据,正在重塑漫长的药物研发流程。

- 靶点发现与虚拟筛选:如百度“文心生物计算大模型”能提升化合物数据库质量,显著提高虚拟筛选的效率和准确性。

- 临床试验:医渡科技的智能筛选系统为肿瘤类项目平均节省88.5%的人工筛查成本。Outcomes4Me则用NLP技术为癌症患者精准匹配临床试验,按“成功入组”向药企收费。

- 数据驱动研发:Tempus平台整合基因组、临床数据,为药企提供研发服务与去标识化数据SaaS,2025年Q2单季收入达3.15亿美元。

4. 健康管理:院外的“守护者”

借助可穿戴设备与AI,健康管理从医院延伸至家庭,构建连续照护体系。

例如,APUS医疗大模型在河南省儿童医院提供智能分诊、诊中提醒等服务,有效缓解资源紧张。针对认知障碍的AI数字诊疗平台,则能实现一对多的高效评估与干预训练。

⚠️ 跨越鸿沟:落地面临的四大挑战

数据之困:碎片化与隐私悖论

高达80%的三甲医院未建立系统化数据共享机制,形成“数据孤岛”。同时,患者隐私保护与数据共享存在天然矛盾,尤其在罕见病领域,样本不足严重限制模型泛化能力。

技术之限:“黑箱”与适配难题

深度学习模型缺乏可解释性,导致临床信任危机。许多产品与临床工作流脱节,反而增加医生负担,且高昂的部署成本让基层医院望而却步。

伦理与监管:责任模糊与标准缺失

当AI诊断出错,责任在算法、医院还是医生?法律界定尚不清晰。全球监管标准不一(如欧盟重临床证据,美国重算法可解释性),也增加了企业合规成本。

三、破局之路:构建协同生态

面对挑战,行业正在从政策、技术、生态多维度寻求破局。

- 政策驱动:国家推动建立高质量医疗数据集和可信数据空间,促进数据互联互通。

- 技术攻坚:采用联邦学习、差分隐私等技术,实现“数据可用不可见”。企业推出轻量化方案,降低基层落地门槛。

- 生态协同:最终需要构建“企业、医院、科研机构、监管部门”四位一体的协同生态,形成“研发-验证-落地-优化”的闭环。

四、未来展望:从赋能到重塑

AI不会取代医生,但会重塑医疗岗位结构,催生大量人机协作的新型岗位。长远来看,AI将从辅助工具升级为行业核心赋能引擎,衍生出精准医疗团队、远程诊疗联盟等多元业态,推动医疗服务向全流程、多维度赋能转变。

其发展将沿着三个方向深化:从辅助诊断向预防医学延伸;构建整合多学科数据的智能诊疗平台;并通过智能调度实现医疗资源的优化配置。

章节二:基层医院引入AI:从规划到落地的全流程指南

AI不再是三甲医院的专属。随着国家政策推动与技术下沉,基层医院正迎来智能化转型的黄金窗口期。从影像诊断到慢病管理,从辅助决策到流程优化,人工智能正成为提升基层医疗服务能力、破解资源不均的关键工具。

根据国家卫健委等五部门联合发布的《关于促进和规范“人工智能+医疗卫生”应用发展的实施意见》,到2030年,基层诊疗智能辅助应用将基本实现全覆盖。这意味着,未来几年将是基层医院引入AI的关键时期。

第一步:明确引入目标与场景

引入AI不是盲目跟风,而是为了解决具体问题。基层医院应优先选择那些“痛点突出、效果明显”的场景进行试点。

🔍 四大高价值应用方向

🩺 临床诊疗辅助

针对基层常见病、多发病,建立智能辅助诊疗应用,向基层医生提供辅助诊疗、处方审核等服务。例如,AI可自动识别肺部CT片中的结节,将诊断时间从15-20分钟压缩至3分钟,大幅提升效率。

📊 医学影像诊断

强化县域医共体内医学影像、心电诊断等资源共享中心作用,推广“分布式检查、集中式诊断”的AI赋能模式。这能有效弥补基层放射科医生不足的短板。

📈 慢性病管理

建立智能慢性病管理和个人健康画像应用,面向高血压、糖尿病等患者开展筛查、评估和个性化干预。通过可穿戴设备数据+AI预测,实现从被动治疗向主动健康管理转型。

⚙️ 医院管理与服务

优化患者服务流程,提供智能预约分诊、预问诊、随访等全流程服务。同时加强医疗质量、费用等数据的智能分析,提升管理效能。

第二步:选择适配的技术路径

基层医院信息化水平参差不齐,必须选择“轻量化部署、低成本可及”的技术方案。核心是确保在现有条件下稳定运行。

💡 技术部署的两种模式

云端协同模式

对于网络条件较好的机构,采用“云端分析+本地轻量客户端”模式。复杂的AI模型在云端运行,基层只需调用接口,大幅降低对本地设备性能的要求。

边缘计算模式

针对网络不稳定的偏远地区,可在县域医共体中心部署边缘计算节点,通过区域级算力中心按需分发资源,支持基层快速构建最小可行产品。

关键工具栈参考:

- 数据采集:智能手环、血糖仪等可穿戴设备

- 模型训练:NVIDIA Clara等医疗AI框架

- 部署应用:Docker + Kubernetes容器化部署

- 系统架构:模块化、微服务化平台设计

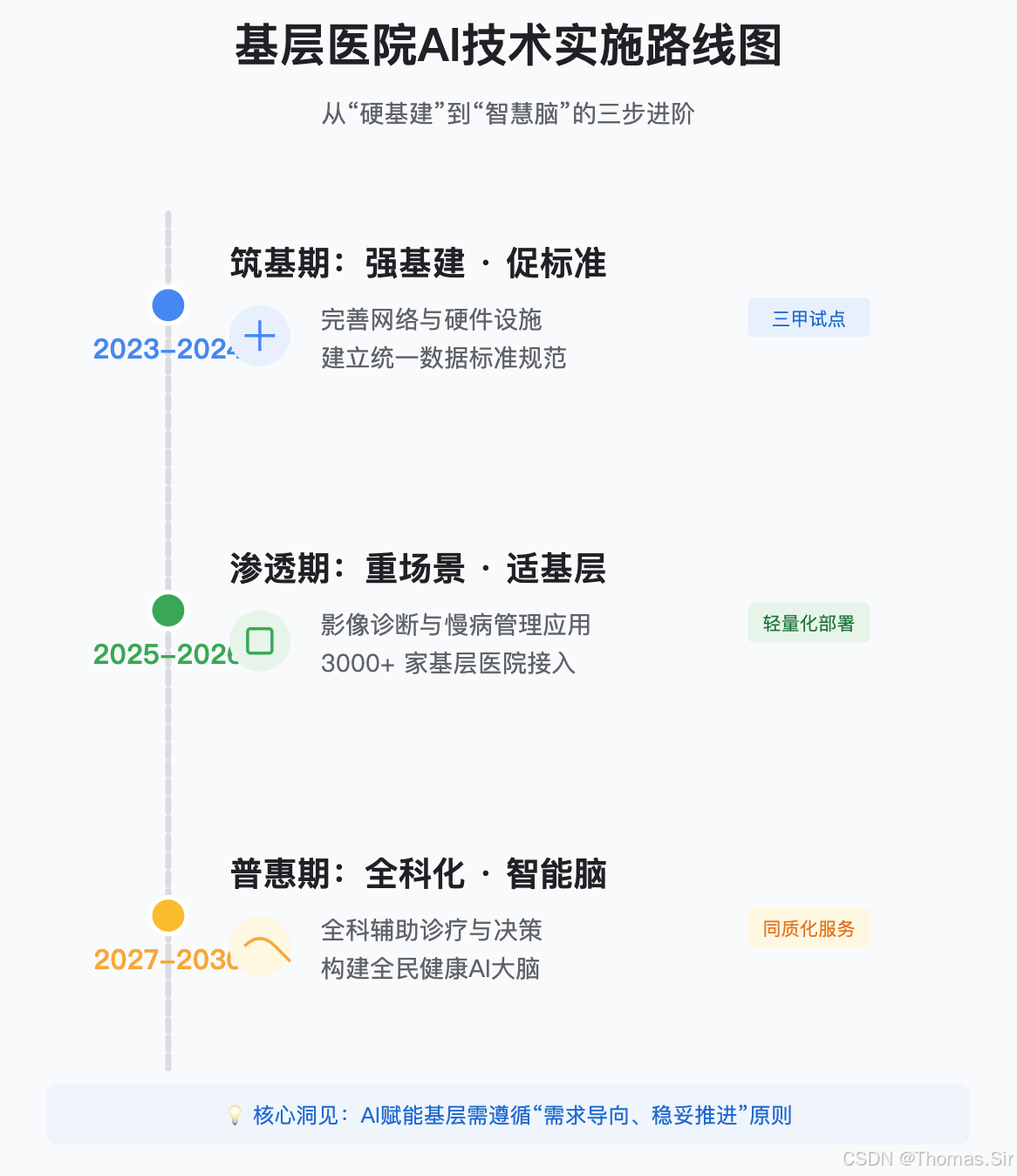

第三步:构建实施路线图

成功的AI引入需要分阶段、有步骤地推进。以下是一个参考性的三年实施路线图,基层医院可根据自身情况调整。

🗓️ 分阶段实施重点

📅 第一年:试点与基础建设(6-12个月)

- 需求评估与场景选择:调研本院最迫切的临床需求,选择1-2个高价值场景(如肺结节筛查、心电图自动分析)

- 基础设施升级:评估并升级网络、存储等基础环境,确保满足AI应用最低要求

- 数据标准化:按照FHIR等国际标准整理历史数据,建立数据治理规范

- 小范围试点:在1-2个科室部署试点应用,收集使用反馈

📅 第二年:推广与整合(13-24个月)

- 应用扩展:将成功试点推广至3-5个核心科室

- 系统集成:将AI应用与现有HIS、PACS等系统深度整合,避免形成新的信息孤岛

- 医共体协同:依托紧密型县域医共体,建立区域级AI诊断中心,实现资源共享

- 效果评估:建立量化评估体系,衡量AI应用在效率、质量、成本等方面的实际价值

📅 第三年:深化与优化(25-36个月)

- 全院覆盖:实现主要临床科室AI辅助全覆盖

- 模式创新:探索“按效果付费”等新型商业模式,如AI辅助诊断按使用次数收费

- 数据价值挖掘:在合规前提下,利用脱敏数据参与区域医疗研究

- 持续优化:基于实际数据反馈,持续迭代AI模型与应用

第四步:规避风险与建立保障

AI医疗涉及患者安全、数据隐私等敏感问题,必须建立完善的风险防控体系。

| 风险类型 | 具体表现 | 应对策略 |

|---|---|---|

| 技术风险 | 算法“黑箱”导致误诊漏诊;系统不稳定影响诊疗流程 | 采用可解释AI技术;建立系统冗余和灾备机制;明确AI仅为辅助工具,医生拥有最终决策权 |

| 数据风险 | 患者隐私泄露;数据质量不高影响模型准确性 | 应用联邦学习、隐私计算等技术;建立数据脱敏和授权管理制度;制定数据质量标准和清洗流程 |

| 合规风险 | AI生成的病历、处方法律效力存疑;责任划分不明确 | 参与行业标准制定;建立AI应用审核和备案制度;明确人机协作的责任边界 |

| 接受度风险 | 医护人员抵触使用;患者不信任AI诊断 | 开展系统性培训,让医生理解AI是“助手”而非“替代”;加强患者教育,透明化AI决策过程 |

🛡️ 四大保障体系

制度保障

制定《AI医疗应用管理办法》,明确使用规范、数据管理、应急预案等制度。

组织保障

成立由院领导牵头的AI推进小组,下设技术、临床、管理三个工作组。

人才保障

培养“医学+AI”复合型人才,与高校合作开设专项培训课程。

资金保障

争取政府专项补助、探索“建设-运营-转移”等多元投入模式。

成功关键与未来展望

基层医院引入AI的本质不是技术采购,而是医疗服务模式的系统性升级。成功的关键在于“务实融合”——技术必须深度适配基层实际工作流。

🚀 五大成功要素

- 一把手工程:院级领导亲自推动,打破部门壁垒

- 临床驱动:从医生实际痛点出发,而非技术炫技

- 渐进式推进:从小场景试点开始,积累信心后再扩大

- 生态合作:与科技公司、上级医院、医共体成员形成合力

- 持续运营:建立长效培训、反馈和优化机制

章节三:AI赋能手环:从硬件到算法的实战指南

当AI算法遇见可穿戴硬件,智能手环便从简单的计步器进化为全天候的健康伴侣。这不仅是代码与传感器的结合,更是数据科学与嵌入式系统的深度交融。

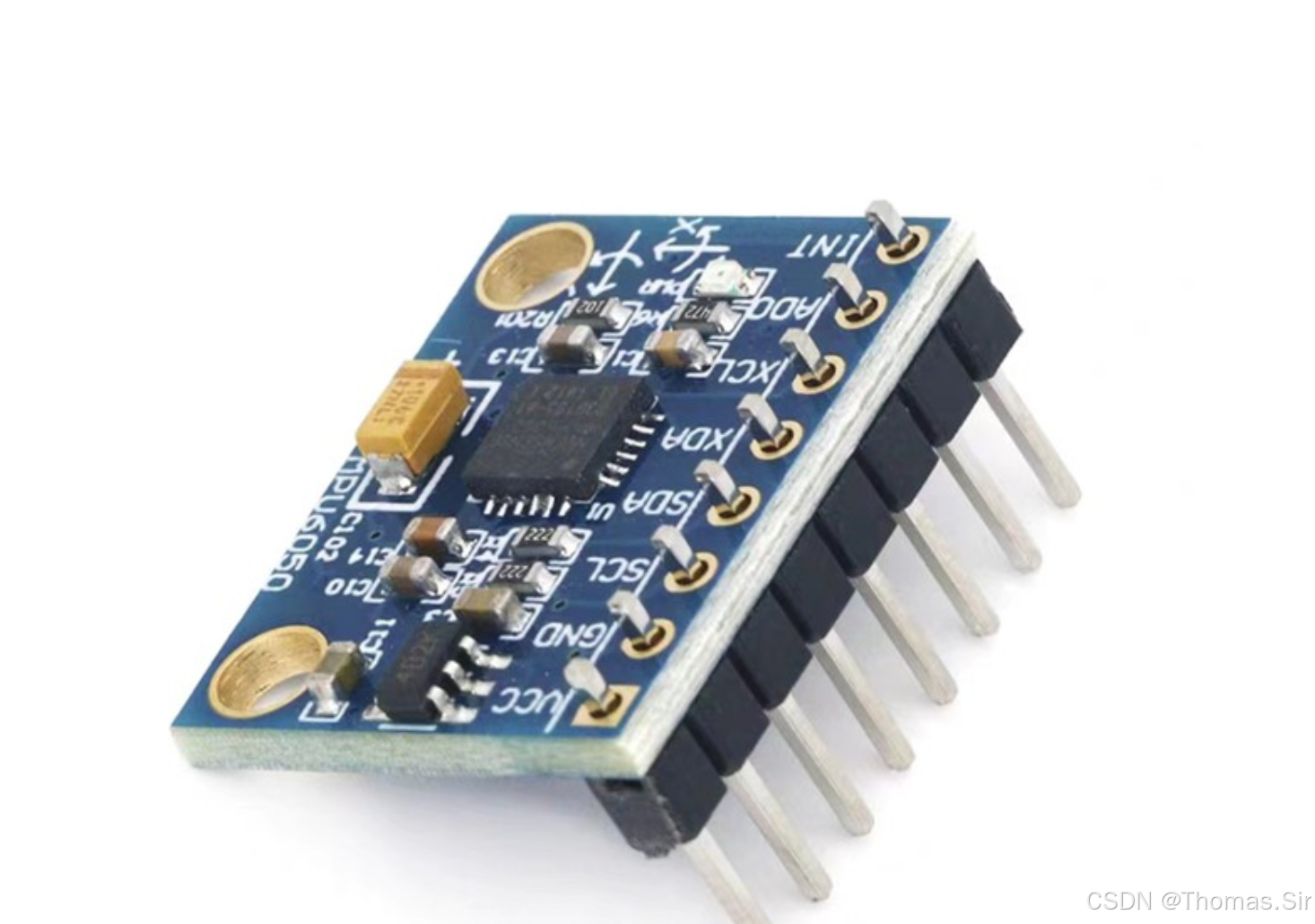

智能手环内部电路板:

将AI接入智能手环,意味着让手环具备“理解”数据的能力——从原始加速度信号中识别运动模式,从心率波动中预判健康风险,从睡眠节律中优化作息建议。这背后是一套完整的硬件选型、数据采集、算法部署与软件集成的技术栈。

一、硬件架构:手环的“感官系统”

一个典型的智能手环硬件系统由多个传感器模块构成,它们如同手环的“感官”,负责采集原始数据。

核心传感器模块

📊运动传感器 (MPU6050)

集成了3轴加速度计和3轴陀螺仪,用于捕捉步态、姿态和运动类型。其16位ADC可测量±2g至±16g范围内的加速度,是计步和活动识别的基础。

❤️生物传感器 (如EM7028)

用于监测心率、血氧饱和度(SpO₂)等生命体征。通过光电体积描记法(PPG)采集信号,为AI分析心血管健康提供数据源。

🧭环境传感器

包括气压计(如SPL06-001)用于海拔测算,磁力计(如LSM303DLHC)实现电子指南针功能,共同构建运动的环境上下文。

MPU6050六轴运动传感器模块:

这些传感器通过I2C或SPI总线与主控MCU(如STM32系列)通信。MCU负责初步的数据滤波、融合,并通过蓝牙模块(如HC-06或KT6368A)将数据实时传输至手机App或云端 。手环通常设计有三种运行模式以平衡功能与功耗:全功能运行模式、低功耗睡眠模式(MCU休眠,仅传感器工作)和完全关机模式。

二、数据流与通信协议

硬件采集的原始数据需要经过标准化处理才能被AI算法有效利用。以MPU6050为例,其输出的原始数字量需要根据设定的量程(如±2g)转换为实际的加速度值(单位:g)。

数据帧设计与传输

下位机(手环)通常以固定频率(如10ms一次)打包传感器数据,通过蓝牙串口发送给上位机(手机App)。一个典型的数据帧格式如下:

#X_ACC Y_ACC Z_ACC$ // 示例:'#'为帧头,'$'为帧尾,中间为三轴加速度值在单片机程序中,数据发送逻辑可能如下所示:

while (1) { SendByte('#'); // 发送帧头 SendData(GetData(0x3B)); // 发送X轴加速度 SendData(GetData(0x3D)); // 发送Y轴加速度 SendData(GetData(0x3F)); // 发送Z轴加速度 SendByte('$'); // 发送帧尾 delay(20); // 延时20ms }

手机端App需要建立一个高效的数据接收与处理机制。由于下位机发送频率高,为避免数据拥堵,可以采用“自动更新的环形栈”数据结构。该结构像一个环形缓冲区,新数据不断覆盖旧数据,读取指针始终指向最新的有效数据段,实现生产与消费线程的解耦。

三、AI算法集成实战

AI能力的核心在于算法模型。对于资源受限的手环端,通常采用“端云协同”的策略:轻量级模型在设备端实时运行,复杂模型在云端进行深度分析。

1. 基础算法:阈值法计步

最简单的AI是规则引擎。例如,通过分析三轴加速度的合加速度值,设定一个阈值来判断是否完成一次有效步伐。当合加速度超过阈值时计步数加一。这种方法实现简单,但容易受干扰产生误判。2. 进阶算法:模式识别

更智能的方法是使用机器学习模型(如决策树、支持向量机或轻量级神经网络)对加速度和陀螺仪数据进行分类,识别步行、跑步、骑行、睡眠等不同状态。这些模型需要在云端用大量标注数据训练,然后转换为TensorFlow Lite或ONNX Runtime等格式部署到手环MCU上。3. 健康预警算法

基于心率变异性(HRV)、静息心率和血氧趋势,可以构建异常检测模型。例如,持续的高静息心率结合睡眠质量下降,可能提示过度疲劳或潜在健康风险。这类算法通常运行在手机App或云端,手环负责提供高质量、连续的数据流。

四、软件开发与集成

完整的AI手环系统涉及嵌入式端、移动端和云端三层开发。

| 开发层面 | 技术栈与工具 | 核心任务 |

|---|---|---|

| 嵌入式端 (手环) | C/C++, FreeRTOS, STM32CubeMX, I2C/SPI驱动 | 传感器驱动、数据采集、滤波、蓝牙通信、轻量级AI模型推理 |

| 移动端 (App) | Android (Java/Kotlin) 或 iOS (Swift), 蓝牙SDK (如MiBand SDK), 图表库 (如AChartEngine) | 设备连接与管理、数据接收与可视化、用户交互、与云端API通信 |

| 云端 | Python, TensorFlow/PyTorch, 云数据库, RESTful API | 大数据存储、复杂模型训练与优化、用户数据分析、生成健康报告与洞察 |

对于Android开发者,可以利用现有的SDK加速开发。例如,小米手环的MiBand SDK封装了底层的蓝牙通信协议,提供了连接管理、数据读取、通知提醒等高级接口,让开发者能更专注于应用逻辑而非蓝牙细节。集成后,通过几行代码即可监听实时步数变化。

五、测试与优化

开发完成后, rigorous testing is crucial。自动化测试框架如Appium可用于模拟用户操作,验证从蓝牙连接、数据同步到界面显示的全流程功能 。性能测试需关注手环的续航时间、数据测量的准确性(如计步误差率)以及App在不同手机型号上的稳定性。

功耗是智能手环的关键指标。优化策略包括:利用MCU的低功耗模式、优化传感器采样频率、在蓝牙传输中采用数据压缩和批量发送、以及优化AI模型的推理效率,例如使用量化技术减小模型体积和计算量。

🚀 快速启动清单

- 第一步:硬件选型与原型搭建:选择主控MCU(如STM32)、传感器(MPU6050、心率模块)、蓝牙模块,完成电路焊接与调试。

- 第二步:嵌入式软件开发:编写传感器驱动、实现数据采集与蓝牙传输协议,完成基础固件。

- 第三步:手机App开发:实现蓝牙扫描与连接,建立稳定数据通道,完成数据接收与基础显示界面。

- 第四步:算法开发与集成:从简单的阈值算法开始,逐步引入更复杂的机器学习模型,先在PC端验证,再尝试部署到设备端。

- 第五步:系统联调与测试:进行端到端功能测试、功耗测试和用户体验测试,迭代优化。

六、总结

将AI接入智能手环,是一个融合硬件工程、嵌入式软件、移动开发和数据科学的综合性项目。它始于一个传感器信号,经过算法的提炼,最终转化为对用户有意义的健康洞察。这场始于芯片,终于体验的旅程,正是软硬件协同创新的魅力所在。

章节四、AI驱动的精准计步实战

现代计步算法已从简单的阈值判断演进为基于AI的动态自适应系统。通过融合传感器数据、机器学习模型和实时优化,可实现95%以上的准确率,同时将功耗控制在合理范围。

一、技术架构演进

三层架构设计:

感知层: 高精度传感器阵列(加速度计+陀螺仪+磁力计)

算法层: 动态阈值+机器学习模型

应用层: 用户行为分析+健康建议

二、AI算法实现路径

1. 信号预处理阶段

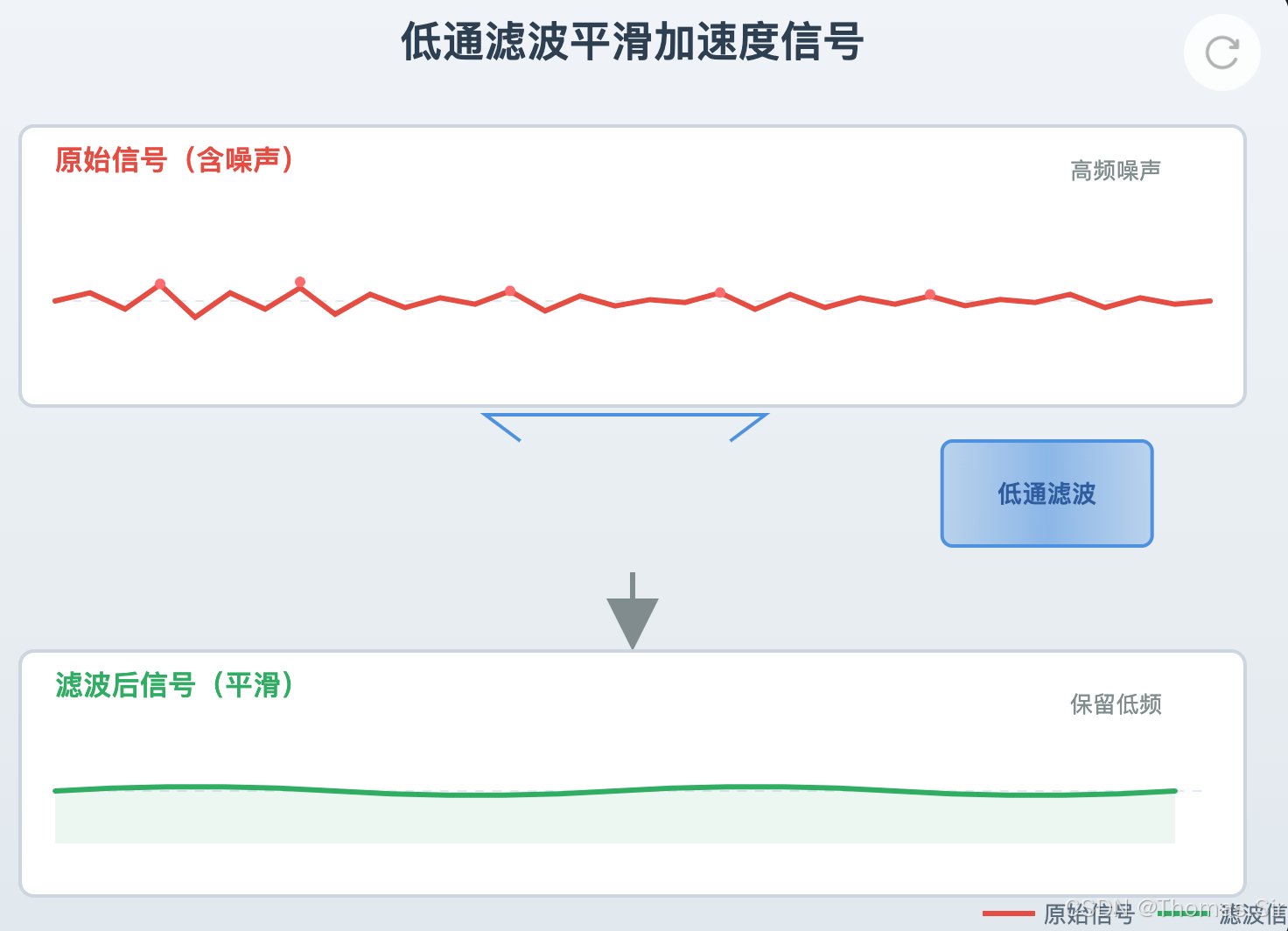

使用巴特沃斯低通滤波器消除高频噪声,采样频率建议设置为100Hz以平衡精度与功耗。关键参数:截止频率2Hz,滤波器阶数4阶。

2. 动态阈值检测

传统固定阈值算法准确率仅70-80%,而动态阈值算法能自适应不同用户步态。通过指数移动平均更新阈值:

threshold = threshold * 0.9 + magnitude * 0.1

配合步频验证(正常步频范围60-120步/分钟)可过滤异常峰值。

3. 机器学习增强

采用轻量级CNN模型(如MobileNetV3)处理滑动窗口数据,识别步态特征模式。实验显示,融合CNN与LSTM的混合模型在公开数据集上准确率达98.2%。

关键创新:GaitSet算法将步态视为无序集合,突破视角变化限制。

三、代码实现

import numpy as np

from scipy import signal

import tensorflow as tf

class AIStepCounter:

def __init__(self):

self.sample_rate = 100 # Hz

self.cutoff = 2.0 # Hz

self.order = 4

self.threshold = 1.2

self.min_interval = 0.3 # seconds

self.last_peak_time = 0

self.model = self.build_cnn_model()

def build_cnn_model(self):

"""构建轻量级CNN模型"""

model = tf.keras.Sequential([

tf.keras.layers.Conv1D(16, kernel_size=5, activation='relu', input_shape=(50, 3)),

tf.keras.layers.MaxPooling1D(2),

tf.keras.layers.Conv1D(32, kernel_size=5, activation='relu'),

tf.keras.layers.GlobalAveragePooling1D(),

tf.keras.layers.Dense(16, activation='relu'),

tf.keras.layers.Dense(1, activation='sigmoid')

])

model.compile(optimizer='adam', loss='binary_crossentropy')

return model

def filter_signal(self, data):

"""巴特沃斯低通滤波"""

nyquist = 0.5 * self.sample_rate

normal_cutoff = self.cutoff / nyquist

b, a = signal.butter(self.order, normal_cutoff, btype='low', analog=False)

return signal.filtfilt(b, a, data)

def detect_steps(self, x, y, z):

"""AI增强的步态检测"""

magnitude = np.sqrt(np.array(x)**2 + np.array(y)**2 + np.array(z)**2)

filtered = self.filter_signal(magnitude)

# 动态阈值更新

self.threshold = self.threshold * 0.9 + filtered[-1] * 0.1

# 峰值检测

steps = 0

current_time = 0.01 # 100Hz sampling

if (filtered[-1] > filtered[-2] and

filtered[-1] > filtered[-3] and

filtered[-1] > self.threshold * 1.1):

if (current_time - self.last_peak_time) > self.min_interval:

steps = 1

self.last_peak_time = current_time

# CNN特征提取(每50样本处理一次)

if len(filtered) % 50 == 0:

window = filtered[-50:].reshape(1, 50, 1)

prediction = self.model.predict(window, verbose=0)

if prediction > 0.5:

steps = 1

return steps

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献200条内容

已为社区贡献200条内容

所有评论(0)