基于YOLO26的人体行为姿态(五类动作)智能分析系统|完整源码+PyQt5界面+训练与部署全流程

基于YOLO26的人体行为姿态(五类动作)智能分析系统|完整源码+PyQt5界面+训练与部署全流程

研究背景与技术意义

人体行为姿态分析是计算机视觉领域的一个重要研究方向,其应用范围涵盖了智能安防监控、人机交互体验、体育运动训练、智能家居控制、医疗康复辅助等众多领域。准确、快速地识别和分析人体姿态,对于提升系统的智能化水平具有重要意义。传统的人体姿态检测方法主要基于两阶段的检测策略,首先通过目标检测算法定位人体区域,然后在人体区域内进行关键点检测,最后根据关键点信息进行姿态分析。这种方法虽然能够获得较为精确的检测结果,但计算复杂度较高,难以满足实时应用的需求。

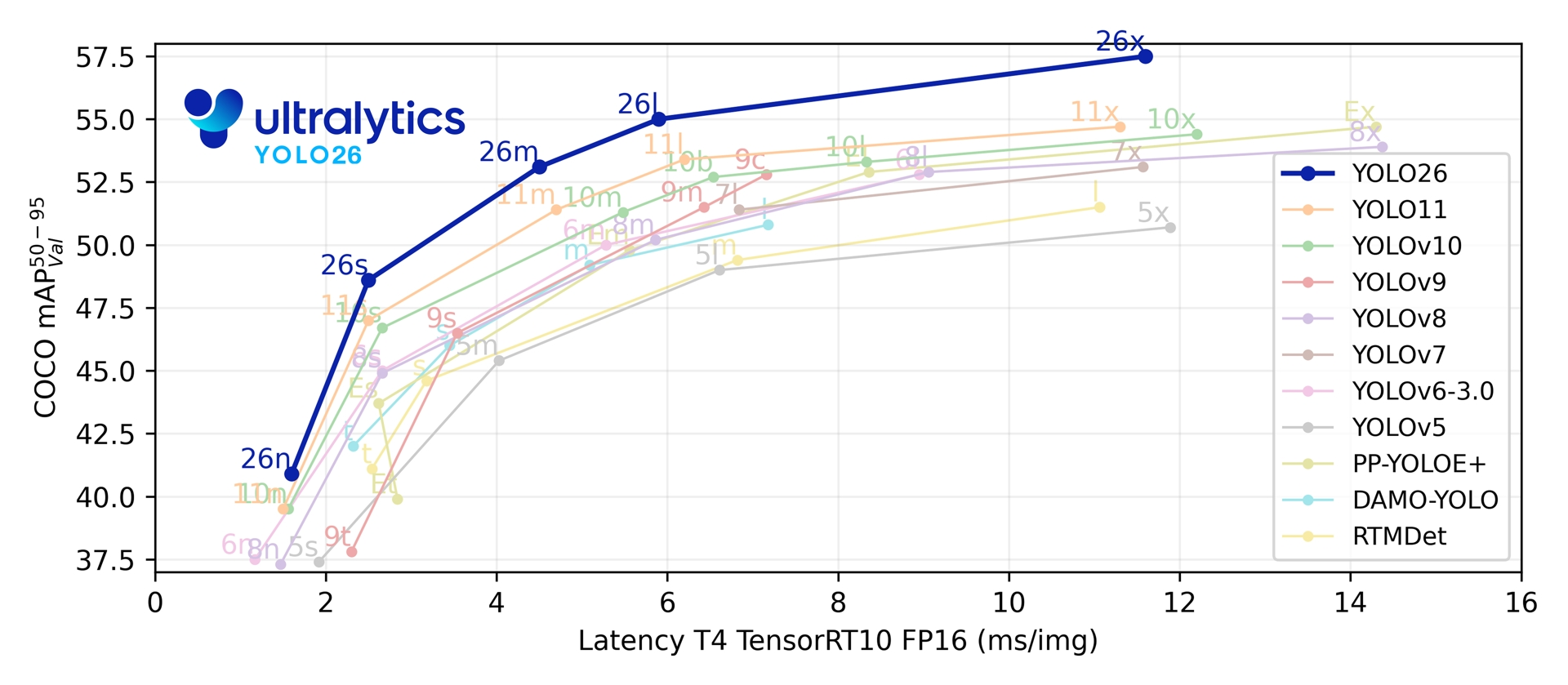

YOLO系列算法作为目标检测领域的标杆之作,其最新版本YOLO26在检测精度和推理速度方面都有了质的飞跃。YOLO26采用了先进的单阶段检测架构,能够直接从输入图像中预测目标的类别和位置,无需额外的后处理步骤,大大提高了检测效率。这种技术优势使得YOLO26非常适合应用于需要实时响应的人体姿态检测场景。本项目正是基于这一技术理念,设计并实现了一套完整的人体行为姿态智能检测系统。

从应用价值的角度来看,人体姿态检测技术的发展将推动多个领域的智能化升级。在安防监控领域,通过实时分析监控区域内人员的行为姿态,可以及时发现异常行为如摔倒、斗殴等在很大程度上提升安防系统的预警能力。在体育训练领域,对运动员的动作姿态进行精准分析,可以帮助教练发现训练中的问题,优化训练方案,提高训练效率。在智能家居领域,通过识别家庭成员的行为姿态,可以实现智能家电控制、老人儿童监护等功能。在医疗健康领域,监测患者的康复训练姿态,可以确保训练动作的准确性和安全性。

源码下载与效果演示

哔哩哔哩视频下方观看:

包含:

📦完整项目源码

📦 预训练模型权重

🗂️ 数据集地址(含标注脚本)

检测类别与数据集

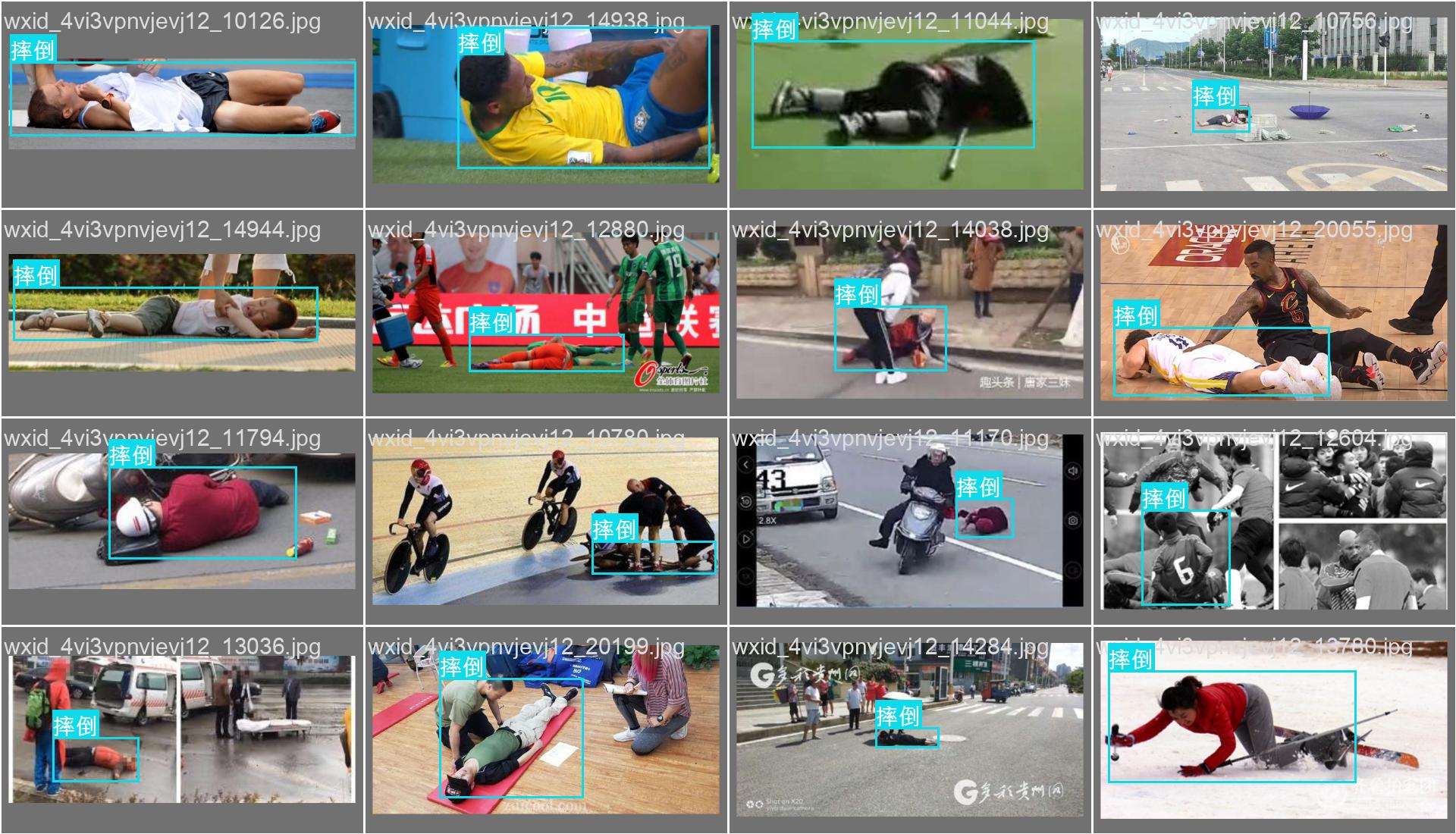

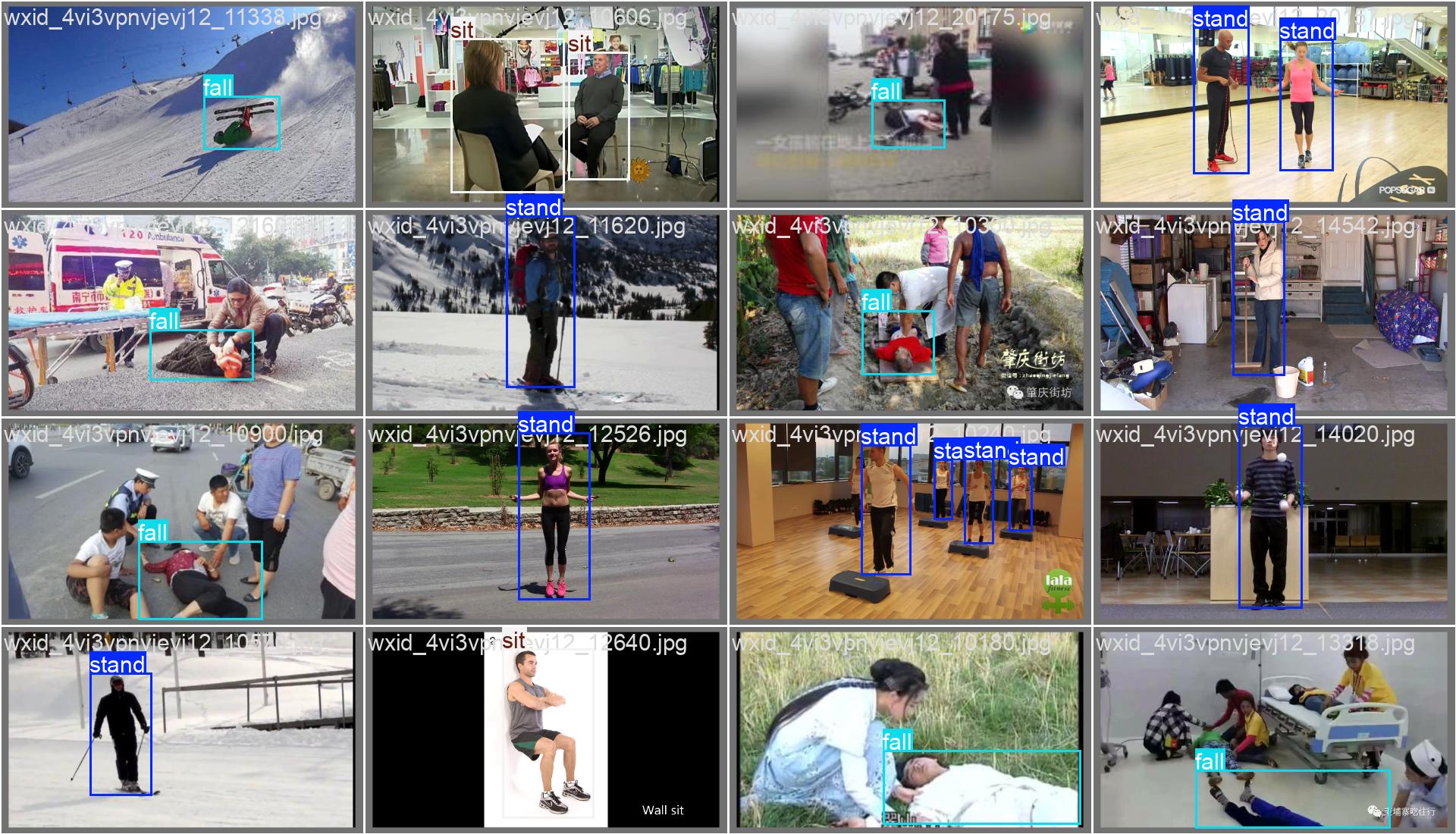

本系统聚焦于五种基本的人体行为姿态识别,这五种姿态基本涵盖了日常生活和工作中最常见的人体形态。站立姿态是最基本的站立状态,反映人体保持直立的状态。跌倒姿态是指人体失去平衡后倒地的状态,这种状态在老人看护、安全监控等场景中具有重要的检测价值。坐姿是人体坐在椅子或地面上的状态,在办公场景、居家场景中都很常见。深蹲姿态是一种特殊的屈膝动作,在健身训练、工厂作业等场景中时有出现。跑步姿态是人体处于快速移动的状态,在体育训练、安全监控等领域具有识别需求。

这五种姿态的划分既考虑了日常生活的覆盖面,也兼顾了实际应用的需求。通过对这五种姿态的识别,系统可以广泛应用于安防监控、健康管理、体育训练等多种场景。数据集的设计充分考虑了样本的多样性和平衡性,确保模型能够学习到各种姿态的典型特征。

在数据集组织方面,系统采用了标准化的目录结构。训练集用于模型参数的学习,验证集用于训练过程中的模型选择和超参数调优。数据集的组织结构清晰,标注准确,为模型的训练和评估提供了良好的基础。每一张图像都经过了精确的人工标注,确保了标注的质量和可靠性。

项目主要工作内容

在数据集构建与预处理方面,项目团队收集并整理了大量包含不同人体姿态的图像数据。这些数据涵盖了室内外多种环境、不同光照条件、不同拍摄角度的情况。在数据预处理阶段,进行了数据清洗,去除了质量较差或标注不准确的样本。然后对数据进行了增强处理,包括随机翻转、随机缩放、随机裁剪、色彩抖动等操作。这些增强技术有效扩充了训练数据的多样性,提高了模型的泛化能力。

在模型选择与配置方面,经过深入的技术调研和对比分析,最终选择了YOLO26作为基础检测模型。YOLO26是YOLO系列的最新版本,采用了更加先进的网络结构和训练策略。针对人体行为姿态检测的特点,对模型进行了针对性的配置和调整,包括网络结构、损失函数、激活函数等方面。这种定制化的配置使得模型能够更好地适应姿态检测的任务需求。

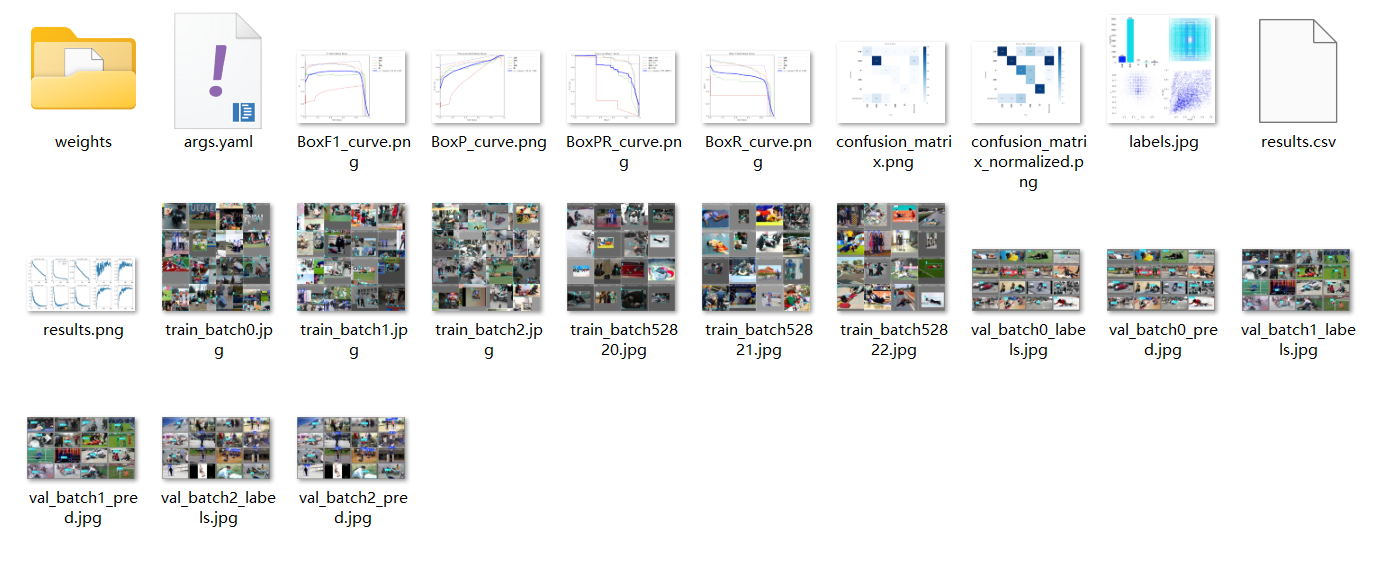

在模型训练与优化方面,使用构建好的数据集对YOLO26模型进行了充分的训练。训练过程中采用了多种优化策略,包括学习率调度、数据增强、早停机制等。学习率调度采用了余弦退火策略,使得模型在训练后期能够更精细地收敛。数据增强显著提高了模型的泛化能力。早停机制有效防止了过拟合现象。训练完成后,模型在验证集上取得了良好的检测性能。

在模型评估与部署方面,使用独立的测试集对训练好的模型进行了全面的性能评估。评估指标包括平均精度均值、精确率、召回率等多项指标。评估结果表明,模型能够准确识别各种人体姿态,具有较高的实用价值。随后将模型部署到了实际应用场景中进行了测试,验证了系统的稳定性和可靠性。

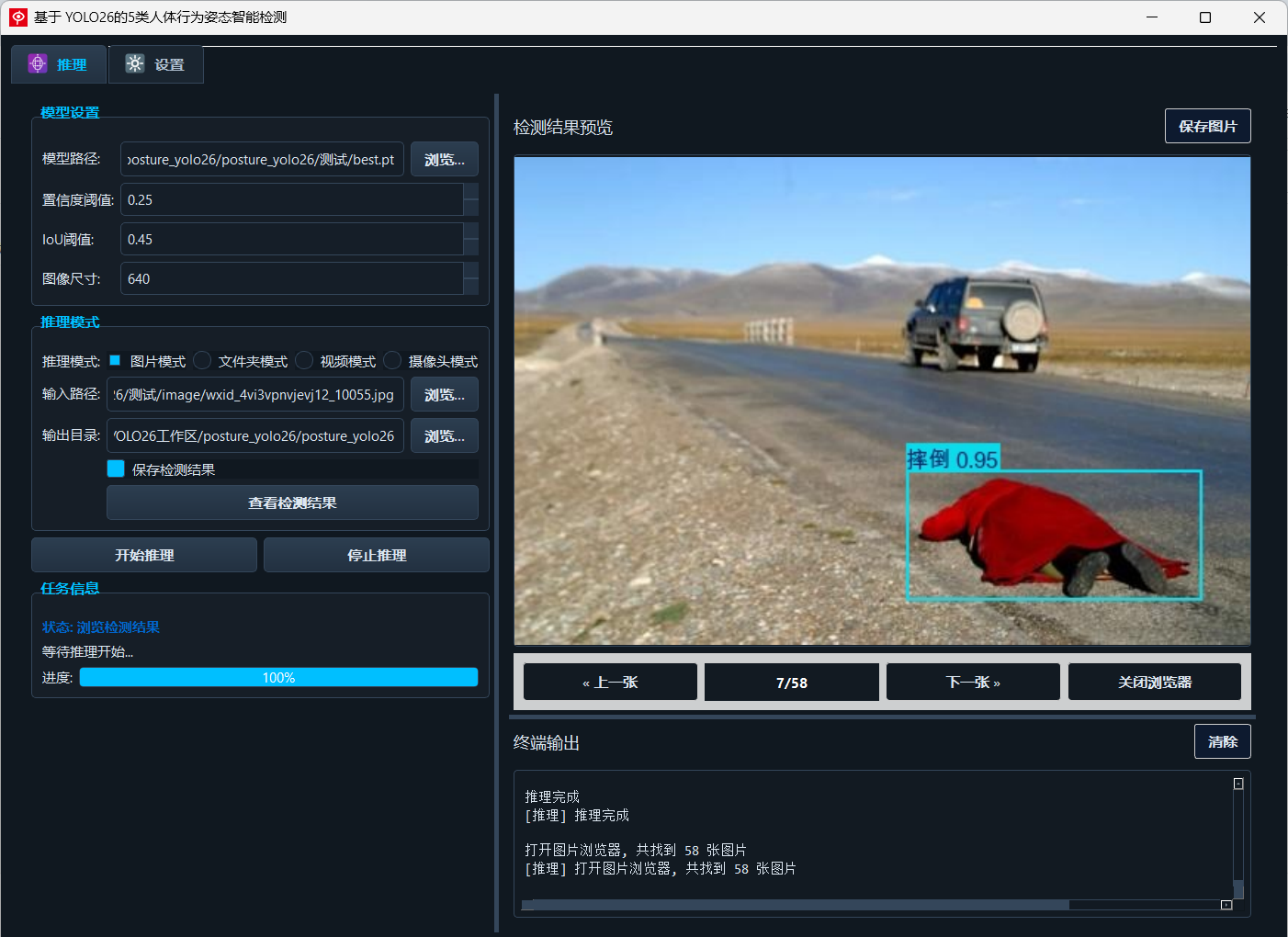

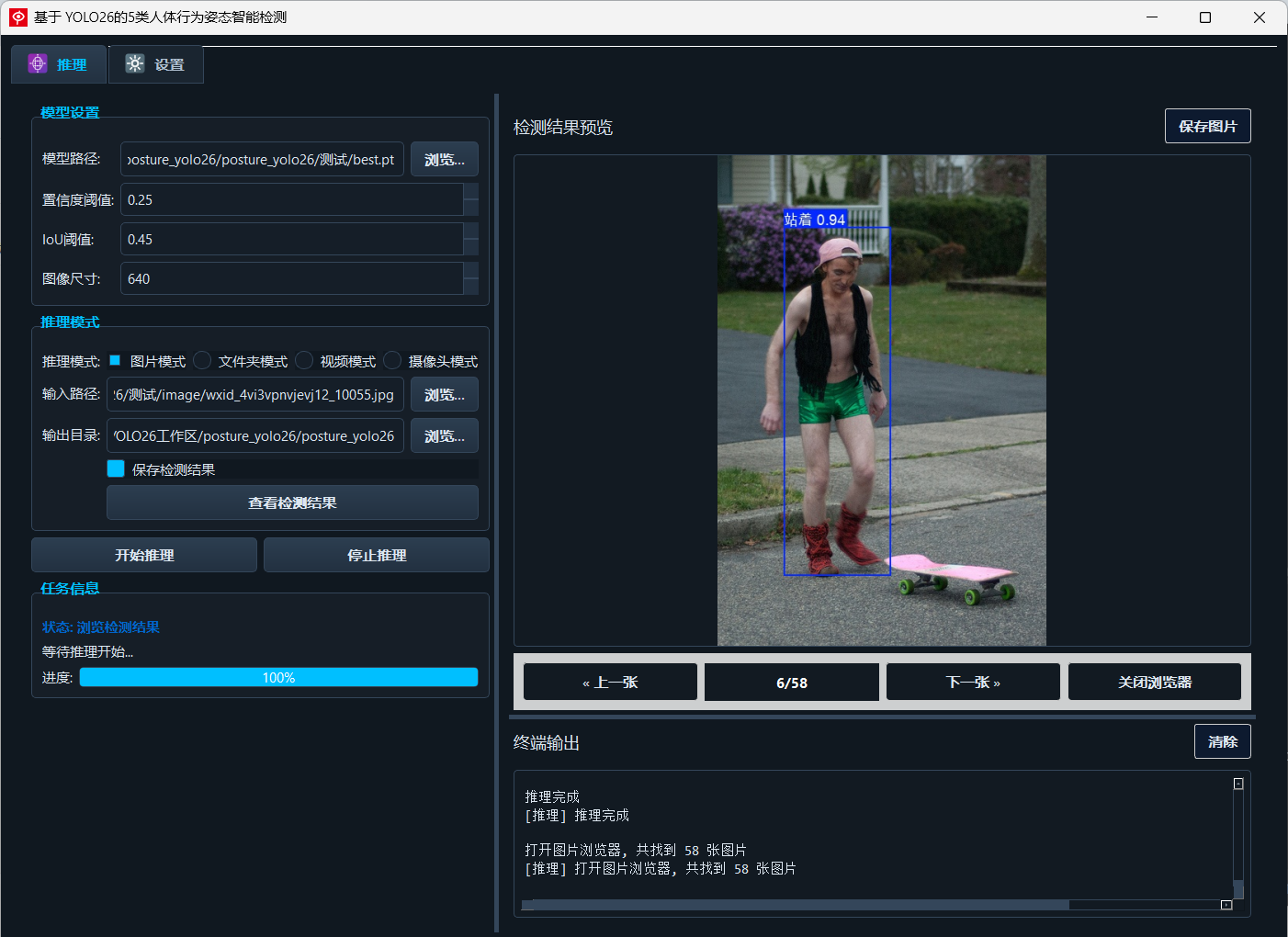

在系统集成与测试方面,将训练好的模型集成到了完整的人体行为姿态检测系统中。系统支持多种输入源,包括静态图像、视频文件和实时摄像头流。检测结果通过可视化界面进行展示,包含了边界框标注、姿态类别标签和置信度分数。系统还提供了结果保存和导出功能,便于后续的数据分析。

国内外技术发展现状

人体行为姿态检测是计算机视觉领域的热点研究方向,国内外学者在这一领域进行了大量的研究工作。早期研究主要使用传统计算机视觉方法,如基于梯度直方图特征、尺度不变特征变换等手工设计的特征,结合支持向量机、随机森林等机器学习分类器进行姿态识别。这些方法在简单场景下能够取得一定效果,但在复杂环境中的泛化能力有限。

随着深度学习技术的快速发展,基于卷积神经网络的姿态检测方法逐渐成为主流。早期的方法主要使用AlexNet、VGG等经典网络结构提取图像特征,然后进行姿态分类。这些方法相比传统方法有了显著提升,但仍存在特征表达能力有限的问题。随后出现了基于R-CNN系列的两阶段检测方法,通过区域提议网络先定位人体区域,然后在感兴趣区域内进行检测,检测精度有了进一步提高,但计算复杂度较高。

近年来,单阶段检测方法如YOLO、SSD等因其高效的检测速度而受到广泛关注。YOLO系列算法在人体行为姿态检测领域得到了广泛应用。YOLOv3引入了多尺度预测和特征金字塔网络,提升了对小目标的检测能力。YOLOv4和YOLOv5在网络架构和训练策略上进行了多项创新,进一步平衡了检测精度和速度。后续版本YOLOv6、YOLOv7、YOLOv8持续优化,性能不断提升。

最新的YOLO26算法采用了更加先进的网络结构设计,在检测精度和推理速度方面都有显著提升。该算法使用了更深的网络层数和更高效的特征提取模块,能够更好地捕捉图像中的细节信息和语义信息。同时,YOLO26还引入了先进的训练策略和损失函数设计,提高了模型的收敛速度和检测性能。

在人体关键点检测方面,OpenPose、AlphaPose等方法首先检测人体的关键点如头部、肩膀、肘部、膝盖等,然后根据关键点的位置关系进行姿态分析。这种方法可以获得较为精细的姿态信息,但计算复杂度较高。此外,基于视频序列的方法利用LSTM、GRU等循环神经网络或3D卷积神经网络,对连续的帧序列进行建模,可以捕捉姿态的时序变化信息。

环境配置与部署指南

在硬件环境方面,系统对计算机硬件有一定的要求。为了获得理想的训练和推理性能,推荐使用以下配置。GPU方面,建议使用至少8GB显存的显卡,如NVIDIA GeForce RTX 3060或更高型号。CPU方面,建议使用Intel i5或更高型号的处理器。内存方面,建议至少16GB RAM。这些配置可以满足大多数应用场景的需求,如果需要处理更高分辨率的图像或更复杂的场景,可以相应提升硬件配置。

在软件环境方面,系统对软件栈有明确的要求。操作系统建议使用Windows或Linux等主流操作系统。Python版本需要3.8或更高版本。PyTorch深度学习框架需要1.8或更高版本。CUDA计算平台需要10.2或更高版本以支持GPU加速。此外,还需要安装OpenCV、NumPy、Pillow等常用的Python库。

git clone <项目代码仓库>

cd <项目目录>

pip install -r requirements.txt

在部署步骤方面,首先需要克隆项目代码到本地,然后进入项目目录安装依赖包。数据集需要放置在指定的目录下,并确保目录结构符合要求。模型训练使用提供的训练脚本,可以根据需要调整训练参数。训练完成后,将最佳的模型权重保存到指定位置。推理使用训练好的模型权重,可以对图像、视频或摄像头输入进行检测。

python train.py --data posture_datasets/data.yaml --cfg models/yolo26.yaml --weights '' --batch-size 16

python val.py --data posture_datasets/data.yaml --weights runs/train/exp/weights/best.pt

python detect.py --source <测试图片或视频路径> --weights runs/train/exp/weights/best.pt

系统技术特色

本系统在技术实现上具有多方面的优势和特色。首先,系统采用了最新的YOLO26作为基础模型,这是目标检测领域的最新研究成果。YOLO26使用了更先进的网络结构和训练策略,在检测精度和速度方面都有显著提升。与传统的两阶段检测方法相比,YOLO26的单阶段检测架构大大简化了检测流程,提高了检测效率。

其次,系统采用了单阶段检测架构,这是其与传统两阶段检测方法的主要区别。传统的两阶段方法需要先检测人体区域,然后在区域内进行姿态分析,计算复杂度较高。而YOLO26直接从图像中预测姿态类别,省去了中间的繁琐步骤,大大保持了较高的检测精度。

第三,系统采用了多种数据增强策略。提高了检测速度,同时数据增强是提高模型泛化能力的重要手段,系统在训练过程中使用了随机翻转、随机缩放、随机旋转、色彩抖动等多种增强技术。这些技术有效扩充了训练数据的多样性,使得模型能够适应各种实际环境条件。

第四,系统采用了先进的模型优化技术。学习率调度技术帮助模型在不同训练阶段采用合适的学习率,加速收敛过程。批量归一化技术稳定了训练过程,提高了模型的泛化能力。早停技术防止了过拟合现象。这些优化技术的综合应用,使得模型能够达到最佳的检测性能。

第五,系统具备优秀的实时检测能力。YOLO26的推理速度快,能够实现实时人体行为姿态检测,满足实际应用的需求。系统可以在毫秒级的时间内完成单帧图像的检测,支持流畅的实时视频分析。

第六,系统具有较强的多场景适应性。经过充分训练和优化,模型在不同场景下都能保持较好的检测性能。无论是在室内还是室外、明亮还是昏暗、简单还是复杂的环境中,系统都能够稳定工作。

系统架构设计

整个系统的架构设计遵循了模块化和可扩展的原则,将整个检测流程划分为多个相互协作的功能模块。输入图像首先经过预处理模块进行尺寸调整和格式转换,然后送入YOLO26模型进行特征提取和姿态预测。特征提取模块负责从输入图像中提取多尺度的特征信息,这些特征包含了图像的纹理、形状、语义等多维度信息。姿态预测模块基于提取的特征预测目标的位置和类别。结果输出模块将检测结果以可视化的形式展示给用户。异常行为告警模块对检测到的异常姿态进行告警提示。

这种架构设计的优势在于各模块职责清晰,便于独立开发和测试。同时,模块之间通过标准接口进行数据交换,使得系统的扩展和维护更加方便。未来可以根据需要添加新的功能模块,如多目标跟踪、行为预测等,而无需对现有架构进行大规模修改。

典型应用场景

智能安防监控是本系统最重要的应用领域之一。在家庭、办公室、商场、银行等场所部署人体姿态检测系统,可以实时监测区域内人员的行为状态。当检测到跌倒等异常姿态时,系统可以立即发出警报,通知相关人员进行处理。这种应用在老人看护、独居安全保障等场景中具有特别重要的价值。在公共场所,系统还可以用于检测斗殴、异常聚集等行为,为公共安全管理提供技术支撑。

体育训练是另一个重要的应用方向。在健身房、体育馆、训练基地等场所,可以使用姿态检测系统对运动员的动作进行实时分析。系统可以识别运动员的跑步姿态、深蹲姿态等,分析动作的准确性和规范性。教练可以根据这些数据进行针对性的指导,帮助运动员改进技术动作,提高训练效果。此外,系统还可以用于动作评分、自动裁判等应用。

智能家居领域也是姿态检测技术的重要应用场景。在智能家居环境中,系统可以识别家庭成员的行为姿态,据此提供个性化的服务。例如,当系统检测到老人跌倒时,可以自动拨打急救电话;当检测到婴儿哭闹时,可以自动调亮灯光或播放安抚音乐。这种无接触式的感知方式既便捷又保护了用户隐私。

医疗康复领域同样可以受益于姿态检测技术。在康复训练过程中,系统可以监测患者的训练姿态,确保动作的准确性和安全性。医护人员可以根据系统的反馈及时调整康复方案。对于行动不便的患者,系统还可以用于日常活动监测,如检测长时间卧床不起、起立困难等情况,及时发现健康风险。

技术总结与未来展望

本文详细介绍了基于YOLO26的人体行为姿态智能检测系统的设计与实现。该系统采用最新的YOLO26目标检测算法,实现了对站立、跌倒、坐、深蹲、跑步等五种人体姿态的实时检测。系统的技术特点主要体现在以下几个方面:

在检测精度方面,系统采用了先进的YOLO26模型,并结合数据增强和模型优化技术,显著提高了检测精度。模型能够准确识别各种姿态,具有较低的误检率和漏检率。

在实时性方面,YOLO26的单阶段检测架构和优化的推理流程,使得系统具备优秀的实时检测能力。系统可以实时处理视频流,满足实际应用对响应速度的要求。

在适应性方面,系统在多种场景下都能保持稳定的检测性能。无论是在室内还是室外、光明还是黑暗、简单还是复杂的环境中,系统都能够可靠工作。

在易用性方面,系统的安装和部署过程相对简单,提供了友好的用户界面和丰富的配置选项。非技术背景的用户也能轻松上手使用。

展望未来,项目团队将在以下几个方向进行深入研究和开发。在检测精度方面,将继续优化模型结构和训练策略,进一步提高检测精度和鲁棒性。在姿态类别方面,将扩展检测的行为类别,增加更多的日常动作,如行走、弯腰、跳跃等。在时序分析方面,将引入视频时序信息,利用连续帧之间的相关性提高检测的准确性。在多模态融合方面,将结合其他传感器如深度相机、惯性传感器等的数据,提供更全面的感知能力。在应用拓展方面,将探索更多的实际应用场景,推动技术的落地应用。

人体行为姿态智能检测技术在智能安防、体育训练、智能家居、医疗康复等领域具有广阔的发展前景。随着深度学习技术的不断进步和计算资源的日益丰富,基于视觉的人体姿态检测将在更多领域发挥重要作用。我们相信,这项技术将为人们的生活带来更多便利和安全。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)