DSIN(深度会话兴趣网络)

在推荐系统和在线广告的 CTR(点击率)预测任务中,捕捉用户动态变化的兴趣是提升模型效果的核心。传统模型虽能利用用户行为序列建模兴趣,但忽略了行为序列的会话内在结构—— 用户行为在单个会话内高度同质,跨会话则呈现异质性。阿里团队于 2019 年提出的Deep Session Interest Network (DSIN) 深度会话兴趣网络,首次将用户行为序列按会话划分,从会话粒度建模用户兴趣的提取、演化与激活。

在推荐系统和在线广告的 CTR(点击率)预测任务中,捕捉用户动态变化的兴趣是提升模型效果的核心。传统模型虽能利用用户行为序列建模兴趣,但忽略了行为序列的会话内在结构—— 用户行为在单个会话内高度同质,跨会话则呈现异质性。阿里团队于 2019 年提出的Deep Session Interest Network (DSIN) 深度会话兴趣网络,首次将用户行为序列按会话划分,从会话粒度建模用户兴趣的提取、演化与激活。

原文链接:https://arxiv.org/pdf/1905.06482

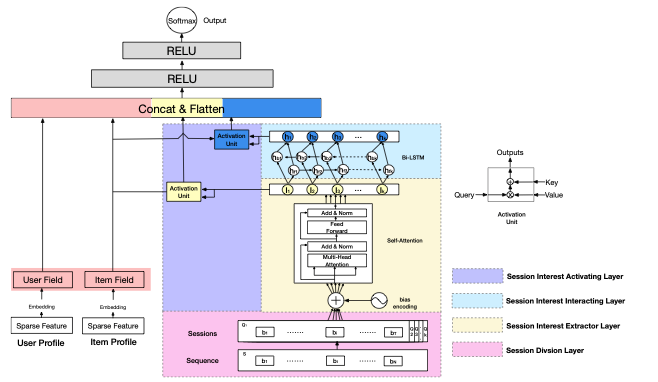

先总结一下:DSIN 先将用户历史行为序列按时间间隔划分为多个会话,再通过带偏置编码的多头自注意力提取每个会话的核心兴趣表示,接着用 Bi-LSTM 捕捉会话间兴趣的动态演化与上下文关联,然后通过局部激活单元针对目标物品自适应为不同会话兴趣分配权重并得到激活后的兴趣表示,最后将该表示与用户、物品画像的嵌入特征拼接,送入 MLP 完成 CTR 预测。

一、背景

1. CTR 预测的核心痛点

推荐系统的候选排序阶段本质是 CTR 预测,用户的历史行为序列是建模用户兴趣的关键依据。但传统序列建模方法(如 DIN、DIEN)将行为序列视为整体,存在两个核心问题:

- 行为序列存在噪声和不连续性:用户行为可能因时间间隔、场景变化出现兴趣跳变,整体建模会混淆用户真实兴趣;

- 忽略了行为的会话结构:用户在连续短时间内的行为通常围绕单一兴趣展开(如 30 分钟内连续浏览裤子),不同时间间隔的行为则对应不同兴趣(如后续浏览戒指、外套),这种天然的会话划分未被利用。

DSIN 的核心思路是:将用户行为序列划分为多个会话,先提取每个会话的核心兴趣,再建模会话间兴趣的演化关系,最后针对目标物品自适应激活相关会话兴趣。

二、模型整体架构

DSIN 基于基础 CTR 模型(BaseModel)扩展,核心是对用户行为序列的四层精细化处理,整体架构分为两部分:用户 / 物品特征嵌入 + 行为序列的会话化处理,最终将所有特征拼接后送入 MLP 完成 CTR 预测。

模型的核心流程为:会话划分层 → 会话兴趣提取层 → 会话兴趣交互层 → 会话兴趣激活层 → MLP 预测层

基础模型(BaseModel)

作为 DSIN 的基础,BaseModel 定义了 CTR 预测的通用特征和训练框架:

- 特征类型:用户画像(性别、城市等)、物品画像(商家 ID、品牌 ID 等)、用户行为(历史点击物品 ID);

- 嵌入层:将高维稀疏特征映射为低维稠密向量,统一嵌入维度为dmodel;

- MLP 与损失函数:拼接所有嵌入特征后送入 MLP,采用负对数似然损失作为训练损失,预测用户点击的概率。

其中y∈{0,1}表示用户是否点击,p(x)为模型预测的点击概率。

其中y∈{0,1}表示用户是否点击,p(x)为模型预测的点击概率。

三、DSIN 核心四层设计

1. 会话划分层(Session Division Layer)

核心目标:将用户的历史行为序列按时间间隔划分为多个独立会话,为后续会话粒度的兴趣提取做准备。

- 划分规则:以30 分钟为时间阈值,相邻行为的时间间隔超过 30 分钟则划分为不同会话(参考 Airbnb 的会话划分方法);

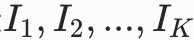

- 符号定义:用户原始行为序列

,划分为K个会话

,划分为K个会话 ,其中第k个会话

,其中第k个会话 ,T为该会话内的行为数量。

,T为该会话内的行为数量。

这一步的核心是剥离行为序列的噪声,让每个会话对应用户的一个独立核心兴趣。

2. 会话兴趣提取层(Session Interest Extractor Layer)

核心目标:提取每个会话的核心兴趣表示,捕捉会话内行为的内在关联,降低无关行为的干扰。该层是 DSIN 的核心创新之一,基于多头自注意力 + 偏置编码(Bias Encoding) 实现,相比传统自注意力,更适配推荐场景的会话建模。

(1)偏置编码(Bias Encoding):超越传统位置编码

传统自注意力的位置编码仅捕捉序列内的位置信息,而 DSIN 的偏置编码新增了会话维度和嵌入维度的偏置,全面捕捉三重信息:会话顺序、会话内行为位置、嵌入向量的维度偏置。偏置编码的定义为:

:会话偏置向量,捕捉第k个会话的全局顺序;

:会话偏置向量,捕捉第k个会话的全局顺序; :位置偏置向量,捕捉会话内第t个行为的位置;

:位置偏置向量,捕捉会话内第t个行为的位置; :维度偏置向量,捕捉嵌入向量第c维的特征偏置。

:维度偏置向量,捕捉嵌入向量第c维的特征偏置。

将偏置编码叠加到会话特征上,更新后的会话为:![]() ,让模型同时感知哪个会话、会话内哪个位置、嵌入的哪个维度的特征。

,让模型同时感知哪个会话、会话内哪个位置、嵌入的哪个维度的特征。

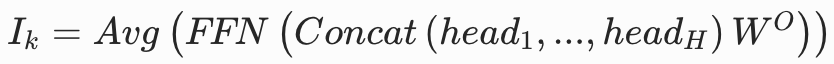

(2)多头自注意力 + 前馈网络

用户的点击行为受多种因素影响(颜色、款式、价格等),多头自注意力能在不同特征子空间捕捉会话内行为的关联,步骤为:

- 将每个会话的特征

拆分为H个头部,每个头部维度

拆分为H个头部,每个头部维度 ;

; - 对每个头部计算自注意力,捕捉该子空间的行为关联;

- 拼接所有头部的结果,送入前馈网络(FFN),并加入残差连接和层归一化,缓解梯度消失;

- 对前馈网络的输出做平均池化,得到第k个会话的核心兴趣表示

。

。

关键设计:不同会话的自注意力权重共享,让模型学习通用的会话兴趣提取模式,提升泛化能力。

3. 会话兴趣交互层(Session Interest Interacting Layer)

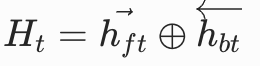

核心目标:建模会话间兴趣的动态演化和顺序关系,捕捉用户兴趣的变化规律(如从 “裤子” 到 “戒指” 再到 “外套” 的兴趣跳变)。DSIN 选用双向 LSTM(Bi-LSTM) 实现该目标,原因是 Bi-LSTM 能同时捕捉前向(从过去到现在)和后向(从现在到过去)的会话兴趣关联,相比单向 LSTM 更全面。

Bi-LSTM 的计算过程

- 将每个会话的兴趣表示

依次输入 Bi-LSTM,得到前向隐藏状态

依次输入 Bi-LSTM,得到前向隐藏状态 和后向隐藏状态

和后向隐藏状态 ;

; - 拼接前向和后向隐藏状态,得到融合上下文的会话兴趣表示

其中

其中 既包含当前会话的兴趣,也包含前后会话的上下文信息,刻画了用户兴趣的演化过程。

既包含当前会话的兴趣,也包含前后会话的上下文信息,刻画了用户兴趣的演化过程。

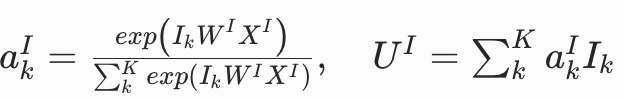

4. 会话兴趣激活层(Session Interest Activating Layer)

核心目标:针对目标物品,自适应分配不同会话兴趣的权重 —— 与目标物品相关的会话兴趣赋予更高权重,无关的则降低权重,实现兴趣的精准激活。该层借鉴了 DIN 的注意力机制,但将注意力粒度从单个行为提升到整个会话,分为两步:

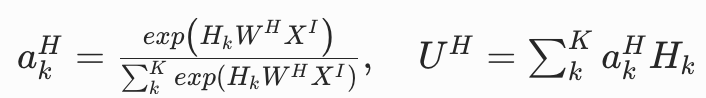

(1)原始会话兴趣的激活

对未融合上下文的会话兴趣![]() ,计算其与目标物品嵌入

,计算其与目标物品嵌入![]() 的相似度,通过 softmax 归一化得到注意力权重,加权求和得到激活后的会话兴趣表示

的相似度,通过 softmax 归一化得到注意力权重,加权求和得到激活后的会话兴趣表示![]() :

:

(2)融合上下文的会话兴趣的激活

对 Bi-LSTM 输出的融合上下文的会话兴趣![]() ,采用相同的注意力机制,得到激活后的表示

,采用相同的注意力机制,得到激活后的表示

最终特征拼接

将用户画像嵌入、目标物品嵌入、![]() 、

、![]() 拼接为一个稠密向量,送入 MLP 完成最终的 CTR 预测。

拼接为一个稠密向量,送入 MLP 完成最终的 CTR 预测。

四、创新

- 提出了会话粒度的 CTR 建模范式:首次明确指出用户行为的 “会话内同质性、跨会话异质性”,将行为序列按会话划分,从根本上解决了传统序列建模的噪声和不连续性问题;

- 设计了偏置编码(Bias Encoding):超越传统位置编码,新增会话和嵌入维度的偏置,让模型更全面地捕捉会话序列的特征信息;

- 构建了端到端的会话兴趣建模流程:从会话划分→兴趣提取→兴趣演化→兴趣激活,形成了一套完整的会话粒度兴趣建模方法,为后续 CTR 预测的序列建模提供了新思路;

- 工业级验证:在 2600 万条的广告数据集和 60 亿条的阿里内部推荐数据集上均取得 SOTA 效果,证明了模型的工业实用性,可直接落地到实际推荐系统中。

五、总结

模型总结

DSIN 的核心是从会话角度重新定义用户行为序列,将传统的 “行为级” 兴趣建模提升到 “会话级”,通过 “划分 - 提取 - 演化 - 激活” 四层设计,精准捕捉用户的核心兴趣及其动态演化规律。相比传统模型,DSIN 的优势在于:

- 更贴合用户真实行为:会话划分符合用户的实际操作习惯,剥离了行为噪声;

- 更精准的兴趣建模:从会话粒度提取兴趣,避免了单个行为的偶然性;

- 更自适应的兴趣激活:针对目标物品激活相关会话,提升了 CTR 预测的精准度。

未来研究方向

原论文提出了 DSIN 的后续优化方向,也为 CTR 预测的研究提供了思路:

- 融合知识图谱:将商品的知识图谱作为先验知识,解释用户的会话行为,进一步提升兴趣建模的可解释性;

- 动态会话划分:目前采用固定的 30 分钟时间阈值,未来可研究自适应的动态会话划分方法,根据用户行为特征调整阈值;

- 多粒度兴趣融合:融合 “行为级”、“会话级”、“长期兴趣级” 的多粒度特征,更全面地建模用户兴趣;

- 轻量化改进:DSIN 包含自注意力和 Bi-LSTM,计算量较大,未来可通过模型压缩、轻量化设计,提升其在实时推荐系统中的推理速度。

七、适用

- 适用于电商、广告、短视频等多场景:只要存在用户行为序列的场景,均可通过会话划分提升 CTR 预测效果;

- 兼容现有推荐系统框架:DSIN 基于基础 CTR 模型扩展,可直接嵌入到现有的推荐系统候选排序阶段,无需重构整体框架;

- 提升推荐精准度和用户体验:通过精准建模用户会话兴趣,让推荐结果更贴合用户的实时需求,减少无效推荐,提升用户点击和转化。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)